OpenAI Whisper הוא דגם מתקדם של זיהוי דיבור אוטומטי (ASR) עם רישיון MIT. טכנולוגיית ASR מוצאת שימוש בשירותי תמלול, עוזרות קוליות ושיפור הנגישות לאנשים עם לקות שמיעה. מודל חדשני זה מאומן על מערך נתונים עצום ומגוון של נתונים רב-לשוניים ומרובי משימות בפיקוח שנאסף מהאינטרנט. הדיוק וההתאמה הגבוהים שלו הופכים אותו לנכס יקר ערך עבור מגוון רחב של משימות הקשורות לקול.

בנוף ההולך ומתפתח של למידת מכונה ובינה מלאכותית, אמזון SageMaker מספק מערכת אקולוגית מקיפה. SageMaker מעצימה מדעני נתונים, מפתחים וארגונים לפתח, לאמן, לפרוס ולנהל מודלים של למידת מכונה בקנה מידה. מציע מגוון רחב של כלים ויכולות, הוא מפשט את כל זרימת העבודה של למידת מכונה, מעיבוד מוקדם של נתונים ופיתוח מודלים ועד לפריסה וניטור ללא מאמץ. הממשק הידידותי למשתמש של SageMaker הופך אותה לפלטפורמה מרכזית למיצוי מלוא הפוטנציאל של AI, ומבססת אותה כפתרון משנה משחק בתחום הבינה המלאכותית.

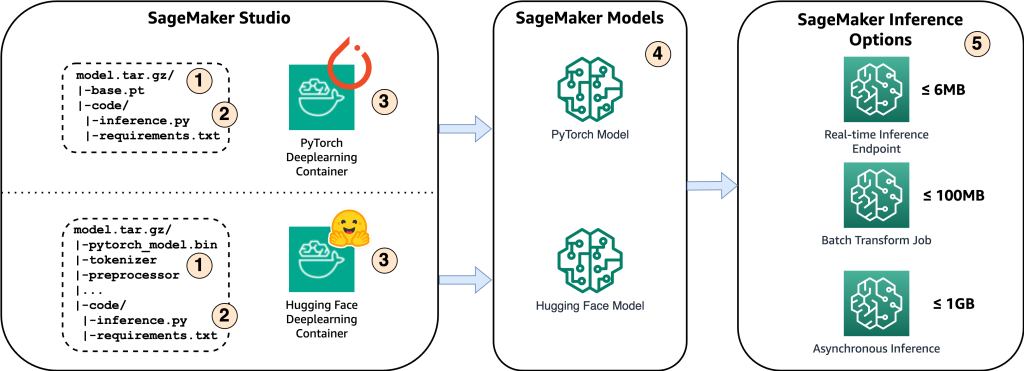

בפוסט זה, אנו מתחילים בחקירה של היכולות של SageMaker, תוך התמקדות ספציפית באירוח דגמי Whisper. נצלול עמוק לשתי שיטות לעשות זאת: האחת משתמשת במודל Whisper PyTorch והשנייה משתמשת ביישום Hugging Face של מודל Whisper. בנוסף, נערוך בחינה מעמיקה של אפשרויות ההסקה של SageMaker, ונשווה אותן בין פרמטרים כמו מהירות, עלות, גודל מטען ומדרגיות. ניתוח זה מאפשר למשתמשים לקבל החלטות מושכלות בעת שילוב דגמי Whisper במקרי השימוש והמערכות הספציפיות שלהם.

סקירת פתרונות

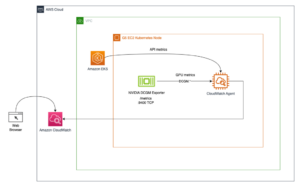

התרשים הבא מציג את המרכיבים העיקריים של פתרון זה.

- על מנת לארח את הדגם באמזון SageMaker, הצעד הראשון הוא לשמור את חפצי הדגם. חפצים אלה מתייחסים למרכיבים החיוניים של מודל למידת מכונה הדרושים ליישומים שונים, כולל פריסה והכשרה מחדש. הם יכולים לכלול פרמטרים של מודל, קובצי תצורה, רכיבי עיבוד מקדים, כמו גם מטא נתונים, כגון פרטי גרסה, מחבר וכל הערה הקשורה לביצועים שלה. חשוב לציין שדגמי Whisper עבור יישומי PyTorch ו-Huging Face מורכבים מחפצי מודל שונים.

- לאחר מכן, אנו יוצרים תסריטי מסקנות מותאמים אישית. בתוך סקריפטים אלו, אנו מגדירים כיצד יש לטעון את המודל ומציינים את תהליך ההסקה. זה גם המקום שבו נוכל לשלב פרמטרים מותאמים אישית לפי הצורך. בנוסף, אתה יכול לרשום את חבילות Python הנדרשות ב-a

requirements.txtקוֹבֶץ. במהלך פריסת הדגם, חבילות Python אלו מותקנות אוטומטית בשלב האתחול. - לאחר מכן אנו בוחרים את מיכלי הלמידה העמוקים של PyTorch או Hugging Face (DLC) המסופקים ומתוחזקים על ידי AWS. קונטיינרים אלה הם תמונות Docker שנבנו מראש עם מסגרות למידה עמוקות וחבילות Python נחוצות אחרות. למידע נוסף, תוכל לבדוק זאת קישור.

- עם חפצי המודל, סקריפטים מותאמים אישית ו-DLC נבחרים, ניצור דגמי אמזון SageMaker עבור PyTorch ו-Huging Face בהתאמה.

- לבסוף, ניתן לפרוס את המודלים ב- SageMaker ולהשתמש בהם עם האפשרויות הבאות: נקודות קצה בזמן אמת, עבודות טרנספורמציה של אצווה ונקודות קצה אסינכרוניות. נצלול לאפשרויות אלו ביתר פירוט בהמשך הפוסט הזה.

המחברת והקוד לדוגמה עבור פתרון זה זמינים בנושא זה מאגר GitHub.

איור 1. סקירה כללית של רכיבי פתרון מרכזיים

Walkthrough

אירוח את דגם Whisper ב- Amazon SageMaker

בסעיף זה, נסביר את השלבים לאירוח דגם Whisper באמזון SageMaker, באמצעות PyTorch ו-Huging Face Frameworks, בהתאמה. כדי להתנסות בפתרון זה, אתה צריך חשבון AWS וגישה לשירות Amazon SageMaker.

מסגרת PyTorch

- שמור חפצי דגם

האפשרות הראשונה לארח את המודל היא להשתמש ב- חבילת Python הרשמית של Whisper, שניתן להתקין באמצעות pip install openai-whisper. חבילה זו מספקת דגם PyTorch. בעת שמירת חפצי מודל במאגר המקומי, הצעד הראשון הוא לשמור את הפרמטרים הניתנים ללמידה של המודל, כגון משקלי מודל והטיות של כל שכבה ברשת העצבית, כקובץ 'pt'. אתה יכול לבחור בין גדלים שונים של דגמים, כולל 'קטנטן', 'בסיס', 'קטן', 'בינוני' ו'גדול'. גדלים של דגמים גדולים יותר מציעים ביצועי דיוק גבוהים יותר, אך באים במחיר של חביון מסקנות ארוך יותר. בנוסף, עליך לשמור את מילון מצב המודל ואת מילון המימדים, המכילים מילון Python הממפה כל שכבה או פרמטר של מודל PyTorch לפרמטרים הניתנים ללמידה המתאימים לו, יחד עם מטא נתונים אחרים ותצורות מותאמות אישית. הקוד שלהלן מראה כיצד לשמור את חפצי Whisper PyTorch.

- בחר DLC

השלב הבא הוא לבחור את ה-DLC המובנה מראש מתוך זה קישור. היזהר בעת בחירת התמונה הנכונה על ידי התחשבות בהגדרות הבאות: מסגרת (PyTorch), גרסת מסגרת, משימה (הסקת מסקנות), גרסת Python וחומרה (כלומר, GPU). מומלץ להשתמש בגרסאות העדכניות ביותר למסגרת ול-Python במידת האפשר, מכיוון שהדבר מביא לביצועים טובים יותר ומטפל בבעיות ידועות ובאגים מהגרסאות קודמות.

- צור דגמי אמזון SageMaker

לאחר מכן, אנו משתמשים ב- SageMaker Python SDK כדי ליצור מודלים של PyTorch. חשוב לזכור להוסיף משתני סביבה בעת יצירת מודל PyTorch. כברירת מחדל, TorchServe יכול לעבד גדלי קבצים של עד 6MB בלבד, ללא קשר לסוג ההסקה המשמש.

הטבלה הבאה מציגה את ההגדרות עבור גרסאות PyTorch שונות:

| מסגרת | משתני סביבה |

| PyTorch 1.8 (מבוסס על TorchServe) | "TS_MAX_REQUEST_SIZE': '100000000'" TS_MAX_RESPONSE_SIZE': '100000000'" TS_DEFAULT_RESPONSE_TIMEOUT': '1000' |

| PyTorch 1.4 (מבוסס על MMS) | "MMS_MAX_REQUEST_SIZE': '1000000000'" MMS_MAX_RESPONSE_SIZE': '1000000000'" MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- הגדר את שיטת טעינת המודל ב-inference.py

במנהג inference.py סקריפט, אנו בודקים תחילה את הזמינות של GPU בעל יכולת CUDA. אם GPU כזה זמין, אנו מקצים את ה 'cuda' מכשיר אל DEVICE מִשְׁתַנֶה; אחרת, אנו מקצים את 'cpu' התקן. שלב זה מבטיח שהדגם ממוקם על החומרה הזמינה לצורך חישוב יעיל. אנו טוענים את מודל PyTorch באמצעות חבילת Whisper Python.

מסגרת מחבקת פנים

- שמור חפצי דגם

האפשרות השנייה היא להשתמש לחישה של חיבוק פנים יישום. ניתן לטעון את הדגם באמצעות AutoModelForSpeechSeq2Seq כיתת שנאים. הפרמטרים הניתנים ללמידה נשמרים בקובץ בינארי (bin) באמצעות ה- save_pretrained שיטה. יש גם לשמור את הטוקנייזר והקדם-מעבד בנפרד כדי להבטיח שדגם Hugging Face יפעל כראוי. לחלופין, אתה יכול לפרוס מודל באמזון SageMaker ישירות ממרכז החיבוק על ידי הגדרת שני משתני סביבה: HF_MODEL_ID ו HF_TASK. למידע נוסף, אנא עיין בזה דף אינטרנט.

- בחר DLC

בדומה למסגרת PyTorch, אתה יכול לבחור DLC Hugging Face בנוי מראש מאותו זה קישור. הקפד לבחור DLC התומך בשנאי Hugging Face העדכניים ביותר וכולל תמיכה ב-GPU.

- צור דגמי אמזון SageMaker

באופן דומה, אנו משתמשים ב- SageMaker Python SDK ליצירת דגמי Hugging Face. לדגם Hugging Face Whisper יש מגבלת ברירת מחדל שבה הוא יכול לעבד רק קטעי אודיו של עד 30 שניות. כדי לטפל במגבלה זו, אתה יכול לכלול את chunk_length_s פרמטר במשתנה הסביבה בעת יצירת מודל Hugging Face, ומאוחר יותר להעביר פרמטר זה לסקריפט ההסקה המותאם אישית בעת טעינת המודל. לבסוף, הגדר את משתני הסביבה כדי להגדיל את גודל המטען ואת פסק הזמן הקצוב לתגובה עבור הכלי Hugging Face.

| מסגרת | משתני סביבה |

|

מיכל מסקנות של חיבוק פנים (מבוסס על MMS) |

"MMS_MAX_REQUEST_SIZE': '2000000000'" MMS_MAX_RESPONSE_SIZE': '2000000000'" MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- הגדר את שיטת טעינת המודל ב-inference.py

בעת יצירת סקריפט מסקנות מותאם אישית עבור דגם Hugging Face, אנו משתמשים בצינור, המאפשר לנו לעבור את chunk_length_s כפרמטר. פרמטר זה מאפשר למודל לעבד ביעילות קבצי אודיו ארוכים במהלך הסקה.

בחינת אפשרויות מסקנות שונות באמזון SageMaker

השלבים לבחירת אפשרויות ההסקה זהים עבור דגמי PyTorch ו-Huging Face, כך שלא נבדיל ביניהם להלן. עם זאת, ראוי לציין שבזמן כתיבת פוסט זה, ה מסקנות ללא שרת אפשרות מ- SageMaker אינה תומכת במעבדי GPU, וכתוצאה מכך, אנו לא כוללים אפשרות זו עבור מקרה שימוש זה.

אנחנו יכולים לפרוס את המודל כנקודת קצה בזמן אמת, לספק תגובות באלפיות שניות. עם זאת, חשוב לציין כי אפשרות זו מוגבלת לעיבוד קלט מתחת ל-6 מגה-בייט. אנו מגדירים את ה-serializer כ-Serializer של אודיו, שאחראי על המרת נתוני הקלט לפורמט מתאים לדגם הנפרס. אנו משתמשים במופע GPU להסקת מסקנות, המאפשר עיבוד מואץ של קבצי אודיו. קלט ההסקה הוא קובץ שמע המגיע מהמאגר המקומי.

אפשרות ההסקה השנייה היא עבודת המרת אצווה, המסוגלת לעבד עומסי קלט של עד 100 מגה-בייט. עם זאת, שיטה זו עשויה להימשך מספר דקות של חביון. כל מופע יכול לטפל רק בבקשת אצווה אחת בכל פעם, וגם ההפעלה והכיבוי של המופע דורשים כמה דקות. תוצאות ההסקה נשמרות בשירות אחסון פשוט של אמזון (אמזון S3) דלי עם השלמת עבודת ההמרה האצווה.

בעת הגדרת שנאי האצווה, הקפד לכלול max_payload = 100 לטפל במטענים גדולים יותר ביעילות. קלט ההסקה צריך להיות הנתיב של Amazon S3 לקובץ אודיו או תיקיית Amazon S3 Bucket המכילה רשימה של קבצי אודיו, כל אחד בגודל קטן מ-100 MB.

Batch Transform מחלק את האובייקטים של Amazon S3 בקלט לפי מפתח וממפה אובייקטים של Amazon S3 למופעים. לדוגמה, כאשר יש לך קבצי שמע מרובים, מופע אחד עשוי לעבד את input1.wav, ומופע אחר עשוי לעבד את הקובץ בשם input2.wav כדי לשפר את המדרגיות. טרנספורמציה אצווה מאפשרת לך להגדיר max_concurrent_transforms כדי להגדיל את מספר בקשות ה-HTTP המבוצעות לכל מיכל שנאי בודד. עם זאת, חשוב לציין שהערך של (max_concurrent_transforms* max_payload) לא יעלה על 100 MB.

לבסוף, Amazon SageMaker Asynchronous Inference אידיאלי לעיבוד בקשות מרובות בו-זמנית, ומציע חביון מתון ותמיכה בעומסי קלט של עד 1 GB. אפשרות זו מספקת מדרגיות מצוינת, ומאפשרת הגדרה של קבוצת קנה מידה אוטומטי עבור נקודת הקצה. כאשר מתרחש גל של בקשות, הוא גדל אוטומטית כדי לטפל בתעבורה, וברגע שכל הבקשות מעובדות, נקודת הקצה מצטמצמת ל-0 כדי לחסוך בעלויות.

באמצעות הסקה אסינכרונית, התוצאות נשמרות אוטומטית בדלי של אמזון S3. בתוך ה AsyncInferenceConfig, תוכל להגדיר התראות עבור השלמות מוצלחות או נכשלות. נתיב הקלט מצביע על מיקום Amazon S3 של קובץ השמע. לפרטים נוספים, עיין בקוד על GitHub.

אופציונלי: כפי שצוין קודם לכן, יש לנו אפשרות להגדיר קבוצת קנה מידה אוטומטי עבור נקודת הסיום האסינכרונית, מה שמאפשר לה להתמודד עם עלייה פתאומית בבקשות להסקה. דוגמה לקוד מסופקת בזה מאגר GitHub. בתרשים הבא, אתה יכול לצפות בתרשים קו המציג שני מדדים מ אמזון CloudWatch: ApproximateBacklogSize ו ApproximateBacklogSizePerInstance. בתחילה, כאשר הופעלו 1000 בקשות, רק מופע אחד היה זמין לטיפול בהסקה. במשך שלוש דקות, גודל הצבר עלה בעקביות על שלוש (שימו לב שניתן להגדיר את המספרים הללו), וקבוצת ההגדלה האוטומטית הגיבה על ידי סיבוב מופעים נוספים כדי לנקות ביעילות את הצבר. זה הביא לירידה משמעותית ב ApproximateBacklogSizePerInstance, המאפשר לעבד בקשות צבר בקשות הרבה יותר מהר מאשר בשלב הראשוני.

איור 2. תרשים קו הממחיש את השינויים הזמניים במדדי Amazon CloudWatch

ניתוח השוואתי לאפשרויות ההסקה

ההשוואות עבור אפשרויות מסקנות שונות מבוססות על מקרי שימוש נפוצים בעיבוד אודיו. הסקת מסקנות בזמן אמת מציעה את מהירות ההסקה המהירה ביותר אך מגבילה את גודל המטען ל-6 MB. סוג מסקנות זה מתאים למערכות פקודות שמע, בהן משתמשים שולטים או מקיימים אינטראקציה עם מכשירים או תוכנות באמצעות פקודות קוליות או הוראות מדוברות. פקודות קוליות הן בדרך כלל קטנות בגודלן, והשהייה נמוכה של מסקנות היא חיונית כדי להבטיח שפקודות מתומללות יכולות להפעיל מיד פעולות עוקבות. טרנספורמציה אצווה היא אידיאלית למשימות לא מקוונות מתוזמנות, כאשר כל גודל קובץ שמע הוא מתחת ל-100 מגה-בייט, ואין דרישה ספציפית לזמני תגובה מהירים להסקת מסקנות. הסקה אסינכרונית מאפשרת העלאות של עד 1 GB ומציעה השהיית הסקה מתונה. סוג הסקה זה מתאים לתמלול סרטים, סדרות טלוויזיה וכנסים מוקלטים שבהם צריך לעבד קבצי אודיו גדולים יותר.

הן אפשרויות הסקת זמן אמת והן אסינכרונית מספקות יכולות קנה מידה אוטומטי, המאפשרות למופעי נקודות הקצה להגדיל או להקטין באופן אוטומטי בהתבסס על נפח הבקשות. במקרים ללא בקשות, קנה מידה אוטומטי מסיר מופעים מיותרים, ועוזר לך למנוע עלויות הקשורות למופעים שהוגדרו שאינם בשימוש פעיל. עם זאת, להסקת מסקנות בזמן אמת, יש לשמור לפחות מופע מתמשך אחד, מה שעלול להוביל לעלויות גבוהות יותר אם נקודת הקצה פועלת ברציפות. לעומת זאת, הסקה אסינכרונית מאפשרת להפחית את נפח המופע ל-0 כאשר אינו בשימוש. בעת הגדרת עבודת טרנספורמציה אצווה, ניתן להשתמש במספר מופעים כדי לעבד את העבודה ולהתאים את max_concurrent_transforms כדי לאפשר למופע אחד לטפל בבקשות מרובות. לכן, כל שלוש אפשרויות ההסקה מציעות מדרגיות רבה.

ניקיון

לאחר שתסיים להשתמש בפתרון, הקפד להסיר את נקודות הקצה של SageMaker כדי למנוע הוצאות נוספות. אתה יכול להשתמש בקוד שסופק כדי למחוק נקודות קצה בזמן אמת וא-סינכרוניות, בהתאמה.

סיכום

בפוסט זה, הראינו לכם כיצד פריסת מודלים של למידת מכונה לעיבוד אודיו הפכה חיונית יותר ויותר בתעשיות שונות. ניקח את מודל Whisper כדוגמה, הדגמנו כיצד לארח דגמי ASR בקוד פתוח באמזון SageMaker באמצעות גישות PyTorch או Hugging Face. החקירה כללה אפשרויות מסקנות שונות באמזון SageMaker, ומציעה תובנות לגבי טיפול יעיל בנתוני אודיו, ביצוע תחזיות וניהול עלויות בצורה יעילה. פוסט זה נועד לספק ידע לחוקרים, מפתחים ומדעני נתונים המעוניינים למנף את מודל Whisper עבור משימות הקשורות לאודיו וקבלת החלטות מושכלות לגבי אסטרטגיות מסקנות.

למידע מפורט יותר על פריסת דגמים ב- SageMaker, עיין בזה מדריך למפתחים. בנוסף, ניתן לפרוס את מודל Whisper באמצעות SageMaker JumpStart. לפרטים נוספים, אנא בדוק את דגמי Whisper לזיהוי דיבור אוטומטי זמינים כעת באמזון SageMaker JumpStart הודעה.

אל תהסס לבדוק את המחברת והקוד עבור הפרויקט הזה GitHub ושתף אותנו בתגובה שלך.

על המחבר

יינג הו, דוקטורט, הוא אדריכל אבות טיפוס למידת מכונה ב-AWS. תחומי העניין העיקריים שלה כוללים למידה עמוקה, עם דגש על GenAI, Computer Vision, NLP וחיזוי נתונים של סדרות זמן. בזמנה הפנוי, היא נהנית לבלות רגעי איכות עם משפחתה, לשקוע ברומנים ולטייל בפארקים הלאומיים של בריטניה.

יינג הו, דוקטורט, הוא אדריכל אבות טיפוס למידת מכונה ב-AWS. תחומי העניין העיקריים שלה כוללים למידה עמוקה, עם דגש על GenAI, Computer Vision, NLP וחיזוי נתונים של סדרות זמן. בזמנה הפנוי, היא נהנית לבלות רגעי איכות עם משפחתה, לשקוע ברומנים ולטייל בפארקים הלאומיים של בריטניה.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- :יש ל

- :הוא

- :לֹא

- :איפה

- $ למעלה

- 1

- 10

- 100

- 12

- 14

- 16

- 19

- 30

- 32

- 8

- a

- מוּאָץ

- גישה

- נגישות

- חֶשְׁבּוֹן

- דיוק

- לרוחב

- פעולות

- באופן פעיל

- להוסיף

- נוסף

- בנוסף

- כתובת

- לְהַתְאִים

- מתקדם

- AI

- מטרות

- תעשיות

- מאפשר

- מאפשר

- לאורך

- גם

- אמזון בעברית

- אמזון SageMaker

- אמזון שירותי אינטרנט

- an

- אנליזה

- ו

- אחר

- כל

- יישומים

- גישות

- ARE

- אזורים

- מערך

- מלאכותי

- בינה מלאכותית

- AS

- נכס

- עוזרים

- המשויך

- At

- אודיו

- מחבר

- מכני עם סלילה אוטומטית

- באופן אוטומטי

- זמינות

- זמין

- לְהִמָנַע

- AWS

- בסיס

- מבוסס

- BE

- להיות

- להלן

- מוטב

- בֵּין

- הטיות

- BIN

- שניהם

- באגים

- אבל

- by

- CAN

- יכולות

- מסוגל

- זהיר

- מקרים

- שינויים

- תרשים

- לבדוק

- בחרו

- בחירה

- בכיתה

- ברור

- קוד

- איך

- הערה

- Common

- השוואה

- השוואות

- השלמת

- השלמה

- רכיבים

- מַקִיף

- חישוב

- המחשב

- ראייה ממוחשבת

- לנהל

- כנסים

- תְצוּרָה

- מוגדר

- תצורה

- בהתחשב

- באופן עקבי

- להכיל

- מכולה

- מכולות

- ברציפות

- לעומת זאת

- לִשְׁלוֹט

- המרת

- לתקן

- תוֹאֵם

- עלות

- עלויות

- יכול

- CPU

- לִיצוֹר

- יוצרים

- מכריע

- מנהג

- נתונים

- החלטות

- להקטין

- עמוק

- למידה עמוקה

- בְּרִירַת מֶחדָל

- לְהַגדִיר

- מופגן

- לפרוס

- פרס

- פריסה

- פריסה

- פרט

- מְפוֹרָט

- פרטים

- לפתח

- מפתחים

- צעצועי התפתחות

- מכשיר

- התקנים

- אחר

- להבחין

- מֵמַד

- ישירות

- מציג

- צלילה

- שונה

- סַוָר

- לא

- עושה

- מטה

- בְּמַהֲלָך

- e

- כל אחד

- מוקדם יותר

- המערכת האקולוגית

- יעילות

- יעיל

- יעילות

- ללא מאמץ

- או

- אחר

- לצאת לדרך

- מעצים

- לאפשר

- מאפשר

- מה שמאפשר

- להקיף

- נקודת קצה

- נקודות קצה

- להגביר את

- שיפור

- לְהַבטִיחַ

- מבטיח

- שלם

- סביבה

- חיוני

- מקימים

- Ether (ETH)

- בדיקה

- דוגמה

- עולה על

- חריג

- מצוין

- לְנַסוֹת

- להסביר

- חקירה

- היכרות

- פָּנִים

- נכשל

- שקר

- משפחה

- מהר

- מהר יותר

- המהיר ביותר

- מעטים

- שלח

- קבצים

- ממצאים

- ראשון

- להתמקד

- התמקדות

- הבא

- בעד

- פוּרמָט

- מסגרת

- מסגרות

- חופשי

- החל מ-

- מלא

- GPU

- GPUs

- גדול

- קְבוּצָה

- לטפל

- טיפול

- חומרה

- יש

- שמיעה

- עזרה

- לה

- גָבוֹהַ

- גבוה יותר

- טיולים

- המארח

- אירוח

- איך

- איך

- אולם

- HTML

- http

- HTTPS

- טבור

- חיבוק פנים

- i

- אידאל

- if

- איור

- תמונה

- תמונות

- הפעלה

- יישומים

- לייבא

- חשוב

- in

- מעמיק

- לכלול

- כולל

- כולל

- בע"מ

- להגדיל

- יותר ויותר

- בנפרד

- אנשים

- תעשיות

- מידע

- הודעה

- בתחילה

- בהתחלה

- ייזום

- קלט

- תשומות

- תובנות

- להתקין

- למשל

- מקרים

- הוראות

- שילוב

- מוֹדִיעִין

- אינטראקציה

- אינטרס

- מעוניין

- מִמְשָׁק

- אל תוך

- בעיות

- IT

- שֶׁלָה

- עבודה

- מקומות תעסוקה

- jpg

- מפתח

- ידע

- ידוע

- נוף

- גדול יותר

- לבסוף

- חֶבִיוֹן

- מאוחר יותר

- האחרון

- שכבה

- עוֹפֶרֶת

- למידה

- הכי פחות

- מינוף

- רישיון

- הגבלה

- מוגבל

- קו

- רשימה

- לִטעוֹן

- טוען

- מקומי

- מיקום

- ארוך

- עוד

- נמוך

- מכונה

- למידת מכונה

- עשוי

- ראשי

- לעשות

- עושה

- עשייה

- לנהל

- ניהול

- מפות

- מאי..

- מוּזְכָּר

- מידע נוסף

- שיטה

- שיטות

- מדדים

- יכול

- מילי שניות

- דקות

- MIT

- ML

- מודל

- מודלים

- בינוני

- רגעים

- ניטור

- יותר

- סרטים

- הרבה

- מספר

- צריך

- שם

- לאומי

- פארקים לאומיים

- הכרחי

- צורך

- נחוץ

- רשת

- עצביים

- רשת עצבית

- הבא

- NLP

- לא

- הערות

- מחברה

- הערות

- הודעה

- הודעות

- וציין

- עַכשָׁיו

- מספר

- מספרים

- אובייקט

- אובייקטים

- להתבונן

- of

- הַצָעָה

- הצעה

- המיוחדות שלנו

- רשמי

- לא מחובר

- on

- פעם

- ONE

- רק

- קוד פתוח

- פועל

- אפשרות

- אפשרויות

- or

- להזמין

- ארגונים

- OS

- אחר

- אַחֶרֶת

- הַחוּצָה

- סקירה

- חבילה

- חבילות

- פרמטר

- פרמטרים

- פרקים

- לעבור

- נתיב

- לבצע

- ביצועים

- שלב

- צינור

- מכריע

- מוצב

- פלטפורמה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- אנא

- נקודות

- אפשרי

- הודעה

- פוטנציאל

- נבואה

- התחזיות

- למנוע

- קודם

- יְסוֹדִי

- תהליך

- מעובד

- תהליך

- מעבד

- פּרוֹיֶקט

- כמו שצריך

- prototyping

- לספק

- ובלבד

- מספק

- מתן

- פיתון

- פיטורך

- איכות

- רכס

- זמן אמת

- תחום

- הכרה

- מוּמלָץ

- מוקלט

- מופחת

- להתייחס

- ללא קשר

- קָשׁוּר

- עיתונות

- לזכור

- להסיר

- מסיר

- מאגר

- לבקש

- בקשות

- לדרוש

- נדרש

- דרישה

- חוקרים

- בהתאמה

- תגובה

- תגובות

- אחראי

- תוצאה

- הביא

- תוצאות

- שמור

- הסבה מקצועית

- לַחֲזוֹר

- בעל חכמים

- אותו

- שמור

- הציל

- חסכת

- בקרת מערכות ותקשורת

- סולם

- מאזניים

- מתוכנן

- מדענים

- תסריט

- סקריפטים

- שְׁנִיָה

- שניות

- סעיף

- מגזרים

- בחר

- נבחר

- בחירה

- סדרה

- שרות

- שירותים

- סט

- הצבה

- הגדרות

- שיתוף

- היא

- צריך

- הראה

- הופעות

- כיבוי

- משמעותי

- פָּשׁוּט

- מפשט

- מידה

- גדל

- קטן

- קטן יותר

- So

- תוכנה

- פִּתָרוֹן

- ספציפי

- במיוחד

- מפורט

- נאום

- זיהוי דיבור

- מְהִירוּת

- הוצאה

- דיבר

- התחלה

- מדינה

- מדינה-of-the-art

- שלב

- צעדים

- אחסון

- אסטרטגיות

- לאחר מכן

- מוצלח

- כזה

- פתאומי

- מַתְאִים

- תמיכה

- מסייע

- תומך

- בטוח

- לְהִתְנַחְשֵׁל

- מערכות

- שולחן

- לקחת

- נטילת

- המשימות

- משימות

- טכנולוגיה

- מֵאֲשֶׁר

- זֶה

- השמיים

- בריטניה

- שֶׁלָהֶם

- אותם

- אז

- שם.

- לכן

- אלה

- הֵם

- זֶה

- שְׁלוֹשָׁה

- זמן

- סדרת זמן

- פִּי

- ל

- כלים

- לפיד

- תְנוּעָה

- רכבת

- מְאוּמָן

- לשנות

- שנאי

- רוֹבּוֹטרִיקִים

- להפעיל

- מופעל

- tv

- סדרות טלביזיה

- שתיים

- סוג

- בדרך כלל

- Uk

- תחת

- נעילה

- על

- us

- להשתמש

- מְשׁוּמָשׁ

- ידידותי למשתמש

- משתמשים

- באמצעות

- תועלת

- לנצל

- ניצול

- בעל ערך

- ערך

- משתנה

- שונים

- Vast

- גרסה

- חזון

- קול

- פקודות קול

- כֶּרֶך

- לחכות

- רוצה

- היה

- we

- אינטרנט

- שירותי אינטרנט

- טוֹב

- היו

- מתי

- בכל פעם

- אשר

- Whisper

- רָחָב

- טווח רחב

- עם

- בתוך

- זרימת עבודה

- עובד

- ראוי

- כתיבה

- אתה

- זפירנט