Nel mondo odierno basato sui dati, la capacità di spostare e analizzare facilmente i dati su diverse piattaforme è essenziale. Flusso di app Amazon, un servizio di integrazione dei dati completamente gestito, è stato in prima linea nell'ottimizzazione del trasferimento di dati tra servizi AWS, applicazioni SaaS (Software as a Service) e ora Google BigQuery. In questo post del blog esplori il nuovo Connettore Google BigQuery in Amazon AppFlow e scopri come semplifica il processo di trasferimento dei dati dal data warehouse di Google a Servizio di archiviazione semplice Amazon (Amazon S3), offrendo vantaggi significativi ai professionisti e alle organizzazioni dei dati, inclusa la democratizzazione dell'accesso ai dati multi-cloud.

Panoramica di Amazon AppFlow

Flusso di app Amazon è un servizio di integrazione completamente gestito che puoi utilizzare per trasferire in modo sicuro i dati tra applicazioni SaaS come Google BigQuery, Salesforce, SAP, Hubspot e ServiceNow e servizi AWS come Amazon S3 e Amazon RedShift, in pochi clic. Con Amazon AppFlow puoi eseguire flussi di dati praticamente su qualsiasi scala e con la frequenza che preferisci: secondo una pianificazione, in risposta a un evento aziendale o su richiesta. Puoi configurare funzionalità di trasformazione dei dati come il filtraggio e la convalida per generare dati ricchi e pronti all'uso come parte del flusso stesso, senza passaggi aggiuntivi. Amazon AppFlow crittografa automaticamente i dati in movimento e consente di limitare il flusso dei dati sull'Internet pubblica per le applicazioni SaaS integrate con Collegamento privato AWS, riducendo l'esposizione alle minacce alla sicurezza.

Presentazione del connettore Google BigQuery

Il nuovo Connettore Google BigQuery in Amazon AppFlow svela le possibilità per le organizzazioni che desiderano utilizzare la capacità analitica del data warehouse di Google e integrare, analizzare, archiviare o elaborare ulteriormente senza sforzo i dati di BigQuery, trasformandoli in informazioni fruibili.

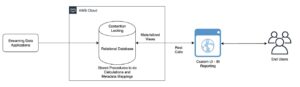

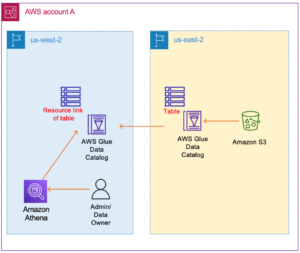

Architettura

Esaminiamo l'architettura per trasferire i dati da Google BigQuery ad Amazon S3 utilizzando Amazon AppFlow.

- Seleziona un'origine dati: In Flusso di app Amazon, seleziona Google BigQuery come origine dati. Specifica le tabelle o i set di dati da cui desideri estrarre i dati.

- Mappatura e trasformazione dei campi: configura il trasferimento dei dati utilizzando l'interfaccia visiva intuitiva di Amazon AppFlow. È possibile mappare i campi dati e applicare le trasformazioni necessarie per allineare i dati ai propri requisiti.

- Frequenza di trasferimento: decidi la frequenza con cui desideri trasferire i dati, ad esempio giornaliera, settimanale o mensile, supportando flessibilità e automazione.

- Destinazione: specifica un bucket S3 come destinazione per i tuoi dati. Amazon AppFlow sposterà i dati in modo efficiente, rendendoli accessibili nel tuo storage Amazon S3.

- Consumo: Utilizzare Amazzone Atena per analizzare i dati in Amazon S3.

Prerequisiti

Il set di dati utilizzato in questa soluzione è generato da Sintea, un simulatore sintetico di popolazione di pazienti e un progetto opensource nell'ambito del Licenza Apache 2.0. Carica questi dati in Google BigQuery o utilizza il set di dati esistente.

Collega Amazon AppFlow al tuo account Google BigQuery

Per questo post utilizzerai un account Google, un client OAuth con le autorizzazioni appropriate e i dati di Google BigQuery. Per abilitare l'accesso a Google BigQuery da Amazon AppFlow, devi configurare anticipatamente un nuovo client OAuth. Per istruzioni, vedere Connettore Google BigQuery per Amazon AppFlow.

Configura Amazon S3

Ogni oggetto in Amazon S3 viene archiviato in un bucket. Prima di poter archiviare i dati in Amazon S3, è necessario crea un bucket S3 per memorizzare i risultati.

Crea un nuovo bucket S3 per i risultati di Amazon AppFlow

Per creare un bucket S3, completa i seguenti passaggi:

- Nella console di gestione AWS per Amazon S3scegli Crea un secchio.

- Entra in un mondo unico a livello mondiale nome per il tuo secchio; per esempio,

appflow-bq-sample. - Scegli Crea secchio.

Crea un nuovo bucket S3 per i risultati di Amazon Athena

Per creare un bucket S3, completa i seguenti passaggi:

- Nella console di gestione AWS per Amazon S3scegli Crea un secchio.

- Entra in un mondo unico a livello mondiale nome per il tuo secchio; per esempio,

athena-results. - Scegli Crea secchio.

Ruolo utente (ruolo IAM) per AWS Glue Data Catalog

Per catalogare i dati trasferiti con il flusso, è necessario disporre del ruolo utente appropriato AWS Identity and Access Management (IAM). Fornisci questo ruolo ad Amazon AppFlow per concedere le autorizzazioni necessarie per creare un file Catalogo dati di AWS Glue, tabelle, database e partizioni.

Per un esempio di policy IAM con le autorizzazioni richieste, consulta Esempi di policy basate sull'identità per Amazon AppFlow.

Guida dettagliata alla progettazione

Esaminiamo ora un caso d'uso pratico per vedere come funziona il connettore Amazon AppFlow da Google BigQuery a Amazon S3. Per questo caso d'uso, utilizzerai Amazon AppFlow per archiviare i dati storici da Google BigQuery ad Amazon S3 per l'archiviazione e l'analisi a lungo termine.

Configura Amazon AppFlow

Crea un nuovo flusso Amazon AppFlow per trasferire i dati da Google Analytics ad Amazon S3.

- Sulla Console Amazon AppFlowscegli Crea flusso.

- Inserisci un nome per il tuo flusso; Per esempio,

my-bq-flow. - Aggiungi necessario tag; ad esempio, per Le entrare

enve per Valore entraredev.

- Scegli Avanti.

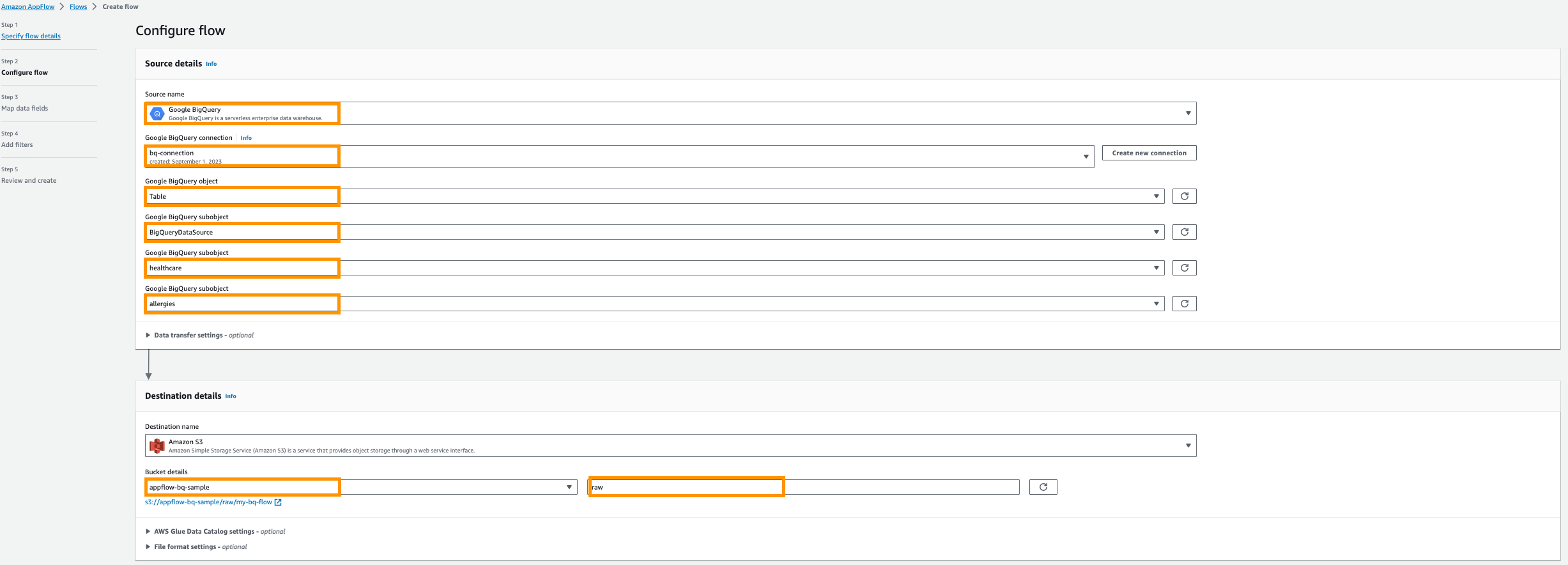

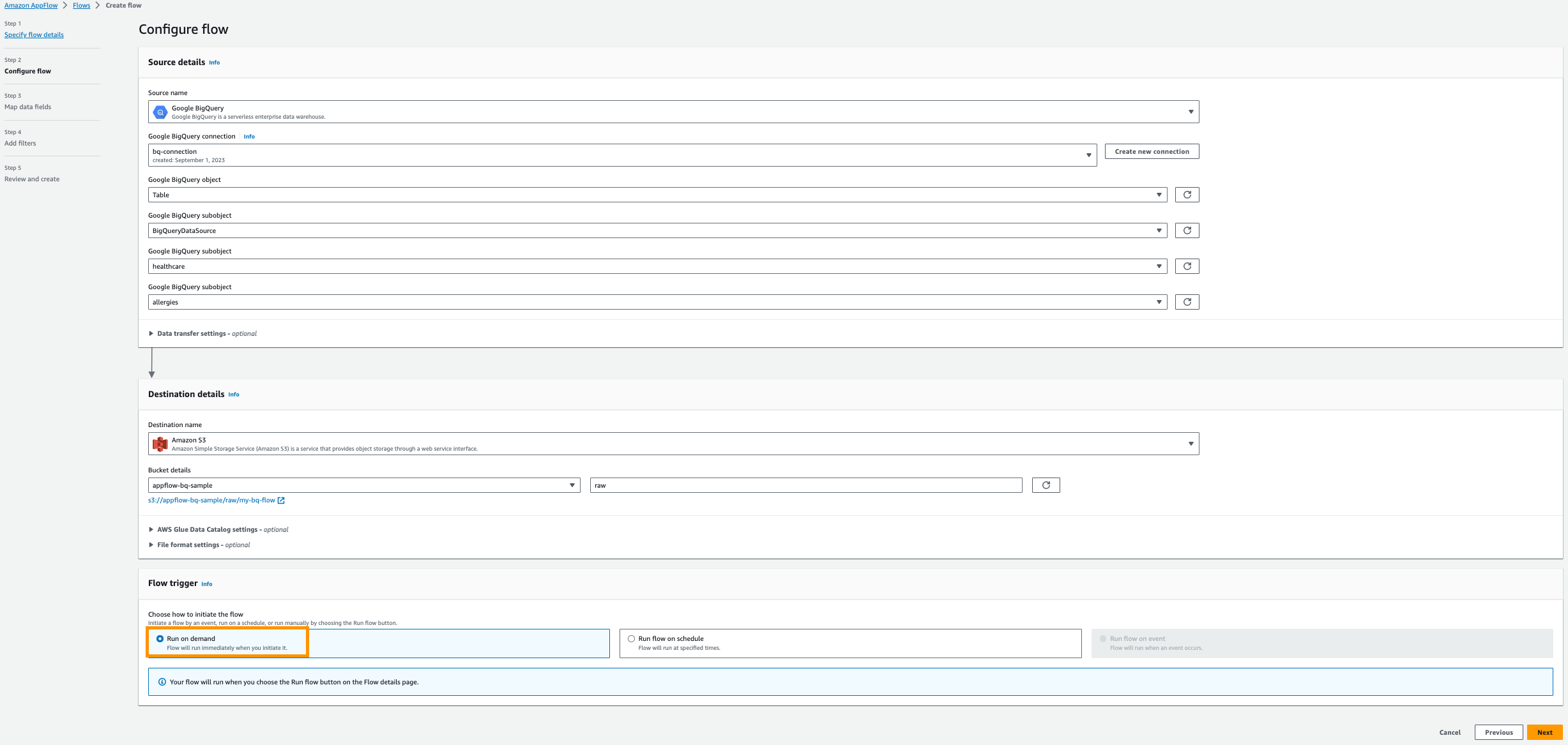

- Nel Nome della fontescegli Google BigQuery.

- Scegli Crea una nuova connessione.

- Inserisci il tuo OAuth ID cliente ed Client Secret, quindi dai un nome alla tua connessione; Per esempio,

bq-connection.

- Nella finestra pop-up, scegli di consentire ad amazon.com l'accesso all'API Google BigQuery.

- Nel Scegli l'oggetto Google BigQueryscegli Table.

- Nel Scegli il sottooggetto Google BigQueryscegli NomeProgettoBigQuery.

- Nel Scegli il sottooggetto Google BigQueryscegli DatabaseName.

- Nel Scegli il sottooggetto Google BigQueryscegli TableName.

- Nel Nome della destinazionescegli Amazon S3.

- Nel Dettagli del secchio, scegli il bucket Amazon S3 creato per archiviare i risultati di Amazon AppFlow nei prerequisiti.

- entrare

rawcome prefisso.

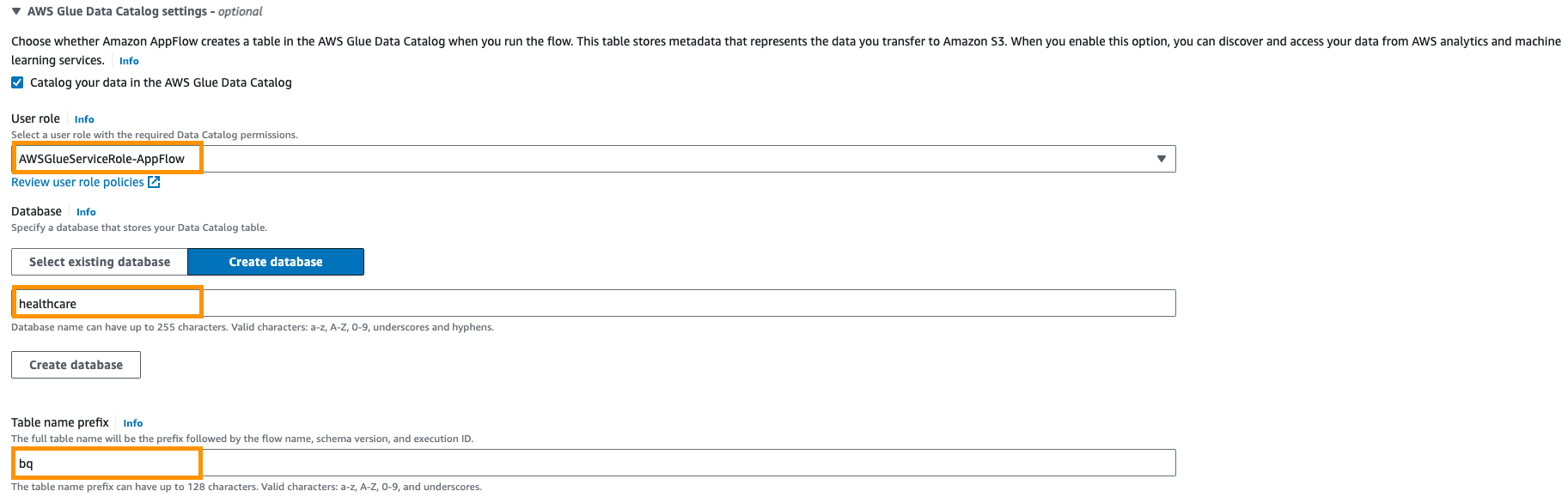

- Quindi, fornisci Catalogo dati di AWS Glue impostazioni per creare una tabella per ulteriori analisi.

- Seleziona il Ruolo dell'utente (Ruolo IAM) creato nei prerequisiti.

- Creare nuovo banca dati per esempio,

healthcare. - Fornire una prefisso della tabella impostazione, ad esempio,

bq.

- Seleziona Esegui su richiesta.

- Scegli Avanti.

- Seleziona Mappa manualmente i campi.

- Seleziona i sei campi seguenti per Nome del campo di origine dalla tabella Allergie:

- Inizio

- Paziente

- Code

- Descrizione

- Tipologia

- Categoria

- Scegli Mappa direttamente i campi.

- Scegli Avanti.

- In Aggiungi filtri sezione, scegliere Avanti.

- Scegli Crea flusso.

Eseguire il flusso

Dopo aver creato il nuovo flusso, puoi eseguirlo su richiesta.

- Sulla Console Amazon AppFlowscegli

my-bq-flow. - Scegli Esegui flusso.

Per questa procedura dettagliata, scegli Esegui il lavoro su richiesta per facilitare la comprensione. In pratica è possibile scegliere un lavoro schedulato ed estrarre periodicamente solo i dati appena aggiunti.

Effettua una query tramite Amazon Athena

Quando selezioni le impostazioni facoltative di AWS Glue Data Catalog, Data Catalog crea il catalogo per i dati, consentendo ad Amazon Athena di eseguire query.

Se ti viene richiesto di configurare la posizione dei risultati della query, vai a Impostazioni profilo scheda e scegliere gestire. Sotto Gestisci le impostazioni, scegli il gruppo di risultati Athena creato nei prerequisiti e scegli Risparmi.

- Sulla Console Amazon Athena, seleziona l'origine dati come

AWSDataCatalog. - Quindi, selezionare Banca Dati as

healthcare. - Ora puoi selezionare la tabella creata dal crawler AWS Glue e visualizzarne l'anteprima.

- Puoi anche eseguire una query personalizzata per trovare le 10 principali allergie, come mostrato nella query seguente.

Note:: Nella query seguente, sostituisci il nome della tabella, in questo caso bq_appflow_mybqflow_1693588670_latest, con il nome della tabella generata nel tuo account AWS.

- Scegli Esegui query.

Questo risultato mostra le prime 10 allergie per numero di casi.

ripulire

Per evitare addebiti, pulisci le risorse nel tuo account AWS completando i seguenti passaggi:

- Nella console Amazon AppFlow, scegli flussi nel pannello di navigazione.

- Dall'elenco dei flussi, seleziona il flusso

my-bq-flowed eliminalo. - Immettere delete per eliminare il flusso.

- Scegli Connessioni nel pannello di navigazione.

- Scegli Google BigQuery dall'elenco dei connettori, selezionare

bq-connectored eliminalo. - Immettere delete per eliminare il connettore.

- Sulla console IAM, scegli Ruoli nella pagina di navigazione, quindi seleziona il ruolo creato per il crawler AWS Glue ed eliminalo.

- Sulla console Amazon Athena:

- Elimina le tabelle create nel database

healthcareutilizzando il crawler AWS Glue. - Elimina il database

healthcare

- Elimina le tabelle create nel database

- Nella console Amazon S3, cerca il bucket di risultati Amazon AppFlow che hai creato, scegli Vuoto per eliminare gli oggetti, quindi eliminare il bucket.

- Nella console Amazon S3, cerca il bucket di risultati Amazon Athena che hai creato, scegli Vuoto per eliminare gli oggetti, quindi eliminare il bucket.

- Pulisci le risorse nel tuo Account Google eliminando il progetto che contiene le risorse di Google BigQuery. Segui la documentazione per ripulire le risorse di Google.

Conclusione

Il connettore Google BigQuery in Amazon AppFlow semplifica il processo di trasferimento dei dati dal data warehouse di Google ad Amazon S3. Questa integrazione semplifica l'analisi e l'apprendimento automatico, l'archiviazione e lo storage a lungo termine, offrendo vantaggi significativi ai professionisti dei dati e alle organizzazioni che cercano di sfruttare le capacità analitiche di entrambe le piattaforme.

Con Amazon AppFlow, le complessità dell'integrazione dei dati vengono eliminate, consentendoti di concentrarti sull'ottenimento di informazioni strategiche dai tuoi dati. Che tu stia archiviando dati storici, eseguendo analisi complesse o preparando dati per l'apprendimento automatico, questo connettore semplifica il processo, rendendolo accessibile a una gamma più ampia di professionisti dei dati.

Se sei interessato a vedere come vengono trasferiti i dati da Google BigQuery ad Amazon S3 utilizzando Amazon AppFlow, dai un'occhiata alla procedura dettagliata video tutorial. In questo tutorial esamineremo l'intero processo, dalla configurazione della connessione all'esecuzione del flusso di trasferimento dei dati. Per ulteriori informazioni su Amazon AppFlow, visita Flusso di app Amazon.

Circa gli autori

Kartikay Khator è un Solutions Architect nel settore Global Life Science presso Amazon Web Services. La sua passione è aiutare i clienti nel loro percorso verso il cloud, concentrandosi sui servizi di analisi AWS. È un appassionato corridore e gli piace fare escursioni.

Kartikay Khator è un Solutions Architect nel settore Global Life Science presso Amazon Web Services. La sua passione è aiutare i clienti nel loro percorso verso il cloud, concentrandosi sui servizi di analisi AWS. È un appassionato corridore e gli piace fare escursioni.

Kamen Sharlandjiev è un Senior Big Data e ETL Solutions Architect ed esperto di Amazon AppFlow. La sua missione è semplificare la vita ai clienti che devono affrontare complesse sfide di integrazione dei dati. La sua arma segreta? Servizi AWS completamente gestiti e a basso codice che possono portare a termine il lavoro con il minimo sforzo e senza codifica.

Kamen Sharlandjiev è un Senior Big Data e ETL Solutions Architect ed esperto di Amazon AppFlow. La sua missione è semplificare la vita ai clienti che devono affrontare complesse sfide di integrazione dei dati. La sua arma segreta? Servizi AWS completamente gestiti e a basso codice che possono portare a termine il lavoro con il minimo sforzo e senza codifica.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/big-data/simplify-data-transfer-google-bigquery-to-amazon-s3-using-amazon-appflow/

- :ha

- :È

- $ SU

- 10

- 100

- 14

- 16

- 17

- 22

- 321

- 8

- 9

- a

- capacità

- Chi siamo

- accesso

- gestione degli accessi

- accessibile

- Il mio account

- operanti in

- aggiungere

- aggiunto

- aggiuntivo

- avanzare

- allineare

- Allergie

- consentire

- Consentire

- consente

- anche

- Amazon

- Amazzone Atena

- Amazon Web Services

- Amazon.com

- an

- .

- Analitico

- analitica

- analizzare

- ed

- in qualsiasi

- api

- applicazioni

- APPLICA

- opportuno

- architettura

- Archivio

- SONO

- AS

- At

- automaticamente

- Automazione

- evitare

- AWS

- Colla AWS

- Console di gestione AWS

- stato

- prima

- sotto

- vantaggi

- fra

- Big

- Big Data

- BigQuery

- Blog

- entrambi

- più ampia

- affari

- by

- Materiale

- Può ottenere

- funzionalità

- capacità

- Custodie

- casi

- catalogo

- Categoria

- sfide

- oneri

- Scegli

- cliente

- Cloud

- codifica

- COM

- completamento di una

- completando

- complesso

- complessità

- veloce

- consolle

- contiene

- crawler

- creare

- creato

- crea

- Creazione

- costume

- Clienti

- alle lezioni

- dati

- l'accesso ai dati

- integrazione dei dati

- data warehouse

- data-driven

- Banca Dati

- banche dati

- dataset

- decide

- Richiesta

- democratizzazione

- descrizione

- destinazione

- scopri

- paesaggio differenziato

- documentazione

- fatto

- alleviare

- più facile

- in modo efficiente

- sforzo

- senza sforzo

- eliminato

- enable

- consentendo

- Intero

- essential

- Etere (ETH)

- Evento

- esempio

- Esempi

- esistente

- esperto

- esplora

- Esposizione

- estratto

- di fronte

- pochi

- campo

- campi

- filtraggio

- Trovare

- Flessibilità

- flusso

- fluente

- flussi

- Focus

- seguire

- i seguenti

- Nel

- prima linea

- Frequenza

- frequentemente

- da

- completamente

- ulteriormente

- generare

- generato

- ottenere

- globali

- Globalmente

- Google Analytics

- concedere

- Gruppo

- cintura da arrampicata

- Avere

- he

- assistenza sanitaria

- aiutare

- escursionismo

- il suo

- storico

- Come

- HTML

- http

- HTTPS

- HubSpot

- IAM

- Identità

- identità e gestione degli accessi

- in

- Compreso

- informazioni

- intuizioni

- istruzioni

- integrare

- integrato

- integrazione

- interessato

- Interfaccia

- Internet

- ai miglioramenti

- intuitivo

- IT

- stessa

- Lavoro

- viaggio

- ad appena

- apprendimento

- Licenza

- Vita

- Scienze della Vita

- LIMITE

- Lista

- caricare

- località

- a lungo termine

- Guarda

- macchina

- machine learning

- make

- Fare

- gestito

- gestione

- carta geografica

- mappatura

- minimo

- Missione

- Scopri di più

- movimento

- cambiano

- devono obbligatoriamente:

- Nome

- Navigare

- Navigazione

- quasi

- necessaria

- di applicazione

- esigenze

- New

- recentemente

- no

- adesso

- numero

- OAuth

- oggetto

- oggetti

- of

- on

- On-Demand

- esclusivamente

- opensource

- or

- minimo

- organizzazioni

- ancora

- pagina

- vetro

- parte

- appassionato

- paziente

- eseguire

- esecuzione

- permessi

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- politica

- pop-up

- popolazione

- possibilità

- Post

- Pratico

- pratica

- preparazione

- prerequisiti

- Anteprima

- processi

- Scelto dai professionisti

- progetto

- fornire

- fornitura

- la percezione

- query

- gamma

- riducendo

- sostituire

- necessario

- Requisiti

- Risorse

- risposta

- limitare

- colpevole

- Risultati

- recensioni

- Ricco

- Ruolo

- Correre

- corridore

- running

- SaaS

- forza di vendita

- linfa

- Scala

- programma

- in programma

- Scienze

- Cerca

- Segreto

- Sezione

- in modo sicuro

- problemi di

- Minacce alla sicurezza

- vedere

- cerca

- servizio

- ServiceNow

- Servizi

- set

- regolazione

- impostazioni

- mostrato

- Spettacoli

- significativa

- Un'espansione

- semplificare

- simulatore

- SIX

- Software

- software come un servizio

- soluzione

- Soluzioni

- Fonte

- Passi

- conservazione

- Tornare al suo account

- memorizzati

- razionalizzazione

- tale

- sintetico

- tavolo

- Fai

- che

- Il

- loro

- poi

- questo

- minacce

- Attraverso

- a

- di oggi

- top

- Top 10

- trasferimento

- Trasferimento

- Trasformazione

- trasformazioni

- trasformazione

- lezione

- Digitare

- per

- e una comprensione reciproca

- unico

- Presenta

- uso

- caso d'uso

- utilizzato

- Utente

- utilizzando

- convalida

- APPREZZIAMO

- Visita

- camminare

- walkthrough

- volere

- Magazzino

- we

- sito web

- servizi web

- settimanale

- se

- OMS

- volere

- finestra

- con

- senza

- lavori

- mondo

- Tu

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro