Immagine dell'autore

In questo tutorial impareremo come configurare e utilizzare l'API OpenAI per vari casi d'uso. Il tutorial è progettato per essere facile da seguire, anche per chi ha una conoscenza limitata della programmazione Python. Esploreremo come chiunque può generare risposte e accedere a modelli linguistici di grandi dimensioni e di alta qualità.

I API OpenAI consente agli sviluppatori di accedere facilmente a un'ampia gamma di modelli IA sviluppati da OpenAI. Fornisce un'interfaccia intuitiva che consente agli sviluppatori di incorporare nelle loro applicazioni funzionalità intelligenti basate su modelli OpenAI all'avanguardia. L'API può essere utilizzata per vari scopi, tra cui generazione di testo, chat a più turni, incorporamenti, trascrizione, traduzione, sintesi vocale, comprensione di immagini e generazione di immagini. Inoltre, l'API è compatibile con curl, Python e Node.js.

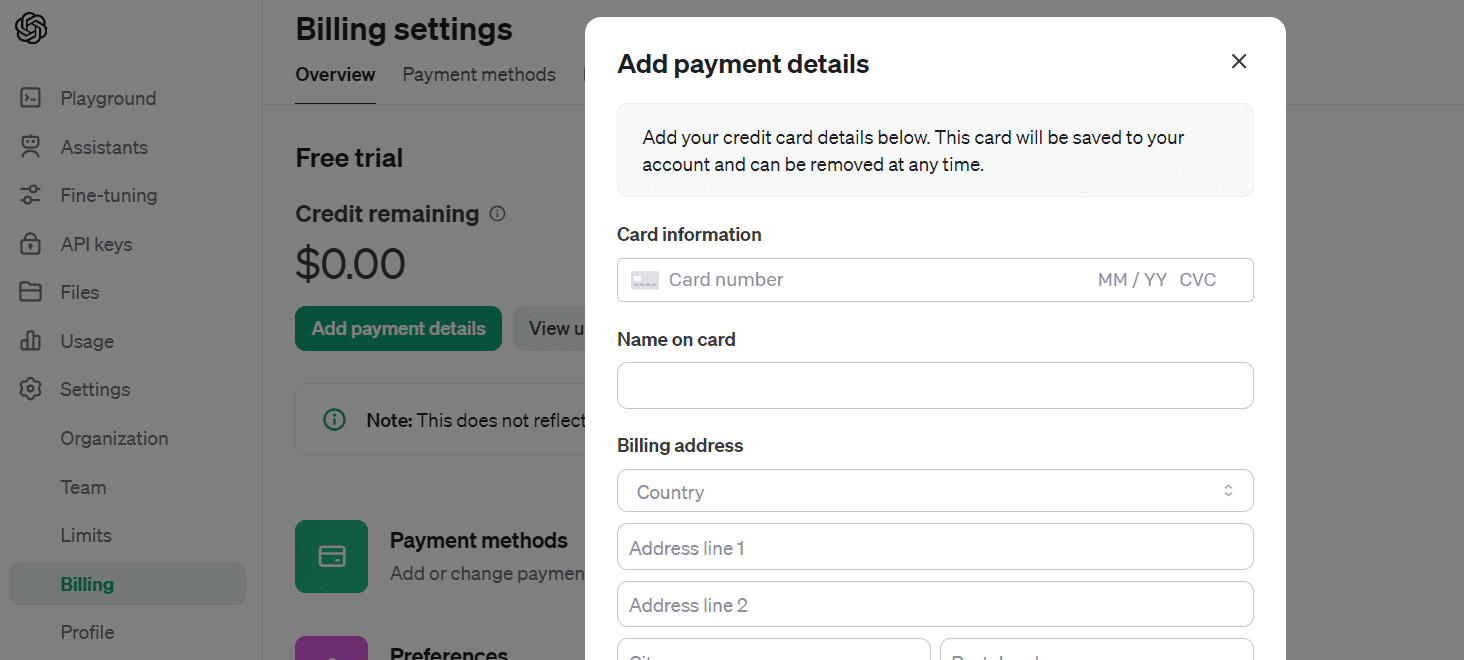

Per iniziare con l'API OpenAI, devi prima creare un account su openai.com. In precedenza, a ogni utente veniva concesso credito gratuito, ma ora i nuovi utenti devono acquistare credito.

Per acquistare credito, vai su "Impostazioni", quindi su "Fatturazione" e infine su "Aggiungi dettagli di pagamento". Inserisci i dati della tua carta di debito o credito e assicurati di disabilitare la ricarica automatica. Una volta caricati 10 USD, puoi utilizzarli per un anno.

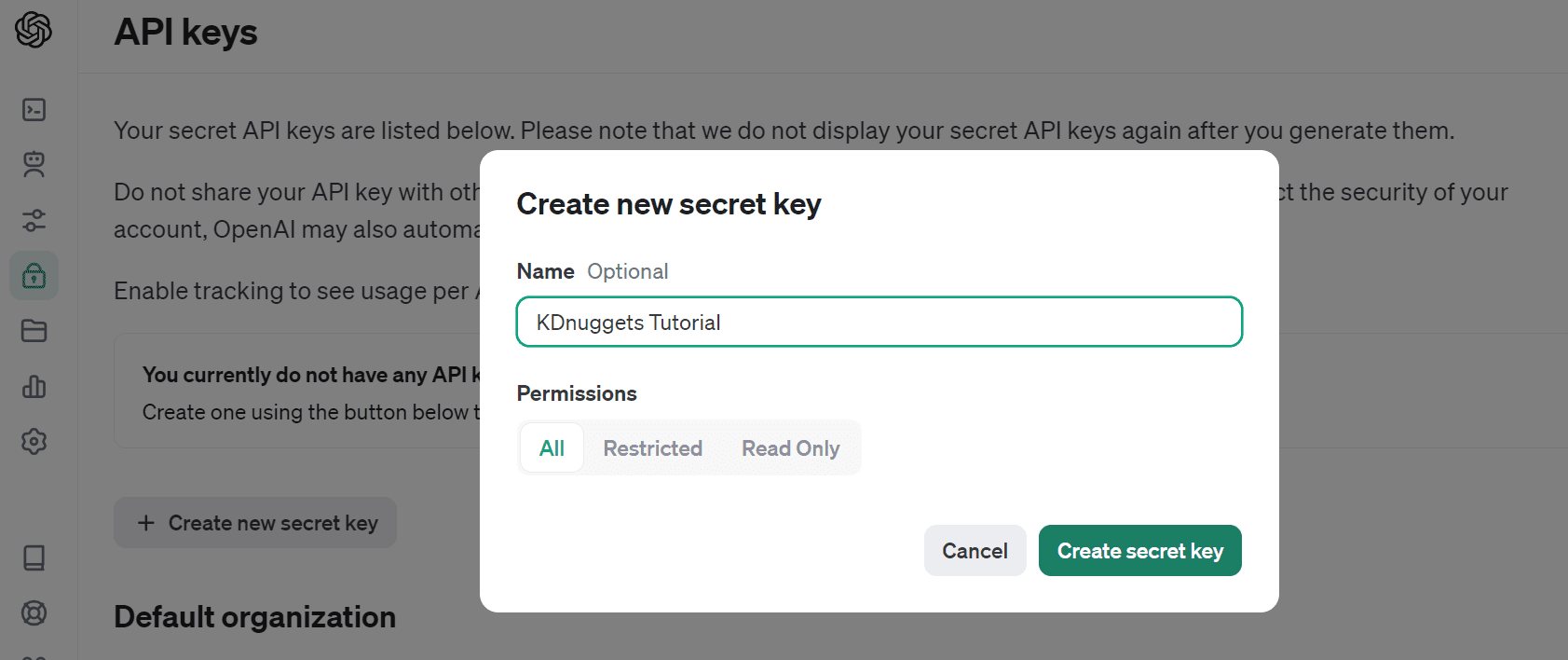

Creiamo la chiave API accedendo a "Chiavi API" e selezionando "Crea nuova chiave segreta". Dategli un nome e cliccate su “Crea chiave segreta”.

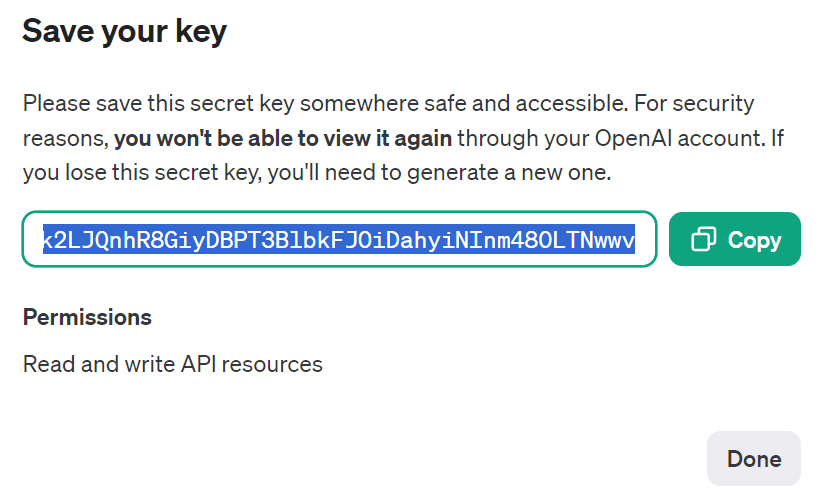

Copia l'API e crea una variabile di ambiente sul computer locale.

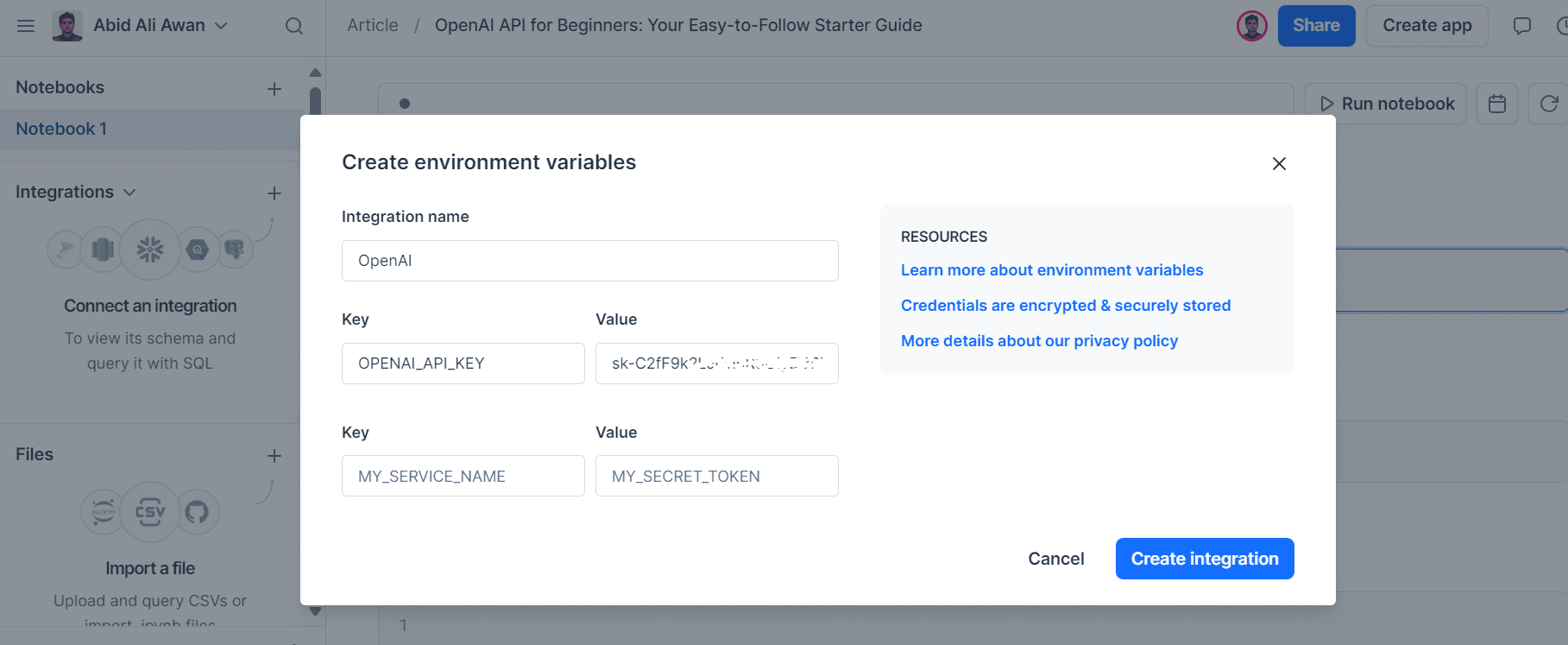

Utilizzo Deepnote come IDE. È facile creare variabili di ambiente. Basta andare su "Integrazione", selezionare "crea variabile di ambiente", fornire un nome e un valore per la chiave e creare l'integrazione.

Successivamente, installeremo il pacchetto OpenAI Python utilizzando pip.

%pip install --upgrade openaiCreeremo ora un client in grado di accedere a vari tipi di modelli a livello globale.

Se hai impostato la variabile di ambiente con il nome "OPENAI_API_KEY", non è necessario fornire al client OpenAI una chiave API.

from openai import OpenAI

client = OpenAI()Tieni presente che dovresti fornire una chiave API solo se il nome della variabile di ambiente è diverso da quello predefinito.

import os

from openai import OpenAI

client = OpenAI(

api_key=os.environ.get("SECRET_KEY"),

)Utilizzeremo una funzione legacy per generare la risposta. La funzione di completamento richiede il nome del modello, il prompt e altri argomenti per generare la risposta.

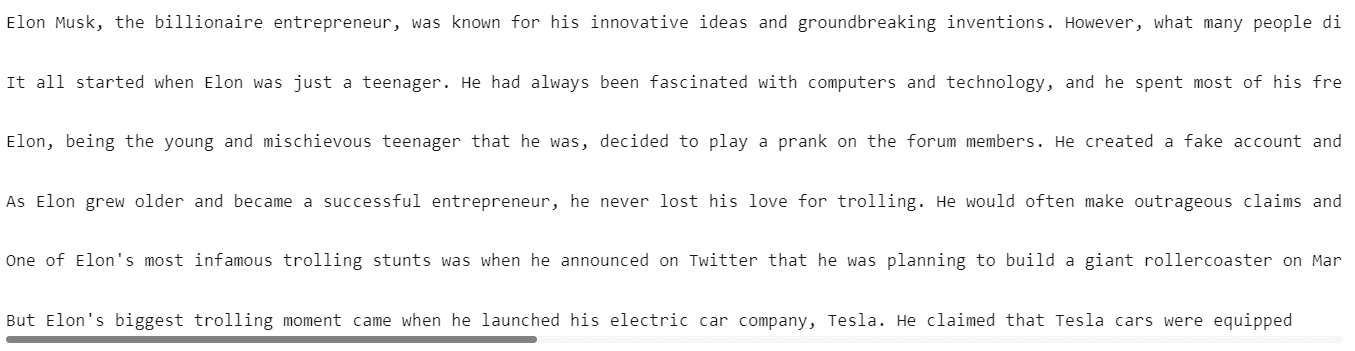

completion = client.completions.create(

model="gpt-3.5-turbo-instruct",

prompt="Write a short story about Elon Musk being the biggest troll.",

max_tokens=300,

temperature=0.7,

)

print(completion.choices[0].text)

Il modello GPT3.5 ha generato una storia straordinaria su Elon Musk.

Possiamo anche trasmettere in streaming la nostra risposta fornendo un argomento aggiuntivo "stream".

Invece di attendere la risposta completa, la funzionalità di flusso consente l'elaborazione dell'output non appena viene generato. Questo approccio aiuta a ridurre la latenza percepita restituendo l'output del modello linguistico token per token anziché tutto in una volta.

stream = client.completions.create(

model="gpt-3.5-turbo-instruct",

prompt="Write a Python code for accessing the REST API securely.",

max_tokens=300,

temperature=0.7,

stream = True

)

for chunk in stream:

print(chunk.choices[0].text, end="")

Il modello utilizzava il completamento della chat API. Prima di generare la risposta, esploriamo i modelli disponibili.

Puoi visualizzare l'elenco di tutti i modelli disponibili oppure leggere il Modelli pagina della documentazione ufficiale.

print(client.models.list())

Utilizzeremo l'ultima versione di GPT-3.5 e le forniremo un elenco di un dizionario per le istruzioni di sistema e i messaggi utente. Assicurati di seguire lo stesso schema di messaggio.

completion = client.chat.completions.create(

model="gpt-3.5-turbo-1106",

messages=[

{

"role": "system",

"content": "You are an experienced data scientist, adept at presenting complex data concepts with creativity.",

},

{

"role": "user",

"content": "What is Feature Engineering, and what are some common methods?",

},

],

)

print(completion.choices[0].message.content)

Come possiamo vedere, abbiamo generato un risultato simile all'API legacy. Quindi, perché utilizzare questa API? Successivamente, impareremo perché l'API di completamento della chat è più flessibile e più facile da usare.

Feature engineering is the process of selecting, creating, or transforming features (variables) in a dataset to improve the performance of machine learning models. It involves identifying the most relevant and informative features and preparing them for model training. Effective feature engineering can significantly enhance the predictive power of a model and its ability to generalize to new data.

Some common methods of feature engineering include:

1. Imputation: Handling missing values in features by filling them in with meaningful values such as the mean, median, or mode of the feature.

2. One-Hot Encoding: Converting categorical variables into binary vectors to represent different categories as individual features.

3. Normalization/Standardization: Scaling numerical features to bring t.........

Ora impareremo come avere una conversazione a più turni con il nostro modello di intelligenza artificiale. Per fare ciò, aggiungeremo la risposta dell'assistente alla conversazione precedente e includeremo anche il nuovo messaggio nello stesso formato del messaggio. Successivamente, forniremo un elenco di dizionari alla funzione di completamento della chat.

chat=[

{"role": "system", "content": "You are an experienced data scientist, adept at presenting complex data concepts with creativity."},

{"role": "user", "content": "What is Feature Engineering, and what are some common methods?"}

]

chat.append({"role": "assistant", "content": str(completion.choices[0].message.content)})

chat.append({"role": "user", "content": "Can you summarize it, please?"})

completion = client.chat.completions.create(

model="gpt-3.5-turbo-1106",

messages=chat

)

print(completion.choices[0].message.content)

Il modello ha compreso il contesto e ha riassunto per noi le funzionalità ingegneristiche.

Feature engineering involves selecting, creating, or transforming features in a dataset to enhance the performance of machine learning models. Common methods include handling missing values, converting categorical variables, scaling numerical features, creating new features using interactions and polynomials, selecting important features, extracting time-series and textual features, aggregating information, and reducing feature dimensionality. These techniques aim to improve the model's predictive power by refining and enriching the input features.Per sviluppare applicazioni avanzate, dobbiamo convertire il testo in incorporamenti. Questi incorporamenti vengono utilizzati per la ricerca di similarità, la ricerca semantica e i motori di raccomandazione. Possiamo generare incorporamenti fornendo il testo API e il nome del modello. È così semplice.

text = "Data Engineering is a rapidly growing field that focuses on the collection, storage, processing, and analysis of large volumes of structured and unstructured data. It involves various tasks such as data extraction, transformation, loading (ETL), data modeling, database design, and optimization to ensure that data is accessible, accurate, and relevant for decision-making purposes."

DE_embeddings = client.embeddings.create(input=text, model="text-embedding-3-small")

print(chat_embeddings.data[0].embedding)

[0.0016297283582389355, 0.0013418874004855752, 0.04802832752466202, -0.041273657232522964, 0.02150309458374977, 0.004967313259840012,.......]Ora possiamo convertire il testo in voce, la voce in testo e anche tradurlo utilizzando l'API audio.

trascrizioni

Useremo il Il Wi-Fi 7 cambierà tutto Video di YouTube e convertirlo in mp3. Successivamente, apriremo il file e lo forniremo all'API di trascrizione audio.

audio_file= open("Data/techlinked.mp3", "rb")

transcript = client.audio.transcriptions.create(

model="whisper-1",

file=audio_file

)

print(transcript.text)

Il modello Whisper è fantastico. Ha una trascrizione perfetta dell'audio.

The Consumer Electronics Show has officially begun in Las Vegas and we'll be bringing you all the highlights from right here in our regular studio where it's safe and clean and not a desert. I hate sand. The Wi-Fi Alliance announced that they have officially confirmed the Wi-Fi 7 standard and they've already started to certify devices to ensure they work together. Unlike me and Selena, that was never gonna last. The new standard will have twice the channel bandwidth of Wi-Fi 5, 6, and 6E, making it better for, surprise,......Traduzione

Possiamo anche trascrivere l'audio inglese in un'altra lingua. Nel nostro caso, lo convertiremo in lingua urdu. Aggiungeremo semplicemente un altro argomento "lingua" e gli forniremo il codice lingua ISO "ur".

translations = client.audio.transcriptions.create(

model="whisper-1",

response_format="text",

language="ur",

file=audio_file,

)

print(translations)

La traduzione per le lingue non latine è imperfetta, ma utilizzabile per un prodotto minimo vitale.

کنسومر ایلیکٹرانک شاہی نے لاس بیگیس میں شامل شروع کیا ہے اور ہم آپ کو جمہوری بہترین چیزیں اپنے ریگلر سٹوڈیو میں یہاں جارہے ہیں جہاں یہ آمید ہے اور خوبصورت ہے اور دنیا نہیں ہے مجھے سانڈ بھولتا ہے وائ فائی آلائنٹس نے اعلان کیا کہ انہوں نے وائ فائی سیبن سٹانڈرڈ کو شامل شروع کیا اور انہوں ن........

Text to Speech

Per convertire il tuo testo in audio dal suono naturale, utilizzeremo l'API vocale e gli forniremo il nome del modello, il nome del doppiatore e il testo di input. Successivamente, salveremo il file audio nella nostra cartella "Dati".

response = client.audio.speech.create(

model="tts-1",

voice="alloy",

input= '''I see skies of blue and clouds of white

The bright blessed days, the dark sacred nights

And I think to myself

What a wonderful world

'''

)

response.stream_to_file("Data/song.mp3")

Per ascoltare il file audio all'interno del Deepnote Notebook, utilizzeremo la funzione IPython Audio.

from IPython.display import Audio

Audio("Data/song.mp3")

L'API OpenAI fornisce agli utenti l'accesso a un modello multimodale attraverso la funzione di completamento della chat. Per comprendere le immagini, possiamo utilizzare l'ultimo modello di visione GPT-4.

Nell'argomento del messaggio abbiamo fornito una richiesta per porre domande sull'immagine e sull'URL dell'immagine. L'immagine proviene da Pixabay. Assicurati di seguire lo stesso formato del messaggio per evitare errori.

response = client.chat.completions.create(

model="gpt-4-vision-preview",

messages=[

{

"role": "user",

"content": [

{

"type": "text",

"text": "Could you please identify this image's contents and provide its location?",

},

{

"type": "image_url",

"image_url": {

"url": "https://images.pexels.com/photos/235731/pexels-photo-235731.jpeg?auto=compress&cs=tinysrgb&w=1260&h=750&dpr=2",

},

},

],

}

],

max_tokens=300,

)

print(response.choices[0].message.content)

L'output spiega perfettamente l'immagine.

This is an image of a person carrying a large number of rice seedlings on a carrying pole. The individual is wearing a conical hat, commonly used in many parts of Asia as protection from the sun and rain, and is walking through what appears to be a flooded field or a wet area with lush vegetation in the background. The sunlight filtering through the trees creates a serene and somewhat ethereal atmosphere.

It's difficult to determine the exact location from the image alone, but this type of scene is typically found in rural areas of Southeast Asian countries like Vietnam, Thailand, Cambodia, or the Philippines, where rice farming is a crucial part of the agricultural industry and landscape.

Invece di fornire un URL di immagine, possiamo anche caricare un file di immagine locale e fornirlo all'API di completamento della chat. Per fare ciò, dobbiamo prima scaricare l'immagine di Manjeet Singh Yadav da pexels.com.

!curl -o /work/Data/indian.jpg "https://images.pexels.com/photos/1162983/pexels-photo-1162983.jpeg?auto=compress&cs=tinysrgb&w=1260&h=750&dpr=2"

Quindi, caricheremo l'immagine e la codificheremo nel formato base64.

import base64

def encode_image(image_path):

with open(image_path, "rb") as image_file:

return base64.b64encode(image_file.read()).decode('utf-8')

image_path = "Data/indian.jpg"

# generating the base64 string

base64_image = encode_image(image_path)

Invece di fornire l'URL dell'immagine, forniremo i metadati e la stringa base64 dell'immagine.

response = client.chat.completions.create(

model="gpt-4-vision-preview",

messages=[

{

"role": "user",

"content": [

{

"type": "text",

"text": "Could you please identify this image's contents.",

},

{

"type": "image_url",

"image_url": {

"url": f"data:image/jpeg;base64,{base64_image}"

},

},

],

}

],

max_tokens=100,

)

print(response.choices[0].message.content)

Il modello ha analizzato con successo l'immagine e ha fornito una spiegazione dettagliata al riguardo.

The image shows a woman dressed in traditional Indian attire, specifically a classical Indian saree with gold and white colors, which is commonly associated with the Indian state of Kerala, known as the Kasavu saree. She is adorned with various pieces of traditional Indian jewelry including a maang tikka (a piece of jewelry on her forehead), earrings, nose ring, a choker, and other necklaces, as well as bangles on her wrists.

The woman's hairstyle features jasmine flowers arranged inPossiamo anche generare immagini utilizzando il modello DALLE-3. Dobbiamo solo fornire il nome del modello, il prompt, le dimensioni, la qualità e il numero di immagini all'API delle immagini.

response = client.images.generate(

model="dall-e-3",

prompt="a young woman sitting on the edge of a mountain",

size="1024x1024",

quality="standard",

n=1,

)

image_url = response.data[0].url

L'immagine generata viene salvata online ed è possibile scaricarla per visualizzarla localmente. Per fare ciò, scaricheremo l'immagine con la funzione "richiesta", fornendo l'URL dell'immagine e la directory locale in cui desideri salvarla. Successivamente, utilizzeremo la funzione Immagine della libreria Pillow per aprire e mostrare l'immagine.

import urllib.request

from PIL import Image

urllib.request.urlretrieve(image_url, '/work/Data/woman.jpg')

img = Image.open('/work/Data/woman.jpg')

img.show()

Abbiamo ricevuto un'immagine generata di alta qualità. È semplicemente fantastico!

Se hai difficoltà a eseguire una qualsiasi delle API OpenAI Python, sentiti libero di dare un'occhiata al mio progetto Nota profonda.

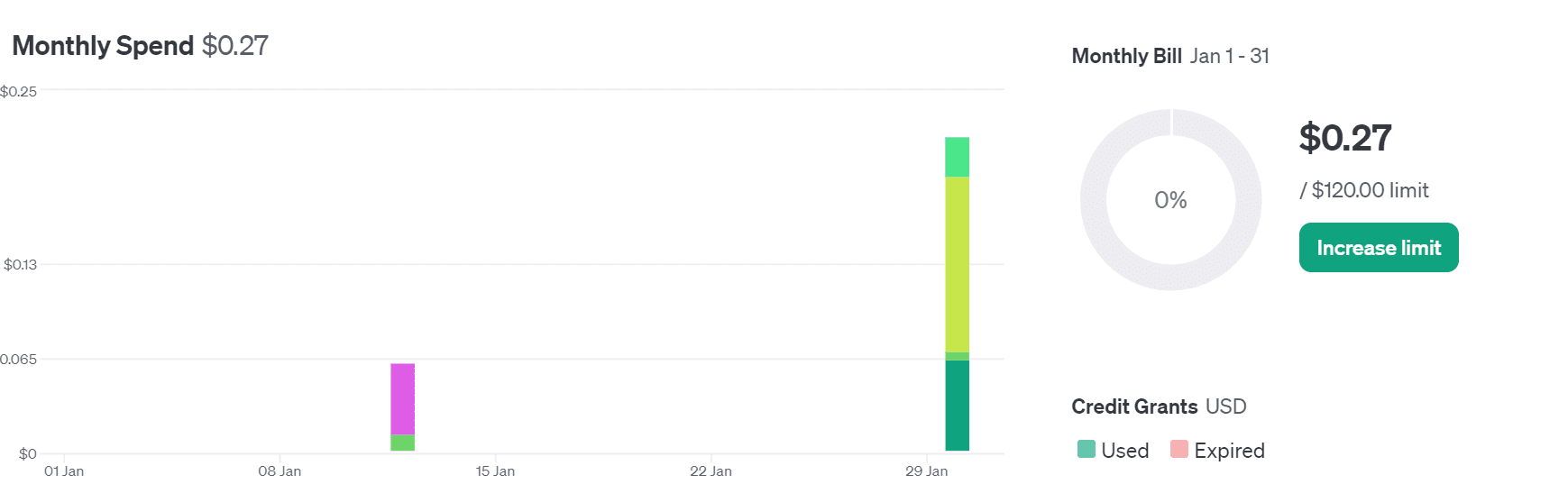

Sto sperimentando OpenAPI da qualche tempo e alla fine abbiamo utilizzato solo 0.22 dollari di credito, che trovo abbastanza conveniente. Con la mia guida, anche i principianti possono iniziare a creare le proprie applicazioni IA. È un processo semplice: non è necessario addestrare il proprio modello o distribuirlo. Puoi accedere a modelli all'avanguardia utilizzando l'API, che migliora continuamente con ogni nuova versione.

In questa guida, spieghiamo come configurare l'API OpenAI Python e generare semplici risposte di testo. Apprendiamo anche di chat multiturn, incorporamenti, trascrizione, traduzione, sintesi vocale, visione e API di generazione di immagini.

Fammi sapere se vuoi che utilizzi queste API per creare un'applicazione AI avanzata.

Grazie per aver letto.

Abid Ali Awan (@1abidaliawan) è un professionista di data scientist certificato che ama creare modelli di machine learning. Attualmente si sta concentrando sulla creazione di contenuti e sulla scrittura di blog tecnici sulle tecnologie di apprendimento automatico e scienza dei dati. Abid ha conseguito un Master in Technology Management e una laurea in Ingegneria delle Telecomunicazioni. La sua visione è quella di costruire un prodotto di intelligenza artificiale utilizzando una rete neurale grafica per studenti alle prese con malattie mentali.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://www.kdnuggets.com/openai-api-for-beginners-your-easy-to-follow-starter-guide?utm_source=rss&utm_medium=rss&utm_campaign=openai-api-for-beginners-your-easy-to-follow-starter-guide

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 12

- 13

- 14

- 16

- 17

- 19

- 2%

- 20

- 21

- 22

- 5

- 6

- 7

- 8

- 9

- a

- capacità

- Chi siamo

- a proposito

- accesso

- accessibile

- Accedendo

- Il mio account

- preciso

- aggiungere

- Inoltre

- abile

- Avanzate

- conveniente

- Dopo shavasana, sedersi in silenzio; saluti;

- aggregando

- Agricoltura

- AI

- Modelli AI

- puntare

- Tutti

- alleanza

- consente

- Lega

- da solo

- già

- anche

- stupefacente

- an

- .

- analizzato

- ed

- ha annunciato

- Un altro

- in qualsiasi

- chiunque

- api

- API

- appare

- Applicazioni

- applicazioni

- approccio

- SONO

- RISERVATA

- aree

- argomento

- argomenti

- disposte

- AS

- Asia

- asiatico

- chiedendo

- Assistant

- associato

- At

- Atmosfera

- Audio

- disponibile

- evitare

- sfondo

- Larghezza di banda

- BE

- stato

- prima

- principianti

- iniziato

- essendo

- Meglio

- Maggiore

- fatturazione

- binario

- benedetto

- blog

- Blu

- Brillants

- portare

- Portare

- costruire

- Costruzione

- ma

- by

- Cambogia

- Materiale

- carta

- trasporto

- Custodie

- casi

- categoria

- Certificato

- certificare

- il cambiamento

- canale

- chiacchierare

- dai un'occhiata

- cavedano

- clicca

- cliente

- codice

- collezione

- COM

- Uncommon

- comunemente

- compatibile

- completamento di una

- completamento

- complesso

- comprendere

- concetti

- CONFERMATO

- Consumer

- Elettronica di consumo

- contenuto

- creazione di contenuti

- testuali

- contesto

- continuamente

- Conversazione

- convertire

- conversione

- potuto

- paesi

- coprire

- creare

- crea

- Creazione

- creazione

- la creatività

- credito

- carta di credito

- cruciale

- Attualmente

- Scuro

- dati

- scienza dei dati

- scienziato di dati

- Banca Dati

- Giorni

- Addebito

- Decision Making

- def

- Predefinito

- Laurea

- schierare

- DESERTO

- Design

- progettato

- dettagliati

- dettagli

- Determinare

- sviluppare

- sviluppato

- sviluppatori

- dispositivi

- diverso

- difficile

- Dsiplay

- do

- documentazione

- dollari

- don

- scaricare

- ogni

- più facile

- facilmente

- facile

- bordo

- Efficace

- Elettronica

- Elon

- Elon Musk

- incorporamento

- Abilita

- codifica

- finito

- Ingegneria

- Motori

- Inglese

- accrescere

- arricchendo

- garantire

- entrare

- Ambiente

- errori

- Etere (ETH)

- etereo

- Anche

- Ogni

- esattamente

- esperto

- sperimentazione

- Spiegare

- spiegazione

- esplora

- extra

- estrazione

- agricoltura

- caratteristica

- Caratteristiche

- sentire

- campo

- Compila il

- riempimento

- filtraggio

- Infine

- Trovare

- Nome

- flessibile

- allagata

- si concentra

- messa a fuoco

- seguire

- Nel

- fronte

- formato

- essere trovato

- Gratis

- da

- function

- generare

- generato

- la generazione di

- ELETTRICA

- ottenere

- gif

- Dare

- dato

- Globalmente

- Go

- Oro

- grafico

- Grafico rete neurale

- Crescita

- guida

- Manovrabilità

- ha

- odio

- Avere

- he

- aiuta

- suo

- qui

- alta qualità

- evidenzia

- il suo

- detiene

- Come

- Tutorial

- HTTPS

- i

- identificare

- identificazione

- if

- malattia

- Immagine

- generazione di immagini

- immagini

- importare

- importante

- competenze

- miglioramento

- in

- includere

- Compreso

- incorporare

- indiano

- individuale

- industria

- informazioni

- informativo

- ingresso

- install

- integrazione

- Intelligente

- interazioni

- Interfaccia

- ai miglioramenti

- comporta

- ISO

- IT

- SUO

- gioielli

- jpg

- ad appena

- KDnuggets

- Le

- Tasti

- Sapere

- conoscenze

- conosciuto

- paesaggio

- Lingua

- Le Lingue

- grandi

- LAS

- Las Vegas

- Cognome

- Latenza

- con i più recenti

- IMPARARE

- apprendimento

- Eredità

- lasciare

- Biblioteca

- piace

- Limitato

- Lista

- ll

- caricare

- Caricamento in corso

- locale

- a livello locale

- località

- ama

- macchina

- machine learning

- make

- Fare

- gestione

- molti

- Mastercard

- me

- significare

- significativo

- mentale

- Malattia mentale

- messaggio

- messaggi

- Metadati

- metodi

- ordine

- prodotto minimo vitale

- mancante

- Moda

- modello

- modellismo

- modelli

- Scopri di più

- maggior parte

- La Montagna

- Muschio

- my

- me

- Nome

- navigazione

- Bisogno

- Rete

- Neurale

- rete neurale

- mai

- New

- Nuove funzionalità

- nuovi utenti

- GENERAZIONE

- nodo

- Node.js

- naso

- Nota

- taccuino

- adesso

- numero

- of

- ufficiale

- Ufficialmente

- on

- una volta

- ONE

- online

- esclusivamente

- aprire

- OpenAI

- ottimizzazione

- or

- OS

- Altro

- nostro

- su

- produzione

- proprio

- pacchetto

- pagina

- parte

- Ricambi

- Cartamodello

- Pagamento

- percepito

- perfetta

- perfettamente

- performance

- persona

- Philippines

- pezzo

- pezzi

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- polinomi

- energia

- alimentato

- predittiva

- preparazione

- precedente

- in precedenza

- processi

- lavorazione

- Prodotto

- professionale

- Programmazione

- progetto

- istruzioni

- protezione

- fornire

- purché

- fornisce

- fornitura

- Acquista

- fini

- Python

- qualità

- Domande

- abbastanza

- RAIN

- gamma

- rapidamente

- piuttosto

- Leggi

- Lettura

- ricevuto

- Consigli

- ridurre

- riducendo

- raffinazione

- Basic

- rilasciare

- pertinente

- rispondere

- rappresentare

- richiesta

- necessario

- richiede

- risposta

- risposte

- REST

- colpevole

- ritorno

- di ritorno

- Riso

- destra

- Anello

- Ruolo

- Correre

- Rurale

- Aree rurali

- s

- sacro

- sicura

- stesso

- SABBIA

- Risparmi

- salvato

- scala

- scena

- Scienze

- Scienziato

- Cerca

- Segreto

- in modo sicuro

- vedere

- select

- Selezione

- semantico

- set

- impostazioni

- lei

- Corti

- dovrebbero

- mostrare attraverso le sue creazioni

- Spettacoli

- significativamente

- simile

- Un'espansione

- semplicemente

- Seduta

- Taglia

- cieli

- So

- alcuni

- piuttosto

- Arrivo

- source

- sud-est

- in particolare

- discorso

- Standard

- inizia a

- iniziato

- Regione / Stato

- state-of-the-art

- conservazione

- Storia

- ruscello

- Corda

- strutturato

- dati strutturati e non strutturati

- Lottando

- Gli studenti

- studio

- Con successo

- tale

- riassumere

- Dom.

- luce del sole

- sicuro

- sorpresa

- sistema

- T

- task

- Consulenza

- tecniche

- Tecnologie

- Tecnologia

- telecomunicazione

- testo

- generazione di testo

- Text-to-Speech

- testuale

- Tailandia

- di

- che

- I

- Filippine

- loro

- Li

- poi

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- think

- questo

- quelli

- Attraverso

- tempo

- a

- insieme

- token

- tradizionale

- Treni

- Training

- Trascrizione

- Trasformazione

- trasformazione

- tradurre

- Traduzione

- Traduzioni

- Alberi

- troll

- vero

- lezione

- Due volte

- Digitare

- Tipi di

- tipicamente

- e una comprensione reciproca

- inteso

- a differenza di

- non strutturati

- urdu

- URL

- us

- utilizzabile

- USD

- uso

- utilizzato

- Utente

- user-friendly

- utenti

- utilizzando

- APPREZZIAMO

- Valori

- variabile

- variabili

- vario

- Ve

- vettori

- VEGAS

- versione

- vitale

- Video

- Vietnam

- Visualizza

- visione

- Voce

- volumi

- In attesa

- a piedi

- volere

- Prima

- we

- WELL

- Che

- Che cosa è l'

- quale

- Sussurro

- bianca

- OMS

- perché

- Wi-fi

- largo

- Vasta gamma

- volere

- con

- entro

- donna

- meraviglioso

- Lavora

- lavorare insieme

- mondo

- scrivere

- scrittura

- anno

- Tu

- giovane

- Trasferimento da aeroporto a Sharm

- youtube

- zefiro