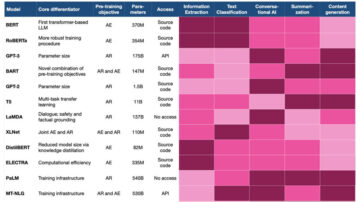

I Large Language Models (LLM) rappresentano una sfida unica quando si tratta di valutazione delle prestazioni. A differenza del tradizionale apprendimento automatico in cui i risultati sono spesso binari, i risultati del LLM si collocano in uno spettro di correttezza. Inoltre, sebbene il tuo modello base possa eccellere in parametri generali, le prestazioni generali non garantiscono prestazioni ottimali per i tuoi casi d'uso specifici.

Pertanto, un approccio olistico alla valutazione degli LLM deve utilizzare una varietà di approcci, come l'utilizzo di LLM per valutare gli LLM (ovvero l'autovalutazione) e l'utilizzo di approcci ibridi uomo-LLM. Questo articolo approfondisce le fasi specifiche dei diversi metodi, spiegando come creare set di valutazione personalizzati su misura per la tua applicazione, individuare metriche rilevanti e implementare metodi di valutazione rigorosi, sia per la selezione dei modelli che per il monitoraggio delle prestazioni in corso nella produzione.

Crea set di valutazione mirati per i tuoi casi d'uso

Per valutare le prestazioni di un LLM su un caso d'uso specifico, è necessario testare il modello su una serie di esempi rappresentativi dei casi d'uso target. Ciò richiede la creazione di un set di valutazione personalizzato.

- Inizia in piccolo. Per testare le prestazioni LLM nel tuo caso d'uso, puoi iniziare con un minimo di 10 esempi. Ciascuno di questi esempi può essere eseguito più volte per valutare la coerenza e l'affidabilità del modello.

- Raccogli esempi stimolanti. Gli esempi che scegli non dovrebbero essere semplici. Dovrebbero essere stimolanti, progettati per testare al massimo la capacità del modello. Ciò potrebbe includere suggerimenti con input inaspettati, domande che potrebbero indurre pregiudizi o domande che richiedono una profonda comprensione dell'argomento. Non si tratta di ingannare il modello, ma piuttosto di assicurarsi che sia preparato per la natura imprevedibile delle applicazioni del mondo reale.

- Prendi in considerazione l'utilizzo degli LLM per creare un set di valutazione. È interessante notare che è una pratica comune sfruttare i modelli linguistici per creare set di valutazione per valutare se stessi o altri modelli linguistici. Ad esempio, un LLM può generare una serie di coppie di domande e risposte basate su un testo di input, che puoi utilizzare come primo lotto di campioni per la tua applicazione di risposta alle domande.

- Incorpora il feedback degli utenti. Che si tratti di test interni del team o di un'implementazione più ampia, il feedback degli utenti spesso rivela sfide impreviste e scenari reali. Tale feedback può essere integrato come nuovi esempi stimolanti nei tuoi set di valutazione.

In sostanza, la creazione di un set di valutazione personalizzato è un processo dinamico, che si adatta e cresce di pari passo con il ciclo di vita del progetto LLM. Questa metodologia iterativa garantisce che il tuo modello rimanga in sintonia con le sfide attuali e rilevanti.

Combina metriche, confronti e valutazione basata su criteri

Le sole metriche sono generalmente insufficienti per valutare gli LLM. Gli LLM operano in un ambito in cui non esiste sempre un'unica risposta "corretta". Inoltre, l’utilizzo di parametri aggregati può essere fuorviante. Un modello potrebbe eccellere in un ambito e vacillare in un altro, registrando comunque un punteggio medio impressionante.

I tuoi criteri di valutazione dipenderanno dagli attributi distinti del particolare sistema LLM. Sebbene l’accuratezza e l’imparzialità siano obiettivi comuni, altri criteri potrebbero essere fondamentali in scenari specifici. Ad esempio, un chatbot medico può dare priorità all’innocuità della risposta, un bot dell’assistenza clienti potrebbe enfatizzare il mantenimento di un tono amichevole e coerente, oppure un’applicazione di sviluppo web potrebbe richiedere output in un formato specifico.

Per snellire il processo, più criteri di valutazione possono essere integrati in uno unico funzione di feedback. Prenderà come input il testo generato da un LLM e alcuni metadati, quindi restituirà un punteggio che indica la qualità del testo.

Pertanto, la valutazione olistica delle prestazioni LLM comporta in genere almeno 3 approcci diversi:

- Metriche quantitative: quando esistono risposte corrette definitive, è possibile utilizzare per impostazione predefinita i metodi di valutazione ML tradizionali approcci quantitativi.

- Confronti di riferimento: Per i casi senza una risposta singolare chiara ma con un riferimento disponibile di risposte accettabili, la risposta del modello può essere confrontata e contrapposta ad esempi preesistenti.

- Valutazione basata su criteri: In assenza di un riferimento, l'attenzione si sposta sulla valutazione dei risultati del modello rispetto ai criteri predefiniti.

Sia i confronti di riferimento che le valutazioni basate su criteri possono essere eseguiti da valutatori umani o attraverso processi automatizzati. Successivamente, approfondiremo i vantaggi e gli svantaggi di questi distinti approcci di valutazione.

Approcci umani, di autovalutazione e ibridi

La valutazione umana è spesso vista come il gold standard per valutare le applicazioni di machine learning, inclusi i sistemi basati su LLM, ma non è sempre fattibile a causa di vincoli temporali o tecnici. Gli approcci di autovalutazione e ibridi vengono spesso utilizzati in contesti aziendali per ridimensionare la valutazione delle prestazioni LLM.

Valutazione umana

Avere una supervisione umana sull'output delle applicazioni basate su LLM è essenziale per garantire l'accuratezza e l'affidabilità di questi sistemi. Tuttavia, fare affidamento esclusivamente su questo approccio per valutare gli LLM potrebbe non essere l'ideale a causa delle seguenti limitazioni chiave:

- Preoccupazioni di qualità: Sorprendentemente, modelli avanzati come GPT-4 spesso producono valutazioni di qualità superiore rispetto ai risultati medi dei lavoratori assunti tramite Mechanical Turk. I valutatori umani, se non guidati da meticolosi disegni sperimentali, potrebbero non concentrarsi sulle qualità fondamentali che contano di più. C'è una propensione a lasciarsi prendere da elementi superficiali; ad esempio, potrebbero preferire una risposta ben formattata ma errata rispetto a una precisa ma presentata in modo chiaro.

- Implicazioni sui costi: Acquisire valutazioni umane di alto livello è costoso. Maggiore è la qualità della valutazione ricercata, maggiori saranno i costi associati.

- Vincoli di tempo: La raccolta delle valutazioni umane richiede molto tempo. Nel frenetico mondo dello sviluppo di sistemi basati su LLM, dove le implementazioni possono avvenire in pochi giorni o settimane, gli sviluppatori non possono sempre permettersi di fermarsi e attendere il feedback.

Questi vincoli sottolineano l’importanza di integrare le valutazioni umane con tecniche di valutazione più efficienti.

Autovalutazione

I grandi modelli linguistici si sono dimostrati abili nel valutare le prestazioni delle loro controparti. In particolare, un LLM più avanzato o più grande può essere utilizzato per valutare le prestazioni di modelli più piccoli. È anche comune utilizzare un LLM per valutare i propri risultati. Considerati i meccanismi degli LLM, un modello potrebbe inizialmente fornire una risposta errata. Tuttavia, fornendo allo stesso modello un suggerimento strategicamente elaborato che richiede una valutazione della sua risposta iniziale, il modello ottiene effettivamente l’opportunità di “riflettere” o “ripensare”. Questa procedura aumenta sostanzialmente la probabilità che il modello identifichi eventuali errori.

L'utilizzo di LLM per valutare altri LLM offre un'alternativa rapida ed economica all'impiego di valutatori umani. Tuttavia, questo metodo presenta insidie critiche che i leader aziendali e tecnologici devono essere pronti ad affrontare:

- Quando viene incaricato di valutare una risposta su una scala da 1 a 5, i LLM potrebbero farlo mostrano un pregiudizio coerente verso una valutazione specifica, indipendentemente dall'effettiva qualità della risposta.

- Quando si confronta la propria produzione con quella di altri modelli, un LLM in genere mostra una preferenza per la propria risposta.

- La sequenza dei candidati alla risposta può occasionalmente influenzare la valutazione, come ad esempio, dimostrare una preferenza per la prima risposta del candidato visualizzata.

- Gli LLM tendono a farlo preferire risposte più lunghe, anche se contengono errori fattuali o sono più difficili da comprendere e utilizzare per gli utenti umani.

Date le imperfezioni inerenti alle valutazioni LLM, l'incorporazione strategica della supervisione manuale da parte di valutatori umani rimane un passaggio consigliabile e non dovrebbe essere omesso dal processo di sviluppo dell'applicazione LLM.

Approccio ibrido

L'approccio prevalente prevede che gli sviluppatori si affidino fortemente alle valutazioni automatiche agevolate dai LLM. Ciò li dota di un meccanismo di feedback immediato, consentendo una rapida selezione del modello, messa a punto e sperimentazione con vari suggerimenti di sistema. L'obiettivo è ottenere un sistema con prestazioni ottimali basato su queste valutazioni automatiche. Una volta completata la fase di valutazione automatizzata, il passaggio successivo prevede in genere un'analisi più approfondita con valutatori umani di alta qualità per convalidare l'affidabilità dell'autovalutazione.

Garantire valutazioni umane di alta qualità può essere un’impresa costosa. Sebbene non sia pragmatico ricorrere a questo livello di controllo dopo ogni piccolo perfezionamento del sistema, la valutazione umana è una fase indispensabile prima della transizione di un sistema LLM in un ambiente di produzione. Come notato in precedenza, le valutazioni dei LLM possono manifestare pregiudizi ed essere inaffidabili.

Dopo la distribuzione, è fondamentale raccogliere feedback genuini dagli utenti finali delle nostre applicazioni basate su LLM. Il feedback può essere semplice come chiedere agli utenti di valutare una risposta come utile (pollice su) o non utile (pollice giù), ma idealmente dovrebbe essere accompagnato da commenti dettagliati che evidenzino i punti di forza e i difetti delle risposte del modello.

Gli aggiornamenti del modello fondamentale o i cambiamenti nelle query degli utenti potrebbero inavvertitamente ridurre le prestazioni dell'applicazione o esporre punti deboli latenti. Il monitoraggio continuo delle prestazioni dell'applicazione LLM rispetto ai criteri da noi definiti rimane fondamentale per tutta la sua vita operativa in modo da poter identificare e risolvere rapidamente le carenze emergenti. .

Punti chiave

La valutazione delle prestazioni dei sistemi basati su LLM presenta sfide uniche, distinguendo l'attività dalle valutazioni convenzionali dell'apprendimento automatico. Nel processo di valutazione di un sistema LLM, è necessario prendere in considerazione le seguenti considerazioni critiche per informare la metodologia:

- Set di valutazione personalizzati: per ricavare informazioni utili, è fondamentale costruire set di valutazione robusti e incentrati sull'applicazione. Questi set non devono necessariamente essere grandi, ma dovrebbero comprendere una gamma di campioni impegnativi.

- Espansione dinamica delle sfide di valutazione: man mano che ricevi feedback dagli utenti, è fondamentale espandere e perfezionare in modo iterativo il set di valutazione per cogliere sfide e sfumature in evoluzione.

- Metriche quantitative e criteri qualitativi: La natura intricata degli LLM spesso sfugge a semplici parametri quantitativi. È essenziale stabilire una serie di criteri su misura per il tuo caso d'uso specifico, consentendo una valutazione più sfumata delle prestazioni del modello.

- Funzione di feedback unificato: Per semplificare il processo di valutazione, si consideri la possibilità di combinare più criteri in un'unica e coerente funzione di feedback.

- Approccio di valutazione ibrido: Sfruttare sia i LLM che i valutatori umani di alta qualità nel processo di valutazione offre una prospettiva più completa e produce i risultati più affidabili ed economici.

- Monitoraggio continuo del mondo reale: Unendo il feedback degli utenti con la funzione di feedback unificato, è possibile monitorare e ottimizzare continuamente le prestazioni LLM, garantendo un allineamento coerente con i requisiti del mondo reale.

Ti piace questo articolo? Iscriviti per ulteriori aggiornamenti sulla ricerca AI.

Ti faremo sapere quando pubblicheremo altri articoli di riepilogo come questo.

Leggi Anche

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Automobilistico/VE, Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Grafico Prime. Migliora il tuo gioco di trading con ChartPrime. Accedi qui.

- BlockOffset. Modernizzare la proprietà della compensazione ambientale. Accedi qui.

- Fonte: https://www.topbots.com/llm-performance-evaluation/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- a

- WRI

- accettabile

- accompagnati

- Il mio account

- precisione

- preciso

- Raggiungere

- l'acquisizione di

- presenti

- indirizzo

- Avanzate

- vantaggi

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- aggregato

- AI

- ricerca ai

- Consentire

- da solo

- anche

- alternativa

- sempre

- an

- ed

- Un altro

- rispondere

- risposte

- in qualsiasi

- a parte

- Applicazioni

- Sviluppo di applicazioni

- applicazioni

- approccio

- approcci

- SONO

- articolo

- news

- AS

- valutare

- valutazione

- associato

- At

- gli attributi

- Automatizzata

- Automatico

- disponibile

- media

- attendere

- base

- basato

- BE

- prima

- Al di là di

- pregiudizi

- aumenta

- Bot

- entrambi

- ampio

- Costruzione

- affari

- ma

- by

- Materiale

- candidato

- i candidati

- Ultra-Grande

- catturare

- Custodie

- casi

- catturati

- Challenge

- sfide

- impegnativo

- chatbot

- Scegli

- COERENTE

- Raccolta

- combinando

- viene

- Commenti

- Uncommon

- rispetto

- confronto

- Completato

- globale

- Prendere in considerazione

- Considerazioni

- coerente

- vincoli

- costruire

- continuamente

- convenzionale

- Nucleo

- correggere

- costo effettivo

- costoso

- Costi

- potuto

- copertura

- creare

- criteri

- critico

- cruciale

- Corrente

- costume

- cliente

- Assistenza clienti

- Giorni

- deep

- più profondo

- Predefinito

- definito

- definitivo

- dimostrando

- deployment

- implementazioni

- progettato

- disegni

- dettagliati

- sviluppatori

- Mercato

- diverso

- visualizzati

- distinto

- non

- dominio

- Dont

- giù

- inconvenienti

- dovuto

- dinamico

- e

- ogni

- In precedenza

- in maniera efficace

- efficiente

- o

- elementi

- emergenti del mondo

- enfatizzare

- consentendo

- circondare

- sforzarsi

- assicura

- assicurando

- Impresa

- Ambiente

- errori

- essenza

- essential

- stabilire

- Etere (ETH)

- valutare

- la valutazione

- valutazione

- valutazioni

- Anche

- Ogni

- evoluzione

- esempio

- Esempi

- Excel

- eseguito

- esistere

- Espandere

- espansione

- costoso

- sperimentale

- facilitato

- Factual

- falena

- fast-paced

- favorire

- fattibile

- feedback

- pochi

- Nome

- Focus

- i seguenti

- Nel

- formato

- frequentemente

- amichevole

- da

- function

- Inoltre

- raccogliere

- Generale

- generalmente

- generare

- generato

- genuino

- ottenere

- dato

- scopo

- Oro

- Gold Standard

- Crescita

- di garanzia

- accadere

- Più forte

- Sfruttamento

- Avere

- avendo

- pesantemente

- alta qualità

- superiore

- mettendo in evidenza

- olistica

- Come

- Tutorial

- Tuttavia

- HTTPS

- umano

- IBRIDO

- i

- ideale

- idealmente

- identificare

- identificazione

- if

- immediato

- imperativo

- realizzare

- importanza

- impressionante

- in

- includere

- incluso

- indica

- far sapere

- inerente

- inizialmente

- inizialmente

- ingresso

- Ingressi

- intuizioni

- esempio

- integrato

- interno

- ai miglioramenti

- IT

- SUO

- stessa

- jpg

- Le

- Sapere

- Lingua

- grandi

- superiore, se assunto singolarmente.

- capi

- apprendimento

- meno

- Livello

- Leva

- leveraging

- Vita

- ciclo di vita

- piace

- probabilità

- limiti

- LLP

- più a lungo

- macchina

- machine learning

- mantenimento

- Manuale

- Importanza

- max-width

- Maggio..

- meccanico

- meccanica

- meccanismo

- medicale

- semplice

- fusione

- Metadati

- metodo

- Metodologia

- metodi

- meticoloso

- Metrica

- forza

- minore

- ingannevole

- ML

- modello

- modelli

- Monitorare

- monitoraggio

- Scopri di più

- più efficiente

- maggior parte

- multiplo

- devono obbligatoriamente:

- Natura

- necessariamente

- Bisogno

- New

- GENERAZIONE

- segnatamente

- noto

- Obiettivi d'Esame

- of

- Offerte

- di frequente

- on

- una volta

- ONE

- in corso

- operare

- operativa

- Opportunità

- ottimale

- or

- Altro

- nostro

- risultati

- produzione

- ancora

- svista

- proprio

- coppie

- supremo

- particolare

- pausa

- performance

- esecuzione

- prospettiva

- fase

- Platone

- Platone Data Intelligence

- PlatoneDati

- pratica

- pragmatico

- preparato

- presenti

- presentata

- presents

- Dare priorità

- procedura

- processi

- i processi

- produrre

- Produzione

- progetti

- comprovata

- fornire

- Domande e risposte

- qualitativo

- qualità

- qualità

- quantitativo

- query

- Domande

- rapidamente

- gamma

- tasso

- piuttosto

- valutazione

- mondo reale

- regno

- ricevere

- raffinare

- Indipendentemente

- registro

- rilasciare

- pertinente

- problemi di

- affidabile

- basandosi

- resti

- rappresentante

- richieste

- richiedere

- Requisiti

- richiede

- riparazioni

- Resort

- risposta

- risposte

- Risultati

- Rivela

- rigoroso

- robusto

- Correre

- stesso

- Scala

- Scenari

- Punto

- scrutinio

- Cercare

- Selezione

- prodotti

- sequenziamento

- set

- Set

- regolazione

- impostazioni

- Turni

- carenze

- dovrebbero

- segno

- Un'espansione

- semplificare

- singolare

- inferiore

- So

- unicamente

- alcuni

- specifico

- Spettro

- Standard

- inizia a

- step

- Passi

- Ancora

- lineare

- Strategico

- strategicamente

- snellire

- punti di forza

- soggetto

- sostanzialmente

- tale

- SOMMARIO

- superiore

- supporto

- SWIFT

- sistema

- SISTEMI DI TRATTAMENTO

- su misura

- Fai

- preso

- Tandem

- Target

- mirata

- Task

- team

- Consulenza

- tecniche

- Tecnologia

- test

- Testing

- che

- Il

- loro

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- questo

- Attraverso

- per tutto

- richiede tempo

- volte

- a

- TONE

- TOPBOT

- verso

- tradizionale

- transizione

- tipicamente

- capire

- e una comprensione reciproca

- Inaspettato

- imprevisto

- unificato

- unico

- a differenza di

- imprevedibile

- Aggiornamenti

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- utilizzando

- generalmente

- utilizzare

- utilizzati

- CONVALIDARE

- varietà

- via

- visti

- we

- sito web

- Sviluppo Web

- Settimane

- quando

- se

- quale

- while

- più ampia

- volere

- con

- entro

- senza

- lavoratori

- mondo

- ancora

- i rendimenti

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro