Gli Stati Uniti, il Regno Unito, l’Australia e altri 15 paesi hanno pubblicato linee guida globali per aiutare a proteggere i modelli di intelligenza artificiale da eventuali manomissioni, esortando le aziende a rendere i loro modelli “sicuri fin dalla progettazione”.

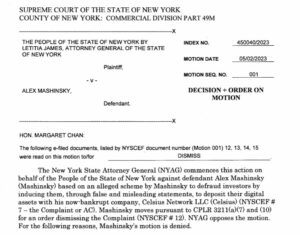

Il 26 novembre, i 18 paesi hanno pubblicato un documento di 20 pagine documento delineando come le aziende di intelligenza artificiale dovrebbero gestire la propria sicurezza informatica quando sviluppano o utilizzano modelli di intelligenza artificiale, poiché affermano che "la sicurezza può spesso essere una considerazione secondaria" in un settore in rapida evoluzione.

Le linee guida consistevano in raccomandazioni per lo più generali come mantenere uno stretto controllo sull’infrastruttura del modello di intelligenza artificiale, monitorare eventuali manomissioni dei modelli prima e dopo il rilascio e formare il personale sui rischi per la sicurezza informatica.

Novità entusiasmanti! Abbiamo unito le forze con @NCSC e 21 partner internazionali per sviluppare le “Linee guida per lo sviluppo di sistemi di intelligenza artificiale sicuri”! Questa è la collaborazione operativa in azione per un’intelligenza artificiale sicura nell’era digitale: https://t.co/DimUhZGW4R#AISicurezza #SecureByDesign pic.twitter.com/e0sv5ACiC3

— Agenzia per la sicurezza informatica e le infrastrutture (@CISAgov) 27 Novembre 2023

Non sono state menzionate alcune questioni controverse nello spazio dell’intelligenza artificiale, inclusi i possibili controlli che dovrebbero esserci sull’uso modelli generatori di immagini e falsi profondi o metodi di raccolta dati e utilizzo nei modelli di training: un problema riscontrato diverse aziende di intelligenza artificiale hanno fatto causa sulle denunce di violazione del copyright.

“Siamo a un punto di svolta nello sviluppo dell’intelligenza artificiale, che potrebbe essere la tecnologia più importante del nostro tempo”, ha affermato il segretario americano per la sicurezza interna Alejandro Mayorkas. disse in una dichiarazione. “La sicurezza informatica è fondamentale per costruire sistemi di intelligenza artificiale sicuri, protetti e affidabili”.

Le linee guida seguono altre iniziative governative che influiscono sull’intelligenza artificiale, compresi i governi e le aziende di intelligenza artificiale riunione per un vertice sulla sicurezza dell'intelligenza artificiale a Londra all’inizio di questo mese per coordinare un accordo sullo sviluppo dell’intelligenza artificiale.

Nel frattempo, l’Unione Europea lo è svelare i dettagli del suo AI Act che supervisionerà lo spazio e il presidente degli Stati Uniti Joe Biden in ottobre ha emesso un ordine esecutivo che fissa gli standard per la sicurezza e la protezione dell’IA, sebbene entrambi hanno visto respingimenti dal settore dell’intelligenza artificiale sostenendo che potrebbero soffocare l’innovazione.

Altri cofirmatari delle nuove linee guida “secure by design” includono Canada, Francia, Germania, Israele, Italia, Giappone, Nuova Zelanda, Nigeria, Norvegia, Corea del Sud e Singapore. Anche le aziende di intelligenza artificiale, tra cui OpenAI, Microsoft, Google, Anthropic e Scale AI, hanno contribuito allo sviluppo delle linee guida.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://cointelegraph.com/news/us-britain-countries-ink-ai-cybersecurity-guidelines-secure-by-design

- :È

- 15%

- 26

- 27

- a

- Legge

- Action

- Dopo shavasana, sedersi in silenzio; saluti;

- agenzia

- Accordo

- AI

- Legge sull'IA

- Modelli AI

- Sistemi di intelligenza artificiale

- anche

- an

- ed

- e infrastruttura

- Antropico

- in qualsiasi

- SONO

- in giro

- artificiale

- intelligenza artificiale

- AS

- At

- Australia

- Vasca

- BE

- prima

- essendo

- Biden

- entrambi

- Gran Bretagna

- Costruzione

- by

- Materiale

- Canada

- certo

- rivendicato

- sostenendo

- coalizione

- Cointelegraph

- collaborazione

- collezione

- Aziende

- consequenziale

- contribuito

- controlli

- coordinare

- copyright

- violazione del copyright

- potuto

- paesi

- crypto

- Cybersecurity

- Cybersecurity and Infrastructure Security Agency

- dati

- deep

- Design

- sviluppare

- in via di sviluppo

- Mercato

- digitale

- era digitale

- In precedenza

- bordo

- EU

- europeo

- Unione europea

- esecutivo

- ordine esecutivo

- occhio

- fast-paced

- Aziende

- seguire

- Nel

- Forze

- Francia

- da

- Generale

- Germania

- globali

- Enti Pubblici

- I governi

- linee guida

- maniglia

- Avere

- Aiuto

- patria

- Homeland Security

- Come

- HTTPS

- in

- includere

- Compreso

- industria

- Inflessione

- Punto di flessione

- Infrastruttura

- infrazione

- iniziative

- Innovazione

- Intelligence

- Internazionale

- Israele

- problema

- Rilasciato

- sicurezza

- Italia

- SUO

- Giappone

- joe

- Joe Biden

- congiunto

- jpg

- Le

- Regno

- Corea

- Londra

- mantenimento

- make

- Maggio..

- menzionato

- metodi

- Microsoft

- modelli

- monitoraggio

- Mese

- maggior parte

- soprattutto

- NCSC

- New

- Nuova Zelanda

- Nigeria

- Norvegia

- novembre

- ottobre

- of

- di frequente

- on

- OpenAI

- operativa

- or

- minimo

- Altro

- nostro

- su

- delineando

- sorvegliare

- partner

- Platone

- Platone Data Intelligence

- PlatoneDati

- punto

- possibile

- Presidente

- presidente joe biden

- protegge

- di rose

- raccomandazioni

- rilasciare

- rilasciato

- rischi

- Rivale

- s

- sicura

- Sicurezza

- Sicurezza

- Scala

- scala ai

- secondario

- segretario

- sicuro

- problemi di

- visto

- set

- dovrebbero

- Singapore

- Sud

- Corea del Sud

- lo spazio

- STAFF

- standard

- dichiarazione

- stati

- soffocare

- tale

- sistema

- SISTEMI DI TRATTAMENTO

- Tech

- Tecnologia

- che

- Il

- loro

- Là.

- di

- questo

- anche se?

- tempo

- a

- Training

- affidabili sul mercato

- noi

- unione

- Unito

- UK

- Stati Uniti

- sollecitando

- us

- uso

- usa

- utilizzando

- avverte

- we

- pesare

- WELL

- sono stati

- Che

- quando

- quale

- volere

- con

- Zelanda

- zefiro