Le applicazioni di intelligenza artificiale generativa (AI) costruite attorno a modelli linguistici di grandi dimensioni (LLM) hanno dimostrato il potenziale per creare e accelerare il valore economico per le imprese. Esempi di applicazioni includono ricerca conversazionale, assistenza dell'agente dell'assistenza clienti, analisi dell'assistenza clienti, assistenti virtuali self-service, chatbots, generazione di contenuti multimediali ricchi, moderazione dei contenuti, compagni di codifica per accelerare lo sviluppo di software sicuro e ad alte prestazioni, approfondimenti più approfonditi da fonti di contenuto multimodali, accelerazione delle indagini e delle mitigazioni della sicurezza della vostra organizzazione, e altro ancora. Molti clienti sono alla ricerca di indicazioni su come gestire la sicurezza, la privacy e la conformità mentre sviluppano applicazioni di intelligenza artificiale generativa. Comprendere e affrontare le vulnerabilità, le minacce e i rischi del LLM durante le fasi di progettazione e architettura aiuta i team a concentrarsi sulla massimizzazione dei vantaggi economici e di produttività che l'intelligenza artificiale generativa può apportare. Essere consapevoli dei rischi favorisce la trasparenza e la fiducia nelle applicazioni di intelligenza artificiale generativa, incoraggia una maggiore osservabilità, aiuta a soddisfare i requisiti di conformità e facilita il processo decisionale informato da parte dei leader.

L'obiettivo di questo post è consentire agli ingegneri dell'AI e dell'apprendimento automatico (ML), ai data scientist, ai solution architect, ai team di sicurezza e ad altre parti interessate di avere un modello mentale e un framework comuni per applicare le migliori pratiche di sicurezza, consentendo ai team di AI/ML di muoversi veloce senza sacrificare la sicurezza per la velocità. Nello specifico, questo post cerca di aiutare i data scientist e l'intelligenza artificiale che potrebbero non essere stati precedentemente esposti ai principi di sicurezza ad acquisire una comprensione delle migliori pratiche fondamentali in materia di sicurezza e privacy nel contesto dello sviluppo di applicazioni di intelligenza artificiale generativa utilizzando LLM. Discutiamo anche delle preoccupazioni comuni in materia di sicurezza che possono minare la fiducia nell'intelligenza artificiale, come identificato dal Top 10 dei progetti OWASP (Worldwide Application Security Project) aperti per le applicazioni LLMe mostra come utilizzare AWS per aumentare il tuo livello di sicurezza e la tua sicurezza innovando con l'intelligenza artificiale generativa.

Questo post fornisce tre passaggi guidati per progettare strategie di gestione del rischio durante lo sviluppo di applicazioni di intelligenza artificiale generativa utilizzando LLM. Innanzitutto approfondiamo le vulnerabilità, le minacce e i rischi che derivano dall'implementazione, dalla distribuzione e dall'uso delle soluzioni LLM e forniamo indicazioni su come iniziare a innovare pensando alla sicurezza. Discuteremo quindi di come costruire su basi sicure sia essenziale per l’intelligenza artificiale generativa. Infine, li colleghiamo insieme a un carico di lavoro LLM di esempio per descrivere un approccio all'architettura con una sicurezza di difesa approfondita oltre i confini della fiducia.

Entro la fine di questo post, Gli ingegneri AI/ML, i data scientist e gli esperti di tecnologia attenti alla sicurezza saranno in grado di identificare strategie per progettare difese a più livelli per le loro applicazioni di intelligenza artificiale generativa, capire come mappare la Top 10 OWASP per i problemi di sicurezza LLM ad alcuni controlli corrispondenti e costruire conoscenze fondamentali verso rispondendo ai seguenti temi principali delle domande dei clienti AWS per le loro applicazioni:

- Quali sono alcuni dei rischi comuni per la sicurezza e la privacy legati all'utilizzo dell'intelligenza artificiale generativa basata su LLM nelle mie applicazioni che posso influenzare maggiormente con questa guida?

- Quali sono alcuni modi per implementare controlli di sicurezza e privacy nel ciclo di vita di sviluppo per applicazioni LLM di intelligenza artificiale generativa su AWS?

- Quali best practice operative e tecniche posso integrare nel modo in cui la mia organizzazione crea applicazioni LLM di intelligenza artificiale generativa per gestire i rischi e aumentare la fiducia nelle applicazioni di intelligenza artificiale generativa che utilizzano LLM?

Migliora i risultati in termini di sicurezza sviluppando al contempo l'intelligenza artificiale generativa

L’innovazione con l’intelligenza artificiale generativa utilizzando LLM richiede di iniziare pensando alla sicurezza per sviluppare la resilienza organizzativa, costruire su basi sicure e integrare la sicurezza con un approccio di difesa approfondito. La sicurezza è un responsabilità condivisa tra AWS e i clienti AWS. Tutti i principi del modello di responsabilità condivisa di AWS sono applicabili alle soluzioni di IA generativa. Aggiorna la tua comprensione del modello di responsabilità condivisa di AWS applicato a infrastrutture, servizi e dati quando crei soluzioni LLM.

Inizia pensando alla sicurezza per sviluppare la resilienza organizzativa

Inizia pensando alla sicurezza per sviluppare la resilienza organizzativa per lo sviluppo di applicazioni di intelligenza artificiale generativa che soddisfino i tuoi obiettivi di sicurezza e conformità. La resilienza organizzativa attinge ed estende il definizione di resilienza nel Canone di architettura AWS per includere e preparare la capacità di un’organizzazione di riprendersi dalle interruzioni. Considera il tuo livello di sicurezza, la governance e l'eccellenza operativa quando valuti la preparazione generale per sviluppare un'intelligenza artificiale generativa con LLM e la resilienza della tua organizzazione a qualsiasi potenziale impatto. Man mano che la tua organizzazione avanza nell’uso di tecnologie emergenti come l’intelligenza artificiale generativa e i LLM, la resilienza organizzativa complessiva dovrebbe essere considerata come la pietra angolare di una strategia difensiva a più livelli per proteggere risorse e linee di business da conseguenze indesiderate.

La resilienza organizzativa è importante per le applicazioni LLM

Sebbene tutti i programmi di gestione del rischio possano trarre vantaggio dalla resilienza, la resilienza organizzativa è fondamentale per l’intelligenza artificiale generativa. Cinque dei 10 principali rischi identificati da OWASP per le applicazioni LLM si basano sulla definizione di controlli architettonici e operativi e sulla loro applicazione su scala organizzativa al fine di gestire il rischio. Questi cinque rischi sono la gestione insicura dell’output, le vulnerabilità della catena di fornitura, la divulgazione di informazioni sensibili, l’eccessiva agenzia e l’eccessiva dipendenza. Inizia ad aumentare la resilienza organizzativa socializzando i tuoi team affinché considerino la sicurezza dell'intelligenza artificiale, del machine learning e dell'intelligenza artificiale generativa un requisito fondamentale del business e una priorità assoluta durante l'intero ciclo di vita del prodotto, dall'ideazione, alla ricerca, allo sviluppo dell'applicazione, alla distribuzione e alla utilizzo. Oltre alla consapevolezza, i tuoi team dovrebbero agire per tenere conto dell'intelligenza artificiale generativa nelle pratiche di governance, garanzia e convalida della conformità.

Costruisci la resilienza organizzativa attorno all'intelligenza artificiale generativa

Le organizzazioni possono iniziare ad adottare modi per sviluppare le proprie capacità e capacità per l’AI/ML e la sicurezza dell’intelligenza artificiale generativa all’interno delle proprie organizzazioni. Dovresti iniziare estendendo i programmi di sicurezza, garanzia, conformità e sviluppo esistenti per tenere conto dell’intelligenza artificiale generativa.

Di seguito sono riportate le cinque aree chiave di interesse per l'AI organizzativa, il ML e la sicurezza dell'IA generativa:

- Comprendere il panorama della sicurezza AI/ML

- Includere diverse prospettive nelle strategie di sicurezza

- Agire in modo proattivo per garantire le attività di ricerca e sviluppo

- Allineare gli incentivi ai risultati organizzativi

- Preparati a scenari di sicurezza realistici in AI/ML e AI generativa

Sviluppa un modello di minaccia durante l'intero ciclo di vita dell'intelligenza artificiale generativa

Le organizzazioni che costruiscono con l’intelligenza artificiale generativa dovrebbero concentrarsi sulla gestione del rischio, non sull’eliminazione del rischio, e includere modellazione delle minacce e pianificazione della continuità aziendale la pianificazione, lo sviluppo e le operazioni di carichi di lavoro di intelligenza artificiale generativa. Lavorare a ritroso rispetto all’utilizzo in produzione dell’IA generativa sviluppando un modello di minaccia per ciascuna applicazione utilizzando i tradizionali rischi per la sicurezza e i rischi specifici dell’IA generativa. Alcuni rischi possono essere accettabili per la tua azienda e un esercizio di modellazione delle minacce può aiutare la tua azienda a identificare qual è la tua propensione al rischio accettabile. Ad esempio, la tua azienda potrebbe non richiedere un tempo di attività del 99.999% su un'applicazione di intelligenza artificiale generativa, quindi il tempo di ripristino aggiuntivo associato al ripristino utilizzando Backup AWS con Ghiacciaio Amazon S3 può essere un rischio accettabile. Al contrario, i dati nel modello potrebbero essere estremamente sensibili e altamente regolamentati, quindi deviazione da Servizio di gestione delle chiavi AWS (AWSKMS) chiave gestita dal cliente (CMK) rotazione e utilizzo di Firewall di rete AWS contribuire a far rispettare il Transport Layer Security (TLS) per il traffico in entrata e in uscita per proteggerlo dall'esfiltrazione dei dati potrebbe rappresentare un rischio inaccettabile.

Valutare i rischi (inerenti e residui) dell'utilizzo dell'applicazione di intelligenza artificiale generativa in un ambiente di produzione per identificare i giusti controlli fondamentali e a livello di applicazione. Pianifica tempestivamente il rollback e il ripristino da eventi di sicurezza della produzione e interruzioni del servizio come tempestività di inserimento, addestramento al data-avvelenamento, modello di negazione del servizio e furto di modello e definisci le misure di mitigazione che utilizzerai quando definisci i requisiti dell'applicazione. Conoscere i rischi e i controlli che devono essere messi in atto aiuterà a definire il miglior approccio di implementazione per la creazione di un’applicazione di intelligenza artificiale generativa e fornirà alle parti interessate e ai decisori informazioni per prendere decisioni aziendali informate sui rischi. Se non hai familiarità con il flusso di lavoro generale di AI e ML, inizia con la revisione 7 modi per migliorare la sicurezza dei carichi di lavoro di machine learning per aumentare la familiarità con i controlli di sicurezza necessari per i tradizionali sistemi AI/ML.

Proprio come la creazione di qualsiasi applicazione ML, la creazione di un'applicazione di intelligenza artificiale generativa implica il passaggio attraverso una serie di fasi del ciclo di vita di ricerca e sviluppo. Potresti voler rivedere il Matrice di ambito della sicurezza dell'intelligenza artificiale generativa AWS per aiutare a costruire un modello mentale per comprendere le principali discipline di sicurezza che dovresti considerare a seconda della soluzione di intelligenza artificiale generativa selezionata.

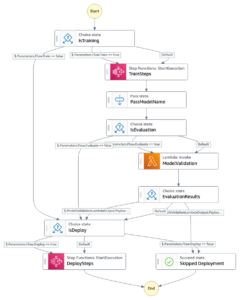

Le applicazioni di intelligenza artificiale generativa che utilizzano LLM vengono generalmente sviluppate e gestite seguendo passaggi ordinati:

- Requisiti delle applicazioni – Identificare gli obiettivi aziendali, i requisiti e i criteri di successo del caso d’uso

- Selezione del modello – Selezionare un modello di base che sia in linea con i requisiti del caso d'uso

- Adattamento e messa a punto del modello – Preparare i dati, ingegnerizzare i suggerimenti e perfezionare il modello

- Valutazione del modello – Valuta i modelli di base con metriche specifiche del caso d'uso e seleziona il modello con le migliori prestazioni

- Distribuzione e integrazione – Distribuisci il modello di base selezionato sulla tua infrastruttura ottimizzata e integralo con la tua applicazione di intelligenza artificiale generativa

- Monitoraggio delle applicazioni – Monitorare le prestazioni dell'applicazione e del modello per consentire l'analisi della causa principale

Assicurati che i team comprendano la natura critica della sicurezza come parte delle fasi di progettazione e architettura del ciclo di vita di sviluppo software sin dal primo giorno. Ciò significa discutere la sicurezza a ogni livello dello stack e del ciclo di vita e posizionare la sicurezza e la privacy come fattori abilitanti per raggiungere gli obiettivi aziendali. Architetta i controlli per le minacce prima di avviare l'applicazione LLM e valuta se i dati e le informazioni che utilizzerai per l'adattamento e il perfezionamento del modello garantiscono l'implementazione dei controlli negli ambienti di ricerca, sviluppo e formazione. Nell'ambito dei test di garanzia della qualità, introdurre minacce sintetiche alla sicurezza (come il tentativo di avvelenare i dati di addestramento o il tentativo di estrarre dati sensibili tramite ingegneria tempestiva dannosa) per testare regolarmente le difese e il livello di sicurezza.

Inoltre, le parti interessate dovrebbero stabilire una cadenza di revisione coerente per i carichi di lavoro di produzione di intelligenza artificiale, machine learning e intelligenza artificiale generativa e stabilire la priorità organizzativa sulla comprensione dei compromessi tra controllo ed errore umano e macchina prima del lancio. La convalida e la garanzia che questi compromessi siano rispettati nelle applicazioni LLM distribuite aumenterà la probabilità di successo nella mitigazione del rischio.

Crea applicazioni di intelligenza artificiale generativa su basi cloud sicure

In AWS, la sicurezza è la nostra massima priorità. AWS è progettato per essere l'infrastruttura cloud globale più sicura su cui creare, migrare e gestire applicazioni e carichi di lavoro. Ciò è supportato dal nostro vasto set di oltre 300 strumenti di sicurezza cloud e dalla fiducia dei nostri milioni di clienti, comprese le organizzazioni più sensibili alla sicurezza come servizi governativi, sanitari e finanziari. Quando crei applicazioni di intelligenza artificiale generativa utilizzando LLM su AWS, ottieni vantaggi in termini di sicurezza da Ambiente di cloud computing AWS sicuro, affidabile e flessibile.

Utilizza un'infrastruttura globale AWS per sicurezza, privacy e conformità

Quando sviluppi applicazioni ad uso intensivo di dati su AWS, puoi beneficiare di un'infrastruttura della regione globale AWS, progettata per fornire funzionalità in grado di soddisfare i tuoi principali requisiti di sicurezza e conformità. Ciò è rafforzato dal ns Impegno di sovranità digitale di AWS, il nostro impegno nell'offrirti il set più avanzato di controlli e funzionalità di sovranità disponibile nel cloud. Ci impegniamo ad espandere le nostre capacità per consentirti di soddisfare le tue esigenze sovranità digitale esigenze, senza compromettere le prestazioni, l'innovazione, la sicurezza o la scalabilità del cloud AWS. Per semplificare l'implementazione delle migliori pratiche in materia di sicurezza e privacy, prendi in considerazione l'utilizzo di progetti di riferimento e infrastrutture come risorse di codice come Architettura di riferimento per la sicurezza AWS (AWS SRA) e la Architettura di riferimento sulla privacy di AWS (AWS PRA). Leggi di più progettare soluzioni per la privacy, sovranità fin dalla progettazionee conformità su AWS e utilizzare servizi come Configurazione AWS, Artefatto AWSe Responsabile dell'audit AWS per supportare le vostre esigenze di privacy, conformità, audit e osservabilità.

Comprendi il tuo livello di sicurezza utilizzando AWS Well-Architected e Cloud Adoption Frameworks

AWS offre linee guida sulle best practice sviluppate in anni di esperienza nel supportare i clienti nell'architettura dei loro ambienti cloud con Framework ben progettato di AWS e nell'evoluzione per realizzare valore aziendale dalle tecnologie cloud con Quadro di adozione del cloud AWS (AWS CAF). Comprendi il livello di sicurezza dei tuoi carichi di lavoro di intelligenza artificiale, machine learning e intelligenza artificiale generativa eseguendo una revisione del framework ben architettato. Le revisioni possono essere eseguite utilizzando strumenti come Strumento AWS ben progettatoo con l'aiuto del tuo team AWS tramite Supporto aziendale AWS. Lo strumento ben progettato di AWS integra automaticamente gli approfondimenti da Consulente affidabile di AWS per valutare quali sono le migliori pratiche in atto e quali opportunità esistono per migliorare la funzionalità e l'ottimizzazione dei costi. Lo strumento AWS Well-Architected offre anche obiettivi personalizzati con best practice specifiche come Obiettivo di apprendimento automatico per consentirti di misurare regolarmente le tue architetture rispetto alle migliori pratiche e identificare le aree di miglioramento. Controlla il tuo viaggio nel percorso verso la realizzazione del valore e la maturità del cloud comprendendo come i clienti AWS adottano strategie per sviluppare capacità organizzative nel Framework di adozione del cloud AWS per intelligenza artificiale, machine learning e intelligenza artificiale generativa. Potresti anche trarre vantaggio dalla comprensione della tua preparazione complessiva al cloud partecipando a un corso Valutazione della preparazione al cloud AWS. AWS offre ulteriori opportunità di coinvolgimento: chiedi al team del tuo account AWS ulteriori informazioni su come iniziare con Centro per l'innovazione dell'IA generativa.

Accelera l'apprendimento in materia di sicurezza e AI/ML con indicazioni, formazione e certificazione sulle best practice

AWS cura anche i consigli di Best practice per sicurezza, identità e conformità ed Documentazione sulla sicurezza di AWS per aiutarti a identificare modi per proteggere i tuoi ambienti operativi, di formazione, di sviluppo, di test. Se hai appena iniziato, approfondisci la formazione e la certificazione sulla sicurezza, valuta la possibilità di iniziare con Fondamenti di sicurezza di AWS e la Piano di apprendimento sulla sicurezza AWS. Puoi anche usare il Modello di maturità della sicurezza AWS per aiutarti a trovare e dare priorità alle migliori attività nelle diverse fasi di maturità su AWS, a partire dai successi rapidi, attraverso fasi fondamentali, efficienti e ottimizzate. Dopo che tu e i tuoi team avrete acquisito una conoscenza di base della sicurezza su AWS, consigliamo vivamente di rivederla Come affrontare la modellazione delle minacce e poi condurre un esercizio di modellazione delle minacce con i tuoi team iniziando con Workshop sulla modellazione delle minacce per i costruttori programma di allenamento. Ce ne sono molti altri Risorse di formazione e certificazione sulla sicurezza AWS a disposizione.

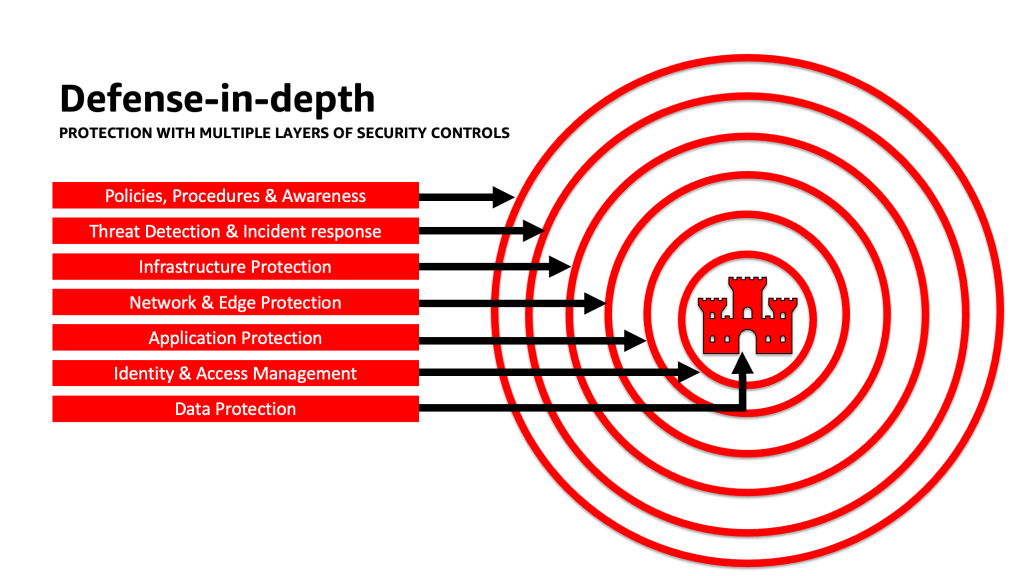

Applica un approccio di difesa approfondito per proteggere le applicazioni LLM

L'applicazione di un approccio di sicurezza di difesa approfondita ai carichi di lavoro, ai dati e alle informazioni dell'intelligenza artificiale generativa può contribuire a creare le migliori condizioni per raggiungere i tuoi obiettivi aziendali. Le best practice di sicurezza approfondite mitigano molti dei rischi comuni che qualsiasi carico di lavoro deve affrontare, aiutando te e i tuoi team ad accelerare l'innovazione dell'intelligenza artificiale generativa. Una strategia di sicurezza di difesa approfondita utilizza più difese ridondanti per proteggere account, carichi di lavoro, dati e risorse AWS. Aiuta a garantire che, se un controllo di sicurezza viene compromesso o fallisce, esistano livelli aggiuntivi per isolare le minacce e prevenire, rilevare, rispondere e ripristinare gli eventi di sicurezza. Puoi utilizzare una combinazione di strategie, inclusi servizi e soluzioni AWS, a ogni livello per migliorare la sicurezza e la resilienza dei tuoi carichi di lavoro di intelligenza artificiale generativa.

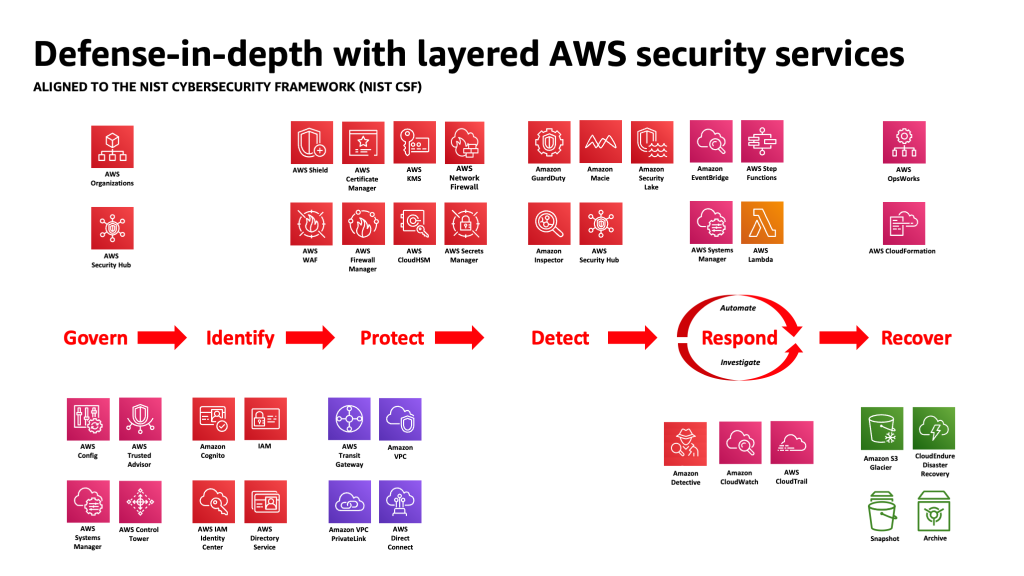

Molti clienti AWS si allineano ai framework standard del settore, come Quadro di sicurezza informatica del NIST. Questo framework aiuta a garantire che le difese di sicurezza siano protette attraverso i pilastri Identificazione, Protezione, Rilevamento, Risposta, Ripristino e, aggiunto più recentemente, Governare. Questo framework può quindi essere facilmente mappato ai servizi di sicurezza AWS e anche a quelli di terze parti integrate per aiutarti a convalidare la copertura e le policy adeguate per qualsiasi evento di sicurezza riscontrato dalla tua organizzazione.

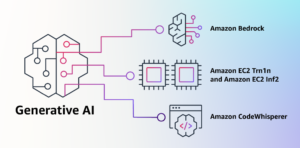

Difesa approfondita: proteggi il tuo ambiente, quindi aggiungi funzionalità avanzate di sicurezza e privacy specifiche per AI/ML

Una strategia di difesa approfondita dovrebbe iniziare proteggendo innanzitutto i tuoi account e la tua organizzazione, quindi aggiungendo funzionalità aggiuntive di sicurezza e privacy integrate aggiuntive di servizi come Roccia Amazzonica ed Amazon Sage Maker. Amazon offre oltre 30 servizi nel portafoglio Sicurezza, Identità e Conformità che sono integrati con i servizi AI/ML di AWS e possono essere utilizzati insieme per proteggere carichi di lavoro, account e organizzazione. Per difendersi adeguatamente dalla OWASP Top 10 per LLM, questi dovrebbero essere utilizzati insieme ai servizi AI/ML di AWS.

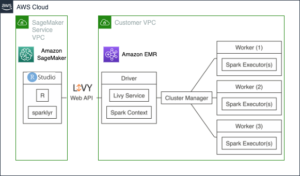

Inizia implementando una politica di privilegio minimo, utilizzando servizi come Analizzatore di accesso IAM a cercare account, ruoli e risorse eccessivamente permissivi per limitare l'accesso utilizzando credenziali a breve termine. Successivamente, assicurati che tutti i dati inattivi siano crittografati con AWS KMS, anche considerando l'uso di CMK, e che tutti i dati e i modelli siano sottoposti a versione e sottoposti a backup utilizzando Servizio di archiviazione semplice Amazon (Amazon S3) controllo delle versioni e applicazione dell'immutabilità a livello di oggetto con Blocco oggetti Amazon S3. Proteggi tutti i dati in transito tra i servizi utilizzando Gestore certificati AWS e / o CA privata AWSe mantenerlo all'interno dei VPC utilizzando Collegamento privato AWS. Definisci regole rigorose per l'ingresso e l'uscita dei dati per proteggere da manipolazioni ed estrazioni utilizzando i VPC Firewall di rete AWS politiche. Prendi in considerazione l'inserimento Firewall applicazione Web AWS (AWS WAF) di fronte a proteggere le applicazioni web e le API da robot dannosi, Attacchi SQL injection, cross-site scripting (XSS), e prese di conto con Controllo delle frodi. Accedere con AWS CloudTrail, Cloud privato virtuale di Amazon (Amazon VPC) log di flusso e Servizio Amazon Elastic Kubernetes (Amazon EKS) contribuiranno a fornire una revisione forense di ogni transazione disponibile per servizi come Detective Amazon. È possibile utilizzare Ispettore Amazon per automatizzare l'individuazione e la gestione delle vulnerabilità Cloud di calcolo elastico di Amazon (Amazon EC2) istanze, contenitori, AWS Lambda funzioni, e identificare la raggiungibilità di rete dei carichi di lavoro. Proteggi i tuoi dati e modelli da attività sospette utilizzando Amazon Guard Dutyi modelli di minacce e i feed di intelligence basati su ML e abilitando le sue funzionalità aggiuntive per protezione EKS, protezione ECS, protezione S3, protezione RDS, protezione da malware, protezione Lambda e altro ancora. Puoi utilizzare servizi come Hub di sicurezza AWS per centralizzare e automatizzare i controlli di sicurezza per rilevare deviazioni dalle migliori pratiche di sicurezza e accelerare le indagini e automatizzare la correzione dei risultati di sicurezza con i playbook. Puoi anche prendere in considerazione l'implementazione di a zero fiducia architettura su AWS per aumentare ulteriormente l'autenticazione granulare e i controlli di autorizzazione per ciò a cui gli utenti umani o i processi da macchina a macchina possono accedere in base alla richiesta. Considera anche l'utilizzo Lago di sicurezza Amazon per centralizzare automaticamente i dati di sicurezza provenienti da ambienti AWS, fornitori SaaS, locali e fonti cloud in un data lake appositamente creato archiviato nel tuo account. Con Security Lake puoi ottenere una comprensione più completa dei dati di sicurezza nell'intera organizzazione.

Dopo che il tuo ambiente di carico di lavoro AI generativo è stato protetto, puoi sovrapporre funzionalità specifiche di AI/ML, come Gestore di dati di Amazon SageMaker identificare potenziali errori durante la preparazione dei dati e Amazon SageMaker Chiarire per rilevare bias nei dati e nei modelli ML. Puoi anche usare Monitor modello Amazon SageMaker per valutare la qualità dei modelli SageMaker ML in produzione e avvisarti in caso di scostamenti nella qualità dei dati, nella qualità del modello e nell'attribuzione delle funzionalità. Questi servizi AWS AI/ML che lavorano insieme (incluso SageMaker che collabora con Amazon Bedrock) con i servizi di sicurezza AWS possono aiutarti a identificare potenziali fonti di pregiudizi naturali e proteggerti dalla manomissione dannosa dei dati. Ripeti questa procedura per ciascuna delle 10 principali vulnerabilità OWASP per LLM per assicurarti di massimizzare il valore dei servizi AWS per implementare una difesa approfondita per proteggere i tuoi dati e carichi di lavoro.

Come ha scritto Clarke Rodgers, AWS Enterprise Strategist, nel suo post sul blog "CISO Insight: ogni servizio AWS è un servizio di sicurezza", "Direi che praticamente ogni servizio all'interno del cloud AWS consente di per sé un risultato di sicurezza o può essere utilizzato (da solo o insieme a uno o più servizi) dai clienti per raggiungere un obiettivo di sicurezza, rischio o conformità." E "I Customer Chief Information Security Officer (CISO) (o i rispettivi team) potrebbero voler prendersi il tempo per assicurarsi di essere esperti di tutti i servizi AWS perché potrebbe esserci un obiettivo di sicurezza, rischio o conformità che può essere raggiunto, anche se un servizio non rientra nella categoria "Sicurezza, identità e conformità".

Difese a livello ai confini del trust nelle applicazioni LLM

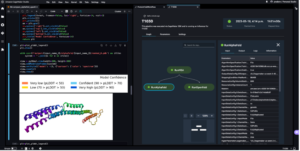

Quando si sviluppano sistemi e applicazioni generativi basati sull'intelligenza artificiale, è necessario considerare le stesse preoccupazioni di qualsiasi altra applicazione ML, come menzionato nella sezione MITRE ATLAS Matrice delle minacce del machine learning, come prestare attenzione alle origini del software e dei componenti dati (come eseguire un audit del software open source, rivedere la distinta base del software (SBOM) e analizzare i flussi di lavoro dei dati e le integrazioni API) e implementare le protezioni necessarie contro le minacce della catena di fornitura LLM. Includi approfondimenti provenienti dai framework di settore e sii consapevole dei modi in cui utilizzare più fonti di intelligence sulle minacce e informazioni sui rischi per adattare ed estendere le tue difese di sicurezza per tenere conto dei rischi per la sicurezza legati all'intelligenza artificiale, al machine learning e all'intelligenza artificiale generativa che sono emergenti e non inclusi nei framework tradizionali. Cerca informazioni complementari sui rischi specifici dell’intelligenza artificiale da fonti dell’industria, della difesa, governative, internazionali e accademiche, perché nuove minacce emergono e si evolvono regolarmente in questo spazio e i framework e le guide complementari vengono aggiornati frequentemente. Ad esempio, quando si utilizza un modello RAG (Retrieval Augmented Generation), se il modello non include i dati necessari, potrebbe richiederli da un'origine dati esterna per l'utilizzo durante l'inferenza e il perfezionamento. La fonte interrogata potrebbe essere fuori dal tuo controllo e rappresentare una potenziale fonte di compromissione nella catena di fornitura. Un approccio di difesa approfondita dovrebbe essere esteso alle fonti esterne per stabilire fiducia, autenticazione, autorizzazione, accesso, sicurezza, privacy e accuratezza dei dati a cui si accede. Per approfondire, leggi “Crea un'applicazione aziendale sicura con l'intelligenza artificiale generativa e RAG utilizzando Amazon SageMaker JumpStart"

Analizza e mitiga i rischi nelle tue applicazioni LLM

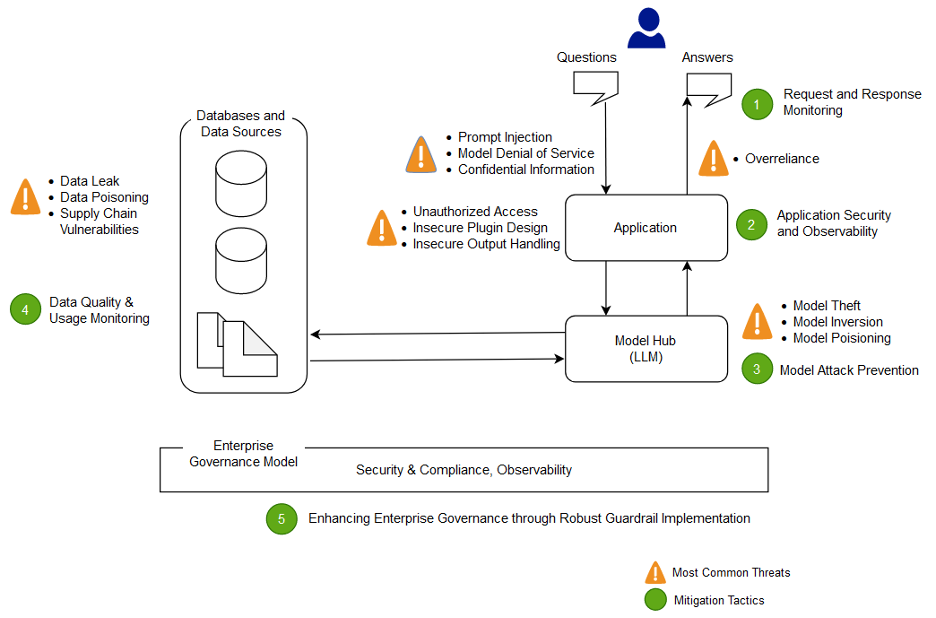

In questa sezione, analizziamo e discutiamo alcune tecniche di mitigazione del rischio basate su confini e interazioni di fiducia, o aree distinte del carico di lavoro con ambito di controlli e profilo di rischio simili e appropriati. In questa architettura di esempio di un'applicazione chatbot, sono presenti cinque limiti di attendibilità in cui vengono dimostrati i controlli, in base al modo in cui i clienti AWS comunemente costruiscono le loro applicazioni LLM. La tua applicazione LLM può avere limiti di fiducia più o meno definibili. Nell'architettura di esempio seguente, questi limiti di attendibilità sono definiti come:

- Interazioni con l'interfaccia utente (richiesta e risposta)

- Interazioni tra applicazioni

- Interazioni del modello

- Interazioni dei dati

- Interazioni organizzative e utilizzo

Interazioni con l'interfaccia utente: sviluppare il monitoraggio delle richieste e delle risposte

Rilevare e rispondere tempestivamente agli incidenti informatici legati all'intelligenza artificiale generativa valutando una strategia per affrontare il rischio derivante dagli input e dagli output dell'applicazione di intelligenza artificiale generativa. Ad esempio, potrebbe essere necessario strumentare un monitoraggio aggiuntivo dei comportamenti e del flusso di dati per rilevare la divulgazione di informazioni sensibili all'esterno del dominio o dell'organizzazione, nel caso in cui vengano utilizzate nell'applicazione LLM.

Le applicazioni di intelligenza artificiale generativa dovrebbero comunque rispettare le migliori pratiche di sicurezza standard quando si tratta di proteggere i dati. Stabilire proteggere il perimetro dei dati ed proteggere gli archivi di dati sensibili. Crittografa i dati e le informazioni utilizzate per le applicazioni LLM inattive e in transito. Proteggi i dati utilizzati per addestrare il tuo modello dall'avvelenamento dei dati di addestramento comprendendo e controllando quali utenti, processi e ruoli sono autorizzati a contribuire agli archivi dati, nonché il modo in cui i dati fluiscono nell'applicazione, monitorando le deviazioni dei bias e utilizzando il controllo delle versioni e storage immutabile in servizi di storage come Amazon S3. Stabilisci controlli rigorosi in ingresso e in uscita dei dati utilizzando servizi come AWS Network Firewall e AWS VPC per proteggerti da input sospetti e dal rischio di esfiltrazione di dati.

Durante il processo di formazione, aggiornamento o perfezionamento, è necessario essere consapevoli di tutti i dati sensibili utilizzati. Dopo che i dati sono stati utilizzati durante uno di questi processi, è necessario pianificare uno scenario in cui qualsiasi utente del modello diventa improvvisamente in grado di estrarre nuovamente i dati o le informazioni utilizzando tecniche di prompt injection. Comprendi i rischi e i vantaggi derivanti dall'utilizzo di dati sensibili nei tuoi modelli e nell'inferenza. Implementare robusti meccanismi di autenticazione e autorizzazione per stabilire e gestire autorizzazioni di accesso granulari, che non si basino sulla logica dell'applicazione LLM per impedire la divulgazione. È stato dimostrato che, in alcune condizioni, l'input controllato dall'utente per un'applicazione di intelligenza artificiale generativa è in grado di fornire un vettore per estrarre informazioni dal modello o da qualsiasi parte dell'input non controllata dall'utente. Ciò può avvenire tramite inserimento tempestivo, in cui l'utente fornisce input che fanno sì che l'output del modello si discosti dai guardrail previsti dell'applicazione LLM, inclusa la fornitura di indizi sui set di dati su cui il modello è stato originariamente addestrato.

Implementare quote di accesso a livello utente per gli utenti che forniscono input e ricevono output da un modello. Dovresti prendere in considerazione approcci che non consentano l'accesso anonimo in condizioni in cui i dati e le informazioni di addestramento del modello sono sensibili o dove esiste il rischio che un avversario forni un facsimile del tuo modello in base al suo input e all'output del modello allineato. In generale, se parte dell'input di un modello è costituito da testo arbitrario fornito dall'utente, considerare l'output suscettibile di inserimento tempestivo e di conseguenza garantire che l'uso degli output includa contromisure tecniche e organizzative implementate per mitigare la gestione insicura dell'output, un'eccessiva agenzia e dipendenza eccessiva. Nell'esempio precedente relativo al filtraggio di input dannosi utilizzando AWS WAF, prendi in considerazione la creazione di un filtro davanti alla tua applicazione per tale potenziale uso improprio dei prompt e sviluppa una policy su come gestirli ed evolverli man mano che il modello e i dati crescono. Considera anche una revisione filtrata dell'output prima che venga restituito all'utente per garantire che soddisfi gli standard di qualità, accuratezza o moderazione dei contenuti. Potresti voler personalizzarlo ulteriormente per le esigenze della tua organizzazione con un ulteriore livello di controllo sugli input e sugli output davanti ai tuoi modelli per mitigare i modelli di traffico sospetti.

Interazioni tra applicazioni: sicurezza e osservabilità delle applicazioni

Esamina la tua applicazione LLM prestando attenzione a come un utente potrebbe utilizzare il tuo modello per aggirare l'autorizzazione standard per uno strumento o una toolchain downstream a cui non dispone dell'autorizzazione per accedere o utilizzare. Un'altra preoccupazione a questo livello riguarda l'accesso ad archivi dati esterni utilizzando un modello come meccanismo di attacco utilizzando rischi LLM tecnici o organizzativi illimitati. Ad esempio, se il tuo modello è addestrato per accedere a determinati archivi dati che potrebbero contenere dati sensibili, dovresti assicurarti di disporre di controlli di autorizzazione adeguati tra il tuo modello e gli archivi dati. Utilizza attributi immutabili sugli utenti che non provengono dal modello durante l'esecuzione dei controlli di autorizzazione. La gestione insicura e assoluta dell'output, la progettazione non sicura dei plugin e un'eccessiva azione possono creare condizioni in cui un attore della minaccia può utilizzare un modello per ingannare il sistema di autorizzazione facendogli aumentare i privilegi effettivi, portando un componente a valle a credere che l'utente sia autorizzato a recuperare dati o prendere una specifica azione.

Quando si implementa qualsiasi plug-in o strumento di intelligenza artificiale generativa, è imperativo esaminare e comprendere il livello di accesso concesso, nonché esaminare attentamente i controlli di accesso che sono stati configurati. L'utilizzo di plugin di intelligenza artificiale generativa insicuri e non mitigati può rendere il tuo sistema vulnerabile alle vulnerabilità e alle minacce della catena di fornitura, portando potenzialmente ad azioni dannose, inclusa l'esecuzione di codice remoto.

Interazioni dei modelli: prevenzione degli attacchi dei modelli

Dovresti essere consapevole dell'origine di eventuali modelli, plug-in, strumenti o dati che utilizzi, al fine di valutare e mitigare le vulnerabilità della catena di fornitura. Ad esempio, alcuni formati di modello comuni consentono l'incorporamento di codice eseguibile arbitrario nei modelli stessi. Utilizza mirroring dei pacchetti, scansione e ispezioni aggiuntive pertinenti agli obiettivi di sicurezza della tua organizzazione.

Anche i set di dati su cui addestri e ottimizzi i tuoi modelli devono essere rivisti. Se si ottimizza ulteriormente automaticamente un modello in base al feedback degli utenti (o ad altre informazioni controllabili dall'utente finale), è necessario considerare se un attore di minacce dannose potrebbe modificare arbitrariamente il modello in base alla manipolazione delle risposte e ottenere l'avvelenamento dei dati di addestramento.

Interazioni con i dati: monitora la qualità e l'utilizzo dei dati

I modelli di intelligenza artificiale generativa come gli LLM generalmente funzionano bene perché sono stati addestrati su una grande quantità di dati. Sebbene questi dati aiutino gli LLM a completare attività complesse, possono anche esporre il sistema al rischio di addestramento ai dati avvelenati, che si verifica quando vengono inclusi o omessi dati inappropriati all'interno di un set di dati di addestramento che possono alterare il comportamento di un modello. Per mitigare questo rischio, dovresti esaminare la tua catena di fornitura e comprendere il processo di revisione dei dati per il tuo sistema prima che vengano utilizzati all'interno del tuo modello. Sebbene la pipeline di addestramento sia una fonte primaria di avvelenamento dei dati, dovresti anche esaminare il modo in cui il tuo modello ottiene i dati, ad esempio in un modello RAG o un data Lake, e se la fonte di tali dati è attendibile e protetta. Utilizza i servizi di sicurezza AWS come AWS Security Hub, Amazon GuardDuty e Amazon Inspector per monitorare continuamente le attività sospette in Amazon EC2, Amazon EKS, Amazon S3, Servizio di database relazionale Amazon (Amazon RDS) e accesso alla rete che potrebbero essere indicatori di minacce emergenti e utilizzare Detective per visualizzare le indagini sulla sicurezza. Considera anche l'utilizzo di servizi come Lago di sicurezza Amazon per accelerare le indagini sulla sicurezza creando un data lake appositamente creato per centralizzare automaticamente i dati di sicurezza provenienti da ambienti AWS, fornitori SaaS, on-premise e origini cloud che contribuiscono ai carichi di lavoro AI/ML.

Interazioni organizzative: implementare protezioni di governance aziendale per l'intelligenza artificiale generativa

Identifica i rischi associati all'uso dell'intelligenza artificiale generativa per le tue aziende. Dovresti creare la tassonomia dei rischi della tua organizzazione e condurre valutazioni dei rischi per prendere decisioni informate durante l'implementazione di soluzioni di intelligenza artificiale generativa. Sviluppare un piano di continuità aziendale (BCP) che include carichi di lavoro AI, ML e AI generativa e che può essere implementato rapidamente per sostituire la funzionalità persa di un'applicazione LLM interessata o offline per soddisfare gli SLA.

Identifica le lacune, le inefficienze e le incoerenze nei processi e nelle risorse e migliora la consapevolezza e la proprietà in tutta la tua azienda. Modello di minaccia tutti i carichi di lavoro di intelligenza artificiale generativa per identificare e mitigare potenziali minacce alla sicurezza che potrebbero portare a risultati con un impatto negativo sul business, tra cui l’accesso non autorizzato ai dati, la negazione del servizio e l’uso improprio delle risorse. Approfitta del nuovo Strumento di modellazione AWS Threat Composer per contribuire a ridurre il time-to-value durante l'esecuzione della modellazione delle minacce. Più avanti nei cicli di sviluppo, valuta la possibilità di includere l'introduzione ingegneria del caos della sicurezza esperimenti di inserimento dei guasti per creare condizioni reali per comprendere come il sistema reagirà alle incognite e creare fiducia nella resilienza e nella sicurezza del sistema.

Includere diverse prospettive nello sviluppo di strategie di sicurezza e meccanismi di gestione del rischio per garantire l'adesione e la copertura per l'intelligenza artificiale/ML e la sicurezza generativa in tutti i ruoli e funzioni lavorative. Porta sul tavolo una mentalità di sicurezza fin dall'inizio e ricerca di qualsiasi applicazione di intelligenza artificiale generativa per allinearla ai requisiti. Se hai bisogno di ulteriore assistenza da AWS, chiedi al tuo account manager AWS di assicurarti che ci sia uguale supporto chiedendo agli AWS Solutions Architect di AWS Security e AI/ML di aiutarti in tandem.

Assicurati che la tua organizzazione di sicurezza intraprenda regolarmente azioni per favorire la comunicazione sia sulla consapevolezza del rischio che sulla comprensione della gestione del rischio tra le parti interessate dell'intelligenza artificiale generativa come product manager, sviluppatori di software, data scientist e leadership esecutiva, consentendo all'intelligence sulle minacce e alla guida sui controlli di raggiungere i team che potrebbero essere influenzato. Le organizzazioni di sicurezza possono supportare una cultura di divulgazione responsabile e miglioramento iterativo partecipando alle discussioni e portando nuove idee e informazioni agli stakeholder dell’IA generativa che si riferiscono ai loro obiettivi aziendali. Impara di più riguardo il nostro impegno per un’intelligenza artificiale responsabile e aggiuntivo risorse di intelligenza artificiale responsabili per aiutare i nostri clienti.

Ottieni il vantaggio di consentire una migliore postura organizzativa per l'intelligenza artificiale generativa sbloccando il time-to-value nei processi di sicurezza esistenti della tua organizzazione. Valuta in modo proattivo i casi in cui la tua organizzazione potrebbe richiedere processi eccessivamente onerosi dato il contesto di sicurezza dell'intelligenza artificiale generativa e perfezionarli per fornire a sviluppatori e scienziati un percorso chiaro da avviare con i controlli corretti in atto.

Valutare dove potrebbero esserci opportunità per allineare gli incentivi, ridurre i rischi e fornire una visione chiara sui risultati desiderati. Aggiorna le linee guida e le difese dei controlli per soddisfare le esigenze in evoluzione dell'intelligenza artificiale/ML e dello sviluppo di applicazioni di intelligenza artificiale generativa per ridurre la confusione e l'incertezza che possono costare tempo di sviluppo, aumentare il rischio e aumentare l'impatto.

Garantire che le parti interessate che non sono esperti di sicurezza siano in grado sia di comprendere come la governance organizzativa, le politiche e le fasi di gestione del rischio si applicano ai loro carichi di lavoro, sia di applicare i meccanismi di gestione del rischio. Prepara la tua organizzazione a rispondere a eventi e scenari realistici che potrebbero verificarsi con applicazioni di intelligenza artificiale generativa e assicurati che i ruoli dei costruttori di intelligenza artificiale generativa e i team di risposta siano consapevoli dei percorsi e delle azioni di escalation in caso di preoccupazione per qualsiasi attività sospetta.

Conclusione

Per commercializzare con successo l'innovazione con qualsiasi tecnologia nuova ed emergente è necessario iniziare con una mentalità che metta innanzitutto la sicurezza, basandosi su un'infrastruttura sicura e pensando a come integrare ulteriormente la sicurezza a ogni livello dello stack tecnologico in anticipo con una difesa approfondita. approccio. Ciò include interazioni a più livelli del tuo stack tecnologico e punti di integrazione all’interno della tua catena di fornitura digitale, per garantire la resilienza organizzativa. Sebbene l’intelligenza artificiale generativa introduca alcune nuove sfide in termini di sicurezza e privacy, se segui le migliori pratiche di sicurezza fondamentali, come l’utilizzo di una difesa approfondita con servizi di sicurezza a più livelli, puoi contribuire a proteggere la tua organizzazione da molti problemi comuni e minacce in evoluzione. Dovresti implementare servizi AWS Security a più livelli nei carichi di lavoro di intelligenza artificiale generativa e nell'organizzazione più ampia e concentrarti sui punti di integrazione nelle catene di fornitura digitali per proteggere i tuoi ambienti cloud. Quindi puoi utilizzare le funzionalità avanzate di sicurezza e privacy nei servizi AWS AI/ML come Amazon SageMaker e Amazon Bedrock per aggiungere ulteriori livelli di controlli avanzati di sicurezza e privacy alle tue applicazioni di intelligenza artificiale generativa. Integrare la sicurezza fin dall’inizio renderà più veloce, più semplice e più conveniente innovare con l’intelligenza artificiale generativa, semplificando al tempo stesso la conformità. Ciò ti aiuterà ad aumentare il controllo, la fiducia e l'osservabilità delle tue applicazioni di intelligenza artificiale generativa per i tuoi dipendenti, clienti, partner, autorità di regolamentazione e altre parti interessate.

Riferimenti aggiuntivi

- Framework standard di settore per la gestione e la sicurezza dei rischi specifici di AI/ML:

Circa gli autori

Christopher Rae è uno dei principali specialisti GTM di sicurezza a livello mondiale focalizzato sullo sviluppo e l'esecuzione di iniziative strategiche che accelerano e scalano l'adozione dei servizi di sicurezza AWS. È appassionato dell'intersezione tra sicurezza informatica e tecnologie emergenti, con oltre 20 anni di esperienza in ruoli di leadership strategica globale fornendo soluzioni di sicurezza a clienti nel settore dei media, dell'intrattenimento e delle telecomunicazioni. Si ricarica attraverso la lettura, i viaggi, il cibo e il vino, la scoperta di nuova musica e la consulenza per startup in fase iniziale.

Christopher Rae è uno dei principali specialisti GTM di sicurezza a livello mondiale focalizzato sullo sviluppo e l'esecuzione di iniziative strategiche che accelerano e scalano l'adozione dei servizi di sicurezza AWS. È appassionato dell'intersezione tra sicurezza informatica e tecnologie emergenti, con oltre 20 anni di esperienza in ruoli di leadership strategica globale fornendo soluzioni di sicurezza a clienti nel settore dei media, dell'intrattenimento e delle telecomunicazioni. Si ricarica attraverso la lettura, i viaggi, il cibo e il vino, la scoperta di nuova musica e la consulenza per startup in fase iniziale.

Elia Inverno è un ingegnere di sicurezza senior in Amazon Security, ha conseguito una laurea in ingegneria della sicurezza informatica ed è pieno di amore per Harry Potter. Elijah eccelle nell'identificare e affrontare le vulnerabilità nei sistemi di intelligenza artificiale, fondendo competenze tecniche con un tocco di magia. Elijah progetta protocolli di sicurezza su misura per gli ecosistemi IA, conferendo un tocco magico alle difese digitali. Spinto dall'integrità, Elijah ha un background di sicurezza in organizzazioni del settore pubblico e commerciale focalizzate sulla protezione della fiducia.

Elia Inverno è un ingegnere di sicurezza senior in Amazon Security, ha conseguito una laurea in ingegneria della sicurezza informatica ed è pieno di amore per Harry Potter. Elijah eccelle nell'identificare e affrontare le vulnerabilità nei sistemi di intelligenza artificiale, fondendo competenze tecniche con un tocco di magia. Elijah progetta protocolli di sicurezza su misura per gli ecosistemi IA, conferendo un tocco magico alle difese digitali. Spinto dall'integrità, Elijah ha un background di sicurezza in organizzazioni del settore pubblico e commerciale focalizzate sulla protezione della fiducia.

Ram Vital è Principal ML Solutions Architect presso AWS. Ha oltre 3 decenni di esperienza nell'architettura e nella creazione di applicazioni distribuite, ibride e cloud. La sua passione è creare soluzioni AI/ML e big data sicure e scalabili per aiutare i clienti aziendali nel loro percorso di adozione e ottimizzazione del cloud per migliorare i risultati aziendali. Nel tempo libero va in moto e cammina con il suo Sheepadoodle di 3 anni!

Ram Vital è Principal ML Solutions Architect presso AWS. Ha oltre 3 decenni di esperienza nell'architettura e nella creazione di applicazioni distribuite, ibride e cloud. La sua passione è creare soluzioni AI/ML e big data sicure e scalabili per aiutare i clienti aziendali nel loro percorso di adozione e ottimizzazione del cloud per migliorare i risultati aziendali. Nel tempo libero va in moto e cammina con il suo Sheepadoodle di 3 anni!

Navneet Tuteia è un Data Specialist presso Amazon Web Services. Prima di entrare in AWS, Navneet ha lavorato come facilitatore per le organizzazioni che cercavano di modernizzare le proprie architetture di dati e implementare soluzioni AI/ML complete. Ha conseguito una laurea in ingegneria presso la Thapar University e un master in statistica presso la Texas A&M University.

Navneet Tuteia è un Data Specialist presso Amazon Web Services. Prima di entrare in AWS, Navneet ha lavorato come facilitatore per le organizzazioni che cercavano di modernizzare le proprie architetture di dati e implementare soluzioni AI/ML complete. Ha conseguito una laurea in ingegneria presso la Thapar University e un master in statistica presso la Texas A&M University.

Emily Soward è un Data Scientist con AWS Professional Services. Ha conseguito un Master of Science con Distinction in Artificial Intelligence presso l'Università di Edimburgo in Scozia, Regno Unito, con enfasi sull'elaborazione del linguaggio naturale (NLP). Emily ha ricoperto ruoli scientifici e ingegneristici applicati incentrati su ricerca e sviluppo di prodotti abilitati all'IA, eccellenza operativa e governance per i carichi di lavoro dell'IA in esecuzione presso organizzazioni del settore pubblico e privato. Contribuisce alla guida dei clienti come relatore senior di AWS e, di recente, come autrice di AWS Well-Architected in the Machine Learning Lens.

Emily Soward è un Data Scientist con AWS Professional Services. Ha conseguito un Master of Science con Distinction in Artificial Intelligence presso l'Università di Edimburgo in Scozia, Regno Unito, con enfasi sull'elaborazione del linguaggio naturale (NLP). Emily ha ricoperto ruoli scientifici e ingegneristici applicati incentrati su ricerca e sviluppo di prodotti abilitati all'IA, eccellenza operativa e governance per i carichi di lavoro dell'IA in esecuzione presso organizzazioni del settore pubblico e privato. Contribuisce alla guida dei clienti come relatore senior di AWS e, di recente, come autrice di AWS Well-Architected in the Machine Learning Lens.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/architect-defense-in-depth-security-for-generative-ai-applications-using-the-owasp-top-10-for-llms/

- :ha

- :È

- :non

- :Dove

- $ SU

- 1

- 10

- 100

- 125

- 150

- 30

- 300

- a

- capacità

- capace

- WRI

- accademico

- accelerare

- accettabile

- accesso

- Accesso ai dati

- Accedendo

- di conseguenza

- Il mio account

- conti

- precisione

- Raggiungere

- il raggiungimento

- operanti in

- Action

- azioni

- attività

- attività

- adattamento

- aggiungere

- aggiunto

- aggiunta

- aggiuntivo

- indirizzo

- indirizzamento

- aderenza

- regolare

- adottare

- Adottando

- Adozione

- Avanzate

- avanzamenti

- Vantaggio

- consulenza

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- agenzia

- Agente

- AI

- Modelli AI

- Sistemi di intelligenza artificiale

- AI / ML

- allineare

- Allineati

- Allinea

- Tutti

- consentire

- permesso

- Consentire

- da solo

- anche

- Sebbene il

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon Sage Maker

- Amazon Web Services

- tra

- quantità

- an

- analizzare

- l'analisi

- ed

- e infrastruttura

- Anonimo

- Un altro

- rispondere

- in qualsiasi

- api

- appetito

- applicabile

- Applicazioni

- Sviluppo di applicazioni

- sicurezza delle applicazioni

- applicazioni

- applicato

- si applica

- APPLICA

- AMMISSIONE

- approccio

- approcci

- opportuno

- architetti

- architettonico

- architettura

- SONO

- aree

- discutere

- sorgere

- in giro

- artificiale

- intelligenza artificiale

- Intelligenza artificiale (AI)

- AS

- chiedere

- valutare

- valutazioni

- Attività

- Assistenza

- assistenti

- associato

- garanzia

- At

- atlante

- attacco

- attacchi

- il tentativo

- attenzione

- gli attributi

- revisione

- aumentata

- Autenticazione

- autore

- autorizzazione

- autorizzato

- automatizzare

- automaticamente

- disponibile

- consapevole

- consapevolezza

- AWS

- Cliente AWS

- Servizi professionali AWS

- precedente

- Backed

- sfondo

- basato

- basic

- base

- BE

- perché

- diventa

- stato

- prima

- iniziare

- comportamento

- essendo

- credendo

- beneficio

- vantaggi

- MIGLIORE

- best practice

- Meglio

- fra

- pregiudizio

- Big

- Big Data

- Conto

- mescolanza

- Blog

- entrambi

- confini

- portare

- Portare

- costruire

- costruttore

- costruttori

- Costruzione

- costruisce

- costruito

- incassato

- affari

- aziende

- by

- aggirare

- Cadenza

- Materiale

- Può ottenere

- funzionalità

- Ultra-Grande

- Custodie

- Categoria

- Causare

- cause

- centralizzare

- certo

- a livello internazionale

- Certificazione

- catena

- Catene

- sfide

- il cambiamento

- Chaos

- chatbot

- Controlli

- capo

- pulire campo

- Cloud

- adozione del cloud

- applicazioni cloud

- il cloud computing

- infrastruttura cloud

- Cloud Security

- codice

- combinazione

- Venire

- viene

- commercializzare

- impegno

- impegnata

- Uncommon

- comunemente

- Comunicazione

- compagno

- compagni

- azienda

- completamento di una

- complesso

- conformità

- componente

- Compositore

- comprendere

- globale

- compromesso

- Compromissione

- compromettendo

- Calcolare

- informatica

- Problemi della Pelle

- interessato

- preoccupazioni

- condizioni

- Segui il codice di Condotta

- fiducia

- configurato

- confusione

- congiunzione

- Connettiti

- Conseguenze

- Prendere in considerazione

- considerato

- considerando

- coerente

- consiste

- contenere

- Tecnologie Container

- contenuto

- moderazione dei contenuti

- contesto

- continuità

- continuamente

- contribuire

- contribuisce

- di controllo

- controllo

- controlli

- al contrario

- Nucleo

- pietra angolare

- correggere

- Corrispondente

- Costo

- costo effettivo

- potuto

- copertura

- creare

- Creazione

- critico

- Cultura

- curati

- cliente

- Clienti

- personalizzare

- personalizzate

- Cyber

- sicurezza informatica

- Cybersecurity

- cicli

- dati

- Lago di dati

- Preparazione dei dati

- qualità dei dati

- scienziato di dati

- manomissione dei dati

- Banca Dati

- dataset

- giorno

- decenni

- Decision Making

- decisori

- decisioni

- deep

- più profondo

- Difesa

- difensiva

- definire

- definito

- definizione

- Laurea

- consegna

- scavare

- dimostrato

- Denial of Service

- Dipendente

- schierare

- schierato

- distribuzione

- deployment

- profondità

- descrivere

- Design

- disegni

- desiderato

- individuare

- sviluppare

- sviluppato

- sviluppatori

- in via di sviluppo

- Mercato

- deviare

- deviazione

- diverso

- digitale

- discipline

- Rivelazione

- scoprire

- scoperta

- discutere

- discutere

- discussioni

- interruzioni

- distinto

- distinzione

- distribuito

- immersione

- paesaggio differenziato

- prospettive diverse

- non

- dominio

- Dont

- disegna

- spinto

- durante

- ogni

- In precedenza

- Presto

- fase iniziale

- più facile

- facilmente

- Economico

- valore economico

- ecosistemi

- Edimburgo

- Efficace

- efficiente

- o

- incorporamento

- emergere

- emergenti del mondo

- tecnologie emergenti

- Tecnologia emergente

- enfasi

- dipendenti

- e potenza

- enable

- Abilita

- consentendo

- incoraggia

- crittografato

- fine

- imporre

- far rispettare

- ingegnere

- Ingegneria

- Ingegneri

- migliorata

- garantire

- Impresa

- clienti aziendali

- Intrattenimento

- Intero

- Ambiente

- ambienti

- pari

- errore

- intensificazione

- essential

- stabilire

- stabilire

- Etere (ETH)

- valutare

- la valutazione

- valutazione

- Anche

- Evento

- eventi

- Ogni

- evolvere

- evoluzione

- esaminare

- esempio

- Esempi

- Eccellenza

- eccessivo

- esecuzione

- esecutivo

- Esercitare

- esfiltrazione

- esistere

- esistente

- espansione

- previsto

- esperienza

- esperimenti

- competenza

- esperti

- Esposizione

- estendere

- estendendo

- si estende

- esterno

- extra

- estratto

- estrarre i dati

- estremamente

- facce

- facilita

- facilitatore

- fallisce

- Autunno

- Familiarità

- FAST

- più veloce

- caratteristica

- Caratteristiche

- feedback

- meno

- filtro

- filtraggio

- finanziario

- servizi finanziari

- Trovate

- ricerca

- I risultati

- firewall

- Nome

- cinque

- fiuto

- flessibile

- flusso

- flussi

- Focus

- concentrato

- seguire

- i seguenti

- cibo

- Nel

- Legale

- Favorire

- Fosters

- Fondazione

- Fondamentale

- Contesto

- quadri

- frequentemente

- da

- anteriore

- funzionalità

- funzioni

- fondamentale

- ulteriormente

- Guadagno

- lacune

- Generale

- generalmente

- ELETTRICA

- generativo

- AI generativa

- ottenere

- ottenere

- dato

- globali

- scopo

- Obiettivi

- andando

- governare

- la governance

- Enti Pubblici

- governo

- concesso

- cresce

- guida

- guida

- guidata

- Guide

- ha avuto

- maniglia

- Manovrabilità

- Avere

- he

- assistenza sanitaria

- Aiuto

- aiutare

- aiuta

- Alte prestazioni

- vivamente

- il suo

- possesso

- detiene

- Come

- Tutorial

- HTML

- http

- HTTPS

- Hub

- umano

- IBRIDO

- i

- idea

- idee

- identificato

- identificare

- identificazione

- Identità

- if

- immutabilità

- immutabile

- Impact

- impattato

- impatti

- imperativo

- realizzare

- implementazione

- implementato

- Implementazione

- competenze

- miglioramento

- in

- Incentive

- inizio

- incidenti

- includere

- incluso

- inclusi

- Compreso

- incongruenze

- Aumento

- è aumentato

- crescente

- industria

- inefficienze

- informazioni

- informazioni di sicurezza

- informati

- Infrastruttura

- infusa

- inerente

- iniziative

- innovare

- innovare

- Innovazione

- ingresso

- Ingressi

- insicuro

- interno

- intuizione

- intuizioni

- istanze

- integrare

- integrato

- Integra

- integrazione

- integrazioni

- interezza

- Intelligence

- interazioni

- interesse

- Interfaccia

- Internazionale

- intersezione

- ai miglioramenti

- introdurre

- Introduce

- l'introduzione di

- indagine

- Indagini

- comporta

- sicurezza

- IT

- SUO

- stessa

- Lavoro

- accoppiamento

- viaggio

- jpg

- ad appena

- mantenere

- Le

- Aree chiave

- Regno

- conoscenze

- kubernetes

- lago

- Lingua

- grandi

- superiore, se assunto singolarmente.

- infine

- dopo

- lanciare

- strato

- stratificato

- galline ovaiole

- portare

- capi

- Leadership

- principale

- IMPARARE

- apprendimento

- meno

- lente

- lenti

- Livello

- ciclo di vita

- piace

- probabilità

- linea

- Linee

- registrazione

- logica

- Guarda

- cerca

- perso

- amore

- macchina

- machine learning

- make

- maligno

- il malware

- gestire

- gestito

- gestione

- direttore

- I gestori

- gestione

- manipolazione

- Manipolazione

- modo

- molti

- carta geografica

- Mastercard

- master

- Materiale

- Matters

- maturità

- massimizzando

- Maggio..

- si intende

- misurare

- meccanismo

- meccanismi di

- Media

- Soddisfare

- Soddisfa

- mentale

- menzionato

- di cartone

- Metrica

- forza

- migrare

- milioni

- mente

- Mindset

- uso improprio

- Ridurre la perdita dienergia con una

- attenuazione

- ML

- modello

- modellismo

- modelli

- moderazione

- modernizzare

- Monitorare

- monitoraggio

- Scopri di più

- maggior parte

- MOTO

- cambiano

- molti

- multiplo

- Musica

- devono obbligatoriamente:

- my

- Naturale

- Linguaggio naturale

- Elaborazione del linguaggio naturale

- Natura

- necessaria

- Bisogno

- di applicazione

- esigenze

- Rete

- Accesso alla rete

- New

- GENERAZIONE

- nista

- nlp

- oggetto

- obiettivo

- Obiettivi d'Esame

- verificarsi

- of

- MENO

- offerta

- Offerte

- ufficiali

- offline

- on

- ONE

- aprire

- open source

- operato

- operativa

- Operazioni

- Opportunità

- ottimizzazione

- ottimizzati

- or

- minimo

- organizzazione

- organizzativa

- organizzazioni

- Origin

- originariamente

- origini

- Altro

- nostro

- su

- Risultato

- risultati

- produzione

- uscite

- al di fuori

- ancora

- complessivo

- eccessivamente

- proprietà

- pacchetto

- parte

- partecipante

- parti

- partner

- Ricambi

- appassionato

- sentiero

- percorsi

- modelli

- performance

- eseguita

- esecuzione

- permessi

- prospettive

- fasi

- pilastri

- conduttura

- posto

- piano

- pianificazione

- Platone

- Platone Data Intelligence

- PlatoneDati

- plug-in

- i plugin

- punti

- veleno

- Termini e Condizioni

- politica

- posizionamento

- Post

- potenziale

- potenzialmente

- pratica

- pratiche

- preparazione

- Preparare

- prevenire

- precedente

- premio

- Direttore

- principi

- Precedente

- prioritizzazione

- priorità

- Privacy

- un bagno

- settore privato

- privilegio

- privilegi

- processi

- i processi

- lavorazione

- Prodotto

- Produzione

- della produttività

- professionale

- Profilo

- Programma

- Programmi

- progetto

- istruzioni

- corretto

- propriamente

- protegge

- protetta

- proteggere

- protezione

- protocolli

- fornire

- fornitori

- fornisce

- fornitura

- la percezione

- metti

- qualità

- query

- domanda

- Presto

- rapidamente

- straccio

- raggiungere

- Reagire

- Leggi

- prontezza

- Lettura

- mondo reale

- realistico

- realizzazione

- rendersi conto

- ricevente

- recentemente

- raccomandare

- raccomandazioni

- Recuperare

- recupero

- ridurre

- riferimento

- raffinare

- regione

- Basic

- regolarmente

- regolamentati

- Regolatori

- relazionato

- pertinente

- affidabile

- fare affidamento

- bonifica

- a distanza

- ripetere

- sostituire

- richiesta

- richiedendo

- richiedere

- requisito

- Requisiti

- richiede

- riparazioni

- ricerca e sviluppo

- elasticità

- risorsa

- Risorse

- rispettati

- quelli

- Rispondere

- risposta

- risposte

- responsabilità

- responsabile

- REST

- limitare

- riqualificazione

- richiamo

- recensioni

- rivisto

- revisione

- Recensioni

- corse

- destra

- Rischio

- propensione al rischio

- gestione del rischio

- Risk Mitigation

- rischi

- robusto

- Rodgers

- ruoli

- radice

- di routine

- norme

- running

- s

- SaaS

- sagemaker

- stesso

- scalabile

- Scala

- scansione

- scenario

- Scenari

- Scienze

- scientifico

- Scienziato

- scienziati

- portata

- Scopo

- Scozia

- Cerca

- Sezione

- settore

- sicuro

- assicurato

- fissaggio

- problemi di

- vantaggi per la sicurezza

- eventi di sicurezza

- rischi per la sicurezza

- Minacce alla sicurezza

- strumenti di sicurezza

- Cercare

- cerca

- cerca

- select

- selezionato

- anziano

- delicata

- servito

- servizio

- Servizi

- set

- regolazione

- condiviso

- lei

- dovrebbero

- mostrare attraverso le sue creazioni

- Vista

- simile

- Un'espansione

- semplificare

- semplificando

- So

- socializzare

- Software

- fattura del software

- Sviluppatori di software

- lo sviluppo del software

- soluzione

- Soluzioni

- alcuni

- Fonte

- fonti

- sovranità

- lo spazio

- Speaker

- specialista

- specifico

- in particolare

- velocità

- pila

- tappe

- stakeholder

- Standard

- standard

- inizia a

- iniziato

- Di partenza

- Startup

- statistica

- Passi

- Ancora

- conservazione

- memorizzati

- negozi

- Strategico

- strategie

- Stratega

- Strategia

- rigoroso

- fortemente

- sostanzialmente

- il successo

- Con successo

- tale

- fornire

- supply chain

- Catene di fornitura

- supporto

- Supporto

- sicuro

- adatto

- sospettoso

- sintetico

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- su misura

- Fai

- prende

- Tandem

- task

- tassonomia

- team

- le squadre

- Consulenza

- tecniche

- Tecnologie

- tecnologi

- Tecnologia

- telecom

- test

- Testing

- test

- Texas

- testo

- che

- Il

- L’ORIGINE

- furto

- loro

- Li

- temi

- si

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- Pensiero

- Terza

- terzi

- questo

- quelli

- minaccia

- intelligenza delle minacce

- minacce

- tre

- Attraverso

- per tutto

- tempo

- tempestivo

- TLS

- a

- insieme

- strumenti

- top

- Top 10

- toccare

- verso

- Trading

- tradizionale

- traffico

- Treni

- allenato

- Training

- delle transazioni

- transito

- Trasparenza

- trasporto

- Di viaggio

- Affidati ad

- di fiducia

- tipicamente

- non autorizzato

- Incertezza

- per

- minare

- capire

- e una comprensione reciproca

- sconosciuto

- Unito

- UK

- Università

- assoluto

- Aggiornanento

- aggiornato

- sostenere

- uptime

- uso

- caso d'uso

- utilizzato

- Utente

- utenti

- usa

- utilizzando

- utilizzare

- utilizzati

- Utilizzando

- CONVALIDARE

- convalidando

- convalida

- APPREZZIAMO

- versato

- via

- virtuale

- potenzialmente

- visualizzare

- vs

- vulnerabilità

- vulnerabilità

- passeggiate

- volere

- warrants

- Prima

- modi

- we

- sito web

- applicazione web

- applicazioni web

- servizi web

- WELL

- Che

- quando

- se

- quale

- while

- OMS

- tutto

- volere

- VINO

- vittorie

- con

- entro

- senza

- Lavora

- lavorato

- flusso di lavoro

- flussi di lavoro

- lavoro

- In tutto il mondo

- sarebbe

- ha scritto

- XSS

- anni

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro