Pentingnya gudang data dan analitik yang dilakukan pada platform gudang data terus meningkat selama bertahun-tahun, dengan banyak bisnis mengandalkan sistem ini sebagai misi penting untuk pengambilan keputusan operasional jangka pendek dan perencanaan strategis jangka panjang. Secara tradisional, gudang data disegarkan dalam siklus batch, misalnya bulanan, mingguan, atau harian, sehingga bisnis dapat memperoleh berbagai wawasan darinya.

Banyak organisasi menyadari bahwa penyerapan data nyaris real-time bersama dengan analitik tingkat lanjut membuka peluang baru. Misalnya, sebuah lembaga keuangan dapat memprediksi apakah transaksi kartu kredit adalah penipuan dengan menjalankan program deteksi anomali dalam mode waktu-nyata dan bukan dalam mode batch.

Dalam posting ini, kami menunjukkan caranya Pergeseran Merah Amazon dapat memberikan prediksi streaming ingestion dan machine learning (ML) dalam satu platform.

Amazon Redshift adalah gudang data cloud yang cepat, dapat diskalakan, aman, dan terkelola sepenuhnya yang mempermudah dan hemat biaya untuk menganalisis semua data Anda menggunakan SQL standar.

Amazon Redshift ML memudahkan analis data dan pengembang database untuk membuat, melatih, dan menerapkan model ML menggunakan perintah SQL yang sudah dikenal di gudang data Amazon Redshift.

Kami bersemangat untuk meluncurkan Penyerapan Streaming Amazon Redshift untuk Aliran Data Amazon Kinesis dan Amazon Managed Streaming untuk Apache Kafka (Amazon MSK), yang memungkinkan Anda menyerap data langsung dari aliran data Kinesis atau topik Kafka tanpa harus memasukkan data Layanan Penyimpanan Sederhana Amazon (Amazon S3). Penyerapan streaming Amazon Redshift memungkinkan Anda mencapai latensi rendah dalam hitungan detik sambil menyerap ratusan megabyte data ke dalam gudang data Anda.

Postingan ini menunjukkan bagaimana Amazon Redshift, gudang data cloud, memungkinkan Anda membuat prediksi ML hampir real-time dengan menggunakan penyerapan streaming Amazon Redshift dan fitur Redshift ML dengan bahasa SQL yang sudah dikenal.

Ikhtisar solusi

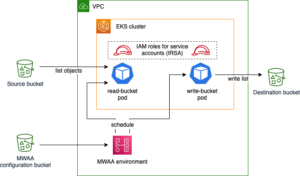

Dengan mengikuti langkah-langkah yang diuraikan dalam postingan ini, Anda dapat menyiapkan aplikasi streamer produser di Cloud komputasi elastis Amazon (Amazon EC2) yang mensimulasikan transaksi kartu kredit dan mendorong data ke Kinesis Data Streams secara real time. Anda menyiapkan tampilan materialisasi Amazon Redshift Streaming Ingestion di Amazon Redshift, tempat data streaming diterima. Anda melatih dan mem-build model Redshift ML untuk menghasilkan inferensi real-time terhadap data streaming.

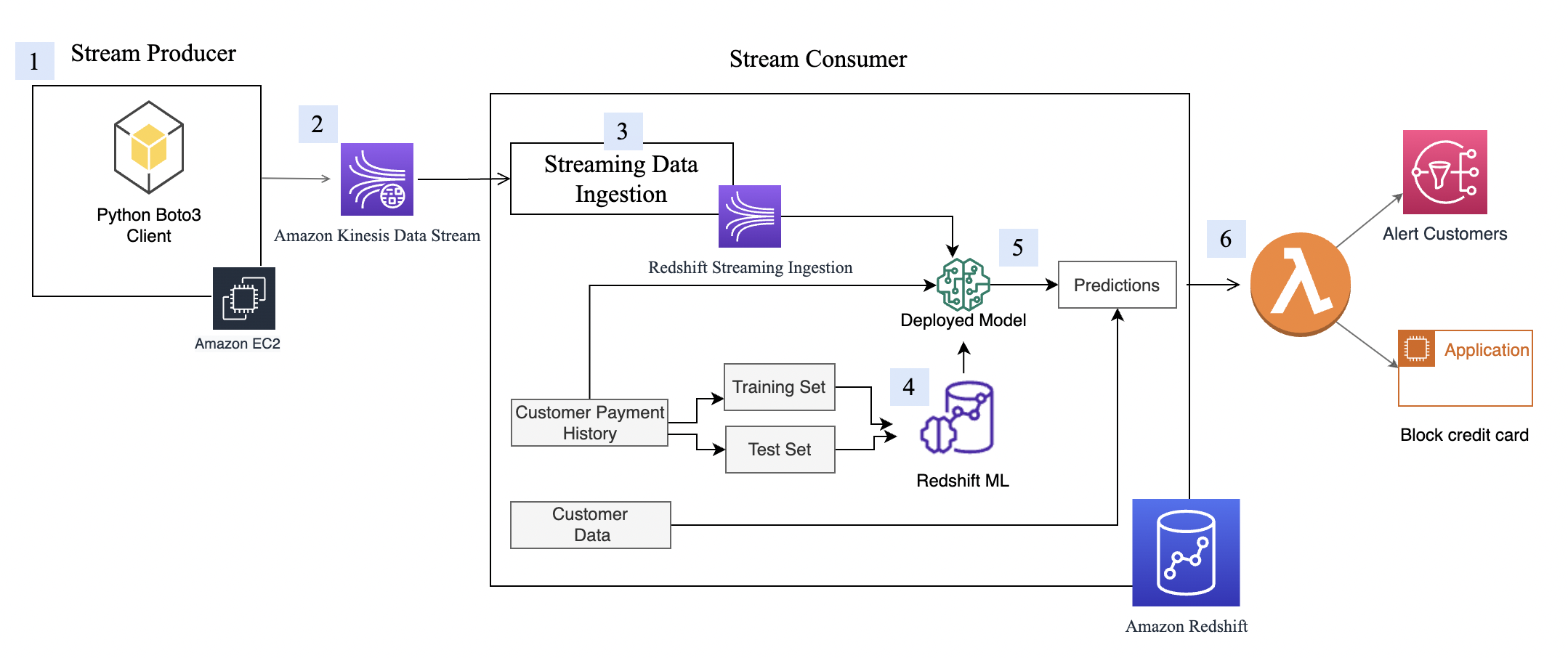

Diagram berikut mengilustrasikan arsitektur dan aliran proses.

Proses langkah demi langkah adalah sebagai berikut:

- Instans EC2 mensimulasikan aplikasi transaksi kartu kredit, yang memasukkan transaksi kartu kredit ke aliran data Kinesis.

- Aliran data menyimpan data transaksi kartu kredit yang masuk.

- Tampilan material Amazon Redshift Streaming Ingestion dibuat di atas aliran data, yang secara otomatis menyerap data streaming ke Amazon Redshift.

- Anda membangun, melatih, dan menerapkan model ML menggunakan Redshift ML. Model Redshift ML dilatih menggunakan data transaksional historis.

- Anda mengubah data streaming dan menghasilkan prediksi ML.

- Anda dapat mengingatkan pelanggan atau memperbarui aplikasi untuk mengurangi risiko.

Panduan ini menggunakan data streaming transaksi kartu kredit. Data transaksi kartu kredit tersebut fiktif dan berdasarkan a simulator. Kumpulan data pelanggan juga fiktif dan dibuat dengan beberapa fungsi data acak.

Prasyarat

- Buat klaster Amazon Redshift.

- Konfigurasikan cluster untuk menggunakan Redshift ML.

- membuat an Identitas AWS dan Manajemen Akses (IAM) pengguna.

- Perbarui peran IAM yang dilampirkan ke klaster Redshift untuk menyertakan izin untuk mengakses aliran data Kinesis. Untuk informasi lebih lanjut tentang kebijakan yang diperlukan, lihat Memulai penyerapan streaming.

- Buat instans EC5.4 m2xlarge. Kami menguji aplikasi Producer dengan instans m5.4xlarge tetapi Anda bebas menggunakan jenis instans lainnya. Saat membuat instance, gunakan amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 AMI.

- Untuk memastikan bahwa Python3 terinstal di instans EC2, jalankan perintah berikut untuk memverifikasi versi Python Anda (perhatikan bahwa skrip ekstraksi data hanya berfungsi di Python 3):

- Instal paket dependen berikut untuk menjalankan program simulator:

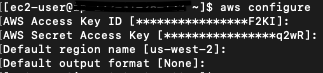

- Konfigurasikan Amazon EC2 menggunakan variabel seperti kredensial AWS yang dibuat untuk pengguna IAM yang dibuat pada langkah 3 di atas. Tangkapan layar berikut menunjukkan contoh menggunakan aws configure.

Siapkan Kinesis Data Streams

Amazon Kinesis Data Streams adalah layanan streaming data real-time yang dapat diskalakan dan tahan lama. Itu dapat terus menangkap gigabyte data per detik dari ratusan ribu sumber, seperti aliran klik situs web, aliran peristiwa basis data, transaksi keuangan, umpan media sosial, log TI, dan peristiwa pelacakan lokasi. Data yang dikumpulkan tersedia dalam milidetik untuk mengaktifkan kasus penggunaan analitik real-time seperti dasbor real-time, deteksi anomali real-time, harga dinamis, dan lainnya. Kami menggunakan Kinesis Data Streams karena ini adalah solusi tanpa server yang dapat diskalakan berdasarkan penggunaan.

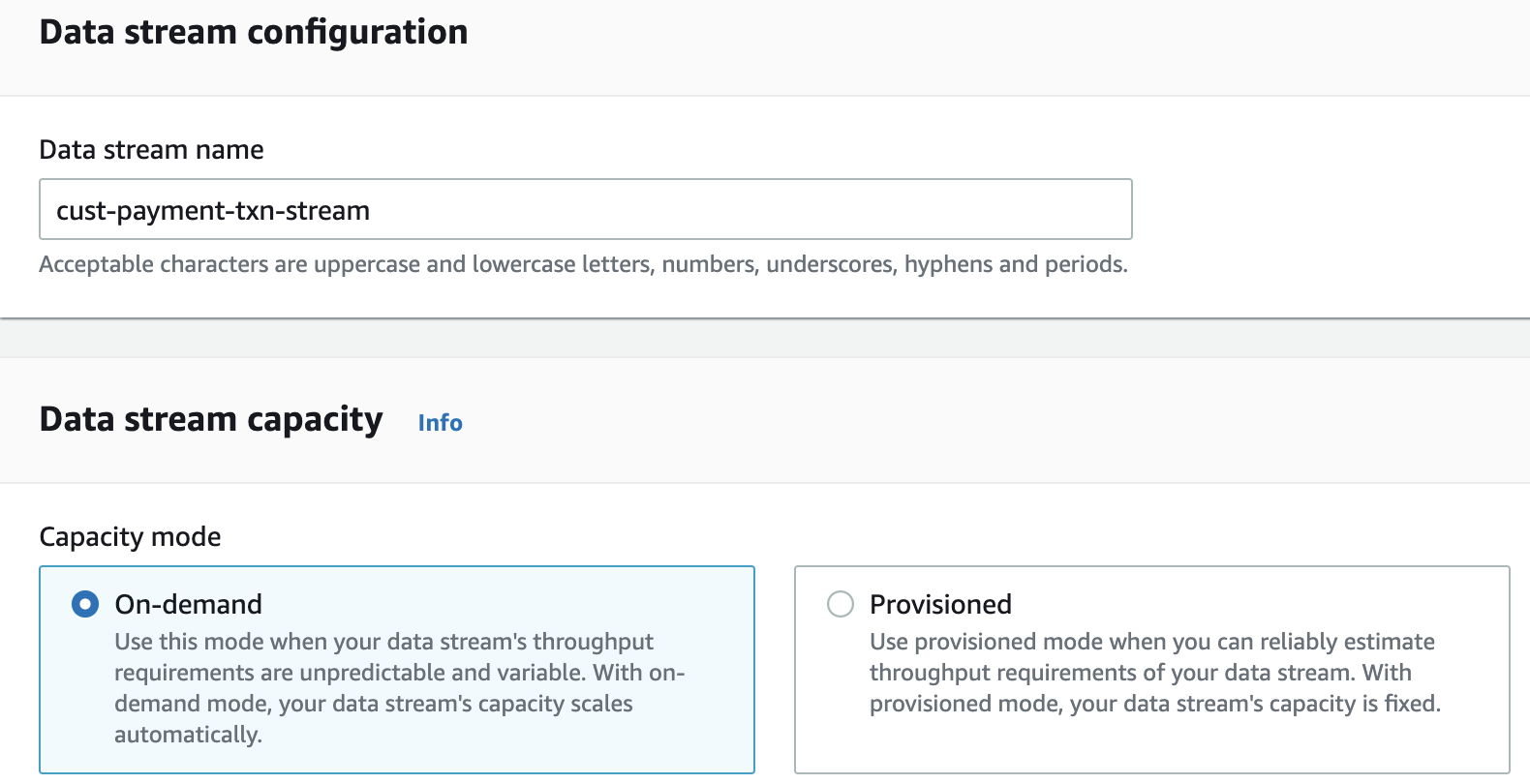

Buat aliran data Kinesis

Pertama, Anda perlu membuat aliran data Kinesis untuk menerima data streaming:

- Di konsol Amazon Kinesis, pilih Aliran data di panel navigasi.

- Pilih Buat aliran data.

- Untuk Nama aliran data, Masuk

cust-payment-txn-stream. - Untuk Modus kapasitas, pilih Sesuai permintaan.

- Untuk opsi lainnya, pilih opsi default dan ikuti petunjuk untuk menyelesaikan penyiapan.

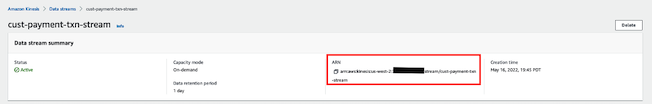

- Tangkap ARN untuk aliran data yang dibuat untuk digunakan di bagian selanjutnya saat menentukan kebijakan IAM Anda.

Siapkan izin

Agar aplikasi streaming dapat menulis ke Kinesis Data Streams, aplikasi harus memiliki akses ke Kinesis. Anda dapat menggunakan pernyataan kebijakan berikut untuk memberikan proses simulator yang Anda siapkan di bagian selanjutnya akses ke aliran data. Gunakan ARN aliran data yang Anda simpan di langkah sebelumnya.

Konfigurasikan produser streaming

Sebelum kami dapat menggunakan data streaming di Amazon Redshift, kami memerlukan sumber data streaming yang menulis data ke aliran data Kinesis. Posting ini menggunakan generator data yang dibuat khusus dan AWS SDK untuk Python (Boto3) untuk mempublikasikan data ke aliran data. Untuk petunjuk penyiapan, lihat Simulator Produser. Proses simulator ini menerbitkan data streaming ke aliran data yang dibuat pada langkah sebelumnya (cust-payment-txn-stream).

Konfigurasikan konsumen aliran

Bagian ini membahas tentang mengonfigurasi konsumen aliran (tampilan penyerapan streaming Amazon Redshift).

Amazon Redshift Streaming Ingestion menyediakan penyerapan data streaming berlatensi rendah dan berkecepatan tinggi dari Kinesis Data Streams ke tampilan terwujud Amazon Redshift. Anda dapat mengonfigurasi klaster Amazon Redshift untuk mengaktifkan penyerapan streaming dan membuat tampilan terwujud dengan penyegaran otomatis, menggunakan pernyataan SQL, seperti yang dijelaskan di Membuat tampilan terwujud di Amazon Redshift. Proses penyegaran tampilan terwujud otomatis akan menyerap data streaming dengan kecepatan ratusan megabyte data per detik dari Kinesis Data Streams ke Amazon Redshift. Ini menghasilkan akses cepat ke data eksternal yang disegarkan dengan cepat.

Setelah membuat tampilan terwujud, Anda dapat mengakses data dari aliran data menggunakan SQL dan menyederhanakan saluran data dengan membuat tampilan terwujud langsung di atas aliran.

Selesaikan langkah-langkah berikut untuk mengonfigurasi tampilan terwujud streaming Amazon Redshift:

- Di konsol IAM, pilih kebijakan di panel navigasi.

- Pilih Buat kebijakan.

- Buat kebijakan IAM baru bernama

KinesisStreamPolicy. Untuk definisi kebijakan streaming, lihat Memulai penyerapan streaming. - Di panel navigasi, pilih Peran.

- Pilih Buat peran.

- Pilih Layanan AWS Dan pilihlah Redshift dan Redshift dapat disesuaikan.

- Buat peran baru yang disebut

redshift-streaming-roledan melampirkan kebijakanKinesisStreamPolicy. - Buat skema eksternal untuk dipetakan ke Kinesis Data Streams :

Sekarang Anda dapat membuat tampilan terwujud untuk menggunakan data aliran. Anda dapat menggunakan tipe data SUPER untuk menyimpan muatan sebagaimana adanya, dalam format JSON, atau menggunakan fungsi JSON Amazon Redshift untuk mengurai data JSON ke dalam kolom individual. Untuk posting ini, kami menggunakan metode kedua karena skemanya terdefinisi dengan baik.

- Buat tampilan materialisasi konsumsi streaming

cust_payment_tx_stream. Dengan menentukan AUTO REFRESH YES dalam kode berikut, Anda dapat mengaktifkan pembaruan otomatis tampilan proses penyerapan streaming, yang menghemat waktu dengan menghindari pembuatan jaringan pipa data:

Perhatikan bahwa json_extract_path_text memiliki batasan panjang 64 KB. Juga filter from_varbye mencatat lebih besar dari 65KB.

- Segarkan data.

Tampilan terwujud streaming Amazon Redshift disegarkan secara otomatis oleh Amazon Redshift untuk Anda. Dengan cara ini, Anda tidak perlu khawatir tentang kedaluwarsa data. Dengan penyegaran otomatis tampilan terwujud, data dimuat secara otomatis ke Amazon Redshift saat tersedia di aliran. Jika Anda memilih untuk melakukan operasi ini secara manual, gunakan perintah berikut:

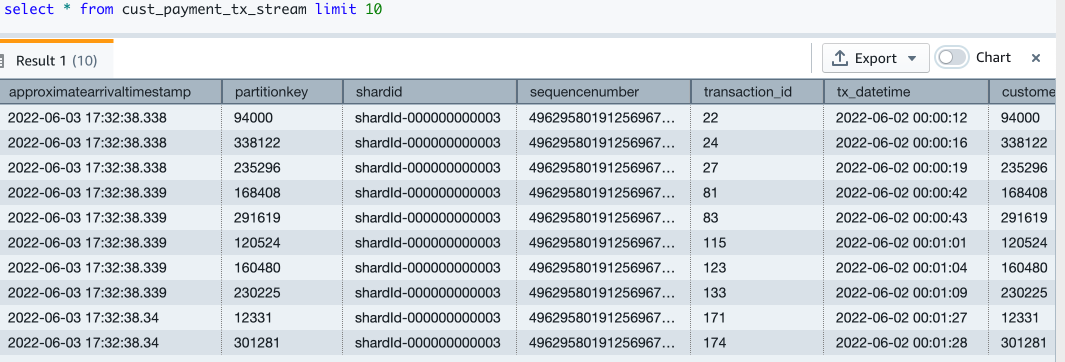

- Sekarang mari kita kueri tampilan materialisasi streaming untuk melihat data sampel:

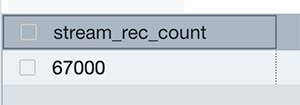

- Mari kita periksa berapa banyak rekaman yang ada di tampilan streaming sekarang:

Sekarang Anda telah selesai menyiapkan tampilan penyerapan streaming Amazon Redshift, yang terus diperbarui dengan data transaksi kartu kredit yang masuk. Dalam penyiapan saya, saya melihat bahwa sekitar 67,000 rekaman telah ditarik ke tampilan streaming pada saat saya menjalankan kueri jumlah pilihan. Angka ini mungkin berbeda untuk Anda.

Pergeseran merah ML

Dengan Redshift ML, Anda dapat menghadirkan model ML terlatih atau membuatnya secara native. Untuk informasi lebih lanjut, lihat Menggunakan pembelajaran mesin di Amazon Redshift.

Dalam postingan ini, kami melatih dan membuat model ML menggunakan kumpulan data historis. Data tersebut berisi a tx_fraud bidang yang menandai transaksi historis sebagai penipuan atau tidak. Kami membangun model ML yang diawasi menggunakan Redshift Auto ML, yang belajar dari kumpulan data ini dan memprediksi transaksi masuk saat dijalankan melalui fungsi prediksi.

Di bagian berikut, kami menunjukkan cara menyiapkan kumpulan data historis dan data pelanggan.

Muat kumpulan data historis

Tabel historis memiliki lebih banyak bidang daripada yang dimiliki sumber data streaming. Kolom ini berisi pengeluaran terbaru pelanggan dan skor risiko terminal, seperti jumlah transaksi penipuan yang dihitung dengan mengubah data streaming. Ada juga variabel kategori seperti transaksi akhir pekan atau transaksi malam hari.

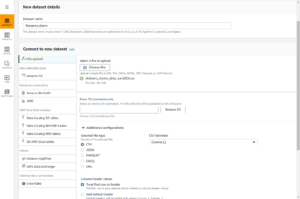

Untuk memuat data historis, jalankan perintah menggunakan Editor kueri Amazon Redshift.

Buat tabel riwayat transaksi dengan kode berikut. DDL juga dapat ditemukan di GitHub.

Mari kita periksa berapa banyak transaksi yang dimuat:

Periksa tren transaksi penipuan dan non-penipuan bulanan:

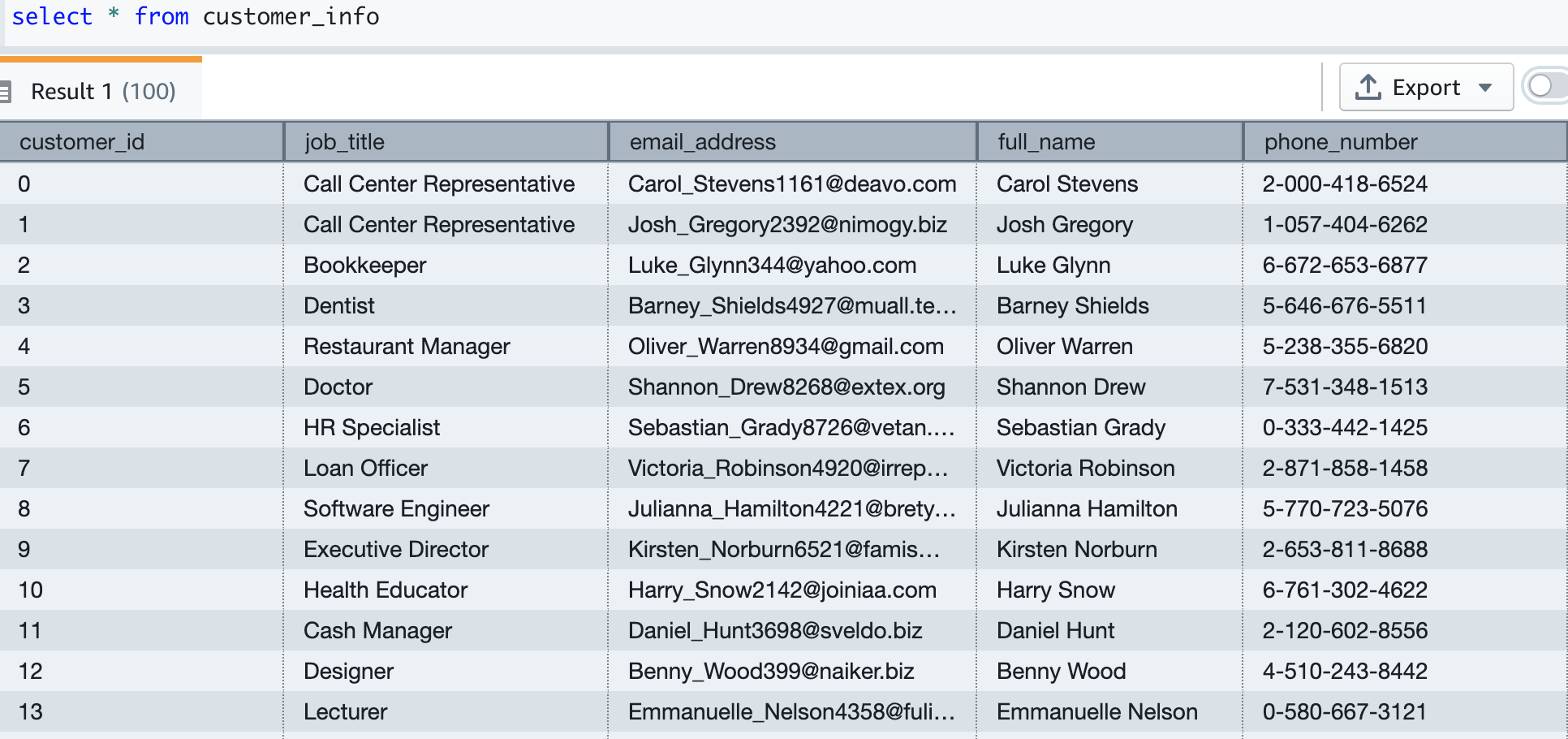

Membuat dan memuat data pelanggan

Sekarang kita membuat tabel pelanggan dan memuat data yang berisi email dan nomor telepon pelanggan. Kode berikut membuat tabel, memuat data, dan membuat sampel tabel. Tabel DDL tersedia di GitHub.

Data pengujian kami memiliki sekitar 5,000 pelanggan. Tangkapan layar berikut menunjukkan contoh data pelanggan.

Buat model ML

Tabel transaksi kartu historis kami memiliki data selama 6 bulan, yang sekarang kami gunakan untuk melatih dan menguji model ML.

Model mengambil bidang berikut sebagai masukan:

Kita mendapatkan tx_fraud sebagai keluaran.

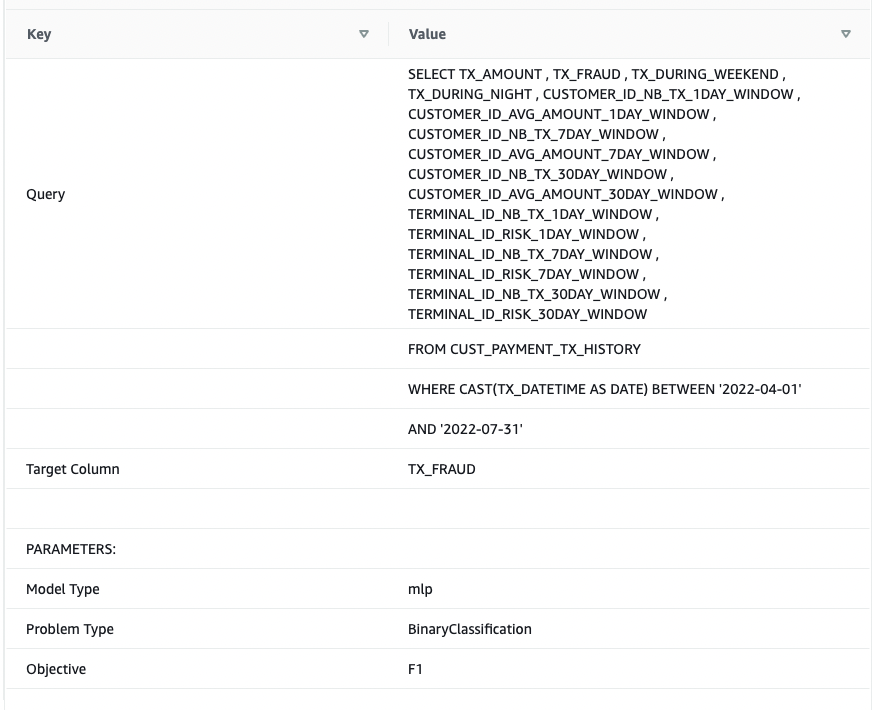

Kami membagi data ini menjadi kumpulan data pelatihan dan pengujian. Transaksi dari 2022-04-01 hingga 2022-07-31 adalah untuk set pelatihan. Transaksi dari 2022-08-01 hingga 2022-09-30 digunakan untuk set pengujian.

Mari buat model ML menggunakan SQL yang sudah dikenal Pernyataan CREATE MODEL. Kami menggunakan bentuk dasar dari perintah Redshift ML. Metode berikut menggunakan Autopilot Amazon SageMaker, yang melakukan persiapan data, rekayasa fitur, pemilihan model, dan pelatihan secara otomatis untuk Anda. Berikan nama bucket S3 Anda yang berisi kode tersebut.

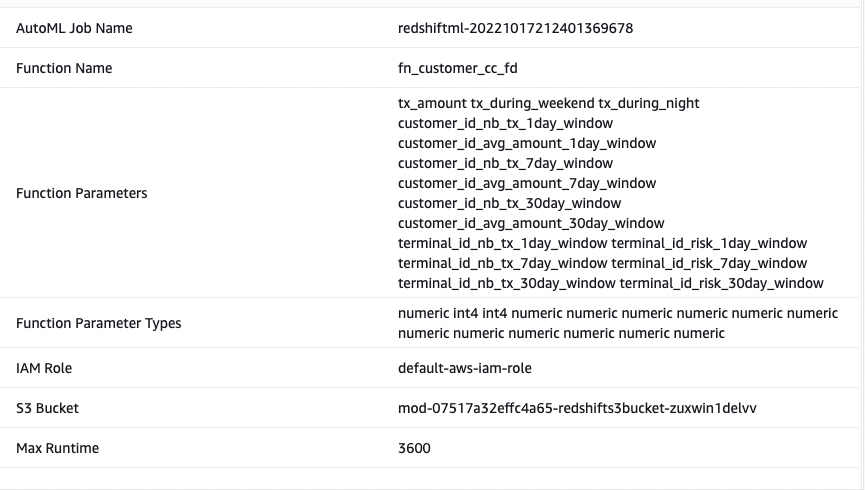

Saya menyebut model ML sebagai Cust_cc_txn_fd, dan fungsi prediksi sebagai fn_customer_cc_fd. Klausa FROM menampilkan kolom input dari tabel historis public.cust_payment_tx_history. Parameter target diatur ke tx_fraud, yang merupakan variabel target yang kami coba prediksi. IAM_Role disetel ke default karena cluster dikonfigurasi dengan peran ini; jika tidak, Anda harus memberikan ARN peran IAM klaster Amazon Redshift Anda. saya mengatur max_runtime hingga 3,600 detik, yaitu waktu yang kami berikan kepada SageMaker untuk menyelesaikan prosesnya. Redshift ML menerapkan model terbaik yang diidentifikasi dalam kerangka waktu ini.

Bergantung pada kerumitan model dan jumlah data, mungkin diperlukan beberapa waktu agar model tersedia. Jika Anda menemukan pemilihan model Anda tidak selesai, tingkatkan nilai untuk max_runtime. Anda dapat menetapkan nilai maksimal 9999.

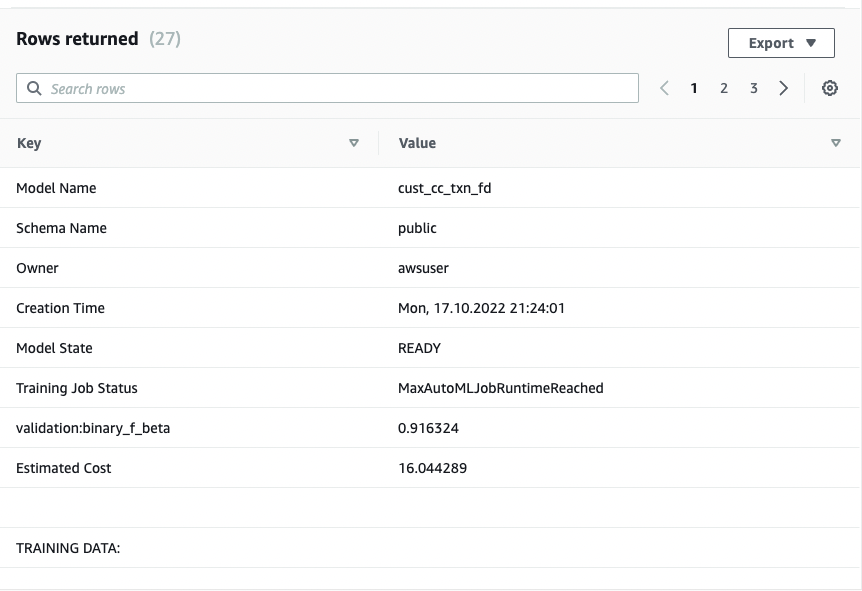

Perintah CREATE MODEL dijalankan secara asinkron, yang artinya berjalan di latar belakang. Anda dapat menggunakan TAMPILKAN MODEL perintah untuk melihat status model. Saat status ditampilkan sebagai Siap, berarti model dilatih dan diterapkan.

Tangkapan layar berikut menunjukkan keluaran kami.

Dari output, saya melihat bahwa model tersebut telah dikenali dengan benar BinaryClassification, dan F1 telah dipilih sebagai tujuan. Itu Skor F1 adalah metrik yang mempertimbangkan keduanya presisi dan ingatan. Ini mengembalikan nilai antara 1 (presisi dan perolehan sempurna) dan 0 (skor serendah mungkin). Dalam kasus saya, ini 0.91. Semakin tinggi nilainya, semakin baik kinerja model.

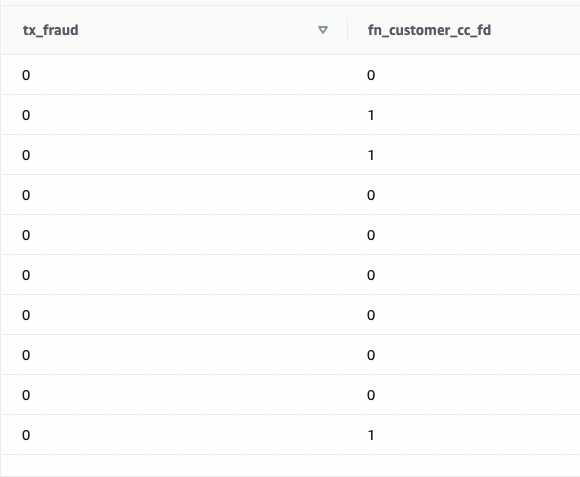

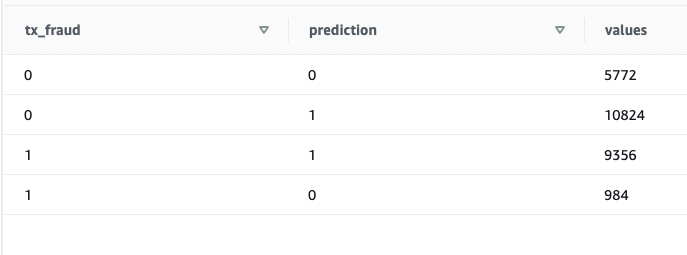

Mari kita uji model ini dengan set data uji. Jalankan perintah berikut, yang mengambil prediksi sampel:

Kami melihat bahwa beberapa nilai cocok dan beberapa tidak. Mari bandingkan prediksi dengan kebenaran dasar:

Kami memvalidasi bahwa model berfungsi dan skor F1 bagus. Mari beralih ke menghasilkan prediksi pada data streaming.

Memprediksi transaksi penipuan

Karena model Redshift ML siap digunakan, kita dapat menggunakannya untuk menjalankan prediksi terhadap penyerapan data streaming. Kumpulan data historis memiliki lebih banyak bidang daripada yang kami miliki di sumber data streaming, tetapi itu hanyalah metrik kebaruan dan frekuensi di sekitar pelanggan dan risiko terminal untuk transaksi penipuan.

Kita dapat menerapkan transformasi di atas data streaming dengan sangat mudah dengan menyematkan SQL di dalam tampilan. Buat tampilan pertama, yang menggabungkan data streaming di tingkat pelanggan. Kemudian buat pandangan kedua, yang mengumpulkan data streaming pada level terminal, dan pandangan ketiga, yang menggabungkan data transaksional yang masuk dengan data agregat pelanggan dan terminal dan memanggil fungsi prediksi di satu tempat. Kode untuk tampilan ketiga adalah sebagai berikut:

Jalankan pernyataan SELECT pada tampilan:

Saat Anda menjalankan pernyataan SELECT berulang kali, transaksi kartu kredit terbaru mengalami transformasi dan prediksi ML hampir secara real time.

Hal ini menunjukkan kekuatan Amazon Redshift—dengan perintah SQL yang mudah digunakan, Anda dapat mentransformasikan data streaming dengan menerapkan fungsi jendela yang kompleks dan menerapkan model ML untuk memprediksi transaksi penipuan semuanya dalam satu langkah, tanpa membangun jaringan pipa data yang rumit atau membangun dan mengelola infrastruktur tambahan.

Perluas solusinya

Karena aliran data masuk dan prediksi ML dibuat hampir secara waktu nyata, Anda dapat membuat proses bisnis untuk memberi tahu pelanggan menggunakan Layanan Pemberitahuan Sederhana Amazon (Amazon SNS), atau Anda dapat mengunci akun kartu kredit pelanggan dalam sistem operasional.

Posting ini tidak membahas detail operasi ini, tetapi jika Anda tertarik untuk mempelajari lebih lanjut tentang membangun solusi berbasis peristiwa menggunakan Amazon Redshift, lihat yang berikut ini Repositori GitHub.

Membersihkan

Untuk menghindari timbulnya biaya di masa mendatang, hapus sumber daya yang dibuat sebagai bagian dari postingan ini.

Kesimpulan

Dalam postingan ini, kami mendemonstrasikan cara menyiapkan aliran data Kinesis, mengonfigurasi produsen, dan menerbitkan data ke aliran, lalu membuat tampilan Penyerapan Streaming Amazon Redshift dan membuat kueri data di Amazon Redshift. Setelah data berada di klaster Amazon Redshift, kami mendemonstrasikan cara melatih model ML dan membangun fungsi prediksi serta menerapkannya pada data streaming untuk menghasilkan prediksi mendekati waktu nyata.

Jika Anda memiliki umpan balik atau pertanyaan, silakan tinggalkan di komentar.

Tentang Penulis

Bhanu Pittamally adalah Arsitek Solusi Spesialis Analytics yang berbasis di Dallas. Dia berspesialisasi dalam membangun solusi analitik. Latar belakangnya ada di gudang data—arsitektur, pengembangan, dan administrasi. Dia telah berkecimpung di bidang data dan analitik selama lebih dari 15 tahun.

Bhanu Pittamally adalah Arsitek Solusi Spesialis Analytics yang berbasis di Dallas. Dia berspesialisasi dalam membangun solusi analitik. Latar belakangnya ada di gudang data—arsitektur, pengembangan, dan administrasi. Dia telah berkecimpung di bidang data dan analitik selama lebih dari 15 tahun.

Praveen Kadipikonda adalah Arsitek Solusi Spesialis Analitik Senior di AWS yang berbasis di Dallas. Dia membantu pelanggan membangun solusi analitik yang efisien, berkinerja, dan dapat diskalakan. Dia telah bekerja dengan membangun database dan solusi gudang data selama lebih dari 15 tahun.

Praveen Kadipikonda adalah Arsitek Solusi Spesialis Analitik Senior di AWS yang berbasis di Dallas. Dia membantu pelanggan membangun solusi analitik yang efisien, berkinerja, dan dapat diskalakan. Dia telah bekerja dengan membangun database dan solusi gudang data selama lebih dari 15 tahun.

Ritesh Kumar Sinha adalah Arsitek Solusi Spesialis Analytics yang berbasis di San Francisco. Dia telah membantu pelanggan membangun pergudangan data yang dapat diskalakan dan solusi data besar selama lebih dari 16 tahun. Dia suka merancang dan membangun solusi end-to-end yang efisien di AWS. Di waktu luangnya, dia suka membaca, berjalan, dan melakukan yoga.

Ritesh Kumar Sinha adalah Arsitek Solusi Spesialis Analytics yang berbasis di San Francisco. Dia telah membantu pelanggan membangun pergudangan data yang dapat diskalakan dan solusi data besar selama lebih dari 16 tahun. Dia suka merancang dan membangun solusi end-to-end yang efisien di AWS. Di waktu luangnya, dia suka membaca, berjalan, dan melakukan yoga.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 Pelanggan

- 1

- 10

- 100

- 11

- 15 tahun

- 67

- 7

- 9

- a

- Sanggup

- Tentang Kami

- atas

- mengakses

- Akun

- Mencapai

- Tindakan

- Tambahan

- administrasi

- maju

- Setelah

- terhadap

- Waspada

- Semua

- memungkinkan

- Amazon

- Amazon EC2

- Amazon Kinesis

- jumlah

- Analis

- Analitik

- analisis

- menganalisa

- dan

- deteksi anomali

- Apache

- Aplikasi

- Mendaftar

- Menerapkan

- arsitektur

- sekitar

- melampirkan

- mobil

- secara otomatis

- secara otomatis

- tersedia

- menghindari

- AWS

- latar belakang

- berdasarkan

- dasar

- karena

- menjadi

- TERBAIK

- Lebih baik

- antara

- Besar

- Big data

- membawa

- membangun

- Bangunan

- bisnis

- proses bisnis

- bisnis

- panggilan

- bernama

- Panggilan

- menangkap

- kartu

- kasus

- kasus

- karakter

- beban

- memeriksa

- Pilih

- Kota

- awan

- Kelompok

- kode

- Kolom

- menggabungkan

- kedatangan

- komentar

- membandingkan

- lengkap

- menyelesaikan

- kompleks

- kompleksitas

- menghitung

- menganggap

- konsul

- memakan

- konsumen

- mengandung

- hemat biaya

- bisa

- membuat

- dibuat

- menciptakan

- membuat

- Surat kepercayaan

- kredit

- kartu kredit

- pelanggan

- data pelanggan

- pelanggan

- siklus

- harian

- Dallas

- data

- Persiapan data

- data warehouse

- gudang data

- Basis Data

- database

- kumpulan data

- Tanggal

- Pengambilan Keputusan

- Default

- mendefinisikan

- menyampaikan

- menunjukkan

- tergantung

- menyebarkan

- dikerahkan

- menyebarkan

- dijelaskan

- Mendesain

- rincian

- Deteksi

- pengembang

- Pengembangan

- berbeda

- langsung

- Tidak

- melakukan

- Dont

- dow

- dinamis

- mudah

- mudah digunakan

- efek

- efisien

- aktif

- memungkinkan

- ujung ke ujung

- Teknik

- Enter

- Eter (ETH)

- Acara

- peristiwa

- contoh

- gembira

- luar

- ekstraksi

- f1

- akrab

- FAST

- Fitur

- Fitur

- umpan balik

- bidang

- Fields

- filter

- keuangan

- Menemukan

- bendera

- aliran

- mengikuti

- berikut

- berikut

- bentuk

- format

- ditemukan

- FRAME

- Francisco

- penipuan

- deteksi penipuan

- Gratis

- Frekuensi

- dari

- sepenuhnya

- fungsi

- fungsi

- masa depan

- menghasilkan

- dihasilkan

- menghasilkan

- generator

- mendapatkan

- Memberikan

- Go

- baik

- memberikan

- Tanah

- Kelompok

- memiliki

- membantu

- membantu

- lebih tinggi

- Menyoroti

- historis

- sejarah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTML

- HTTPS

- Ratusan

- IAM

- diidentifikasi

- identitas

- pentingnya

- in

- memasukkan

- masuk

- Meningkatkan

- meningkatkan

- sendiri-sendiri

- informasi

- Infrastruktur

- memasukkan

- Sisipan

- wawasan

- install

- contoh

- Lembaga

- instruksi

- tertarik

- IT

- ikut

- json

- kafka

- Aliran Data Kinesis

- bahasa

- lebih besar

- Latensi

- Terbaru

- jalankan

- pengetahuan

- Meninggalkan

- Panjang

- Tingkat

- MEMBATASI

- pembatasan

- memuat

- beban

- jangka panjang

- Rendah

- mesin

- Mesin belajar

- terbuat

- membuat

- MEMBUAT

- berhasil

- pelaksana

- manual

- banyak

- peta

- secara besar-besaran

- sesuai

- matplotlib.dll

- max

- cara

- Media

- metode

- metrik

- Metrik

- Mengurangi

- ML

- mode

- model

- model

- bulanan

- bulan

- lebih

- paling

- pindah

- nama

- Navigasi

- Perlu

- kebutuhan

- New

- berikutnya

- pemberitahuan

- jumlah

- mati rasa

- tujuan

- ONE

- membuka

- operasi

- operasional

- Operasi

- Peluang

- Opsi

- urutan

- organisasi

- Lainnya

- diuraikan

- paket

- panda

- pane

- parameter

- bagian

- sempurna

- melakukan

- prestasi

- melakukan

- Izin

- telepon

- Tempat

- perencanaan

- Platform

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- silahkan

- Kebijakan

- kebijaksanaan

- mungkin

- Pos

- kekuasaan

- Ketelitian

- meramalkan

- ramalan

- Prediksi

- Prediksi

- sebelumnya

- di harga

- proses

- proses

- produsen

- program

- memberikan

- menyediakan

- publik

- menerbitkan

- Ular sanca

- Pertanyaan

- segera

- acak

- Bacaan

- siap

- nyata

- real-time

- data waktu nyata

- mewujudkan

- menerima

- diterima

- baru

- diakui

- arsip

- BERKALI-KALI

- menggantikan

- wajib

- sumber

- Sumber

- ISTIRAHAT

- Hasil

- Pengembalian

- Risiko

- Peran

- Run

- berjalan

- pembuat bijak

- San

- San Fransisco

- terukur

- Skala

- screenshot

- SDK

- yg keturunan dr laut

- Kedua

- detik

- Bagian

- bagian

- aman

- terpilih

- seleksi

- Tanpa Server

- layanan

- set

- pengaturan

- pengaturan

- penyiapan

- jangka pendek

- Menunjukkan

- Pertunjukkan

- Sederhana

- menyederhanakan

- simulator

- So

- Sosial

- media sosial

- larutan

- Solusi

- beberapa

- sumber

- sumber

- spesialis

- spesialisasi

- menghabiskan

- membagi

- SQL

- Tahap

- standar

- mulai

- Negara

- Pernyataan

- Laporan

- Status

- Langkah

- Tangga

- penyimpanan

- menyimpan

- toko

- Strategis

- aliran

- Streaming

- Layanan streaming

- stream

- seperti itu

- besar

- sistem

- sistem

- tabel

- Mengambil

- Dibutuhkan

- Pembicaraan

- target

- terminal

- uji

- Grafik

- Ketiga

- ribuan

- Melalui

- waktu

- timestamp

- untuk

- puncak

- tema

- secara tradisional

- Pelatihan VE

- terlatih

- Pelatihan

- .

- transaksional

- Transaksi

- Mengubah

- transformasi

- mengubah

- kecenderungan

- Memperbarui

- diperbarui

- penggunaan

- menggunakan

- Pengguna

- divalidasi

- nilai

- Nilai - Nilai

- berbagai

- Kejujuran

- versi

- View

- 'view'

- berjalan

- walkthrough

- Gudang

- Pergudangan

- Situs Web

- akhir pekan

- mingguan

- Apa

- yang

- sementara

- Wikipedia

- akan

- tanpa

- bekerja

- kerja

- bekerja

- menulis

- tahun

- Yoga

- Anda

- zephyrnet.dll