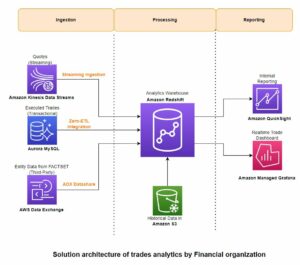

Pergeseran Merah Amazon adalah data warehouse skala petabyte yang cepat, terkelola sepenuhnya, yang memberikan fleksibilitas untuk menggunakan komputasi yang disediakan atau tanpa server untuk beban kerja analitik Anda. Menggunakan Amazon Redshift Tanpa Server dan Editor Kueri v2, Anda dapat memuat dan membuat kueri kumpulan data besar hanya dengan beberapa klik dan hanya membayar apa yang Anda gunakan. Arsitektur komputasi dan penyimpanan terpisah dari Amazon Redshift memungkinkan Anda membangun beban kerja yang sangat dapat diskalakan, tangguh, dan hemat biaya. Banyak pelanggan memigrasikan beban kerja pergudangan data mereka ke Amazon Redshift dan memanfaatkan kemampuan kaya yang ditawarkannya. Berikut ini adalah beberapa kemampuan penting:

- Amazon Redshift berintegrasi mulus dengan yang lebih luas layanan analitik di AWS. Ini memungkinkan Anda memilih alat yang tepat untuk pekerjaan yang tepat. Analitik modern jauh lebih luas daripada pergudangan data berbasis SQL. Amazon Redshift memungkinkan Anda membangun arsitektur rumah danau dan kemudian melakukan analitik apa pun, seperti analitik interaktif, analitik operasional, pemrosesan data besar, persiapan data visual, analitik prediktif, pembelajaran mesin (ML), dan lainnya.

- Anda tidak perlu khawatir tentang beban kerja, seperti ETL, dasbor, kueri ad-hoc, dan sebagainya, yang saling mengganggu. Kamu bisa mengisolasi beban kerja menggunakan berbagi data, sambil menggunakan kumpulan data dasar yang sama.

- Saat pengguna menjalankan banyak kueri pada waktu puncak, hitung skala dengan mulus dalam hitungan detik untuk memberikan kinerja yang konsisten pada konkurensi tinggi. Anda mendapatkan satu jam kapasitas penskalaan konkurensi gratis selama 24 jam penggunaan. Kredit gratis ini memenuhi permintaan konkurensi sebesar 97% dari basis pelanggan Amazon Redshift.

- Amazon Redshift mudah digunakan penyesuaian diri dan pengoptimalan diri kemampuan. Anda bisa mendapatkan wawasan lebih cepat tanpa menghabiskan waktu yang berharga untuk mengelola gudang data Anda.

- Toleransi kesalahan sudah terpasang. Semua data yang ditulis ke Amazon Redshift secara otomatis dan terus menerus direplikasi Layanan Penyimpanan Sederhana Amazon (Amazon S3). Setiap kegagalan perangkat keras diganti secara otomatis.

- Amazon Redshift adalah sederhana untuk berinteraksi dengan. Anda dapat mengakses data dengan aplikasi tradisional, berbasis cloud, terkontainerisasi, dan tanpa server berbasis layanan web atau berbasis peristiwa, dan seterusnya.

- Pergeseran merah ML memudahkan data scientist untuk membuat, melatih, dan menerapkan model ML menggunakan SQL yang sudah dikenal. Mereka juga dapat menjalankan prediksi menggunakan SQL.

- Amazon Redshift menyediakan keamanan data yang komprehensif tanpa biaya tambahan. Anda dapat menyiapkan enkripsi data end-to-end, mengonfigurasi aturan firewall, menentukan kontrol keamanan tingkat baris dan kolom terperinci pada data sensitif, dan sebagainya.

- Pergeseran Merah Amazon terintegrasi mulus dengan layanan AWS lainnya dan alat pihak ketiga. Anda dapat memindahkan, mengubah, memuat, dan membuat kueri kumpulan data besar dengan cepat dan andal.

Dalam postingan ini, kami memberikan panduan untuk memigrasi gudang data dari Google BigQuery ke Amazon Redshift menggunakan Alat Konversi Skema AWS (AWS SCT) dan Agen ekstraksi data AWS SCT. AWS SCT adalah layanan yang membuat migrasi database heterogen dapat diprediksi dengan mengonversi sebagian besar kode database dan objek penyimpanan secara otomatis ke format yang kompatibel dengan database target. Objek apa pun yang tidak dapat dikonversi secara otomatis ditandai dengan jelas sehingga dapat dikonversi secara manual untuk menyelesaikan migrasi. Selain itu, AWS SCT dapat memindai kode aplikasi Anda untuk pernyataan SQL tersemat dan mengonversinya.

Ikhtisar solusi

AWS SCT menggunakan akun layanan untuk terhubung ke proyek BigQuery Anda. Pertama, kami membuat database Amazon Redshift tempat data BigQuery dimigrasikan. Selanjutnya, kami membuat bucket S3. Kemudian, kami menggunakan AWS SCT untuk mengonversi skema BigQuery dan menerapkannya ke Amazon Redshift. Terakhir, untuk memigrasikan data, kami menggunakan agen ekstraksi data AWS SCT, yang mengekstrak data dari BigQuery, mengunggahnya ke dalam bucket S3, lalu menyalinnya ke Amazon Redshift.

Prasyarat

Sebelum memulai panduan ini, Anda harus memiliki prasyarat berikut:

- Stasiun kerja dengan AWS SCT, Amazon Coretto 11, dan driver Amazon Redshift.

- Anda dapat menggunakan Amazon Elastic Compute Cloud (Amazon EC2) atau desktop lokal Anda sebagai workstation. Dalam panduan ini, kami menggunakan Contoh Windows Amazon EC2. Untuk membuatnya, gunakan panduan ini.

- Untuk mengunduh dan menginstal AWS SCT pada instans EC2 yang Anda buat sebelumnya, gunakan panduan ini.

- Unduh driver JDBC Amazon Redshift dari lokasi ini.

- Download dan menginstal Amazon Coretto 11.

- Akun layanan GCP yang dapat digunakan AWS SCT untuk terhubung ke proyek BigQuery sumber Anda.

- Hibah Admin BigQuery dan Admin Penyimpanan peran ke akun layanan.

- Salin file kunci akun Layanan, yang dibuat di konsol manajemen cloud Google, ke instans EC2 yang memiliki AWS SCT.

- Buat bucket Cloud Storage di GCP untuk menyimpan data sumber Anda selama migrasi.

Panduan ini mencakup langkah-langkah berikut:

- Buat Grup Kerja dan Namespace Amazon Redshift Tanpa Server

- Buat Bucket dan Folder AWS S3

- Mengonversi dan menerapkan Skema BigQuery ke Amazon Redshift menggunakan AWS SCT

- Menghubungkan ke Sumber Google BigQuery

- Hubungkan ke Target Amazon Redshift

- Mengonversi skema BigQuery ke Amazon Redshift

- Menganalisis laporan penilaian dan mengatasi item tindakan

- Terapkan skema yang dikonversi untuk menargetkan Amazon Redshift

- Migrasikan data menggunakan agen ekstraksi data AWS SCT

- Membangkitkan Kepercayaan dan Penyimpanan Kunci (Opsional)

- Instal dan mulai agen ekstraksi data

- Daftarkan agen ekstraksi data

- Tambahkan partisi virtual untuk tabel besar (Opsional)

- Buat tugas migrasi lokal

- Mulai Tugas Migrasi Data Lokal

- Lihat Data di Amazon Redshift

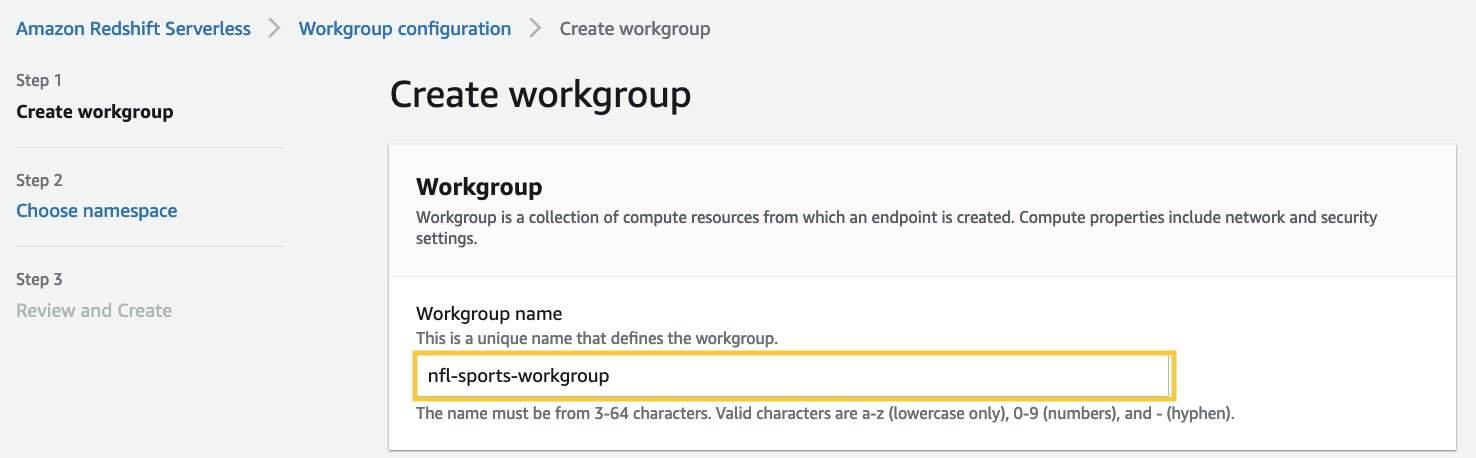

Buat Grup Kerja dan Namespace Amazon Redshift Tanpa Server

Pada langkah ini, kami membuat grup kerja dan namespace Amazon Redshift Serverless. Workgroup adalah kumpulan sumber daya komputasi dan namespace adalah kumpulan objek database dan pengguna. Untuk mengisolasi beban kerja dan mengelola sumber daya yang berbeda di Amazon Redshift Tanpa Server, Anda dapat membuat ruang nama dan grup kerja serta mengelola penyimpanan dan menghitung sumber daya secara terpisah.

Ikuti langkah-langkah ini untuk membuat workgroup dan namespace Amazon Redshift Serverless:

- Arahkan ke folder Konsol Amazon Redshift.

- Di kanan atas, pilih Wilayah AWS yang ingin Anda gunakan.

- Perluas panel Amazon Redshift di sebelah kiri dan pilih Redshift Tanpa Server.

- Pilih Buat Grup Kerja.

- Untuk Nama kelompok kerja, masukkan nama yang menjelaskan sumber daya komputasi.

- Verifikasi bahwa VPC sama dengan VPC seperti instans EC2 dengan AWS SCT.

- Pilih Selanjutnya.

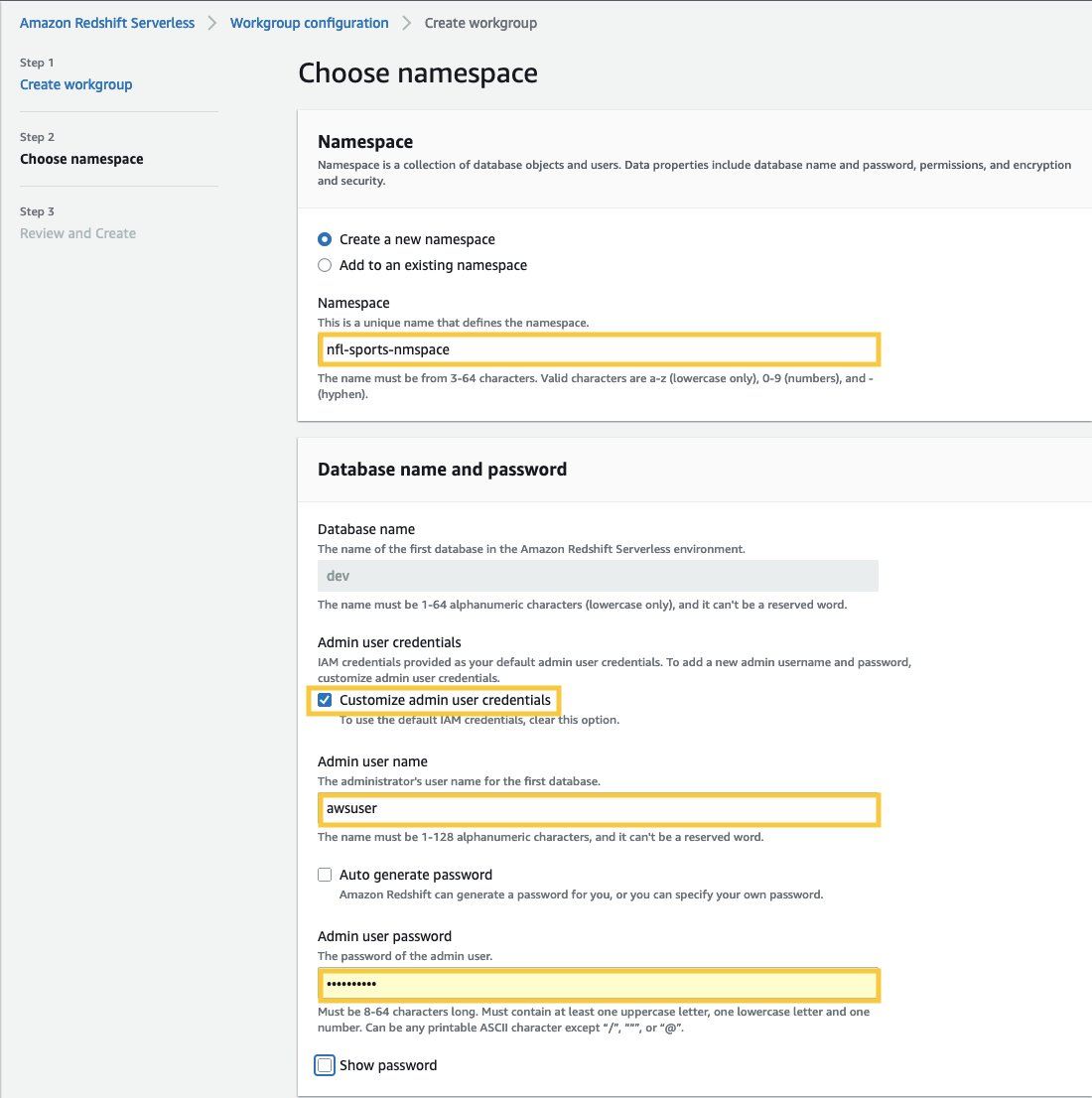

- Untuk Nama ruang nama, masukkan nama yang mendeskripsikan kumpulan data Anda.

- In Nama basis data dan kata sandi bagian, pilih kotak centang Sesuaikan kredensial pengguna admin.

- Untuk nama pengguna administrator, masukkan nama pengguna pilihan Anda, misalnya awsuser.

- Untuk Kata sandi pengguna admin: masukkan kata sandi pilihan Anda, misalnya Pergeseran Merah SayaPW2022.

- Pilih Next. Perhatikan bahwa data di namespace Amazon Redshift Serverless dienkripsi secara default.

- Dalam majalah Tinjau dan Buat halaman, pilih membuat.

- Buat AWS Identitas dan Manajemen Akses (IAM) dan atur sebagai default di namespace Anda, seperti yang dijelaskan berikut ini. Perhatikan bahwa hanya ada satu peran IAM default.

- Arahkan ke folder Dasbor Tanpa Server Amazon Redshift.

- Bawah Ruang nama / Grup Kerja, pilih namespace yang baru saja Anda buat.

- Navigasi keKeamanan dan enkripsi.

- Bawah izin, pilih Kelola peran IAM.

- Navigasi ke Kelola peran IAM. Kemudian, pilih Kelola peran IAM tarik-turun dan pilih Buat peran IAM.

- Bawah Tentukan bucket Amazon S3 untuk diakses oleh peran IAM, pilih salah satu metode berikut:

- Pilih Tidak ada bucket Amazon S3 tambahan untuk memungkinkan peran IAM yang dibuat hanya mengakses bucket S3 dengan nama yang diawali dengan redshift.

- Pilih Setiap ember Amazon S3 untuk mengizinkan peran IAM yang dibuat untuk mengakses semua bucket S3.

- Pilih Bucket Amazon S3 khusus untuk menentukan satu atau beberapa bucket S3 untuk diakses oleh peran IAM yang dibuat. Kemudian pilih satu atau beberapa bucket S3 dari tabel.

- Pilih Buat peran IAM sebagai default. Amazon Redshift secara otomatis membuat dan menetapkan peran IAM sebagai default.

- Abadikan Titik Akhir untuk grup kerja Tanpa Server Amazon Redshift yang baru saja Anda buat.

Buat bucket dan folder S3

Selama proses migrasi data, AWS SCT menggunakan Amazon S3 sebagai area pementasan untuk data yang diekstrak. Ikuti langkah-langkah ini untuk membuat bucket S3:

- Arahkan ke folder Konsol Amazon S3

- Pilih Buat ember. itu Buat ember penyihir terbuka.

- Untuk Nama ember, masukkan nama unik yang sesuai dengan DNS untuk bucket Anda (misalnya, nama unik-bq-rs). Lihat aturan untuk penamaan keranjang saat memilih nama.

- Untuk Wilayah AWS, pilih wilayah tempat Anda membuat grup kerja Tanpa Server Amazon Redshift.

- Pilih Buat Ember.

- Dalam majalah Konsol Amazon S3, arahkan ke keranjang S3 yang baru saja Anda buat (misalnya, nama unik-bq-rs).

- Pilih "Membuat folder" untuk membuat folder baru.

- Untuk Nama folder, Enter masuk Dan pilihlah Membuat folder.

Mengonversi dan menerapkan Skema BigQuery ke Amazon Redshift menggunakan AWS SCT

Untuk mengonversi skema BigQuery ke format Amazon Redshift, kami menggunakan AWS SCT. Mulailah dengan masuk ke instans EC2 yang kami buat sebelumnya, lalu luncurkan AWS SCT.

Ikuti langkah-langkah ini menggunakan AWS SCT:

Hubungkan ke Sumber BigQuery

- Dari Menu File pilih Buat Proyek Baru.

- Pilih lokasi untuk menyimpan file dan data proyek Anda.

- Berikan nama yang bermakna namun mudah diingat untuk proyek Anda, seperti BigQuery ke Amazon Redshift.

- Untuk terhubung ke gudang data sumber BigQuery, pilih Tambahkan sumber dari menu utama.

- Pilih Pertanyaan Besar Dan pilihlah Selanjutnya. Itu Tambahkan sumber kotak dialog muncul.

- Untuk Nama koneksi, masukkan nama untuk menjelaskan koneksi BigQuery. AWS SCT menampilkan nama ini pada pohon di panel kiri.

- Untuk Jalur kunci, berikan jalur file kunci akun layanan yang sebelumnya dibuat di konsol manajemen awan Google.

- Pilih uji koneksi untuk memverifikasi bahwa AWS SCT dapat terhubung ke proyek BigQuery sumber Anda.

- Setelah koneksi berhasil divalidasi, pilih Terhubung.

Hubungkan ke Target Amazon Redshift

Ikuti langkah-langkah ini untuk terhubung ke Amazon Redshift:

- Di AWS SCT, pilih Tambahkan Sasaran dari menu utama.

- Pilih Pergeseran Merah Amazon, Lalu pilih Next. Grafik Tambahkan Sasaran kotak dialog muncul.

- Untuk Nama koneksi, masukkan nama untuk mendeskripsikan koneksi Amazon Redshift. AWS SCT menampilkan nama ini pada pohon di panel kanan.

- Untuk Nama server, masukkan titik akhir grup kerja Tanpa Server Amazon Redshift yang diambil sebelumnya.

- Untuk pelabuhan server, Enter 5439.

- Untuk basis data, Enter dev.

- Untuk Nama belakang, masukkan nama pengguna yang dipilih saat membuat grup kerja Amazon Redshift Serverless.

- Untuk Kata Sandi, masukkan kata sandi yang dipilih saat membuat grup kerja Amazon Redshift Serverless.

- Hapus tanda centang kotak "Gunakan AWS Glue".

- Pilih uji koneksi untuk memverifikasi bahwa AWS SCT dapat terhubung ke grup kerja Amazon Redshift target Anda.

- Pilih Terhubung untuk terhubung ke target Amazon Redshift.

Perhatikan bahwa sebagai alternatif Anda dapat menggunakan nilai koneksi yang disimpan di Manajer Rahasia AWS.

Mengonversi skema BigQuery ke Amazon Redshift

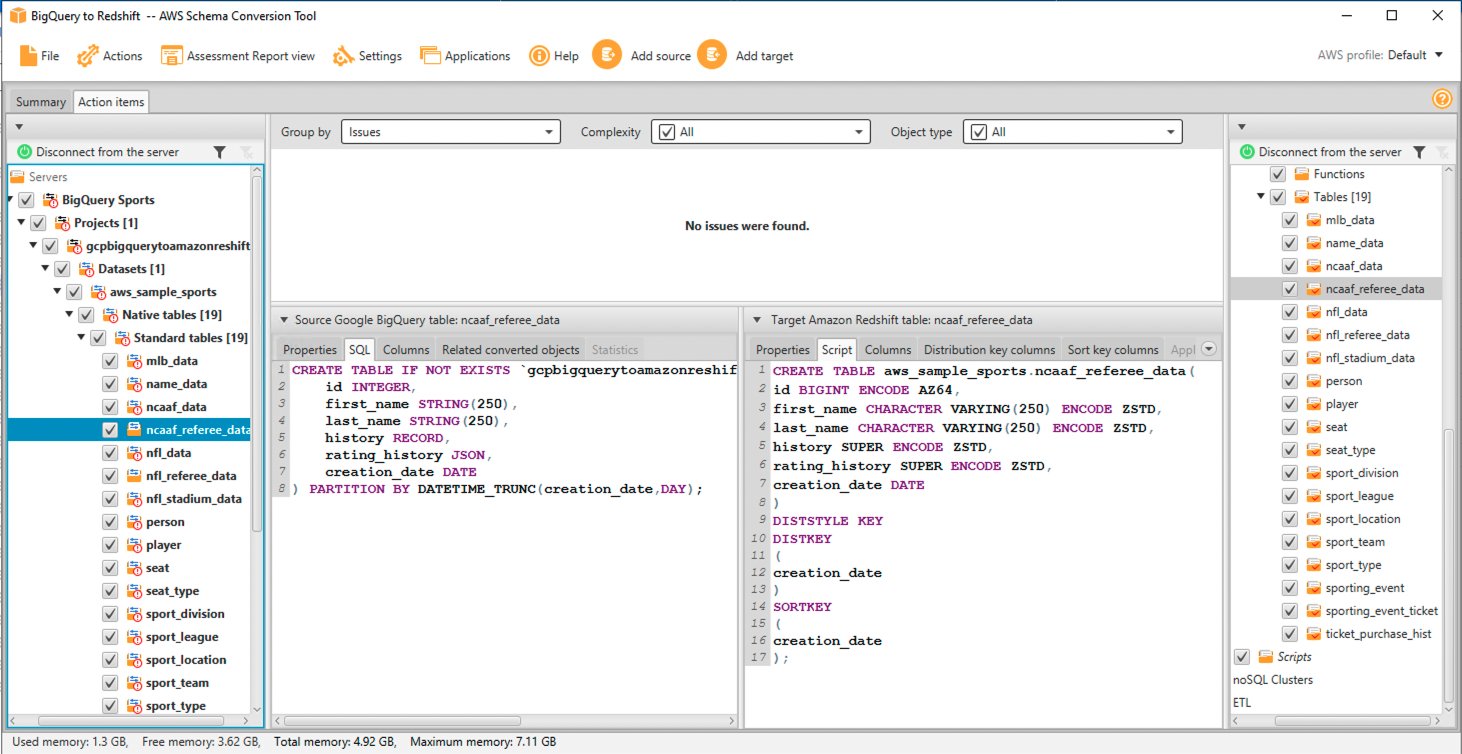

Setelah koneksi sumber dan target berhasil dibuat, Anda akan melihat pohon objek BigQuery sumber di panel kiri dan pohon objek Amazon Redshift target di panel kanan.

Ikuti langkah-langkah berikut untuk mengonversi skema BigQuery ke format Amazon Redshift:

- Di panel kiri, klik kanan pada skema yang ingin Anda ubah.

- Pilih Konversi Skema.

- Sebuah kotak dialog muncul dengan pertanyaan, Objek mungkin sudah ada di database target. Mengganti?. Pilih Ya.

Setelah konversi selesai, Anda akan melihat skema baru dibuat di panel Amazon Redshift (panel kanan) dengan nama yang sama dengan skema BigQuery Anda.

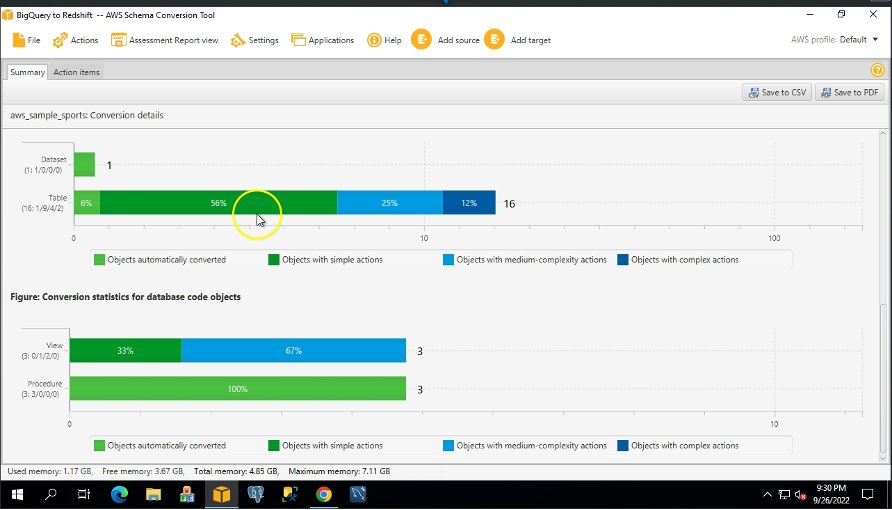

Skema sampel yang kami gunakan memiliki 16 tabel, 3 tampilan, dan 3 prosedur. Anda dapat melihat objek ini dalam format Amazon Redshift di panel kanan. AWS SCT mengonversi semua kode BigQuery dan objek data ke format Amazon Redshift. Selain itu, Anda dapat menggunakan AWS SCT untuk mengonversi skrip SQL eksternal, kode aplikasi, atau file tambahan dengan SQL tersemat.

Menganalisis laporan penilaian dan mengatasi item tindakan

AWS SCT membuat laporan penilaian untuk menilai kompleksitas migrasi. AWS SCT dapat mengonversi sebagian besar kode dan objek database. Namun, beberapa objek mungkin memerlukan konversi manual. AWS SCT menyorot objek ini dengan warna biru di diagram statistik konversi dan membuat item tindakan dengan kompleksitas yang menyertainya.

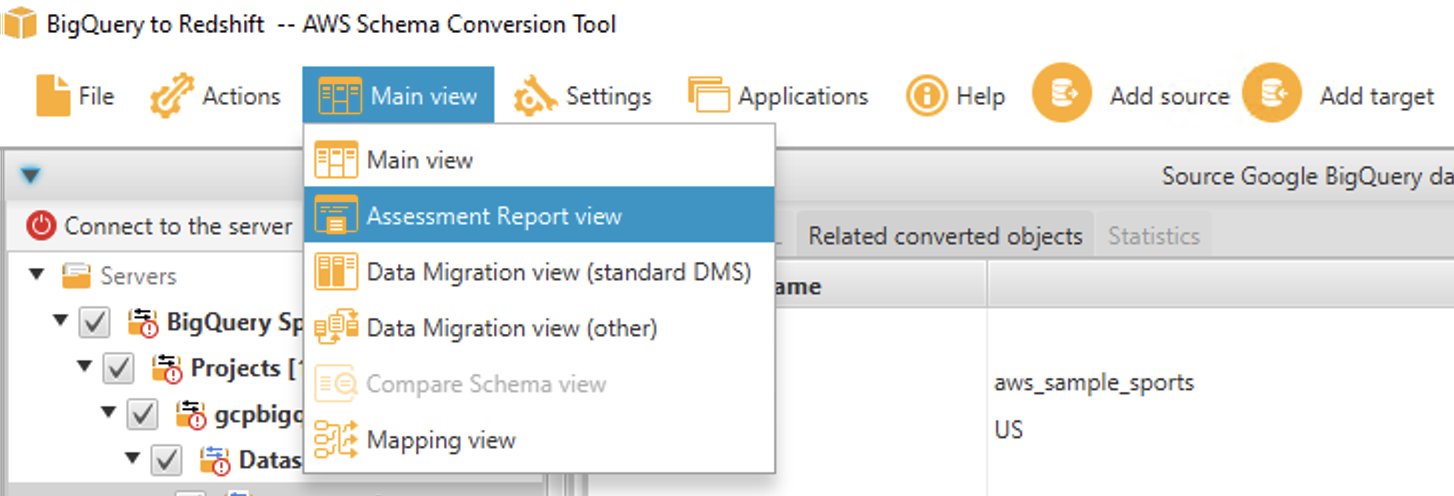

Untuk melihat laporan penilaian, alihkan dari Tampilan utama ke Tampilan Laporan Penilaian sebagai berikut:

Grafik Kesimpulan tab memperlihatkan objek yang dikonversi secara otomatis, dan objek yang tidak dikonversi secara otomatis. Hijau mewakili konversi otomatis atau dengan item tindakan sederhana. Biru mewakili item tindakan sedang dan kompleks yang memerlukan intervensi manual.

Grafik Barang Aksi tab menunjukkan tindakan yang disarankan untuk setiap masalah konversi. Jika Anda memilih item tindakan dari daftar, AWS SCT menyoroti objek tempat item tindakan diterapkan.

Laporan ini juga berisi rekomendasi tentang cara mengonversi item skema secara manual. Misalnya, setelah penilaian berjalan, laporan mendetail untuk database/skema menunjukkan upaya yang diperlukan untuk merancang dan menerapkan rekomendasi untuk mengonversi item Tindakan. Untuk informasi selengkapnya tentang memutuskan cara menangani konversi manual, lihat Menangani konversi manual di AWS SCT. Amazon Redshift mengambil beberapa tindakan secara otomatis saat mengonversi skema ke Amazon Redshift. Objek dengan tindakan ini ditandai dengan tanda peringatan berwarna merah.

Anda dapat mengevaluasi dan memeriksa DDL objek individual dengan memilihnya dari panel kanan, dan Anda juga dapat mengeditnya sesuai kebutuhan. Dalam contoh berikut, AWS SCT memodifikasi kolom tipe data RECORD dan JSON di tabel BigQuery ncaaf_referee_data menjadi tipe data SUPER di Amazon Redshift. Kunci partisi di tabel ncaaf_referee_data diubah menjadi kunci distribusi dan kunci pengurutan di Amazon Redshift.

Terapkan skema yang dikonversi untuk menargetkan Amazon Redshift

Untuk menerapkan skema yang dikonversi ke Amazon Redshift, pilih skema yang dikonversi di panel kanan, klik kanan, lalu pilih Terapkan ke basis data.

Migrasikan data dari BigQuery ke Amazon Redshift menggunakan agen ekstraksi data AWS SCT

Agen ekstraksi AWS SCT mengekstrak data dari database sumber Anda dan memigrasikannya ke AWS Cloud. Dalam panduan ini, kami menunjukkan cara mengonfigurasi agen ekstraksi AWS SCT untuk mengekstrak data dari BigQuery dan bermigrasi ke Amazon Redshift.

Pertama, instal agen ekstraksi AWS SCT pada instans Windows yang sama dengan AWS SCT yang diinstal. Untuk kinerja yang lebih baik, kami menyarankan Anda menggunakan instans Linux terpisah untuk menginstal agen ekstraksi jika memungkinkan. Untuk kumpulan data besar, Anda dapat menggunakan beberapa agen ekstraksi data untuk meningkatkan kecepatan migrasi data.

Membangkitkan kepercayaan dan penyimpanan kunci (opsional)

Anda dapat menggunakan komunikasi terenkripsi Secure Socket Layer (SSL) dengan ekstraktor data AWS SCT. Saat Anda menggunakan SSL, semua data yang diteruskan di antara aplikasi tetap pribadi dan tidak terpisahkan. Untuk menggunakan komunikasi SSL, Anda harus menghasilkan kepercayaan dan penyimpanan kunci menggunakan AWS SCT. Anda dapat melewati langkah ini jika tidak ingin menggunakan SSL. Kami merekomendasikan penggunaan SSL untuk beban kerja produksi.

Ikuti langkah-langkah ini untuk menghasilkan kepercayaan dan penyimpanan kunci:

- Di AWS SCT, buka Pengaturan → Pengaturan Global → Keamanan.

- Pilih Hasilkan kepercayaan dan penyimpanan kunci.

- Masukkan nama dan kata sandi untuk kepercayaan dan penyimpanan kunci dan pilih lokasi tempat Anda ingin menyimpannya.

- Pilih Menghasilkan.

Instal dan konfigurasikan Agen Ekstraksi Data

Dalam paket instalasi untuk AWS SCT, Anda menemukan agen sub-folder (aws-schema-conversion-tool-1.0.latest.zipagents). Temukan dan instal file yang dapat dieksekusi dengan nama seperti aws-skema-konversi-alat-ekstraktor-xxxxxxxx.msi.

Dalam proses instalasi, ikuti langkah berikut untuk mengonfigurasi AWS SCT Data Extractor:

- Untuk Pelabuhan mendengarkan, masukkan nomor port tempat agen mendengarkan. Ini adalah 8192 secara default.

- Untuk Tambahkan vendor sumber, Masuk tidak, karena Anda tidak memerlukan driver untuk terhubung ke BigQuery.

- Untuk Tambahkan driver Amazon Redshift, Masuk YES.

- Untuk Masukkan file atau file driver Redshift JDBC, masukkan lokasi tempat Anda mengunduh driver Amazon Redshift JDBC.

- Untuk Folder kerja, masukkan jalur tempat agen ekstraksi data AWS SCT akan menyimpan data yang diekstraksi. Folder kerja dapat berada di komputer yang berbeda dari agen, dan satu folder kerja dapat digunakan bersama oleh beberapa agen di komputer yang berbeda.

- Untuk Aktifkan komunikasi SSL, Masuk iya nih. Pilih Tidak di sini jika Anda tidak ingin menggunakan SSL.

- Untuk Toko kunci, masukkan lokasi penyimpanan yang dipilih saat membuat kepercayaan dan penyimpanan kunci.

- Untuk Kata sandi penyimpanan kunci, masukkan kata sandi untuk penyimpanan kunci.

- Untuk Aktifkan autentikasi SSL klien, Masuk iya nih.

- Untuk Toko kepercayaan, masukkan lokasi penyimpanan yang dipilih saat membuat kepercayaan dan penyimpanan kunci.

- Untuk Kata sandi toko tepercaya, masukkan kata sandi untuk toko kepercayaan.

Memulai Agen Ekstraksi Data

Gunakan prosedur berikut untuk memulai agen ekstraksi. Ulangi prosedur ini di setiap komputer yang memiliki agen ekstraksi yang diinstal.

Agen ekstraksi bertindak sebagai pendengar. Saat Anda memulai agen dengan prosedur ini, agen mulai mendengarkan instruksi. Anda mengirim instruksi agen untuk mengekstrak data dari gudang data Anda di bagian selanjutnya.

Untuk memulai agen ekstraksi, navigasikan ke direktori Agen Ekstraktor Data AWS SCT. Misalnya, di Microsoft Windows, klik dua kali C:Program FilesAWS SCT Data Extractor AgentStartAgent.bat.

- Di komputer yang telah menginstal agen ekstraksi, dari prompt perintah atau jendela terminal, jalankan perintah yang tercantum mengikuti sistem operasi Anda.

- Untuk memeriksa status agen, jalankan perintah yang sama tetapi ganti mulai dengan status.

- Untuk menghentikan agen, jalankan perintah yang sama tetapi ganti start dengan stop.

- Untuk memulai ulang agen, jalankan file RestartAgent.bat yang sama.

Daftarkan Agen Ekstraksi Data

Ikuti langkah-langkah ini untuk mendaftarkan Agen Ekstraksi Data:

- Di AWS SCT, ubah tampilan menjadi Tampilan Migrasi Data (lainnya) Dan pilihlah + Daftar.

- Di tab koneksi:

- Untuk Deskripsi Produk, masukkan nama untuk mengidentifikasi Agen Ekstraksi Data.

- Untuk nama tuan rumah, jika Anda menginstal Agen Ekstraksi Data di stasiun kerja yang sama dengan AWS SCT, masukkan 0.0.0.0 untuk menunjukkan host lokal. Jika tidak, masukkan nama host mesin tempat Agen Ekstraksi Data AWS SCT diinstal. Disarankan untuk menginstal Agen Ekstraksi Data di Linux untuk kinerja yang lebih baik.

- Untuk pelabuhan, masukkan nomor yang dimasukkan untuk Pelabuhan Mendengarkan saat memasang Agen Ekstraksi Data AWS SCT.

- Pilih kotak centang untuk menggunakan SSL (jika menggunakan SSL) untuk mengenkripsi koneksi AWS SCT ke Agen Ekstraksi Data.

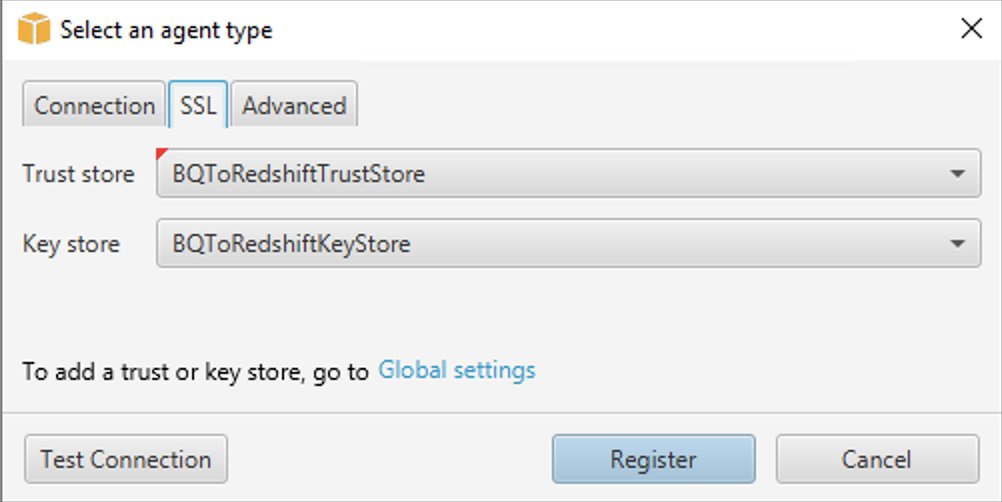

- Jika Anda menggunakan SSL, maka di Tab SSL:

- Untuk toko kepercayaan, pilih nama toko kepercayaan yang dibuat kapan menghasilkan Penyimpanan Kunci dan Kepercayaan (opsional, Anda dapat melewati ini jika konektivitas SSL tidak diperlukan).

- Untuk Toko Kunci, pilih nama penyimpanan kunci yang dibuat kapan menghasilkan Penyimpanan Kunci dan Kepercayaan (opsional, Anda dapat melewati ini jika konektivitas SSL tidak diperlukan).

- Pilih uji koneksi.

- Setelah koneksi berhasil divalidasi, pilih Daftar.

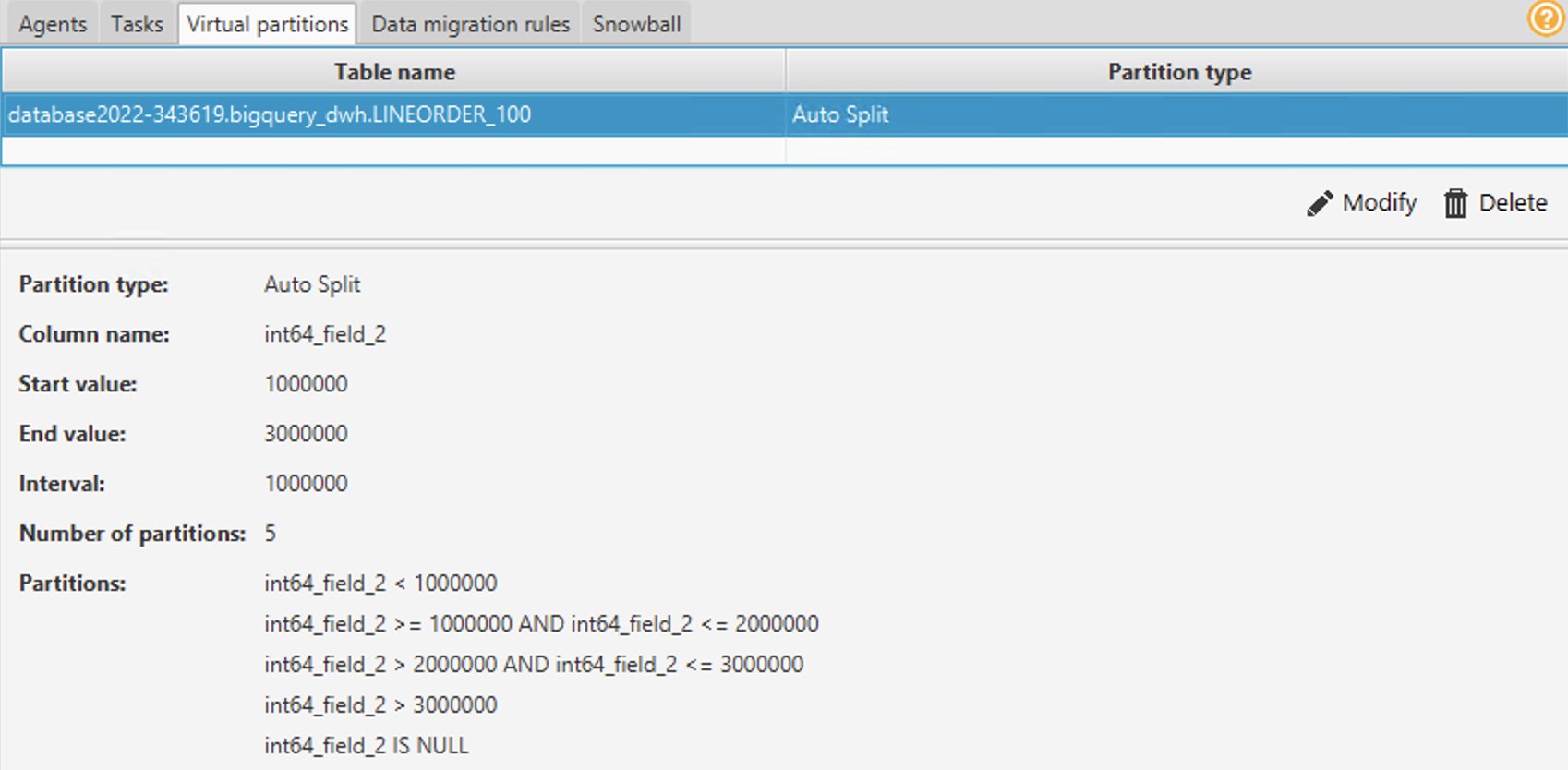

Tambahkan partisi virtual untuk tabel besar (opsional)

Anda dapat menggunakan AWS SCT untuk membuat partisi virtual guna mengoptimalkan kinerja migrasi. Saat partisi virtual dibuat, AWS SCT mengekstrak data secara paralel untuk partisi. Kami merekomendasikan membuat partisi virtual untuk tabel besar.

Ikuti langkah-langkah ini untuk membuat partisi virtual:

- Batalkan pilihan semua objek pada tampilan database sumber di AWS SCT.

- Pilih tabel yang ingin Anda tambahkan partisi virtual.

- Klik kanan pada tabel, dan pilih Tambahkan Partisi Virtual.

- Anda dapat menggunakan partisi List, Range, atau Auto Split. Untuk mempelajari lebih lanjut tentang partisi virtual, lihat Gunakan partisi virtual di AWS SCT. Dalam contoh ini, kami menggunakan Pemisahan partisi otomatis, yang menghasilkan partisi rentang secara otomatis. Anda akan menentukan nilai awal, nilai akhir, dan seberapa besar partisi seharusnya. AWS SCT menentukan partisi secara otomatis. Untuk demonstrasi, pada tabel Lineorder:

- Untuk Nilai Awal, masukkan 1000000.

- Untuk Nilai Akhir, masukkan 3000000.

- Untuk Selang, masukkan 1000000 untuk menunjukkan ukuran partisi.

- Pilih Ok.

Anda dapat melihat partisi yang dihasilkan secara otomatis di bawah Partisi Virtual tab. Dalam contoh ini, AWS SCT secara otomatis membuat lima partisi berikut untuk bidang tersebut:

-

- >=1000000 dan <=2000000

- > 2000000 dan <= 3000000

- > 3000000

- IS NULL

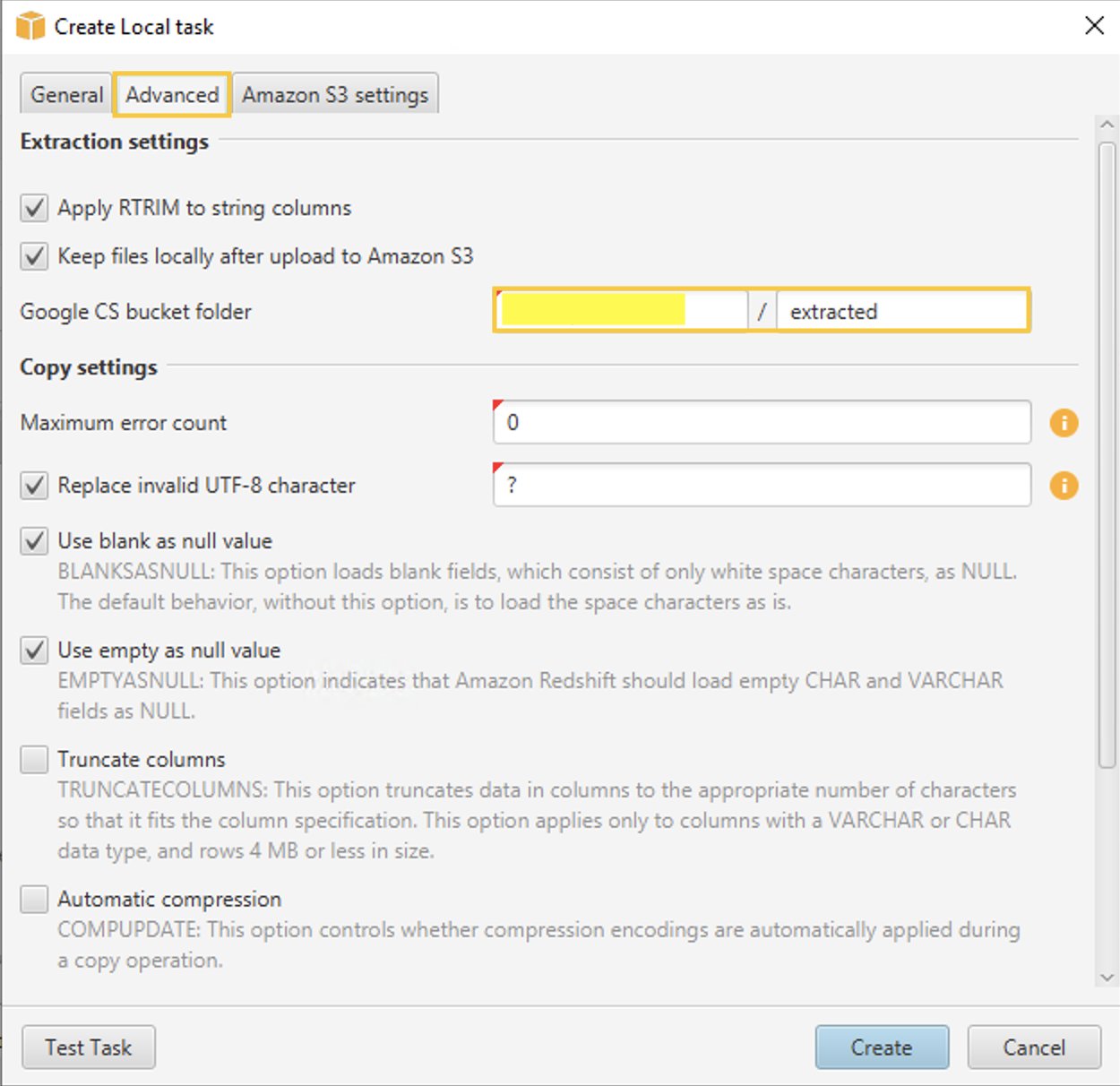

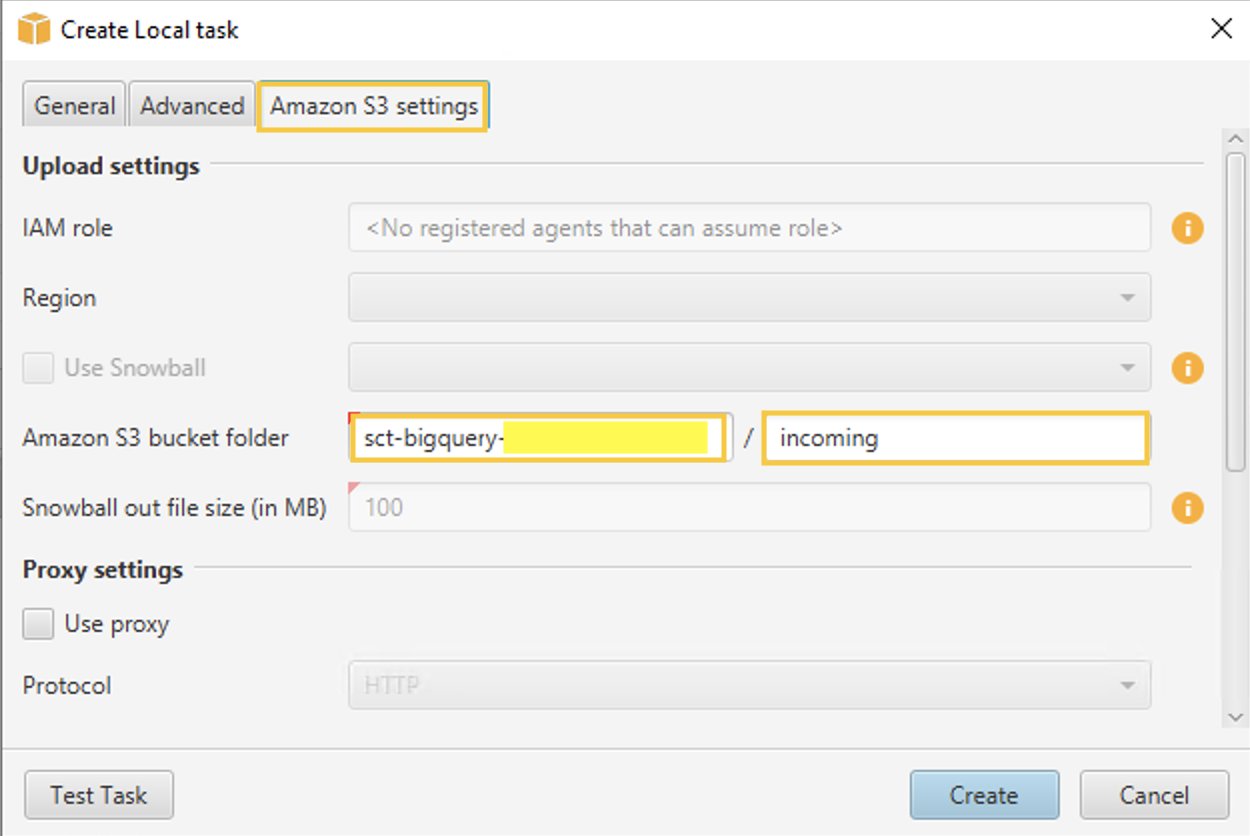

Buat tugas migrasi lokal

Untuk memigrasikan data dari BigQuery ke Amazon Redshift, buat, jalankan, dan pantau tugas migrasi lokal dari AWS SCT. Langkah ini menggunakan agen ekstraksi data untuk memigrasikan data dengan membuat tugas.

Ikuti langkah-langkah ini untuk membuat tugas migrasi lokal:

- Di AWS SCT, di bawah nama skema di panel kiri, klik kanan Tabel standar.

- Pilih Buat tugas Lokal.

- Ada tiga mode migrasi yang dapat Anda pilih:

- Ekstrak data sumber dan simpan di pc/mesin virtual (VM) lokal tempat agen berjalan.

- Ekstrak data dan unggah ke bucket S3.

- Pilih Ekstrak unggah dan salin, yang mengekstrak data ke bucket S3 lalu menyalin ke Amazon Redshift.

- Dalam majalah Advanced tab, untuk Folder keranjang Google CS masuk ke bucket/folder Google Cloud Storage yang Anda buat sebelumnya di GCP Management Console. AWS SCT menyimpan data yang diekstraksi di lokasi ini.

- Dalam majalah Pengaturan Amazon S3 tab, untuk folder ember Amazon S3, berikan nama bucket dan folder dari bucket S3 yang Anda buat sebelumnya. Agen ekstraksi data AWS SCT mengunggah data ke dalam bucket/folder S3 sebelum menyalin ke Amazon Redshift.

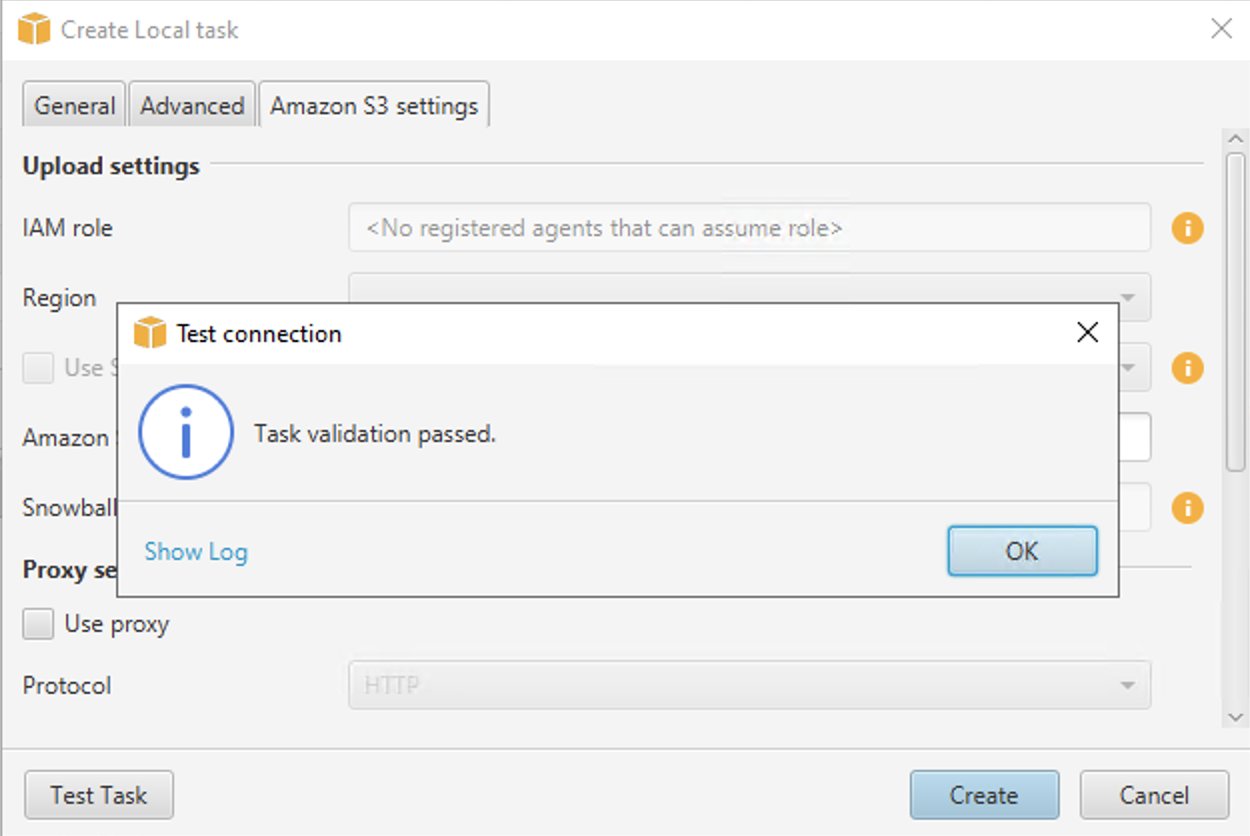

- Pilih Tugas Tes.

- Setelah tugas berhasil divalidasi, pilih membuat.

Mulai Tugas Migrasi Data Lokal

Untuk memulai tugas, pilih Start tombol di Tasks Tab.

- Pertama, Agen Ekstraksi Data mengekstrak data dari BigQuery ke dalam keranjang penyimpanan GCP.

- Kemudian, agen mengunggah data ke Amazon S3 dan meluncurkan perintah salin untuk memindahkan data ke Amazon Redshift.

- Pada titik ini, AWS SCT telah berhasil memigrasikan data dari tabel sumber BigQuery ke tabel Amazon Redshift.

Lihat data di Amazon Redshift

Setelah tugas migrasi data berhasil dijalankan, Anda dapat terhubung ke Amazon Redshift dan memvalidasi data.

Ikuti langkah-langkah berikut untuk memvalidasi data di Amazon Redshift:

- Arahkan ke folder Editor Kueri Amazon Redshift V2.

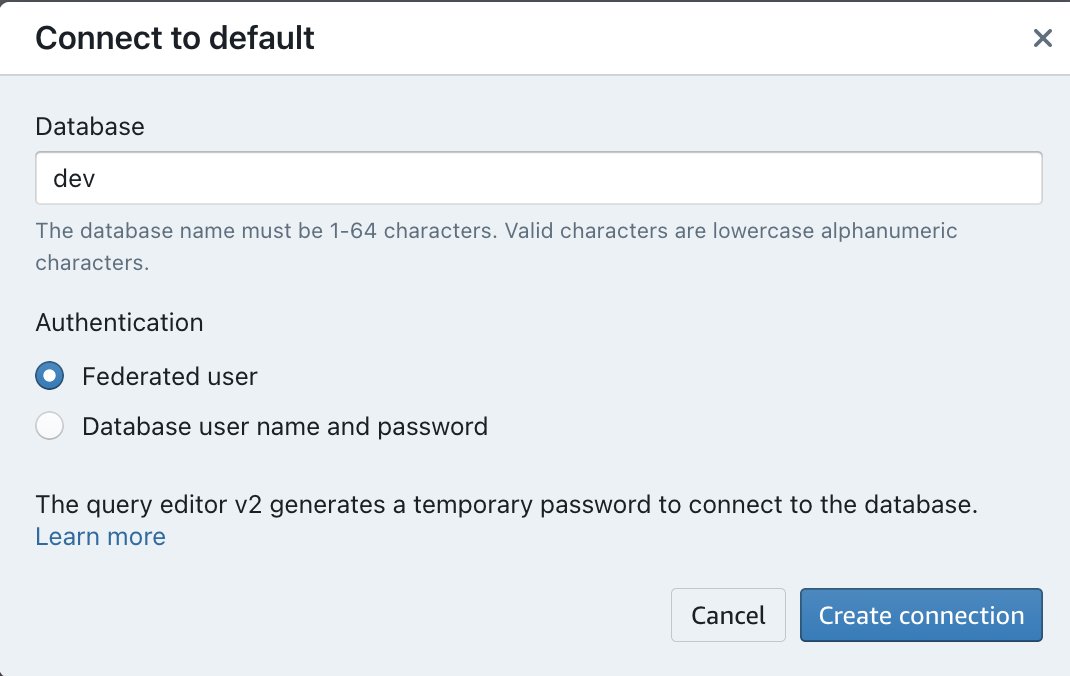

- Klik dua kali pada nama grup kerja Amazon Redshift Serverless yang Anda buat.

- Pilih Pengguna Federasi opsi di bawah Otentikasi.

- Pilih Buat Koneksi.

- Buat editor baru dengan memilih + icon.

- Di editor, tulis kueri untuk memilih dari nama skema dan nama tabel/nama tampilan yang ingin Anda verifikasi. Jelajahi data, jalankan kueri ad-hoc, dan buat visualisasi serta bagan dan tampilan.

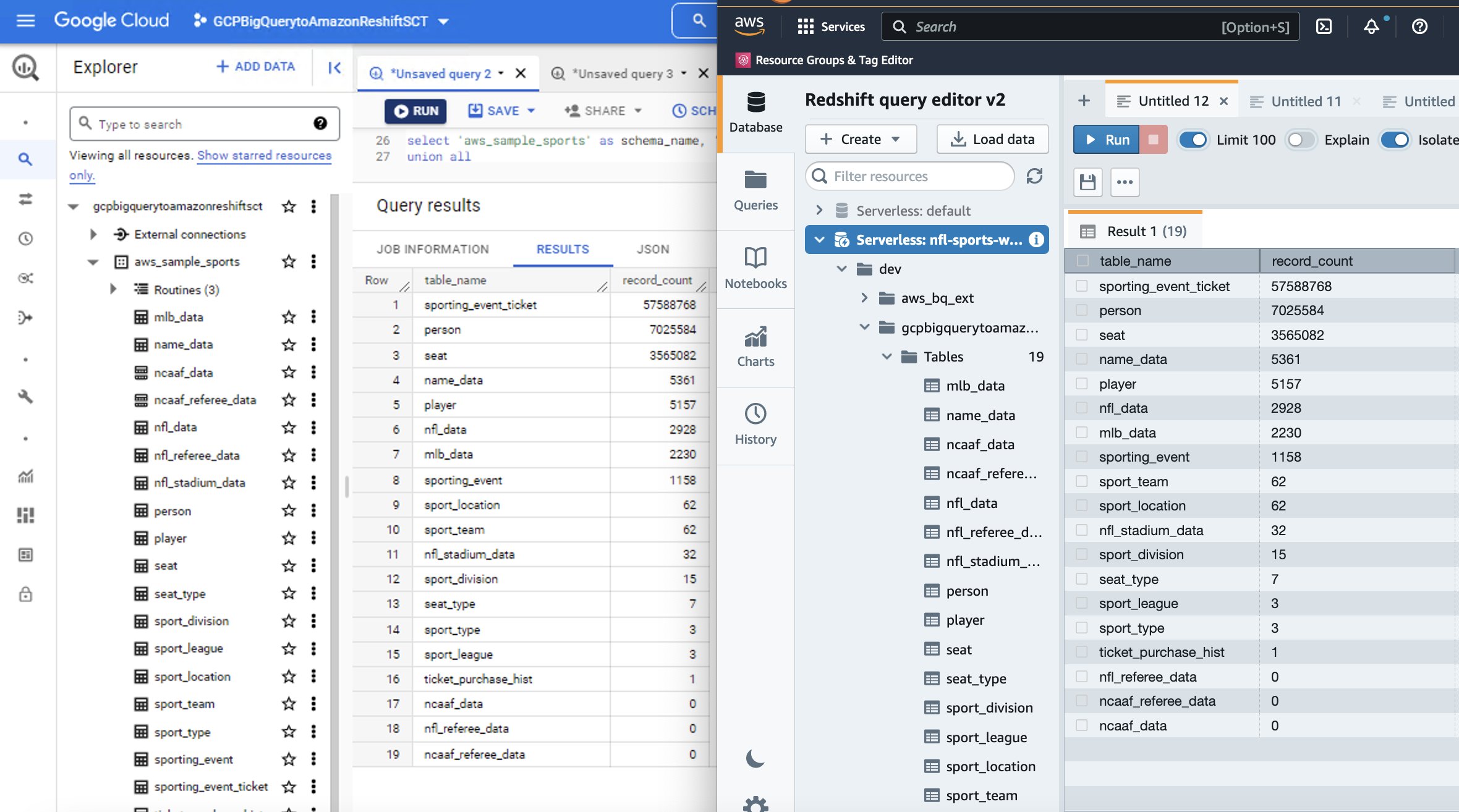

Berikut adalah perbandingan berdampingan antara sumber BigQuery dan target Amazon Redshift untuk kumpulan data olahraga yang kami gunakan dalam panduan ini.

Bersihkan semua sumber daya AWS yang Anda buat untuk latihan ini

Ikuti langkah-langkah ini untuk menghentikan instans EC2:

- Arahkan ke folder Konsol Amazon EC2.

- Di panel navigasi, pilih Contoh.

- Pilih kotak centang untuk instans EC2 yang Anda buat.

- Pilih Keadaan contoh, Dan kemudian Hentikan instance.

- Pilih Mengakhiri ketika diminta untuk konfirmasi.

Ikuti langkah-langkah ini untuk menghapus workgroup dan namespace Amazon Redshift Serverless

- Navigasi ke Dasbor Tanpa Server Amazon Redshift.

- Bawah Ruang nama / Grup Kerja, pilih ruang kerja yang Anda buat.

- Bawah tindakan, pilih Hapus grup kerja.

- Pilih kotak centang Hapus namespace terkait.

- Hapus tanda centang Buat cuplikan akhir.

- Enter hapus di kotak teks konfirmasi hapus dan pilih Hapus.

Ikuti langkah-langkah ini untuk menghapus bucket S3

- Navigasi ke Konsol Amazon S3.

- Pilih keranjang yang Anda buat.

- Pilih Delete.

- Untuk mengonfirmasi penghapusan, masukkan nama keranjang di kolom input teks.

- Pilih Hapus ember.

Kesimpulan

Memindahkan gudang data bisa menjadi proyek yang menantang, kompleks, namun bermanfaat. AWS SCT mengurangi kerumitan migrasi gudang data. Dengan mengikuti panduan ini, Anda dapat memahami bagaimana tugas migrasi data mengekstrak, mengunduh, lalu memigrasikan data dari BigQuery ke Amazon Redshift. Solusi yang kami sajikan dalam posting ini melakukan migrasi objek dan data database satu kali. Perubahan data yang dilakukan di BigQuery saat migrasi sedang berlangsung tidak akan tercermin di Amazon Redshift. Saat migrasi data sedang berlangsung, tunda tugas ETL Anda ke BigQuery atau putar ulang ETL dengan mengarahkan ke Amazon Redshift setelah migrasi. Pertimbangkan untuk menggunakan praktik terbaik untuk AWS SCT.

AWS SCT memiliki beberapa batasan saat menggunakan BigQuery sebagai sumber. Misalnya, AWS SCT tidak dapat mengonversi sub kueri dalam fungsi analitik, fungsi geografi, fungsi agregat statistik, dan sebagainya. Temukan daftar lengkap batasan di Panduan pengguna AWS SCT. Kami berencana untuk mengatasi keterbatasan ini dalam rilis mendatang. Terlepas dari keterbatasan ini, Anda dapat menggunakan AWS SCT untuk secara otomatis mengonversi sebagian besar kode BigQuery dan objek penyimpanan Anda.

Unduh dan instal AWS SCT, masuk ke Konsol AWS, checkout Amazon Redshift Tanpa Server, dan mulailah bermigrasi!

Tentang penulis

Cedrick Hoody adalah Arsitek Solusi dengan fokus pada migrasi database menggunakan AWS Database Migration Service (DMS) dan AWS Schema Conversion Tool (SCT) di AWS. Dia mengerjakan tantangan terkait migrasi DB. Dia bekerja sama dengan pelanggan sektor bisnis EdTech, Energi, dan ISV untuk membantu mereka mewujudkan potensi sesungguhnya dari layanan DMS. Dia telah membantu memigrasikan 100 database ke cloud AWS menggunakan DMS dan SCT.

Cedrick Hoody adalah Arsitek Solusi dengan fokus pada migrasi database menggunakan AWS Database Migration Service (DMS) dan AWS Schema Conversion Tool (SCT) di AWS. Dia mengerjakan tantangan terkait migrasi DB. Dia bekerja sama dengan pelanggan sektor bisnis EdTech, Energi, dan ISV untuk membantu mereka mewujudkan potensi sesungguhnya dari layanan DMS. Dia telah membantu memigrasikan 100 database ke cloud AWS menggunakan DMS dan SCT.

Amit Arora adalah Arsitek Solusi dengan fokus pada Database dan Analitik di AWS. Dia bekerja dengan pelanggan Teknologi Keuangan dan Energi Global kami dan mitra bersertifikasi AWS untuk memberikan bantuan teknis dan merancang solusi pelanggan pada proyek migrasi cloud, membantu pelanggan bermigrasi dan memodernisasi database mereka yang ada ke AWS Cloud.

Amit Arora adalah Arsitek Solusi dengan fokus pada Database dan Analitik di AWS. Dia bekerja dengan pelanggan Teknologi Keuangan dan Energi Global kami dan mitra bersertifikasi AWS untuk memberikan bantuan teknis dan merancang solusi pelanggan pada proyek migrasi cloud, membantu pelanggan bermigrasi dan memodernisasi database mereka yang ada ke AWS Cloud.

Jagadish Kumar adalah Arsitek Solusi Spesialis Analytics di AWS yang berfokus pada Amazon Redshift. Dia sangat tertarik dengan Arsitektur Data dan membantu pelanggan membangun solusi analitik dalam skala besar di AWS.

Jagadish Kumar adalah Arsitek Solusi Spesialis Analytics di AWS yang berfokus pada Amazon Redshift. Dia sangat tertarik dengan Arsitektur Data dan membantu pelanggan membangun solusi analitik dalam skala besar di AWS.

Anusha Challa adalah Arsitek Solusi Spesialis Analitik Senior di AWS yang berfokus pada Amazon Redshift. Dia telah membantu banyak pelanggan membangun solusi gudang data berskala besar di cloud dan lokal. Anusha sangat tertarik dengan analitik data dan ilmu data dan memungkinkan pelanggan mencapai kesuksesan dengan proyek data berskala besar mereka.

Anusha Challa adalah Arsitek Solusi Spesialis Analitik Senior di AWS yang berfokus pada Amazon Redshift. Dia telah membantu banyak pelanggan membangun solusi gudang data berskala besar di cloud dan lokal. Anusha sangat tertarik dengan analitik data dan ilmu data dan memungkinkan pelanggan mencapai kesuksesan dengan proyek data berskala besar mereka.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/migrate-google-bigquery-to-amazon-redshift-using-aws-schema-conversion-tool-sct/

- 1

- 10

- 100

- 9

- a

- Tentang Kami

- mengakses

- Akun

- Mencapai

- Bertindak

- Tindakan

- tindakan

- Tambahan

- alamat

- admin

- Setelah

- Agen

- agen

- Semua

- sudah

- Amazon

- Analitik

- Analytical

- analisis

- dan

- Aplikasi

- aplikasi

- Mendaftar

- arsitektur

- DAERAH

- penilaian

- Bantuan

- terkait

- Otentikasi

- mobil

- secara otomatis

- AWS

- mendasarkan

- BAT

- sebelum

- manfaat

- Lebih baik

- antara

- Besar

- Biru

- Kotak

- membangun

- bisnis

- tombol

- Bisa Dapatkan

- tidak bisa

- kemampuan

- Kapasitas

- Tersertifikasi

- tantangan

- menantang

- perubahan

- Perubahan

- Charts

- memeriksa

- Pembayaran

- pilihan

- Pilih

- memilih

- terpilih

- Jelas

- klien

- rapat

- awan

- Cloud Storage

- kode

- koleksi

- Kolom

- Kolom

- Komunikasi

- perbandingan

- cocok

- lengkap

- kompleks

- kompleksitas

- menghitung

- komputer

- komputer

- konfigurasi

- Memastikan

- Terhubung

- koneksi

- Koneksi

- Konektivitas

- Mempertimbangkan

- konsisten

- konsul

- mengandung

- kontrol

- Konversi

- konversi

- mengubah

- dikonversi

- penyalinan

- Biaya

- hemat biaya

- membuat

- dibuat

- menciptakan

- membuat

- kredit

- pelanggan

- Solusi Pelanggan

- pelanggan

- data

- Data Analytics

- ilmu data

- berbagi data

- Basis Data

- database

- kumpulan data

- Memutuskan

- Default

- Permintaan

- menyebarkan

- menggambarkan

- dijelaskan

- Mendesain

- Desktop

- Meskipun

- terperinci

- ditentukan

- dialog

- berbeda

- menampilkan

- distribusi

- Dont

- Download

- download

- pengemudi

- driver

- selama

- setiap

- Terdahulu

- mudah digunakan

- editor

- usaha

- tertanam

- aktif

- memungkinkan

- memungkinkan

- terenkripsi

- enkripsi

- ujung ke ujung

- Titik akhir

- energi

- Enter

- masuk

- Lingkungan Hidup

- Eter (ETH)

- mengevaluasi

- contoh

- Laksanakan

- ada

- menyelidiki

- luar

- tambahan

- ekstrak

- Ekstrak

- akrab

- FAST

- lebih cepat

- beberapa

- bidang

- File

- File

- terakhir

- Akhirnya

- keuangan

- teknologi keuangan

- Menemukan

- firewall

- Pertama

- keluwesan

- Fokus

- terfokus

- mengikuti

- berikut

- berikut

- format

- Gratis

- dari

- penuh

- fungsi

- Selanjutnya

- masa depan

- menghasilkan

- dihasilkan

- menghasilkan

- geografi

- mendapatkan

- Aksi

- Google Cloud

- Hijau

- menangani

- Perangkat keras

- membantu

- membantu

- membantu

- membantu

- di sini

- High

- highlight

- sangat

- memegang

- Beranda

- tuan rumah

- JAM

- Rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- HTTPS

- ICON

- mengenali

- identitas

- melaksanakan

- in

- Meningkatkan

- menunjukkan

- sendiri-sendiri

- informasi

- memasukkan

- wawasan

- install

- Instalasi

- contoh

- instruksi

- integral

- Terintegrasi

- berinteraksi

- mengganggu

- intervensi

- isu

- IT

- item

- Pekerjaan

- Jobs

- json

- kunci

- Jenis

- besar

- besar-besaran

- Terbaru

- jalankan

- meluncurkan

- lapisan

- BELAJAR

- Lets

- Tingkat

- keterbatasan

- linux

- Daftar

- Daftar

- Listening

- memuat

- lokal

- tempat

- mesin

- terbuat

- Utama

- Mayoritas

- membuat

- MEMBUAT

- mengelola

- pengelolaan

- manajer

- pelaksana

- panduan

- manual

- banyak

- berarti

- medium

- Memenuhi

- menu

- metode

- Microsoft

- Microsoft Windows

- mungkin

- bermigrasi

- migrasi

- ML

- model

- modern

- memodernisasi

- Memantau

- lebih

- paling

- pindah

- msi

- beberapa

- nama

- nama

- penamaan

- Arahkan

- Navigasi

- Perlu

- New

- berikutnya

- penting

- jumlah

- obyek

- objek

- Penawaran

- ONE

- membuka

- operasi

- sistem operasi

- Optimize

- Lainnya

- jika tidak

- paket

- pane

- panel

- Paralel

- rekan

- Lulus

- bergairah

- Kata Sandi

- path

- Membayar

- Puncak

- melakukan

- prestasi

- melakukan

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- Titik

- mungkin

- Pos

- potensi

- praktek

- Bisa ditebak

- Prediksi

- prasyarat

- disajikan

- sebelumnya

- swasta

- Prosedur

- proses

- Produksi

- program

- Kemajuan

- proyek

- memprojeksikan

- memberikan

- menyediakan

- menempatkan

- pertanyaan

- segera

- jarak

- menyadari

- sarankan

- rekomendasi

- direkomendasikan

- catatan

- Merah

- mengurangi

- tercermin

- wilayah

- daftar

- terkait

- Pers

- sisa

- ulangi

- menggantikan

- diganti

- direplikasi

- melaporkan

- laporan

- merupakan

- permintaan

- membutuhkan

- wajib

- tabah

- Sumber

- bermanfaat

- Kaya

- Klik kanan

- Peran

- peran

- BARIS

- aturan

- Run

- sama

- terukur

- Skala

- sisik

- skala

- pemindaian

- Ilmu

- ilmuwan

- script

- mulus

- detik

- Bagian

- sektor

- aman

- keamanan

- memilih

- peka

- Tanpa Server

- layanan

- Layanan

- set

- set

- pengaturan

- pengaturan

- beberapa

- berbagi

- berbagi

- harus

- Menunjukkan

- Pertunjukkan

- menandatangani

- Sederhana

- tunggal

- Ukuran

- Potret

- So

- larutan

- Solusi

- beberapa

- sumber

- spesialis

- kecepatan

- Pengeluaran

- membagi

- Olahraga

- SSL

- pementasan

- awal

- Mulai

- dimulai

- Laporan

- statistik

- statistika

- Status

- Langkah

- Tangga

- berhenti

- penyimpanan

- menyimpan

- tersimpan

- toko

- sukses

- berhasil

- seperti itu

- besar

- Beralih

- sistem

- tabel

- Mengambil

- Dibutuhkan

- target

- tugas

- Teknis

- Teknologi

- terminal

- Grafik

- Sumber

- mereka

- pihak ketiga

- tiga

- waktu

- kali

- untuk

- toleransi

- alat

- alat

- tradisional

- Pelatihan VE

- Mengubah

- benar

- Kepercayaan

- bawah

- pokok

- memahami

- unik

- penggunaan

- menggunakan

- Pengguna

- Pengguna

- MENGESAHKAN

- divalidasi

- Berharga

- nilai

- Nilai - Nilai

- penjaja

- vendor

- memeriksa

- versi

- View

- 'view'

- maya

- walkthrough

- peringatan

- jaringan

- Apa

- yang

- sementara

- lebih luas

- akan

- Windows

- dalam

- tanpa

- Kelompok Kerja

- kerja

- bekerja

- workstation

- akan

- menulis

- tertulis

- Anda

- zephyrnet.dll