Makalah teknis baru berjudul “Pencarian Arsitektur Neural yang Dioptimalkan Perangkat Keras Hyperscale” diterbitkan oleh para peneliti di Google, Apple, dan Waymo.

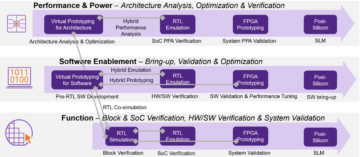

“Makalah ini memperkenalkan Pencarian Arsitektur Neural yang Dioptimalkan Perangkat Keras Hyperscale (H2O-NAS) untuk secara otomatis merancang model pembelajaran mesin yang akurat dan berperforma tinggi yang disesuaikan dengan arsitektur perangkat keras yang mendasarinya. H2O-NAS terdiri dari tiga komponen utama: algoritma pencarian “one-shot” paralel masif baru dengan pembagian bobot yang cerdas, yang dapat menskalakan ke ruang pencarian. O(10280) dan menangani lalu lintas produksi dalam jumlah besar; ruang pencarian yang dioptimalkan untuk perangkat keras untuk beragam model ML pada perangkat keras yang heterogen; dan model kinerja hibrida dua fase yang baru serta fungsi penghargaan multi-tujuan yang dioptimalkan untuk penerapan skala besar,” tulis makalah tersebut.

Cari makalah teknis di sini. Diterbitkan Maret 2023.

Sheng Li, Garrett Andersen, Tao Chen, Liqun Cheng, Julian Grady, Da Huang, Quoc V. Le, Andrew Li, Xin Li, Yang Li, Chen Liang, Yifeng Lu, Yun Ni, Ruoming Pang, Mingxing Tan, Martin Wicke, Gang Wu, Shengqi Zhu, Parthasarathy Ranganathan, dan Norman P. Jouppi. 2023. Pencarian Arsitektur Neural yang Dioptimalkan Perangkat Keras Hyperscale. Dalam Prosiding Konferensi Internasional ACM ke-28 tentang Dukungan Arsitektur untuk Bahasa Pemrograman dan Sistem Operasi, Volume 3 (ASPLOS 2023). Asosiasi Mesin Komputasi, New York, NY, AS, 343–358. https://doi.org/10.1145/3582016.3582049

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- Platoblockchain. Intelijen Metaverse Web3. Pengetahuan Diperkuat. Akses Di Sini.

- Mencetak Masa Depan bersama Adryenn Ashley. Akses Di Sini.

- Sumber: https://semiengineering.com/hyperscale-hw-optimized-neural-architecture-search-google/

- ][P

- 2023

- a

- tepat

- ACM

- algoritma

- dan

- Andersen

- Andrew

- Apple

- arsitektur

- arsitektur

- Asosiasi

- At

- secara otomatis

- by

- CAN

- chen

- Cheng

- komponen

- komputasi

- Konferensi

- DA

- penyebaran

- Mendesain

- beberapa

- Pertama

- Untuk

- fungsi

- Gang

- menangani

- Perangkat keras

- HTTPS

- Hibrida

- in

- Cerdas

- Internasional

- Memperkenalkan

- kunci

- Bahasa

- besar

- pengetahuan

- mesin

- Mesin belajar

- mesin-mesin

- March

- Martin

- secara besar-besaran

- ML

- model

- model

- saraf

- New

- NY

- novel

- NY

- of

- on

- operasi

- sistem operasi

- dioptimalkan

- kertas

- Paralel

- prestasi

- plato

- Kecerdasan Data Plato

- Data Plato

- Prosiding

- Produksi

- Pemrograman

- bahasa pemrograman

- diterbitkan

- peneliti

- Pahala

- Skala

- Pencarian

- berbagi

- spasi

- Negara

- mendukung

- sistem

- disesuaikan

- Teknis

- Grafik

- tiga

- berjudul

- untuk

- lalu lintas

- pokok

- Amerika Serikat

- volume

- volume

- adalah

- waymo

- berat

- yang

- dengan

- wu

- zephyrnet.dll