Analisis Data Otomatis (ADA) di AWS adalah solusi AWS yang memungkinkan Anda memperoleh wawasan bermakna dari data dalam hitungan menit melalui antarmuka pengguna yang sederhana dan intuitif. ADA menawarkan platform analisis data asli AWS yang siap digunakan langsung oleh analis data untuk berbagai kasus penggunaan. Dengan ADA, tim dapat menyerap, mengubah, mengatur, dan menanyakan beragam kumpulan data dari berbagai sumber data tanpa memerlukan keahlian teknis khusus. ADA menyediakan satu set konektor yang sudah dibuat sebelumnya untuk menyerap data dari berbagai sumber termasuk Layanan Penyimpanan Sederhana Amazon (Amazon S3), Aliran Data Amazon Kinesis, amazoncloudwatch, Amazon CloudTrail, dan Amazon DynamoDB serta banyak lainnya.

ADA menyediakan platform dasar yang dapat digunakan oleh analis data dalam beragam kasus penggunaan termasuk TI, keuangan, pemasaran, penjualan, dan keamanan. Konektor data CloudWatch ADA yang siap pakai memungkinkan penyerapan data dari log CloudWatch di akun AWS yang sama di mana ADA telah diterapkan, atau dari akun AWS yang berbeda.

Dalam postingan ini, kami mendemonstrasikan bagaimana pengembang aplikasi atau penguji aplikasi dapat menggunakan ADA untuk memperoleh wawasan operasional aplikasi yang berjalan di AWS. Kami juga menunjukkan bagaimana Anda dapat menggunakan solusi ADA untuk terhubung ke berbagai sumber data di AWS. Kami dulu menerapkan solusi ADA ke akun AWS dan menyiapkan solusi ADA dengan menciptakan produk data menggunakan konektor data. Kami kemudian menggunakan ADA Query Workbench untuk menggabungkan kumpulan data terpisah dan mengkueri data yang berkorelasi, menggunakan Structured Query Language (SQL) yang sudah dikenal, untuk mendapatkan wawasan. Kami juga menunjukkan bagaimana ADA dapat diintegrasikan dengan alat intelijen bisnis (BI) seperti Tableau untuk memvisualisasikan data dan membuat laporan.

Ikhtisar solusi

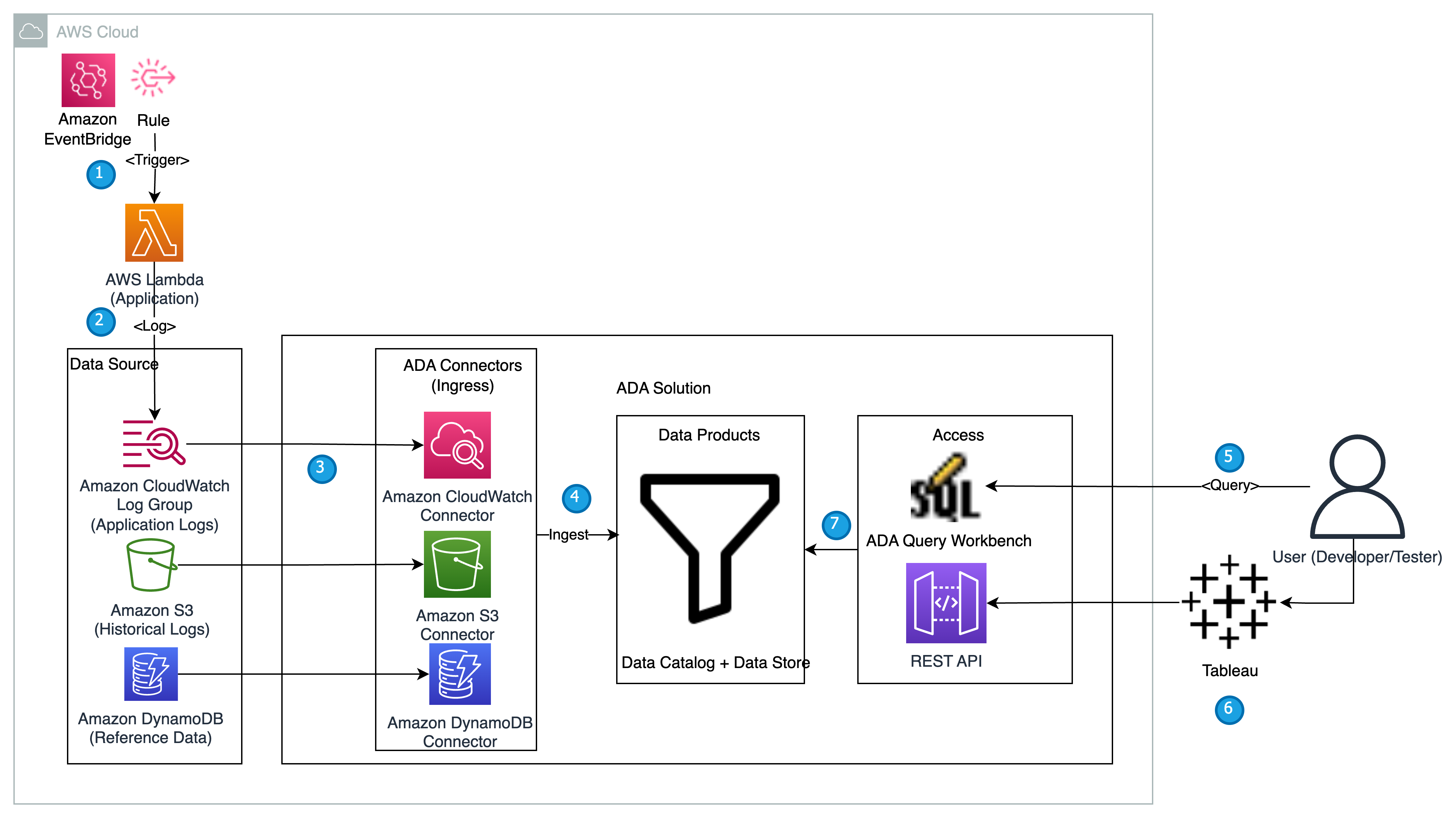

Di bagian ini, kami menyajikan arsitektur solusi untuk demo dan menjelaskan alur kerjanya. Untuk tujuan demonstrasi, aplikasi yang dipesan lebih dahulu disimulasikan menggunakan AWS Lambda fungsi yang mengeluarkan log masuk Format Log Apache pada interval yang telah ditentukan menggunakan Jembatan Acara Amazon. Format standar ini dapat dihasilkan oleh banyak server web berbeda dan dibaca oleh banyak program analisis log. Log aplikasi (fungsi Lambda) dikirim ke grup log CloudWatch. Log aplikasi historis disimpan dalam bucket S3 untuk referensi dan untuk tujuan kueri. Tabel pencarian dengan daftar Kode status HTTP beserta deskripsinya disimpan dalam tabel DynamoDB. Ketiganya berfungsi sebagai sumber data yang dimasukkan ke dalam ADA untuk korelasi, kueri, dan analisis. Kami menerapkan solusi ADA ke akun AWS dan mengatur ADA. Kami kemudian membuat produk data dalam ADA untuk Grup log CloudWatch, Ember S3, dan DynamoDB. Saat produk data dikonfigurasi, ADA menyediakan saluran data untuk menyerap data dari sumber. Dengan ADA Query Workbench, Anda dapat mengkueri data yang diserap menggunakan SQL biasa untuk pemecahan masalah aplikasi atau diagnosis masalah.

Diagram berikut memberikan gambaran umum tentang arsitektur dan alur kerja penggunaan ADA untuk mendapatkan wawasan tentang log aplikasi.

Alur kerja meliputi langkah-langkah berikut:

- Fungsi Lambda dijadwalkan untuk dipicu pada interval 2 menit menggunakan EventBridge.

- Fungsi Lambda mengeluarkan log yang disimpan di grup log CloudWatch tertentu di bawah

/aws/lambda/CdkStack-AdaLogGenLambdaFunction. Log aplikasi dibuat menggunakan skema Apache Log Format tetapi disimpan di grup log CloudWatch dalam format JSON. - Produk data untuk CloudWatch, Amazon S3, dan DynamoDB dibuat di ADA. Produk data CloudWatch terhubung ke grup log CloudWatch tempat log aplikasi (fungsi Lambda) disimpan. Konektor Amazon S3 terhubung ke folder bucket S3 tempat log historis disimpan. Konektor DynamoDB menyambung ke tabel DynamoDB tempat kode status yang dirujuk oleh aplikasi dan log riwayat disimpan.

- Untuk setiap produk data, ADA menerapkan infrastruktur saluran data untuk menyerap data dari sumbernya. Ketika penyerapan data selesai, Anda dapat menulis kueri menggunakan SQL melalui ADA Query Workbench.

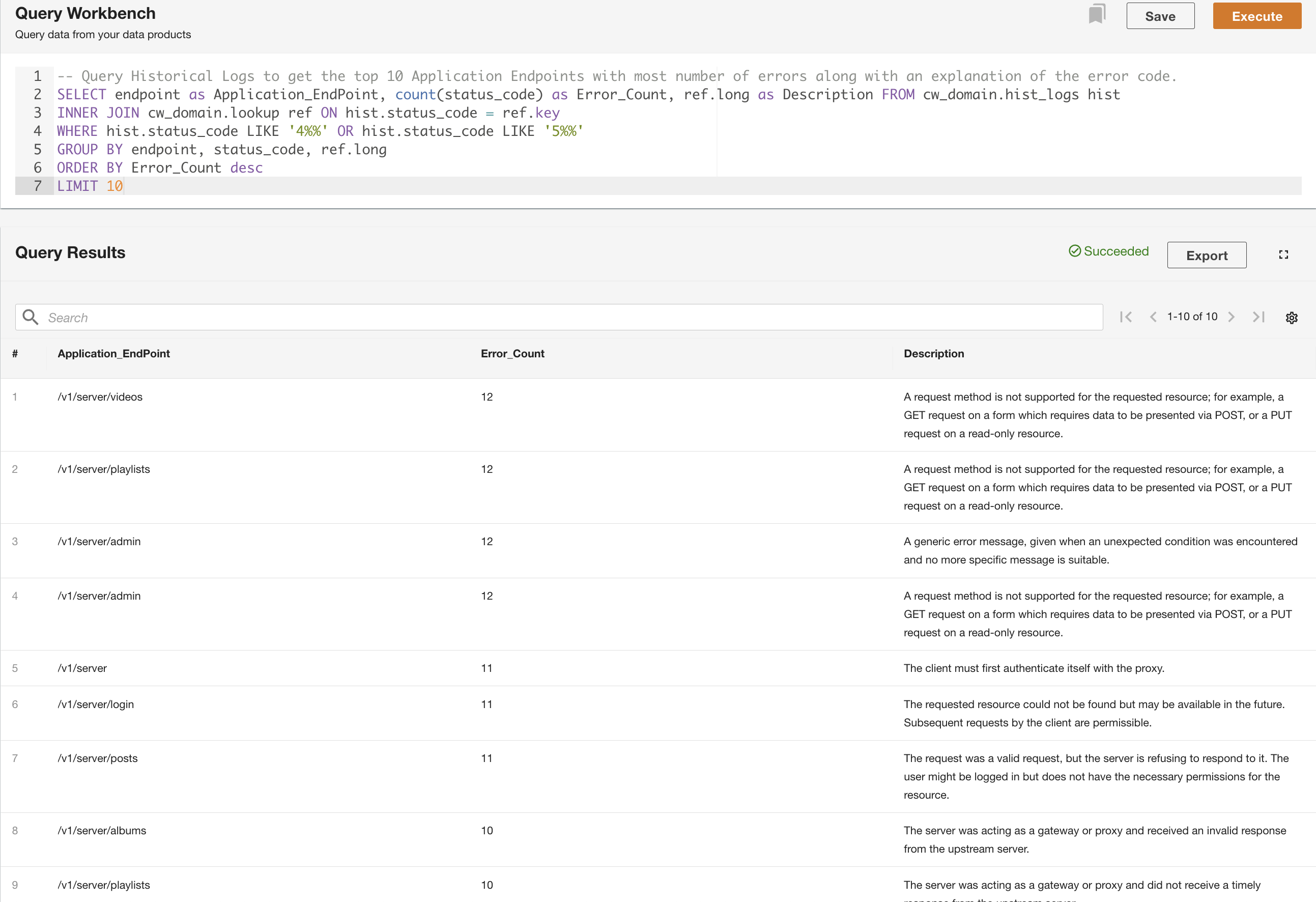

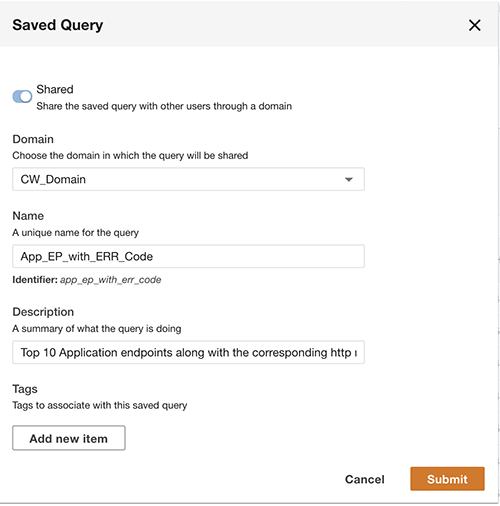

- Anda dapat masuk ke portal ADA dan menulis kueri SQL dari Query Workbench untuk mendapatkan wawasan ke dalam log aplikasi. Secara opsional, Anda dapat menyimpan kueri dan membagikan kueri tersebut dengan pengguna ADA lain di domain yang sama. Fitur kueri ADA didukung oleh Amazon Athena, yang merupakan layanan analitik interaktif tanpa server yang menyediakan cara yang disederhanakan dan fleksibel untuk menganalisis data berukuran petabyte.

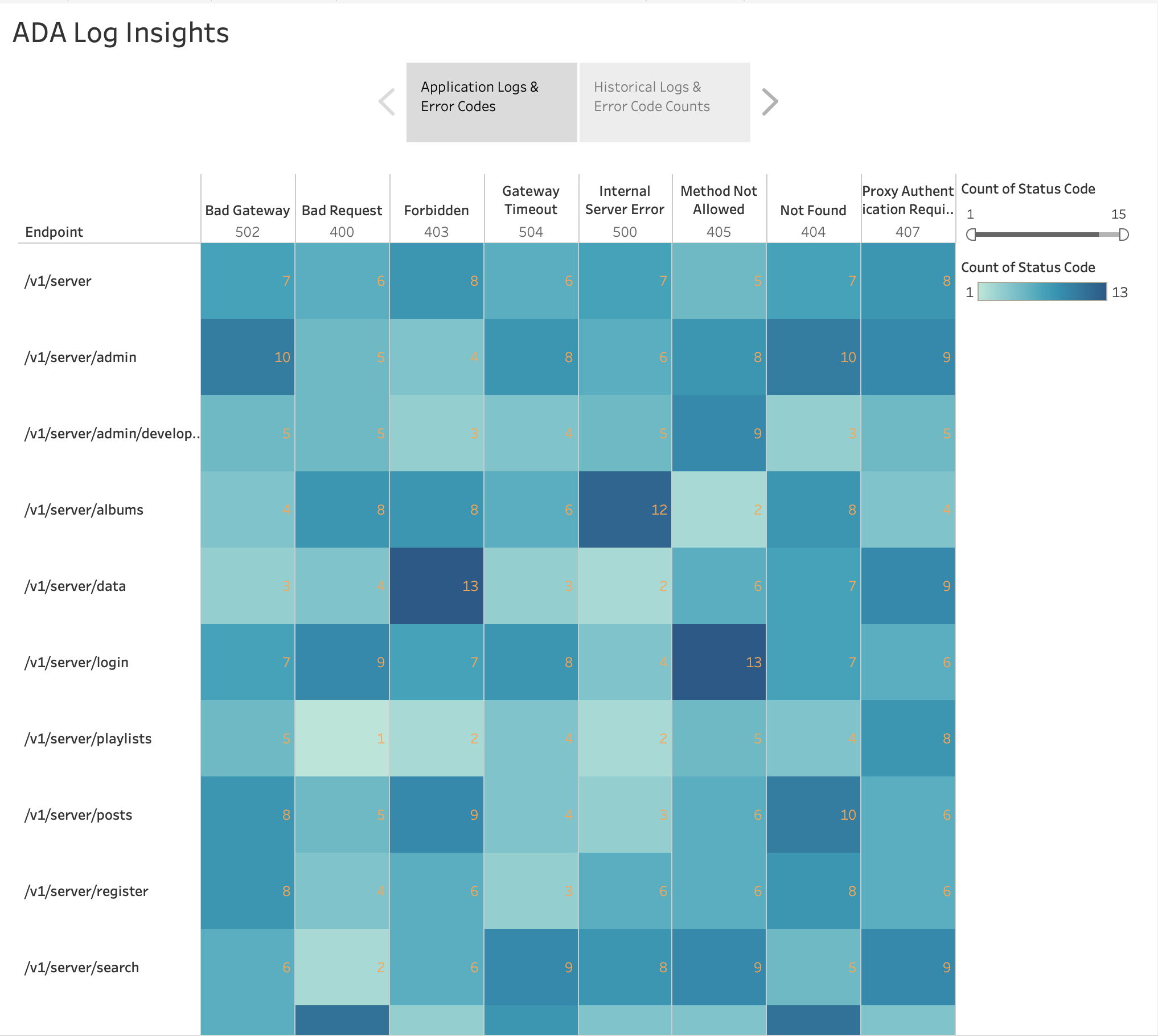

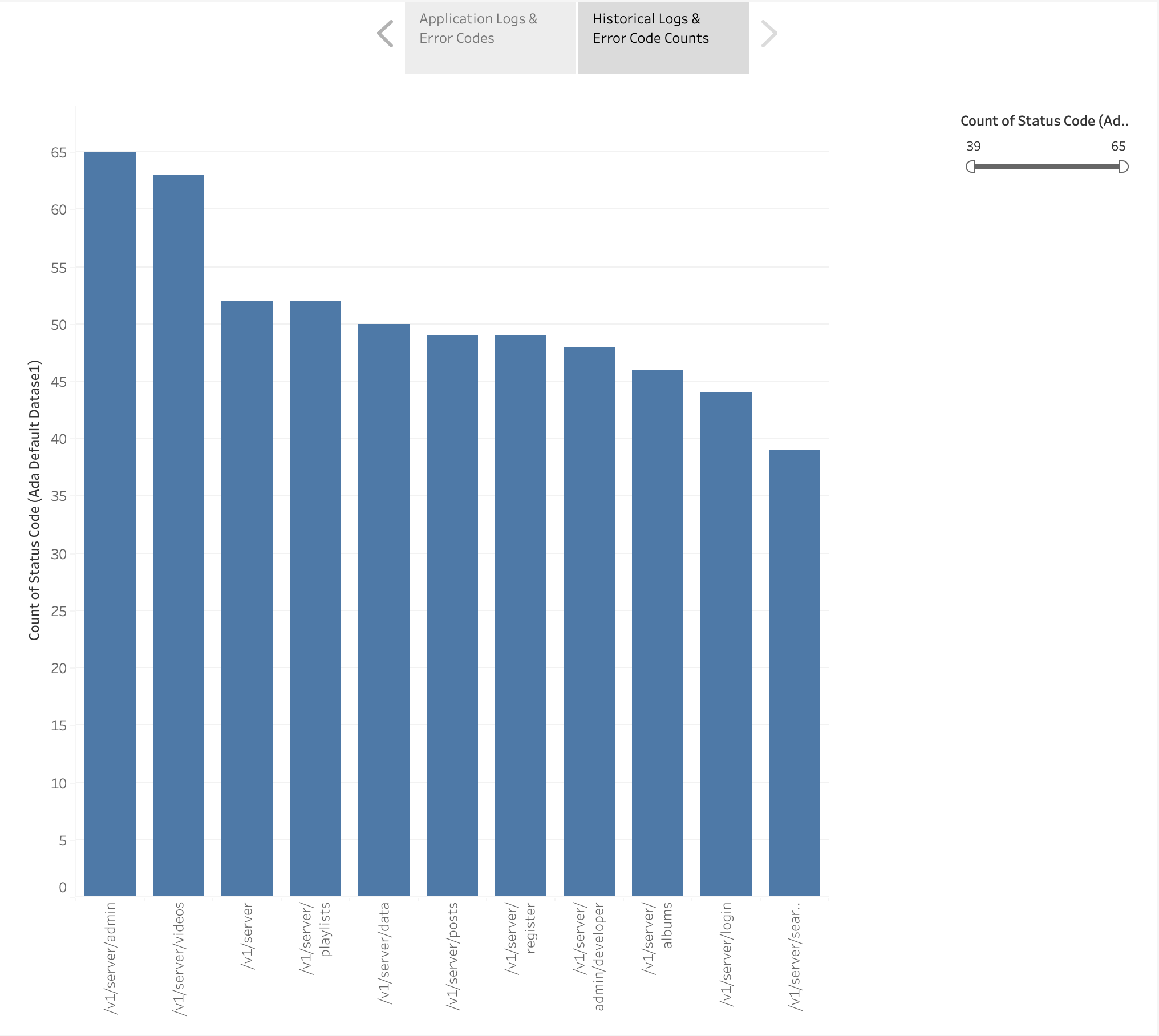

- Tableau dikonfigurasi untuk mengakses produk data ADA melalui titik akhir jalan keluar ADA. Anda kemudian membuat dasbor dengan dua grafik. Bagan pertama adalah peta panas yang menunjukkan prevalensi kode kesalahan HTTP yang berkorelasi dengan titik akhir API aplikasi. Bagan kedua adalah bagan batang yang memperlihatkan 10 API aplikasi teratas dengan jumlah total kode kesalahan HTTP dari data historis.

Prasyarat

Untuk posting ini, Anda harus melengkapi prasyarat berikut:

- Instal Antarmuka Baris Perintah AWS (AWS CLI), Kit Pengembangan AWS Cloud (AWSCDK) prasyarat, khusus TypeScript prasyarat, dan git.

- Menyebarkan solusi ADA di akun AWS Anda di

us-east-1Wilayah.- Berikan email admin saat meluncurkan ADA Formasi AWS Cloud tumpukan. Ini diperlukan ADA untuk mengirimkan kata sandi pengguna root. Nomor telepon admin diperlukan untuk menerima pesan kata sandi satu kali jika autentikasi multifaktor (MFA) diaktifkan. Untuk demo ini, MFA tidak diaktifkan.

- Bangun dan terapkan aplikasi sampel (tersedia di GitHub repo) solusi agar sumber daya berikut dapat disediakan di akun Anda di

us-east-1Wilayah:- Fungsi Lambda yang menyimulasikan aplikasi pembuatan log dan aturan EventBridge yang memanggil fungsi aplikasi dengan interval 2 menit.

- Bucket S3 dengan kebijakan bucket yang relevan dan file CSV yang berisi log aplikasi historis.

- Tabel DynamoDB dengan data pencarian.

- Relevan Identitas AWS dan Manajemen Akses (IAM) peran dan izin yang diperlukan untuk layanan.

- Secara opsional, instal Desktop Tableau, penyedia BI pihak ketiga. Untuk postingan kali ini kami menggunakan Tableau Desktop versi 2021.2. Ada biaya yang harus dikeluarkan untuk menggunakan versi berlisensi dari aplikasi Tableau Desktop. Untuk rincian tambahan, lihat Lisensi tablo informasi.

Terapkan dan siapkan ADA

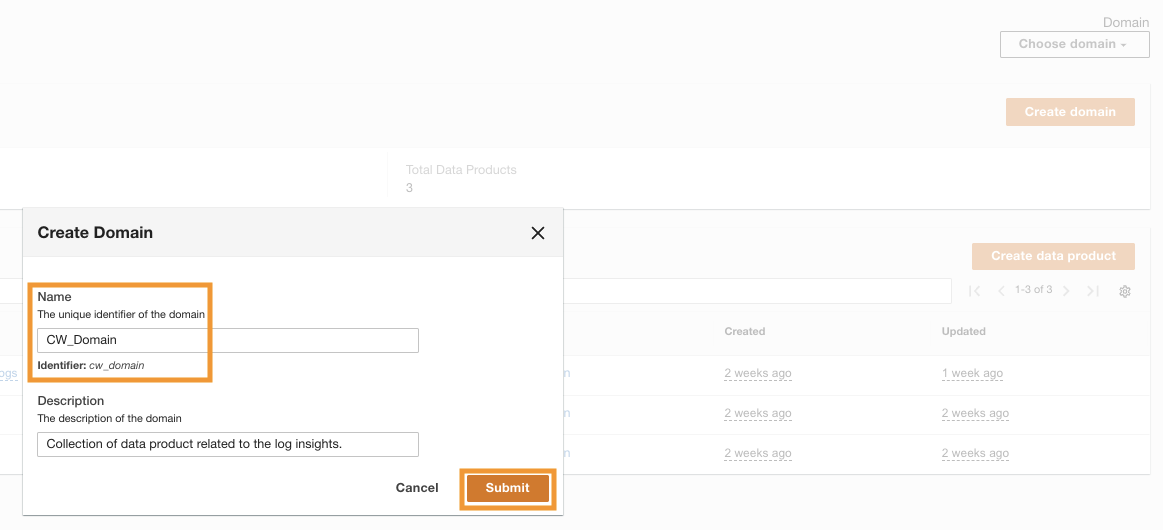

Setelah ADA berhasil diterapkan, Anda bisa masuk menggunakan email admin yang disediakan saat instalasi. Anda kemudian membuat domain bernama CW_Domain. Domain adalah kumpulan produk data yang ditentukan pengguna. Misalnya, domain mungkin berupa tim atau proyek. Domain menyediakan cara terstruktur bagi pengguna untuk mengatur produk data mereka dan mengelola izin akses.

- Di konsol ADA, pilih Domain di panel navigasi.

- Pilih Buat domain.

- Masukkan nama (

CW_Domain) dan deskripsi, lalu pilih Kirim.

Siapkan infrastruktur aplikasi sampel menggunakan AWS CDK

Solusi AWS CDK yang menerapkan aplikasi demo dihosting GitHub. Langkah-langkah untuk mengkloning repo dan menyiapkan proyek AWS CDK dirinci di bagian ini. Sebelum Anda menjalankan perintah ini, pastikan untuk melakukannya mengkonfigurasi kredensial AWS Anda. Buat folder, buka terminal, dan navigasikan ke folder tempat solusi AWS CDK perlu diinstal. Jalankan kode berikut:

Langkah-langkah ini melakukan tindakan berikut:

- Instal dependensi perpustakaan

- Bangun proyek

- Hasilkan templat CloudFormation yang valid

- Terapkan tumpukan menggunakan AWS CloudFormation di akun AWS Anda

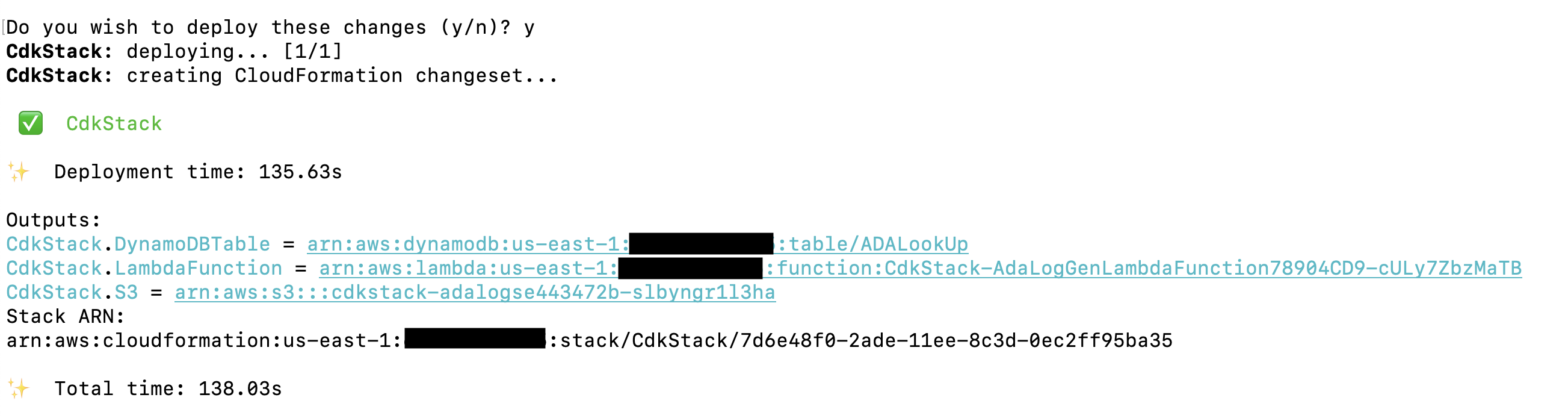

Penerapan ini memerlukan waktu sekitar 1–2 menit dan membuat tabel pencarian DynamoDB, fungsi Lambda, dan bucket S3 yang berisi file log historis sebagai output. Salin nilai-nilai ini ke aplikasi pengeditan teks, seperti Notepad.

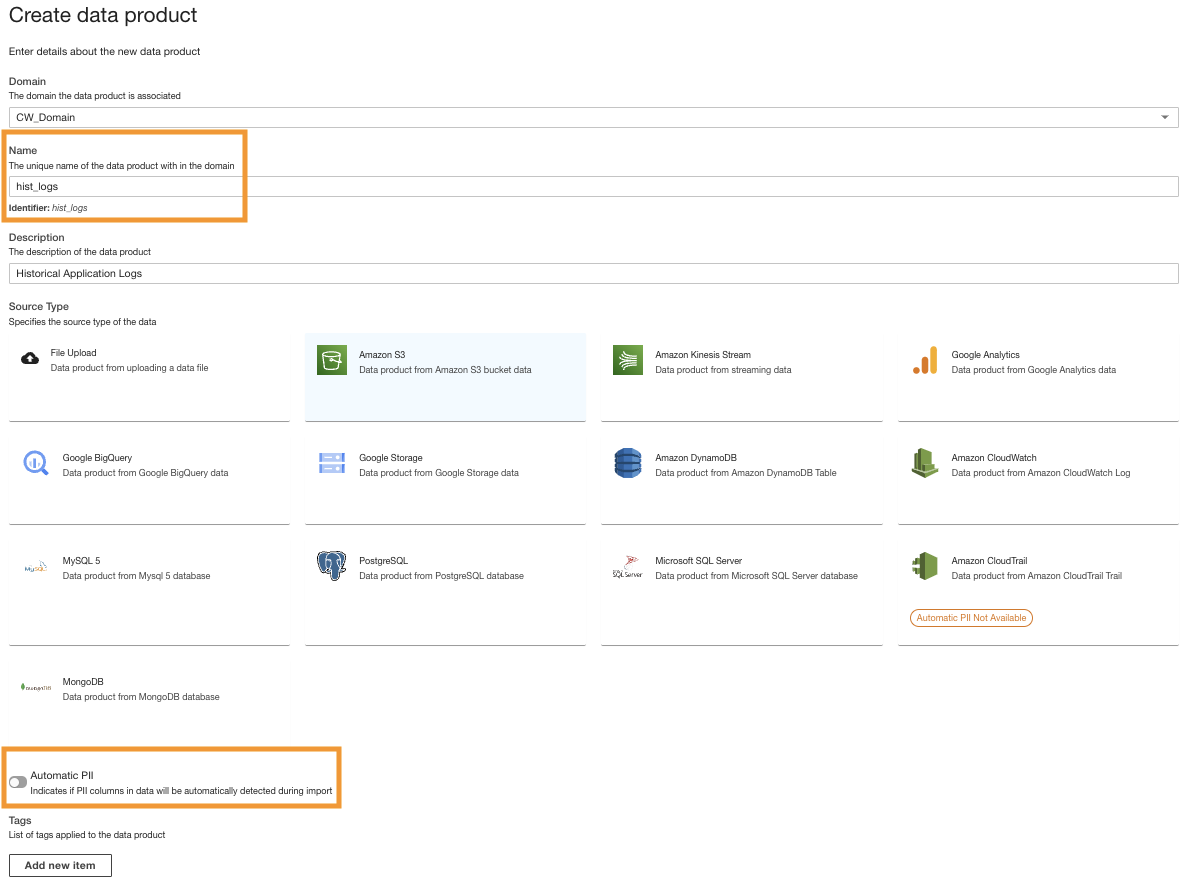

Buat produk data ADA

Kami membuat tiga produk data berbeda untuk demo ini, satu untuk setiap sumber data yang akan Anda kueri untuk mendapatkan wawasan operasional. Produk data adalah kumpulan data (kumpulan data seperti tabel atau file CSV) yang telah berhasil diimpor ke ADA dan dapat dikueri.

Buat produk data CloudWatch

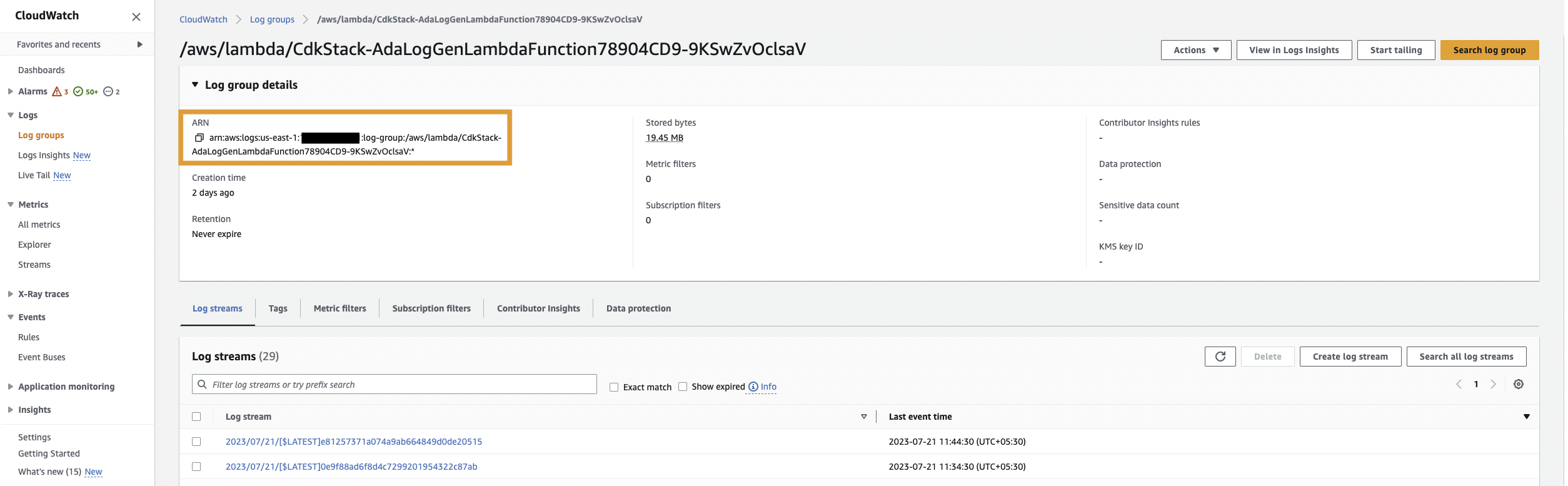

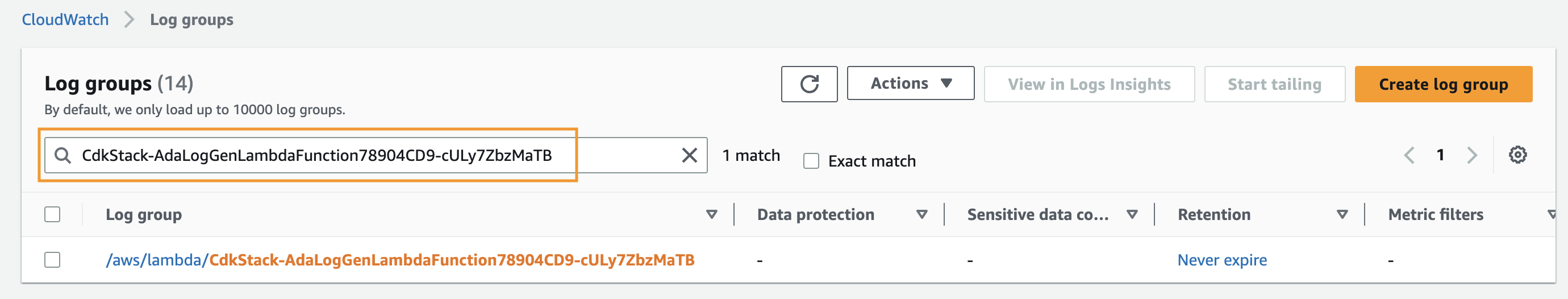

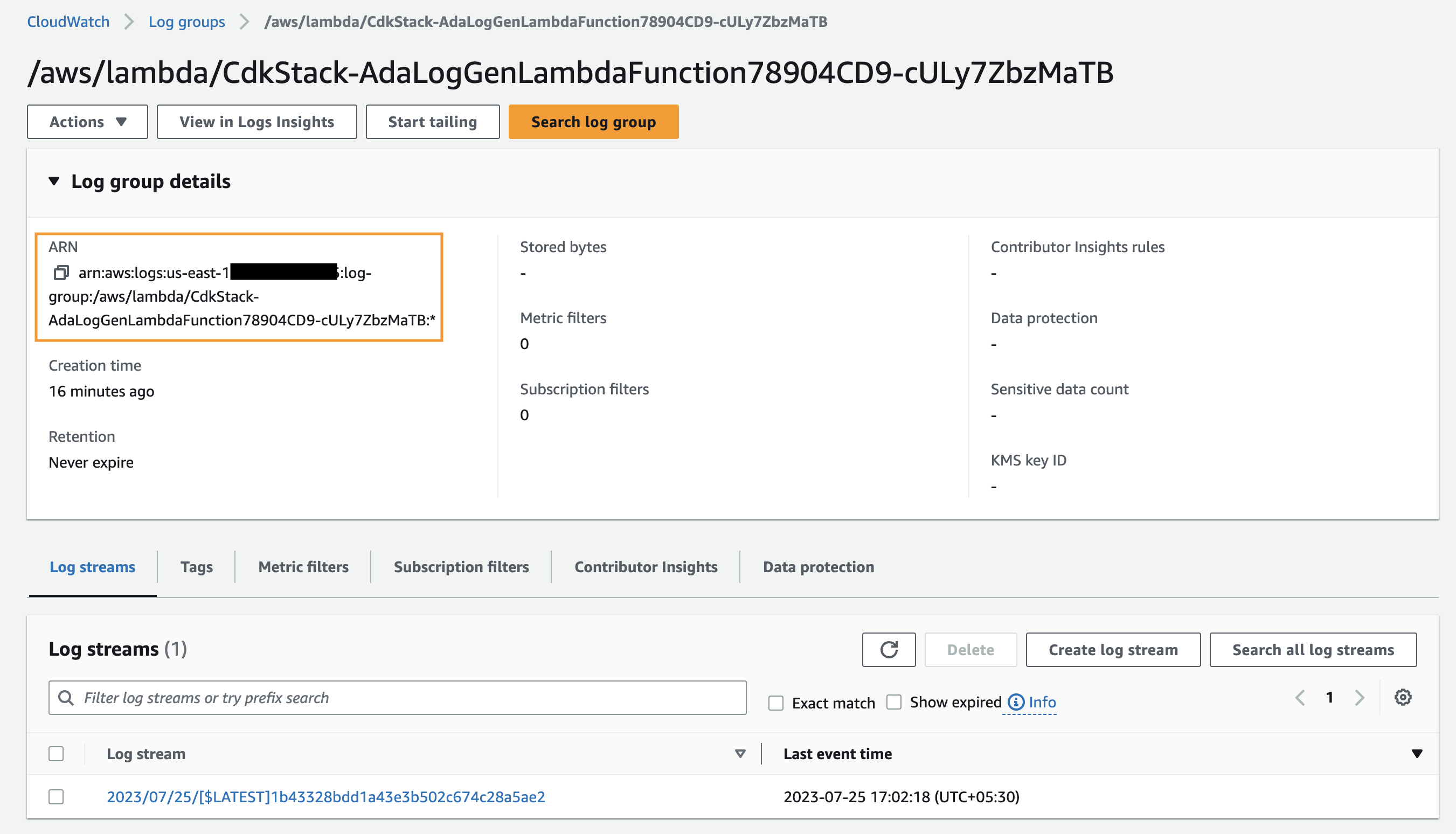

Pertama, kami membuat produk data untuk log aplikasi dengan menyiapkan ADA untuk menyerap grup log CloudWatch untuk aplikasi sampel (fungsi Lambda). Menggunakan CdkStack.LambdaFunction output untuk mendapatkan ARN fungsi Lambda dan menemukan ARN grup log CloudWatch yang sesuai di konsol CloudWatch.

Kemudian selesaikan langkah-langkah berikut:

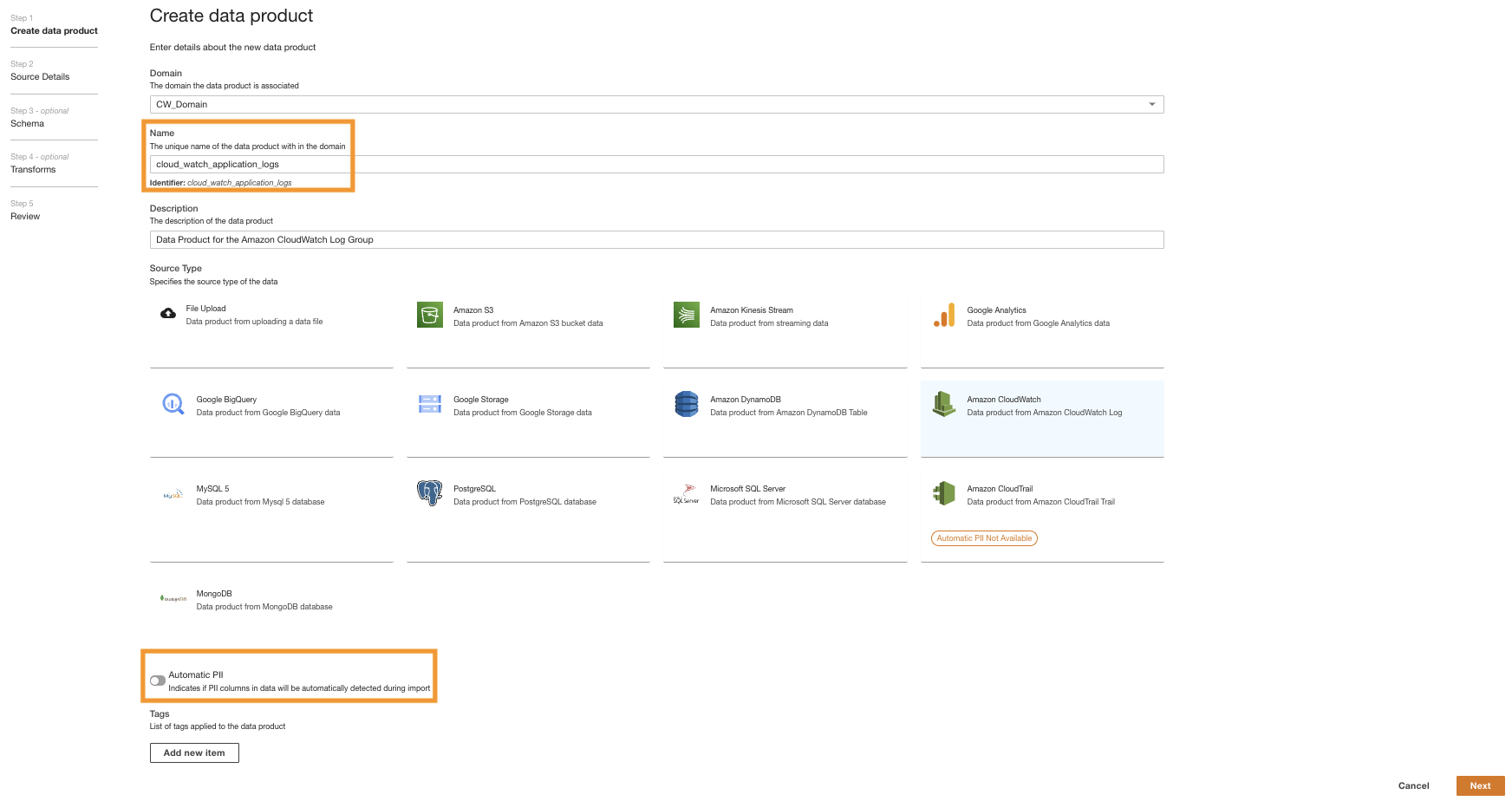

- Di konsol ADA, navigasikan ke domain ADA dan buat produk data CloudWatch.

- Untuk Nama¸ masukkan nama.

- Untuk Jenis sumber, pilih amazoncloudwatch.

- Disable PII otomatis.

ADA memiliki fitur yang secara otomatis mendeteksi data informasi pengenal pribadi (PII) selama impor yang diaktifkan secara default. Untuk demo ini, kami menonaktifkan opsi ini untuk produk data karena penemuan data PII tidak termasuk dalam cakupan demo ini.

- Pilih Selanjutnya.

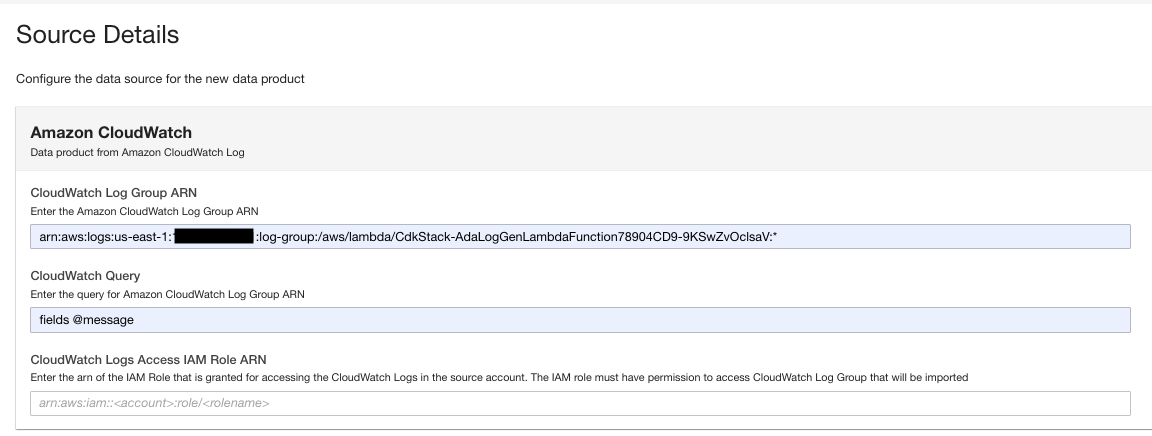

- Cari dan pilih ARN grup log CloudWatch yang disalin dari langkah sebelumnya.

- Salin ARN grup log.

- Pada halaman produk data, masukkan ARN grup log.

- Untuk Kueri CloudWatch, masukkan kueri yang Anda ingin ADA dapatkan dari grup log.

Dalam demo ini, kami menanyakan bidang @message karena kami tertarik untuk mendapatkan log aplikasi dari grup log.

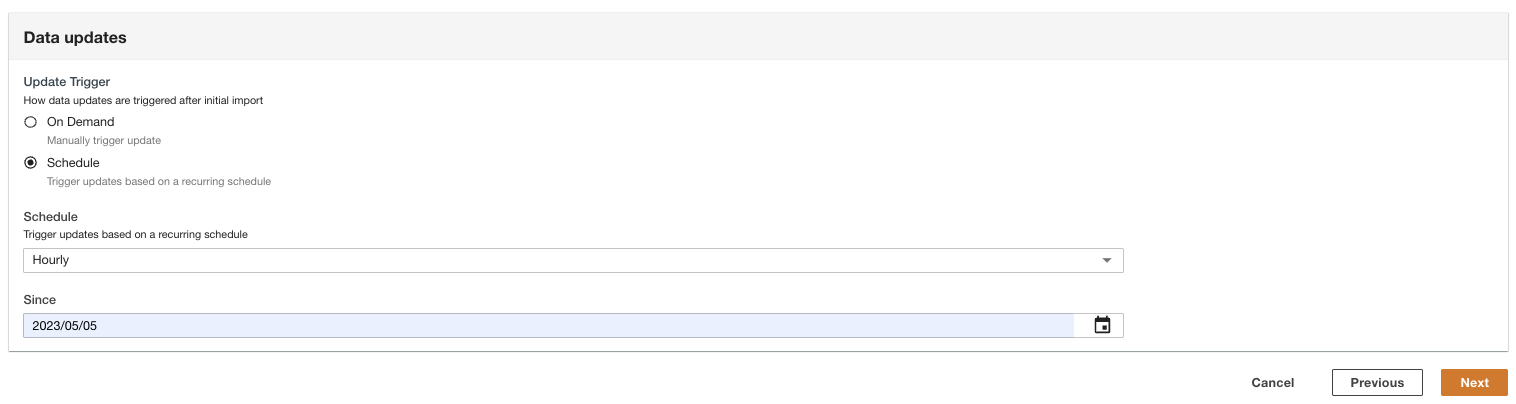

- Pilih bagaimana pembaruan data dipicu setelah impor awal.

ADA dapat dikonfigurasi untuk menyerap data dari sumber pada interval fleksibel (hingga 15 menit atau lebih) atau sesuai permintaan. Untuk demo, kami mengatur pembaruan data agar berjalan setiap jam.

- Pilih Selanjutnya.

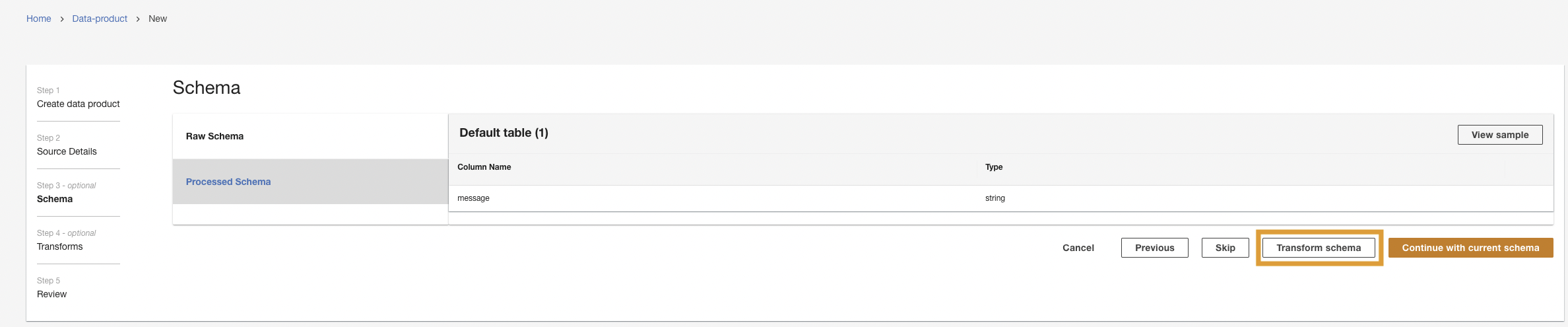

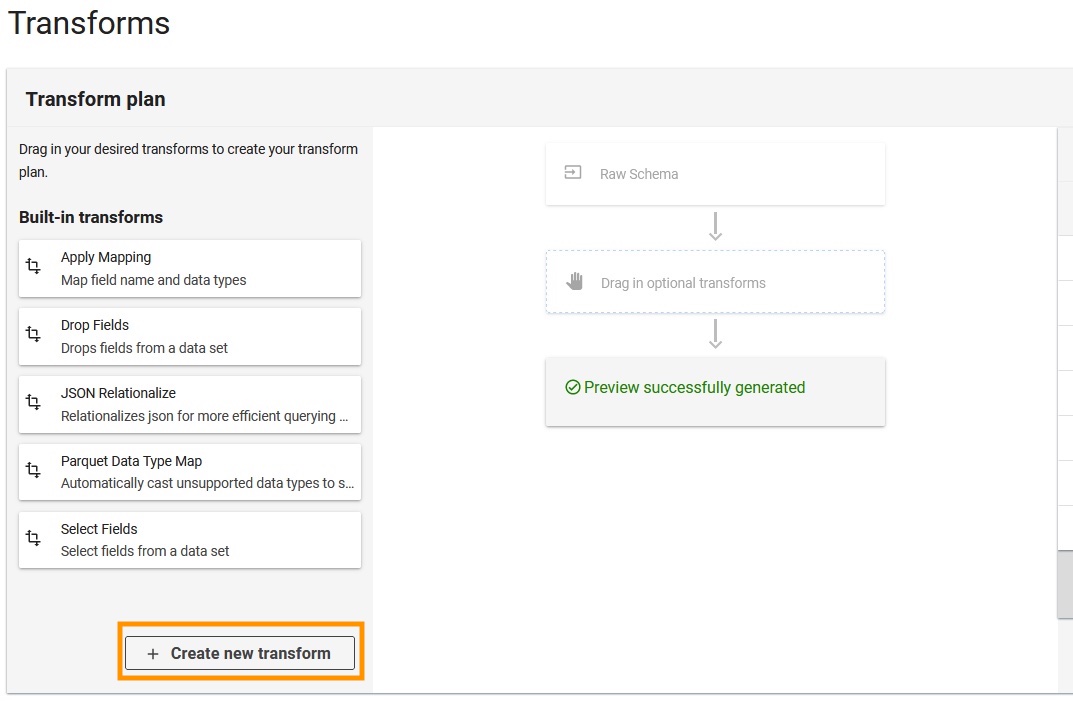

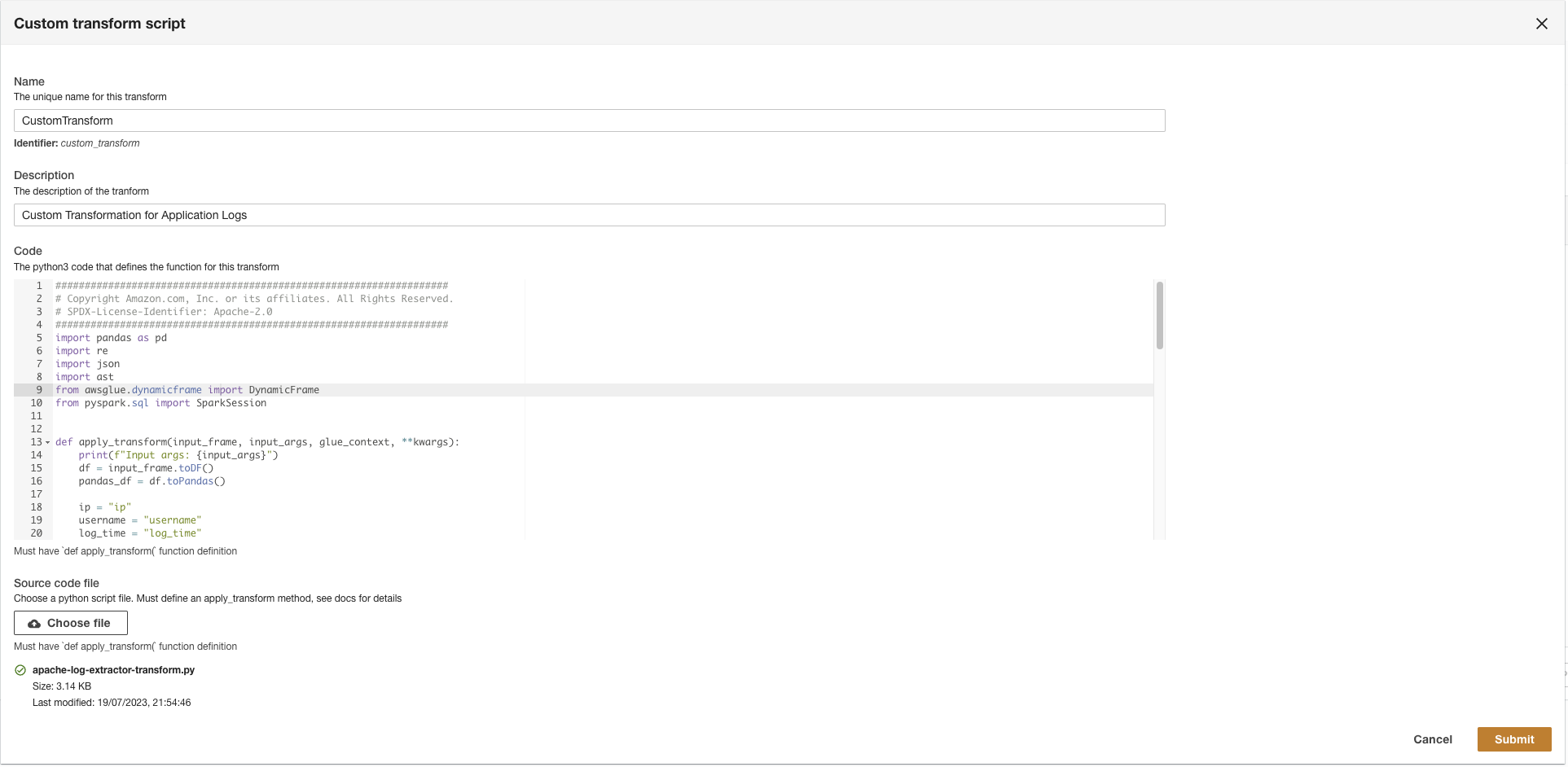

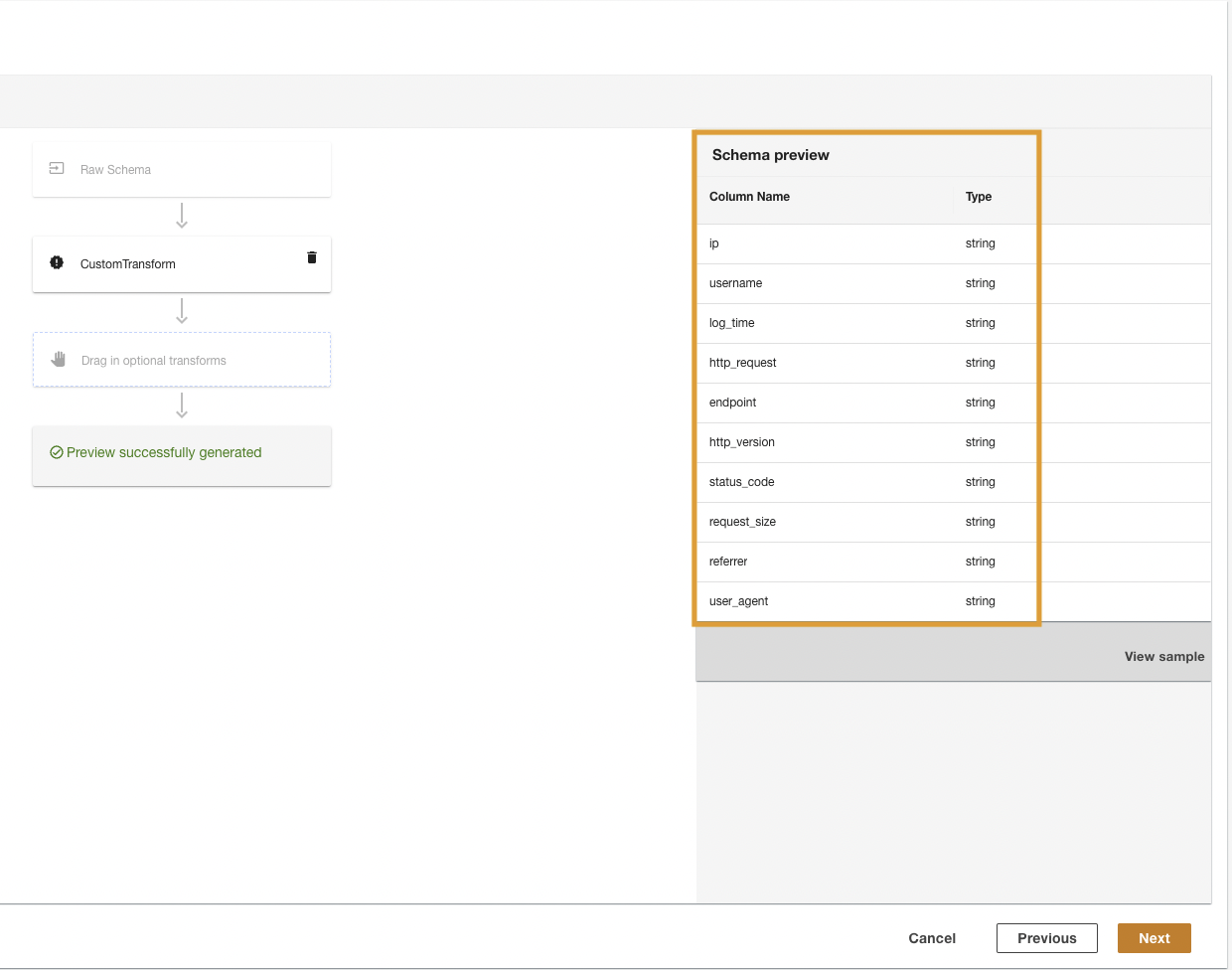

Selanjutnya, ADA akan terhubung ke grup log dan menanyakan skema. Karena log berada dalam Format Log Apache, kami mengubah log menjadi kolom terpisah sehingga kami dapat menjalankan kueri pada kolom log tertentu. ADA menyediakan empat kegagalan transformasi dan mendukung transformasi khusus melalui skrip Python. Dalam demo ini, kami menjalankan skrip Python khusus untuk mengubah bidang pesan JSON menjadi bidang Format Log Apache.

- Pilih Transformasi skema.

- Pilih Buat transformasi baru.

- Unggah

apache-log-extractor-transform.pynaskah dari/asset/transform_logs/folder. - Pilih Kirim.

ADA akan mengubah log CloudWatch menggunakan skrip dan menyajikan skema yang diproses.

- Pilih Selanjutnya.

- Pada langkah terakhir, tinjau langkah-langkahnya dan pilih Kirim.

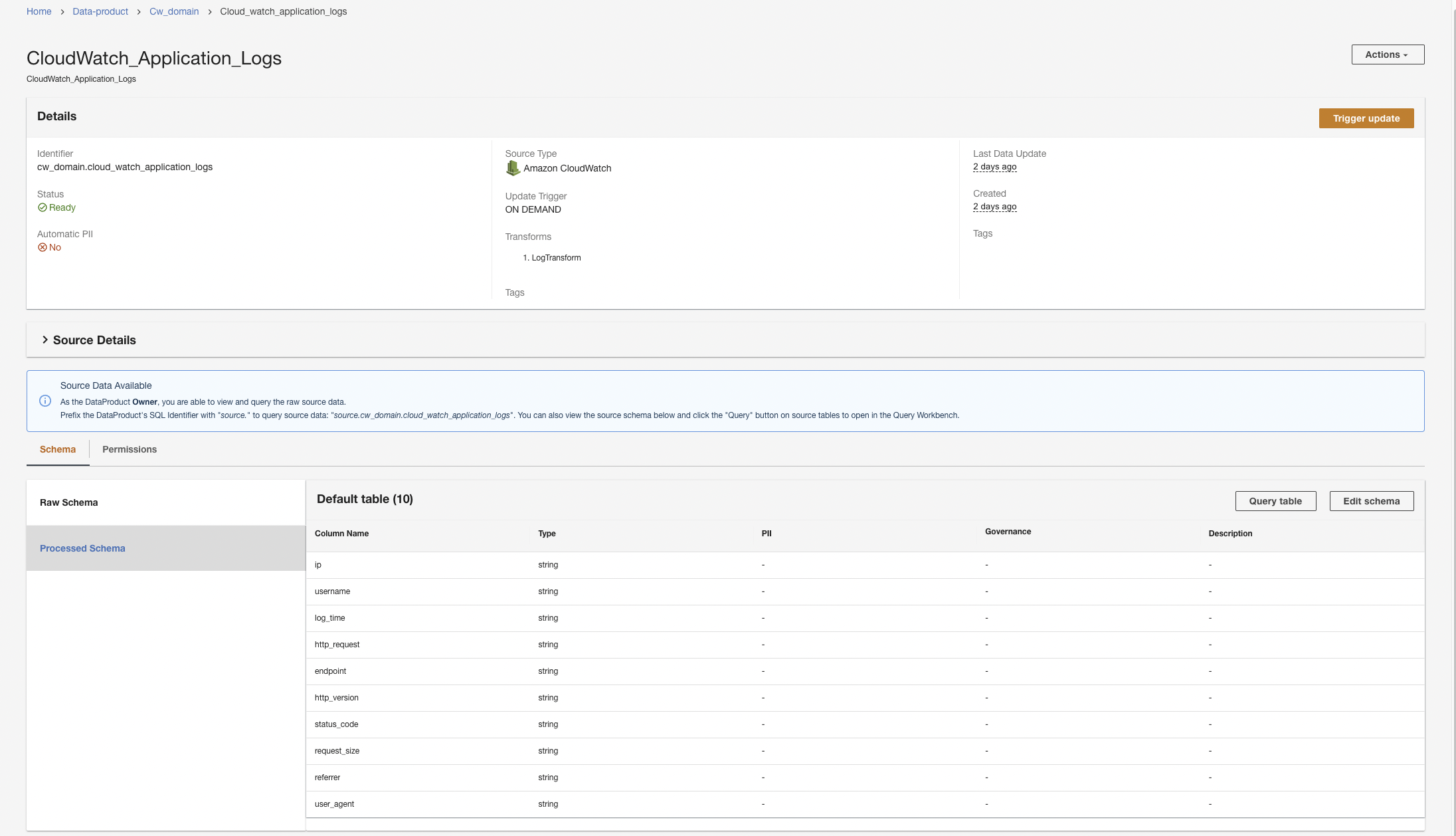

ADA akan memulai pemrosesan data, membuat saluran data, dan menyiapkan grup log CloudWatch untuk dikueri dari Query Workbench. Proses ini akan memakan waktu beberapa menit untuk diselesaikan dan akan ditampilkan di konsol ADA di bawah Produk Data.

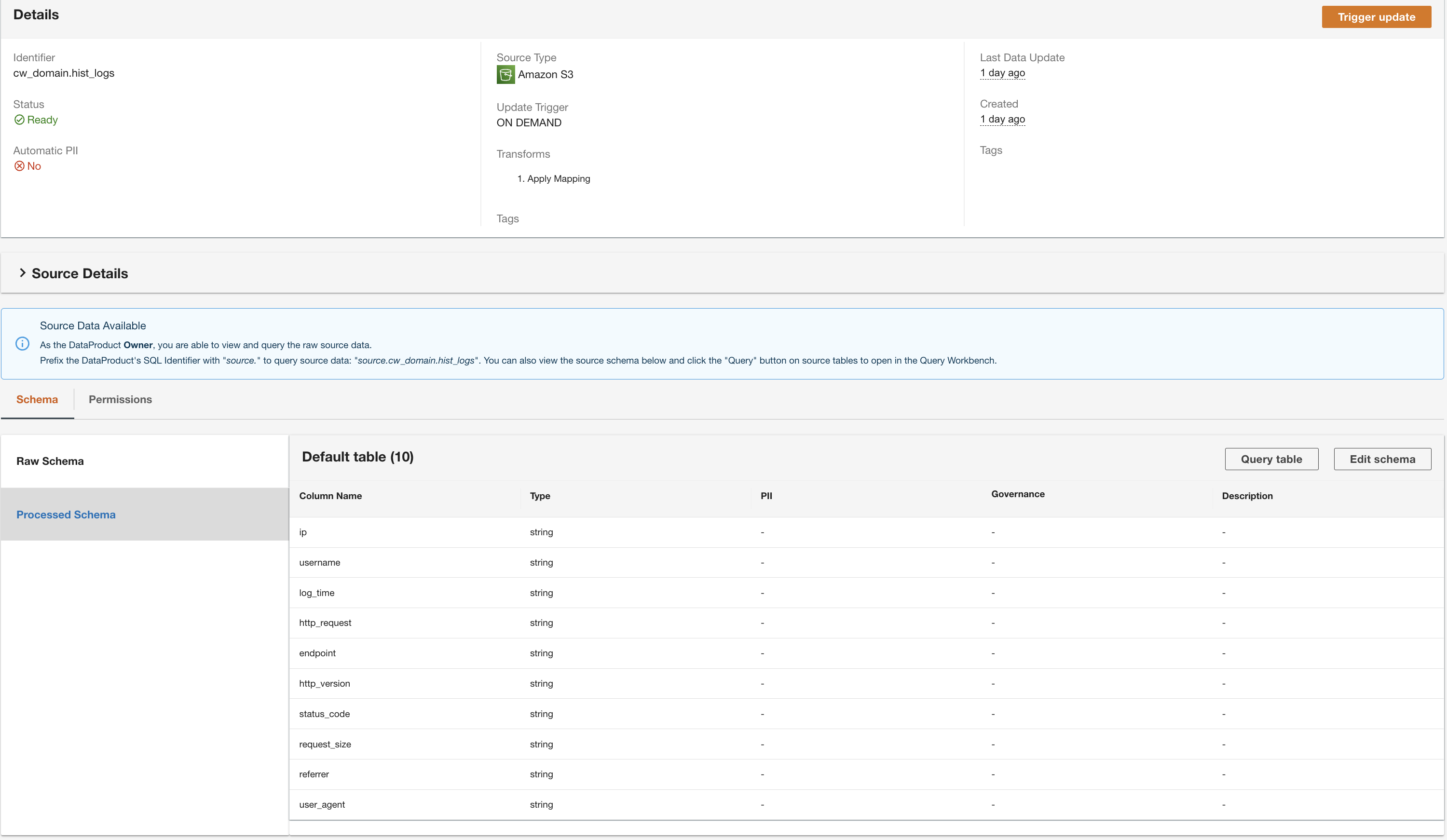

Buat produk data Amazon S3

Kami mengulangi langkah-langkah untuk menambahkan log historis dari sumber data Amazon S3 dan mencari data referensi dari tabel DynamoDB. Untuk kedua sumber data ini, kami tidak membuat transformasi kustom karena format datanya dalam CSV (untuk log historis) dan atribut kunci (untuk data pencarian referensi).

- Di konsol ADA, buat produk data baru.

- Masukkan nama (

hist_logs) dan pilih Amazon S3.

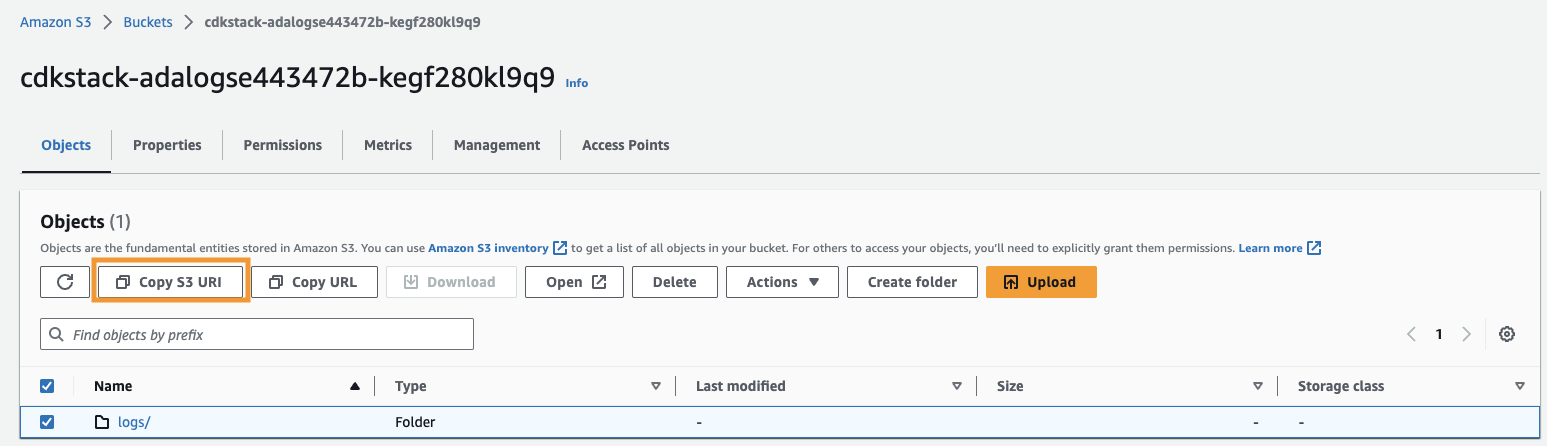

- Salin URI Amazon S3 (teks setelahnya

arn:aws:s3:::) DariCdkStack.S3variabel output dan navigasikan ke konsol Amazon S3. - Di kotak pencarian, masukkan teks yang disalin, buka bucket S3, pilih

/logsfolder, dan pilih Salin S3 URI.

Log sejarah disimpan di jalur ini.

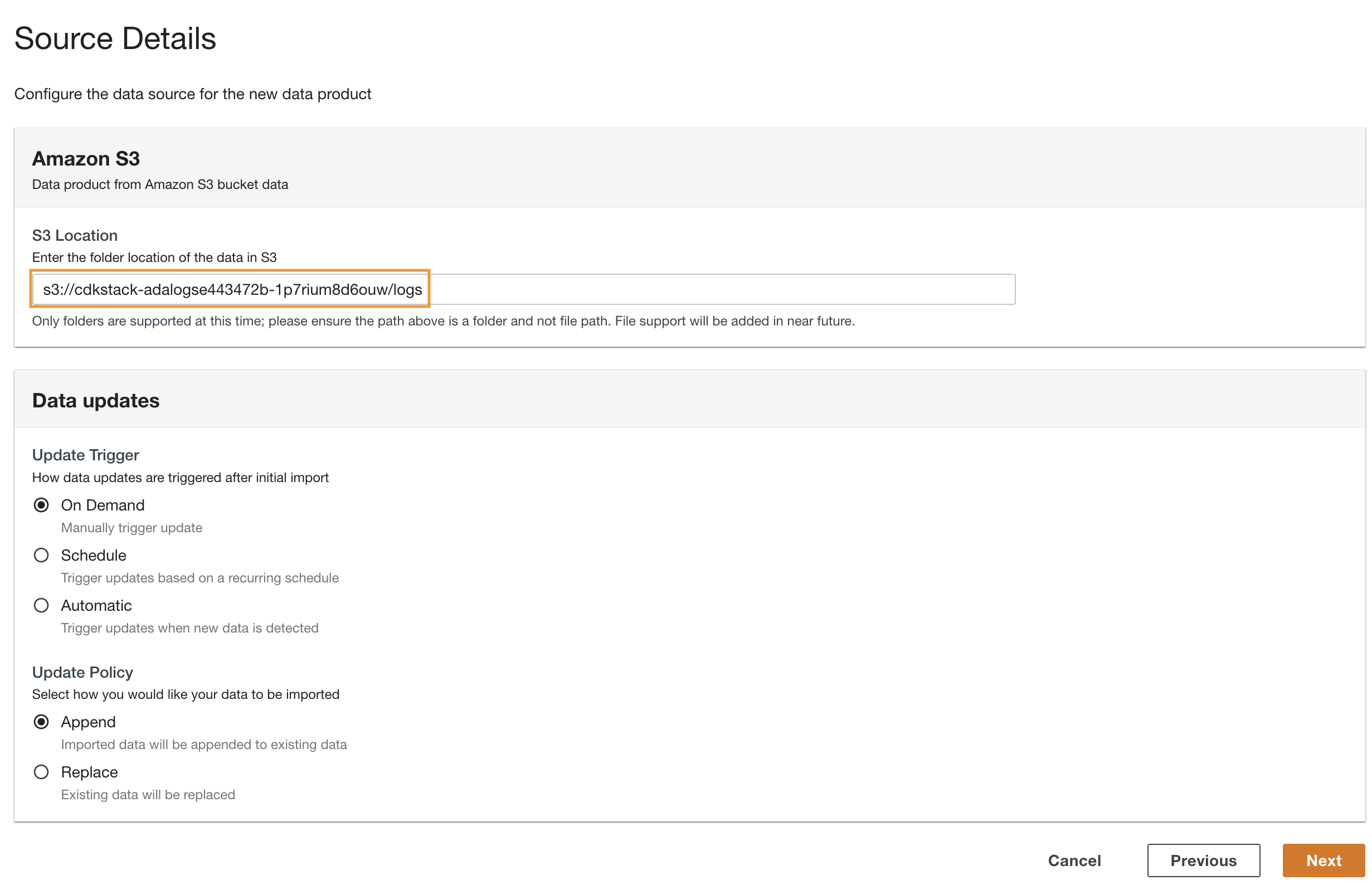

- Navigasikan kembali ke konsol ADA dan masukkan URI S3 yang disalin Lokasi S3.

- Untuk Perbarui Pemicu, pilih On Demand karena log historis diperbarui pada frekuensi yang tidak ditentukan.

- Untuk Perbarui Kebijakan, pilih Menambahkan untuk menambahkan data yang baru diimpor ke data yang sudah ada.

- Pilih Selanjutnya.

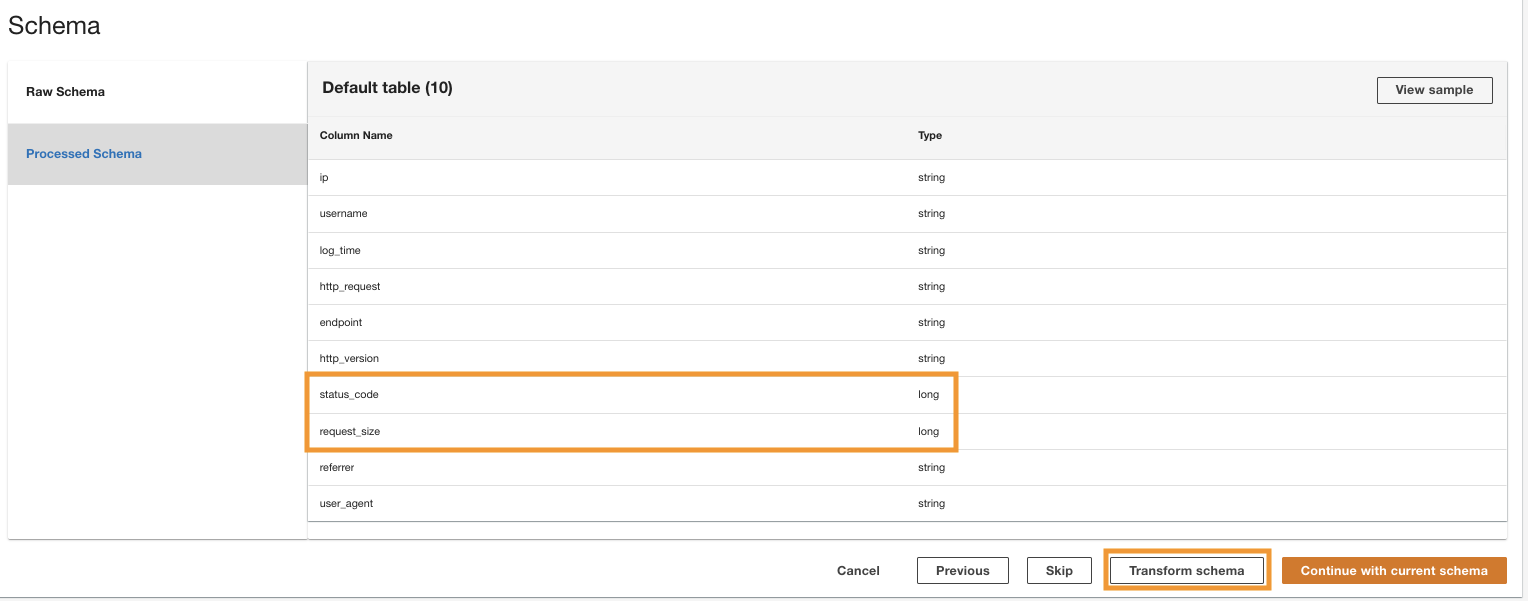

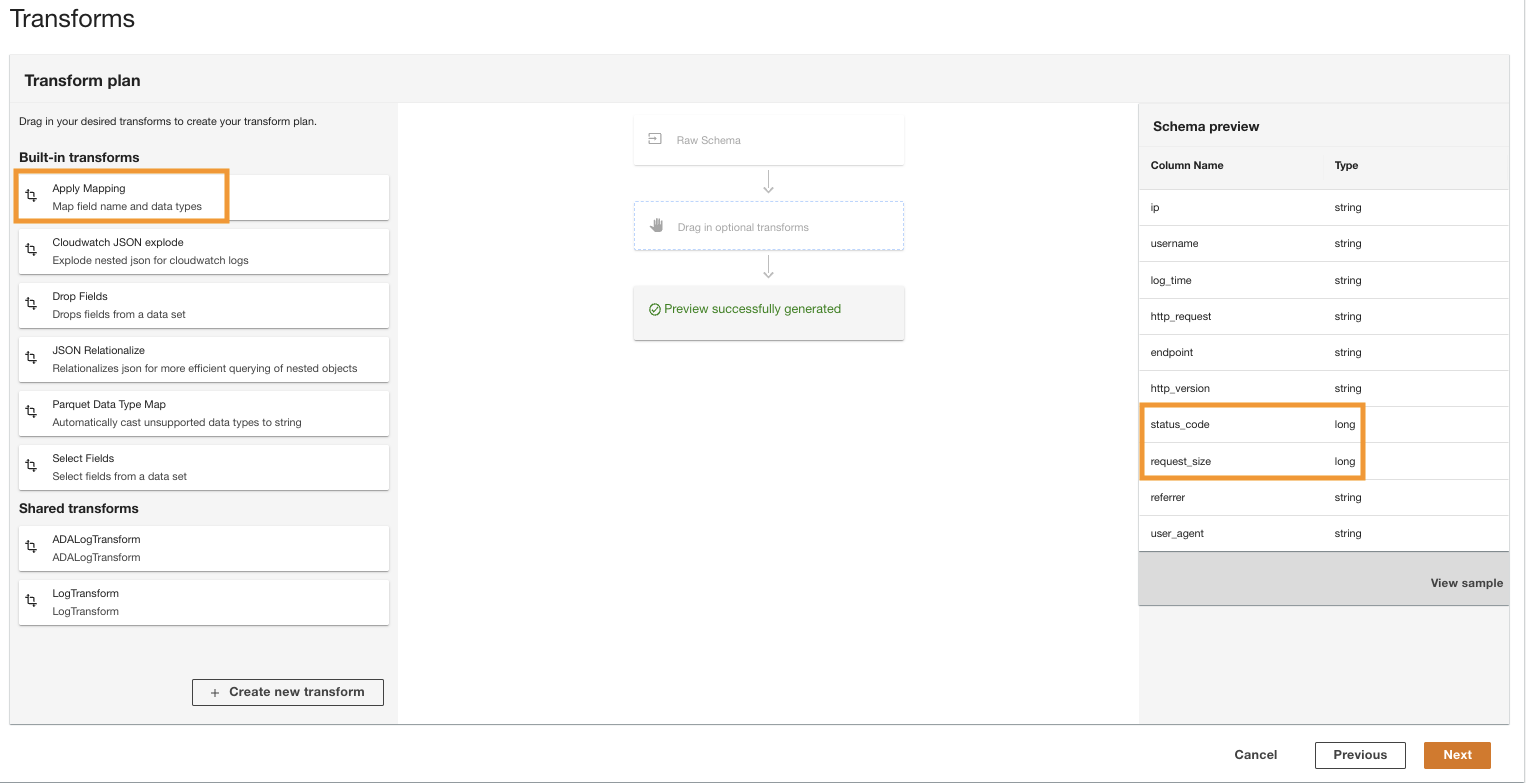

ADA memproses skema untuk file di jalur folder yang dipilih. Karena log dalam format CSV, ADA dapat membaca nama kolom tanpa memerlukan transformasi tambahan. Namun, kolomnya status_code dan request_size disimpulkan sebagai tipe panjang oleh ADA. Kami ingin menjaga tipe data kolom tetap konsisten di antara produk data sehingga kami bisa menggabungkan tabel data dan mengkueri data. Kolom status_code akan digunakan untuk membuat gabungan di seluruh tabel data.

- Pilih Transformasi skema untuk mengubah tipe data dua kolom menjadi tipe data string.

Perhatikan nama kolom yang disorot di Pratinjau skema panel sebelum menerapkan transformasi tipe data.

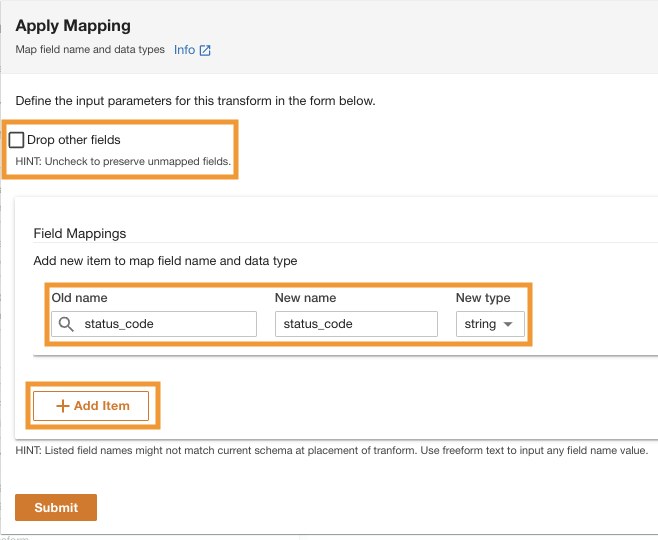

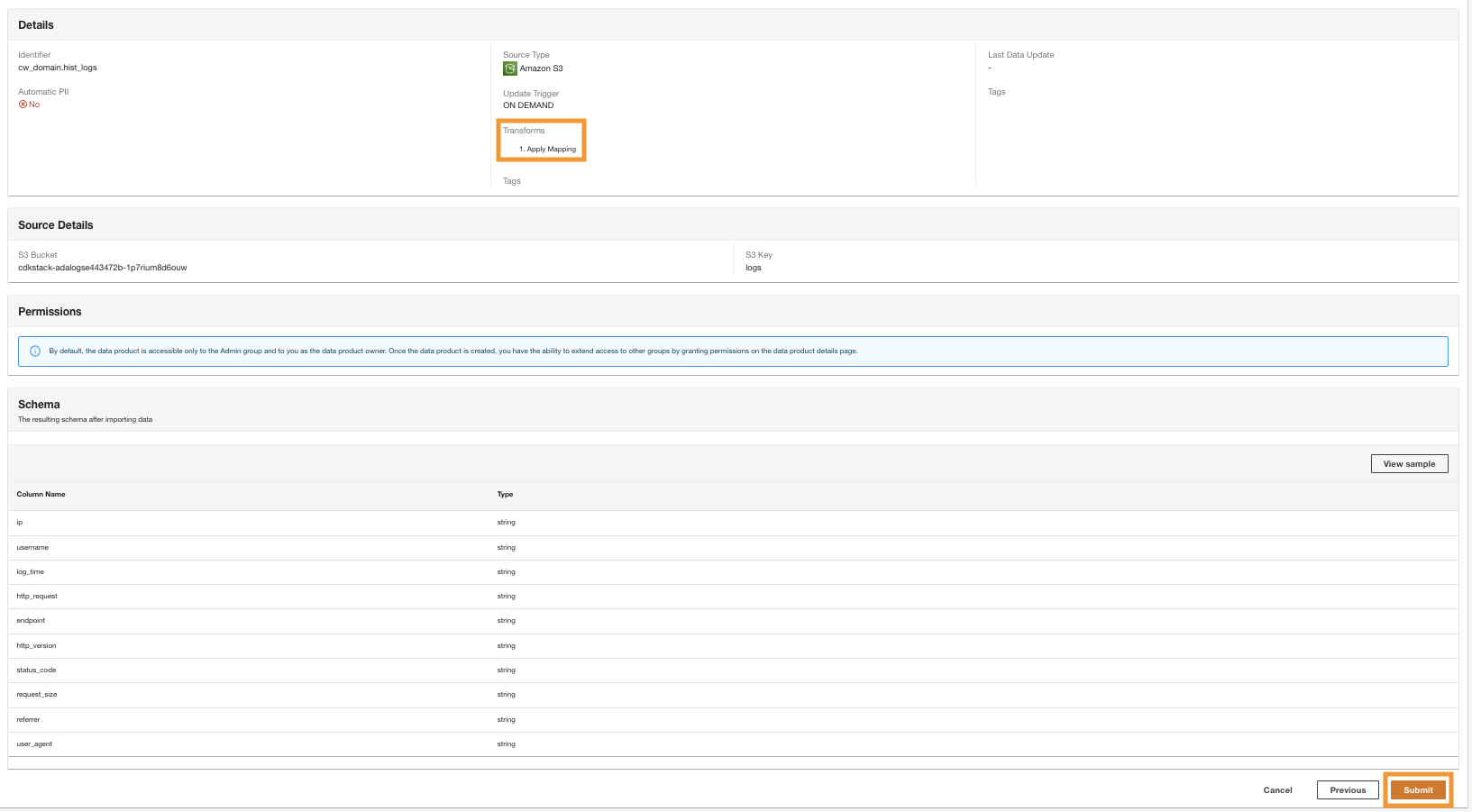

- Dalam majalah Transformasi rencana panel, di bawah Transformasi bawaan, pilih Terapkan Pemetaan.

Opsi ini memungkinkan Anda mengubah tipe data dari satu tipe ke tipe lainnya.

- Dalam majalah Terapkan Pemetaan bagian, batalkan pilihan Jatuhkan bidang lainnya.

Jika opsi ini tidak dinonaktifkan, hanya kolom yang diubah yang akan dipertahankan dan semua kolom lainnya akan dihapus. Karena kami ingin mempertahankan semua kolom, kami menonaktifkan opsi ini.

- Bawah Pemetaan Lapangan¸ untuk Nama lama dan Nama baru, Masuk

status_codedan untuk Tipe baru, Masukstring.

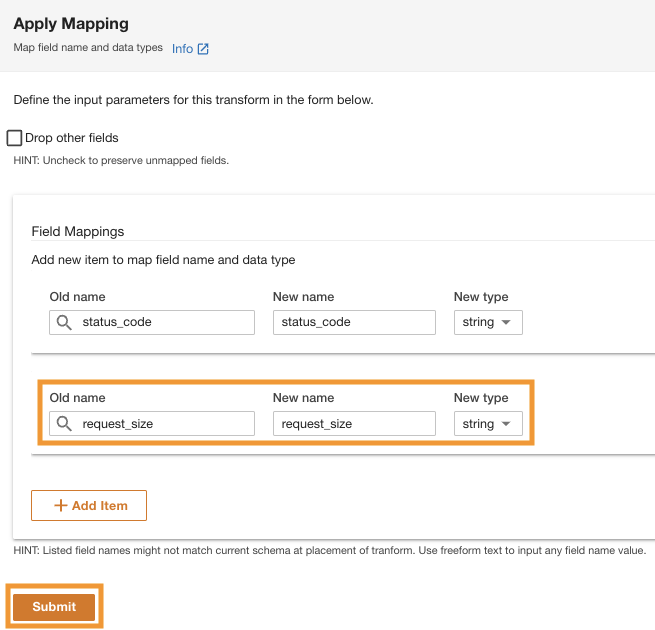

- Pilih Tambahkan Barang.

- Untuk Nama lama dan Nama baru¸ masukkan request_size dan untuk Tipe data baru, masukkan string.

- Pilih Kirim.

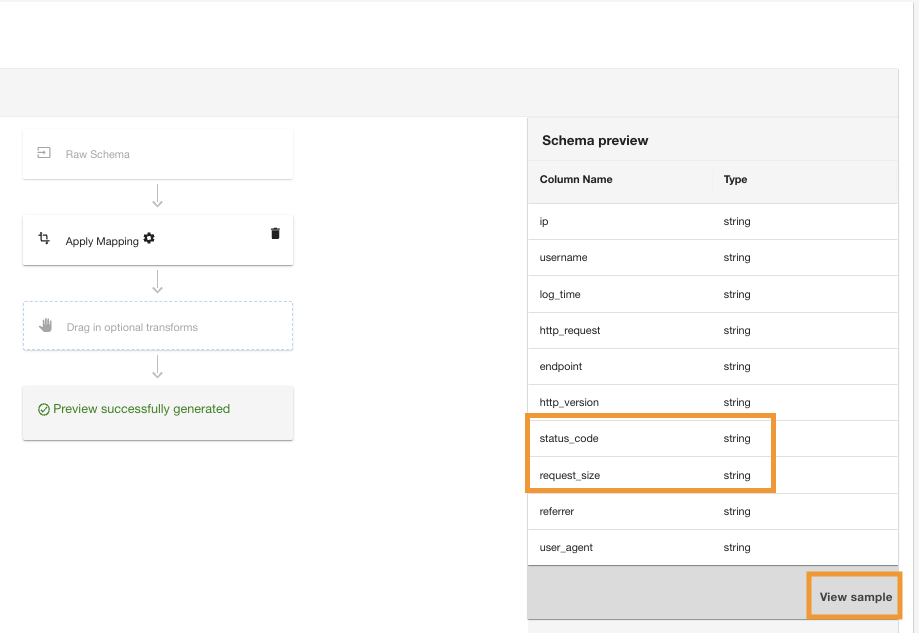

ADA akan menerapkan transformasi pemetaan pada sumber data Amazon S3. Perhatikan tipe kolom di Pratinjau skema pane

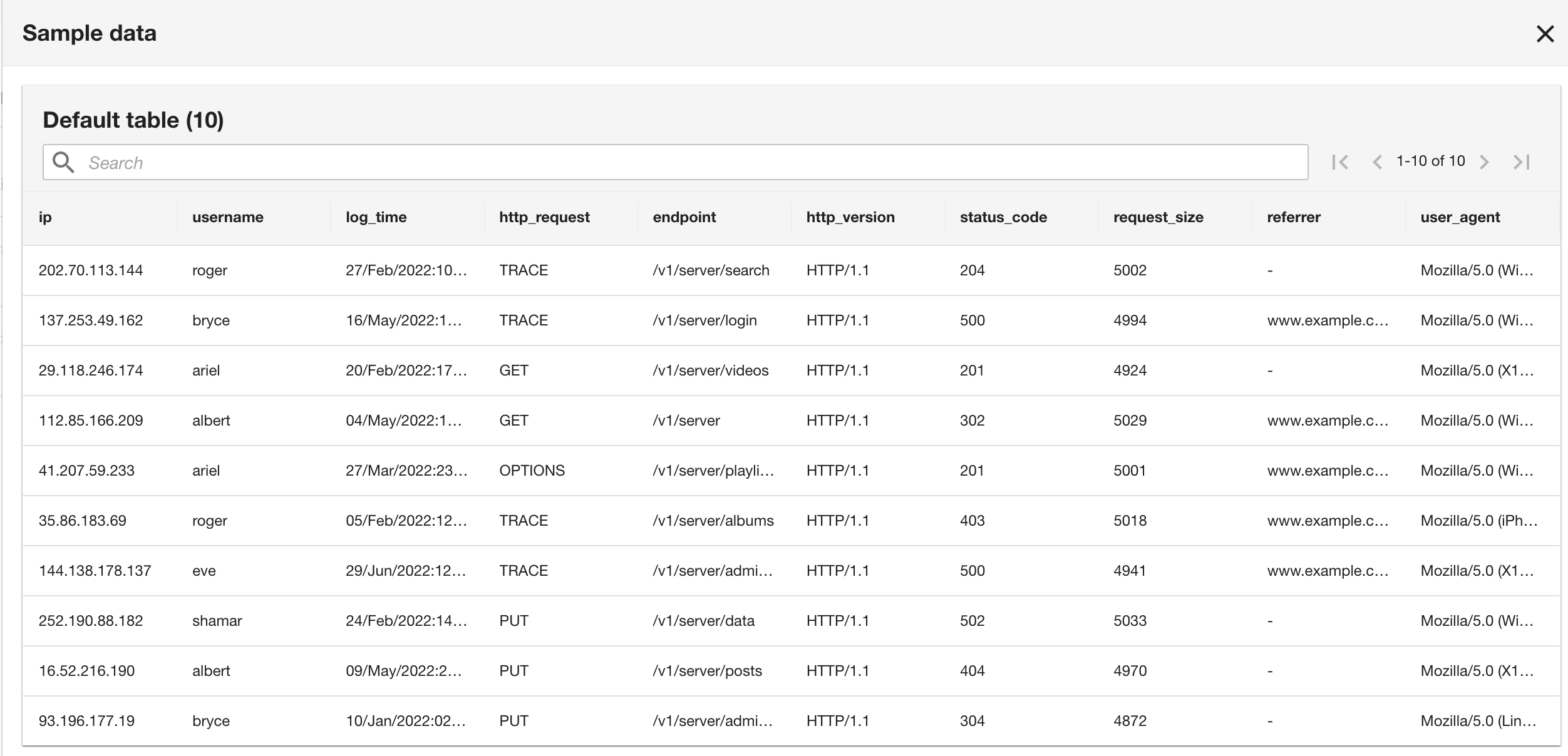

- Pilih Lihat sampel untuk melihat pratinjau data dengan transformasi yang diterapkan.

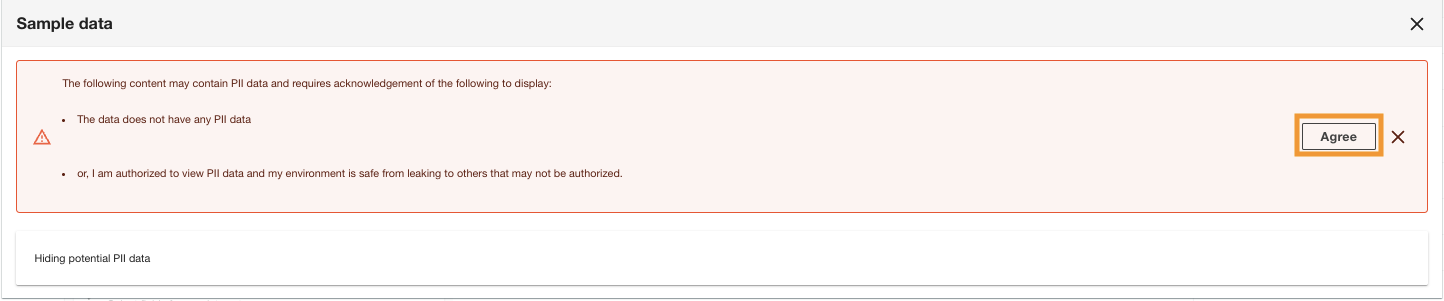

ADA akan menampilkan pengakuan data PII untuk memastikan bahwa hanya pengguna resmi yang dapat melihat data tersebut atau kumpulan data tidak berisi data PII apa pun.

- Pilih Setuju untuk terus melihat data sampel.

Perhatikan bahwa skema ini identik dengan skema grup log CloudWatch karena log aplikasi saat ini dan log aplikasi historis berada dalam Format Log Apache.

- Pada langkah terakhir, tinjau konfigurasi dan pilih Kirim.

ADA mulai memproses data dari sumber Amazon S3, membuat infrastruktur backend, dan menyiapkan produk data. Proses ini memakan waktu beberapa menit tergantung pada ukuran data.

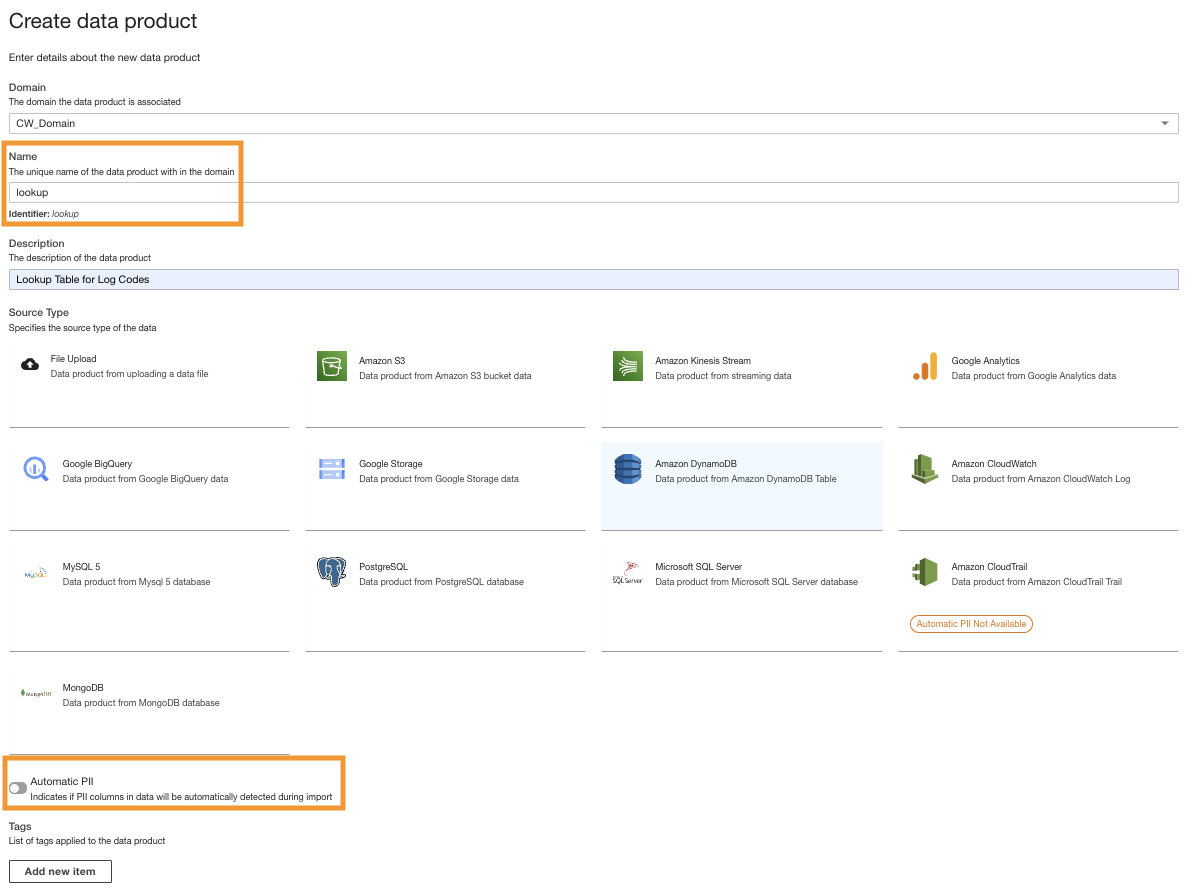

Buat produk data DynamoDB

Terakhir, kami membuat produk data DynamoDB. Selesaikan langkah-langkah berikut:

- Di konsol ADA, buat produk data baru.

- Masukkan nama (

lookup) dan pilih Amazon DynamoDB.

- Masukkan

Cdk.DynamoDBTablevariabel keluaran untuk ARN Tabel DynamoDB.

Tabel ini berisi atribut-atribut kunci yang akan digunakan sebagai tabel pencarian dalam demo ini. Untuk data pencarian, kami menggunakan kode HTTP dan deskripsi panjang dan pendek dari kode tersebut. Anda juga dapat menggunakan sumber file PostgreSQL, MySQL, atau CSV sebagai alternatif.

- Untuk Perbarui Pemicu, pilih Sesuai Permintaan.

Pembaruan akan dilakukan sesuai permintaan karena pencarian sebagian besar untuk tujuan referensi saat melakukan kueri dan setiap pembaruan pada data pencarian dapat diperbarui di ADA menggunakan pemicu sesuai permintaan.

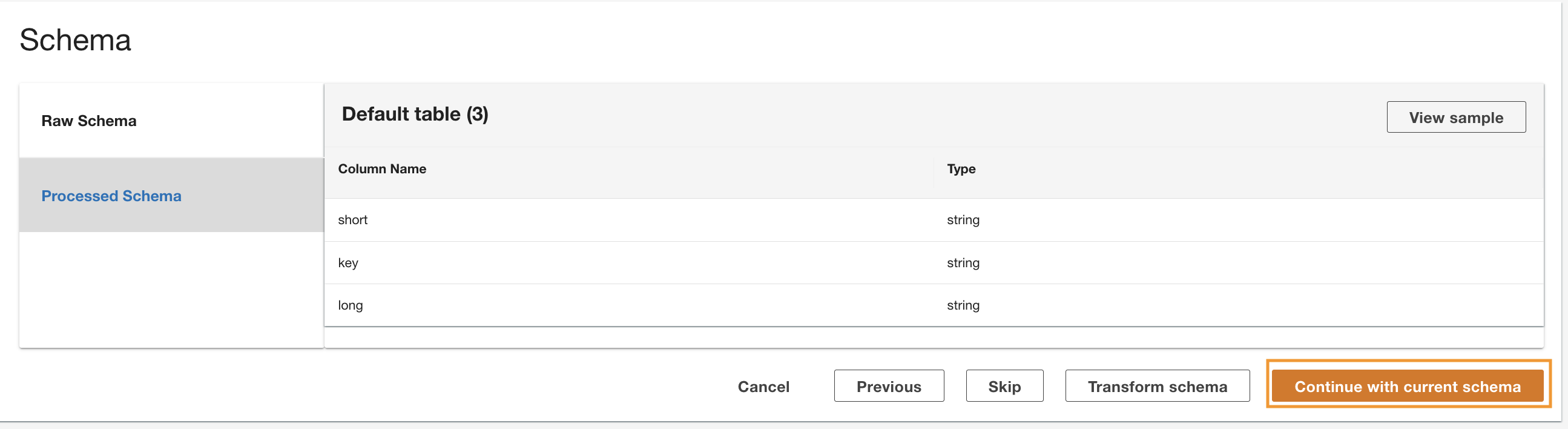

- Pilih Selanjutnya.

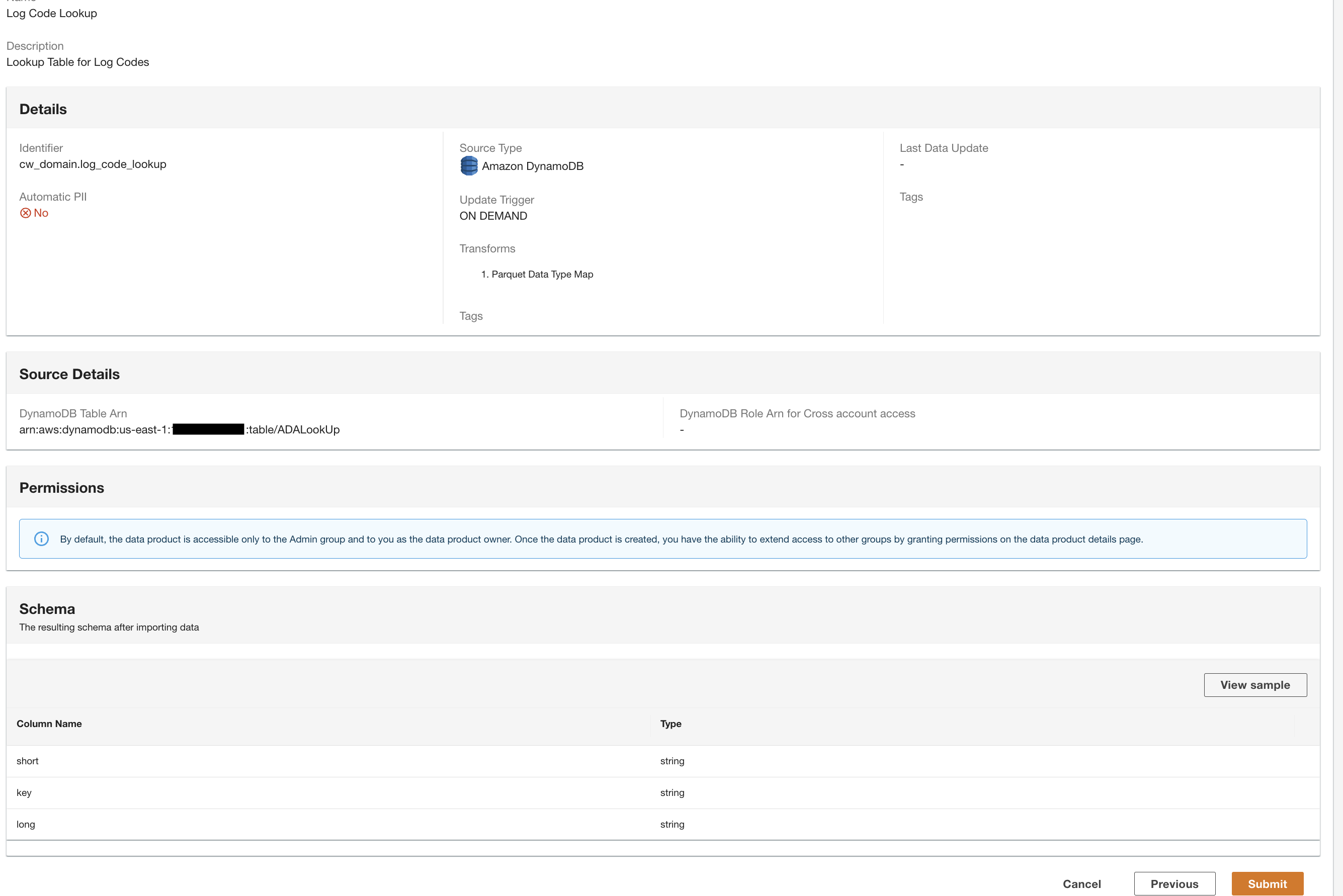

ADA membaca skema dari skema DynamoDB yang mendasarinya dan menampilkan nama dan jenis kolom untuk transformasi opsional. Kami akan melanjutkan dengan pemilihan skema default karena tipe kolom konsisten dengan tipe dari grup log CloudWatch dan sumber data CSV Amazon S3. Memiliki tipe data yang konsisten di seluruh sumber data memungkinkan kita menulis kueri untuk mengambil rekaman dengan menggabungkan tabel menggunakan bidang kolom. Misalnya kolom key dalam skema DynamoDB sesuai dengan status_code dalam produk data Amazon S3 dan CloudWatch. Kita bisa menulis query yang bisa menggabungkan tiga tabel menggunakan nama kolom key. Contohnya ditunjukkan di bagian selanjutnya.

- Pilih Lanjutkan dengan skema saat ini.

- Tinjau konfigurasi dan pilih Kirim.

ADA akan memproses data dari sumber data tabel DynamoDB dan menyiapkan produk data. Bergantung pada ukuran data, proses ini memerlukan waktu beberapa menit.

Sekarang kami memiliki ketiga produk data yang diproses oleh ADA dan tersedia bagi Anda untuk menjalankan kueri.

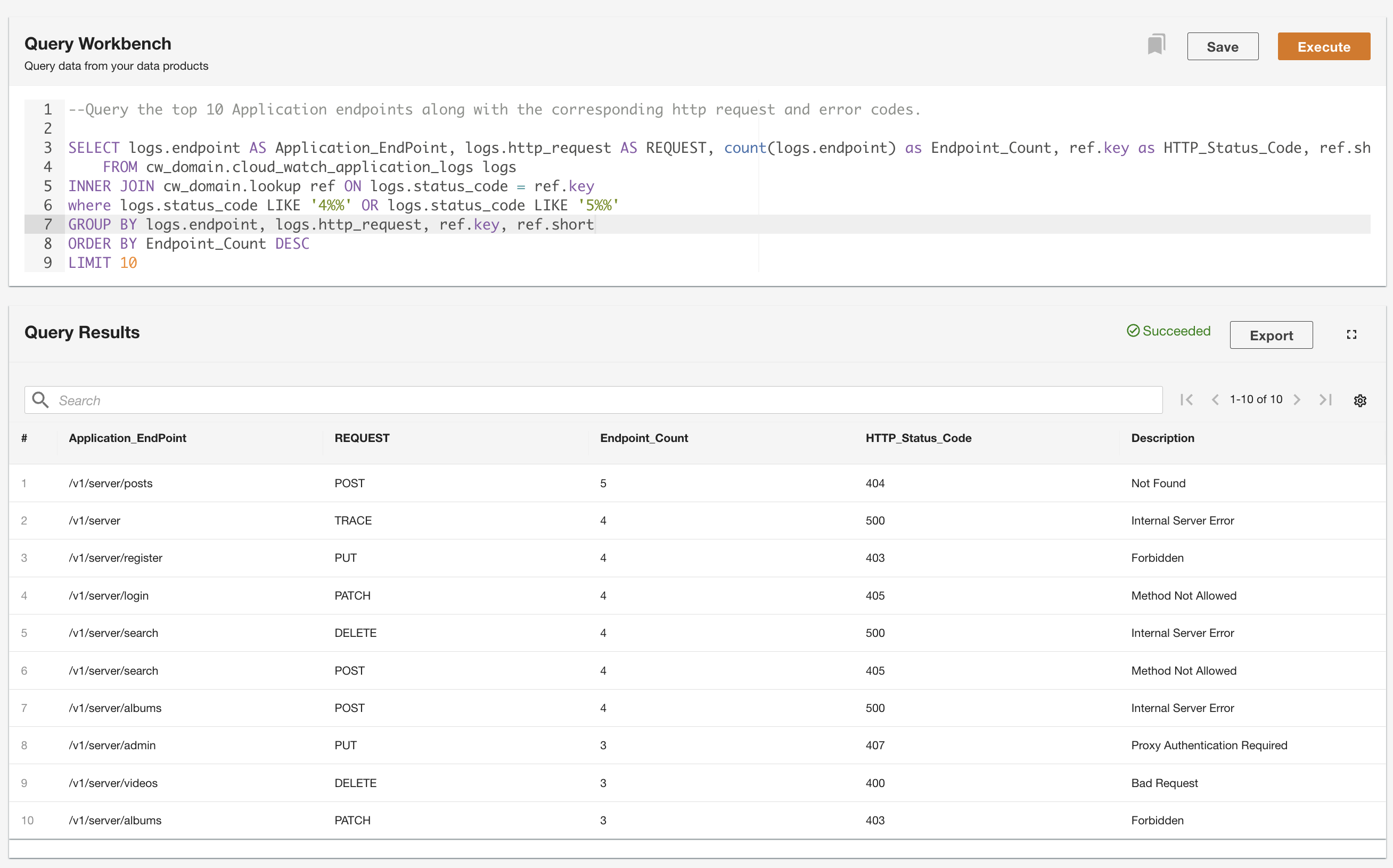

Gunakan Query Workbench untuk menanyakan data

ADA memungkinkan Anda menjalankan kueri terhadap produk data sambil mengabstraksi sumber data dan membuatnya dapat diakses menggunakan SQL (Structured Query Language). Anda dapat menulis kueri dan menggabungkan tabel sama seperti Anda melakukan kueri terhadap tabel dalam database relasional. Kami mendemonstrasikan kemampuan kueri ADA melalui dua skenario pengguna. Dalam kedua skenario tersebut, kami menggabungkan kumpulan data log aplikasi ke tabel pencarian kode kesalahan. Dalam kasus penggunaan pertama, kami menanyakan log aplikasi saat ini untuk mengidentifikasi 10 titik akhir aplikasi yang paling banyak diakses bersama dengan kode status HTTP yang sesuai:

Dalam contoh kedua, kami menanyakan tabel log historis untuk mendapatkan 10 titik akhir aplikasi teratas dengan kesalahan terbanyak untuk memahami pola panggilan titik akhir:

Selain membuat kueri, Anda juga bisa menyimpan kueri dan membagikan kueri tersimpan dengan pengguna lain di domain yang sama. Kueri bersama dapat diakses langsung dari Query Workbench. Hasil query juga dapat diekspor ke format CSV.

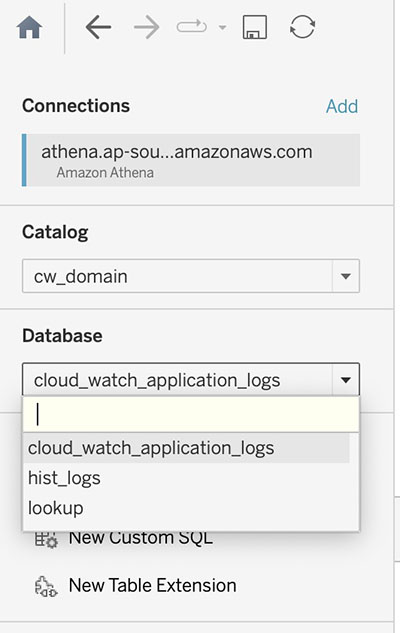

Visualisasikan produk data ADA di Tableau

ADA menawarkan kemampuan untuk menghubungkan ke alat BI pihak ketiga untuk memvisualisasikan data dan membuat laporan dari produk data ADA. Dalam demo ini, kami menggunakan integrasi asli ADA dengan Tableau untuk memvisualisasikan data dari tiga produk data yang kami konfigurasikan sebelumnya. Menggunakan konektor Athena Tableau dan mengikuti langkah-langkahnya Konfigurasi tablo, Anda dapat mengonfigurasi ADA sebagai sumber data di Tableau. Setelah koneksi berhasil dibuat antara Tableau dan ADA, Tableau akan mengisi tiga produk data di bawah katalog Tableau cw_domain.

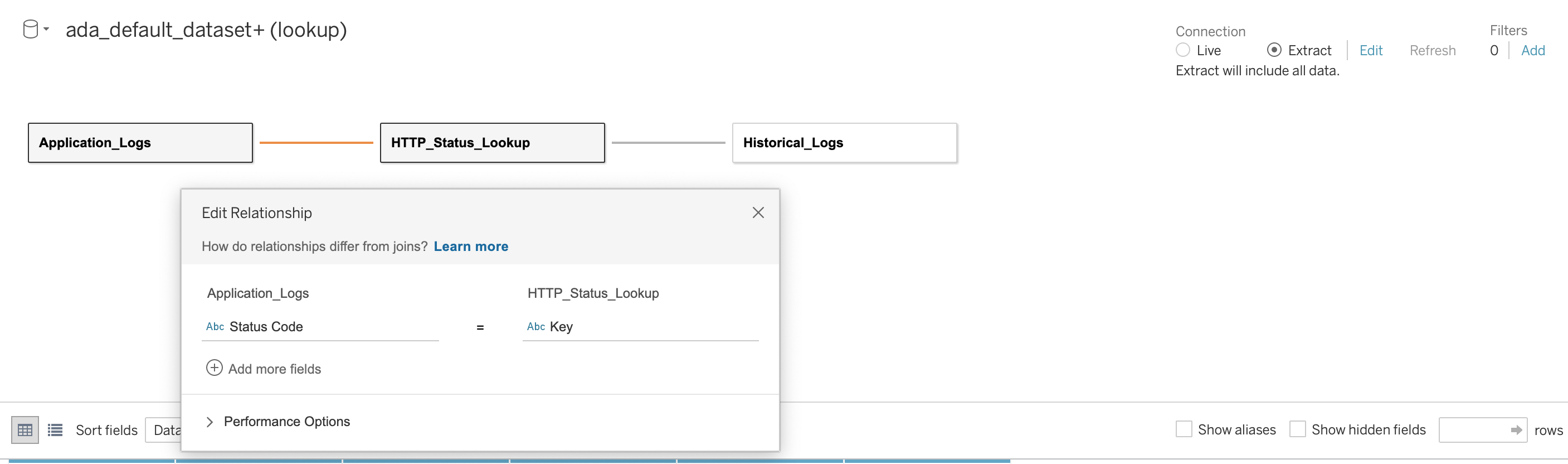

Kami kemudian membangun hubungan di tiga database menggunakan kode status HTTP sebagai kolom gabungan, seperti yang ditunjukkan pada gambar layar berikut. Tableau memungkinkan kita bekerja dalam mode online dan offline dengan sumber data. Dalam mode online, Tableau akan terhubung ke ADA dan menanyakan produk data secara langsung. Dalam mode offline, kita dapat menggunakan Ekstrak opsi untuk mengekstrak data dari ADA dan mengimpor data ke Tableau. Dalam demo ini, kami mengimpor data ke Tableau untuk membuat kueri lebih responsif. Kami kemudian menyimpan buku kerja Tableau. Kita dapat memeriksa data dari sumber data dengan memilih database dan Memperbarui sekarang.

Dengan konfigurasi sumber data yang diterapkan di Tableau, kami dapat membuat laporan, diagram, dan visualisasi khusus pada produk data ADA. Mari pertimbangkan dua kasus penggunaan untuk visualisasi.

Seperti yang ditunjukkan pada gambar berikut, kami memvisualisasikan frekuensi kesalahan HTTP berdasarkan titik akhir aplikasi menggunakan bawaan Tableau peta panas bagan. Kami memfilter kode status HTTP agar hanya menyertakan kode kesalahan dalam rentang 4xx dan 5xx.

Kami juga membuat diagram batang untuk menggambarkan titik akhir aplikasi dari log historis yang diurutkan berdasarkan jumlah kode kesalahan HTTP. Dalam grafik ini, kita dapat melihat bahwa /v1/server/admin titik akhir telah menghasilkan kode status kesalahan HTTP terbanyak.

Membersihkan

Membersihkan infrastruktur aplikasi sampel adalah proses dua langkah. Pertama, untuk menghapus infrastruktur yang disediakan untuk tujuan demo ini, jalankan perintah berikut di terminal:

Untuk pertanyaan berikut, masukkan y dan AWS CDK akan menghapus sumber daya yang dikerahkan untuk demo:

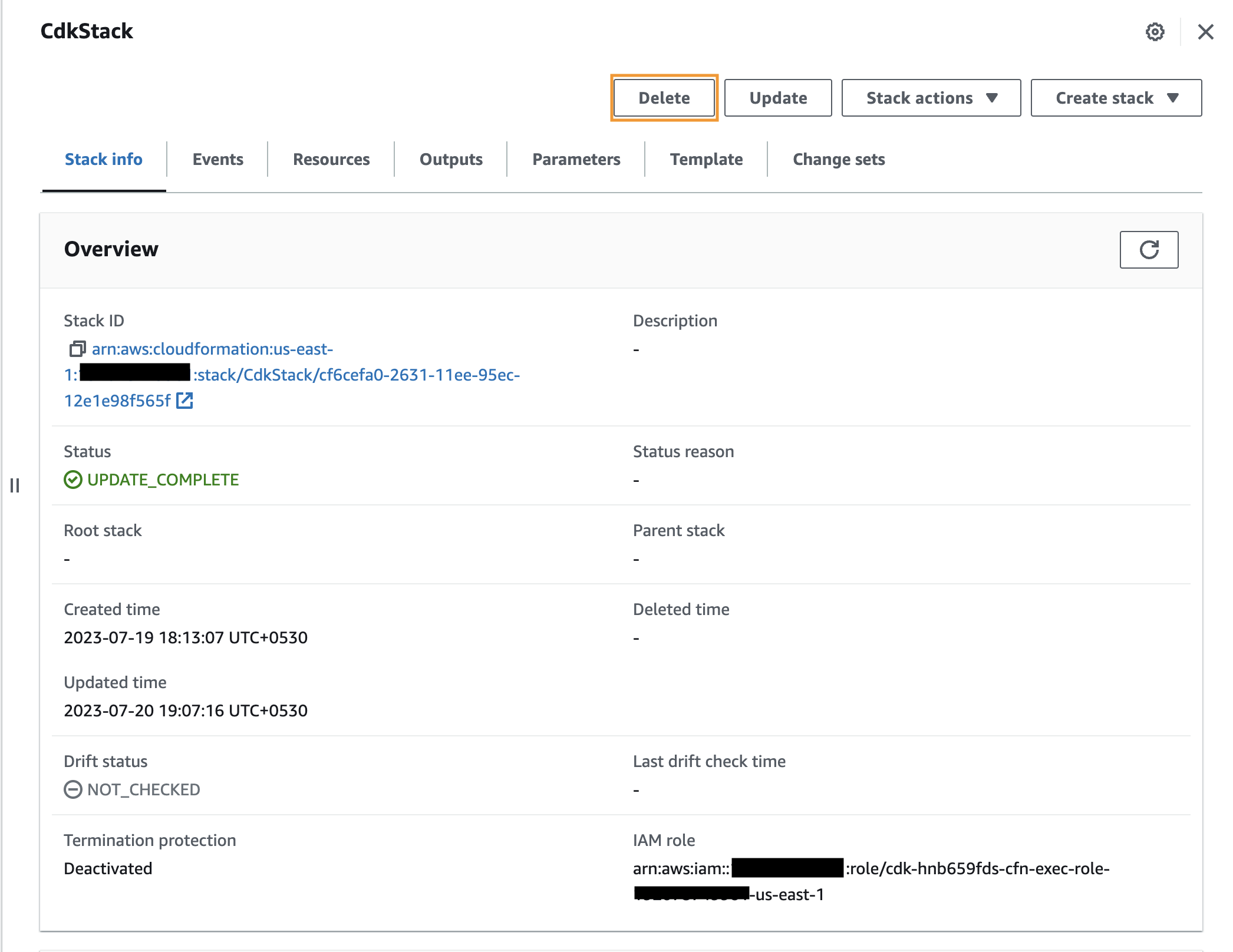

Alternatifnya, Anda dapat menghapus sumber daya melalui konsol AWS CloudFormation dengan menavigasi ke tumpukan CdkStack dan memilih Delete.

Langkah kedua adalah uninstall ADA. Untuk instruksi, lihat Copot pemasangan solusinya.

Kesimpulan

Dalam postingan ini, kami mendemonstrasikan cara menggunakan solusi ADA untuk memperoleh wawasan dari log aplikasi yang disimpan di dua sumber data berbeda. Kami mendemonstrasikan cara menginstal ADA pada akun AWS dan menerapkan komponen demo menggunakan AWS CDK. Kami membuat produk data di ADA dan mengonfigurasi produk data dengan masing-masing sumber data menggunakan konektor data bawaan ADA. Kami mendemonstrasikan cara mengkueri produk data menggunakan kueri SQL standar dan menghasilkan wawasan tentang data log. Kami juga menghubungkan klien Tableau Desktop, produk BI pihak ketiga, ke ADA dan mendemonstrasikan cara membuat visualisasi terhadap produk data.

ADA mengotomatiskan proses menyerap, mengubah, mengatur, dan menanyakan beragam kumpulan data dan menyederhanakan pengelolaan siklus hidup data. Konektor bawaan ADA memungkinkan Anda menyerap data dari beragam sumber data. Tim perangkat lunak dengan pengetahuan dasar tentang produk dan layanan AWS akan dapat menyiapkan platform analisis data operasional dalam beberapa jam dan menyediakan akses aman ke data. Data kemudian dapat ditanyakan dengan mudah dan cepat menggunakan antarmuka pengguna web yang intuitif dan mandiri.

Cobalah ADA hari ini untuk mengelola dan mendapatkan wawasan dari data dengan mudah.

Tentang penulis

Aparajithan Vaidyanathan adalah Arsitek Solusi Perusahaan Utama di AWS. Dia mendukung pelanggan perusahaan bermigrasi dan memodernisasi beban kerja mereka di cloud AWS. Dia adalah Arsitek Cloud dengan pengalaman lebih dari 23 tahun dalam merancang dan mengembangkan sistem perangkat lunak perusahaan berskala besar dan terdistribusi. Dia berspesialisasi dalam Pembelajaran Mesin & Analisis Data dengan fokus pada domain Rekayasa Data dan Fitur. Dia adalah pelari maraton yang bercita-cita tinggi dan hobinya meliputi hiking, bersepeda, dan menghabiskan waktu bersama istri dan dua putranya.

Aparajithan Vaidyanathan adalah Arsitek Solusi Perusahaan Utama di AWS. Dia mendukung pelanggan perusahaan bermigrasi dan memodernisasi beban kerja mereka di cloud AWS. Dia adalah Arsitek Cloud dengan pengalaman lebih dari 23 tahun dalam merancang dan mengembangkan sistem perangkat lunak perusahaan berskala besar dan terdistribusi. Dia berspesialisasi dalam Pembelajaran Mesin & Analisis Data dengan fokus pada domain Rekayasa Data dan Fitur. Dia adalah pelari maraton yang bercita-cita tinggi dan hobinya meliputi hiking, bersepeda, dan menghabiskan waktu bersama istri dan dua putranya.

Rashim Rahman adalah Pengembang Perangkat Lunak yang berbasis di Sydney, Australia dengan pengalaman lebih dari 10 tahun dalam pengembangan dan arsitektur perangkat lunak. Pekerjaan utamanya adalah membangun solusi AWS sumber terbuka berskala besar untuk kasus penggunaan umum pelanggan dan masalah bisnis. Di waktu luangnya, ia menikmati olahraga dan menghabiskan waktu bersama teman dan keluarga.

Rashim Rahman adalah Pengembang Perangkat Lunak yang berbasis di Sydney, Australia dengan pengalaman lebih dari 10 tahun dalam pengembangan dan arsitektur perangkat lunak. Pekerjaan utamanya adalah membangun solusi AWS sumber terbuka berskala besar untuk kasus penggunaan umum pelanggan dan masalah bisnis. Di waktu luangnya, ia menikmati olahraga dan menghabiskan waktu bersama teman dan keluarga.

Hafiz Saadullah adalah Manajer Produk Teknis Utama di Amazon Web Services. Hafiz berfokus pada Solusi AWS, yang dirancang untuk membantu pelanggan dengan mengatasi masalah bisnis umum dan kasus penggunaan.

Hafiz Saadullah adalah Manajer Produk Teknis Utama di Amazon Web Services. Hafiz berfokus pada Solusi AWS, yang dirancang untuk membantu pelanggan dengan mengatasi masalah bisnis umum dan kasus penggunaan.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Otomotif / EV, Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- ChartPrime. Tingkatkan Game Trading Anda dengan ChartPrime. Akses Di Sini.

- BlockOffset. Modernisasi Kepemilikan Offset Lingkungan. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/derive-operational-insights-from-application-logs-using-automated-data-analytics-on-aws/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 10

- 11

- 12

- 14

- 15%

- 16

- 160

- 17

- 2021

- 3000

- 500

- 7

- 8

- 9

- a

- kemampuan

- Sanggup

- Tentang Kami

- mengakses

- diakses

- dapat diakses

- Akun

- di seluruh

- tindakan

- ADA

- menambahkan

- tambahan

- Tambahan

- menangani

- admin

- Setelah

- terhadap

- Semua

- mengizinkan

- memungkinkan

- sepanjang

- juga

- alternatif

- Amazon

- Amazon Web Services

- antara

- an

- analisis

- Analis

- analisis

- menganalisa

- dan

- Lain

- Apa pun

- Apache

- api

- Lebah

- Aplikasi

- aplikasi

- terapan

- Mendaftar

- Menerapkan

- arsitektur

- ADALAH

- AS

- bercita-cita tinggi

- At

- atribut

- Australia

- Otentikasi

- berwenang

- Otomatis

- mengotomatiskan

- secara otomatis

- tersedia

- AWS

- Formasi AWS Cloud

- kembali

- Backend

- bar

- berdasarkan

- dasar

- BE

- karena

- menjadi

- sebelum

- dipesan lebih dahulu

- antara

- kedua

- Kotak

- membangun

- Bangunan

- built-in

- bisnis

- intelijen bisnis

- tapi

- by

- panggilan

- CAN

- kemampuan

- kasus

- kasus

- katalog

- CD

- perubahan

- Grafik

- Charts

- Pilih

- memilih

- klien

- awan

- kode

- Kode

- koleksi

- Kolom

- Kolom

- Umum

- lengkap

- komponen

- konfigurasi

- dikonfigurasi

- Terhubung

- terhubung

- koneksi

- menghubungkan

- Mempertimbangkan

- konsisten

- konsul

- mengandung

- terus

- berkorelasi

- Korelasi

- Sesuai

- berkorespondensi

- Biaya

- membuat

- dibuat

- menciptakan

- membuat

- Surat kepercayaan

- terbaru

- adat

- pelanggan

- pelanggan

- dasbor

- data

- Data Analytics

- pengolahan data

- Basis Data

- database

- kumpulan data

- Default

- Permintaan

- Demo

- mendemonstrasikan

- menunjukkan

- Tergantung

- menyebarkan

- dikerahkan

- penyebaran

- menyebarkan

- deskripsi

- dirancang

- merancang

- Desktop

- terperinci

- rincian

- Pengembang

- berkembang

- Pengembangan

- diagnosa

- berbeda

- langsung

- cacat

- penemuan

- Display

- didistribusikan

- beberapa

- Tidak

- domain

- domain

- Dont

- menjatuhkan

- selama

- setiap

- Terdahulu

- mudah

- mengedit

- antara

- diaktifkan

- memungkinkan

- Titik akhir

- endpoint

- Teknik

- memastikan

- Enter

- Enterprise

- pelanggan perusahaan

- Solusi perusahaan

- kesalahan

- kesalahan

- menetapkan

- mapan

- Eter (ETH)

- contoh

- ada

- pengalaman

- Menjelaskan

- penjelasan

- ekstrak

- ekstrak datanya

- akrab

- keluarga

- Fitur

- beberapa

- bidang

- Fields

- Angka

- File

- File

- terakhir

- keuangan

- Pertama

- fleksibel

- Fokus

- berfokus

- berikut

- Untuk

- format

- empat

- Frekuensi

- teman

- dari

- fungsi

- Mendapatkan

- menghasilkan

- dihasilkan

- mendapatkan

- mendapatkan

- memerintah

- Kelompok

- Grup

- Memiliki

- memiliki

- he

- membantu

- Disorot

- mendaki

- -nya

- historis

- Hobi

- host

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- IAM

- identik

- mengenali

- identitas

- if

- mengimpor

- in

- memasukkan

- termasuk

- Termasuk

- informasi

- Infrastruktur

- mulanya

- wawasan

- install

- instalasi

- instruksi

- terpadu

- integrasi

- Intelijen

- interaktif

- tertarik

- Antarmuka

- ke

- intuitif

- memanggil

- terlibat

- isu

- IT

- ikut

- bergabung

- Bergabung

- jpg

- json

- hanya

- Menjaga

- kunci

- pengetahuan

- bahasa

- besar

- besar-besaran

- Terakhir

- kemudian

- peluncuran

- pengetahuan

- Perpustakaan

- Izin

- siklus hidup

- 'like'

- MEMBATASI

- baris

- Daftar

- hidup

- mencatat

- penebangan

- Panjang

- melihat

- lookup

- mesin

- Mesin belajar

- membuat

- Membuat

- mengelola

- pengelolaan

- manajer

- banyak

- peta

- pemetaan

- Maraton

- Marketing

- hal

- berarti

- pesan

- MFA

- mungkin

- bermigrasi

- menit

- mode

- memodernisasi

- lebih

- paling

- kebanyakan

- Mozilla

- otentikasi multi-faktor

- MySQL

- nama

- Bernama

- nama

- asli

- Arahkan

- menavigasi

- Navigasi

- Perlu

- dibutuhkan

- kebutuhan

- New

- baru saja

- berikutnya

- jumlah

- of

- Penawaran

- Pengunjung

- Tua

- on

- Sesuai Permintaan

- ONE

- secara online

- hanya

- Buka

- open source

- operasional

- pilihan

- or

- urutan

- Lainnya

- Lainnya

- di luar

- keluaran

- ikhtisar

- halaman

- pane

- Kata Sandi

- path

- pola

- melakukan

- Izin

- Sendiri

- telepon

- saleh

- pipa saluran

- Tempat

- Polos

- rencana

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- Kebijakan

- Portal

- Pos

- Postgresql

- didukung

- Mempersiapkan

- Mempersiapkan

- prasyarat

- menyajikan

- hadiah

- Preview

- sebelumnya

- terutama

- Utama

- Sebelumnya

- masalah

- memproses

- proses

- diproses

- proses

- pengolahan

- Diproduksi

- Produk

- manajer produk

- Produk

- Produk dan Layanan

- program

- proyek

- memberikan

- disediakan

- pemberi

- menyediakan

- tujuan

- tujuan

- Ular sanca

- query

- pertanyaan

- segera

- jarak

- Baca

- siap

- menerima

- arsip

- disebut

- wilayah

- hubungan

- relevan

- menghapus

- ulangi

- laporan

- permintaan

- wajib

- Sumber

- itu

- responsif

- Hasil

- menahan

- ulasan

- naik

- peran

- akar

- Aturan

- Run

- pelari

- berjalan

- penjualan

- sama

- Save

- Skala

- skenario

- dijadwalkan

- cakupan

- Pencarian

- Kedua

- Bagian

- aman

- keamanan

- melihat

- terpilih

- seleksi

- mengirim

- mengirim

- terpisah

- melayani

- Tanpa Server

- layanan

- Layanan

- set

- pengaturan

- Share

- berbagi

- Pendek

- ditunjukkan

- Pertunjukkan

- Sederhana

- disederhanakan

- menyederhanakan

- Ukuran

- keterampilan

- So

- Perangkat lunak

- pengembangan perangkat lunak

- larutan

- Solusi

- sumber

- sumber

- spesialis

- spesialisasi

- tertentu

- ditentukan

- Pengeluaran

- Olahraga

- SQL

- tumpukan

- standalone

- standar

- awal

- dimulai

- Status

- Langkah

- Tangga

- penyimpanan

- tersimpan

- Tali

- tersusun

- sukses

- berhasil

- seperti itu

- Mendukung

- yakin

- sydney

- sistem

- tabel

- Tablo

- Mengambil

- Dibutuhkan

- tim

- tim

- Teknis

- keterampilan teknis

- terminal

- bahwa

- Grafik

- Sumber

- mereka

- kemudian

- Sana.

- Ini

- pihak ketiga

- ini

- tiga

- Melalui

- waktu

- untuk

- hari ini

- alat

- puncak

- Top 10

- Total

- Mengubah

- Transformasi

- transformasi

- berubah

- mengubah

- transformasi

- dipicu

- dua

- mengetik

- jenis

- bawah

- pokok

- memahami

- diperbarui

- Pembaruan

- atas

- URI

- us

- menggunakan

- gunakan case

- bekas

- Pengguna

- User Interface

- Pengguna

- menggunakan

- Nilai - Nilai

- variabel

- variasi

- versi

- melalui

- View

- ingin

- Cara..

- we

- jaringan

- layanan web

- BAIK

- ketika

- yang

- sementara

- lebar

- Rentang luas

- istri

- akan

- dengan

- dalam

- tanpa

- Kerja

- alur kerja

- bekerja

- akan

- menulis

- tahun

- kamu

- Anda

- zephyrnet.dll