Di dunia yang berbasis data saat ini, kemampuan untuk memindahkan dan menganalisis data dengan mudah di berbagai platform sangatlah penting. Alur Aplikasi Amazon, layanan integrasi data yang terkelola sepenuhnya, telah menjadi yang terdepan dalam menyederhanakan transfer data antara layanan AWS, aplikasi perangkat lunak sebagai layanan (SaaS), dan kini Google BigQuery. Dalam postingan blog ini, Anda menjelajahi hal baru Konektor Google BigQuery di Amazon AppFlow dan temukan cara menyederhanakan proses transfer data dari gudang data Google ke Layanan Penyimpanan Sederhana Amazon (Amazon S3), memberikan manfaat yang signifikan bagi para profesional dan organisasi data, termasuk demokratisasi akses data multi-cloud.

Ikhtisar Amazon AppFlow

Alur Aplikasi Amazon adalah layanan integrasi terkelola sepenuhnya yang dapat Anda gunakan untuk mentransfer data dengan aman antara aplikasi SaaS seperti Google BigQuery, Salesforce, SAP, Hubspot, dan ServiceNow, dan layanan AWS seperti Amazon S3 dan Pergeseran Merah Amazon, hanya dalam beberapa klik. Dengan Amazon AppFlow, Anda dapat menjalankan aliran data pada hampir semua skala dan frekuensi yang Anda pilih—sesuai jadwal, sebagai respons terhadap peristiwa bisnis, atau sesuai permintaan. Anda dapat mengonfigurasi kemampuan transformasi data seperti pemfilteran dan validasi untuk menghasilkan data yang kaya dan siap digunakan sebagai bagian dari alur itu sendiri, tanpa langkah tambahan. Amazon AppFlow secara otomatis mengenkripsi data yang bergerak, dan memungkinkan Anda membatasi aliran data melalui internet publik untuk aplikasi SaaS yang terintegrasi dengan Tautan Pribadi AWS, mengurangi paparan terhadap ancaman keamanan.

Memperkenalkan konektor Google BigQuery

Baru Konektor Google BigQuery di Amazon AppFlow mengungkap kemungkinan bagi organisasi yang ingin menggunakan kemampuan analitis gudang data Google, dan dengan mudah mengintegrasikan, menganalisis, menyimpan, atau memproses lebih lanjut data dari BigQuery, mengubahnya menjadi wawasan yang dapat ditindaklanjuti.

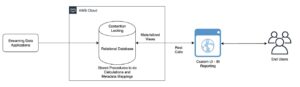

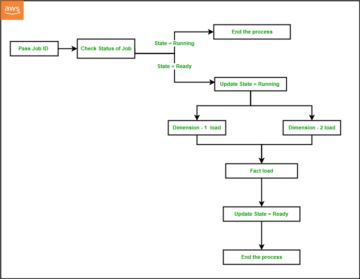

Arsitektur

Mari kita tinjau arsitektur untuk mentransfer data dari Google BigQuery ke Amazon S3 menggunakan Amazon AppFlow.

- Pilih sumber data: Masuk Alur Aplikasi Amazon, pilih Google BigQuery sebagai sumber data Anda. Tentukan tabel atau kumpulan data yang datanya ingin Anda ekstrak.

- Pemetaan dan transformasi lapangan: Konfigurasikan transfer data menggunakan antarmuka visual intuitif Amazon AppFlow. Anda dapat memetakan bidang data dan menerapkan transformasi sesuai kebutuhan untuk menyelaraskan data dengan kebutuhan Anda.

- Frekuensi transfer: Tentukan seberapa sering Anda ingin mentransfer data—seperti harian, mingguan, atau bulanan—mendukung fleksibilitas dan otomatisasi.

- Tujuan: Tentukan bucket S3 sebagai tujuan data Anda. Amazon AppFlow akan memindahkan data secara efisien, sehingga dapat diakses di penyimpanan Amazon S3 Anda.

- Konsumsi: Gunakan Amazon Athena untuk menganalisis data di Amazon S3.

Prasyarat

Dataset yang digunakan dalam solusi ini dihasilkan oleh Sintea, simulator populasi pasien sintetis dan proyek sumber terbuka di bawah Lisensi Apache 2.0. Muat data ini ke Google BigQuery atau gunakan kumpulan data Anda yang sudah ada.

Hubungkan Amazon AppFlow ke akun Google BigQuery Anda

Untuk postingan ini, Anda menggunakan akun Google, klien OAuth dengan izin yang sesuai, dan data Google BigQuery. Untuk mengaktifkan akses Google BigQuery dari Amazon AppFlow, Anda harus menyiapkan klien OAuth baru terlebih dahulu. Untuk instruksi, lihat Konektor Google BigQuery untuk Amazon AppFlow.

Siapkan Amazon S3

Setiap objek di Amazon S3 disimpan dalam bucket. Sebelum Anda dapat menyimpan data di Amazon S3, Anda harus melakukannya buat ember S3 untuk menyimpan hasilnya.

Buat bucket S3 baru untuk hasil Amazon AppFlow

Untuk membuat bucket S3, selesaikan langkah-langkah berikut:

- Di konsol AWS Management untuk Amazon S3, pilih Buat ember.

- Masukkan unik secara global nama untuk ember Anda; sebagai contoh,

appflow-bq-sample. - Pilih Buat ember.

Buat bucket S3 baru untuk hasil Amazon Athena

Untuk membuat bucket S3, selesaikan langkah-langkah berikut:

- Di konsol AWS Management untuk Amazon S3, pilih Buat ember.

- Masukkan unik secara global nama untuk ember Anda; sebagai contoh,

athena-results. - Pilih Buat ember.

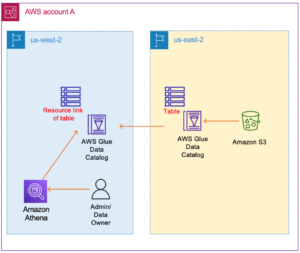

Peran pengguna (IAM role) untuk Katalog Data AWS Glue

Untuk membuat katalog data yang Anda transfer dengan aliran Anda, Anda harus memiliki peran pengguna yang sesuai Identitas dan Manajemen Akses AWS (IAM). Anda memberikan peran ini ke Amazon AppFlow untuk memberikan izin yang diperlukan untuk membuat Katalog Data AWS Glue, tabel, database, dan partisi.

Untuk contoh kebijakan IAM yang memiliki izin yang diperlukan, lihat Contoh kebijakan berbasis identitas untuk Amazon AppFlow.

Panduan desain

Sekarang, mari kita telusuri kasus penggunaan praktis untuk melihat cara kerja konektor Amazon AppFlow Google BigQuery ke Amazon S3. Untuk kasus penggunaan, Anda akan menggunakan Amazon AppFlow untuk mengarsipkan data historis dari Google BigQuery ke Amazon S3 untuk penyimpanan analisis jangka panjang.

Siapkan Amazon AppFlow

Buat alur Amazon AppFlow baru untuk mentransfer data dari Google Analytics ke Amazon S3.

- pada Konsol Amazon AppFlow, pilih Buat aliran.

- Masukkan nama untuk aliran Anda; Misalnya,

my-bq-flow. - Tambahkan seperlunya Tag; misalnya untuk kunci Enter

envdan untuk Nilai Enterdev.

- Pilih Selanjutnya.

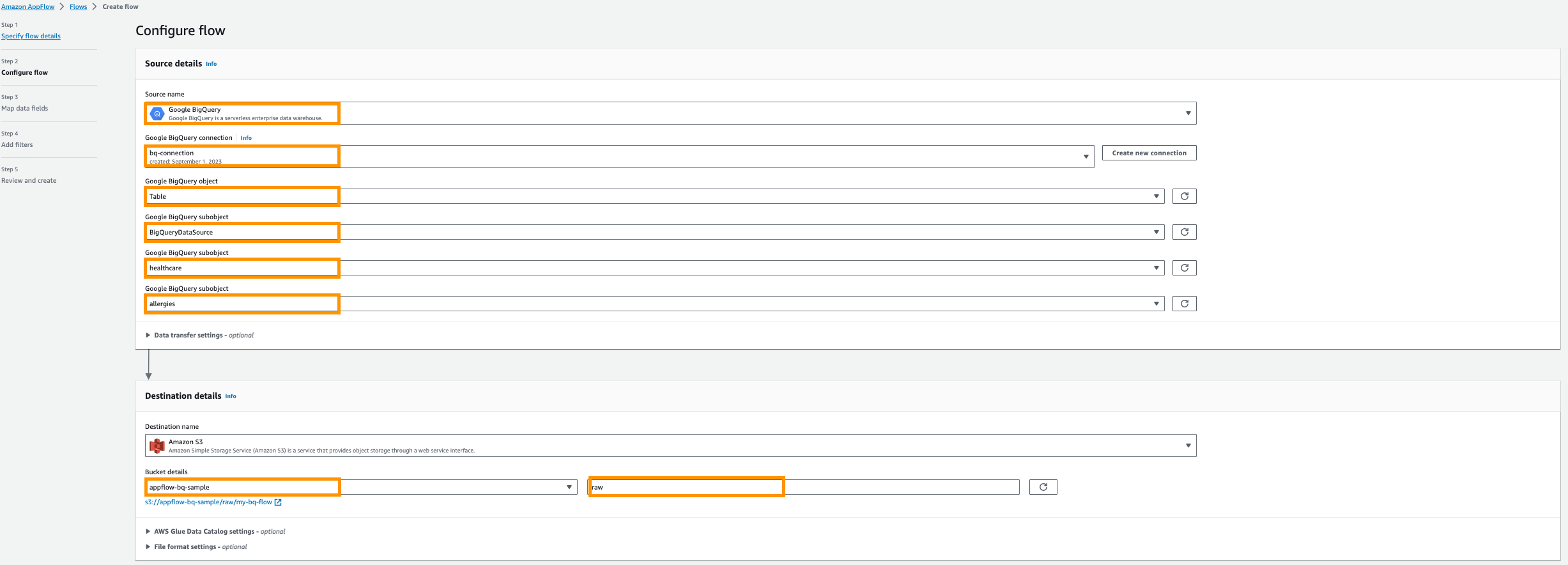

- Untuk Nama asal, pilih Google BigQuery.

- Pilih Buat koneksi baru.

- Masukkan OAuth Anda ID pelanggan dan Rahasia Klien, lalu beri nama koneksi Anda; Misalnya,

bq-connection.

- Di jendela pop-up, pilih untuk mengizinkan amazon.com akses ke Google BigQuery API.

- Untuk Pilih objek Google BigQuery, pilih tabel.

- Untuk Pilih subobjek Google BigQuery, pilih NamaProyek BigQuery.

- Untuk Pilih subobjek Google BigQuery, pilih Nama Basis Data.

- Untuk Pilih subobjek Google BigQuery, pilih NamaTabel.

- Untuk Nama tujuan, pilih Amazon S3.

- Untuk Detail ember, pilih bucket Amazon S3 yang Anda buat untuk menyimpan hasil Amazon AppFlow di prasyarat.

- Enter

rawsebagai awalan.

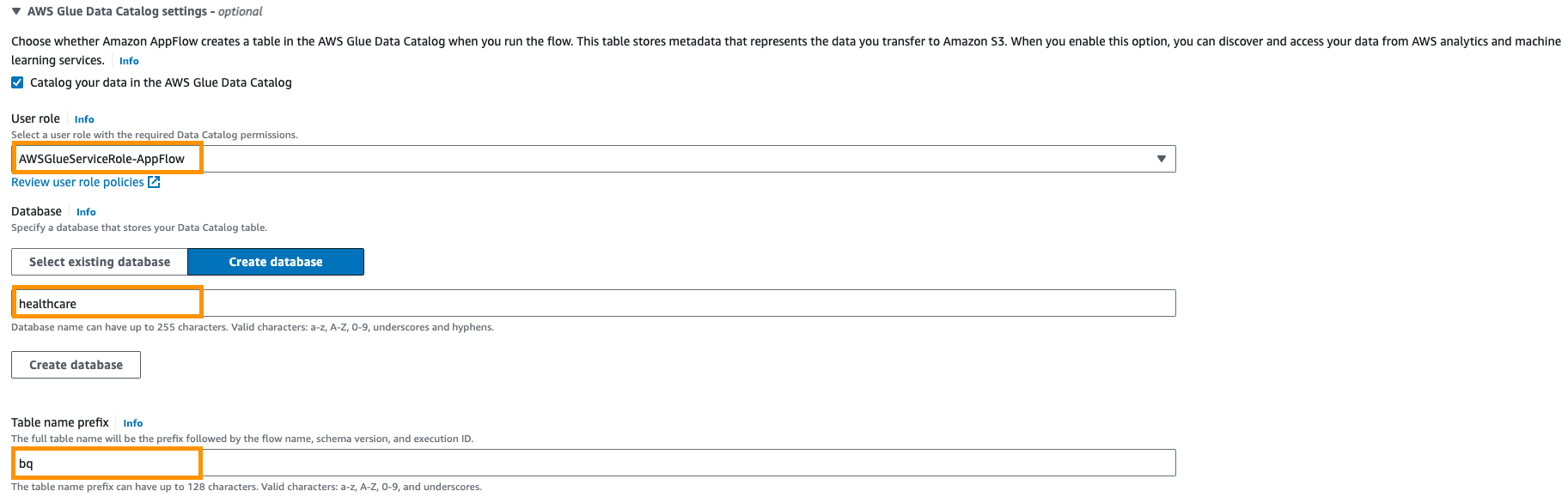

- Selanjutnya, sediakan Katalog Data AWS Glue pengaturan untuk membuat tabel untuk analisis lebih lanjut.

- Pilih Peran pengguna (IAM role) dibuat di prasyarat.

- Membuat baru Database sebagai contoh,

healthcare. - Menyediakan awalan tabel pengaturan misalnya,

bq.

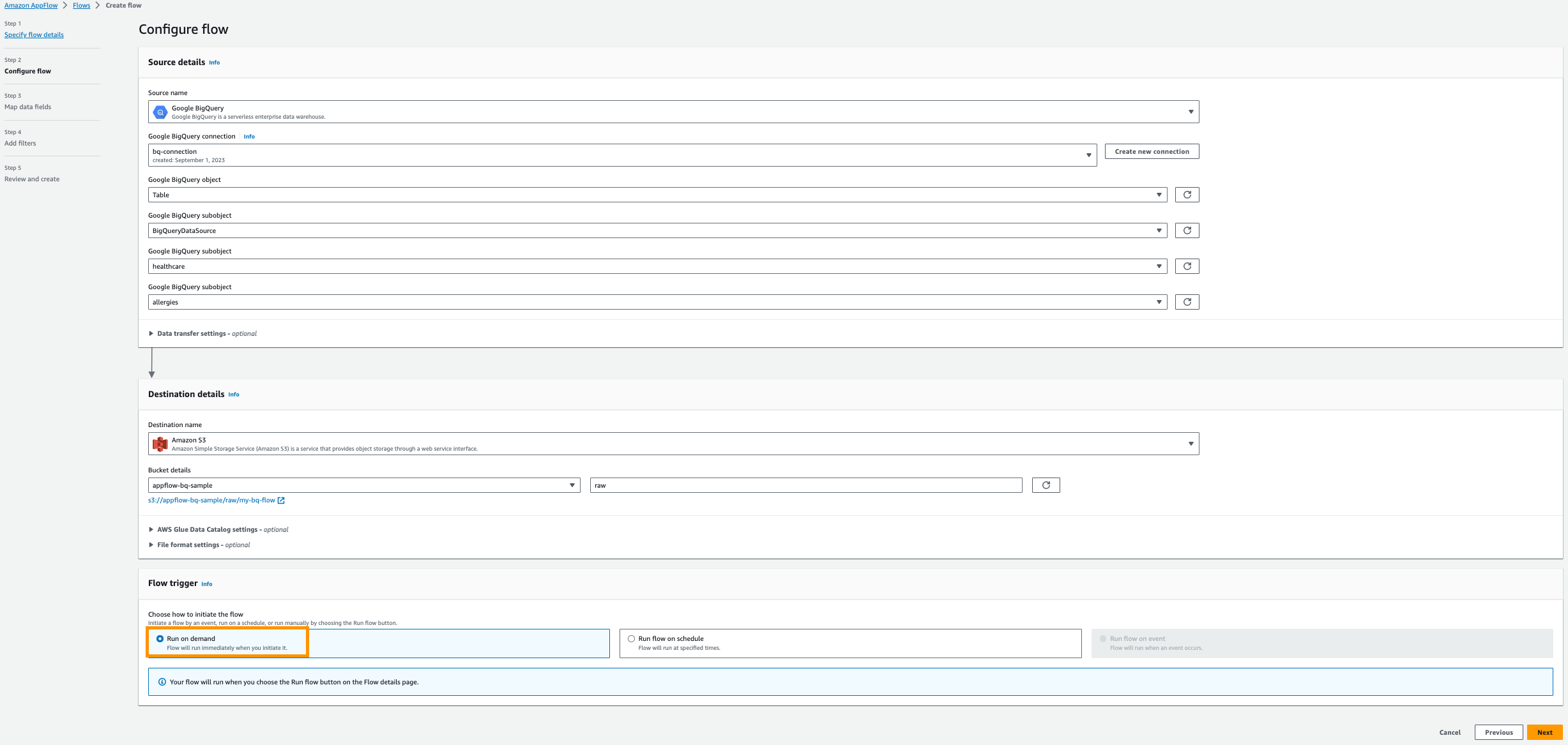

- Pilih Jalankan sesuai permintaan.

- Pilih Next.

- Pilih Petakan bidang secara manual.

- Pilih enam bidang berikut untuk Nama bidang sumber dari tabel Alergi:

- Start

- Pasien

- Kode

- Deskripsi Produk

- Tipe

- Kategori

- Pilih Bidang peta secara langsung.

- Pilih Selanjutnya.

- In Tambahkan filter bagian, pilih Selanjutnya.

- Pilih Buat aliran.

Jalankan alurnya

Setelah membuat aliran baru, Anda dapat menjalankannya sesuai permintaan.

- pada Konsol Amazon AppFlow, pilih

my-bq-flow. - Pilih Jalankan aliran.

Untuk panduan ini, pilih jalankan pekerjaan sesuai permintaan untuk kemudahan pemahaman. Dalam praktiknya, Anda dapat memilih pekerjaan terjadwal dan secara berkala hanya mengekstrak data yang baru ditambahkan.

Kueri melalui Amazon Athena

Saat Anda memilih pengaturan opsional AWS Glue Data Catalog, Data Catalog membuat katalog untuk data, memungkinkan Amazon Athena untuk melakukan kueri.

Jika Anda diminta untuk mengonfigurasi lokasi hasil kueri, navigasikan ke Settings tab dan pilih Mengelola. Dibawah Kelola pengaturan, pilih keranjang hasil Athena yang dibuat di prasyarat dan pilih Save.

- pada Konsol Amazon Athena, pilih Sumber Data sebagai

AWSDataCatalog. - Selanjutnya, pilih Basis Data as

healthcare. - Sekarang Anda dapat memilih tabel yang dibuat oleh crawler AWS Glue dan mempratinjaunya.

- Anda juga dapat menjalankan kueri khusus untuk menemukan 10 alergi teratas seperti yang ditunjukkan dalam kueri berikut.

Note: Pada query di bawah ini, ganti nama tabel, dalam kasus ini bq_appflow_mybqflow_1693588670_latest, dengan nama tabel yang dihasilkan di akun AWS Anda.

- Pilih Jalankan kueri.

Hasil ini menunjukkan 10 alergi teratas berdasarkan jumlah kasus.

Membersihkan

Untuk menghindari timbulnya biaya, bersihkan sumber daya di akun AWS Anda dengan menyelesaikan langkah-langkah berikut:

- Di konsol Amazon AppFlow, pilih Mengalir di panel navigasi.

- Dari daftar aliran, pilih aliran

my-bq-flow, dan hapus. - Masukkan hapus untuk menghapus aliran.

- Pilih Koneksi di panel navigasi.

- Pilih Google BigQuery dari daftar konektor, pilih

bq-connector, dan hapus. - Masukkan delete untuk menghapus konektor.

- Di konsol IAM, pilih Peran di halaman navigasi, lalu pilih peran yang Anda buat untuk crawler AWS Glue dan hapus.

- Di konsol Amazon Athena:

- Hapus tabel yang dibuat di bawah database

healthcaremenggunakan crawler AWS Glue. - Jatuhkan basis data

healthcare

- Hapus tabel yang dibuat di bawah database

- Di konsol Amazon S3, cari bucket hasil Amazon AppFlow yang Anda buat, pilih Empty untuk menghapus objek, lalu hapus bucket.

- Di konsol Amazon S3, cari bucket hasil Amazon Athena yang Anda buat, pilih Empty untuk menghapus objek, lalu hapus bucket.

- Bersihkan sumber daya di akun Google Anda dengan menghapus proyek yang berisi sumber daya Google BigQuery. Ikuti dokumentasi untuk membersihkan sumber daya Google.

Kesimpulan

Konektor Google BigQuery di Amazon AppFlow menyederhanakan proses transfer data dari gudang data Google ke Amazon S3. Integrasi ini menyederhanakan analitik dan pembelajaran mesin, pengarsipan, dan penyimpanan jangka panjang, memberikan manfaat signifikan bagi para profesional data dan organisasi yang ingin memanfaatkan kemampuan analitis kedua platform.

Dengan Amazon AppFlow, kerumitan integrasi data dihilangkan, memungkinkan Anda fokus untuk memperoleh wawasan yang dapat ditindaklanjuti dari data Anda. Baik Anda mengarsipkan data historis, melakukan analisis kompleks, atau menyiapkan data untuk pembelajaran mesin, konektor ini menyederhanakan prosesnya, sehingga dapat diakses oleh lebih banyak profesional data.

Jika Anda tertarik untuk melihat bagaimana transfer data dari Google BigQuery ke Amazon S3 menggunakan Amazon AppFlow, lihat langkah demi langkah video tutorial. Dalam tutorial ini, kita akan menjalani seluruh proses, mulai dari menyiapkan koneksi hingga menjalankan aliran transfer data. Untuk informasi lebih lanjut tentang Amazon AppFlow, kunjungi Alur Aplikasi Amazon.

Tentang penulis

Kartikay Khator adalah Arsitek Solusi pada Global Life Science di Amazon Web Services. Dia bersemangat membantu pelanggan dalam perjalanan cloud mereka dengan fokus pada layanan analitik AWS. Dia adalah seorang pelari yang rajin dan suka hiking.

Kartikay Khator adalah Arsitek Solusi pada Global Life Science di Amazon Web Services. Dia bersemangat membantu pelanggan dalam perjalanan cloud mereka dengan fokus pada layanan analitik AWS. Dia adalah seorang pelari yang rajin dan suka hiking.

Kamen Sharlandjiev adalah Senior Arsitek Solusi Big Data dan ETL serta pakar Amazon AppFlow. Misinya adalah membuat hidup lebih mudah bagi pelanggan yang menghadapi tantangan integrasi data yang kompleks. Senjata rahasianya? Layanan AWS berkode rendah dan terkelola sepenuhnya yang dapat menyelesaikan pekerjaan dengan sedikit usaha dan tanpa pengkodean.

Kamen Sharlandjiev adalah Senior Arsitek Solusi Big Data dan ETL serta pakar Amazon AppFlow. Misinya adalah membuat hidup lebih mudah bagi pelanggan yang menghadapi tantangan integrasi data yang kompleks. Senjata rahasianya? Layanan AWS berkode rendah dan terkelola sepenuhnya yang dapat menyelesaikan pekerjaan dengan sedikit usaha dan tanpa pengkodean.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/simplify-data-transfer-google-bigquery-to-amazon-s3-using-amazon-appflow/

- :memiliki

- :adalah

- $NAIK

- 10

- 100

- 14

- 16

- 17

- 22

- 321

- 8

- 9

- a

- kemampuan

- Tentang Kami

- mengakses

- manajemen akses

- dapat diakses

- Akun

- di seluruh

- menambahkan

- menambahkan

- Tambahan

- memajukan

- meluruskan

- Alergi

- mengizinkan

- Membiarkan

- memungkinkan

- juga

- Amazon

- Amazon Athena

- Amazon Web Services

- Amazon.com

- an

- analisis

- Analytical

- analisis

- menganalisa

- dan

- Apa pun

- api

- aplikasi

- Mendaftar

- sesuai

- arsitektur

- arsip

- ADALAH

- AS

- At

- secara otomatis

- Otomatisasi

- menghindari

- AWS

- Lem AWS

- Konsol Manajemen AWS

- menjadi

- sebelum

- di bawah

- Manfaat

- antara

- Besar

- Big data

- permintaan besar

- Blog

- kedua

- lebih luas

- bisnis

- by

- CAN

- Bisa Dapatkan

- kemampuan

- kemampuan

- kasus

- kasus

- katalog

- Kategori

- tantangan

- beban

- Pilih

- klien

- awan

- Pengkodean

- COM

- lengkap

- menyelesaikan

- kompleks

- kompleksitas

- koneksi

- konsul

- mengandung

- crawler

- membuat

- dibuat

- menciptakan

- membuat

- adat

- pelanggan

- harian

- data

- akses data

- integrasi data

- data warehouse

- Data-driven

- Basis Data

- database

- kumpulan data

- memutuskan

- Permintaan

- demokratisasi

- deskripsi

- tujuan

- menemukan

- beberapa

- dokumentasi

- dilakukan

- memudahkan

- mudah

- efisien

- usaha

- mudah

- dieliminasi

- aktif

- memungkinkan

- Seluruh

- penting

- Eter (ETH)

- Acara

- contoh

- contoh

- ada

- ahli

- menyelidiki

- Pencahayaan

- ekstrak

- menghadapi

- beberapa

- bidang

- Fields

- penyaringan

- Menemukan

- keluwesan

- aliran

- Mengalir

- Mengalir

- Fokus

- mengikuti

- berikut

- Untuk

- garis terdepan

- Frekuensi

- sering

- dari

- sepenuhnya

- lebih lanjut

- menghasilkan

- dihasilkan

- mendapatkan

- Aksi

- Secara global

- Google Analytics

- memberikan

- Kelompok

- memanfaatkan

- Memiliki

- he

- kesehatan

- membantu

- mendaki

- -nya

- historis

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTML

- http

- HTTPS

- Hubspot

- IAM

- identitas

- identitas dan manajemen akses

- in

- Termasuk

- informasi

- wawasan

- instruksi

- mengintegrasikan

- terpadu

- integrasi

- tertarik

- Antarmuka

- Internet

- ke

- intuitif

- IT

- Diri

- Pekerjaan

- perjalanan

- hanya

- pengetahuan

- Lisensi

- Hidup

- Ilmu Kehidupan

- MEMBATASI

- Daftar

- memuat

- tempat

- jangka panjang

- melihat

- mesin

- Mesin belajar

- membuat

- Membuat

- berhasil

- pengelolaan

- peta

- pemetaan

- minimal

- Misi

- lebih

- gerakan

- pindah

- harus

- nama

- Arahkan

- Navigasi

- hampir

- perlu

- dibutuhkan

- kebutuhan

- New

- baru saja

- tidak

- sekarang

- jumlah

- sumpah

- obyek

- objek

- of

- on

- Sesuai Permintaan

- hanya

- opensource

- or

- urutan

- organisasi

- lebih

- halaman

- pane

- bagian

- bergairah

- pasien

- melakukan

- melakukan

- Izin

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- kebijaksanaan

- pop-up

- populasi

- kemungkinan

- Pos

- Praktis

- praktek

- mempersiapkan

- prasyarat

- Preview

- proses

- profesional

- proyek

- memberikan

- menyediakan

- publik

- query

- jarak

- mengurangi

- menggantikan

- wajib

- Persyaratan

- Sumber

- tanggapan

- membatasi

- mengakibatkan

- Hasil

- ulasan

- Kaya

- Peran

- Run

- pelari

- berjalan

- SaaS

- tenaga penjualan

- getah

- Skala

- menjadwalkan

- dijadwalkan

- Ilmu

- Pencarian

- Rahasia

- Bagian

- aman

- keamanan

- Ancaman keamanan

- melihat

- pencarian

- layanan

- Sekarang Layanan

- Layanan

- set

- pengaturan

- pengaturan

- ditunjukkan

- Pertunjukkan

- penting

- Sederhana

- menyederhanakan

- simulator

- ENAM

- Perangkat lunak

- perangkat lunak sebagai layanan

- larutan

- Solusi

- sumber

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- pelurusan

- seperti itu

- sintetis

- tabel

- Mengambil

- bahwa

- Grafik

- mereka

- kemudian

- ini

- ancaman

- Melalui

- untuk

- hari ini

- puncak

- Top 10

- transfer

- Mentransfer

- Transformasi

- transformasi

- mengubah

- tutorial

- mengetik

- bawah

- pemahaman

- unik

- Meluncurkan

- menggunakan

- gunakan case

- bekas

- Pengguna

- menggunakan

- pengesahan

- nilai

- Mengunjungi

- berjalan

- walkthrough

- ingin

- Gudang

- we

- jaringan

- layanan web

- mingguan

- apakah

- SIAPA

- akan

- jendela

- dengan

- tanpa

- bekerja

- dunia

- kamu

- Anda

- Youtube

- zephyrnet.dll