Dengan Amazon ESDM 6.15, kami meluncurkan Formasi Danau AWS berbasis kontrol akses terperinci (FGAC) pada Open Table Formats (OTFs), termasuk Apache Hudi, Apache Iceberg, dan Delta lake. Hal ini memungkinkan Anda menyederhanakan keamanan dan tata kelola danau data transaksional dengan memberikan kontrol akses pada izin tingkat tabel, kolom, dan baris dengan pekerjaan Apache Spark Anda. Banyak perusahaan besar berupaya menggunakan data lake transaksional mereka untuk mendapatkan wawasan dan meningkatkan pengambilan keputusan. Anda dapat membangun arsitektur rumah danau menggunakan Amazon EMR yang terintegrasi dengan Lake Formation untuk FGAC. Kombinasi layanan ini memungkinkan Anda melakukan analisis data pada data lake transaksional Anda sambil memastikan akses yang aman dan terkendali.

Komponen server catatan Amazon EMR mendukung fungsionalitas pemfilteran data tingkat atribut tabel, kolom, baris, sel, dan bertingkat. Ini memperluas dukungan ke format Hive, Apache Hudi, Apache Iceberg, dan Delta lake untuk operasi membaca (termasuk perjalanan waktu dan kueri tambahan) dan menulis (pada pernyataan DML seperti INSERT). Selain itu, dengan versi 6.15, Amazon EMR memperkenalkan perlindungan kontrol akses untuk antarmuka web aplikasinya seperti Spark History Server pada klaster, Yarn Timeline Server, dan Yarn Resource Manager UI.

Dalam postingan ini, kami mendemonstrasikan cara mengimplementasikan FGAC Apache Hudi tabel menggunakan Amazon EMR yang terintegrasi dengan Lake Formation.

Kasus penggunaan danau data transaksi

Pelanggan Amazon EMR sering menggunakan Format Tabel Terbuka untuk mendukung transaksi ACID dan kebutuhan perjalanan waktu mereka di data lake. Dengan melestarikan versi historis, perjalanan waktu data lake memberikan manfaat seperti audit dan kepatuhan, pemulihan dan rollback data, analisis yang dapat direproduksi, dan eksplorasi data pada berbagai titik waktu.

Kasus penggunaan data lake transaksi populer lainnya adalah kueri tambahan. Kueri tambahan mengacu pada strategi kueri yang berfokus pada pemrosesan dan analisis hanya data baru atau yang diperbarui dalam data lake sejak kueri terakhir. Ide utama di balik kueri tambahan adalah menggunakan metadata atau mekanisme pelacakan perubahan untuk mengidentifikasi data baru atau data yang diubah sejak kueri terakhir. Dengan mengidentifikasi perubahan ini, mesin kueri dapat mengoptimalkan kueri untuk hanya memproses data yang relevan, sehingga mengurangi waktu pemrosesan dan kebutuhan sumber daya secara signifikan.

Ikhtisar solusi

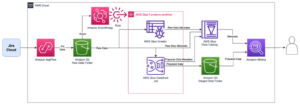

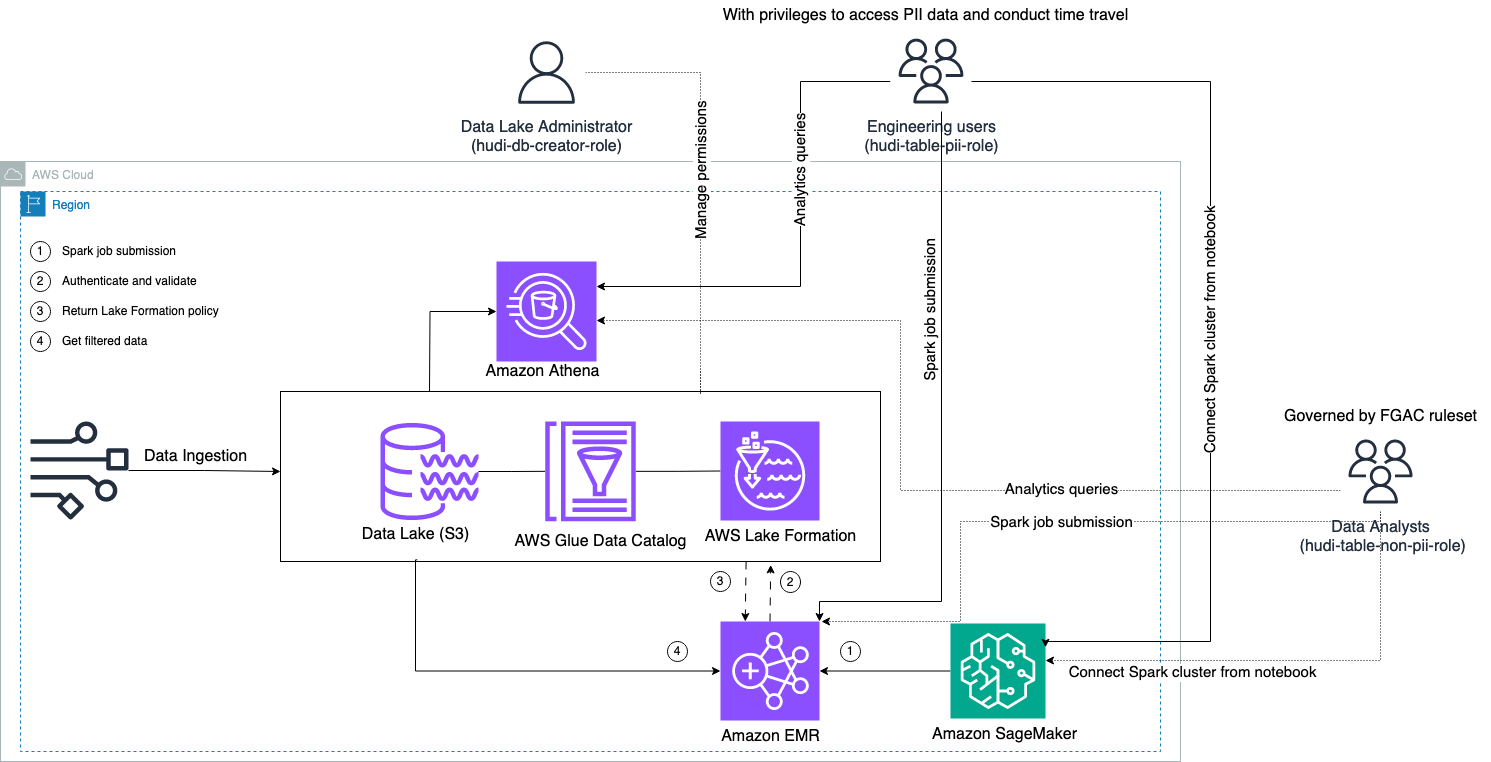

Dalam postingan ini, kami mendemonstrasikan cara mengimplementasikan FGAC pada tabel Apache Hudi menggunakan Amazon EMR Cloud komputasi elastis Amazon (Amazon EC2) terintegrasi dengan Lake Formation. Apache Hudi adalah kerangka kerja data lake transaksional sumber terbuka yang sangat menyederhanakan pemrosesan data tambahan dan pengembangan saluran data. Fitur FGAC baru ini mendukung semua OTF. Selain mendemonstrasikan dengan Hudi di sini, kami akan menindaklanjuti tabel OTF lainnya dengan blog lain. Kita gunakan laptop in Studio Amazon SageMaker untuk membaca dan menulis data Hudi melalui izin akses pengguna yang berbeda melalui cluster EMR. Hal ini mencerminkan skenario akses data di dunia nyata—misalnya, jika pengguna teknis memerlukan akses data penuh untuk memecahkan masalah pada platform data, sedangkan analis data mungkin hanya perlu mengakses sebagian dari data tersebut yang tidak berisi informasi identitas pribadi (PII). ). Mengintegrasikan dengan Danau Formasi melalui Peran waktu proses Amazon EMR selanjutnya memungkinkan Anda meningkatkan postur keamanan data dan menyederhanakan manajemen kontrol data untuk beban kerja Amazon EMR. Solusi ini memastikan lingkungan yang aman dan terkendali untuk akses data, memenuhi beragam kebutuhan dan persyaratan keamanan dari berbagai pengguna dan peran dalam suatu organisasi.

Diagram berikut menggambarkan arsitektur solusi.

Kami melakukan proses penyerapan data untuk memasukkan (memperbarui dan menyisipkan) kumpulan data Hudi ke Layanan Penyimpanan Sederhana Amazon (Amazon S3), dan pertahankan atau perbarui skema tabel di Lem AWS Katalog Data. Dengan nol pergerakan data, kita dapat menanyakan tabel Hudi yang diatur oleh Lake Formation melalui berbagai layanan AWS, seperti Amazon Athena, Amazon ESDM, dan Amazon SageMaker.

Saat pengguna mengirimkan pekerjaan Spark melalui titik akhir klaster EMR mana pun (EMR Steps, Livy, EMR Studio, dan SageMaker), Lake Formation memvalidasi hak istimewa mereka dan menginstruksikan klaster EMR untuk memfilter data sensitif seperti data PII.

Solusi ini memiliki tiga tipe pengguna berbeda dengan tingkat izin berbeda untuk mengakses data Hudi:

- peran-pencipta-hudi-db – Ini digunakan oleh administrator data lake yang memiliki hak istimewa untuk melakukan operasi DDL seperti membuat, memodifikasi, dan menghapus objek database. Mereka dapat menentukan aturan pemfilteran data di Lake Formation untuk kontrol akses data tingkat baris dan kolom. Aturan FGAC ini memastikan bahwa data lake aman dan memenuhi peraturan privasi data yang disyaratkan.

- peran-hudi-tabel-pii – Ini digunakan oleh pengguna teknik. Pengguna teknik mampu melakukan perjalanan waktu dan kueri tambahan pada Copy-on-Write (CoW) dan Merge-on-Read (MoR). Mereka juga memiliki hak istimewa untuk mengakses data PII berdasarkan stempel waktu apa pun.

- peran-hudi-tabel-non-pii – Ini digunakan oleh analis data. Hak akses data analis data diatur oleh aturan resmi FGAC yang dikendalikan oleh administrator data lake. Mereka tidak memiliki visibilitas pada kolom yang berisi data PII seperti nama dan alamat. Selain itu, mereka tidak dapat mengakses deretan data yang tidak memenuhi ketentuan tertentu. Misalnya, pengguna hanya dapat mengakses baris data milik negaranya.

Prasyarat

Anda dapat mendownload ketiga buku catatan yang digunakan dalam postingan ini dari GitHub repo.

Sebelum Anda menerapkan solusi, pastikan Anda memiliki hal berikut:

Selesaikan langkah-langkah berikut untuk menyiapkan izin Anda:

- Masuk ke akun AWS Anda dengan pengguna IAM admin Anda.

Pastikan Anda berada dius-east-1Wilayah.

- Buat bucket S3 di

us-east-1Wilayah (misalnya,emr-fgac-hudi-us-east-1-<ACCOUNT ID>).

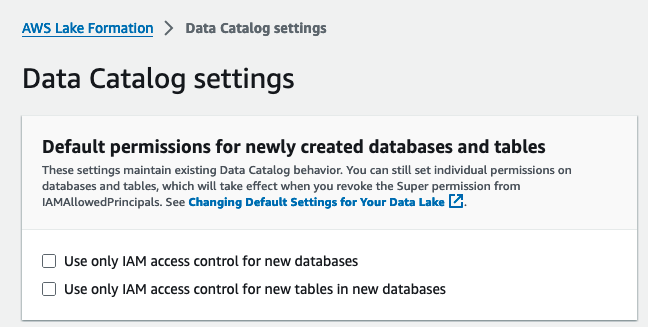

Selanjutnya, kita aktifkan Formasi Danau dengan mengubah model izin default.

- Masuk ke konsol Lake Formation sebagai pengguna administrator.

- Pilih Setelan Katalog Data bawah Administrasi di panel navigasi.

- Bawah Izin default untuk database dan tabel yang baru dibuat, batal pilih Gunakan hanya kontrol akses IAM untuk database baru dan Gunakan hanya kontrol akses IAM untuk tabel baru di database baru.

- Pilih Save.

Alternatifnya, Anda perlu mencabut IAMAallowedPrincipals pada sumber daya (database dan tabel) yang dibuat jika Anda memulai Lake Formation dengan opsi default.

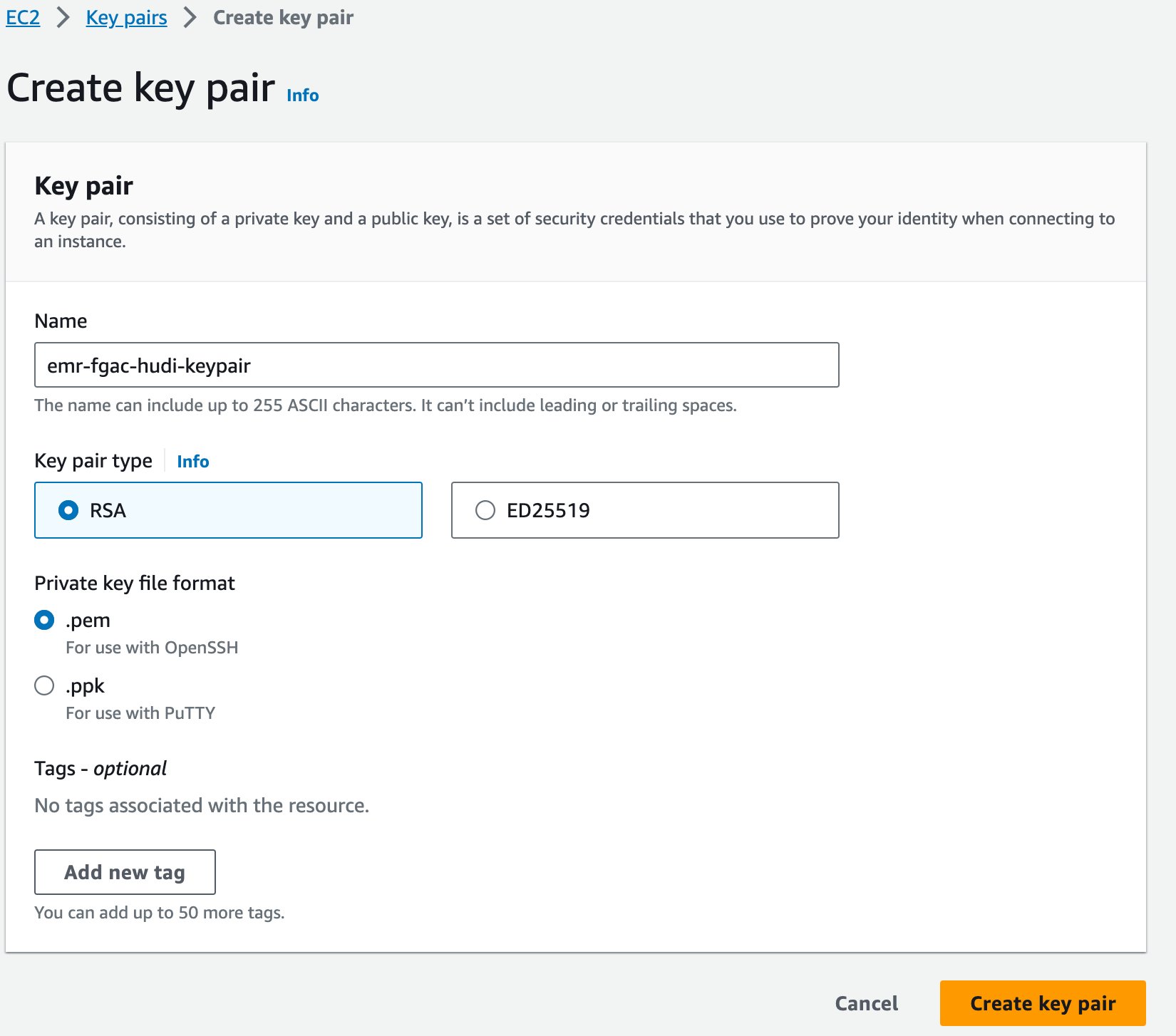

Terakhir, kami membuat pasangan kunci untuk Amazon EMR.

- Di konsol Amazon EC2, pilih Pasangan kunci di panel navigasi.

- Pilih Buat pasangan kunci.

- Untuk Nama, masukkan nama (misalnya

emr-fgac-hudi-keypair). - Pilih Buat pasangan kunci.

Pasangan kunci yang dihasilkan (untuk posting ini, emr-fgac-hudi-keypair.pem) akan disimpan ke komputer lokal Anda.

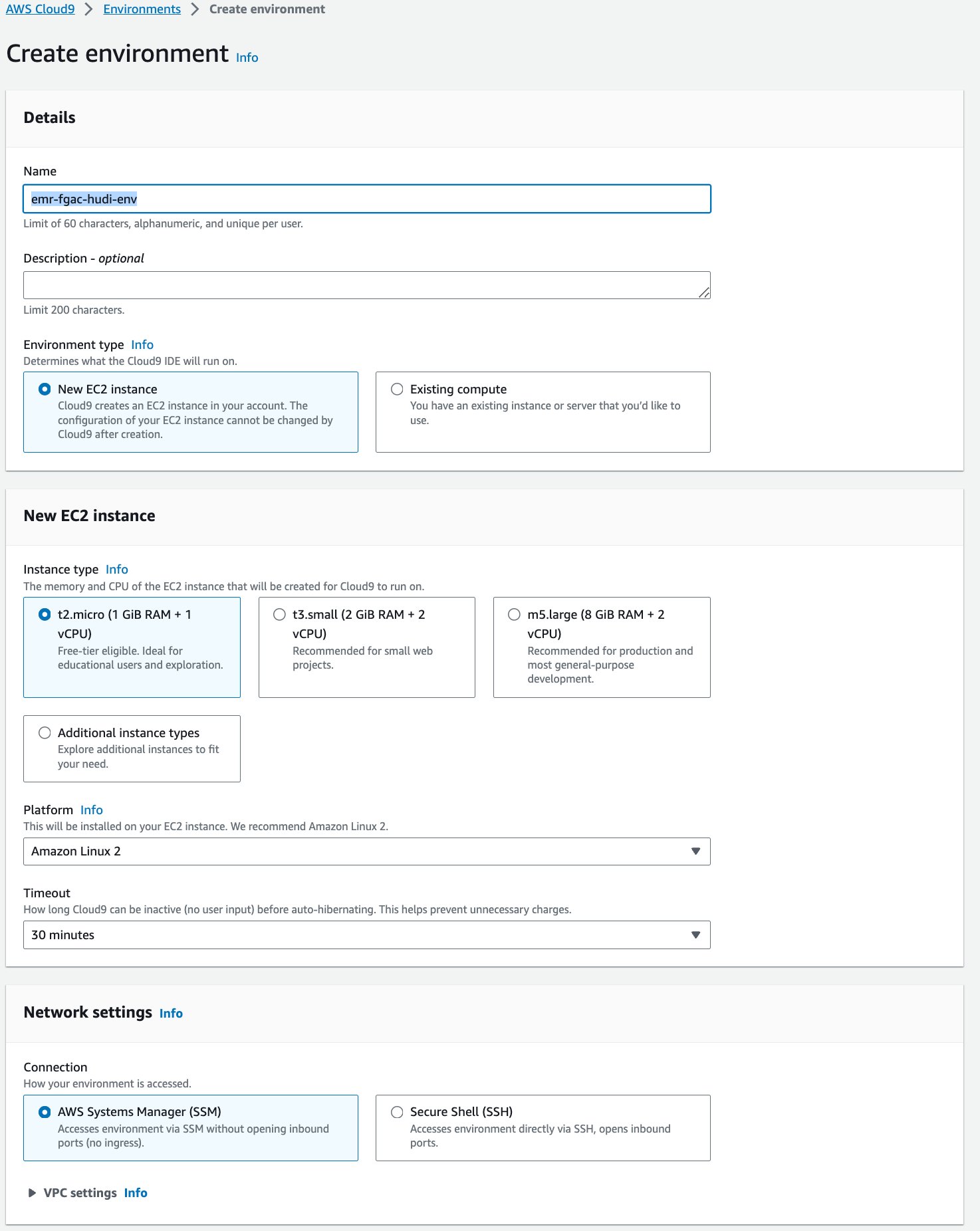

Selanjutnya, kita membuat sebuah AWS Cloud9 lingkungan pengembangan interaktif (IDE).

- Di konsol AWS Cloud9, pilih Lingkungan di panel navigasi.

- Pilih Ciptakan lingkungan.

- Untuk Namamasukkan nama (misalnya,

emr-fgac-hudi-env). - Pertahankan pengaturan lainnya sebagai default.

- Pilih membuat.

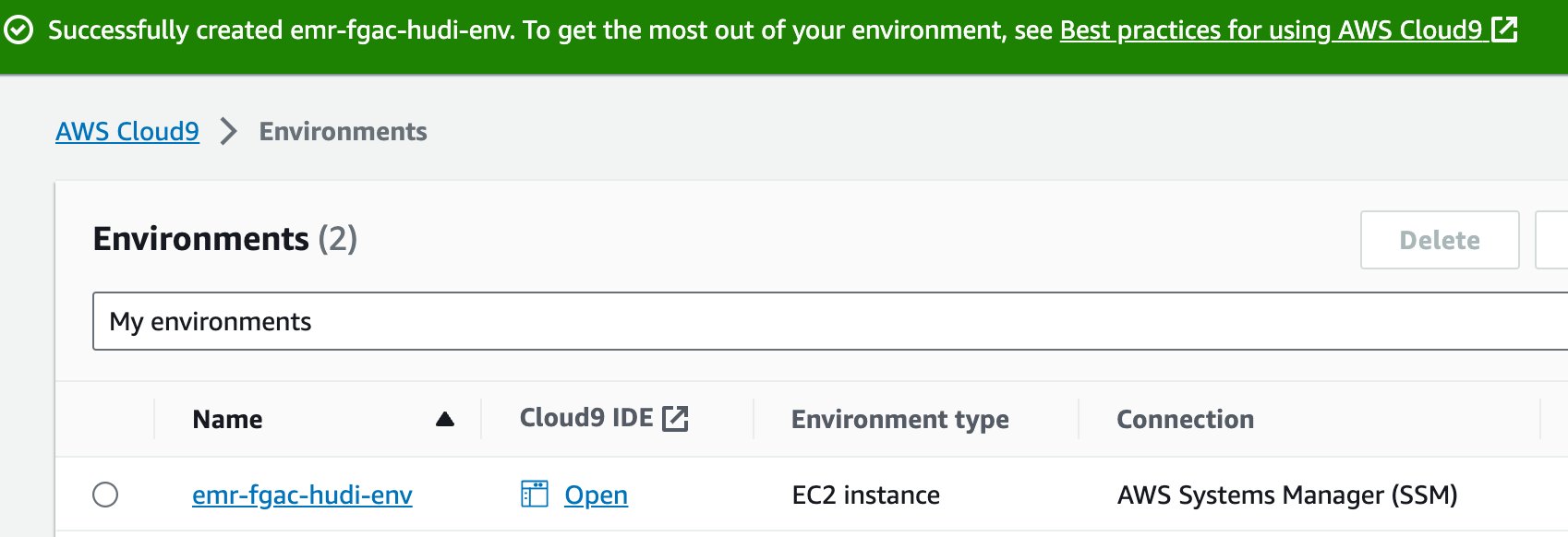

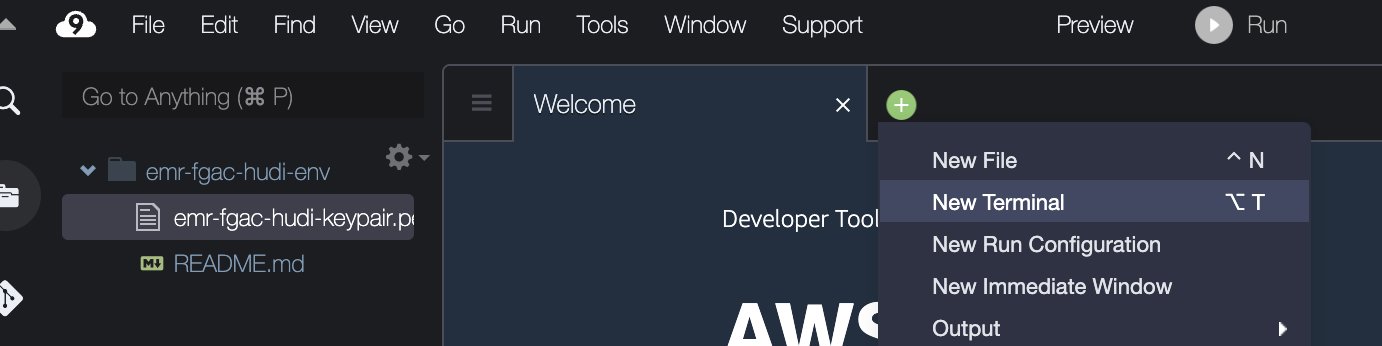

- Ketika IDE sudah siap, pilih Open untuk membukanya

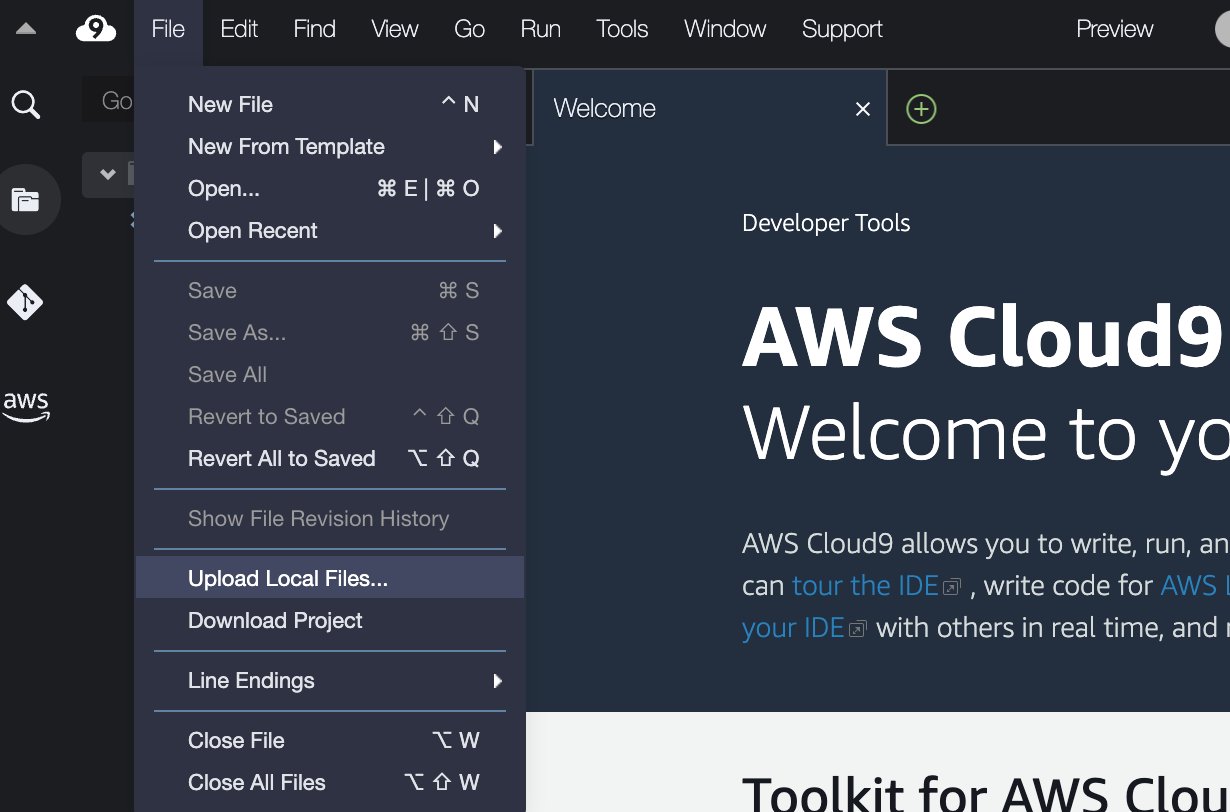

- Di AWS Cloud9 IDE, di File menu, pilih Unggah File Lokal.

- Unggah file pasangan kunci (

emr-fgac-hudi-keypair.pem). - Pilih tanda plus dan pilih Terminal Baru.

- Di terminal, masukkan baris perintah berikut:

Perhatikan bahwa kode contoh adalah bukti konsep untuk tujuan demonstrasi saja. Untuk sistem produksi, gunakan otoritas sertifikasi (CA) tepercaya untuk menerbitkan sertifikat. Mengacu pada Memberikan sertifikat untuk mengenkripsi data dalam transit dengan enkripsi Amazon EMR untuk rincian.

Terapkan solusi melalui AWS CloudFormation

Kami menyediakan Formasi AWS Cloud templat yang secara otomatis menyiapkan layanan dan komponen berikut:

- Bucket S3 untuk data lake. Ini berisi contoh kumpulan data TPC-DS.

- Klaster EMR dengan konfigurasi keamanan dan DNS publik diaktifkan.

- Peran IAM runtime EMR dengan izin terperinci Lake Formation:

- -hudi-db-peran pencipta – Peran ini digunakan untuk membuat database dan tabel Apache Hudi.

- -hudi-table-pii-role – Peran ini memberikan izin untuk menanyakan semua kolom tabel Hudi, termasuk kolom dengan PII.

- -hudi-table-non-pii-role – Peran ini memberikan izin untuk menanyakan tabel Hudi yang telah memfilter kolom PII menurut Lake Formation.

- Peran eksekusi SageMaker Studio yang memungkinkan pengguna mengambil peran runtime EMR yang sesuai.

- Sumber daya jaringan seperti VPC, subnet, dan grup keamanan.

Selesaikan langkah-langkah berikut untuk menyebarkan sumber daya:

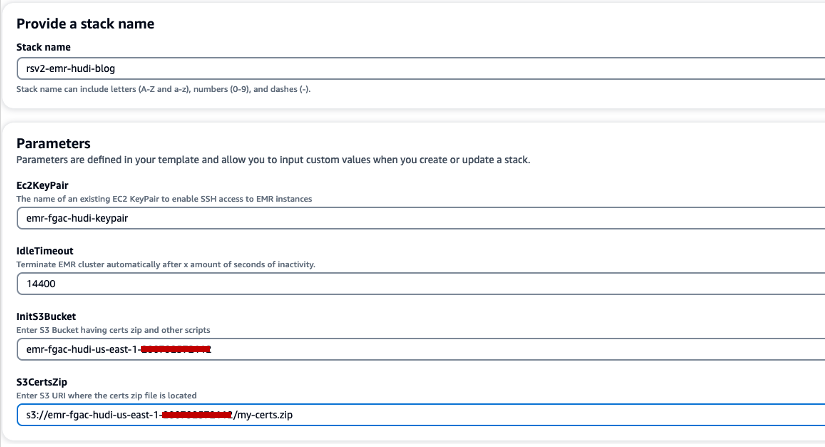

- Pilih Buat tumpukan dengan cepat untuk meluncurkan tumpukan CloudFormation.

- Untuk Nama tumpukan, masukkan nama tumpukan (misalnya,

rsv2-emr-hudi-blog). - Untuk Ec2KeyPair, masukkan nama pasangan kunci Anda.

- Untuk Waktu Idle habis, masukkan waktu tunggu menganggur untuk klaster EMR guna menghindari pembayaran untuk klaster saat tidak digunakan.

- Untuk InitS3Bucket, masukkan nama bucket S3 yang Anda buat untuk menyimpan file .zip sertifikat enkripsi Amazon EMR.

- Untuk S3CertsZip, masukkan URI S3 dari file .zip sertifikat enkripsi Amazon EMR.

- Pilih Saya mengakui bahwa AWS CloudFormation dapat membuat sumber daya IAM dengan nama khusus.

- Pilih Buat tumpukan.

Penyebaran tumpukan CloudFormation membutuhkan waktu sekitar 10 menit.

Siapkan Lake Formation untuk integrasi Amazon EMR

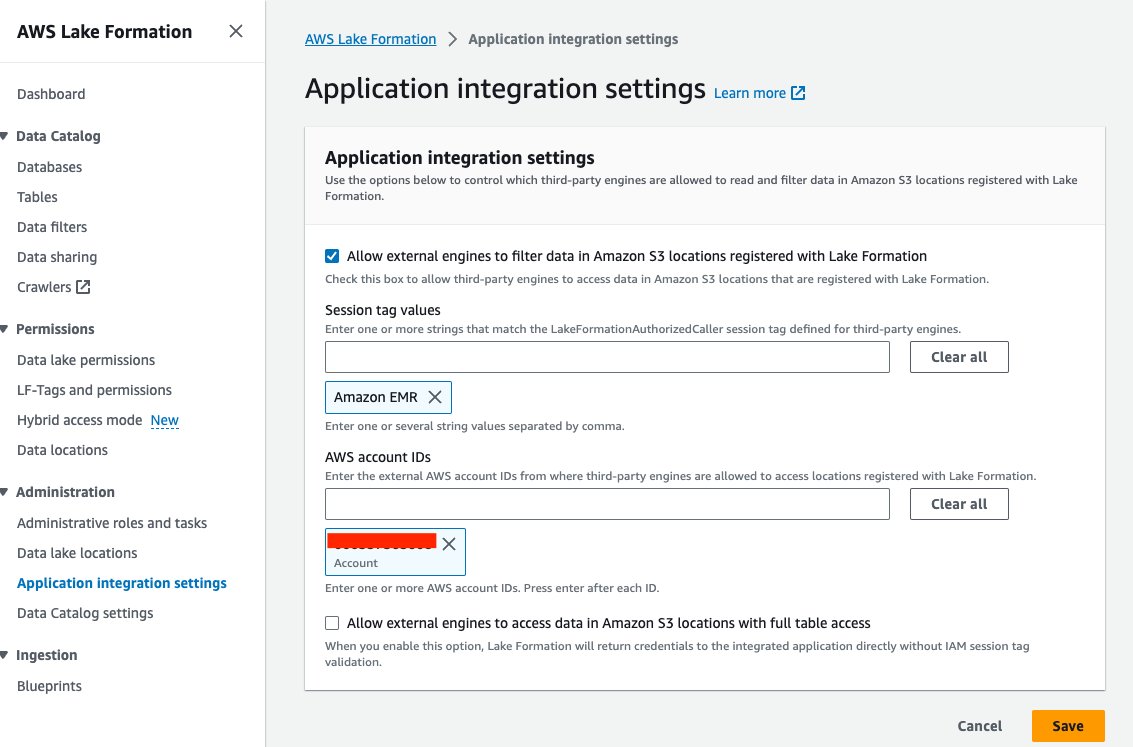

Selesaikan langkah-langkah berikut untuk menyiapkan Formasi Danau:

- Di konsol Formasi Danau, pilih Pengaturan integrasi aplikasi bawah Administrasi di panel navigasi.

- Pilih Izinkan mesin eksternal memfilter data di lokasi Amazon S3 yang terdaftar di Lake Formation.

- Pilih Amazon ESDM untuk Nilai tag sesi.

- Masukkan ID akun AWS Anda untuk ID akun AWS.

- Pilih Save.

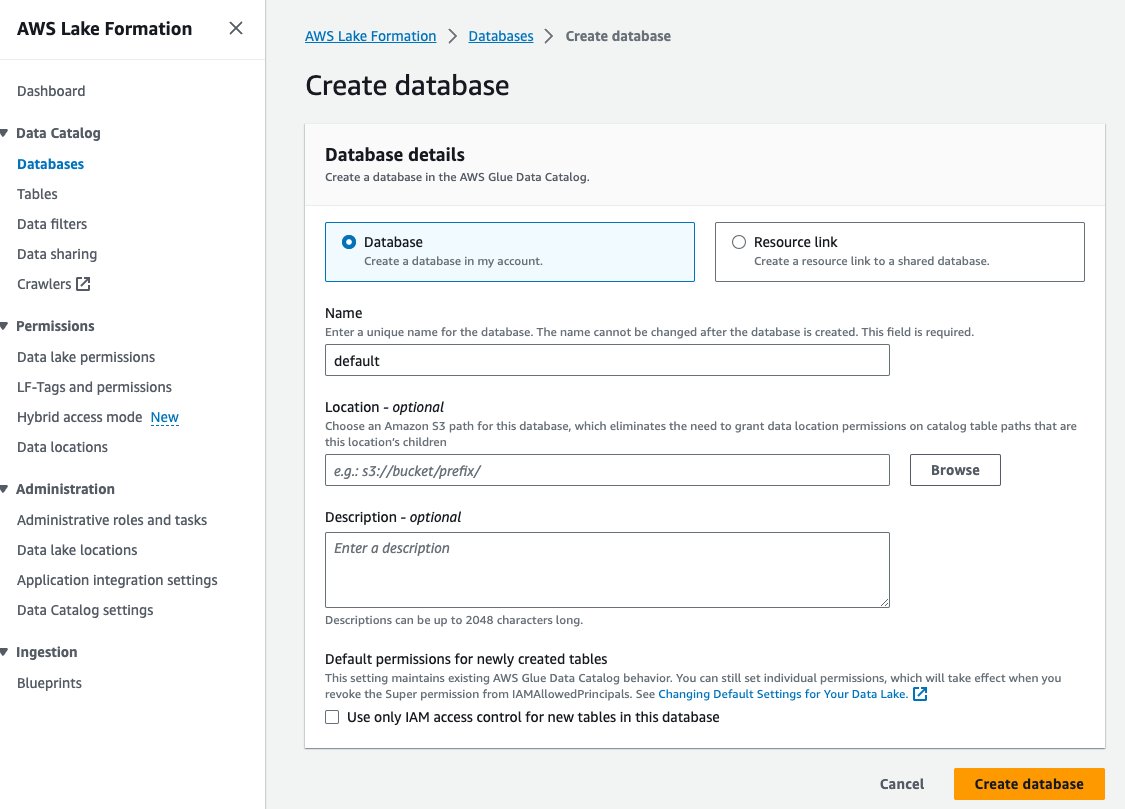

- Pilih Database bawah Katalog Data di panel navigasi.

- Pilih Buat database.

- Untuk Nama, masukkan default.

- Pilih Buat database.

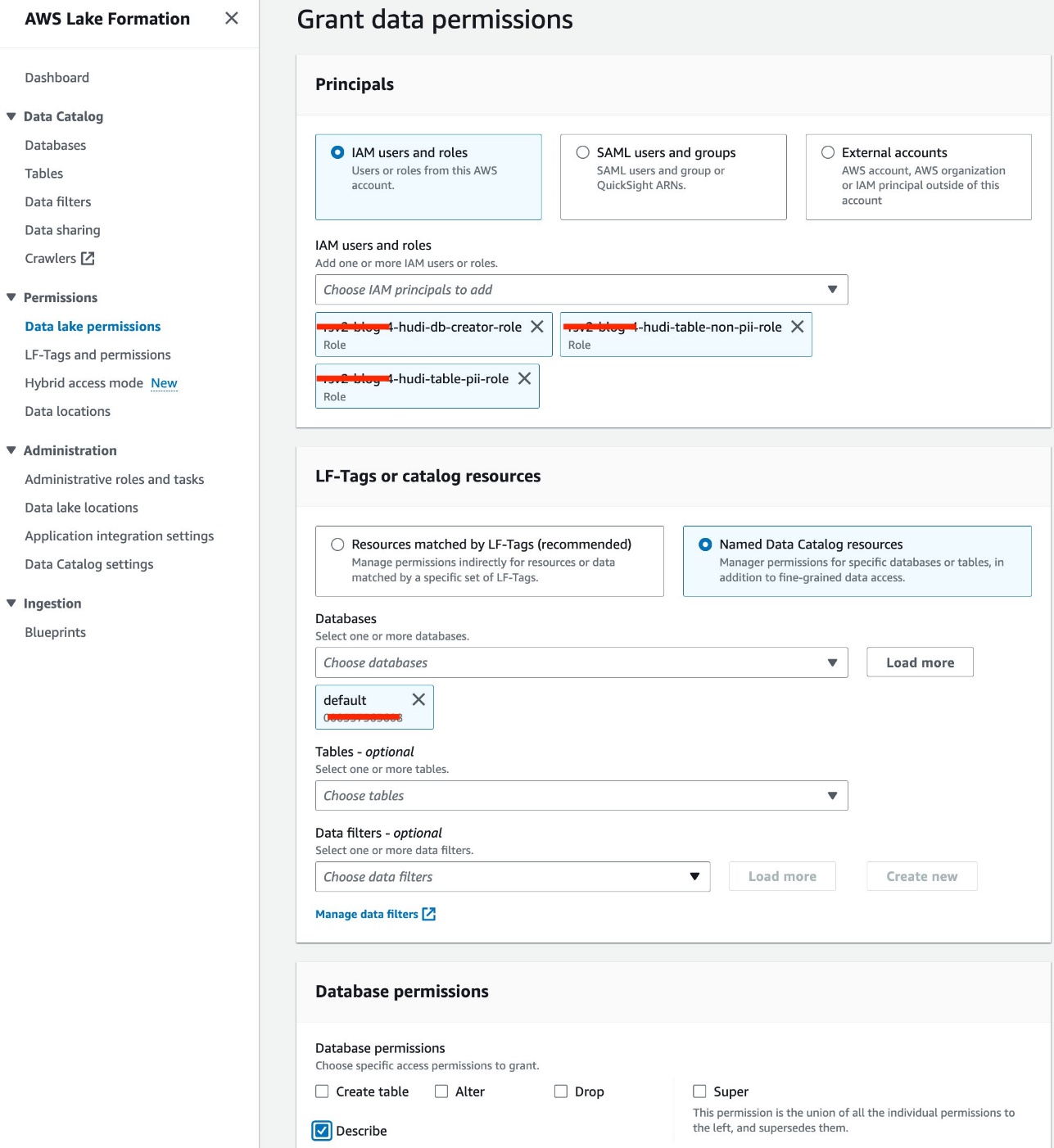

- Pilih Izin danau data bawah izin di panel navigasi.

- Pilih Hibah.

- Pilih Pengguna dan peran IAM.

- Pilih peran IAM Anda.

- Untuk Database, pilih bawaan.

- Untuk Izin basis data, pilih Menggambarkan.

- Pilih Hibah.

Salin file Hudi JAR ke Amazon EMR HDFS

Untuk gunakan Hudi dengan notebook Jupyter, Anda perlu menyelesaikan langkah-langkah berikut untuk klaster EMR, termasuk menyalin file Hudi JAR dari direktori lokal Amazon EMR ke penyimpanan HDFS-nya, sehingga Anda dapat mengonfigurasi sesi Spark untuk menggunakan Hudi:

- Otorisasi lalu lintas SSH masuk (pelabuhan 22).

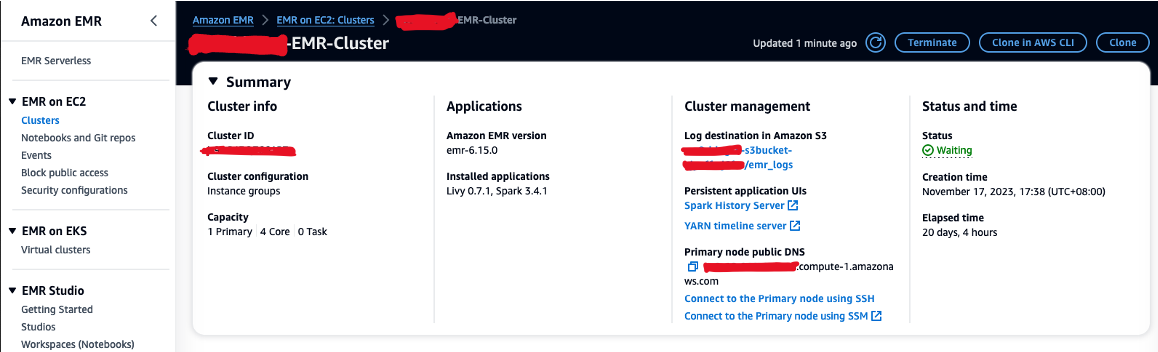

- Salin nilai untuk DNS publik simpul utama (misalnya, ec2-XXX-XXX-XXX-XXX.compute-1.amazonaws.com) dari klaster EMR Kesimpulan bagian.

- Kembali ke terminal AWS Cloud9 sebelumnya yang Anda gunakan untuk membuat key pair EC2.

- Jalankan perintah berikut untuk SSH ke node utama EMR. Ganti placeholder dengan nama host DNS EMR Anda:

- Jalankan perintah berikut untuk menyalin file Hudi JAR ke HDFS:

Buat database dan tabel Hudi di Lake Formation

Sekarang kita siap membuat database dan tabel Hudi dengan FGAC yang diaktifkan oleh peran runtime EMR. Itu Peran runtime EMR adalah IAM role yang dapat Anda tentukan saat mengirimkan pekerjaan atau kueri ke klaster EMR.

Berikan izin kepada pembuat basis data

Pertama, mari kita berikan izin kepada pembuat database Lake Formation<STACK-NAME>-hudi-db-creator-role:

- Masuk ke akun AWS Anda sebagai administrator.

- Di konsol Formasi Danau, pilih Peran dan tugas administratif bawah Administrasi di panel navigasi.

- Konfirmasikan bahwa pengguna login AWS Anda telah ditambahkan sebagai administrator data lake.

- Dalam majalah Pembuat basis data bagian, pilih Hibah.

- Untuk Pengguna dan peran IAM, pilih

<STACK-NAME>-hudi-db-creator-role. - Untuk Izin katalog, pilih Buat database.

- Pilih Hibah.

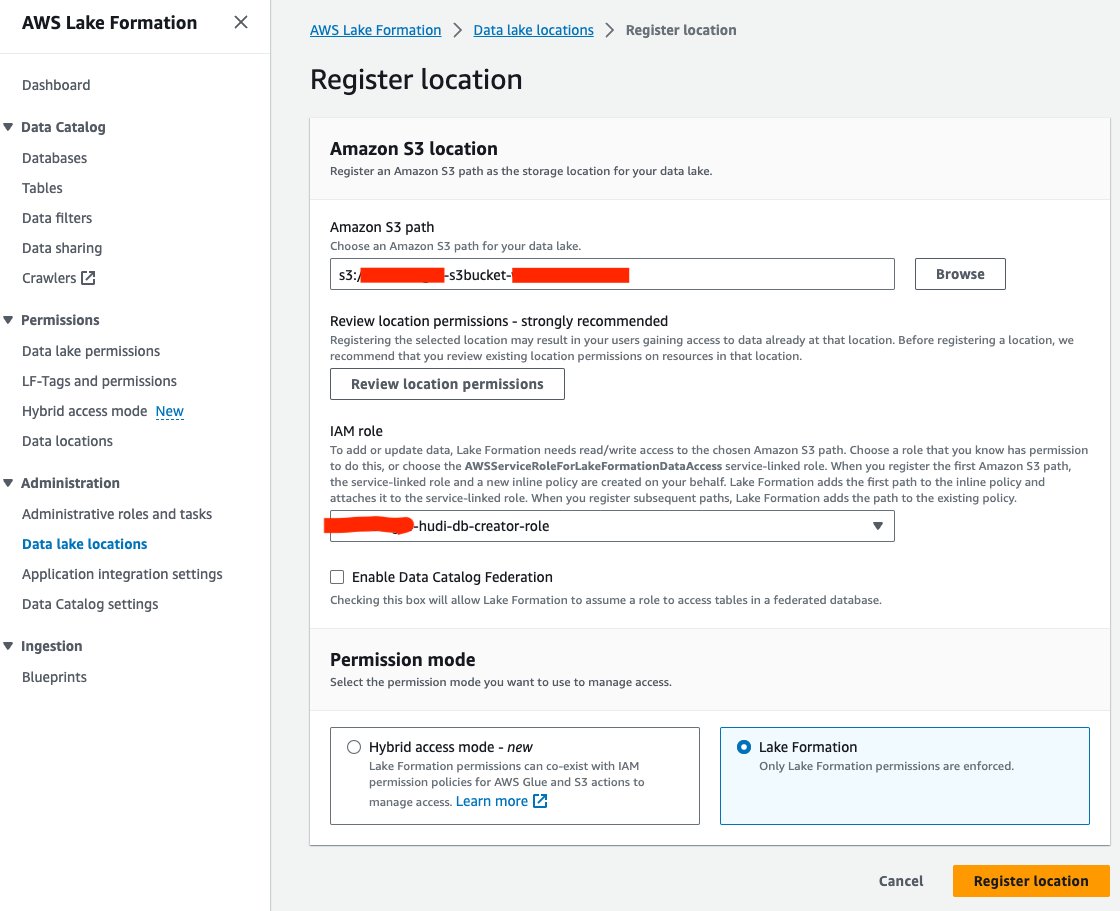

Daftarkan lokasi data lake

Selanjutnya mari kita daftarkan lokasi data lake S3 di Lake Formation:

- Di konsol Formasi Danau, pilih Lokasi data lake bawah Administrasi di panel navigasi.

- Pilih Daftarkan lokasi.

- Untuk Jalur Amazon S3, Pilih Browse dan pilih bucket data lake S3. (

<STACK_NAME>s3bucket-XXXXXXX) dibuat dari tumpukan CloudFormation. - Untuk Peran IAM, pilih

<STACK-NAME>-hudi-db-creator-role. - Untuk Mode izin, pilih Formasi Danau.

- Pilih Daftarkan lokasi.

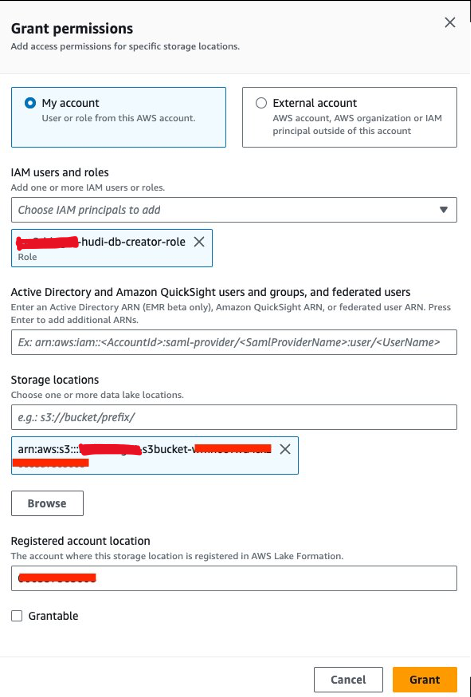

Berikan izin lokasi data

Selanjutnya, kita perlu memberikan hibah<STACK-NAME>-hudi-db-creator-roleizin lokasi data:

- Di konsol Formasi Danau, pilih Lokasi data bawah izin di panel navigasi.

- Pilih Hibah.

- Untuk Pengguna dan peran IAM, pilih

<STACK-NAME>-hudi-db-creator-role. - Untuk Lokasi penyimpanan, masukkan ember S3 (

<STACK_NAME>-s3bucket-XXXXXXX). - Pilih Hibah.

Hubungkan ke klaster EMR

Sekarang, mari gunakan notebook Jupyter di SageMaker Studio untuk terhubung ke klaster EMR dengan peran runtime EMR pembuat database:

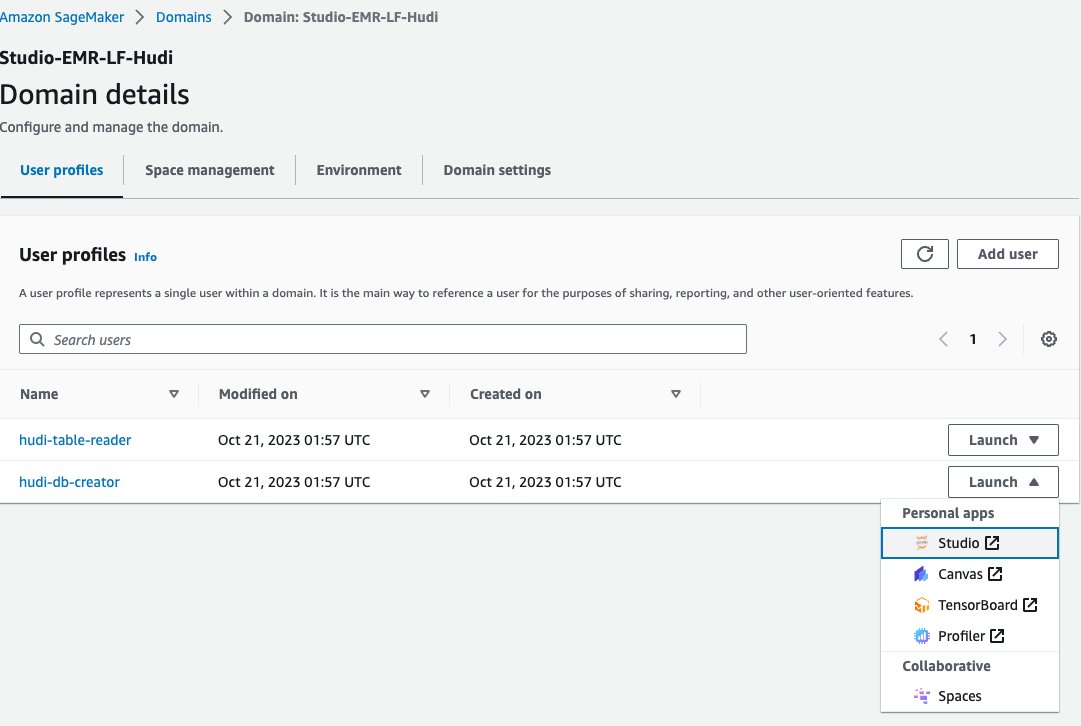

- Di konsol SageMaker, pilih Domain di panel navigasi.

- Pilih domainnya

<STACK-NAME>-Studio-EMR-LF-Hudi. - pada Launch menu di sebelah profil pengguna

<STACK-NAME>-hudi-db-creator, pilih studio.

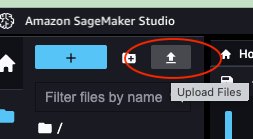

- Unduh buku catatan rsv2-hudi-db-pencipta-notebook.

- Pilih ikon unggah.

- Pilih buku catatan Jupyter yang diunduh dan pilih Open.

- Buka buku catatan yang diunggah.

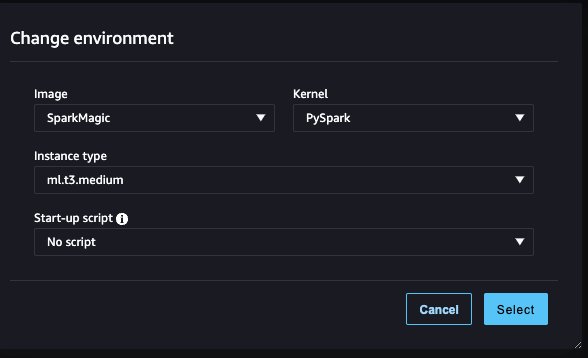

- Untuk Gambar, pilih Percikan Ajaib.

- Untuk Inti, pilih PySpark.

- Biarkan konfigurasi lainnya sebagai default dan pilih Pilih.

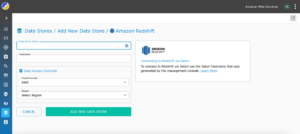

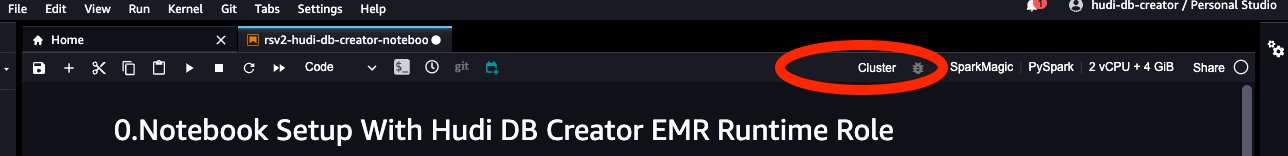

- Pilih Kelompok untuk terhubung ke klaster EMR.

- Pilih EMR pada klaster EC2 (

<STACK-NAME>-EMR-Cluster) dibuat dengan tumpukan CloudFormation. - Pilih Terhubung.

- Untuk Peran eksekusi ESDM, pilih

<STACK-NAME>-hudi-db-creator-role. - Pilih Terhubung.

Membuat database dan tabel

Sekarang Anda dapat mengikuti langkah-langkah di buku catatan untuk membuat database dan tabel Hudi. Langkah-langkah utamanya adalah sebagai berikut:

- Saat Anda memulai notebook, konfigurasikan

“spark.sql.catalog.spark_catalog.lf.managed":"true"untuk memberi tahu Spark bahwa spark_catalog dilindungi oleh Lake Formation. - Buat tabel Hudi menggunakan Spark SQL berikut.

- Masukkan data dari tabel sumber ke tabel Hudi.

- Masukkan data lagi ke dalam tabel Hudi.

Kueri tabel Hudi melalui Lake Formation dengan FGAC

Setelah Anda membuat database dan tabel Hudi, Anda siap untuk mengkueri tabel menggunakan kontrol akses terperinci dengan Lake Formation. Kami telah membuat dua jenis tabel Hudi: Copy-On-Write (COW) dan Merge-On-Read (MOR). Tabel COW menyimpan data dalam format kolom (Parket), dan setiap pembaruan membuat versi file baru selama penulisan. Ini berarti bahwa untuk setiap pembaruan, Hudi menulis ulang seluruh file, yang bisa lebih banyak menggunakan sumber daya namun memberikan kinerja baca yang lebih cepat. MOR, di sisi lain, diperkenalkan untuk kasus-kasus di mana COW mungkin tidak optimal, khususnya untuk beban kerja tulis atau perubahan yang berat. Dalam tabel MOR, setiap kali ada pembaruan, Hudi hanya menulis baris untuk rekaman yang diubah, sehingga mengurangi biaya dan memungkinkan penulisan dengan latensi rendah. Namun, performa baca mungkin lebih lambat dibandingkan dengan tabel COW.

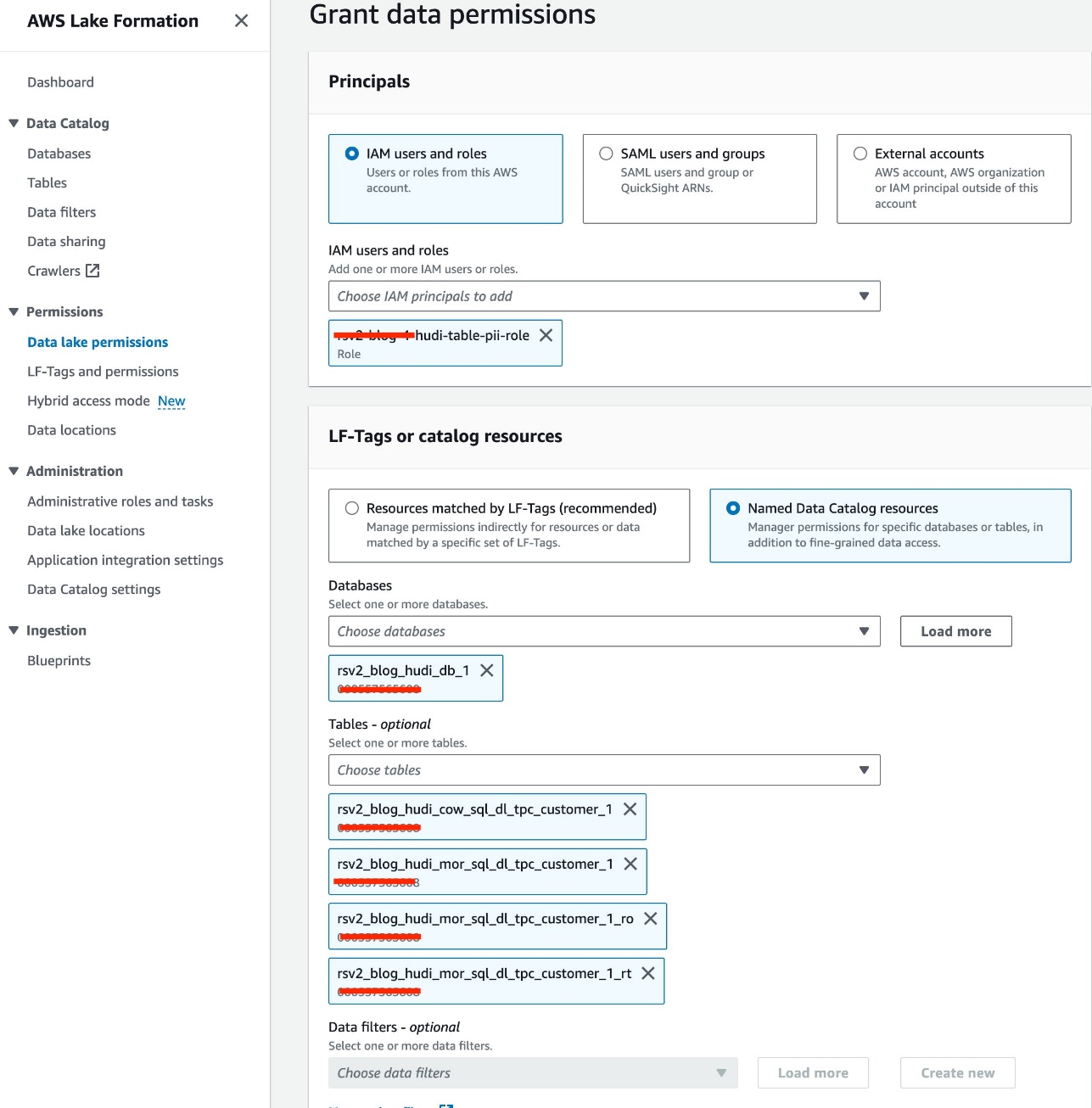

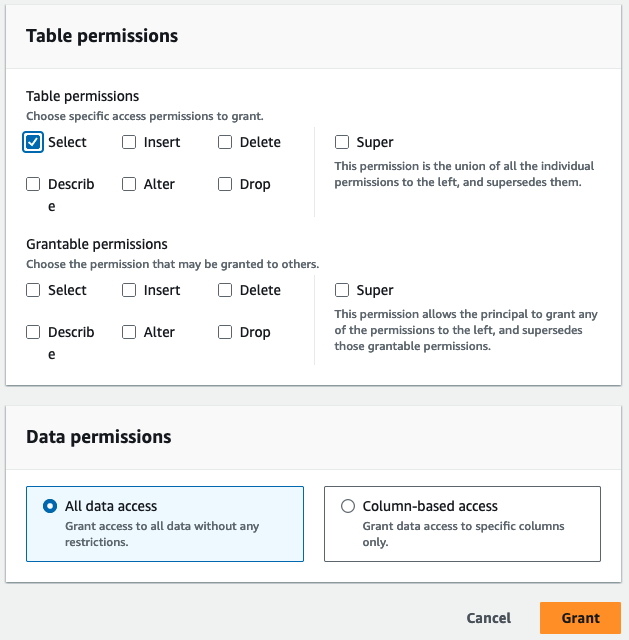

Berikan izin akses tabel

Kami menggunakan peran IAM<STACK-NAME>-hudi-table-pii-roleuntuk menanyakan Hudi COW dan MOR yang berisi kolom PII. Kami pertama-tama memberikan izin akses tabel melalui Lake Formation:

- Di konsol Formasi Danau, pilih Izin danau data bawah izin di panel navigasi.

- Pilih Hibah.

- Pilih

<STACK-NAME>-hudi-table-pii-roleuntuk Pengguna dan peran IAM. - Pilih

rsv2_blog_hudi_db_1basis data untuk Database. - Untuk Meja, pilih empat tabel Hudi yang Anda buat di notebook Jupyter.

- Untuk Izin tabel, pilih Pilih.

- Pilih Hibah.

Kolom PII kueri

Sekarang Anda siap menjalankan buku catatan untuk menanyakan tabel Hudi. Mari ikuti langkah serupa pada bagian sebelumnya untuk menjalankan notebook di SageMaker Studio:

- Di konsol SageMaker, navigasikan ke

<STACK-NAME>-Studio-EMR-LF-Hudidomain. - pada Launch menu di sebelah

<STACK-NAME>-hudi-table-readerprofil pengguna, pilih studio. - Unggah buku catatan yang diunduh rsv2-hudi-tabel-pii-reader-notebook.

- Buka buku catatan yang diunggah.

- Ulangi langkah-langkah penyiapan buku catatan dan sambungkan ke klaster EMR yang sama, tetapi gunakan peran tersebut

<STACK-NAME>-hudi-table-pii-role.

Pada tahap saat ini, klaster EMR yang mendukung FGAC perlu melakukan kueri pada kolom waktu penerapan Hudi untuk melakukan kueri tambahan dan perjalanan waktu. Itu tidak mendukung sintaks "cap waktu pada" Spark dan Spark.read(). Kami secara aktif berupaya menggabungkan dukungan untuk kedua tindakan tersebut dalam rilis Amazon EMR mendatang dengan FGAC diaktifkan.

Anda sekarang dapat mengikuti langkah-langkah di buku catatan. Berikut adalah beberapa langkah yang disorot:

- Jalankan kueri snapshot.

- Jalankan kueri tambahan.

- Jalankan kueri perjalanan waktu.

- Jalankan kueri tabel MOR yang dioptimalkan untuk dibaca dan real-time.

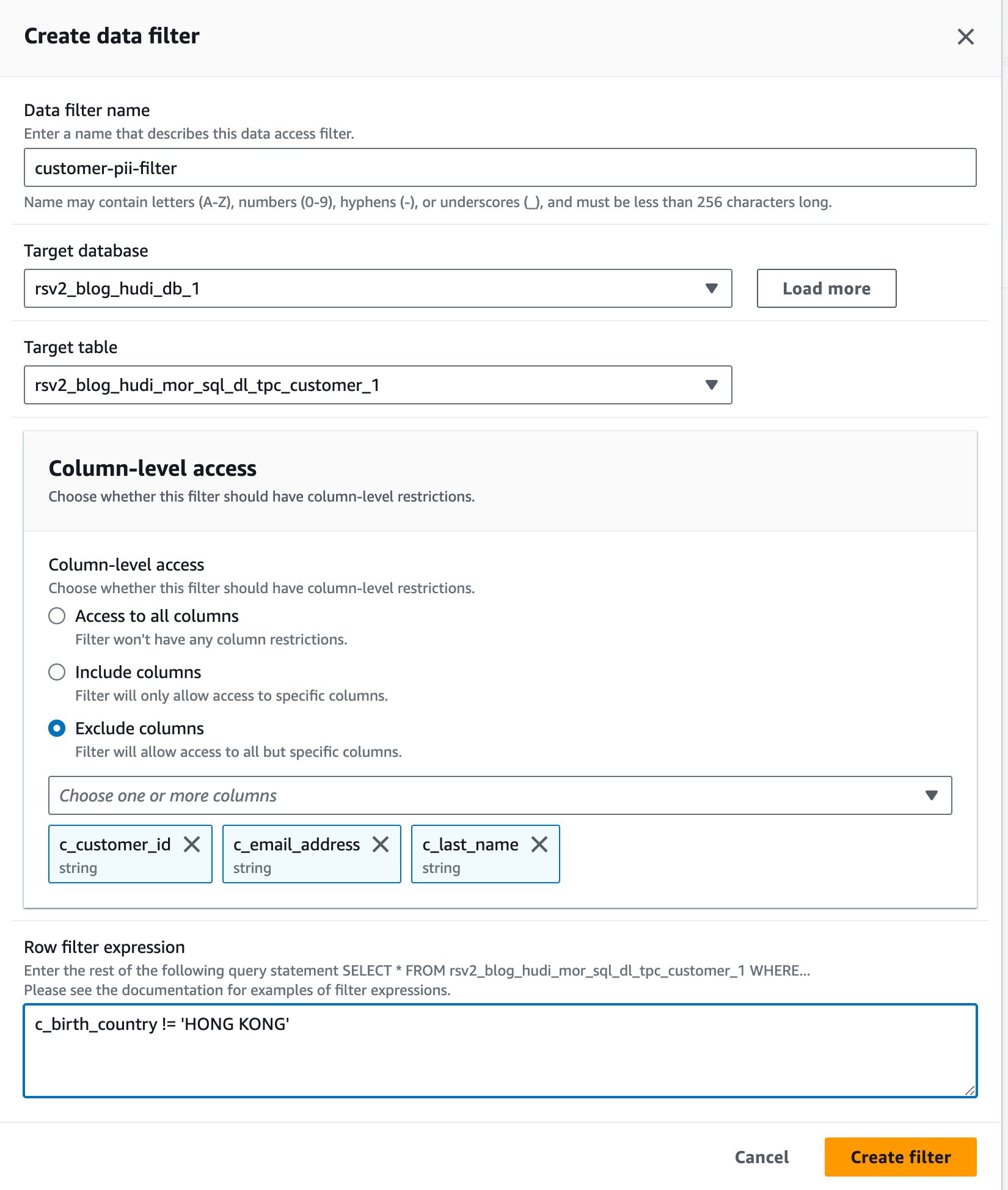

Kueri tabel Hudi dengan filter data tingkat kolom dan tingkat baris

Kami menggunakan peran IAM<STACK-NAME>-hudi-table-non-pii-roleuntuk menanyakan tabel Hudi. Peran ini tidak diperbolehkan untuk menanyakan kolom apa pun yang berisi PII. Kami menggunakan filter data tingkat kolom dan tingkat baris Lake Formation untuk menerapkan kontrol akses terperinci:

- Di konsol Formasi Danau, pilih Filter data bawah Katalog Data di panel navigasi.

- Pilih Buat filter baru.

- Untuk Nama filter data, Masuk

customer-pii-filter. - Pilih

rsv2_blog_hudi_db_1untuk Basis data sasaran. - Pilih

rsv2_blog_hudi_mor_sql_dl_customer_1untuk Tabel target. - Pilih Kecualikan kolom Dan pilih

c_customer_id,c_email_address, danc_last_namekolom. - Enter

c_birth_country != 'HONG KONG'untuk Ekspresi filter baris. - Pilih Buat filter.

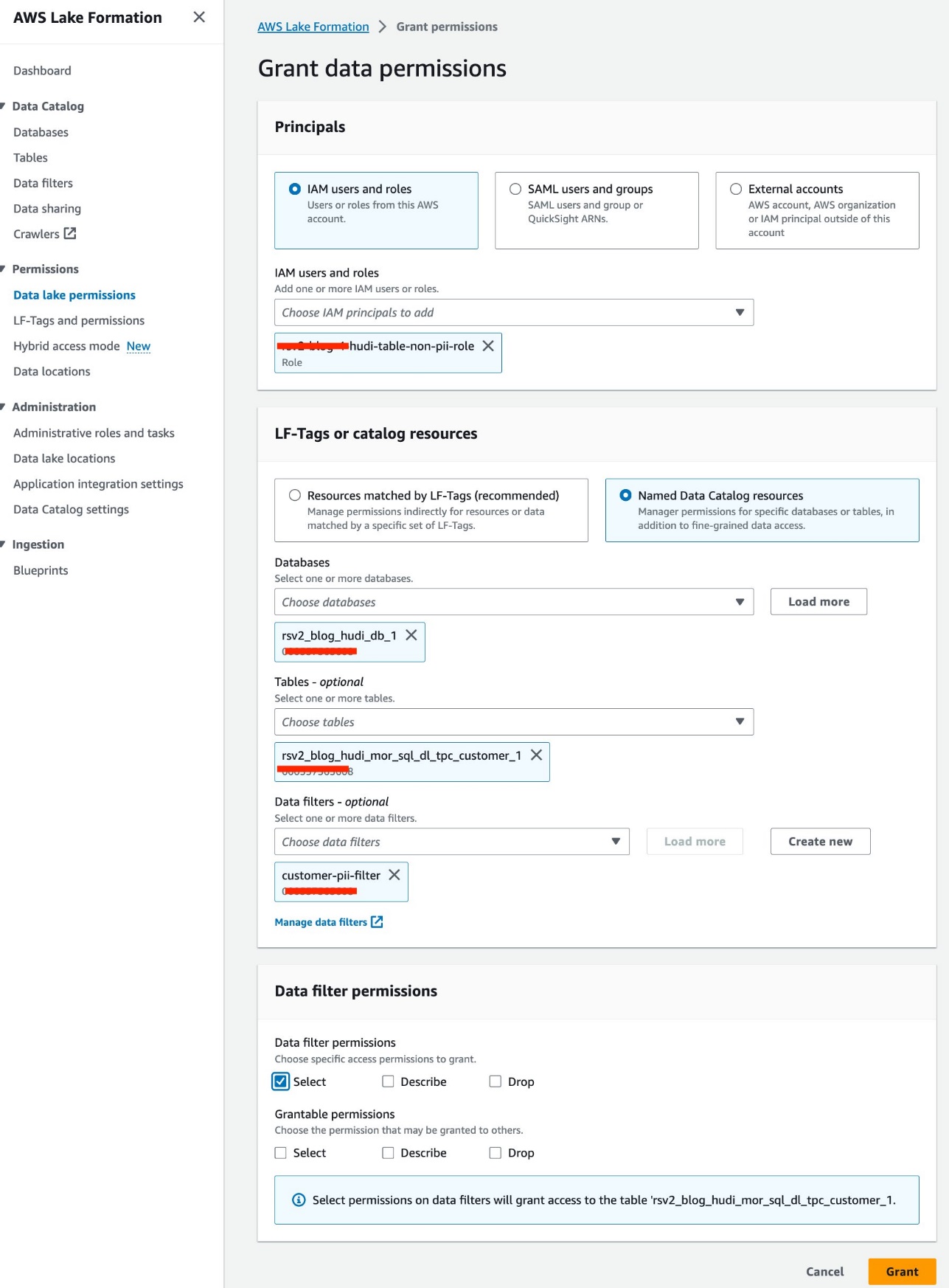

- Pilih Izin danau data bawah izin di panel navigasi.

- Pilih Hibah.

- Pilih

<STACK-NAME>-hudi-table-non-pii-roleuntuk Pengguna dan peran IAM. - Pilih

rsv2_blog_hudi_db_1untuk Database. - Pilih

rsv2_blog_hudi_mor_sql_dl_tpc_customer_1untuk Meja. - Pilih

customer-pii-filteruntuk Filter data. - Untuk Izin filter data, pilih Pilih.

- Pilih Hibah.

Mari ikuti langkah serupa untuk menjalankan notebook di SageMaker Studio:

- Di konsol SageMaker, navigasikan ke domain

Studio-EMR-LF-Hudi. - pada Launch menu untuk

hudi-table-readerprofil pengguna, pilih studio. - Unggah buku catatan yang diunduh rsv2-hudi-tabel-non-pii-reader-notebook Dan pilihlah Open.

- Ulangi langkah-langkah penyiapan buku catatan dan sambungkan ke klaster EMR yang sama, tetapi pilih peran

<STACK-NAME>-hudi-table-non-pii-role.

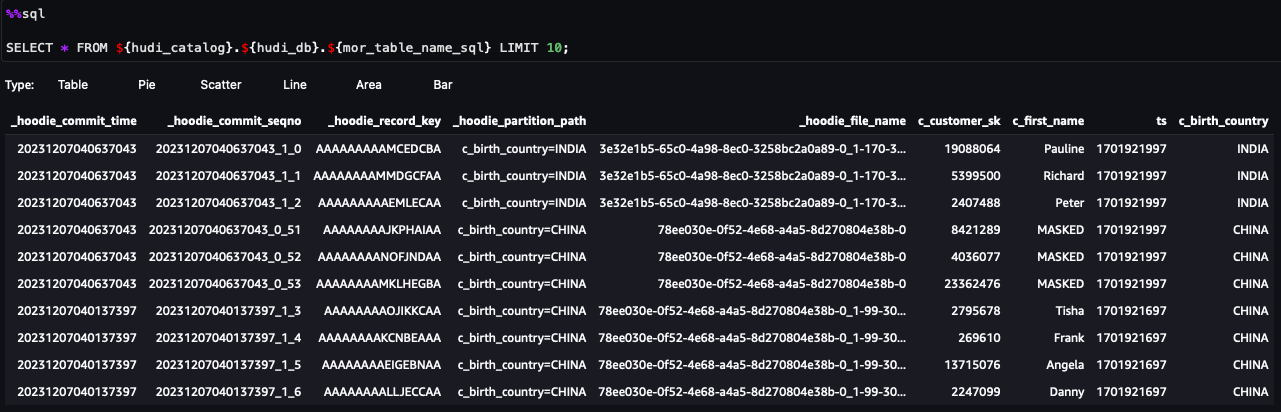

Anda sekarang dapat mengikuti langkah-langkah di buku catatan. Dari hasil query terlihat bahwa FGAC melalui filter data Lake Formation telah diterapkan. Peran tersebut tidak dapat melihat kolom PIIc_customer_id,c_last_name, danc_email_address. Juga, baris dariHONG KONGtelah disaring.

Membersihkan

Setelah Anda selesai bereksperimen dengan solusi tersebut, sebaiknya bersihkan sumber daya dengan langkah-langkah berikut untuk menghindari biaya tak terduga:

- Matikan aplikasi SageMaker Studio untuk profil pengguna.

Kluster EMR akan dihapus secara otomatis setelah nilai batas waktu idle.

- Hapus Sistem File Amazon Elastis Volume (Amazon EFS) dibuat untuk domain.

- Kosongkan bucket S3 dibuat oleh tumpukan CloudFormation.

- Di konsol AWS CloudFormation, hapus tumpukan.

Kesimpulan

Dalam postingan ini, kami menggunakan Apachi Hudi, salah satu jenis tabel OTF, untuk mendemonstrasikan fitur baru ini guna menerapkan kontrol akses terperinci di Amazon EMR. Anda dapat menentukan izin terperinci di Lake Formation untuk tabel OTF dan menerapkannya melalui kueri Spark SQL pada kluster EMR. Anda juga dapat menggunakan fitur data lake transaksional seperti menjalankan kueri snapshot, kueri tambahan, perjalanan waktu, dan kueri DML. Harap dicatat bahwa fitur baru ini mencakup semua tabel OTF.

Fitur ini diluncurkan mulai Amazon EMR rilis 6.15 secara keseluruhan daerah di mana Amazon EMR tersedia. Dengan integrasi Amazon EMR dengan Lake Formation, Anda dapat mengelola dan memproses big data dengan percaya diri, membuka wawasan, dan memfasilitasi pengambilan keputusan yang tepat sekaligus menjunjung keamanan dan tata kelola data.

Untuk mempelajari lebih lanjut, lihat Aktifkan Lake Formation dengan Amazon EMR dan jangan ragu untuk menghubungi AWS Solutions Architects Anda, yang dapat membantu sepanjang perjalanan data Anda.

tentang Penulis

Raymond Lai adalah Arsitek Solusi Senior yang berspesialisasi dalam melayani kebutuhan pelanggan perusahaan besar. Keahliannya terletak pada membantu pelanggan dalam memigrasikan sistem dan database perusahaan yang rumit ke AWS, membangun gudang data perusahaan dan platform data lake. Raymond unggul dalam mengidentifikasi dan merancang solusi untuk kasus penggunaan AI/ML, dan dia memiliki fokus khusus pada solusi AWS Tanpa Server dan desain Arsitektur Berbasis Peristiwa.

Raymond Lai adalah Arsitek Solusi Senior yang berspesialisasi dalam melayani kebutuhan pelanggan perusahaan besar. Keahliannya terletak pada membantu pelanggan dalam memigrasikan sistem dan database perusahaan yang rumit ke AWS, membangun gudang data perusahaan dan platform data lake. Raymond unggul dalam mengidentifikasi dan merancang solusi untuk kasus penggunaan AI/ML, dan dia memiliki fokus khusus pada solusi AWS Tanpa Server dan desain Arsitektur Berbasis Peristiwa.

Bin Wang, PhD, adalah Arsitek Solusi Spesialis Analitik Senior di AWS, yang memiliki pengalaman lebih dari 12 tahun di industri ML, dengan fokus khusus pada periklanan. Dia memiliki keahlian dalam pemrosesan bahasa alami (NLP), sistem rekomendasi, beragam algoritma ML, dan operasi ML. Dia sangat bersemangat menerapkan ML/DL dan teknik big data untuk memecahkan masalah dunia nyata.

Bin Wang, PhD, adalah Arsitek Solusi Spesialis Analitik Senior di AWS, yang memiliki pengalaman lebih dari 12 tahun di industri ML, dengan fokus khusus pada periklanan. Dia memiliki keahlian dalam pemrosesan bahasa alami (NLP), sistem rekomendasi, beragam algoritma ML, dan operasi ML. Dia sangat bersemangat menerapkan ML/DL dan teknik big data untuk memecahkan masalah dunia nyata.

Aditya Syah adalah Insinyur Pengembangan Perangkat Lunak di AWS. Dia tertarik pada Mesin Basis Data dan Gudang Data dan telah mengerjakan optimalisasi kinerja, kepatuhan keamanan, dan kepatuhan ACID untuk mesin seperti Apache Hive dan Apache Spark.

Aditya Syah adalah Insinyur Pengembangan Perangkat Lunak di AWS. Dia tertarik pada Mesin Basis Data dan Gudang Data dan telah mengerjakan optimalisasi kinerja, kepatuhan keamanan, dan kepatuhan ACID untuk mesin seperti Apache Hive dan Apache Spark.

Melodi Yang adalah Arsitek Solusi Data Besar Senior untuk Amazon EMR di AWS. Dia adalah pemimpin analitik berpengalaman yang bekerja dengan pelanggan AWS untuk memberikan panduan praktik terbaik dan saran teknis untuk membantu kesuksesan mereka dalam transformasi data. Bidang minatnya adalah kerangka kerja sumber terbuka dan otomatisasi, rekayasa data, dan DataOps.

Melodi Yang adalah Arsitek Solusi Data Besar Senior untuk Amazon EMR di AWS. Dia adalah pemimpin analitik berpengalaman yang bekerja dengan pelanggan AWS untuk memberikan panduan praktik terbaik dan saran teknis untuk membantu kesuksesan mereka dalam transformasi data. Bidang minatnya adalah kerangka kerja sumber terbuka dan otomatisasi, rekayasa data, dan DataOps.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/enforce-fine-grained-access-control-on-open-table-formats-via-amazon-emr-integrated-with-aws-lake-formation/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 130

- 15%

- 16

- 17

- 20

- 22

- 400

- 7

- 8

- 9

- a

- Tentang Kami

- mengakses

- Akun

- mengakui

- tindakan

- aktif

- menambahkan

- Selain itu

- alamat

- admin

- administrator

- pengiklanan

- nasihat

- Setelah

- lagi

- AI / ML

- algoritma

- Semua

- mengizinkan

- diizinkan

- memungkinkan

- di samping

- juga

- Amazon

- Amazon EC2

- Amazon ESDM

- Amazon Web Services

- an

- analisis

- Analis

- Analitik

- analisis

- menganalisis

- dan

- Apa pun

- Apache

- Apache Spark

- Aplikasi

- terapan

- Mendaftar

- Menerapkan

- arsitek

- arsitektur

- ADALAH

- daerah

- sekitar

- AS

- membantu

- Bantuan

- membantu

- menganggap

- At

- audit

- kewenangan

- berwenang

- secara otomatis

- Otomatisasi

- tersedia

- menghindari

- AWS

- AWS Cloud9

- Formasi AWS Cloud

- Formasi Danau AWS

- kembali

- berdasarkan

- BE

- menjadi

- di belakang

- makhluk

- Manfaat

- selain

- TERBAIK

- Besar

- Big data

- blog

- membual

- kedua

- membangun

- tapi

- by

- CA

- CAN

- mampu

- membawa

- membawa

- kasus

- kasus

- katalog

- katering

- tertentu

- sertifikat

- sertifikat

- Sertifikasi

- perubahan

- berubah

- Perubahan

- Tiongkok

- Pilih

- Pembersihan

- Cloud9

- Kelompok

- kode

- Kolom

- Kolom

- COM

- kombinasi

- melakukan

- Perusahaan

- dibandingkan

- lengkap

- pemenuhan

- komponen

- komponen

- menghitung

- komputer

- konsep

- Kondisi

- Mengadakan

- dengan penuh percaya diri

- konfigurasi

- Terhubung

- konsul

- membangun

- kontak

- mengandung

- mengandung

- kontrol

- dikendalikan

- kontrol

- penyalinan

- Sesuai

- Biaya

- Biaya

- negara

- meliputi

- membuat

- dibuat

- menciptakan

- membuat

- pencipta

- terbaru

- adat

- pelanggan

- data

- akses data

- analisis data

- Danau Data

- Platform Data

- privasi data

- pengolahan data

- keamanan data

- data warehouse

- Basis Data

- database

- Pengambilan Keputusan

- sangat

- Default

- menetapkan

- Delta

- mendemonstrasikan

- menunjukkan

- menyebarkan

- penyebaran

- Mendesain

- merancang

- rincian

- Pengembangan

- berbeda

- berbeda

- beberapa

- dns

- do

- tidak

- Tidak

- domain

- dilakukan

- Dont

- turun

- Download

- didorong

- selama

- setiap

- lain

- aktif

- diaktifkan

- memungkinkan

- enkripsi

- akhir

- endpoint

- melaksanakan

- Mesin

- insinyur

- Teknik

- Mesin

- memastikan

- Memastikan

- memastikan

- Enter

- Enterprise

- pelanggan perusahaan

- Seluruh

- Lingkungan Hidup

- Eter (ETH)

- Acara

- Setiap

- contoh

- eksekusi

- ada

- pengalaman

- berpengalaman

- keahlian

- eksplorasi

- Meluas

- luar

- memfasilitasi

- lebih cepat

- Fitur

- Fitur

- merasa

- File

- File

- menyaring

- penyaringan

- filter

- Pertama

- Fokus

- berfokus

- mengikuti

- berikut

- berikut

- Untuk

- format

- pembentukan

- empat

- Kerangka

- kerangka

- Gratis

- dari

- Memenuhi

- penuh

- fungsi

- lebih lanjut

- masa depan

- Mendapatkan

- dihasilkan

- pemerintahan

- diatur

- memberikan

- sangat

- Kelompok

- Grup

- bimbingan

- tangan

- Memiliki

- he

- dia

- di sini

- Disorot

- -nya

- historis

- sejarah

- Sarang lebah

- Hong

- Hong Kong

- Rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTML

- http

- HTTPS

- IAM

- ICON

- ID

- ide

- mengenali

- mengidentifikasi

- Siaga

- if

- menggambarkan

- melaksanakan

- memperbaiki

- in

- termasuk

- Termasuk

- menggabungkan

- inkremental

- India

- industri

- memberitahu

- informasi

- informasi

- memasukkan

- wawasan

- terpadu

- Mengintegrasikan

- integrasi

- interaktif

- tertarik

- kepentingan

- Antarmuka

- intern

- ke

- rumit

- diperkenalkan

- Memperkenalkan

- isu

- IT

- NYA

- Pekerjaan

- Jobs

- perjalanan

- jpg

- Notebook Jupyter

- kunci

- Kong

- danau

- bahasa

- besar

- Terakhir

- jalankan

- diluncurkan

- pemimpin

- BELAJAR

- adalah ide yang bagus

- terletak

- 'like'

- MEMBATASI

- baris

- lokal

- tempat

- lokasi

- masuk

- utama

- membuat

- mengelola

- berhasil

- pengelolaan

- manajer

- banyak

- Mungkin..

- cara

- mekanisme

- pertemuan

- menu

- Metadata

- mungkin

- bermigrasi

- menit

- ML

- Algoritme ML

- dimodifikasi

- lebih

- gerakan

- nama

- nama

- Alam

- Bahasa Alami

- Pengolahan Bahasa alami

- Arahkan

- Navigasi

- Perlu

- kebutuhan

- New

- Fitur baru

- baru saja

- berikutnya

- nLP

- simpul

- mencatat

- buku catatan

- laptop

- sekarang

- objek

- of

- sering

- on

- ONE

- hanya

- Buka

- open source

- openssl

- Operasi

- optimal

- Optimize

- pilihan

- Opsi

- or

- urutan

- organisasi

- Lainnya

- di luar

- lebih

- pasangan

- pane

- tertentu

- khususnya

- bergairah

- pembayaran

- prestasi

- melakukan

- izin

- Izin

- Sendiri

- phd

- saleh

- placeholder

- Platform

- Platform

- plato

- Kecerdasan Data Plato

- Data Plato

- silahkan

- plus

- poin

- Populer

- memiliki

- Pos

- praktek

- melestarikan

- sebelumnya

- primer

- pribadi

- hak istimewa

- hak

- masalah

- proses

- pengolahan

- Produksi

- Profil

- profil

- bukti

- bukti konsep

- terlindung

- perlindungan

- memberikan

- menyediakan

- menyediakan

- publik

- tujuan

- query

- Baca

- Bacaan

- siap

- dunia nyata

- real-time

- sarankan

- catatan

- pemulihan

- mengurangi

- mengurangi

- lihat

- mengacu

- mencerminkan

- wilayah

- daftar

- terdaftar

- peraturan

- melepaskan

- Pers

- relevan

- menggantikan

- wajib

- Persyaratan

- sumber

- intensif sumber daya

- Sumber

- mengakibatkan

- Hasil

- hak

- Peran

- peran

- BARIS

- RSA

- aturan

- Run

- berjalan

- pembuat bijak

- sama

- Save

- Bagian

- aman

- Dijamin

- keamanan

- melihat

- Mencari

- memilih

- senior

- peka

- Server

- Tanpa Server

- Layanan

- Sidang

- set

- set

- pengaturan

- penyiapan

- dia

- menandatangani

- signifikan

- mirip

- Sederhana

- disederhanakan

- menyederhanakan

- sejak

- Potret

- So

- Perangkat lunak

- pengembangan perangkat lunak

- larutan

- Solusi

- MEMECAHKAN

- beberapa

- sumber

- percikan

- spesialis

- spesialisasi

- SQL

- tumpukan

- Tahap

- awal

- mulai

- Mulai

- Laporan

- Tangga

- penyimpanan

- toko

- Penyelarasan

- Tali

- studio

- menyerahkan

- subnet

- sukses

- seperti itu

- RINGKASAN

- mendukung

- Mendukung

- yakin

- sintaksis

- sistem

- tabel

- MENANDAI

- Dibutuhkan

- Teknis

- teknik

- Template

- terminal

- bahwa

- Grafik

- Sumber

- mereka

- Mereka

- kemudian

- Sana.

- Ini

- mereka

- ini

- tiga

- Melalui

- waktu

- perjalanan waktu

- waktu

- untuk

- Pelacakan

- .

- transaksional

- Transformasi

- transit

- perjalanan

- benar

- Terpercaya

- Ts

- dua

- mengetik

- jenis

- ui

- bawah

- Tiba-tiba

- tidak dikenal

- unlocking

- Memperbarui

- diperbarui

- menegakkan

- upload

- URI

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna

- menggunakan

- memvalidasi

- nilai

- berbagai

- versi

- melalui

- jarak penglihatan

- volume

- Gudang

- Pergudangan

- we

- jaringan

- layanan web

- ketika

- sedangkan

- yang

- sementara

- SIAPA

- akan

- dengan

- dalam

- bekerja

- kerja

- menulis

- tahun

- kamu

- Anda

- zephyrnet.dll

- nol

- Zip