Di era big data ini, organisasi di seluruh dunia terus mencari cara inovatif untuk mengekstraksi nilai dan wawasan dari kumpulan data mereka yang sangat besar. Apache Spark menawarkan skalabilitas dan kecepatan yang dibutuhkan untuk memproses data dalam jumlah besar secara efisien.

Amazon ESDM adalah solusi cloud big data yang terdepan di industri untuk pemrosesan data berskala petabyte, analitik interaktif, dan pembelajaran mesin (ML) menggunakan kerangka kerja sumber terbuka seperti Apache Spark, Sarang Apache, dan Presto. Amazon EMR adalah tempat terbaik untuk menjalankan Apache Spark. Anda dapat dengan cepat dan mudah membuat kluster Spark terkelola dari Konsol Manajemen AWS, Antarmuka Baris Perintah AWS (AWS CLI), atau API Amazon EMR. Anda juga dapat menggunakan fitur tambahan Amazon EMR, termasuk fast Layanan Penyimpanan Sederhana Amazon Konektivitas (Amazon S3) menggunakan Amazon EMR File System (EMRFS), integrasi dengan Tempat Amazon EC2 pasar dan Lem AWS Katalog Data, dan Penskalaan Terkelola EMR untuk menambah atau menghapus instans dari klaster Anda. Studio Amazon EMR adalah lingkungan pengembangan terintegrasi (IDE) yang memudahkan ilmuwan data dan insinyur data untuk mengembangkan, memvisualisasikan, dan men-debug aplikasi rekayasa data dan ilmu data yang ditulis dalam R, Python, Scala, dan PySpark. EMR Studio menyediakan notebook Jupyter yang dikelola sepenuhnya, dan alat seperti Spark UI dan YARN Timeline Service untuk menyederhanakan proses debug.

Untuk membuka potensi yang tersembunyi dalam kumpulan data, penting untuk melampaui analisis tradisional. Masukkan AI generatif, teknologi mutakhir yang menggabungkan ML dengan kreativitas untuk menghasilkan teks, seni, dan bahkan kode yang mirip manusia. Batuan Dasar Amazon adalah cara paling mudah untuk membangun dan menskalakan aplikasi AI generatif dengan model dasar (FM). Amazon Bedrock adalah layanan terkelola sepenuhnya yang membuat FM dari Amazon dan perusahaan AI terkemuka tersedia melalui API, sehingga Anda dapat dengan cepat bereksperimen dengan berbagai FM di taman bermain, dan menggunakan satu API untuk inferensi terlepas dari model yang Anda pilih, sehingga memberikan Anda memiliki fleksibilitas untuk menggunakan FM dari penyedia berbeda dan selalu mengikuti perkembangan versi model terbaru dengan perubahan kode minimal.

Dalam postingan ini, kami mengeksplorasi bagaimana Anda dapat meningkatkan analisis data Anda dengan AI generatif menggunakan Amazon EMR, Amazon Bedrock, dan pyspark-ai perpustakaan. Pustaka pyspark-ai adalah SDK bahasa Inggris untuk Apache Spark. Dibutuhkan instruksi dalam bahasa Inggris dan mengkompilasinya menjadi objek PySpark seperti DataFrames. Hal ini memudahkan penggunaan Spark, sehingga Anda dapat fokus dalam mengekstraksi nilai dari data Anda.

Ikhtisar solusi

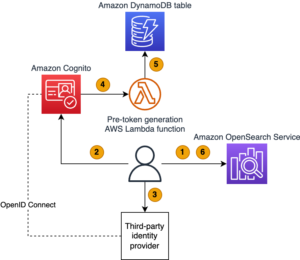

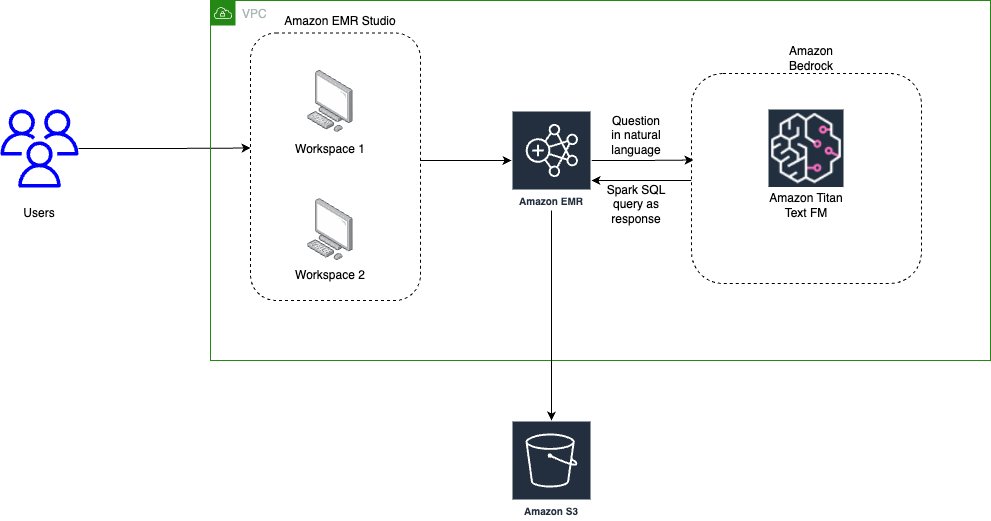

Diagram berikut mengilustrasikan arsitektur penggunaan AI generatif dengan Amazon EMR dan Amazon Bedrock.

EMR Studio adalah IDE berbasis web untuk notebook Jupyter yang terkelola sepenuhnya dan berjalan di kluster EMR. Kami berinteraksi dengan Ruang Kerja EMR Studio yang terhubung ke kluster EMR yang sedang berjalan dan menjalankan notebook yang disediakan sebagai bagian dari postingan ini. Kami menggunakan Taksi Kota New York data untuk mengumpulkan wawasan tentang berbagai perjalanan taksi yang dilakukan oleh pengguna. Kami mengajukan pertanyaan dalam bahasa alami di atas data yang dimuat di Spark DataFrame. Pustaka pyspark-ai kemudian menggunakan Amazon Titan Text FM dari Amazon Bedrock untuk membuat kueri SQL berdasarkan pertanyaan bahasa alami. Pustaka pyspark-ai mengambil kueri SQL, menjalankannya menggunakan Spark SQL, dan memberikan hasilnya kembali kepada pengguna.

Dalam solusi ini, Anda dapat membuat dan mengonfigurasi sumber daya yang diperlukan di akun AWS Anda dengan Formasi AWS Cloud templat. Templat menciptakan Lem AWS database dan tabel, bucket S3, VPC, dan lainnya Identitas AWS dan Manajemen Akses (IAM) sumber daya yang digunakan dalam solusi.

Templat ini dirancang untuk menunjukkan cara menggunakan EMR Studio dengan paket pyspark-ai dan Amazon Bedrock, dan tidak dimaksudkan untuk penggunaan produksi tanpa modifikasi. Selain itu, templatnya menggunakan us-east-1 Wilayah dan tidak dapat berfungsi di Wilayah lain tanpa modifikasi. Templat ini menciptakan sumber daya yang menimbulkan biaya saat digunakan. Ikuti langkah pembersihan di akhir postingan ini untuk menghapus sumber daya dan menghindari biaya yang tidak perlu.

Prasyarat

Sebelum Anda meluncurkan tumpukan CloudFormation, pastikan Anda memiliki hal berikut:

- Akun AWS yang menyediakan akses ke layanan AWS

- Pengguna IAM dengan access key dan secret key untuk mengonfigurasi AWS CLI, dan izin untuk membuat IAM role, kebijakan IAM, dan tumpukan di AWS CloudFormation

- Titan Text G1 – Model Ekspres saat ini dalam pratinjau, jadi Anda harus memiliki akses pratinjau untuk menggunakannya sebagai bagian dari postingan ini

Buat sumber daya dengan AWS CloudFormation

CloudFormation membuat sumber daya AWS berikut:

- Tumpukan VPC dengan subnet privat dan publik untuk digunakan dengan EMR Studio, tabel rute, dan gateway NAT.

- Klaster EMR dengan Python 3.9 terinstal. Kami menggunakan tindakan bootstrap untuk menginstal Python 3.9 dan paket relevan lainnya seperti dependensi pyspark-ai dan Amazon Bedrock. (Untuk informasi lebih lanjut, lihat skrip bootstrap.)

- Bucket S3 untuk EMR Studio Workspace dan penyimpanan notebook.

- Peran dan kebijakan IAM untuk pengaturan EMR Studio, akses Amazon Bedrock, dan menjalankan notebook

Untuk memulai, selesaikan langkah-langkah berikut:

Tumpukan CloudFormation membutuhkan waktu sekitar 20–30 menit untuk diselesaikan. Anda dapat memantau kemajuannya di konsol AWS CloudFormation. Saat statusnya terbaca CREATE_COMPLETE, akun AWS Anda akan memiliki sumber daya yang diperlukan untuk mengimplementasikan solusi ini.

Buat Studio ESDM

Sekarang Anda dapat membuat EMR Studio dan Workspace untuk bekerja dengan kode notebook. Selesaikan langkah-langkah berikut:

- Di konsol EMR Studio, pilih Buat Studio.

- Masukkan Nama Studio as

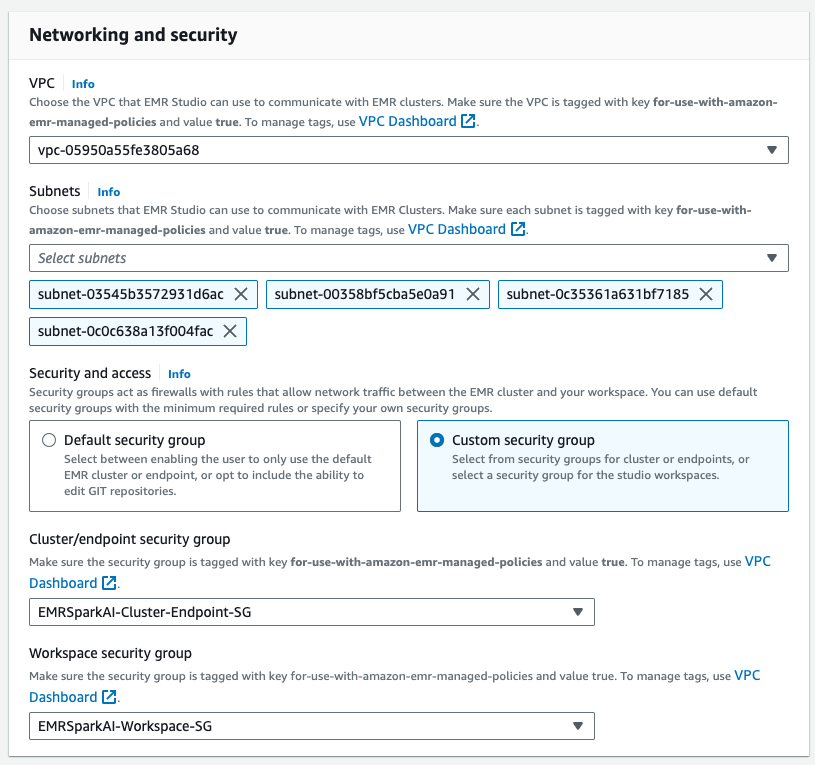

GenAI-EMR-Studiodan berikan deskripsinya. - Dalam majalah Jaringan dan keamanan bagian, tentukan hal berikut:

- Untuk VPC, pilih VPC yang Anda buat sebagai bagian dari tumpukan CloudFormation yang Anda terapkan. Dapatkan ID VPC menggunakan output CloudFormation untuk kunci VPCID.

- Untuk Subnet, pilih keempat subnet.

- Untuk Keamanan dan akses, pilih Grup keamanan khusus.

- Untuk Grup keamanan klaster/titik akhir, pilih

EMRSparkAI-Cluster-Endpoint-SG. - Untuk Grup keamanan ruang kerja, pilih

EMRSparkAI-Workspace-SG.

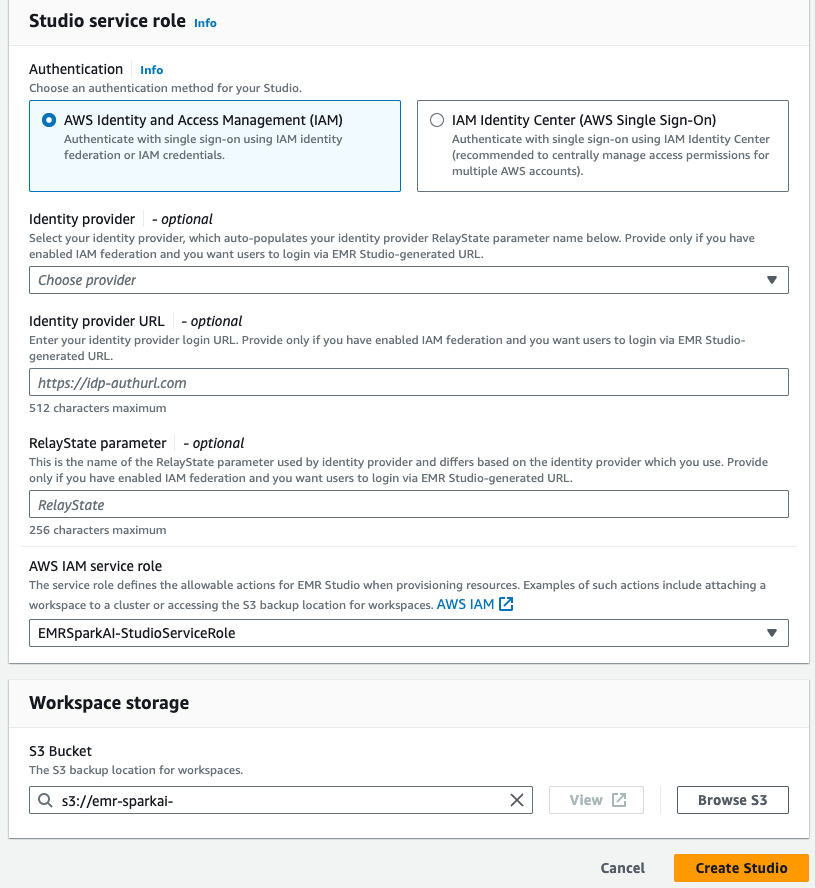

- Dalam majalah Peran layanan studio bagian, tentukan hal berikut:

- Untuk Otentikasi, pilih Identitas dan Manajemen Akses AWS (IAM).

- Untuk Peran layanan AWS IAM, pilih

EMRSparkAI-StudioServiceRole.

- Dalam majalah Penyimpanan ruang kerja bagian, telusuri dan pilih bucket S3 untuk penyimpanan dimulai

emr-sparkai-<account-id>. - Pilih Buat Studio.

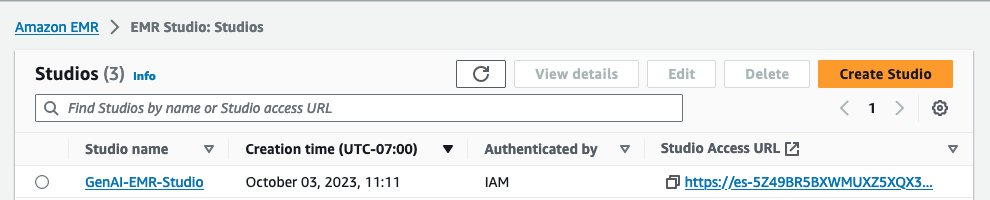

- Saat EMR Studio dibuat, pilih tautan di bawah URL Akses Studio untuk mengakses Studio.

- Saat Anda berada di Studio, pilih Buat ruang kerja.

- Add

emr-genaisebagai nama untuk Ruang Kerja dan pilih Buat ruang kerja. - Saat Ruang Kerja dibuat, pilih namanya untuk meluncurkan Ruang Kerja (pastikan Anda telah menonaktifkan pemblokir pop-up apa pun).

Analisis data besar menggunakan Apache Spark dengan Amazon EMR dan AI generatif

Sekarang setelah kami menyelesaikan penyiapan yang diperlukan, kami dapat mulai melakukan analisis big data menggunakan Apache Spark dengan Amazon EMR dan AI generatif.

Sebagai langkah pertama, kami memuat buku catatan yang memiliki kode dan contoh yang diperlukan untuk bekerja dengan kasus penggunaan. Kami menggunakan kumpulan data NY Taxi, yang berisi detail tentang naik taksi.

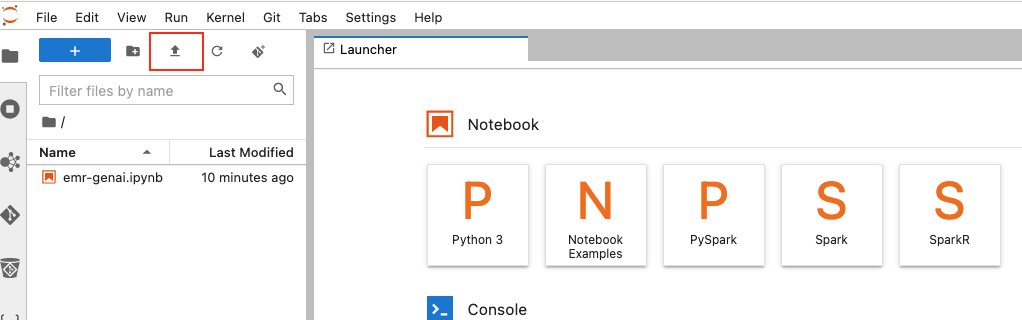

- Unduh file buku catatan NYTaxi.ipynb dan unggah ke Ruang Kerja Anda dengan memilih ikon unggah.

- Setelah buku catatan diimpor, buka buku catatan dan pilih

PySparksebagai kernel.

AI PySpark secara default menggunakan ChatGPT4.0 OpenAI sebagai model LLM, tetapi Anda juga dapat menyambungkan model dari Amazon Bedrock, Mulai Lompatan Amazon SageMaker, dan model pihak ketiga lainnya. Untuk postingan ini, kami menunjukkan cara mengintegrasikan model Amazon Bedrock Titan untuk pembuatan kueri SQL dan menjalankannya dengan Apache Spark di Amazon EMR.

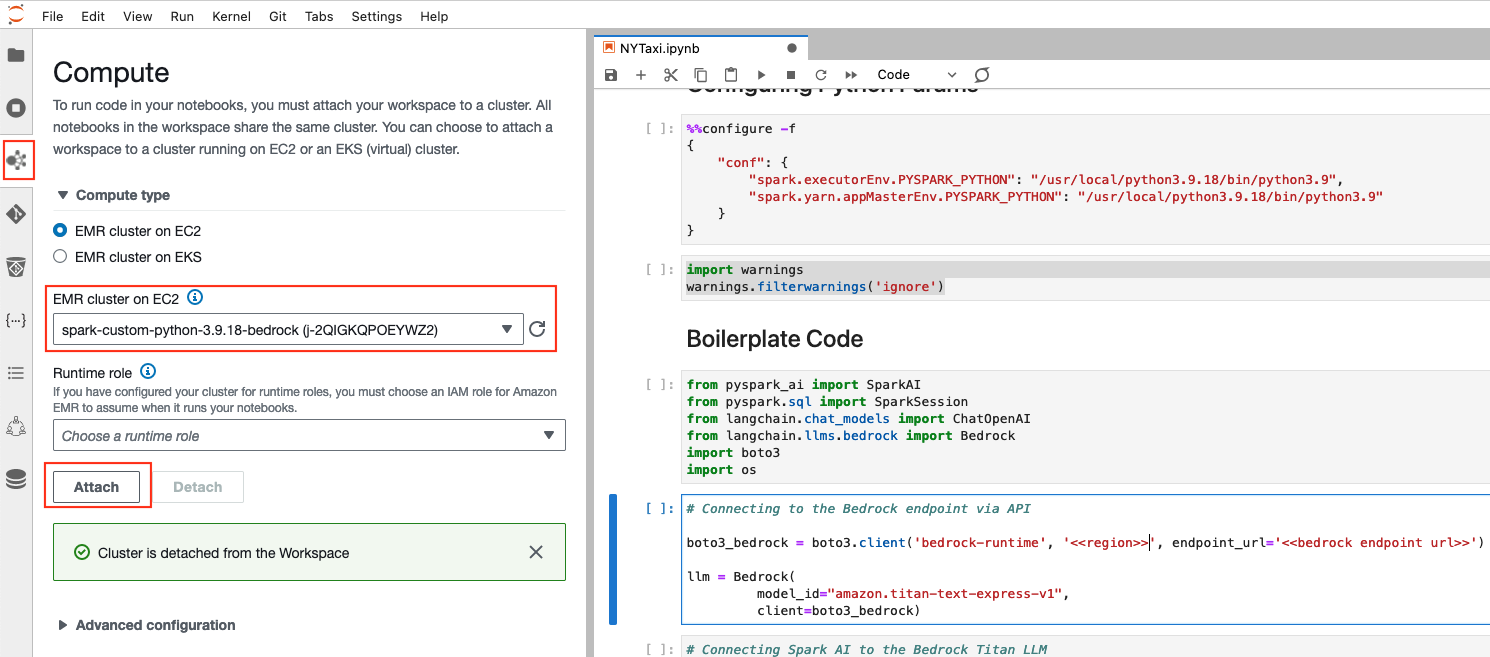

- Untuk memulai dengan notebook, Anda perlu mengaitkan Ruang Kerja ke lapisan komputasi. Untuk melakukannya, pilih menghitung ikon di panel navigasi dan pilih klaster EMR yang dibuat oleh tumpukan CloudFormation.

- Konfigurasikan parameter Python untuk menggunakan paket Python 3.9 yang diperbarui dengan Amazon EMR:

- Impor perpustakaan yang diperlukan:

- Setelah perpustakaan diimpor, Anda dapat menentukan model LLM dari Amazon Bedrock. Dalam hal ini, kami menggunakan amazon.titan-text-express-v1. Anda harus memasukkan URL titik akhir Wilayah dan Amazon Bedrock berdasarkan akses pratinjau Anda untuk model Titan Text G1 – Express.

- Hubungkan Spark AI ke model Amazon Bedrock LLM untuk pembuatan kueri SQL berdasarkan pertanyaan dalam bahasa alami:

Di sini, kami telah menginisialisasi Spark AI dengan verbose=False; Anda juga dapat mengatur verbose=True untuk melihat detail lebih lanjut.

Sekarang Anda dapat membaca data Taksi NYC di Spark DataFrame dan menggunakan kekuatan AI generatif di Spark.

- Misalnya, Anda dapat menanyakan hitungan jumlah rekaman dalam kumpulan data:

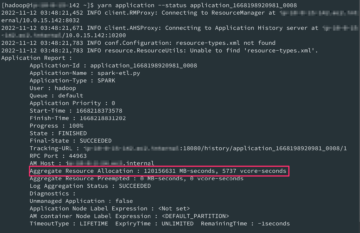

Kami mendapatkan tanggapan berikut:

Spark AI digunakan secara internal LangChain dan rantai SQL, yang menyembunyikan kompleksitas dari pengguna akhir yang bekerja dengan kueri di Spark.

Notebook ini memiliki beberapa contoh skenario lagi untuk mengeksplorasi kekuatan AI generatif dengan Apache Spark dan Amazon EMR.

Membersihkan

Kosongkan isi ember S3 emr-sparkai-<account-id>, hapus Ruang Kerja EMR Studio yang dibuat sebagai bagian dari postingan ini, lalu hapus tumpukan CloudFormation yang Anda terapkan.

Kesimpulan

Postingan ini menunjukkan bagaimana Anda dapat meningkatkan analitik data besar Anda dengan bantuan Apache Spark dengan Amazon EMR dan Amazon Bedrock. Paket PySpark AI memungkinkan Anda memperoleh wawasan bermakna dari data Anda. Ini membantu mengurangi waktu pengembangan dan analisis, mengurangi waktu untuk menulis kueri manual, dan memungkinkan Anda fokus pada kasus penggunaan bisnis Anda.

Tentang Penulis

Saurabh Bhutyani adalah Arsitek Solusi Spesialis Analisis Utama di AWS. Dia bersemangat tentang teknologi baru. Dia bergabung dengan AWS pada tahun 2019 dan bekerja dengan pelanggan untuk memberikan panduan arsitektur untuk menjalankan kasus penggunaan AI generatif, solusi analitik yang dapat diskalakan, dan arsitektur data mesh menggunakan layanan AWS seperti Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, dan Amazon DataZone.

Saurabh Bhutyani adalah Arsitek Solusi Spesialis Analisis Utama di AWS. Dia bersemangat tentang teknologi baru. Dia bergabung dengan AWS pada tahun 2019 dan bekerja dengan pelanggan untuk memberikan panduan arsitektur untuk menjalankan kasus penggunaan AI generatif, solusi analitik yang dapat diskalakan, dan arsitektur data mesh menggunakan layanan AWS seperti Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, dan Amazon DataZone.

Harsh Vardhan adalah Arsitek Solusi Senior AWS, yang berspesialisasi dalam analitik. Beliau memiliki pengalaman lebih dari 8 tahun bekerja di bidang big data dan ilmu data. Dia bersemangat membantu pelanggan menerapkan praktik terbaik dan menemukan wawasan dari data mereka.

Harsh Vardhan adalah Arsitek Solusi Senior AWS, yang berspesialisasi dalam analitik. Beliau memiliki pengalaman lebih dari 8 tahun bekerja di bidang big data dan ilmu data. Dia bersemangat membantu pelanggan menerapkan praktik terbaik dan menemukan wawasan dari data mereka.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/big-data/use-generative-ai-with-amazon-emr-amazon-bedrock-and-english-sdk-for-apache-spark-to-unlock-insights/

- :memiliki

- :adalah

- :bukan

- $NAIK

- 1

- 10

- 100

- 107

- 11

- 20

- 200

- 2019

- 320

- 500

- 521

- 7

- 8

- 9

- 990

- a

- Tentang Kami

- mengakses

- manajemen akses

- Akun

- mengakui

- Tindakan

- menambahkan

- Tambahan

- Selain itu

- mengambil

- AI

- saya menggunakan kasus

- Semua

- Membiarkan

- memungkinkan

- juga

- Amazon

- Amazon Athena

- Amazon ESDM

- Amazon SageMaker

- Amazon Web Services

- jumlah

- an

- analisis

- analisis

- dan

- menjawab

- Apa pun

- Apache

- Apache Spark

- api

- aplikasi

- sekitar

- arsitektur

- arsitektur

- ADALAH

- Seni

- AS

- meminta

- Menghubungkan

- At

- tersedia

- menghindari

- AWS

- Formasi AWS Cloud

- Lem AWS

- Formasi Danau AWS

- kembali

- berdasarkan

- TERBAIK

- Praktik Terbaik

- Luar

- Besar

- Big data

- Bootstrap

- membangun

- bisnis

- tapi

- tombol

- by

- CAN

- kasus

- kasus

- katalog

- rantai

- Perubahan

- beban

- Pilih

- memilih

- Kota

- awan

- awan data besar

- Kelompok

- kode

- menggabungkan

- Perusahaan

- lengkap

- Lengkap

- kompleksitas

- menghitung

- terhubung

- Konektivitas

- konsul

- terus-menerus

- mengandung

- isi

- Biaya

- membuat

- dibuat

- menciptakan

- kreativitas

- Sekarang

- pelanggan

- canggih

- data

- Data Analytics

- pengolahan data

- ilmu data

- Basis Data

- kumpulan data

- Tanggal

- Default

- menetapkan

- mendemonstrasikan

- ketergantungan

- dikerahkan

- memperoleh

- deskripsi

- dirancang

- rincian

- mengembangkan

- Pengembangan

- berbeda

- cacat

- menemukan

- do

- efisien

- mudah

- akhir

- Titik akhir

- Teknik

- Insinyur

- Inggris

- memastikan

- Enter

- memasuki

- Lingkungan Hidup

- Era

- penting

- Eter (ETH)

- Bahkan

- contoh

- contoh

- pengalaman

- eksperimen

- menyelidiki

- ekspres

- ekstrak

- FAST

- Fitur

- beberapa

- bidang

- File

- terakhir

- Pertama

- keluwesan

- Fokus

- mengikuti

- berikut

- Untuk

- pembentukan

- Prinsip Dasar

- empat

- kerangka

- dari

- sepenuhnya

- g1

- mengumpulkan

- pintu gerbang

- menghasilkan

- generasi

- generatif

- AI generatif

- mendapatkan

- Pemberian

- Go

- bimbingan

- Memiliki

- he

- membantu

- membantu

- membantu

- Tersembunyi

- menyembunyikan

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- http

- HTTPS

- i

- IAM

- ICON

- ID

- identitas

- identitas dan manajemen akses

- menggambarkan

- melaksanakan

- mengimpor

- in

- Di lain

- Termasuk

- industri terkemuka

- informasi

- inovatif

- memasukkan

- wawasan

- install

- contoh

- instruksi

- mengintegrasikan

- terpadu

- integrasi

- dimaksudkan

- berinteraksi

- interaktif

- internal

- ke

- IT

- NYA

- bergabung

- jpg

- Menjaga

- kunci

- Tahu

- danau

- bahasa

- besar

- Terbaru

- jalankan

- lapisan

- terkemuka

- pengetahuan

- perpustakaan

- Perpustakaan

- 'like'

- baris

- LINK

- memuat

- mesin

- Mesin belajar

- membuat

- MEMBUAT

- berhasil

- pengelolaan

- panduan

- Pasar

- Mungkin..

- berarti

- jala

- minimal

- menit

- ML

- model

- model

- Memantau

- lebih

- paling

- nama

- Alam

- Bahasa Alami

- Navigasi

- perlu

- Perlu

- dibutuhkan

- jaringan

- New

- Teknologi baru

- buku catatan

- laptop

- sekarang

- jumlah

- NY

- NYC

- objek

- pengamatan

- of

- Penawaran

- on

- Buka

- open source

- or

- organisasi

- Lainnya

- output

- lebih

- ikhtisar

- paket

- paket

- pane

- parameter

- bagian

- bergairah

- melakukan

- Izin

- Tempat

- plato

- Kecerdasan Data Plato

- Data Plato

- tempat bermain

- steker

- Kebijakan

- pop-up

- Pos

- potensi

- kekuasaan

- praktek

- Preview

- Utama

- swasta

- proses

- pengolahan

- Produksi

- Kemajuan

- memberikan

- disediakan

- penyedia

- menyediakan

- publik

- Ular sanca

- query

- pertanyaan

- Pertanyaan

- segera

- R

- Baca

- arsip

- menurunkan

- mengurangi

- lihat

- Bagaimanapun juga

- wilayah

- daerah

- relevan

- menghapus

- wajib

- Sumber

- tanggapan

- Hasil

- wahana

- Peran

- peran

- Rute

- Run

- berjalan

- berjalan

- pembuat bijak

- Scala

- Skalabilitas

- terukur

- Skala

- skala

- skenario

- Ilmu

- ilmuwan

- SDK

- mencari

- Rahasia

- keamanan

- melihat

- memilih

- senior

- layanan

- Layanan

- set

- penyiapan

- Menunjukkan

- menunjukkan

- Sederhana

- menyederhanakan

- tunggal

- So

- larutan

- Solusi

- sumber

- percikan

- spesialis

- mengkhususkan diri

- kecepatan

- SQL

- tumpukan

- Tumpukan

- awal

- mulai

- Mulai

- Status

- Langkah

- Tangga

- penyimpanan

- mudah

- studio

- subnet

- seperti itu

- memperlengkapi secara keterlaluan

- yakin

- sistem

- tabel

- diambil

- Dibutuhkan

- Teknologi

- Teknologi

- Template

- teks

- bahwa

- Grafik

- mereka

- Mereka

- kemudian

- mereka

- pihak ketiga

- ini

- pikir

- Melalui

- waktu

- waktu

- titan

- untuk

- alat

- puncak

- tradisional

- ui

- bawah

- membuka kunci

- diperbarui

- URL

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna

- kegunaan

- menggunakan

- nilai

- variasi

- berbagai

- Luas

- membayangkan

- Cara..

- cara

- we

- jaringan

- layanan web

- berbasis web

- ketika

- yang

- sementara

- akan

- dengan

- dalam

- tanpa

- Kerja

- kerja

- bekerja

- industri udang di seluruh dunia.

- menulis

- tertulis

- tahun

- York

- kamu

- Anda

- zephyrnet.dll