07. február 2023. (

Nanowerk News) A nagy nyelvi modellek, mint például az OpenAI GPT-3, hatalmas neurális hálózatok, amelyek emberszerű szöveget tudnak generálni, a költészettől a programozási kódig. Ezek a gépi tanulási modellek, amelyeket internetes adatok felhasználásával képeztek ki, egy kis bemeneti szöveget vesznek, majd megjósolják a valószínűleg következő szöveget. De ezek a modellek nem mindenre képesek. A kutatók a kontextuson belüli tanulás néven ismert különös jelenséget vizsgálják, amelyben egy nagy nyelvi modell néhány példa láttán megtanulja a feladat végrehajtását – annak ellenére, hogy nem erre a feladatra képezték ki. Például valaki beadhat a modellbe több példamondatot és azok érzelmeit (pozitív vagy negatív), majd egy új mondattal kérheti, és a modell megadhatja a megfelelő érzést. Általában egy gépi tanulási modellt, például a GPT-3-at, új adatokkal kell áttanítani ehhez az új feladathoz. A betanítási folyamat során a modell frissíti a paramétereit, miközben új információkat dolgoz fel a feladat megtanulásához. A kontextuson belüli tanulással azonban a modell paraméterei nem frissülnek, így úgy tűnik, hogy a modell anélkül tanul meg egy új feladatot, hogy bármit is tanulna. Az MIT, a Google Research és a Stanford Egyetem tudósai igyekeznek megfejteni ezt a rejtélyt. Olyan modelleket tanulmányoztak, amelyek nagyon hasonlítanak a nagy nyelvi modellekhez, hogy megnézzék, hogyan tanulhatnak paraméterek frissítése nélkül. A kutatók elméleti eredményei azt mutatják, hogy ezek a hatalmas neurális hálózati modellek képesek kisebb, egyszerűbb lineáris modelleket is magukba temetni. A nagy modell ezután megvalósíthat egy egyszerű tanulási algoritmust, hogy megtanítsa ezt a kisebb, lineáris modellt egy új feladat elvégzésére, csak a nagyobb modellben már szereplő információkat felhasználva. Paraméterei rögzítettek maradnak. Ez a kutatás fontos lépés a kontextuson belüli tanulás mögött meghúzódó mechanizmusok megértése felé, ez a kutatás megnyitja az ajtót a tanulási algoritmusok további feltárására, amelyeket ezek a nagy modellek megvalósíthatnak, mondja Ekin Akyürek, egy számítástechnikai végzettségű hallgató és egy tanulmány vezető szerzője.

“What learning algorithm is in-context learning? Investigations with linear models”) vizsgálja ezt a jelenséget. A kontextuson belüli tanulás jobb megértésével a kutatók lehetővé tehetik a modellek számára, hogy új feladatokat hajtsanak végre költséges átképzés nélkül. „Általában, ha finomhangolni akarja ezeket a modelleket, tartomány-specifikus adatokat kell gyűjtenie, és összetett tervezést kell végeznie. De most megadhatjuk neki a bemenetet, öt példát, és eléri, amit akarunk. Tehát a kontextusban tanulás elég izgalmas jelenség” – mondja Akyürek. Az írásban Akyürekhez csatlakozik Dale Schuurmans, a Google Brain kutatója és az Albertai Egyetem számítástudományi professzora; valamint a vezető szerzők Jacob Andreas, az X konzorcium adjunktusa az MIT Villamosmérnöki és Számítástechnikai Tanszékén, valamint az MIT Számítástechnikai és Mesterséges Intelligencia Laboratóriumának (CSAIL) tagja; Tengyu Ma, a Stanfordi informatika és statisztika adjunktusa; és Danny Zhou, a Google Brain vezető tudósa és kutatási igazgatója. A kutatást a Tanulási Reprezentációk Nemzetközi Konferenciáján mutatják be.

Modell a modellben

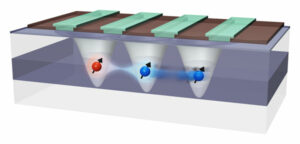

A gépi tanulással foglalkozó kutatóközösségben sok tudós úgy gondolja, hogy a nagy nyelvi modellek a képzésüknek köszönhetően képesek kontextusban tanulni, mondja Akyürek. Például a GPT-3 több százmilliárd paraméterrel rendelkezik, és hatalmas mennyiségű szöveg elolvasásával képezték ki az interneten, a Wikipédia-cikkektől a Reddit-bejegyzésekig. Tehát, amikor valaki bemutatja egy új feladat modellpéldáit, valószínűleg már látott valami nagyon hasonlót, mert a képzési adatkészlete több milliárd webhelyről származó szöveget tartalmazott. Megismétli az edzés során látott mintákat, ahelyett, hogy megtanulna új feladatokat végrehajtani. Akyürek azt feltételezte, hogy a kontextusban tanulók nem csupán a korábban látott mintákhoz illeszkednek, hanem valójában megtanulnak új feladatokat végrehajtani. Ő és mások azzal kísérleteztek, hogy ezeket a modelleket olyan szintetikus adatok felhasználásával figyelmeztették, amelyeket korábban sehol nem láthattak, és úgy találták, hogy a modellek még mindig tanulhatnak néhány példából. Akyürek és munkatársai úgy gondolták, hogy ezekben a neurális hálózati modellekben talán vannak kisebb gépi tanulási modellek, amelyeket a modellek betaníthatnak egy új feladat elvégzésére. „Ez megmagyarázhatja szinte az összes tanulási jelenséget, amelyet ezekkel a nagy modellekkel láttunk” – mondja. Ennek a hipotézisnek a tesztelésére a kutatók egy transzformátornak nevezett neurális hálózati modellt használtak, amely megegyezik a GPT-3 architektúrájával, de kifejezetten kontextuson belüli tanulásra képezték ki. Ennek a transzformátornak az architektúráját vizsgálva elméletileg bebizonyították, hogy képes lineáris modellt írni a rejtett állapotai között. A neurális hálózatok számos, egymással összefüggő csomópontból állnak, amelyek adatokat dolgoznak fel. A rejtett állapotok a bemeneti és kimeneti rétegek közötti rétegek. Matematikai értékeléseik azt mutatják, hogy ez a lineáris modell valahol a transzformátor legkorábbi rétegeiben van megírva. A transzformátor ezután frissítheti a lineáris modellt egyszerű tanulási algoritmusok végrehajtásával. Lényegében a modell önmagának egy kisebb változatát szimulálja és betanítja.

Rejtett rétegek vizsgálata

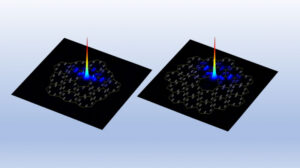

A kutatók ezt a hipotézist szondázó kísérletekkel tárták fel, ahol a transzformátor rejtett rétegeibe néztek, hogy megpróbáljanak visszanyerni egy bizonyos mennyiséget. „Ebben az esetben megpróbáltuk visszaállítani a lineáris modell tényleges megoldását, és meg tudtuk mutatni, hogy a paraméter rejtett állapotba van írva. Ez azt jelenti, hogy a lineáris modell ott van valahol” – mondja. Ezen elméleti munkára építve a kutatók képesek lehetnek arra, hogy a transzformátor kontextuson belüli tanulást végezzen, mindössze két réteg hozzáadásával a neurális hálózathoz. Sok technikai részletet kell még kidolgozni, mielőtt ez lehetséges lenne, figyelmeztet Akyürek, de ez segíthet a mérnököknek olyan modellek megalkotásában, amelyek képesek új feladatokat elvégezni anélkül, hogy új adatokkal kellene áttanulniuk. Tovább haladva, Akyürek azt tervezi, hogy folytatja a kontextuson belüli tanulás feltárását olyan függvényekkel, amelyek összetettebbek, mint az ebben a munkában vizsgált lineáris modellek. Ezeket a kísérleteket nagy nyelvi modellekre is alkalmazhatják, hogy megtudják, viselkedésüket egyszerű tanulási algoritmusok is leírják-e. Ezen túlmenően mélyebben szeretne ásni az előképzési adatok típusaiban, amelyek lehetővé teszik a kontextuson belüli tanulást. „Ezzel a munkával az emberek most elképzelhetik, hogyan tanulhatnak ezek a modellek a példáktól. Szóval remélem, hogy ez megváltoztatja egyesek nézeteit a kontextuson belüli tanulásról” – mondja Akyürek. „Ezek a modellek nem olyan ostobák, mint azt az emberek gondolják. Nem csak memorizálják ezeket a feladatokat. Új feladatokat tanulhatnak meg, mi pedig megmutattuk, hogyan lehet ezt megtenni.”

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- Platoblockchain. Web3 metaverzum intelligencia. Felerősített tudás. Hozzáférés itt.

- Forrás: https://www.nanowerk.com/news2/robotics/newsid=62325.php