Nous pensons que l’IA générative a le potentiel, au fil du temps, de transformer pratiquement toutes les expériences client que nous connaissons. Le nombre d'entreprises qui lancent des applications d'IA générative sur AWS est important et se développe rapidement, notamment adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy et LexisNexis Legal & Professional, pour n'en citer que quelques-unes. Des startups innovantes comme Perplexity AI se lancent à fond sur AWS pour l'IA générative. Des sociétés d'IA de premier plan comme Anthropic ont choisi AWS comme principal fournisseur de cloud pour les charges de travail critiques et comme lieu de formation de leurs futurs modèles. Et les fournisseurs mondiaux de services et de solutions comme Accenture récoltent les avantages des applications d'IA générative personnalisées en permettant à leurs développeurs internes de Chuchoteur de code Amazon.

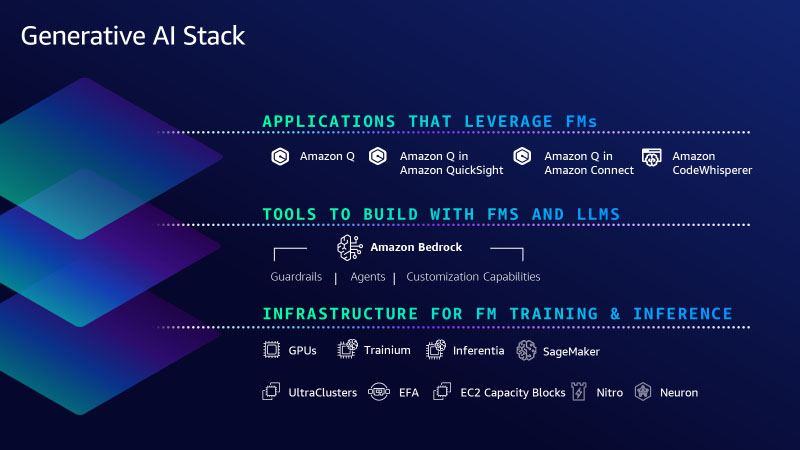

Ces clients choisissent AWS parce que nous nous efforçons de faire ce que nous avons toujours fait : adopter une technologie complexe et coûteuse qui peut transformer l'expérience client et les entreprises et la démocratiser pour les clients de toutes tailles et de toutes capacités techniques. Pour ce faire, nous investissons et innovons rapidement pour fournir l’ensemble de fonctionnalités le plus complet sur les trois couches de la pile d’IA générative. La couche inférieure est l'infrastructure permettant de former des modèles linguistiques étendus (LLM) et d'autres modèles de base (FM) et de produire des inférences ou des prédictions. La couche intermédiaire permet d'accéder facilement à tous les modèles et outils dont les clients ont besoin pour créer et faire évoluer des applications d'IA générative avec la même sécurité, le même contrôle d'accès et les autres fonctionnalités que les clients attendent d'un service AWS. Et au niveau supérieur, nous avons investi dans des applications révolutionnaires dans des domaines clés tels que le codage basé sur l’IA générative. En plus de leur offrir un choix et, comme ils l'attendent de nous, des capacités étendues et approfondies sur toutes les couches, les clients nous disent également qu'ils apprécient notre approche axée sur les données et qu'ils sont convaincus que nous avons tout construit dès le départ avec l'entreprise. niveau de sécurité et de confidentialité.

Cette semaine, nous avons fait un grand pas en avant en annonçant de nombreuses nouvelles fonctionnalités importantes dans les trois couches de la pile afin de permettre à nos clients d'utiliser facilement et de manière pratique l'IA générative de manière omniprésente dans leurs entreprises.

Couche inférieure de la pile : AWS Trainium2 est le dernier ajout à fournir l'infrastructure cloud la plus avancée pour l'IA générative.

La couche inférieure de la pile est l'infrastructure (calcul, réseau, frameworks, services) requise pour former et exécuter les LLM et autres FM. AWS innove pour offrir l'infrastructure la plus avancée pour le ML. Grâce à notre collaboration de longue date avec NVIDIA, AWS a été le premier à intégrer les GPU dans le cloud il y a plus de 12 ans, et plus récemment, nous avons été le premier grand fournisseur de cloud à proposer les GPU NVIDIA H100 avec nos instances P5. Nous continuons d'investir dans des innovations uniques qui font d'AWS le meilleur cloud pour exécuter des GPU, notamment les avantages prix-performances du système de virtualisation le plus avancé (AWS Nitro), un réseau puissant à l'échelle du pétabit avec Elastic Fabric Adapter (EFA) et l'hyper- mise à l'échelle du clustering avec Amazon EC2 UltraClusters (des milliers d'instances accélérées colocalisées dans une zone de disponibilité et interconnectées dans un réseau non bloquant pouvant fournir jusqu'à 3,200 2 Gbit/s pour une formation ML à grande échelle). Nous permettons également à tout client d'accéder plus facilement à la capacité de calcul GPU très recherchée pour l'IA générative avec les blocs de capacité Amazon EC500 pour ML, le premier et le seul modèle de consommation du secteur qui permet aux clients de réserver des GPU pour une utilisation future (jusqu'à 2 heures). déployé dans ECXNUMX UltraClusters) pour les charges de travail ML de courte durée.

Il y a plusieurs années, nous avons réalisé que pour continuer à repousser les limites en matière de prix et de performances, nous devions innover jusqu'au silicium, et nous avons commencé à investir dans nos propres puces. Pour le ML en particulier, nous avons commencé avec AWS Inferentia, notre puce d'inférence spécialement conçue. Aujourd'hui, nous en sommes à notre deuxième génération d'instances AWS Inferentia avec Amazon EC2 Inf2 optimisées spécifiquement pour les applications d'IA générative à grande échelle avec des modèles contenant des centaines de milliards de paramètres. Les instances Inf2 offrent le coût d'inférence le plus bas dans le cloud tout en offrant un débit jusqu'à quatre fois supérieur et une latence jusqu'à dix fois inférieure par rapport aux instances Inf1. Alimentées par jusqu'à 12 puces Inferentia2, Inf2 sont les seules instances EC2 optimisées pour l'inférence qui disposent d'une connectivité haut débit entre les accélérateurs afin que les clients puissent exécuter l'inférence plus rapidement et plus efficacement (à moindre coût) sans sacrifier les performances ou la latence en distribuant des modèles ultra-larges. sur plusieurs accélérateurs. Des clients comme Adobe, Deutsche Telekom et Leonardo.ai ont constaté d'excellents premiers résultats et sont ravis de déployer leurs modèles à grande échelle sur Inf2.

Du côté de la formation, les instances Trn1, alimentées par la puce de formation ML spécialement conçue par AWS, AWS Trainium, sont optimisées pour distribuer la formation sur plusieurs serveurs connectés au réseau EFA. Des clients comme Ricoh ont formé un LLM japonais avec des milliards de paramètres en quelques jours seulement. Databricks obtient un rapport prix-performance jusqu'à 40 % supérieur avec les instances basées sur Trainium pour former des modèles d'apprentissage profond à grande échelle. Mais avec de nouveaux modèles plus performants qui sortent pratiquement chaque semaine, nous continuons à repousser les limites en matière de performances et d'évolutivité, et nous sommes ravis d'annoncer AWS Trainium2, conçu pour offrir des performances de prix encore meilleures pour les modèles de formation comportant des centaines de milliards, voire des milliards de paramètres.. Trainium2 devrait offrir des performances d'entraînement jusqu'à quatre fois plus rapides que Trainium de première génération, et lorsqu'il est utilisé dans EC2 UltraClusters, il devrait fournir jusqu'à 65 exaflops de calcul global. Cela signifie que les clients pourront former un LLM de 300 milliards de paramètres en quelques semaines plutôt qu'en quelques mois. Les performances, l'évolutivité et l'efficacité énergétique de Trainium2 sont quelques-unes des raisons pour lesquelles Anthropic a choisi de former ses modèles sur AWS et utilisera Trainium2 pour ses futurs modèles. Et nous collaborons avec Anthropic sur l'innovation continue avec Trainium et Inferentia. Nous prévoyons que nos premières instances Trainium2 seront disponibles pour les clients en 2024.

Nous avons également doublé la chaîne d'outils logiciels pour notre silicium ML, en particulier en faisant progresser AWS Neuron, le kit de développement logiciel (SDK) qui aide les clients à obtenir les performances maximales de Trainium et Inferentia. Depuis l'introduction de Neuron en 2019, nous avons réalisé des investissements substantiels dans les technologies de compilateur et de framework, et aujourd'hui Neuron prend en charge bon nombre des modèles accessibles au public les plus populaires, notamment Llama 2 de Meta, MPT de Databricks et Stable Diffusion de Stability AI, ainsi que 93 des 100 meilleurs modèles du référentiel de modèles populaire Hugging Face. Neuron se connecte aux frameworks ML populaires tels que PyTorch et TensorFlow, et la prise en charge de JAX arrivera au début de l'année prochaine. Les clients nous disent que Neuron leur a permis de migrer facilement leurs pipelines de formation et d'inférence de modèles existants vers Trainium et Inferentia avec seulement quelques lignes de code.

Personne d'autre n'offre cette même combinaison de choix des meilleures puces ML, de mise en réseau ultra-rapide, de virtualisation et de clusters hyper-évolutifs. Il n'est donc pas surprenant que certaines des startups d'IA générative les plus connues comme AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway et Stability AI fonctionnent sur AWS. Mais vous avez toujours besoin des bons outils pour exploiter efficacement ce calcul afin de créer, former et exécuter des LLM et autres FM de manière efficace et rentable. Et pour beaucoup de ces startups, Amazon Sage Maker Est la réponse. Qu'il s'agisse de créer et de former un nouveau modèle propriétaire à partir de zéro ou de commencer avec l'un des nombreux modèles populaires accessibles au public, la formation est une entreprise complexe et coûteuse. Il n’est pas non plus facile d’exploiter ces modèles de manière rentable. Les clients doivent acquérir de grandes quantités de données et les préparer. Cela implique généralement beaucoup de travail manuel pour nettoyer les données, supprimer les doublons, les enrichir et les transformer. Ensuite, ils doivent créer et maintenir de grands clusters de GPU/accélérateurs, écrire du code pour distribuer efficacement la formation du modèle entre les clusters, vérifier fréquemment, mettre en pause, inspecter et optimiser le modèle, et intervenir manuellement et résoudre les problèmes matériels dans le cluster. Bon nombre de ces défis ne sont pas nouveaux. C'est l'une des raisons pour lesquelles nous avons lancé SageMaker il y a six ans : pour éliminer les nombreuses barrières liées à la formation et au déploiement des modèles et offrir aux développeurs un moyen beaucoup plus simple. Des dizaines de milliers de clients utilisent Amazon SageMaker, et un nombre croissant d'entre eux, comme LG AI Research, Perplexity AI, AI21, Hugging Face et Stability AI, forment des LLM et d'autres FM sur SageMaker. Tout récemment, le Technology Innovation Institute (créateurs des populaires Falcon LLM) a formé le plus grand modèle accessible au public, le Falcon 180B, sur SageMaker. À mesure que la taille et la complexité des modèles ont augmenté, la portée de SageMaker a également augmenté.

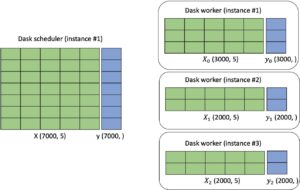

Au fil des années, nous avons ajouté plus de 380 fonctionnalités et capacités révolutionnaires à Amazon SageMaker, telles que le réglage automatique des modèles, la formation distribuée, les options de déploiement de modèles flexibles, les outils pour les OP ML, les outils de préparation des données, les magasins de fonctionnalités, les blocs-notes et l'intégration transparente. avec des évaluations humaines tout au long du cycle de vie du ML et des fonctionnalités intégrées pour une IA responsable. Nous continuons d'innover rapidement pour garantir que les clients de SageMaker soient en mesure de continuer à créer, former et exécuter des inférences pour tous les modèles, y compris les LLM et autres FM. Et nous permettons à nos clients de former et de déployer de grands modèles encore plus facilement et de manière encore plus rentable grâce à deux nouvelles fonctionnalités. Premièrement, pour simplifier la formation, nous Découvrez le tout nouveau HyperPod Amazon SageMaker qui automatise davantage de processus requis pour une formation distribuée à grande échelle et tolérante aux pannes (par exemple, configuration de bibliothèques de formation distribuées, mise à l'échelle des charges de travail de formation sur des milliers d'accélérateurs, détection et réparation des instances défectueuses), accélérant la formation jusqu'à 40 %. En conséquence, des clients comme Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid et d'autres utilisent SageMaker HyperPod pour créer, entraîner ou faire évoluer des modèles. Deuxième, nous introduisons de nouvelles fonctionnalités pour rendre l'inférence plus rentable tout en réduisant la latence. SageMaker aide désormais les clients à déployer plusieurs modèles sur la même instance afin de pouvoir partager des ressources de calcul, réduisant ainsi le coût d'inférence de 50 % (en moyenne). SageMaker surveille également activement les instances qui traitent les demandes d'inférence et achemine intelligemment les demandes en fonction des instances disponibles, ce qui permet d'obtenir une latence d'inférence inférieure de 20 % (en moyenne). Conjecture, Salesforce et Slack utilisent déjà SageMaker pour héberger des modèles en raison de ces optimisations d'inférence.

Couche intermédiaire de la pile : Amazon Bedrock ajoute de nouveaux modèles et une vague de nouvelles fonctionnalités permettant aux clients de créer et de faire évoluer encore plus facilement en toute sécurité des applications d'IA générative.

Même si un certain nombre de clients construiront leurs propres LLM et autres FM, ou feront évoluer un certain nombre d'options accessibles au public, beaucoup ne voudront pas consacrer les ressources et le temps nécessaires pour le faire. Pour eux, la couche intermédiaire de la pile propose ces modèles en tant que service. Notre solution ici, Socle amazonien, permet aux clients de choisir parmi les modèles leaders du secteur d'Anthropic, Stability AI, Meta, Cohere, AI21 et Amazon, de les personnaliser avec leurs propres données et de tirer parti de la sécurité, des contrôles d'accès et des fonctionnalités de pointe auxquels ils sont habitués. dans AWS, le tout via un service géré. Nous avons rendu Amazon Bedrock généralement disponible fin septembre, et la réponse des clients a été extrêmement positive. Des clients du monde entier et de pratiquement tous les secteurs sont ravis d'utiliser Amazon Bedrock. adidas permet aux développeurs d'obtenir des réponses rapides sur tout, depuis les informations de « démarrage » jusqu'aux questions techniques plus approfondies. Booking.com a l'intention d'utiliser l'IA générative pour rédiger des recommandations de voyage sur mesure pour chaque client. Bridgewater Associates développe un assistant d'analyste d'investissement propulsé par LLM pour aider à générer des graphiques, à calculer des indicateurs financiers et à résumer les résultats. Carrier met à la disposition de ses clients des analyses et des informations énergétiques plus précises afin qu'ils réduisent leur consommation d'énergie et leurs émissions de carbone. Clariant offre aux membres de son équipe un chatbot interne à IA générative pour accélérer les processus de R&D, aider les équipes commerciales dans la préparation des réunions et automatiser les e-mails des clients. GoDaddy aide ses clients à créer facilement leur entreprise en ligne en utilisant l'IA générative pour créer leurs sites Web, trouver des fournisseurs, se connecter avec les clients, et bien plus encore. Lexis Nexis Legal & Professional transforme le travail juridique des avocats et augmente leur productivité grâce aux capacités de recherche conversationnelle, de résumé et de rédaction et d'analyse de documents de Lexis+ AI. Le Nasdaq contribue à automatiser les flux de travail d'enquête sur les transactions suspectes et à renforcer ses capacités de lutte contre la criminalité financière et de surveillance. Toutes ces applications d'IA générative, et bien d'autres, s'exécutent sur AWS.

Nous sommes enthousiasmés par l’élan d’Amazon Bedrock, mais il n’en est qu’à ses débuts. Ce que nous avons constaté en travaillant avec nos clients, c'est que tout le monde évolue rapidement, mais l'évolution de l'IA générative se poursuit à un rythme rapide avec de nouvelles options et innovations pratiquement quotidiennes. Les clients découvrent qu'il existe différents modèles qui fonctionnent mieux pour différents cas d'utilisation ou sur différents ensembles de données. Certains modèles sont parfaits pour le résumé, d'autres sont parfaits pour le raisonnement et l'intégration, et d'autres encore ont un support linguistique vraiment impressionnant. Et puis il y a la génération d’images, les cas d’utilisation de recherche, et bien plus encore, tous provenant à la fois de modèles propriétaires et de modèles accessibles à tous. Et à une époque où tant de choses sont inconnaissables, la capacité d’adaptation est sans doute l’outil le plus précieux de tous. Il n’y aura pas de modèle unique pour les gouverner tous. Et certainement pas une seule entreprise technologique fournissant les modèles que tout le monde utilise. Les clients doivent essayer différents modèles. Ils doivent pouvoir basculer entre eux ou les combiner au sein d’un même cas d’utilisation. Cela signifie qu’ils ont besoin d’un véritable choix de prestataires modèles (ce que les événements des 10 derniers jours ont rendu encore plus clair). C'est pourquoi nous avons inventé Amazon Bedrock, pourquoi il résonne si profondément auprès des clients et pourquoi nous continuons à innover et à itérer rapidement pour rendre la construction avec (et le passage entre) une gamme de modèles aussi simple qu'un appel API, en mettant les dernières techniques en œuvre. pour la personnalisation du modèle entre les mains de tous les développeurs, et assurer la sécurité des clients et la confidentialité de leurs données. Nous sommes ravis de présenter plusieurs nouvelles fonctionnalités qui permettront aux clients de créer et de faire évoluer encore plus facilement des applications d'IA générative :

- Choix de modèles élargi avec Anthropic Claude 2.1, Meta Llama 2 70B et des ajouts à la famille Amazon Titan. À l’heure actuelle, les clients continuent d’apprendre et d’expérimenter différents modèles pour déterminer lesquels ils souhaitent utiliser à diverses fins. Ils veulent pouvoir essayer facilement les derniers modèles, et également tester pour voir quelles capacités et fonctionnalités leur donneront les meilleurs résultats et caractéristiques de coût pour leurs cas d'utilisation. Avec Amazon Bedrock, les clients ne sont qu'à un seul appel d'API d'un nouveau modèle. Certains des résultats les plus impressionnants que les clients ont obtenus ces derniers mois proviennent de LLM comme Le modèle Claude d'Anthropic, qui excelle dans un large éventail de tâches, depuis les dialogues sophistiqués et la génération de contenu jusqu'au raisonnement complexe, tout en conservant un degré élevé de fiabilité et de prévisibilité. Les clients rapportent que Claude est beaucoup moins susceptible de produire des sorties nuisibles, plus facile à converser et plus orientable que les autres FM, de sorte que les développeurs peuvent obtenir le résultat souhaité avec moins d'effort. Le modèle de pointe d'Anthropic, Claude 2, obtient des résultats supérieurs au 90e centile aux examens de lecture et d'écriture du GRE, ainsi qu'au raisonnement quantitatif. Et désormais, le nouveau modèle Claude 2.1 est disponible sur Amazon Bedrock. Claude 2.1 offre des fonctionnalités clés aux entreprises, telles qu'une fenêtre contextuelle de 200 2 jetons de pointe (2.0 fois le contexte de Claude 2.1), des taux d'hallucination réduits et des améliorations significatives en termes de précision, même sur de très longues longueurs de contexte. Claude 25 inclut également des invites système améliorées – qui sont des modèles d'instructions offrant une meilleure expérience aux utilisateurs finaux – tout en réduisant le coût des invites et des achèvements de XNUMX %.

Pour un nombre croissant de clients souhaitant utiliser une version gérée du modèle Llama 2 accessible au public de Meta, Amazon Bedrock propose Llama 2 13B et nous ajoutons Llama 2 70B. Llama 2 70B convient aux tâches à grande échelle telles que la modélisation du langage, la génération de texte et les systèmes de dialogue. Les modèles Llama accessibles au public ont été téléchargés plus de 30 millions de fois, et les clients apprécient qu'Amazon Bedrock les propose dans le cadre d'un service géré où ils n'ont pas à se soucier de l'infrastructure ni à disposer d'une expertise approfondie en ML au sein de leurs équipes. De plus, pour la génération d’images, Stability AI propose une suite de modèles texte-image populaires. Stable Diffusion XL 1.0 (SDXL 1.0) est le plus avancé d'entre eux et il est désormais généralement disponible sur Amazon Bedrock.. La dernière édition de ce modèle d'image populaire offre une précision accrue, un meilleur photoréalisme et une résolution plus élevée.

Les clients utilisent également Titan d'Amazonie modèles, qui sont créés et pré-entraînés par AWS pour offrir des fonctionnalités puissantes et très économiques pour une variété de cas d'utilisation. Amazon a 25 ans d'expérience dans le domaine du ML et de l'IA (technologies que nous utilisons dans toutes nos activités) et nous avons beaucoup appris sur la création et le déploiement de modèles. Nous avons soigneusement choisi la manière dont nous entraînons nos modèles et les données que nous utilisons pour ce faire. Nous indemnisons les clients contre les réclamations selon lesquelles nos modèles ou leurs sorties enfreignent les droits d'auteur de quiconque. Nous avons présenté nos premiers modèles Titan en avril de cette année. Titan Texte Lite—maintenant disponible pour tous- est un modèle succinct et rentable pour des cas d'utilisation tels que les chatbots, la synthèse de texte ou la rédaction, et il est également convaincant de l'affiner. Titan Text Express – également désormais disponible pour tous- est plus étendu et peut être utilisé pour un plus large éventail de tâches basées sur du texte, telles que la génération de texte ouvert et le chat conversationnel. Nous proposons ces options de modèle de texte pour donner aux clients la possibilité d'optimiser la précision, les performances et les coûts en fonction de leur cas d'utilisation et des exigences commerciales. Des clients comme Nexxiot, PGA Tour et Ryanair utilisent nos deux modèles Titan Text. Nous disposons également d'un modèle d'intégration, Titan Text Embeddings, pour les cas d'utilisation de recherche et la personnalisation. Des clients comme le Nasdaq constatent d'excellents résultats en utilisant Titan Text Embeddings pour améliorer les capacités de Nasdaq IR Insight afin de générer des informations à partir de plus de 9,000 XNUMX documents d'entreprises mondiales pour les équipes de développement durable, juridiques et comptables. Et nous continuerons d'ajouter de nouveaux modèles à la famille Titan au fil du temps. Nous introduisons un nouveau modèle d'intégration, Titan Multimodal Embeddings., pour alimenter des expériences de recherche et de recommandation multimodales pour les utilisateurs utilisant des images et du texte (ou une combinaison des deux) comme entrées. Et nous sommes introduction d'un nouveau modèle de conversion texte-image, Amazon Titan Image Generator. Avec Titan Image Generator, les clients de secteurs tels que la publicité, le commerce électronique, les médias et le divertissement peuvent utiliser une saisie de texte pour générer des images réalistes de qualité studio en gros volumes et à faible coût. Nous sommes enthousiasmés par la réaction des clients aux modèles Titan et vous pouvez vous attendre à ce que nous continuions à innover dans ce domaine.

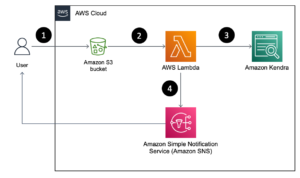

- De nouvelles fonctionnalités pour personnaliser votre application d'IA générative en toute sécurité avec vos données propriétaires: L'une des fonctionnalités les plus importantes d'Amazon Bedrock est la facilité avec laquelle il est possible de personnaliser un modèle. Cela devient vraiment passionnant pour les clients, car c'est là que l'IA générative rencontre leur principal différenciateur : leurs données. Cependant, il est très important que leurs données restent sécurisées, qu’ils en aient le contrôle tout au long du processus et que les améliorations du modèle leur restent confidentielles. Il existe plusieurs façons de procéder, et Amazon Bedrock offre la plus large sélection d'options de personnalisation sur plusieurs modèles). Le premier est le réglage fin. Il est facile de peaufiner un modèle dans Amazon Bedrock. Vous sélectionnez simplement le modèle et Amazon Bedrock en fait une copie. Ensuite, vous pointez quelques exemples étiquetés (par exemple, une série de bonnes paires question-réponse) que vous stockez dans Amazon Simple Storage Service (Amazon S3), et Amazon Bedrock « s'entraîne progressivement » (augmente le modèle copié avec les nouvelles informations). sur ces exemples, et le résultat est un modèle privé, plus précis et plus précis, qui fournit des réponses plus pertinentes et personnalisées. Nous sommes ravis d'annoncer qu'un réglage fin est généralement disponible pour Cohere Command, Meta Llama 2, Amazon Titan Text (Lite et Express), Amazon Titan Multimodal Embeddings et en avant-première pour Amazon Titan Image Generator. Et, grâce à notre collaboration avec Anthropic, nous offrirons bientôt aux clients AWS un accès anticipé à des fonctionnalités uniques pour la personnalisation du modèle et le réglage fin de son modèle de pointe Claude.

Une deuxième technique pour personnaliser les LLM et autres FM pour votre entreprise est la génération augmentée par récupération (RAG), qui vous permet de personnaliser les réponses d'un modèle en augmentant vos invites avec des données provenant de plusieurs sources, notamment des référentiels de documents, des bases de données et des API. En septembre, nous avons introduit une fonctionnalité RAG, Knowledge Bases for Amazon Bedrock, qui connecte en toute sécurité les modèles à vos sources de données propriétaires pour compléter vos invites avec plus d'informations afin que vos applications fournissent des réponses plus pertinentes, contextuelles et précises. Bases de connaissances est désormais généralement disponible avec une API qui exécute l'intégralité du flux de travail RAG de la récupération du texte nécessaire pour augmenter une invite, à l'envoi de l'invite au modèle, au renvoi de la réponse. Les bases de connaissances prennent en charge les bases de données dotées de fonctionnalités vectorielles qui stockent des représentations numériques de vos données (intégrations) que les modèles utilisent pour accéder à ces données pour RAG, notamment Amazon OpenSearch Service, et d'autres bases de données populaires telles que Pinecone et Redis Enterprise Cloud (prise en charge des vecteurs Amazon Aurora et MongoDB à venir). bientôt).

La troisième façon de personnaliser les modèles dans Amazon Bedrock consiste à effectuer une pré-formation continue. Avec cette méthode, le modèle s'appuie sur sa pré-formation originale pour la compréhension générale du langage pour apprendre le langage et la terminologie spécifiques à un domaine. Cette approche s'adresse aux clients qui disposent d'une grande quantité d'informations non étiquetées et spécifiques à un domaine et qui souhaitent permettre à leurs LLM de comprendre le langage, les expressions, les abréviations, les concepts, les définitions et le jargon propres à leur monde (et leur entreprise). Contrairement au réglage fin, qui nécessite une quantité relativement petite de données, la pré-formation continue est effectuée sur de grands ensembles de données (par exemple, des milliers de documents texte). Désormais, des fonctionnalités de pré-formation sont disponibles dans Amazon Bedrock pour Titan Text Lite et Titan Text Express.

- Disponibilité générale de Agents pour le substrat rocheux d’Amazonie pour aider à exécuter des tâches en plusieurs étapes à l'aide de systèmes, de sources de données et des connaissances de l'entreprise. Les LLM sont excellents pour avoir des conversations et générer du contenu, mais les clients veulent que leurs applications puissent do encore plus : prendre des mesures, résoudre des problèmes et interagir avec une gamme de systèmes pour effectuer des tâches en plusieurs étapes telles que la réservation d'un voyage, le dépôt de réclamations d'assurance ou la commande de pièces de rechange. Et Amazon Bedrock peut vous aider à relever ce défi. Avec les agents, les développeurs sélectionnent un modèle, rédigent quelques instructions de base telles que « vous êtes un agent du service client joyeux » et « vérifiez la disponibilité des produits dans le système d'inventaire », pointez le modèle sélectionné vers les bonnes sources de données et les bons systèmes d'entreprise (par exemple, CRM). ou applications ERP) et écrivez quelques fonctions AWS Lambda pour exécuter les API (par exemple, vérifier la disponibilité d'un article dans l'inventaire ERP). Amazon Bedrock analyse automatiquement la demande et la décompose en une séquence logique à l'aide des capacités de raisonnement du modèle sélectionné pour déterminer quelles informations sont nécessaires, quelles API appeler et quand les appeler pour terminer une étape ou résoudre une tâche. Désormais disponibles pour tous, les agents peuvent planifier et effectuer la plupart des tâches commerciales (de la réponse aux questions des clients sur la disponibilité de vos produits à la prise de leurs commandes) et les développeurs n'ont pas besoin d'être familiers avec l'apprentissage automatique, les invites des ingénieurs, la formation de modèles ou la connexion manuelle des systèmes. Et Bedrock fait tout cela de manière sécurisée et privée, et des clients comme Druva et Athene les utilisent déjà pour améliorer la précision et la vitesse de développement de leurs applications d'IA générative.

- Léger Garde-corps pour le substrat rocheux amazonien afin que vous puissiez appliquer des mesures de protection en fonction des exigences de votre cas d'utilisation et de vos politiques d'IA responsable. Les clients veulent être sûrs que les interactions avec leurs applications d'IA sont sûres, éviter les propos toxiques ou offensants, rester pertinents pour leur entreprise et s'aligner sur leurs politiques d'IA responsable. Grâce aux garde-fous, les clients peuvent spécifier les sujets à éviter, et Amazon Bedrock ne fournira aux utilisateurs que des réponses approuvées aux questions appartenant à ces catégories restreintes. Par exemple, une application bancaire en ligne peut être mise en place pour éviter de fournir des conseils en investissement et supprimer les contenus inappropriés (tels que les discours de haine et la violence). Début 2024, les clients pourront également supprimer les informations personnelles identifiables (PII) dans les réponses des modèles. Par exemple, après qu'un client interagit avec un agent du centre d'appels, la conversation du service client est souvent résumée à des fins de tenue de registres, et des garde-fous peuvent supprimer les informations personnelles de ces résumés. Les garde-corps peuvent être utilisés sur tous les modèles d'Amazon Bedrock (y compris les modèles affinés) et avec les agents pour Amazon Bedrock afin que les clients puissent apporter un niveau de protection cohérent à toutes leurs applications d'IA générative.

Couche supérieure de la pile : l'innovation continue rend l'IA générative accessible à un plus grand nombre d'utilisateurs

Au sommet de la pile se trouvent les applications qui exploitent les LLM et autres FM afin que vous puissiez profiter de l'IA générative au travail. Un domaine dans lequel l’IA générative change déjà la donne est celui du codage. L'année dernière, nous avons introduit Amazon CodeWhisperer, qui vous aide à créer des applications plus rapidement et de manière plus sécurisée en générant des suggestions et des recommandations de code en temps quasi réel. Des clients comme Accenture, Boeing, Bundesliga, The Cigna Group, Kone et Warner Music Group utilisent CodeWhisperer pour augmenter la productivité des développeurs. Accenture permet à jusqu'à 50,000 XNUMX de ses développeurs de logiciels et professionnels de l'informatique d'utiliser Amazon CodeWhisperer. Nous souhaitons que le plus grand nombre de développeurs possible puissent bénéficier des avantages de productivité de l'IA générative, c'est pourquoi CodeWhisperer propose des recommandations gratuites à tous.

Cependant, même si les outils de codage d'IA contribuent grandement à faciliter la vie des développeurs, leurs gains en termes de productivité sont limités par leur manque de connaissances des bases de code internes, des API internes, des bibliothèques, des packages et des classes. Une façon d'y penser est que si vous embauchez un nouveau développeur, même s'il est de classe mondiale, il ne sera pas aussi productif dans votre entreprise tant qu'il n'aura pas compris vos meilleures pratiques et votre code. Les outils de codage basés sur l'IA d'aujourd'hui sont comme ce développeur nouvellement embauché. Pour vous aider, nous avons récemment présenté en avant-première un nouveau capacité de personnalisation dans Amazon CodeWhisperer qui exploite en toute sécurité la base de code interne d'un client pour fournir des recommandations de code plus pertinentes et plus utiles. Avec cette capacité, CodeWhisperer est un expert en Un flux efficace peut augmenter code et fournit des recommandations plus pertinentes pour gagner encore plus de temps. Dans une étude que nous avons réalisée avec Persistent, une société mondiale d'ingénierie numérique et de modernisation d'entreprise, nous avons constaté que les personnalisations aident les développeurs à accomplir des tâches jusqu'à 28 % plus rapidement qu'avec les capacités générales de CodeWhisperer. Désormais, un développeur d'une entreprise de technologie de la santé peut demander à CodeWhisperer « d'importer les images IRM associées à l'identifiant client et de les exécuter via le classificateur d'images » pour détecter les anomalies. Étant donné que CodeWhisperer a accès à la base de code, il peut fournir des suggestions beaucoup plus pertinentes, notamment les emplacements d'importation des images IRM et les identifiants client. CodeWhisperer garde les personnalisations totalement privées et le FM sous-jacent ne les utilise pas à des fins de formation, protégeant ainsi la précieuse propriété intellectuelle des clients. AWS est le seul grand fournisseur de cloud à offrir une telle fonctionnalité à tout le monde.

Léger Amazon Q, l'assistant génératif alimenté par l'IA conçu pour le travail

Les développeurs ne sont certainement pas les seuls à se lancer dans l’IA générative : des millions de personnes utilisent des applications de chat génératives. Ce que les premiers fournisseurs ont fait dans ce domaine est passionnant et extrêmement utile pour les consommateurs, mais à bien des égards, ils ne « fonctionnent » pas vraiment au travail. Leurs connaissances générales et leurs capacités sont excellentes, mais ils ne connaissent pas votre entreprise, vos données, vos clients, vos opérations ou votre activité. Cela limite la mesure dans laquelle ils peuvent vous aider. Ils ne savent pas non plus grand-chose de votre rôle : quel travail vous faites, avec qui vous travaillez, quelles informations vous utilisez et à quoi vous avez accès. Ces limitations sont compréhensibles car ces assistants n'ont pas accès aux informations privées de votre entreprise et n'ont pas été conçus pour répondre aux exigences de confidentialité et de sécurité des données dont les entreprises ont besoin pour leur accorder cet accès. Il est difficile de renforcer la sécurité après coup et de s'attendre à ce qu'elle fonctionne correctement. Nous pensons avoir une meilleure solution, qui permettra à chaque personne dans chaque organisation d'utiliser l'IA générative en toute sécurité dans son travail quotidien.

WNous sommes ravis de vous présenter Amazon Q, un nouveau type d'assistant génératif basé sur l'IA, spécifiquement destiné au travail et pouvant être adapté à votre entreprise. Q peut vous aider à obtenir des réponses rapides et pertinentes à des questions urgentes, à résoudre des problèmes, à générer du contenu et à prendre des mesures en utilisant les données et l'expertise trouvées dans les référentiels d'informations, le code et les systèmes d'entreprise de votre entreprise. Lorsque vous discutez avec Amazon Q, il fournit des informations et des conseils immédiats et pertinents pour vous aider à rationaliser les tâches, à accélérer la prise de décision et à stimuler la créativité et l'innovation au travail. Nous avons conçu Amazon Q pour qu'il soit sécurisé et privé, et il peut comprendre et respecter vos identités, rôles et autorisations existants et utiliser ces informations pour personnaliser ses interactions. Si un utilisateur n'est pas autorisé à accéder à certaines données sans Q, il ne peut pas non plus y accéder en utilisant Q. Nous avons conçu Amazon Q pour répondre dès le premier jour aux exigences strictes des entreprises clientes : aucun de leur contenu n'est utilisé pour améliorer les modèles sous-jacents.

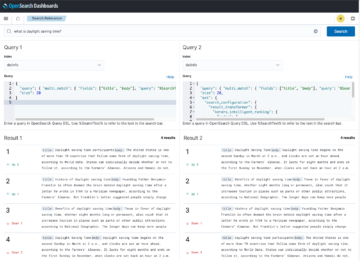

Amazon Q est votre assistant expert pour construire sur AWS: Nous avons formé Amazon Q sur 17 ans de connaissances et d'expérience AWS afin qu'il puisse transformer la façon dont vous créez, déployez et exploitez des applications et des charges de travail sur AWS. Amazon Q dispose d'une interface de discussion dans la console de gestion AWS et la documentation, votre IDE (via CodeWhisperer) et les salles de discussion de votre équipe sur Slack ou d'autres applications de discussion. Amazon Q peut vous aider à explorer de nouvelles fonctionnalités AWS, à démarrer plus rapidement, à apprendre des technologies inconnues, à concevoir des solutions, à dépanner, à mettre à niveau et bien plus encore : c'est un expert des modèles AWS bien architecturés, des meilleures pratiques, de la documentation et des implémentations de solutions. Voici quelques exemples de ce que vous pouvez faire avec votre nouvel assistant expert AWS :

- Obtenez des réponses précises et des conseils sur les fonctionnalités, services et solutions AWS : Demandez à Amazon Q de « Parlez-moi des agents pour Amazon Bedrock » et Q vous donnera une description de la fonctionnalité ainsi que des liens vers des documents pertinents. Vous pouvez également poser à Amazon Q pratiquement n'importe quelle question sur le fonctionnement d'un service AWS (par exemple, « Quelles sont les limites de mise à l'échelle sur une table DynamoDB ? » « Qu'est-ce que Redshift Managed Storage ? »), ou sur la meilleure façon d'architecturer un certain nombre de solutions ( « Quelles sont les bonnes pratiques pour construire des architectures événementielles ? »). Et Amazon Q rassemblera des réponses succinctes et citera toujours (et créera un lien vers) ses sources.

- Choisissez le meilleur service AWS pour votre cas d'utilisation et démarrez rapidement : Demandez à Amazon Q « Quelles sont les manières de créer une application Web sur AWS ? » et il fournira une liste de services potentiels comme AWS Amplifier, AWS Lambdaet une Amazon EC2 avec les avantages de chacun. À partir de là, vous pouvez affiner les options en aidant Q à comprendre vos exigences, préférences et contraintes (par exemple, « Laquelle de ces options serait la meilleure si je souhaite utiliser des conteneurs ? » ou « Dois-je utiliser une base de données relationnelle ou non relationnelle ? »). Terminez par « Comment puis-je commencer ? » et Amazon Q présentera quelques étapes de base et vous orientera vers des ressources supplémentaires.

- Optimisez vos ressources de calcul : Amazon Q peut vous aider à sélectionner des instances Amazon EC2. Si vous lui demandez « Aidez-moi à trouver la bonne instance EC2 pour déployer une charge de travail d'encodage vidéo pour mon application de jeu avec les performances les plus élevées », Q vous obtiendra une liste de familles d'instances avec les raisons de chaque suggestion. Et vous pouvez poser un certain nombre de questions de suivi pour vous aider à trouver le meilleur choix pour votre charge de travail.

- Obtenez de l'aide pour déboguer, tester et optimiser votre code : Si vous rencontrez une erreur lors du codage dans votre IDE, vous pouvez demander de l'aide à Amazon Q en disant : « Mon code contient une erreur d'E/S, pouvez-vous fournir un correctif ? et Q générera le code pour vous. Si vous aimez la suggestion, vous pouvez demander à Amazon Q d'ajouter le correctif à votre application. Étant donné qu'Amazon Q est dans votre IDE, il comprend le code sur lequel vous travaillez et sait où insérer le correctif. Amazon Q peut également créer des tests unitaires (« Écrire des tests unitaires pour la fonction sélectionnée ») qu'il peut insérer dans votre code et que vous pouvez exécuter. Enfin, Amazon Q peut vous indiquer des moyens d'optimiser votre code pour de meilleures performances. Demandez à Q de « Optimiser ma requête DynamoDB sélectionnée » et il utilisera sa compréhension de votre code pour fournir une suggestion en langage naturel sur ce qu'il faut corriger ainsi que le code d'accompagnement que vous pouvez implémenter en un clic.

- Diagnostiquer et résoudre les problèmes : Si vous rencontrez des problèmes dans AWS Management Console, comme des erreurs d'autorisations EC2 ou des erreurs de configuration Amazon S3, vous pouvez simplement appuyer sur le bouton « Dépanner avec Amazon Q », et il utilisera sa compréhension du type d'erreur et du service où se trouve l'erreur. pour vous donner des suggestions pour un correctif. Vous pouvez même demander à Amazon Q de dépanner votre réseau (par exemple, « Pourquoi ne puis-je pas me connecter à mon instance EC2 via SSH ? ») et Q analysera votre configuration de bout en bout et fournira un diagnostic (par exemple, « Cette instance semble se trouver dans un sous-réseau privé, il faudra donc peut-être établir une accessibilité publique »).

- Développez une nouvelle base de code en un rien de temps : Lorsque vous discutez avec Amazon Q dans votre IDE, il combine son expertise en matière de création de logiciels avec une compréhension de votre code : une association puissante ! Auparavant, si vous repreniez un projet de quelqu'un d'autre ou si vous étiez nouveau dans l'équipe, vous deviez peut-être passer des heures à réviser manuellement le code et la documentation pour comprendre comment il fonctionne et à quoi il sert. Désormais, étant donné qu'Amazon Q comprend le code de votre IDE, vous pouvez simplement demander à Amazon Q d'expliquer le code (« Fournissez-moi une description de ce que fait cette application et de son fonctionnement ») et Q vous donnera des détails tels que les services qu'il utilise. le code utilise et ce que font les différentes fonctions (par exemple, Q pourrait répondre par quelque chose comme : « Cette application construit un système de ticket de support de base à l'aide de Python Flask et AWS Lambda » et continuer en décrivant chacune de ses fonctionnalités principales, comment elles sont implémentées, et beaucoup plus).

- Effacez votre retard de fonctionnalités plus rapidement : Vous pouvez même demander à Amazon Q de vous guider et d'automatiser une grande partie du processus de bout en bout d'ajout d'une fonctionnalité à votre application dans Amazon CodeCatalyst, notre service de développement logiciel unifié pour les équipes. Pour ce faire, il vous suffit d'attribuer à Q une tâche de backlog à partir de votre liste de problèmes – tout comme vous le feriez pour un coéquipier – et Q génère un plan étape par étape sur la manière dont il va créer et mettre en œuvre la fonctionnalité. Une fois que vous aurez approuvé le plan, Q rédigera le code et vous présentera les modifications suggérées sous forme de révision du code. Vous pouvez demander une refonte (si nécessaire), approuver et/ou déployer !

- Mettez à niveau votre code en une fraction du temps : La plupart des développeurs ne consacrent en réalité qu’une fraction de leur temps à écrire du nouveau code et à créer de nouvelles applications. Ils consacrent beaucoup plus de temps à des domaines pénibles et difficiles comme la maintenance et les mises à niveau. Effectuez des mises à niveau de la version linguistique. Un grand nombre de clients continuent d'utiliser des versions plus anciennes de Java, car la mise à niveau prendra des mois, voire des années, et des milliers d'heures de développement. Reporter cette opération comporte des coûts et des risques réels : vous passez à côté d'améliorations de performances et vous êtes vulnérable aux problèmes de sécurité. Nous pensons qu'Amazon Q peut changer la donne ici et nous sommes enthousiasmés par cette idée. Transformation du code Amazon Q, une fonctionnalité qui peut supprimer une grande partie de cette lourde tâche et réduire le temps nécessaire à la mise à niveau des applications de quelques jours à quelques minutes. Il vous suffit d'ouvrir le code que vous souhaitez mettre à jour dans votre IDE et de demander à Amazon Q de « /transformer » votre code. Amazon Q analysera l'intégralité du code source de l'application, générera le code dans la langue et la version cibles et exécutera des tests, vous aidant ainsi à réaliser les améliorations de sécurité et de performances des dernières versions linguistiques. Récemment, une très petite équipe de développeurs Amazon a utilisé Amazon Q Code Transformation pour mettre à niveau 1,000 8 applications de production de Java 17 vers Java 10 en seulement deux jours. Le temps moyen par application était inférieur à 8 minutes. Aujourd'hui, Amazon Q Code Transformation effectue des mises à niveau du langage Java de Java 11 ou Java 17 vers Java XNUMX. La prochaine étape (et bientôt) sera la possibilité de transformer .NET Framework en .NET multiplateforme (avec encore plus de transformations à suivre dans le futur). .

Amazon Q est votre expert métier: Vous pouvez connecter Amazon Q aux données, informations et systèmes de votre entreprise afin qu'il puisse tout synthétiser et fournir une assistance personnalisée pour aider les gens à résoudre des problèmes, à générer du contenu et à prendre des mesures pertinentes pour votre entreprise. Intégrer Amazon Q à votre entreprise est simple. Il dispose de plus de 40 connecteurs intégrés vers des systèmes d'entreprise populaires tels qu'Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive et Zendesk. Il peut également se connecter à votre intranet interne, à vos wikis et à vos livres d'exécution, et avec le SDK Amazon Q, vous pouvez établir une connexion à l'application interne de votre choix. Dirigez Amazon Q vers ces référentiels, et il « accélérera » votre activité, en capturant et en comprenant les informations sémantiques qui rendent votre entreprise unique. Ensuite, vous obtenez votre propre application Web Amazon Q simple et conviviale afin que les employés de votre entreprise puissent interagir avec l'interface conversationnelle. Amazon Q se connecte également à votre fournisseur d'identité pour comprendre un utilisateur, son rôle et les systèmes auxquels il est autorisé à accéder afin que les utilisateurs puissent poser des questions détaillées et nuancées et obtenir des résultats personnalisés qui incluent uniquement les informations qu'ils sont autorisés à voir. Amazon Q génère des réponses et des informations précises et fidèles au matériel et aux connaissances que vous lui fournissez, et vous pouvez restreindre les sujets sensibles, bloquer des mots clés ou filtrer les questions et réponses inappropriées. Voici quelques exemples de ce que vous pouvez faire avec le nouvel assistant expert de votre entreprise :

- Obtenez des réponses claires et ultra pertinentes basées sur les données et informations de votre entreprise : Les employés peuvent interroger Amazon Q sur tout ce qu'ils auraient pu devoir rechercher auparavant dans toutes sortes de sources. Demandez « Quelles sont les dernières directives concernant l'utilisation du logo ? » ou « Comment puis-je demander une carte de crédit d'entreprise ? », et Amazon Q synthétisera tout le contenu pertinent qu'il trouve et reviendra avec des réponses rapides ainsi que des liens vers les contenus pertinents. sources (par exemple, portails de marque et référentiels de logos, politiques de frais et déplacement de l'entreprise et applications de cartes).

- Rationalisez les communications quotidiennes : Il suffit de demander et Amazon Q peut générer du contenu (« Créez un article de blog et trois titres sur les réseaux sociaux annonçant le produit décrit dans cette documentation »), créer des résumés (« Rédiger un résumé de la transcription de notre réunion avec une liste à puces d'actions » ), fournir des mises à jour par e-mail (« Rédiger un e-mail mettant en avant nos programmes de formation du troisième trimestre pour les clients en Inde ») et aider à structurer les réunions (« Créer un ordre du jour de réunion pour parler du dernier rapport de satisfaction client »).

- Tâches accomplies : Amazon Q peut aider à accomplir certaines tâches, réduisant ainsi le temps que les employés consacrent à des tâches répétitives comme le dépôt de tickets. Demandez à Amazon Q de « résumer les commentaires des clients sur la nouvelle offre tarifaire dans Slack », puis demandez à Q de prendre ces informations et d'ouvrir un ticket dans Jira pour informer l'équipe marketing. Vous pouvez demander à Q de « Résumer la transcription de cet appel », puis d'« Ouvrir un nouveau dossier pour le client A dans Salesforce ». Amazon Q prend en charge d'autres outils d'automatisation du travail populaires tels que Zendesk et Service Now.

Amazon Q est dans Amazon QuickSight : Avec Amazon Q dans QuickSight, le service de business intelligence d'AWS, les utilisateurs peuvent poser sur leurs tableaux de bord des questions telles que « Pourquoi le nombre de commandes a-t-il augmenté le mois dernier ? » et obtenez des visualisations et des explications sur les facteurs qui ont influencé l'augmentation. Et les analystes peuvent utiliser Amazon Q pour réduire le temps nécessaire à la création de tableaux de bord de quelques jours à quelques minutes avec une simple invite telle que « Montrez-moi les ventes par région et par mois sous forme de graphique à barres empilées ». Q revient immédiatement avec ce diagramme, et vous pouvez facilement l'ajouter à un tableau de bord ou discuter davantage avec Q pour affiner la visualisation (par exemple, « Changer le graphique à barres en diagramme Sankey » ou « Afficher les pays au lieu des régions »). Amazon Q dans QuickSight facilite également l'utilisation des tableaux de bord existants pour informer les parties prenantes de l'entreprise, distiller des informations clés et simplifier la prise de décision à l'aide d'histoires de données. Par exemple, les utilisateurs peuvent demander à Amazon Q de « Construire une histoire sur la façon dont l'entreprise a changé au cours du mois dernier pour une analyse commerciale avec la haute direction », et en quelques secondes, Amazon Q fournit une histoire basée sur des données qui est visuellement convaincante et est entièrement personnalisable. Ces histoires peuvent être partagées en toute sécurité dans toute l’organisation pour aider à aligner les parties prenantes et à prendre de meilleures décisions.

Amazon Q est dans Amazon Connect : Dans Amazon Connect, notre service de centre de contact, Amazon Q aide vos agents du service client à fournir un meilleur service client. Amazon Q exploite les référentiels de connaissances que vos agents utilisent généralement pour obtenir des informations pour les clients, puis les agents peuvent discuter avec Amazon Q directement dans Connect pour obtenir des réponses qui les aident à répondre plus rapidement aux demandes des clients sans avoir besoin de rechercher eux-mêmes dans la documentation. Et même si discuter avec Amazon Q pour obtenir des réponses ultra-rapides est formidable, dans le service client, il n'y a rien de trop rapide. C'est pourquoi Amazon Q en connexion transforme une conversation client en direct avec un agent en une invite et fournit automatiquement à l'agent des réponses possibles, des actions suggérées et des liens vers des ressources. Par exemple, Amazon Q peut détecter qu'un client contacte une société de location de voitures pour modifier sa réservation, générer une réponse permettant à l'agent de communiquer rapidement comment les politiques de frais de modification de l'entreprise s'appliquent et guider l'agent à travers les étapes dont il a besoin pour mettre à jour la réservation. réservation.

Amazon Q est dans AWS Supply Chain (à venir) : Dans AWS Supply Chain, notre service d'analyse de la chaîne d'approvisionnement, Amazon Q aide les planificateurs de l'offre et de la demande, les gestionnaires de stocks et les partenaires commerciaux à optimiser leur chaîne d'approvisionnement en résumant et en mettant en évidence les risques potentiels de rupture de stock ou de surstock, et en visualisant des scénarios pour résoudre le problème. Les utilisateurs peuvent poser à Amazon Q des questions « quoi », « pourquoi » et « et si » sur les données de leur chaîne d'approvisionnement et discuter de scénarios complexes et des compromis entre les différentes décisions de la chaîne d'approvisionnement. Par exemple, un client peut demander : « Quelle est la cause du retard de mes expéditions et comment puis-je accélérer les choses ? » à quoi Amazon Q peut répondre : « 90 % de vos commandes sont sur la côte Est, et une grosse tempête dans le Sud-Est provoque un retard de 24 heures. Si vous expédiez vers le port de New York au lieu de Miami, vous accélérerez les livraisons et réduisez les coûts de 50 %.

Nos clients adoptent rapidement l'IA générative : ils forment des modèles révolutionnaires sur AWS, ils développent des applications d'IA générative à une vitesse record à l'aide d'Amazon Bedrock et ils déploient des applications révolutionnaires au sein de leurs organisations comme Amazon Q. Avec nos dernières annonces, AWS apporte aux clients encore plus de performances, de choix et d'innovation à chaque couche de la pile. L'impact combiné de toutes les fonctionnalités que nous proposons chez re:Invent marque une étape majeure vers l'atteinte d'un objectif passionnant et significatif : nous rendons l'IA générative accessible aux clients de toutes tailles et de toutes capacités techniques afin qu'ils puissent réinventer et transformer ce qu'ils font. est possible.

Resources

À propos de l’auteur

Swami Sivasubramanian est vice-président des données et de l'apprentissage automatique chez AWS. Dans ce rôle, Swami supervise tous les services AWS Database, Analytics, AI & Machine Learning. La mission de son équipe est d'aider les organisations à exploiter leurs données avec une solution de données complète et de bout en bout pour stocker, accéder, analyser, visualiser et prévoir.

Swami Sivasubramanian est vice-président des données et de l'apprentissage automatique chez AWS. Dans ce rôle, Swami supervise tous les services AWS Database, Analytics, AI & Machine Learning. La mission de son équipe est d'aider les organisations à exploiter leurs données avec une solution de données complète et de bout en bout pour stocker, accéder, analyser, visualiser et prévoir.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :possède

- :est

- :ne pas

- :où

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- capacités

- capacité

- Capable

- A Propos

- au dessus de

- accélérer

- accéléré

- accélérateurs

- Accenture

- accès

- accessibilité

- accessible

- Comptabilité

- précision

- Avec cette connaissance vient le pouvoir de prendre

- acquérir

- à travers

- Action

- actes

- activement

- actually

- adapter

- ajouter

- ajoutée

- ajoutant

- ajout

- Supplémentaire

- En outre

- ajouts

- Ajoute

- Adidas

- Adobe

- L'adoption d'

- Avancée

- de suivre

- Avantage

- avantages

- Numérique

- conseils

- Après

- à opposer à

- ordre du jour

- Agent

- agents

- agrégat

- depuis

- AI

- AI et apprentissage automatique

- AI chatbot

- recherche ai

- Alimenté par l'IA

- aligner

- Tous

- permettre

- permet

- le long de

- déjà

- aussi

- toujours

- Amazon

- Chuchoteur de code Amazon

- Amazon EC2

- Amazon QuickSight

- Amazon Sage Maker

- Amazon Web Services

- montant

- quantités

- an

- selon une analyse de l’Université de Princeton

- analyste

- Analystes

- analytique

- il analyse

- des analyses

- ainsi que

- Annoncer

- Nombre d'annonces

- Annoncer

- répondre

- réponses

- Anthropique

- tous

- chacun.e

- quoi que ce soit d'artificiel

- api

- Apis

- appli

- apparaît

- Application

- applications

- Appliquer

- apprécier

- une approche

- approuver

- ,

- applications

- Avril

- SONT

- Réservé

- domaines

- étant

- autour

- AS

- demander

- Assistance

- Assistante gérante

- assistants

- associé

- associés

- At

- Atlassian

- augmenter

- augmentée

- augmentations

- Aurora

- autorisé

- automatiser

- Automates

- Automatique

- automatiquement

- Automation

- l'automobile

- disponibilité

- disponibles

- moyen

- éviter

- et

- AWS

- Inférence AWS

- AWS Lambda

- Console de gestion AWS

- RETOUR

- Services bancaires

- barre

- obstacles

- base

- basé

- Essentiel

- BE

- car

- devient

- était

- a commencé

- CROYONS

- avantages.

- LES MEILLEURS

- les meilleures pratiques

- Améliorée

- jusqu'à XNUMX fois

- Big

- Milliards

- milliards

- Block

- Blocs

- Blog

- Boeing

- Volt (Bolt)

- Réserver

- Booking.com

- Livres

- tous les deux

- Bas et Leggings

- frontières

- brand

- Pause

- pauses

- apporter

- Apporter

- construire

- Développement

- construit

- construit

- intégré

- la performance des entreprises

- l'intelligence d'entreprise

- entreprises

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- Appelez-nous

- centres d'appel

- CAN

- Peut obtenir

- capacités

- aptitude

- capable

- Compétences

- Capturer

- fournisseur

- carbone

- émissions de carbone

- carte

- prudemment

- maisons

- cas

- catégories

- causer

- Canaux centraux

- certaines

- Assurément

- chaîne

- challenge

- globaux

- Change

- modifié

- Échangeur

- Modifications

- en changeant

- caractéristiques

- Graphique

- Charts

- salles de chat

- Chatbot

- Chatbots

- bavardage

- vérifier

- puce

- chips

- le choix

- Selectionnez

- choose

- choisi

- prétentions

- les classes

- Nettoyage

- clair

- cliquez

- le cloud

- infrastructure de cloud

- Grappe

- regroupement

- Côte

- code

- base de code

- Examen du code

- Codage

- collaboration

- collaboration

- COM

- combinaison

- combiner

- combiné

- moissonneuses-batteuses

- comment

- vient

- Venir

- À venir

- communiquer

- Communications

- Sociétés

- Société

- De l'entreprise

- par rapport

- irrésistible

- complet

- complètement

- complexe

- complexité

- complet

- calcul

- concepts

- configuration

- Configurer

- conjecture

- NOUS CONTACTER

- connecté

- connexion

- Connectivité

- connecte

- cohérent

- Console

- contraintes

- Les consommateurs

- consommation

- contact

- centre de contact

- Conteneurs

- contenu

- contexte

- contextuel

- continuer

- a continué

- continue

- continue

- des bactéries

- contrôles

- Conversation

- de la conversation

- conversations

- droit d'auteur

- écriture de copie

- Core

- Prix

- rentable

- Costs

- d'exportation

- Cox

- engendrent

- créée

- notre créativité

- créateurs

- crédit

- carte de crédit

- Criminalité

- CROUSTILLANT

- CRM

- multiplate-forme

- des clients

- expérience client

- Satisfaction client

- Service à la clientèle

- Clients

- personnalisables

- personnalisation

- personnaliser

- sont adaptées

- Cut/Taille

- cycles

- Tous les jours

- tableau de bord

- tableaux de bord

- données

- Préparation des données

- confidentialité des données

- Confidentialité et sécurité des données

- ensembles de données

- data-driven

- Base de données

- bases de données

- Databricks

- journée

- jour après jour

- jours

- La prise de décision

- décisions

- profond

- l'apprentissage en profondeur

- profond

- définitions

- Degré

- retarder

- livrer

- Livraisons

- livrer

- offre

- Demande

- Démocratiser

- Selon

- déployer

- déployé

- déployer

- déploiement

- profondeur

- décrire

- décrit

- la description

- un

- voulu

- détaillé

- détails

- détecter

- Déterminer

- DEUTSCHE TÉLÉCOM

- Développeur

- mobiles

- développement

- Développement

- diagnostic

- dialogue

- Dialogue

- DID

- différent

- La diffusion

- numérique

- directement

- distribuer

- distribué

- formation distribuée

- distribuer

- do

- document

- Documentation

- INSTITUTIONNELS

- Ne fait pas

- faire

- fait

- Ne pas

- doubler

- down

- motivation

- deux

- doublons

- durée

- e

- e-commerce

- chacun

- "Early Bird"

- plus facilement

- même

- Est

- cote est

- Easy

- Économie

- édition

- de manière efficace

- efficace

- efficacement

- effort

- non plus

- d'autre

- emails

- Emissions

- employés

- vous accompagner

- l'autonomisation des

- permettre

- permettant

- codage

- rencontre

- fin

- end-to-end

- énergie

- Consommation d'énergie

- l'efficacité énergétique

- ingénieur

- ENGINEERING

- de renforcer

- améliorations

- enrichissant

- Entreprise

- niveau entreprise

- entreprises

- Divertissement

- Tout

- enveloppe

- Ère

- ERP

- erreur

- Erreurs

- Ether (ETH)

- évaluations

- Pourtant, la

- événements

- JAMAIS

- Chaque

- tout le monde

- peut

- évolution

- évolue

- exemple

- exemples

- excité

- passionnant

- exécuter

- exécutif

- existant

- expansif

- attendre

- accélérer

- cher

- d'experience

- expérimenté

- Expériences

- expert

- nous a permis de concevoir

- Expliquer

- explorez

- express

- .

- Visage

- fait

- facteurs

- équitablement

- fidèle

- faucon

- Automne

- familier

- familles

- famille

- RAPIDE

- plus rapide

- défectueux

- Fonctionnalité

- Fonctionnalités:

- frais

- Réactions

- few

- Dépôt

- une fonction filtre

- finalement

- la traduction de documents financiers

- Trouvez

- trouver

- trouve

- fin

- finition

- Prénom

- Fixer

- flexible

- concentré

- suivre

- Pour

- Pour les consommateurs

- Avant

- trouvé

- Fondation

- quatre

- fraction

- Framework

- cadres

- gratuitement ici

- fréquemment

- friendly

- De

- fonctions

- plus

- avenir

- jeu

- changeur de jeu

- jeux

- Général

- généralement

- générer

- génère

- générateur

- génération

- génératif

- IA générative

- générateur

- obtenez

- obtention

- Donner

- Global

- numérique mondial

- gmail

- Go

- objectif

- aller

- Bien

- GPU

- GPU

- l'

- Sol

- révolutionnaire

- Réservation de groupe

- Croissance

- cultivé

- l'orientation

- guide

- lignes directrices

- ait eu

- Mains

- EN COURS

- Dur

- Matériel

- nuisible

- haine

- discours de haine

- Vous avez

- ayant

- Titres

- la médecine

- lourd

- levage de charges lourdes

- vous aider

- aider

- aide

- ici

- Haute

- augmentation

- le plus élevé

- Soulignant

- très

- louer

- sa

- hébergement

- HEURES

- Comment

- How To

- Cependant

- HTTPS

- Des centaines

- i

- ID

- identités

- Identite

- ids

- if

- image

- génération d'image

- satellite

- Immédiat

- Impact

- Mettre en oeuvre

- implémentations

- mis en œuvre

- importer

- important

- impressionnant

- améliorer

- amélioré

- améliorations

- in

- comprendre

- inclut

- Y compris

- Améliore

- increased

- croissant

- Indicateurs

- individus

- secteurs

- industrie

- leader de l'industrie

- influencé

- info

- informer

- d'information

- Infrastructure

- innovons

- innover

- Innovation

- innovations

- technologie innovante

- contribution

- entrées

- perspicacité

- idées.

- instance

- cas

- plutôt ;

- Institut

- Des instructions

- Assurance

- l'intégration

- intellectuel

- propriété intellectuelle

- Intelligence

- a l'intention

- interagir

- interactions

- interagit

- interconnecté

- Interfaces

- interne

- intervenir

- développement

- introduire

- introduit

- Découvrez le tout nouveau

- A inventé

- inventaire

- Investir

- enquête

- sueñortiendo

- un investissement

- Investissements

- impliqué

- implique

- vous aider à faire face aux problèmes qui vous perturbent

- IT

- Professionnels de l'informatique

- SES

- Japonais

- jargon

- Java

- jpg

- juste

- juste un

- XNUMX éléments à

- en gardant

- ACTIVITES

- Zones-clés

- mots clés

- kit

- Trousse (SDK)

- Savoir

- spécialisées

- sait

- Labs

- Peindre

- langue

- gros

- grande échelle

- le plus grand

- Nom

- L'année dernière

- En retard

- Latence

- Nouveautés

- lancé

- lancement

- Les avocats.

- couche

- poules pondeuses

- Leadership

- conduisant

- APPRENTISSAGE

- savant

- apprentissage

- Légal

- moins

- Allons-y

- Niveau

- Levier

- les leviers

- LexisNexis

- LG

- bibliothèques

- vos produits

- lifting

- comme

- Probable

- limites

- limité

- limites

- lignes

- LINK

- Gauche

- Liste

- le travail

- Vit

- Flamme

- situé

- emplacements

- logique

- logo

- Location

- de longue date

- Lot

- love

- Faible

- baisser

- le plus bas

- click

- machine learning

- LES PLANTES

- maintenir

- le maintien

- facile

- majeur

- a prendre une

- FAIT DU

- Fabrication

- gérés

- gestion

- Gestionnaires

- Manuel

- travail manuel

- manuellement

- de nombreuses

- Stratégie

- Matériel

- matières premières.

- maximales

- Mai..

- me

- significative

- veux dire

- Médias

- Découvrez

- réunion

- réunions

- Se rencontre

- Membres

- simple

- Meta

- méthode

- Miami

- Microsoft

- Microsoft 365

- Milieu

- pourrait

- étape importante

- minutes

- manquer

- Mission

- ML

- modèle

- modélisation statistique

- numériques jumeaux (digital twin models)

- modernisation

- Élan

- MongoDB

- moniteurs

- Mois

- mois

- PLUS

- (en fait, presque toutes)

- Le Plus Populaire

- en mouvement

- MRI

- beaucoup

- plusieurs

- Musique

- must

- my

- prénom

- Nasdaq

- Nature

- Langage naturel

- Près

- nécessaire

- Besoin

- nécessaire

- besoin

- net

- réseau et

- de mise en réseau

- Nouveauté

- New York

- nouvellement

- next

- nitro

- aucune

- ordinateurs portables

- maintenant

- nombre

- Nvidia

- of

- de rabais

- offensive

- code

- offrant

- Offres Speciales

- souvent

- plus

- on

- une fois

- ONE

- et, finalement,

- en ligne

- services bancaires en ligne

- uniquement

- ouvert

- fonctionner

- Opérations

- Optimiser

- optimisé

- l'optimisation

- Options

- or

- passer commande

- organisation

- organisations

- original

- Autre

- Autres

- nos

- ande

- contour

- sortie

- sorties

- plus de

- encombrer

- massivement

- propre

- Rythme

- Forfaits

- douloureux

- paires

- paramètre

- paramètres

- partie

- partenaires,

- les pièces

- passé

- motifs

- pause

- Personnes

- /

- effectuer

- performant

- effectué

- effectue

- autorisation

- autorisations

- personne

- Personnalisation

- Personnaliser

- Personnellement

- PGA Tour

- les expressions clés

- pii

- Place

- plan

- Platon

- Intelligence des données Platon

- PlatonDonnées

- plus

- Point

- politiques

- Populaire

- positif

- possible

- Post

- défaillances

- power

- alimenté

- solide

- Méthode

- pratiquement

- pratiques

- précis

- prévoir

- Prédictions

- préférences

- préparation

- Préparer

- représentent

- président

- Press

- pressant

- Aperçu

- précédemment

- prix

- établissement des prix

- primaire

- la confidentialité

- Confidentialité et sécurité

- Privé

- information privée

- Problème

- d'ouvrabilité

- processus

- les process

- traitement

- produire

- Produit

- Vidéo

- productif

- productivité

- professionels

- ,une équipe de professionnels qualifiés

- Programmes

- Projet

- instructions

- propriété

- propriétaire

- L'utilisation de sélénite dans un espace est un excellent moyen de neutraliser l'énergie instable ou négative.

- protection

- fournir

- de voiture.

- fournisseurs

- fournit

- aportando

- public

- publiquement

- des fins

- Push

- Poussant

- mettre

- Putting

- Python

- pytorch

- Q3

- quantitatif

- question

- fréquemment posées

- Rapide

- vite.

- assez

- R & D

- gamme

- Nos tests de diagnostic produisent des résultats rapides et précis sans nécessiter d'équipement de laboratoire complexe et coûteux,

- rapidement

- Tarifs

- RE

- en cours

- réal

- en temps réel

- réaliste

- réaliser

- réalisé

- vraiment

- récolter

- Les raisons

- récemment

- Recommandation

- recommandations

- record

- réduire

- Prix Réduit

- réduire

- affiner

- région

- libéré

- pertinent

- fiabilité

- reste

- supprimez

- enlever

- réparation

- répétitif

- remplacement

- répondre

- rapport

- dépôt

- nécessaire

- demandes

- conditions

- Exigences

- un article

- réservation

- Réserver

- Résolution

- Résonne

- Resources

- respect

- Réagir

- répondre

- réponse

- réponses

- responsables

- restreindre

- limité

- résultat

- Résultats

- retour

- Avis

- examen

- bon

- risques

- Rôle

- rôle

- Chambres

- routes

- Règle

- Courir

- pour le running

- piste

- sacrifier

- des

- garanties

- en toute sécurité

- sagemaker

- vente

- force de vente

- même

- client

- Épargnez

- dire

- Escaliers intérieurs

- mise à l'échelle

- scénarios

- portée

- scores

- gratter

- Sdk

- fluide

- Rechercher

- Deuxièmement

- Deuxième génération

- secondes

- sécurisé

- en toute sécurité

- sécurité

- sur le lien

- voir

- vu

- Sélectionner

- choisi

- sélection

- envoi

- supérieur

- la haute direction

- sensible

- Septembre

- Séquence

- Série

- serveurs

- service

- ServiceNow

- Services

- set

- Sets

- plusieurs

- Partager

- commun

- navire

- Shorts

- devrait

- côté

- significative

- Silicium

- De même

- étapes

- simplifier

- simplement

- depuis

- SIX

- tailles

- mou

- petit

- So

- Réseaux sociaux

- réseaux sociaux

- Logiciels

- Développeurs de logiciels

- développement de logiciels

- kit de développement logiciel

- sur mesure

- Solutions

- RÉSOUDRE

- quelques

- Quelqu'un

- quelque chose

- disponible

- sophistiqué

- Identifier

- code source

- Sources

- Sud est

- Space

- Spark

- spécifiquement

- discours

- vitesse

- passer

- Stabilité

- stable

- empiler

- empilé

- parties prenantes

- j'ai commencé

- Commencez

- Startups

- state-of-the-art

- rester

- étapes

- Étapes

- Encore

- storage

- Boutique

- STORES

- Stories

- tempête

- Histoire

- rationaliser

- Renforcer

- strict

- structure

- Étude

- sous-réseau

- Ces

- tel

- convient

- suite

- résumé

- RÉSUMÉ

- Super

- complément

- fournisseurs

- la quantité

- Offre et la demande

- chaîne d'approvisionnement

- Support

- Les soutiens

- sûr

- surprenant

- surveillance

- soupçonneux

- Durabilité

- Interrupteur

- synthétiser

- combustion propre

- Système

- table

- Prenez

- prend

- prise

- discutons-en

- Target

- Tâche

- tâches

- équipe

- Membres de l'équipe

- équipes

- Technique

- technique

- techniques

- Les technologies

- Technologie

- innovation technologique

- dire

- dire

- Dix

- dizaines

- tensorflow

- terminologie

- tester

- Essais

- tests

- texte

- génération de texte

- que

- qui

- La

- El futuro

- le monde

- leur

- Les

- se

- puis

- Là.

- Ces

- l'ont

- chose

- des choses

- penser

- Troisièmement

- this

- cette année

- ceux

- milliers

- trois

- Avec

- tout au long de

- débit

- billet

- billets

- fiable

- fois

- Titan

- à

- aujourd'hui

- aujourd'hui

- ensemble

- jeton

- trop

- a

- outil

- les outils

- top

- Les sujets

- Tour

- vers

- vers

- suivre

- Commerce

- Train

- qualifié

- Formation

- Transactions

- Transcription

- Transformer

- De La Carrosserie

- transformations

- transformer

- Voyage

- trillions

- voyage

- vraiment

- La confiance

- Essai

- essayer

- se tourne

- deux

- type

- typiquement

- sous-jacent

- comprendre

- compréhensible

- compréhension

- comprend

- inconnu

- unifiée

- expérience unique et authentique

- caractéristiques uniques

- unité

- contrairement à

- jusqu'à

- Mises à jour

- Actualités

- améliorer

- mises à jour

- us

- Utilisation

- utilisé

- cas d'utilisation

- d'utiliser