À l’ère du Big Data, les organisations du monde entier sont constamment à la recherche de moyens innovants pour extraire de la valeur et des informations de leurs vastes ensembles de données. Apache Spark offre l’évolutivité et la vitesse nécessaires pour traiter efficacement de grandes quantités de données.

Amazon DME est la solution cloud Big Data leader du secteur pour le traitement de données à l'échelle du pétaoctet, l'analyse interactive et l'apprentissage automatique (ML) utilisant des frameworks open source tels qu'Apache Spark, Ruche Apacheet une Presto. Amazon EMR est le meilleur endroit pour exécuter Apache Spark. Vous pouvez créer rapidement et sans effort des clusters Spark gérés à partir du Console de gestion AWS, Interface de ligne de commande AWS (AWS CLI) ou API Amazon EMR. Vous pouvez également utiliser des fonctionnalités Amazon EMR supplémentaires, notamment Service de stockage simple Amazon (Amazon S3) à l'aide du système de fichiers Amazon EMR (EMRFS), intégration avec le Point Amazon EC2 marché et le Colle AWS Data Catalog et EMR Managed Scaling pour ajouter ou supprimer des instances de votre cluster. Amazon EMRStudio est un environnement de développement intégré (IDE) qui permet aux data scientists et aux ingénieurs de données de développer, visualiser et déboguer des applications d'ingénierie et de science des données écrites en R, Python, Scala et PySpark. EMR Studio fournit des notebooks Jupyter entièrement gérés et des outils tels que Spark UI et YARN Timeline Service pour simplifier le débogage.

Pour libérer le potentiel caché dans les réserves de données, il est essentiel d’aller au-delà de l’analyse traditionnelle. Entrez dans l'IA générative, une technologie de pointe qui combine le ML et la créativité pour générer du texte, des œuvres d'art et même du code de type humain. Socle amazonien est le moyen le plus simple de créer et de faire évoluer des applications d'IA générative avec des modèles de base (FM). Amazon Bedrock est un service entièrement géré qui rend les FM d'Amazon et des principales sociétés d'IA disponibles via une API, afin que vous puissiez rapidement expérimenter une variété de FM dans le terrain de jeu et utiliser une seule API pour l'inférence quels que soient les modèles que vous choisissez, ce qui donne vous avez la possibilité d'utiliser les FM de différents fournisseurs et de vous tenir à jour avec les dernières versions de modèles avec un minimum de modifications de code.

Dans cet article, nous explorons comment vous pouvez dynamiser vos analyses de données avec l'IA générative à l'aide d'Amazon EMR, d'Amazon Bedrock et du pyspark-ai bibliothèque. La bibliothèque pyspark-ai est un SDK anglais pour Apache Spark. Il prend des instructions en anglais et les compile dans des objets PySpark comme DataFrames. Cela facilite le travail avec Spark, vous permettant de vous concentrer sur l'extraction de valeur de vos données.

Vue d'ensemble de la solution

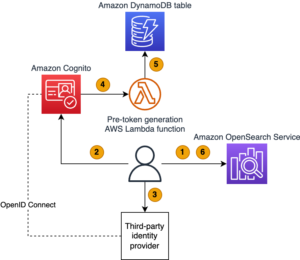

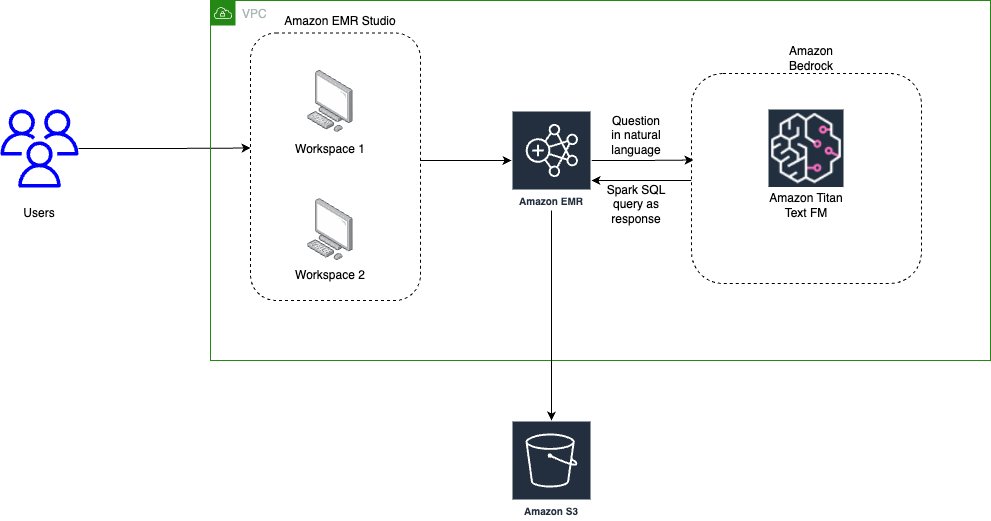

Le diagramme suivant illustre l'architecture d'utilisation de l'IA générative avec Amazon EMR et Amazon Bedrock.

EMR Studio est un IDE basé sur le Web pour les notebooks Jupyter entièrement gérés qui s'exécutent sur des clusters EMR. Nous interagissons avec les espaces de travail EMR Studio connectés à un cluster EMR en cours d'exécution et exécutons le bloc-notes fourni dans le cadre de cet article. Nous utilisons le Taxi de la ville de New York données pour obtenir des informations sur les différents trajets en taxi effectués par les utilisateurs. Nous posons les questions en langage naturel en plus des données chargées dans Spark DataFrame. La bibliothèque pyspark-ai utilise ensuite Amazon Titan Text FM d'Amazon Bedrock pour créer une requête SQL basée sur la question en langage naturel. La bibliothèque pyspark-ai prend la requête SQL, l'exécute à l'aide de Spark SQL et fournit les résultats à l'utilisateur.

Dans cette solution, vous pouvez créer et configurer les ressources requises dans votre compte AWS avec un AWS CloudFormation modèle. Le modèle crée le Colle AWS base de données et tables, compartiment S3, VPC et autres Gestion des identités et des accès AWS (IAM) utilisées dans la solution.

Le modèle est conçu pour montrer comment utiliser EMR Studio avec le package pyspark-ai et Amazon Bedrock, et n'est pas destiné à une utilisation en production sans modification. De plus, le modèle utilise le us-east-1 Région et peut ne pas fonctionner dans d’autres régions sans modification. Le modèle crée des ressources qui génèrent des coûts pendant leur utilisation. Suivez les étapes de nettoyage à la fin de cet article pour supprimer les ressources et éviter des frais inutiles.

Pré-requis

Avant de lancer la pile CloudFormation, assurez-vous de disposer des éléments suivants :

- Un compte AWS qui donne accès aux services AWS

- Un utilisateur IAM avec une clé d'accès et une clé secrète pour configurer l'AWS CLI, ainsi que des autorisations pour créer un rôle IAM, des stratégies IAM et des piles dans AWS CloudFormation.

- Le modèle Titan Text G1 – Express est actuellement en avant-première, vous devez donc disposer d'un accès en avant-première pour l'utiliser dans le cadre de cet article.

Créer des ressources avec AWS CloudFormation

CloudFormation crée les ressources AWS suivantes :

- Une pile VPC avec des sous-réseaux privés et publics à utiliser avec EMR Studio, les tables de routage et la passerelle NAT.

- Un cluster EMR avec Python 3.9 installé. Nous utilisons une action d'amorçage pour installer Python 3.9 et d'autres packages pertinents tels que les dépendances pyspark-ai et Amazon Bedrock. (Pour plus d'informations, reportez-vous au script d'amorçage.)

- Un compartiment S3 pour l'espace de travail EMR Studio et le stockage des ordinateurs portables.

- Rôles et stratégies IAM pour la configuration d'EMR Studio, l'accès à Amazon Bedrock et l'exécution de blocs-notes

Pour commencer, procédez comme suit:

- Selectionnez Pile de lancement :

- Sélectionnez Je reconnais que ce modèle peut créer des ressources IAM.

La pile CloudFormation prend environ 20 à 30 minutes. Vous pouvez surveiller sa progression sur la console AWS CloudFormation. Lorsque son statut indique CREATE_COMPLETE, votre compte AWS disposera des ressources nécessaires à la mise en œuvre de cette solution.

Créer un studio DME

Vous pouvez désormais créer un studio et un espace de travail EMR pour travailler avec le code du notebook. Effectuez les étapes suivantes :

- Sur la console EMR Studio, choisissez Créer un studio.

- Entrer le Nom du studio as

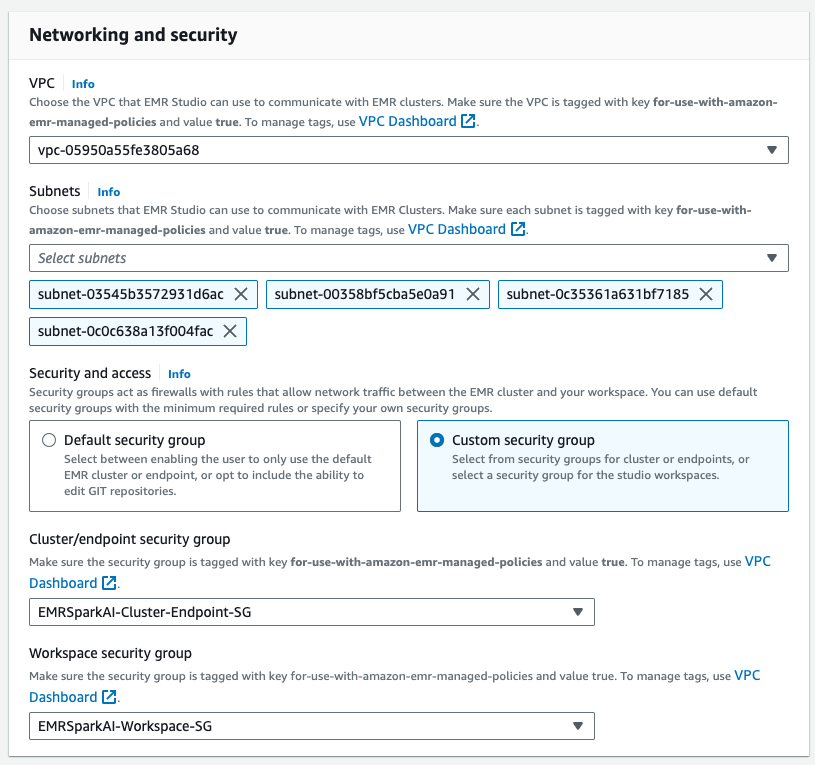

GenAI-EMR-Studioet fournissez une description. - Dans le Réseau et sécurité section, précisez les éléments suivants :

- Pour VPC, choisissez le VPC que vous avez créé dans le cadre de la pile CloudFormation que vous avez déployée. Obtenez l'ID du VPC à l'aide des sorties CloudFormation pour la clé VPCID.

- Pour Sous-réseaux, choisissez les quatre sous-réseaux.

- Pour Sécurité et accès, sélectionnez Groupe de sécurité personnalisé.

- Pour Groupe de sécurité du cluster/point de terminaison, choisissez

EMRSparkAI-Cluster-Endpoint-SG. - Pour Groupe de sécurité de l'espace de travail, choisissez

EMRSparkAI-Workspace-SG.

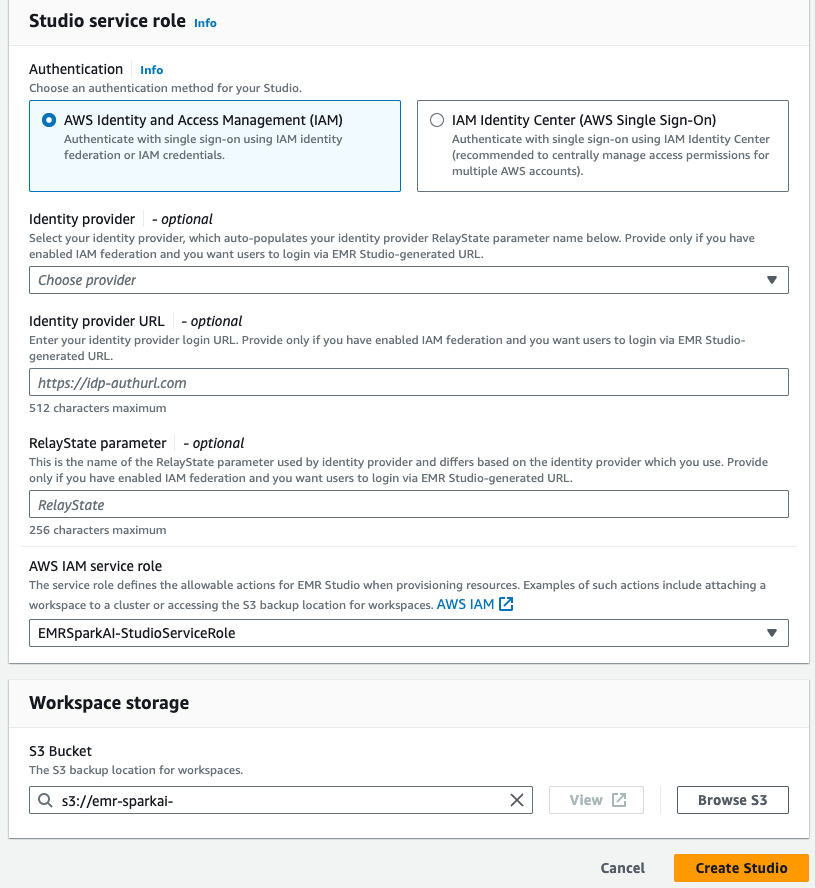

- Dans le Rôle du service Studio section, précisez les éléments suivants :

- Pour Authentification, sélectionnez Gestion des identités et des accès AWS (IAM).

- Pour Rôle de service AWS IAM, choisissez

EMRSparkAI-StudioServiceRole.

- Dans le Stockage de l'espace de travail , parcourez et choisissez le compartiment S3 pour le stockage en commençant par

emr-sparkai-<account-id>. - Selectionnez Créer un atelier.

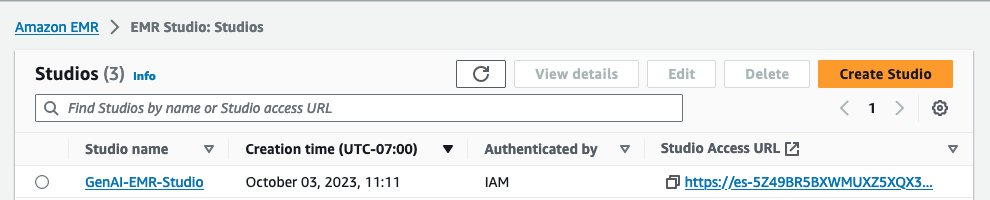

- Lorsque le Studio EMR est créé, choisissez le lien sous URL d'accès au Studio pour accéder au Studio.

- Lorsque vous êtes dans le Studio, choisissez Créer un espace de travail.

- Ajouter

emr-genaicomme nom de l'espace de travail et choisissez Créer un espace de travail. - Une fois l'espace de travail créé, choisissez son nom pour lancer l'espace de travail (assurez-vous d'avoir désactivé tous les bloqueurs de pop-up).

Analyse de Big Data à l'aide d'Apache Spark avec Amazon EMR et l'IA générative

Maintenant que nous avons terminé la configuration requise, nous pouvons commencer à effectuer des analyses Big Data à l'aide d'Apache Spark avec Amazon EMR et l'IA générative.

Dans un premier temps, nous chargeons un bloc-notes contenant le code et les exemples requis pour travailler avec le cas d'utilisation. Nous utilisons l'ensemble de données NY Taxi, qui contient des détails sur les trajets en taxi.

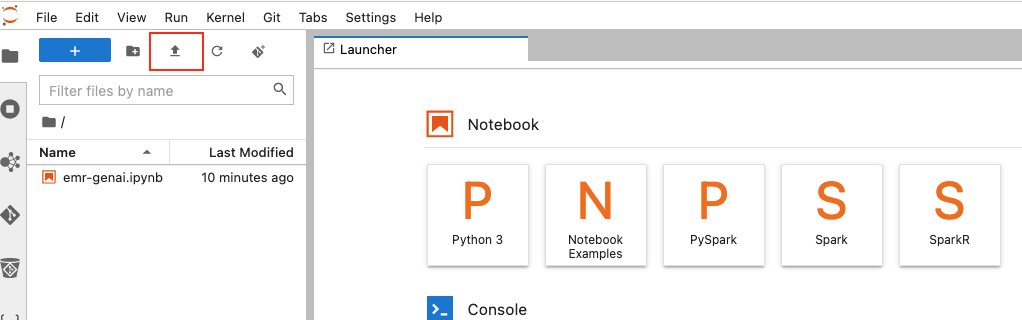

- Téléchargez le fichier du cahier NYTaxi.ipynb et téléchargez-le sur votre espace de travail en choisissant l'icône de téléchargement.

- Une fois le bloc-notes importé, ouvrez-le et choisissez

PySparkcomme noyau.

IA PySpark utilise par défaut ChatGPT4.0 d'OpenAI comme modèle LLM, mais vous pouvez également connecter des modèles d'Amazon Bedrock, Amazon SageMaker JumpStart, et d'autres modèles tiers. Pour cet article, nous montrons comment intégrer le modèle Amazon Bedrock Titan pour la génération de requêtes SQL et l'exécuter avec Apache Spark dans Amazon EMR.

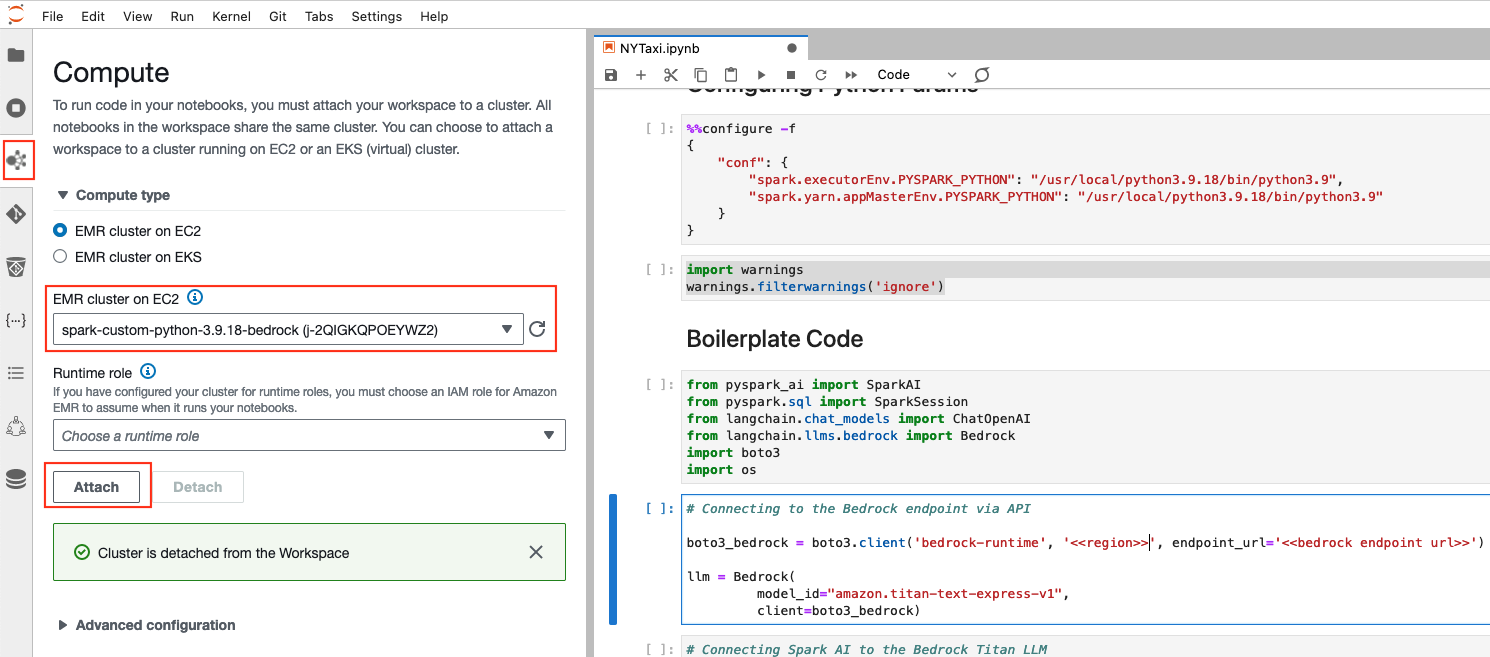

- Pour démarrer avec le notebook, vous devez associer l'espace de travail à une couche de calcul. Pour ce faire, choisissez le calcul dans le volet de navigation et choisissez le cluster EMR créé par la pile CloudFormation.

- Configurez les paramètres Python pour utiliser le package Python 3.9 mis à jour avec Amazon EMR :

- Importez les bibliothèques nécessaires :

- Une fois les bibliothèques importées, vous pouvez définir le modèle LLM depuis Amazon Bedrock. Dans ce cas, nous utilisons amazon.titan-text-express-v1. Vous devez saisir la région et l'URL du point de terminaison Amazon Bedrock en fonction de votre accès en aperçu pour le modèle Titan Text G1 – Express.

- Connectez Spark AI au modèle Amazon Bedrock LLM pour la génération de requêtes SQL basées sur des questions en langage naturel :

Ici, nous avons initialisé Spark AI avec verbose=False ; vous pouvez également définir verbose=True pour voir plus de détails.

Vous pouvez désormais lire les données de NYC Taxi dans un Spark DataFrame et utiliser la puissance de l'IA générative dans Spark.

- Par exemple, vous pouvez demander le nombre d'enregistrements dans l'ensemble de données :

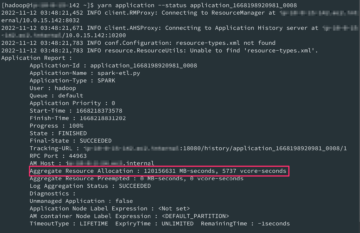

Nous obtenons la réponse suivante:

Spark AI utilise en interne LangChaîne et la chaîne SQL, qui cachent la complexité aux utilisateurs finaux travaillant avec des requêtes dans Spark.

Le bloc-notes contient quelques exemples de scénarios supplémentaires pour explorer la puissance de l'IA générative avec Apache Spark et Amazon EMR.

Nettoyer

Vider le contenu du bucket S3 emr-sparkai-<account-id>, supprimez l'espace de travail EMR Studio créé dans le cadre de cet article, puis supprimez la pile CloudFormation que vous avez déployée.

Conclusion

Cet article montre comment vous pouvez dynamiser vos analyses Big Data à l'aide d'Apache Spark avec Amazon EMR et Amazon Bedrock. Le package PySpark AI vous permet de tirer des informations significatives de vos données. Il permet de réduire le temps de développement et d'analyse, en réduisant le temps d'écriture de requêtes manuelles et en vous permettant de vous concentrer sur votre cas d'utilisation professionnel.

À propos des auteurs

Saurabh Bhutyani est architecte principal de solutions spécialisées en analyse chez AWS. Il est passionné par les nouvelles technologies. Il a rejoint AWS en 2019 et travaille avec les clients pour fournir des conseils architecturaux pour l'exécution de cas d'utilisation d'IA générative, de solutions d'analyse évolutives et d'architectures de maillage de données utilisant des services AWS comme Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, et Amazon DataZone.

Saurabh Bhutyani est architecte principal de solutions spécialisées en analyse chez AWS. Il est passionné par les nouvelles technologies. Il a rejoint AWS en 2019 et travaille avec les clients pour fournir des conseils architecturaux pour l'exécution de cas d'utilisation d'IA générative, de solutions d'analyse évolutives et d'architectures de maillage de données utilisant des services AWS comme Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, et Amazon DataZone.

Harsh Vardhan est un architecte de solutions senior AWS, spécialisé dans l'analyse. Il possède plus de 8 ans d’expérience dans le domaine du big data et de la science des données. Il a pour passion d'aider les clients à adopter les meilleures pratiques et à découvrir des informations à partir de leurs données.

Harsh Vardhan est un architecte de solutions senior AWS, spécialisé dans l'analyse. Il possède plus de 8 ans d’expérience dans le domaine du big data et de la science des données. Il a pour passion d'aider les clients à adopter les meilleures pratiques et à découvrir des informations à partir de leurs données.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://aws.amazon.com/blogs/big-data/use-generative-ai-with-amazon-emr-amazon-bedrock-and-english-sdk-for-apache-spark-to-unlock-insights/

- :possède

- :est

- :ne pas

- $UP

- 1

- 10

- 100

- 107

- 11

- 20

- 200

- 2019

- 320

- 500

- 521

- 7

- 8

- 9

- 990

- a

- A Propos

- accès

- Gestion des accès

- Compte

- reconnaître

- Action

- ajouter

- Supplémentaire

- En outre

- adopter

- AI

- cas d'utilisation de l'IA

- Tous

- Permettre

- permet

- aussi

- Amazon

- Amazone Athéna

- Amazon DME

- Amazon Sage Maker

- Amazon Web Services

- quantités

- an

- selon une analyse de l’Université de Princeton

- analytique

- ainsi que

- répondre

- tous

- Apache

- Apache Spark

- api

- applications

- d'environ

- architectural

- architecture

- SONT

- Art

- AS

- demander

- Associé(e)

- At

- disponibles

- éviter

- AWS

- AWS CloudFormation

- Colle AWS

- Formation AWS Lake

- RETOUR

- basé

- LES MEILLEURS

- les meilleures pratiques

- Au-delà

- Big

- Big Data

- Bootstrap

- construire

- la performance des entreprises

- mais

- bouton (dans la fenêtre de contrôle qui apparaît maintenant)

- by

- CAN

- maisons

- cas

- catalogue

- chaîne

- Modifications

- des charges

- Selectionnez

- choose

- Ville

- le cloud

- données volumineuses sur le cloud

- Grappe

- code

- moissonneuses-batteuses

- Sociétés

- complet

- Complété

- complexité

- calcul

- connecté

- Connectivité

- Console

- constamment

- contient

- contenu

- Costs

- engendrent

- créée

- crée des

- notre créativité

- Lecture

- Clients

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- données

- Analyse de Donnée

- informatique

- science des données

- Base de données

- ensembles de données

- Date

- Réglage par défaut

- Vous permet de définir

- démontrer

- dépendances

- déployé

- dériver

- la description

- un

- détails

- développer

- Développement

- différent

- handicapé

- découvrez

- do

- efficacement

- d'effort

- fin

- Endpoint

- ENGINEERING

- Les ingénieurs

- Anglais

- assurer

- Entrer

- entrant

- Environment

- Ère

- essential

- Ether (ETH)

- Pourtant, la

- exemple

- exemples

- d'experience

- expérience

- explorez

- express

- extrait

- RAPIDE

- Fonctionnalités:

- few

- champ

- Déposez votre dernière attestation

- finale

- Prénom

- Flexibilité

- Focus

- suivre

- Abonnement

- Pour

- formation

- Fondation

- quatre

- cadres

- De

- d’étiquettes électroniques entièrement

- g1

- recueillir

- porte

- générer

- génération

- génératif

- IA générative

- obtenez

- Don

- Go

- l'orientation

- Vous avez

- he

- vous aider

- aider

- aide

- caché

- Cacher

- Comment

- How To

- http

- HTTPS

- i

- IAM

- ICON

- ID

- Identite

- gestion des identités et des accès

- illustre

- Mettre en oeuvre

- importer

- in

- Dans d'autres

- Y compris

- leader de l'industrie

- d'information

- technologie innovante

- contribution

- idées.

- installer

- cas

- Des instructions

- intégrer

- des services

- l'intégration

- prévu

- interagir

- Interactif

- intérieurement

- développement

- IT

- SES

- rejoint

- jpg

- XNUMX éléments à

- ACTIVITES

- Savoir

- lac

- langue

- gros

- Nouveautés

- lancer

- couche

- conduisant

- apprentissage

- bibliothèques

- Bibliothèque

- comme

- Gamme

- LINK

- charge

- click

- machine learning

- a prendre une

- FAIT DU

- gérés

- gestion

- Manuel

- Marché

- Mai..

- significative

- engrener

- minimal

- minutes

- ML

- modèle

- numériques jumeaux (digital twin models)

- Surveiller

- PLUS

- (en fait, presque toutes)

- prénom

- Nature

- Langage naturel

- Navigation

- nécessaire

- Besoin

- nécessaire

- de mise en réseau

- Nouveauté

- Les nouvelles technologies

- cahier

- ordinateurs portables

- maintenant

- nombre

- NY

- NYC

- objets

- observation

- of

- Offres Speciales

- on

- ouvert

- open source

- or

- organisations

- Autre

- sorties

- plus de

- vue d'ensemble

- paquet

- Forfaits

- pain

- paramètres

- partie

- passionné

- effectuer

- autorisations

- Place

- Platon

- Intelligence des données Platon

- PlatonDonnées

- cour de récréation

- fiche

- politiques

- pop-up

- Post

- défaillances

- power

- pratiques

- Aperçu

- Directeur

- Privé

- processus

- traitement

- Vidéo

- Progrès

- fournir

- à condition de

- fournisseurs

- fournit

- public

- Python

- requêtes

- question

- fréquemment posées

- vite.

- R

- Lire

- Articles

- réduire

- réduire

- reportez-vous

- Indépendamment

- région

- régions

- pertinent

- supprimez

- conditions

- Resources

- réponse

- Résultats

- manèges

- Rôle

- rôle

- Itinéraire

- Courir

- pour le running

- fonctionne

- sagemaker

- Scala

- Évolutivité

- évolutive

- Escaliers intérieurs

- mise à l'échelle

- scénarios

- Sciences

- scientifiques

- Sdk

- recherche

- secret

- sécurité

- sur le lien

- Sélectionner

- supérieur

- service

- Services

- set

- installation

- montrer

- montré

- étapes

- simplifier

- unique

- So

- sur mesure

- Solutions

- Identifier

- Spark

- spécialiste

- spécialisation

- vitesse

- SQL

- empiler

- Combos

- Commencer

- j'ai commencé

- Commencez

- Statut

- étapes

- Étapes

- storage

- simple

- studio

- sous-réseaux

- tel

- Surchargez

- sûr

- combustion propre

- table

- tâches

- prend

- Les technologies

- Technologie

- modèle

- texte

- qui

- La

- leur

- Les

- puis

- l'ont

- des tiers.

- this

- pensée

- Avec

- fiable

- calendrier

- Titan

- à

- les outils

- top

- traditionnel

- ui

- sous

- ouvrir

- a actualisé

- URL

- utilisé

- cas d'utilisation

- d'utiliser

- Utilisateur

- utilisateurs

- Usages

- en utilisant

- Plus-value

- variété

- divers

- Vaste

- visualiser

- Façon..

- façons

- we

- web

- services Web

- Basé sur le Web

- quand

- qui

- tout en

- sera

- comprenant

- dans les

- sans

- activités principales

- de travail

- vos contrats

- partout dans le monde

- écrire

- code écrit

- années

- york

- you

- Votre

- zéphyrnet