Image par l'éditeur

Les applications d’IA possèdent des capacités informatiques inégalées qui peuvent propulser le progrès à un rythme sans précédent. Néanmoins, ces outils dépendent fortement de centres de données à forte consommation énergétique pour leurs opérations, ce qui entraîne un manque inquiétant de sensibilité énergétique qui contribue de manière significative à leur empreinte carbone. Étonnamment, ces applications d’IA représentent déjà une part substantielle Entre 2.5 et 3.7 pour cent des émissions mondiales de gaz à effet de serre, dépassant les émissions de l’industrie aéronautique.

Et malheureusement, cette empreinte carbone augmente à un rythme rapide.

À l’heure actuelle, il est urgent de mesurer l’empreinte carbone des applications d’apprentissage automatique, comme le souligne la sagesse de Peter Drucker selon laquelle « on ne peut pas gérer ce qu’on ne peut pas mesurer ». Il existe actuellement un manque de clarté important dans la quantification de l’impact environnemental de l’IA, les chiffres précis nous échappant.

En plus de mesurer l’empreinte carbone, les leaders de l’industrie de l’IA doivent activement se concentrer sur son optimisation. Cette double approche est essentielle pour répondre aux préoccupations environnementales entourant les applications de l’IA et garantir une voie à suivre plus durable.

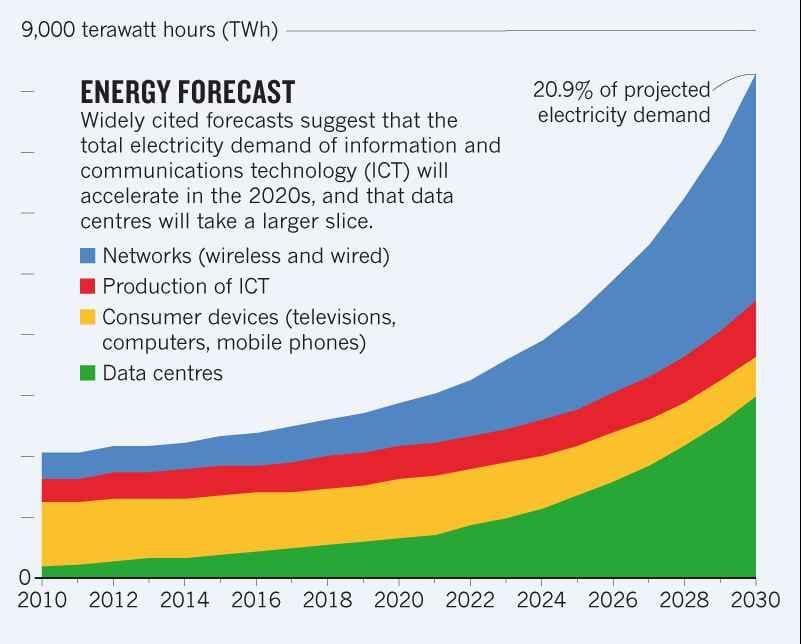

L’utilisation accrue de l’apprentissage automatique nécessite davantage de centres de données, dont beaucoup sont gourmands en énergie et ont donc une empreinte carbone importante. La consommation mondiale d'électricité des centres de données s'élève à 0.9 pour cent en 1.3 dès 2021.

A étude de 2021 estime que cette utilisation peut augmenter jusqu’à 1.86 pour cent d’ici 2030. comprendre représente la tendance croissante de la demande énergétique due aux centres de données

© Tendance de la consommation d'énergie et part d'usage des datacenters

Notamment, plus la consommation d’énergie est élevée, plus l’empreinte carbone sera élevée. Les centres de données chauffent pendant le traitement et peuvent devenir défectueux, voire cesser de fonctionner en raison d'une surchauffe. Ils ont donc besoin d’être refroidis, ce qui nécessite de l’énergie supplémentaire. Autour 40 pour cent de l’électricité consommée par les centres de données est destinée à la climatisation.

Compte tenu de l’empreinte croissante de l’utilisation de l’IA, l’intensité carbone de ces outils doit être prise en compte. Actuellement, les recherches sur ce sujet se limitent à l’analyse de quelques modèles et n’abordent pas adéquatement la diversité desdits modèles.

Voici une méthodologie évoluée et quelques outils efficaces pour calculer l’intensité carbone des systèmes d’IA.

L’intensité carbone logicielle (SCI) Standard est une approche efficace pour estimer l’intensité carbone des systèmes d’IA. Contrairement aux méthodologies conventionnelles qui utilisent une approche de comptabilité carbone attributionnelle, elle utilise une approche informatique conséquentielle.

L'approche conséquentielle tente de calculer le changement marginal des émissions résultant d'une intervention ou d'une décision, telle que la décision de générer une unité supplémentaire. Alors que l’attribution fait référence aux données comptables d’intensité moyenne ou aux inventaires statiques des émissions.

A papier sur « Mesurer l'intensité carbone de l'IA dans les instances cloud » par Jesse Doge et al. a utilisé cette méthodologie pour apporter des recherches plus éclairées. Étant donné qu’une quantité importante de formation sur les modèles d’IA est effectuée sur des instances de cloud computing, cela peut constituer un cadre valable pour calculer l’empreinte carbone des modèles d’IA. L'article affine la formule SCI pour des estimations telles que :

qui est affiné à partir de :

qui découle de

qui découle de

où:

E: Énergie consommée par un système logiciel, principalement des unités de traitement graphique-GPU qui sont du matériel ML spécialisé.

I: Émissions marginales de carbone basées sur l'emplacement du réseau alimentant le centre de données.

M: Carbone intégré ou incorporé, qui est le carbone émis lors de l'utilisation, de la création et de l'élimination du matériel.

R: Unité fonctionnelle, qui dans ce cas est une tâche de formation en apprentissage automatique.

C= O+M, où O est égal à E*I

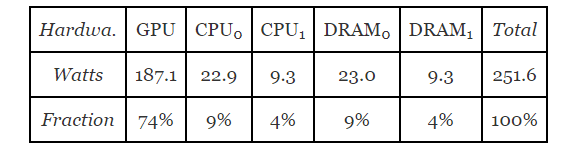

Le document utilise la formule pour estimer la consommation électrique d'une seule instance de cloud. Dans les systèmes ML basés sur le deep learning, une consommation électrique importante est due au GPU, qui est inclus dans cette formule. Ils ont formé un modèle de base BERT utilisant un seul GPU NVIDIA TITAN X (12 Go) dans un serveur standard avec deux processeurs Intel Xeon E5-2630 v3 (2.4 GHz) et 256 Go de RAM (16 x 16 Go DIMM) pour expérimenter l'application de cette formule. La figure suivante montre les résultats de cette expérience :

© Consommation d'énergie et répartition entre les composants d'un serveur

Le GPU revendique 74 pour cent de la consommation d’énergie. Même si les auteurs de l'article considèrent toujours que c'est une sous-estimation, l'inclusion du GPU est un pas dans la bonne direction. Ce n’est pas l’objet des techniques d’estimation conventionnelles, ce qui signifie qu’un contributeur majeur à l’empreinte carbone est négligé dans les estimations. De toute évidence, SCI offre un calcul plus complet et plus fiable de l’intensité carbone.

La formation des modèles d'IA est souvent effectuée sur des instances de calcul cloud, car le cloud le rend flexible, accessible et rentable. Le cloud computing fournit l'infrastructure et les ressources nécessaires pour déployer et former des modèles d'IA à grande échelle. C'est pourquoi la formation des modèles sur le cloud computing se développe progressivement.

Il est important de mesurer l'intensité carbone en temps réel des instances de calcul cloud afin d'identifier les zones adaptées aux efforts d'atténuation. La comptabilisation des émissions marginales par unité d'énergie en fonction du temps et du lieu peut aider à calculer les émissions de carbone opérationnelles, comme le fait un papier 2022.

An opensource outil, le logiciel Cloud Carbon Footprint (CCF) est également disponible pour calculer l'impact des instances cloud.

Voici 7 façons d’optimiser l’intensité carbone des systèmes d’IA.

1. Écrivez un code meilleur et plus efficace

Des codes optimisés peuvent réduire la consommation d'énergie de 30 pour cent grâce à une diminution de l’utilisation de la mémoire et du processeur. L'écriture d'un code économe en carbone implique d'optimiser les algorithmes pour une exécution plus rapide, de réduire les calculs inutiles et de sélectionner du matériel économe en énergie pour effectuer des tâches avec moins d'énergie.

Les développeurs peuvent utiliser des outils de profilage pour identifier les goulots d'étranglement en matière de performances et les domaines à optimiser dans leur code. Ce processus peut conduire à des logiciels plus économes en énergie. Envisagez également de mettre en œuvre des techniques de programmation économes en énergie, où le code est conçu pour s'adapter aux ressources disponibles et donner la priorité aux chemins d'exécution économes en énergie.

2. Sélectionnez un modèle plus efficace

Choisir les bons algorithmes et structures de données est crucial. Les développeurs doivent opter pour des algorithmes qui minimisent la complexité de calcul et, par conséquent, la consommation d'énergie. Si le modèle le plus complexe n’apporte qu’une amélioration de 3 à 5 % mais prend 2 à 3 fois plus de temps à s’entraîner ; puis choisissez le modèle le plus simple et le plus rapide.

La distillation de modèles est une autre technique permettant de condenser de grands modèles en versions plus petites afin de les rendre plus efficaces tout en conservant les connaissances essentielles. Cela peut être réalisé en entraînant un petit modèle pour imiter le grand ou en supprimant les connexions inutiles d'un réseau neuronal.

3. Ajustez les paramètres du modèle

Ajustez les hyperparamètres du modèle à l'aide d'une optimisation à double objectif qui équilibre les performances du modèle (par exemple, la précision) et la consommation d'énergie. Cette approche à double objectif garantit que vous ne sacrifiez pas l'un pour l'autre, ce qui rend vos modèles plus efficaces.

Tirer parti de techniques telles que Réglage précis des paramètres (PEFT) dont l'objectif est d'atteindre des performances similaires au réglage fin traditionnel mais avec un nombre réduit de paramètres entraînables. Cette approche implique d'affiner un petit sous-ensemble de paramètres du modèle tout en gardant gelée la majorité des grands modèles linguistiques (LLM) pré-entraînés, ce qui entraîne des réductions significatives des ressources de calcul et de la consommation d'énergie.

4. Compressez les données et utilisez un stockage à faible consommation d'énergie

Mettez en œuvre des techniques de compression de données pour réduire la quantité de données transmises. Les données compressées nécessitent moins d’énergie pour être transférées et occupent moins d’espace sur le disque. Pendant la phase de diffusion du modèle, l'utilisation d'un cache peut contribuer à réduire les appels effectués vers la couche de stockage en ligne, réduisant ainsi

De plus, choisir la bonne technologie de stockage peut entraîner des gains significatifs. Par ex. AWS Glacier est une solution d'archivage de données efficace et peut constituer une approche plus durable que l'utilisation de S3 si les données n'ont pas besoin d'être consultées fréquemment.

5. Former des modèles à une énergie plus propre

Si vous utilisez un service cloud pour la formation de modèles, vous pouvez choisir la région dans laquelle effectuer les calculs. Choisissez une région qui utilise des sources d'énergie renouvelables à cet effet et vous pourrez réduire les émissions jusqu'à 30 fois. AWS blog récents décrit l'équilibre entre l'optimisation des objectifs commerciaux et les objectifs de développement durable.

Une autre option consiste à sélectionner le moment opportun pour exécuter le modèle. À certaines heures de la journée ; l'énergie est plus propre et ces données peuvent être acquises via un service payant tel que Carte de l'électricité, qui offre un accès à des données en temps réel et à des prévisions futures concernant l'intensité carbone de l'électricité dans différentes régions.

6. Utiliser des centres de données et du matériel spécialisés pour la formation des modèles

Le choix de centres de données et de matériel plus efficaces peut faire une énorme différence en termes d’intensité carbone. Les centres de données et le matériel spécifiques au ML peuvent être 1.4-2 et 2 à 5 fois plus économes en énergie que les modèles généraux.

7. Utilisez des déploiements sans serveur comme AWS Lambda, Azure Functions

Les déploiements traditionnels nécessitent que le serveur soit toujours allumé, ce qui signifie une consommation d'énergie 24h/7 et XNUMXj/XNUMX. Les déploiements sans serveur comme AWS Lambda et Azure Functions fonctionnent très bien avec une intensité carbone minimale.

Le secteur de l’IA connaît une croissance exponentielle, imprégnant toutes les facettes des affaires et de la vie quotidienne. Cependant, cette expansion a un coût : une empreinte carbone croissante qui menace de nous éloigner encore plus de l’objectif consistant à limiter l’augmentation de la température mondiale à seulement 1°C.

Cette empreinte carbone n’est pas seulement une préoccupation actuelle ; ses répercussions peuvent s’étendre à plusieurs générations, affectant ceux qui ne portent aucune responsabilité dans sa création. Il devient donc impératif de prendre des mesures décisives pour atténuer les émissions de carbone liées à l’IA et d’explorer des voies durables pour exploiter son potentiel. Il est crucial de veiller à ce que les avantages de l’IA ne se fassent pas au détriment de l’environnement et du bien-être des générations futures.

Ankur Gupta est un leader en ingénierie avec une décennie d'expérience dans les domaines de la durabilité, des transports, des télécommunications et des infrastructures ; occupe actuellement le poste de responsable de l'ingénierie chez Uber. À ce titre, il joue un rôle central dans l'avancement de la plateforme de véhicules d'Uber, menant la charge vers un avenir zéro émission grâce à l'intégration de véhicules électriques et connectés de pointe.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoData.Network Ai générative verticale. Autonomisez-vous. Accéder ici.

- PlatoAiStream. Intelligence Web3. Connaissance Amplifiée. Accéder ici.

- PlatonESG. Carbone, Technologie propre, Énergie, Environnement, Solaire, La gestion des déchets. Accéder ici.

- PlatoHealth. Veille biotechnologique et essais cliniques. Accéder ici.

- La source: https://www.kdnuggets.com/greening-ai-7-strategies-to-make-applications-more-sustainable?utm_source=rss&utm_medium=rss&utm_campaign=greening-ai-7-strategies-to-make-applications-more-sustainable

- :possède

- :est

- :ne pas

- :où

- $UP

- 1

- 1.3

- 12

- 15%

- 2021

- 2030

- 7

- 9

- a

- accès

- accédé

- accessible

- Compte

- comptabilisés

- Comptabilité

- précision

- atteint

- ACM

- a acquise

- à travers

- actes

- activement

- adapter

- ajout

- Supplémentaire

- propos

- adresser

- adéquatement

- avancement

- affectant

- AI

- Modèles AI

- Systèmes d'IA

- Transport Aérien

- Climatisation

- AL

- algorithmes

- déjà

- aussi

- Bien que

- toujours

- Amazon

- montant

- an

- analyses

- ainsi que le

- et infrastructure

- Une autre

- Application

- applications

- une approche

- SONT

- domaines

- autour

- AS

- At

- atteindre

- Tentatives

- auteurs

- disponibles

- pistes

- moyen

- aviation

- et

- AWS

- AWS Lambda

- Azure

- Balance

- basé

- BE

- Gardez

- devenez

- devient

- va

- avantages.

- Améliorée

- jusqu'à XNUMX fois

- goulets d'étranglement

- apporter

- la performance des entreprises

- mais

- by

- cachette

- calculer

- Appels

- CAN

- capacités

- carbone

- émissions de carbone

- empreinte carbone

- maisons

- Centres

- certaines

- Change

- charge

- Selectionnez

- revendiqué

- prétentions

- clarté

- plus propre

- le cloud

- le cloud computing

- code

- codes

- comment

- vient

- marchandise

- complexe

- complexité

- composants électriques

- calcul

- calcul

- calculs

- calcul

- informatique

- PROBLÈMES DE PEAU

- concernant

- Préoccupations

- menée

- connecté

- Connexions

- consécutif

- par conséquent

- Considérer

- consommées

- consommation

- contribue

- contributeur

- conventionnel

- création

- crucial

- Lecture

- En investissant dans une technologie de pointe, les restaurants peuvent non seulement rester compétitifs dans un marché en constante évolution, mais aussi améliorer significativement l'expérience de leurs clients.

- Tous les jours

- données

- les centres de données

- Datacenter

- journée

- décennie

- décision

- décisif

- diminué

- profond

- l'apprentissage en profondeur

- Demande

- déployer

- déploiements

- un

- mobiles

- différence

- différent

- direction

- disposition

- Diversité

- do

- Doge

- domaines

- fait

- conduite

- deux

- pendant

- e

- E & T

- Efficace

- efficace

- efforts

- Électrique

- électricité

- la consommation d'électricité

- consommation d'électricité

- intégré

- Emissions

- souligné

- employés

- emploie

- énergie

- Consommation d'énergie

- ENGINEERING

- assurer

- Assure

- assurer

- Environment

- environnementales

- les préoccupations environnementales

- Équivaut à

- essential

- estimation

- estimé

- Ether (ETH)

- Pourtant, la

- Chaque

- évolué

- exécution

- existe

- avec des données

- d'experience

- l'expérience

- expérience

- explorez

- exponentiel

- Croissance exponentielle

- étendre

- supplémentaire

- RAPIDE

- plus rapide

- défectueux

- few

- Figure

- Figures

- fin

- flexible

- Focus

- Abonnement

- numérique

- Pour

- formule

- Avant

- Framework

- fréquemment

- De

- gelé

- fonctionnel

- fonctionnement

- fonctions

- plus

- avenir

- Gains

- GAS

- Général

- générer

- Les générations

- Global

- objectif

- Objectifs

- GPU

- peu à peu

- gaz a effet de serre

- Les émissions de gaz à effet de serre

- Grille

- Croissance

- Matériel

- Exploiter

- Vous avez

- he

- fortement

- vous aider

- d'où

- augmentation

- détient

- Cependant

- HTTPS

- majeur

- Avide

- identifier

- AIE

- if

- Impact

- impératif

- la mise en œuvre

- important

- amélioration

- in

- inclus

- inclusion

- Améliore

- increased

- Augmente

- croissant

- industrie

- Actualités

- Infrastructure

- instance

- cas

- l'intégration

- Intel

- intervention

- développement

- implique

- IT

- SES

- jpg

- juste

- KDnuggetsGenericName

- en gardant

- spécialisées

- Peindre

- langue

- gros

- couche

- conduire

- leader

- dirigeants

- conduisant

- apprentissage

- moins

- comme

- limité

- Basé sur la localisation

- baisser

- click

- machine learning

- LES PLANTES

- majeur

- Majorité

- a prendre une

- FAIT DU

- Fabrication

- gérer

- manager

- de nombreuses

- Mai..

- veux dire

- mesurer

- mesure

- Mémoire

- méthodologies

- Méthodologie

- minimal

- minimiser

- Réduire les

- atténuation

- ML

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- plus efficace

- must

- Besoin

- Besoins

- réseau et

- Neural

- Réseau neuronal

- Néanmoins

- aucune

- nombre

- Nvidia

- occupe

- of

- Offres Speciales

- souvent

- on

- ONE

- et, finalement,

- en ligne

- uniquement

- fonctionner

- opérationnel

- Opérations

- opportun

- à mettre en œuvre pour gérer une entreprise rentable. Ce guide est basé sur trois décennies d'expérience

- Optimiser

- l'optimisation

- Option

- or

- Autre

- grandes lignes

- Rythme

- payé

- Papier

- paramètres

- chemin

- /

- pour cent

- effectuer

- performant

- Peter

- phase

- en particulier pendant la préparation

- pivot

- plateforme

- Platon

- Intelligence des données Platon

- PlatonDonnées

- joue

- position

- posséder

- défaillances

- power

- Alimentation

- précis

- Prédictions

- représentent

- pressant

- qui se déroulent

- Prioriser

- processus

- traitement

- Processeur

- profilage

- Programmation

- Progrès

- Propulser

- fournit

- but

- RAM

- en temps réel

- données en temps réel à grande vitesse.

- réduire

- Prix Réduit

- réduire

- réductions

- se réfère

- raffiné

- en ce qui concerne

- région

- régions

- fiable

- compter

- enlever

- Renouvelable

- des énergies renouvelables

- répercussions

- représente

- exigent

- a besoin

- un article

- Resources

- responsabilité

- résultat

- résultant

- Résultats

- retenue

- bon

- Rôle

- Courir

- s

- sacrifier

- Saïd

- Escaliers intérieurs

- SCI

- secteur

- la sélection

- Sensibilité

- serveur

- Sans serveur

- service

- service

- Partager

- devrait

- Spectacles

- significative

- de façon significative

- similaires

- depuis

- unique

- petit

- faibles

- Logiciels

- sur mesure

- Sources

- Space

- enjambant

- spécialisé

- scission

- diriger

- étapes

- Encore

- Arrêter

- storage

- les stratégies

- structures

- sujet

- Ces

- tel

- convient

- incomparable

- Alentours

- Durabilité

- durable

- combustion propre

- Système

- T

- Prenez

- prend

- Tâche

- tâches

- technique

- techniques

- Technologie

- télécommunication

- que

- qui

- La

- leur

- Les

- puis

- Là.

- ainsi

- donc

- Ces

- l'ont

- this

- ceux

- menace

- Avec

- Ainsi

- fiable

- fois

- Titan

- à

- outil

- les outils

- vers

- traditionnel

- Train

- qualifié

- Formation

- transférer

- transport

- Trend

- deux

- Uber

- malheureusement

- unité

- contrairement à

- sans précédent

- sans précédent

- us

- Utilisation

- utilisé

- Usages

- en utilisant

- Info de contact.

- Véhicules

- vital

- façons

- Quoi

- Les

- qui

- tout en

- WHO

- dont

- why

- sera

- sagesse

- comprenant

- activités principales

- écrire

- écriture

- X

- rendements

- you

- Votre

- zéphyrnet