دنیای هوش مصنوعی (AI) به سرعت در حال پیشرفت است و چالشهای بالقوه و اخلاقی بسیار زیادی را به منصه ظهور میرساند. در این زمینه، یادآوری این نکته ضروری است که هوش، در صورت سوء استفاده، می تواند از نداشتن آن به هیچ وجه سخت تر باشد. همانطور که فناوریهای هوش مصنوعی مقیاسپذیر میشوند و به طور فزایندهای در بخشهای مختلف تأثیرگذار میشوند، حکمرانی مسئولانه برای بهرهگیری از مزایای آن و در عین حال کاهش آسیبهای بالقوه بسیار مهم میشود. ظهور هوش مصنوعی مولداگرچه امیدوارکننده است، اما تا حد زیادی به آزمایش و حواشی محدود شده است. برای استقرار این فناوریها در مقیاس، نیاز به چارچوبهای قابل اعتماد و کنترلشده وجود دارد که توسط قوانین کاملاً تعریفشده هدایت میشوند که اقدامات نامطلوب را قادر میسازد یا از آن جلوگیری میکند، اقدامات امنیتی را اجرا میکند، با چارچوبهای نظارتی در حال ظهور سازگار میشود، و پایداری را هم از منظر هزینه و هم تضمین میکند. تاثیر بر توانایی های انسانی و عوامل محیطی، اجتماعی و حاکمیتی (ESG).

برای اینکه شرکتها واقعاً از پتانسیل عظیمی که هوش مصنوعی در مقیاس ارائه میکند، استفاده کنند، باید حکمرانی مسئولانه را در زمینه وسیعتر صنعت در اولویت قرار دهند. یک رویکرد مسئولیتپذیر اول تلاش میکند تا به این جنبه کلیدی بپردازد، و کسبوکارها را قادر میسازد تا در عین حفظ استانداردهای اخلاقی، از فناوری هوش مصنوعی استفاده معناداری کنند.

نگرانی های اخلاقی در هوش مصنوعی

فناوریهای هوش مصنوعی مجموعهای از نگرانیهای اخلاقی را به همراه دارند که نمیتوان آنها را نادیده گرفت. این نگرانی ها عبارتند از حریم خصوصی داده ها، سوگیری الگوریتم، سوء استفاده احتمالی و انطباق با مقررات.

جمعآوری، ذخیرهسازی و استفاده از دادههای شخصی مسائل مهمی را در خصوص حریم خصوصی ایجاد کرده است. سوء استفاده از داده ها می تواند عواقب شدیدی داشته باشد و حقوق افراد را نقض کند. علاوه بر این، سیستمهای هوش مصنوعی از تعصب مصون نیستند و میتوانند ناخواسته نابرابریها یا کلیشههای موجود را تداوم بخشند. پرداختن به سوگیری الگوریتمی برای اطمینان از انصاف و برابری بسیار مهم است.

استفاده نادرست از فناوریهای هوش مصنوعی همچنین میتواند تأثیرات گستردهای داشته باشد و منجر به طیف وسیعی از مسائل اجتماعی و اخلاقی از جمله اطلاعات غلط، نظارت و آسیبهای ناخواسته شود. این امر با مقررات نوظهور تشدید میشود، که اگرچه برای حفظ استانداردهای اخلاقی ضروری است، اما میتواند چالشبرانگیز باشد. انطباق با این چارچوب های نظارتی در حال تحول یک جنبه حیاتی از هوش مصنوعی مسئول است.

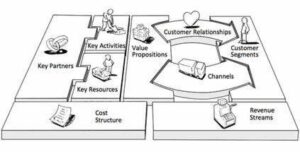

مدیریت مسئولانه هوش مصنوعی یک تلاش چند وجهی است که شامل موارد زیر است:

- چارچوب های اخلاقی: سازمانها باید چارچوبهای اخلاقی روشنی را ایجاد کنند که توسعه و استقرار هوش مصنوعی را هدایت کند و تضمین کند که این فناوری به حقوق فردی و ارزشهای اجتماعی احترام میگذارد.

- انصاف الگوریتمی: اجرای اقدامات برای تشخیص و تصحیح سوگیری در الگوریتمهای هوش مصنوعی برای اطمینان از انصاف و نتایج عادلانه حیاتی است.

- معاملات مورد اعتماد: برای مقیاسبندی مؤثر فناوریهای هوش مصنوعی، باید تراکنشهای قابل اعتماد ایجاد شود تا کاربران بتوانند با اطمینان به تصمیمهای مبتنی بر هوش مصنوعی تکیه کنند.

- تمهیدات امنیتی: پروتکل های امنیتی قوی برای محافظت از سیستم های هوش مصنوعی در برابر تهدیدات سایبری و تضمین حریم خصوصی داده ها ضروری است.

- سازگاری: سیستمهای هوش مصنوعی باید به گونهای طراحی شوند که با چشماندازهای قانونی در حال تحول سازگار شوند و از انطباق مداوم با استانداردهای اخلاقی و قانونی اطمینان حاصل کنند.

- پایداری هزینه: مقرون به صرفه بودن برای اطمینان از اینکه استقرار هوش مصنوعی از نظر مالی قابل دوام باقی می ماند، بسیار مهم است و آن را برای طیف وسیع تری از سازمان ها قابل دسترسی می کند.

- توانایی انسانی و تاثیر ESG: هوش مصنوعی باید قابلیتهای انسانی را افزایش دهد و در عین حال بر عوامل محیطی، اجتماعی و حاکمیتی (ESG) نیز تأثیر مثبت بگذارد و به جامعهای پایدارتر و عادلانهتر کمک کند.

از آنجایی که فناوریهای هوش مصنوعی به تغییر شکل صنایع و جامعه ادامه میدهند، مدیریت مسئولانه هوش مصنوعی دیگر اختیاری نیست. ضروری است. رویکرد مسئولیت اول، اخلاق و مسئولیتپذیری را در هسته توسعه و استقرار هوش مصنوعی قرار میدهد و به سازمانها این امکان را میدهد تا از مزایای این فناوری بهره ببرند و در عین حال به نگرانیهای اخلاقی مانند حفظ حریم خصوصی دادهها، سوگیری الگوریتم و سوء استفاده احتمالی بپردازند. با انجام این کار، میتوانیم اطمینان حاصل کنیم که از قدرت هوش مصنوعی بهطور مسئولانه استفاده میشود و به نفع کسبوکارها و جامعه است.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://www.dataversity.net/responsible-first-ai-governance-addressing-ethical-concerns-for-scalable-adoption/

- : دارد

- :است

- :نه

- a

- در دسترس

- مسئوليت

- اقدامات

- وفق دادن

- نشانی

- خطاب به

- اتخاذ

- ظهور

- AI

- حکمرانی هوش مصنوعی

- سیستم های هوش مصنوعی

- الگوریتم

- الگوریتمی

- تعصب الگوریتمی

- الگوریتم

- معرفی

- اجازه دادن

- همچنین

- an

- و

- هستند

- مصنوعی

- هوش مصنوعی

- هوش مصنوعی (AI)

- AS

- ظاهر

- At

- تلاشها

- BE

- شدن

- شود

- بوده

- سودمند است

- مزایای

- تعصب

- هر دو

- به ارمغان بیاورد

- آوردن

- گسترده تر

- کسب و کار

- by

- CAN

- نمی توان

- قابلیت های

- قابلیت

- چالش ها

- به چالش کشیدن

- واضح

- مجموعه

- انطباق

- نگرانی ها

- اعتماد به نفس

- عواقب

- زمینه

- ادامه دادن

- ادامه داد:

- کمک

- هسته

- اصلاح

- هزینه

- بسیار سخت

- سایبر

- داده ها

- حریم خصوصی داده ها

- DATAVERSITY

- تصمیم گیری

- گسترش

- گسترش

- طراحی

- تشخیص

- پروژه

- عمل

- رانده

- به طور موثر

- سنگ سنباده

- قادر ساختن

- را قادر می سازد

- را در بر می گیرد

- تلاش کن

- اعمال

- بالا بردن

- اطمینان حاصل شود

- حصول اطمینان از

- شرکت

- محیطی

- متساوی

- انصاف

- IS G

- ضروری است

- ایجاد

- تاسیس

- اخلاقی

- اصول اخلاق

- در حال تحول

- موجود

- عوامل

- عدالت

- گسترده

- به لحاظ مالی

- برای

- خط مقدم

- چارچوب

- از جانب

- بیشتر

- حکومت

- اداره می شود

- راهنمایی

- صدمه

- دهنه

- مهار شده

- آیا

- داشتن

- میزبان

- HTTPS

- انسان

- عظیم

- ایمنی

- تأثیر

- تأثیرگذاری

- امری ضروری

- اجرای

- in

- شامل

- از جمله

- به طور فزاینده

- فرد

- لوازم

- صنعت

- نابرابری

- موثر

- اطلاعات

- مسائل

- IT

- کلید

- تا حد زیادی

- برجسته

- قانونی

- قدرت نفوذ

- دیگر

- نگهداری

- ساخت

- ساخت

- معنی دار

- معیارهای

- بدرفتاری

- اطلاعات غلط

- سوء استفاده

- تسکین دهنده

- بیش

- چند وجهی

- باید

- هدایت

- لازم

- نیاز

- نه

- of

- on

- or

- سازمان های

- نتایج

- برترین

- شخصی

- اطلاعات شخصی

- چشم انداز

- اماکن

- افلاطون

- هوش داده افلاطون

- PlatoData

- مثبت

- پتانسیل

- قدرت

- هدیه

- جلوگیری از

- اولویت بندی

- خلوت

- امید بخش

- پروتکل

- مطرح شده

- محدوده

- سریعا

- مقررات

- تنظیم کننده

- پیروی از مقررات

- تکیه

- بقایای

- به یاد داشته باشید

- تغییر شکل

- احترام می گذارد

- مسئوليت

- مسئولانه

- حقوق

- قوانین

- مقیاس پذیر

- مقیاس

- مقیاس Ai

- بخش ها

- تیم امنیت لاتاری

- اقدامات امنیتی

- شدید

- باید

- قابل توجه

- So

- آگاهی

- اجتماعی

- جامعه

- استانداردهای

- ذخیره سازی

- چنین

- نظارت

- پایداری

- قابل تحمل

- سیستم های

- فن آوری

- پیشرفته

- نسبت به

- که

- La

- شان

- آنها

- آنجا.

- اینها

- آنها

- این

- اگر چه؟

- تهدید

- به

- معاملات

- صادقانه

- مورد اعتماد

- بر

- استفاده کنید

- کاربران

- ارزشها

- مختلف

- قابل اعتماد

- حیاتی

- we

- به خوبی تعریف شده است

- چه زمانی

- که

- در حین

- با

- در داخل

- جهان

- زفیرنت