در دنیای امروز ما توسط منابع مختلف اطلاعات مکتوب احاطه شده ایم، اطلاعاتی که معمولاً تصور می کنیم توسط انسان های دیگر نوشته شده است. چه به صورت کتاب، وبلاگ، مقالههای خبری، پستهای فروم، بازخورد در صفحه محصول یا بحث در رسانههای اجتماعی و در بخشهای نظرات باشد، فرض بر این است که متنی که میخوانیم توسط شخص دیگری نوشته شده باشد. با این حال، در طول سالها احتمال نادرست بودن این فرض بیشتر شده است، اخیراً به دلیل مدلهای زبان بزرگ (LLM) مانند GPT-2 و GPT-3 که میتوانند پاراگرافهای قابل قبولی را در مورد هر موضوعی در صورت درخواست ایجاد کنند.

این سؤال را مطرح میکند که آیا ما در آستانه رسیدن به نقطهای هستیم که دیگر نمیتوانیم به طور منطقی مطمئن باشیم که یک نظر آنلاین، یک مقاله خبری، یا حتی کل کتابها و فیلمنامهها توسط یک الگوریتم ساخته نشدهاند، یا شاید حتی در جایی که یک چت آنلاین با یک بازی جذاب جدید معلوم میشود که فقط شما آن را با مجموعهای از کدهای بیاحساس انجام میدهید که برای حداکثر تعامل با مشتریان آموزش داده شده و بهینهسازی شدهاند. (یادداشت سردبیر: نه، ما آن بازی را اینجا بازی نمی کنیم.)

از آنجایی که چنین محتوا و تعاملات تولید شده توسط ماشین شروع به ایفای نقش بزرگتری میکنند، این سوال را مطرح میکند که چگونه میتوانید چنین محتوای تولید شده را شناسایی کنید، و همچنین اینکه آیا این مهم است که محتوا به جای اینکه توسط یک انسان توسط یک الگوریتم تولید شده باشد یا خیر. .

تندی در مقابل بدخواهی

در جورج اورول هزار و نهصد و هشتاد و چهار، وینستون اسمیت بخشی را در وزارت حقیقت به نام بخش داستان توصیف می کند، که در آن ماشین ها دائماً رمان های تازه تولید شده مبتنی بر موضوعات خاص را تولید می کنند. در همین حال، در بخش موسیقی، موسیقی جدید توسط سیستم دیگری به نام versificator در حال تولید است.

با این حال، به همان اندازه که این دنیای تخیلی دیستوپیک است، این محتوای تولید شده توسط ماشین اساساً بی ضرر است، همانطور که وینستون بعداً در کتاب اظهار می کند، وقتی زنی را در منطقه پربازدید شهر مشاهده می کند که آخرین آهنگ را می خواند و شدت احساسی خود را به آهنگ عاشقانه ای که توسط دستگاهی بی احساس و بی فکر به بیرون پریده شد. این ما را به رایج ترین استفاده از محتوای تولید شده توسط ماشین می رساند، که بسیاری استدلال می کنند که صرفاً نوعی اتوماسیون است.

اصطلاح فراگیر در اینجا "روزنامه نگاری خودکار'، و دارد در حال استفاده بوده است سال هاست که با رسانه های معتبر روزنامه نگاری مانند رویترز، AP و دیگران. موارد استفاده در اینجا ساده و سرراست است: اینها سیستمهایی هستند که به گونهای پیکربندی شدهاند که اطلاعات مربوط به عملکرد سهام، گزارشهای فصلی شرکت، نتایج مسابقات ورزشی یا انتخابات محلی را دریافت کنند و مقالهای را طبق یک الگوی از پیش تعیینشده ارائه کنند. مزیت آشکار این است که اتاق های پر از روزنامه نگارانی که به طور خسته کننده نمرات و معیارهای عملکرد را در قالب های مقاله کپی می کنند، می توانند با یک الگوریتم کامپیوتری جایگزین شوند.

در این موارد، کارهایی که شامل معادل ژورنالیستی یا هنری برگرداندن همبرگر در فست فود است، با الگوریتمی جایگزین میشود که هرگز حوصله و حواسپرتی را ندارد، در حالی که انسانها میتوانند کارهای چالشبرانگیزتری از نظر فکری انجام دهند. تعداد کمی استدلال می کنند که مشکلی در این نوع اتوماسیون وجود دارد، زیرا اساساً دقیقاً همان کاری را که به ما قول داده شده بود انجام می دهد.

جایی که همه چیز سایه می اندازد زمانی است که برای اهداف پلید استفاده می شود، مانند جذب ترافیک جستجو با محصولات ماشینی که سعی می کنند چیزی به خواننده بفروشند. اگر چه این اخیرا منجر به خشم قابل توجه در مورد CNET، واقعیت این است که این یک رویکرد فوق العاده سودآور است، بنابراین ممکن است در آینده شاهد بیشتری از آن باشیم. به هر حال، یک مدل زبان بزرگ میتواند مجموعه کاملی از مقالهها را در مدت زمانی که یک نویسنده انسانی طول میکشد تا چند پاراگراف متن را بگذارد، تولید کند.

بیشتر منطقه خاکستری مربوط به کمک به یک نویسنده انسانی است که در حال تبدیل شدن به یک موضوع در دنیای انتشارات علمی است. اخیراً تحت پوشش قرار گرفته است by گاردین، که خودشان در سپتامبر 2020 زمانی که آنها کمی شیرین کاری کردند چاپ مقاله که توسط GPT-3 LLM تولید شده بود. هشداری که وجود داشت این بود که این خروجی مستقیم از LLM نبود، بلکه چیزی بود که یک ویرایشگر انسانی از خروجی های متعدد تولید شده توسط GPT-3 با هم گیج کرده بود. این نسبتاً نشان دهنده نحوه استفاده عمومی از LLM است و به برخی از بزرگترین نقاط ضعف آنها اشاره می کند.

بدون پاسخ اشتباه

در هسته خود مانند LLM GPT-3 یک پایگاه داده به شدت بهم پیوسته از مقادیر است که از متون ورودی که مجموعه داده های آموزشی را تشکیل می دهند، تولید شده است. در مورد GPT-3 این یک پایگاه داده (مدل) با اندازه حدود 800 گیگابایت ایجاد می کند. به منظور جستجو در این پایگاه داده، یک رشته پرس و جو ارائه می شود - به طور کلی به عنوان یک سوال یا عبارت اصلی - که پس از پردازش، ورودی یک الگوریتم برازش منحنی را تشکیل می دهد. اساساً این احتمال مربوط بودن پرس و جو ورودی به بخشی از مدل را تعیین می کند.

هنگامی که یک تطابق احتمالی پیدا شد، خروجی می تواند بر اساس محتمل ترین اتصال بعدی در پایگاه داده مدل ایجاد شود. این به یک LLM اجازه می دهد تا اطلاعات خاصی را در یک مجموعه داده بزرگ بیابد و متون از نظر تئوری بی نهایت طولانی ایجاد کند. با این حال، کاری که نمی تواند انجام دهد این است که تعیین کند آیا پرس و جوی ورودی منطقی است یا اینکه خروجی تولید شده منطقی است. تنها چیزی که الگوریتم میتواند تعیین کند این است که آیا از محتملترین مسیر پیروی میکند، با احتمالاً تغییرات القایی برای مخلوط کردن خروجی.

چیزی که هنوز به عنوان یک مشکل در متون تولید شده توسط LLM در نظر گرفته می شود، تکرار است، اگرچه این مشکل را می توان با برخی ترفندها حل کرد که به خروجی یک "حافظه" می دهد تا تعداد دفعات استفاده از یک کلمه خاص را کاهش دهد. چیزی که حل کردن آن سختتر است، اطمینان مطلق خروجی LLM است، زیرا هیچ راهی برای تعیین اینکه آیا صرفاً مزخرف تولید میکند یا نه و با خوشحالی به غرولند کردن ادامه خواهد داد.

با این حال، با وجود این، زمانی که افراد انسانی در معرض متون GPT-3- و GPT-2 تولید شده قرار می گیرند. مطالعه 2021 توسط الیزابت کلارک و همکاران، احتمال اینکه آنها متون تولید شده توسط این LLMها را - حتی پس از مدتی آموزش - تشخیص دهند، از 55% تجاوز نمی کند و تقریباً شبیه به شانس محض است. فقط چرا انسان ها در تشخیص این متون تولید شده توسط LLM بسیار وحشتناک هستند و شاید کامپیوترها می توانند در اینجا به ما کمک کنند؟

آمار در مقابل شهود

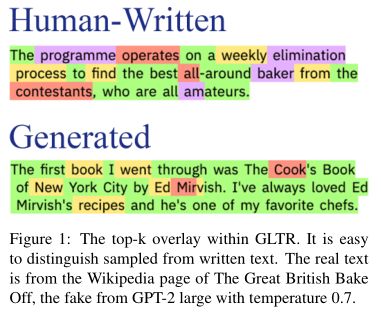

(اعتبار: Gehrmann و همکاران، 2019)

وقتی از یک انسان سوال میشود که آیا یک متن توسط یک انسان ایجاد شده یا توسط یک ماشین تولید شده است، احتمالاً اساساً بر اساس تجربیات خود، «احساس درونی» و احتمالاً طیفی از سرنخها حدس میزنند. در یک مقاله 2019 توسط Sebastian Gehrmann و همکاران، یک رویکرد آماری برای تشخیص متن تولید شده توسط ماشین، علاوه بر شناسایی طیف وسیعی از نمونههای شوم متن تولید شده خودکار، پیشنهاد شده است. اینها شامل نظرات جعلی در مخالفت با بی طرفی شبکه ایالات متحده و بررسی های گمراه کننده است.

رویکرد آماری به تفصیل توسط Gehrmann و همکاران. اتاق آزمون مدل زبان غولپیکر (GLTR، منبع GitHub) شامل تجزیه و تحلیل یک متن داده شده برای قابل پیش بینی بودن آن است. این مشخصه ای است که اغلب توسط خوانندگان به عنوان «کم عمقی» یک متن تولید شده توسط ماشین توصیف می شود، به این دلیل که در پاراگراف ها بدون گفتن چیز زیادی ادامه می دهد. با ابزاری مانند GLTR، چنین متنی در نمایش بصری بیشتر سبز می شود، زیرا از واژگان محدود و قابل پیش بینی استفاده می کند.

In مقاله ارائه شده توسط دافنه ایپولیتو و همکاران. (PDF) در نشست 2020 انجمن زبانشناسی محاسباتی، رویکردهای مختلف برای تشخیص متن تولید شده توسط ماشین، همراه با اثربخشی این روشها بهصورت مجزا در مقابل روش ترکیبی پوشش داده شده است. رویکرد تجزیه و تحلیل top-k مورد استفاده توسط GLTR در این روش ها گنجانده شده است، با رویکردهای جایگزین نمونه برداری هسته (top-p) و سایر روش ها نیز مورد توجه قرار گرفته است.

در نهایت، در این مطالعه، افراد انسانی هنگام طبقهبندی متون GPT-74 میانگین 2 درصد را به دست آوردند، با سیستم تشخیص خودکار به طور کلی امتیاز بهتری کسب کرد. قابل توجه مطالعه توسط آری هولتزمن و همکاران که در نتیجه گیری به آن اشاره شده است، که در آن ذکر شده است که متن نوشته شده توسط انسان به طور کلی دارای آهنگی است که در یک منطقه احتمال کم فرو می رود و از آن خارج می شود. این امر نه تنها باعث می شود که چه چیزی یک متن را برای خواندن جالب می کند، بلکه سرنخی از آنچه که متن را برای یک خواننده انسانی طبیعی جلوه می دهد، ارائه می دهد.

با LLM های مدرن مانند GPT-3، رویکردی مانند نمونه برداری هسته پیشنهاد شده توسط هولتزمن و همکاران. چیزی است که آهنگ طبیعی تری را که از متن نوشته شده توسط انسان انتظار می رود ارائه می دهد. بهجای انتخاب از فهرست گزینههای k بالا، به جای آن، از میان مجموعهای از کاندیداها بهصورت پویا تغییر اندازه داده میشود: جرم احتمال. سپس فهرستی از گزینهها، top-p، خروجی بسیار غنیتری نسبت به رویکرد top-k ارائه میدهد که با GPT-2 و kin استفاده میشد.

معنای این نیز این است که در تحلیل خودکار یک متن، رویکردهای متعددی باید در نظر گرفته شود. برای تجزیه و تحلیل توسط یک خواننده انسانی، تمایز بین متن top-k (GPT-2) و top-p (GPT-3) واضح است، و نوع دوم احتمالاً توسط یک انسان نوشته شده است.

زمان نامشخص

بنابراین به نظر می رسد که پاسخ به این سؤال که آیا یک متن داده شده توسط یک انسان تولید شده است یا نه، یک «شاید» قطعی است. اگرچه تجزیه و تحلیل آماری می تواند نکاتی را در مورد احتمال تولید یک متن توسط یک LLM ارائه دهد، در نهایت قضاوت نهایی باید با یک انسان باشد، که نه تنها می تواند تعیین کند که آیا متن از نظر معنایی و متنی عبور می کند یا خیر، بلکه بررسی می کند. منبع فرضی یک متن برای واقعی بودن

به طور طبیعی، موقعیتهای زیادی وجود دارد که ممکن است مهم نباشد که چه کسی یک متن را نوشته است، تا زمانی که اطلاعات موجود در آن واقعاً صحیح باشد. با این حال، زمانی که احتمالاً قصد شیطانی یا قصد فریب وجود دارد، باید سعی و کوشش لازم را انجام داد. حتی با وجود الگوریتمهای تشخیص خودکار، و با استفاده از یک کاربر آموزشدیده و محتاط، این مسئولیت بر عهده خواننده باقی میماند که اطلاعات را با ارجاع متقابل انجام دهد و اطمینان حاصل کند که آیا اظهاراتی که توسط یک حساب تصادفی در رسانههای اجتماعی ارائه میشود ممکن است واقعی باشد یا خیر.

(یادداشت ویراستار: این پست در مورد تلاش OpenAI برای تشخیص نثر خودش است بین نوشتن و انتشار این مقاله منتشر شد. نتایج آنها چندان عالی نیست، و مانند همه چیز از "Open" AI، روش های آنها به طور عمومی فاش نمی شود. با این حال، می توانید طبقه بندی کننده را امتحان کنید.)

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- پلاتوبلاک چین. Web3 Metaverse Intelligence. دانش تقویت شده دسترسی به اینجا.

- منبع: https://hackaday.com/2023/02/01/detecting-machine-generated-content-an-easier-task-for-machine-or-human/

- 1

- 2019

- 2020

- a

- درباره ما

- مطلق

- حساب

- اضافه

- مزیت - فایده - سود - منفعت

- پس از

- الگوریتم

- الگوریتم

- معرفی

- اجازه می دهد تا

- هر چند

- تحلیل

- تجزیه و تحلیل

- و

- دیگر

- پاسخ

- روش

- رویکردها

- محدوده

- استدلال

- دور و بر

- مقاله

- مقالات

- هنرمندانه

- انجمن

- فرض

- خودکار

- اتوماتیک

- اتوماسیون

- مستقر

- اساسا

- خرس

- شدن

- تبدیل شدن به

- بودن

- بهتر

- میان

- بزرگتر

- بزرگترین

- بیت

- وبلاگ ها

- کتاب

- کتاب

- بی حوصله

- به ارمغان می آورد

- آهنگ

- نام

- نامزد

- نمی توان

- مورد

- موارد

- محتاط

- معین

- به چالش کشیدن

- شانس

- مشخصه

- بررسی

- شهر:

- CNET

- رمز

- مجموعه

- ترکیب شده

- توضیح

- نظرات

- مشترک

- شرکت

- کامپیوتر

- کامپیوتر

- نگرانی ها

- نتیجه

- اعتماد به نفس

- ارتباط

- در نظر گرفته

- به طور مداوم

- محتوا

- کپی برداری

- هسته

- دوره

- پوشش داده شده

- ایجاد

- ایجاد شده

- اعتبار

- منحنی

- مشتریان

- برش

- داده ها

- مجموعه داده ها

- پایگاه داده

- قطعی

- بخش

- شرح داده شده

- با وجود

- دقیق

- مشخص کردن

- تعیین می کند

- سخت کوشی

- بحث و گفتگو

- نمی کند

- پایین

- دوطرفه

- آسان تر

- سردبیر

- اثر

- انتخابات

- شامل

- نامزدی

- تمام

- معادل

- اساسا

- اتر (ETH)

- حتی

- تا کنون

- همه چیز

- کاملا

- تجاوز

- انتظار می رود

- تجارب

- جعلی

- روش

- FAST

- باز خورد

- کمی از

- داستان

- تخیلی

- فیلم

- نهایی

- پیدا کردن

- مناسب

- پیروی

- به دنبال آن است

- غذا

- فوربس

- فرم

- اشکال

- انجمن

- یافت

- از جانب

- کامل

- آینده

- بازی

- عموما

- تولید می کنند

- تولید

- تولید می کند

- جورج

- دریافت کنید

- گرفتن

- غول

- دادن

- داده

- بزرگ

- سبز

- داشتن

- به شدت

- کمک

- اینجا کلیک نمایید

- نکات

- چگونه

- اما

- HTTPS

- انسان

- انسان

- شناسایی

- شناسایی

- in

- شامل

- مشمول

- بطور باور نکردنی

- اطلاعات

- ورودی

- در عوض

- قصد

- فعل و انفعالات

- به هم پیوسته

- جالب

- انزوا

- موضوع

- IT

- مشترک

- روزنامه نگاران

- نگاه داشتن

- کین

- نوع

- زبان

- بزرگ

- آخرین

- برجسته

- رهبری

- سبک

- احتمالا

- محدود شده

- زبان شناسی

- فهرست

- محلی

- طولانی

- دیگر

- عشق

- کم

- دستگاه

- ماشین آلات

- ساخته

- باعث می شود

- ساخت

- بسیاری

- توده

- مسابقه

- ماده

- مسائل

- حداکثر عرض

- بیشترین

- به معنی

- در ضمن

- رسانه ها

- نشست

- صرفا - فقط

- روش

- متریک

- قدرت

- وزارتخانه

- مدل

- مدل

- مدرن

- بیش

- اکثر

- چندگانه

- موسیقی

- طبیعی

- خالص

- بی طرفی خالص

- جدید

- اخبار

- بعد

- اشاره کرد

- عدد

- مشاهده می کند

- واضح

- ONE

- آنلاین

- مخالفت

- گزینه

- سفارش

- دیگر

- دیگران

- رسانه

- خود

- مقاله

- عبور می کند

- الگو

- کارایی

- شاید

- شخص

- محل

- افلاطون

- هوش داده افلاطون

- PlatoData

- محتمل

- بازی

- بازی

- بسیاری

- نقطه

- استخر

- پست

- پست ها

- تمرین

- قابل پیش بینی

- ارائه شده

- احتمال

- مشکل

- در حال پردازش

- محصول

- مفید

- وعده داده شده

- پیشنهاد شده

- ارائه

- ارائه

- فراهم می کند

- عمومی

- منتشر شده

- انتشار

- اهداف

- قرار دادن

- سوال

- افزایش

- تصادفی

- محدوده

- رسیدن به

- خواندن

- خواننده

- خوانندگان

- مطالعه

- تازه

- مربوط

- بقایای

- جایگزین

- گزارش ها

- نمایندگی

- خواسته

- مصمم

- احترام

- نتیجه

- نتایج

- رویترز

- بررسی

- نقش

- اتاق

- اتاق

- تقریبا

- به ثمر رساندن

- اسکریپت

- جستجو

- بخش

- بخش

- فروش

- حس

- سپتامبر

- تنظیم

- ساده

- شرایط

- اندازه

- So

- آگاهی

- رسانه های اجتماعی

- برخی از

- چیزی

- منبع

- منابع

- خاص

- ورزش ها

- پشته

- کامل

- بیانیه

- آماری

- هنوز

- موجودی

- راست

- ساده

- مهاجرت تحصیلی

- چنین

- احاطه شده

- سیستم

- سیستم های

- گرفتن

- طول می کشد

- کار

- قالب

- آزمون

- La

- آینده

- اطلاعات

- جهان

- شان

- خودشان

- اشیاء

- زمان

- بار

- به

- امروز

- با هم

- ابزار

- موضوع

- ترافیک

- آموزش دیده

- آموزش

- در نهایت

- us

- استفاده کنید

- کاربر

- ارزشها

- مختلف

- در مقابل

- چی

- چه شده است

- چه

- که

- در حین

- WHO

- ویکیپدیا

- اراده

- در داخل

- بدون

- زن

- کلمه

- مهاجرت کاری

- جهان

- خواهد بود

- نویسنده

- کتبی

- اشتباه

- سال

- زفیرنت