A technical paper titled “WWW: What, When, Where to Compute-in-Memory” was published by researchers at Purdue University.

چکیده:

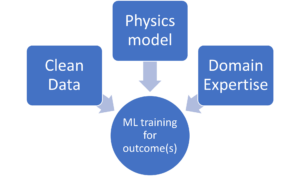

“Compute-in-memory (CiM) has emerged as a compelling solution to alleviate high data movement costs in von Neumann machines. CiM can perform massively parallel general matrix multiplication (GEMM) operations in memory, the dominant computation in Machine Learning (ML) inference. However, re-purposing memory for compute poses key questions on 1) What type of CiM to use: Given a multitude of analog and digital CiMs, determining their suitability from systems perspective is needed. 2) When to use CiM: ML inference includes workloads with a variety of memory and compute requirements, making it difficult to identify when CiM is more beneficial than standard processing cores. 3) Where to integrate CiM: Each memory level has different bandwidth and capacity, that affects the data movement and locality benefits of CiM integration.

In this paper, we explore answers to these questions regarding CiM integration for ML inference acceleration. We use Timeloop-Accelergy for early system-level evaluation of CiM prototypes, including both analog and digital primitives. We integrate CiM into different cache memory levels in an Nvidia A100-like baseline architecture and tailor the dataflow for various ML workloads. Our experiments show CiM architectures improve energy efficiency, achieving up to 0.12x lower energy than the established baseline with INT-8 precision, and upto 4x performance gains with weight interleaving and duplication. The proposed work provides insights into what type of CiM to use, and when and where to optimally integrate it in the cache hierarchy for GEMM acceleration.”

یافتن مقاله فنی اینجا منتشر شده در دسامبر 2023 (پیش چاپ).

Sharma, Tanvi, Mustafa Ali, Indranil Chakraborty, and Kaushik Roy. “WWW: What, When, Where to Compute-in-Memory.” arXiv preprint arXiv:2312.15896 (2023).

خواندن مرتبط

افزایش بهره وری انرژی هوش مصنوعی با محاسبه در حافظه

نحوه پردازش حجم کاری زتا اسکیل و ماندن در بودجه ثابت.

مدلسازی محاسبه در حافظه با کارایی بیولوژیکی

هوش مصنوعی مولد، تراشهسازان را مجبور میکند از منابع محاسباتی هوشمندانهتر استفاده کنند.

SRAM In AI: The Future Of Memory

Why SRAM is viewed as a critical element in new and traditional compute architectures.

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://semiengineering.com/cim-integration-for-ml-inference-acceleration/

- : دارد

- :است

- :جایی که

- $UP

- 1

- 2023

- a

- شتاب

- دستیابی به

- AI

- کم کردن

- an

- و

- پاسخ

- معماری

- AS

- At

- پهنای باند

- خط مقدم

- مفید

- مزایای

- هر دو

- بودجه

- by

- نهانگاه

- CAN

- ظرفیت

- متقاعد کننده

- محاسبه

- محاسبه

- هزینه

- بحرانی

- داده ها

- دسامبر

- تعیین

- مختلف

- مشکل

- دیجیتال

- غالب

- هر

- در اوایل

- بهره وری

- عنصر

- ظهور

- انرژی

- صرفه جویی در مصرف انرژی

- تاسیس

- ارزیابی

- آزمایش

- اکتشاف

- ثابت

- برای

- نیروهای

- از جانب

- آینده

- عایدات

- سوالات عمومی

- داده

- اینجا کلیک نمایید

- سلسله مراتب

- زیاد

- اما

- HTTPS

- شناسایی

- بهبود

- in

- شامل

- از جمله

- بینش

- ادغام

- ادغام

- به

- IT

- JPG

- کلید

- یادگیری

- سطح

- سطح

- کاهش

- دستگاه

- فراگیری ماشین

- ماشین آلات

- ساخت

- انبوه

- ماتریس

- حافظه

- ML

- بیش

- جنبش

- بسیاری

- ضروری

- جدید

- کارت گرافیک Nvidia

- of

- on

- باز کن

- عملیات

- ما

- مقاله

- موازی

- انجام دادن

- کارایی

- چشم انداز

- افلاطون

- هوش داده افلاطون

- PlatoData

- به شمار

- قدرت

- دقت

- روند

- در حال پردازش

- پیشنهاد شده

- نمونه

- فراهم می کند

- منتشر شده

- سوالات

- با توجه

- مورد نیاز

- محققان

- منابع

- روی

- نشان

- راه حل

- استاندارد

- ماندن

- مناسب بودن

- سیستم های

- فنی

- نسبت به

- که

- La

- آینده

- شان

- اینها

- این

- با عنوان

- به

- سنتی

- نوع

- دانشگاه

- استفاده کنید

- تنوع

- مختلف

- مشاهده شده

- از

- بود

- we

- وزن

- چی

- چه زمانی

- با

- در داخل

- مهاجرت کاری

- زفیرنت