See postitus on kirjutatud koos Preshen Goobiahi ja Johan Olivieriga Capitecist.

Apache Spark on laialdaselt kasutatav avatud lähtekoodiga hajutatud töötlemissüsteem, mis on tuntud suuremahuliste andmekoormuste käsitlemise poolest. See leiab sageli rakendust Sparki arendajate seas, kellega koos töötavad Amazon EMR, Amazon SageMaker, AWS liim ja kohandatud Sparki rakendused.

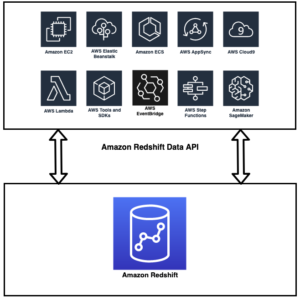

Amazoni punane nihe pakub sujuvat integreerimist Apache Sparkiga, võimaldades teil hõlpsasti juurde pääseda oma Redshifti andmetele nii Amazon Redshiftiga varustatud klastrites kui ka Amazon Redshift serverita. See integratsioon laiendab AWS-i analüütika ja masinõppe (ML) lahenduste võimalusi, muutes andmelao kättesaadavaks suuremale hulgale rakendustele.

Koos Amazon Redshift integratsioon Apache Sparkile, saate kiiresti alustada ja vaevata Sparki rakendusi arendada, kasutades populaarseid keeli, nagu Java, Scala, Python, SQL ja R. Teie rakendused saavad sujuvalt lugeda teie Amazon Redshifti andmelaost ja sinna kirjutada, säilitades samal ajal optimaalse jõudluse ja tehingute järjepidevuse. Lisaks saate kasu tõukepõhise optimeerimise kaudu jõudluse paranemisest, mis suurendab veelgi teie toimingute tõhusust.

Capitec, Lõuna-Aafrika suurim jaepank, millel on üle 21 miljoni jaepanganduse kliendi, püüab pakkuda lihtsaid, taskukohaseid ja juurdepääsetavaid finantsteenuseid, et aidata lõuna-aafriklastel paremini elada, et nad saaksid paremini elada. Selles postituses käsitleme avatud lähtekoodiga Amazon Redshift konnektori edukat integreerimist Capiteci jagatud teenuste funktsiooniplatvormi meeskonna poolt. Apache Sparki Amazon Redshifti integratsiooni kasutamise tulemusena suurenes arendaja tootlikkus 10 korda, funktsioonide genereerimise torujuhtmeid muudeti sujuvamaks ja andmete dubleerimine vähenes nullini.

Ärivõimalus

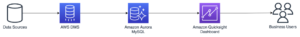

Capiteci jaemüügikrediidi divisjonides on saadaval 19 ennustavat mudelit, mis võimaldavad kasutada 93 AWS Glue'iga loodud funktsiooni. Funktsioonide kirjed on rikastatud Amazon Redshiftis salvestatud faktide ja mõõtmetega. Funktsioonide loomiseks valiti Apache PySpark, kuna see pakub kiiret, detsentraliseeritud ja skaleeritavat mehhanismi erinevatest allikatest pärit andmete vaidlustamiseks.

Need tootmisfunktsioonid mängivad otsustavat rolli reaalajas tähtajaliste laenutaotluste, krediitkaarditaotluste, igakuise krediidikäitumise jälgimise ja igapäevase palga identifitseerimise võimaldamisel ettevõttes.

Andmeallika probleem

PySparki andmekonveierite usaldusväärsuse tagamiseks on oluline, et ettevõtte andmelaos (EDW) oleks järjepidevad kirjetaseme andmed nii dimensiooni- kui ka faktitabelitest. Seejärel ühendatakse need tabelid käitusajal Enterprise Data Lake'i (EDL) tabelitega.

Funktsioonide arendamise ajal nõuavad andmeinsenerid EDW-ga sujuvat liidest. See liides võimaldab neil EDW-st vajalikele andmetele juurde pääseda ja neid andmetorudesse integreerida, võimaldades funktsioonide tõhusat arendamist ja testimist.

Eelmine lahendusprotsess

Eelmises lahenduses kulutasid tootemeeskonna andmeinsenerid 30 minutit ühe jooksu kohta, et Redshifti andmed Sparkile käsitsi avaldada. Sammud hõlmasid järgmist.

- Ehitage Pythonis predikteeritud päring.

- Saada LAADI VÄLJA päring läbi Amazon Redshift Data API.

- Kataloogiandmed AWS-i liimiandmete kataloogis Pandadele mõeldud AWS SDK kaudu, kasutades proovivõttu.

Selline lähenemine tekitas probleeme suurte andmekogumite puhul, nõudis platvormimeeskonnalt korduvat hooldust ja seda oli keeruline automatiseerida.

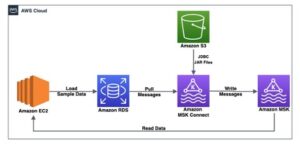

Praeguse lahenduse ülevaade

Capitec suutis need probleemid lahendada Apache Sparki Amazon Redshift integratsiooniga funktsioonide genereerimise torujuhtmetes. Arhitektuur on määratletud järgmisel diagrammil.

Töövoog sisaldab järgmisi samme:

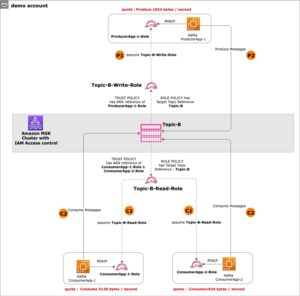

- Sisemised teegid installitakse AWS Glue PySparki töösse selle kaudu AWS CodeArtifact.

- AWS-i liimitöö hangib Redshifti klastri mandaadid AWS-i saladuste haldur ja seadistab Amazon Redshift ühenduse (sisestab klastri mandaadid, mahalaadimiskohad, failivormingud) jagatud sisemise teegi kaudu. Apache Sparki Amazon Redshift integratsioon toetab ka kasutamist AWS-i identiteedi- ja juurdepääsuhaldus (IAM) kuni hankige mandaadid ja looge ühendus Amazon Redshiftiga.

- Sparki päring tõlgitakse Amazon Redshifti optimeeritud päringuks ja esitatakse EDW-le. See saavutatakse Apache Sparki Amazon Redshift integratsiooniga.

- EDW-andmestik laaditakse välja ajutiseks prefiksiks Amazoni lihtne salvestusteenus (Amazon S3) kopp.

- S3 ämbrist pärit EDW andmestik laaditakse Sparki täituritesse Apache Sparki Amazon Redshift integratsiooni kaudu.

- EDL-i andmestik laaditakse Sparki täituritesse AWS-i liimiandmete kataloogi kaudu.

Need komponendid töötavad koos tagamaks, et andmeinseneridel ja tootmisandmete torujuhtmetel on vajalikud tööriistad Amazon Redshifti integratsiooni rakendamiseks Apache Sparki jaoks, päringute käitamiseks ja andmete Amazon Redshiftist EDL-i mahalaadimise hõlbustamiseks.

Amazon Redshifti integratsiooni kasutamine Apache Sparki jaoks AWS Glue 4.0-s

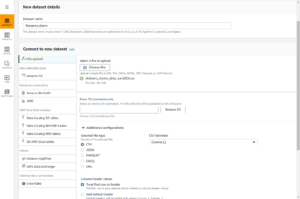

Selles jaotises demonstreerime Amazon Redshifti integreerimise kasulikkust Apache Sparki jaoks, rikastades S3 andmejärves asuvat laenutaotluste tabelit PySparki Redshifti andmelaost pärineva klienditeabega.

. dimclient Amazon Redshifti tabel sisaldab järgmisi veerge:

- Kliendivõti – INT8

- ClientAltKey – VARCHAR50

- PartyIdentifierNumber – VARCHAR20

- ClientCreateDate – KUUPÄEV

- On tühistatud – INT2

- RowIs Current – INT2

. loanapplication AWS-i liimiandmete kataloogi tabel sisaldab järgmisi veerge:

- RecordID – SUUR

- Logikuupäev – TIMESTAMP

- PartyIdentifierNumber – STRING

Redshifti tabelit loetakse Amazon Redshift integratsiooni kaudu Apache Sparkile ja salvestatakse vahemällu. Vaadake järgmist koodi:

Laenutaotluse kirjed loetakse sisse S3 andmejärvest ja neid rikastatakse dimclient tabel Amazon Redshifti teabe kohta:

Selle tulemusena on laenutaotluse kirje (S3 andmejärvest) rikastatud ClientCreateDate veerg (alates Amazon Redshift).

Kuidas Apache Sparki Amazon Redshift integratsioon lahendab andmeallika probleemi

Apache Sparki Amazon Redshift integratsioon lahendab tõhusalt andmete hankimise probleemi järgmiste mehhanismide kaudu:

- Just-in-time lugemine – Amazon Redshifti integratsioon Apache Sparki pistiku jaoks loeb Redshifti tabeleid õigel ajal, tagades andmete ja skeemi järjepidevuse. See on eriti väärtuslik 2. tüüpi aeglaselt muutuv mõõde (SCD) ja ajavahemikku koguvad hetktõmmise faktid. Kombineerides need Redshifti tabelid EDL-i lähtesüsteemi AWS Glue Data Catalog tabelitega PySparki tootmiskonveierites, võimaldab konnektor mitmest allikast pärit andmete sujuvat integreerimist, säilitades samal ajal andmete terviklikkuse.

- Optimeeritud punanihke päringud – Apache Sparki Amazon Redshifti integratsioon mängib Sparki päringuplaani optimeeritud Redshifti päringuks teisendamisel üliolulist rolli. See teisendusprotsess lihtsustab tootemeeskonna arenduskogemust, järgides andmete lokaalsuse põhimõtet. Optimeeritud päringud kasutavad Amazon Redshifti võimalusi ja jõudluse optimeerimist, tagades tõhusa andmete hankimise ja töötlemise Amazon Redshiftist PySparki torujuhtmete jaoks. See aitab arendusprotsessi sujuvamaks muuta, parandades samal ajal andmete hankimise toimingute üldist jõudlust.

Parima soorituse saavutamine

Amazon Redshift integratsioon Apache Sparki jaoks rakendab jõudluse optimeerimiseks automaatselt predikaatide ja päringu allalaadimist. Saate jõudlust parandada, kui kasutate selle integratsiooniga mahalaadimiseks kasutatavat parketi vaikevormingut.

Täiendavate üksikasjade ja koodinäidiste saamiseks vaadake Uus – Amazon Redshift integratsioon Apache Sparkiga.

Lahenduse eelised

Integratsiooni kasutuselevõtt andis meeskonnale mitmeid olulisi eeliseid:

- Suurenenud arendaja tootlikkus – Integratsiooni pakutav PySparki liides suurendas arendaja tootlikkust 10 korda, võimaldades sujuvamat suhtlemist Amazon Redshiftiga.

- Andmete dubleerimise kõrvaldamine – Andmejärves olevad dubleeritud ja AWS Glue'iga kataloogitud Redshift tabelid kõrvaldati, mille tulemuseks oli sujuvam andmekeskkond.

- Vähendatud EDW koormus – Integreerimine hõlbustas andmete valikulist mahalaadimist, minimeerides EDW koormust, eraldades ainult vajalikud andmed.

Kasutades Apache Sparki Amazon Redshifti integratsiooni, on Capitec sillutanud teed täiustatud andmetöötlusele, suuremale tootlikkusele ja tõhusamale funktsioonitehnilisele ökosüsteemile.

Järeldus

Selles postituses arutasime, kuidas Capiteci meeskond edukalt rakendas Apache Sparki jaoks Apache Spark Amazon Redshift integratsiooni, et lihtsustada nende funktsioonide arvutamise töövooge. Nad rõhutasid detsentraliseeritud ja modulaarsete PySparki andmekanalite kasutamise tähtsust ennustavate mudelifunktsioonide loomiseks.

Praegu kasutavad Apache Sparki Amazon Redshift integratsiooni 7 tootmisandmekonveieri ja 20 arendustoru, mis näitab selle tõhusust Capiteci keskkonnas.

Edaspidi plaanib Capiteci jagatud teenuste funktsioonide platvormi meeskond laiendada Amazon Redshifti integratsiooni kasutuselevõttu Apache Sparki jaoks erinevates ärivaldkondades, eesmärgiga täiustada veelgi andmetöötlusvõimalusi ja edendada tõhusaid funktsioonide väljatöötamise tavasid.

Lisateavet Apache Sparki Amazon Redshift integratsiooni kasutamise kohta leiate järgmistest ressurssidest.

Autoritest

Preshen Goobiah on Capiteci funktsiooniplatvormi juhtiv masinõppeinsener. Ta on keskendunud Feature Store'i komponentide kavandamisele ja ehitamisele ettevõttes kasutamiseks. Vabal ajal meeldib talle lugeda ja reisida.

Preshen Goobiah on Capiteci funktsiooniplatvormi juhtiv masinõppeinsener. Ta on keskendunud Feature Store'i komponentide kavandamisele ja ehitamisele ettevõttes kasutamiseks. Vabal ajal meeldib talle lugeda ja reisida.

Johan Olivier on Capiteci mudeliplatvormi masinõppe vaneminsener. Ta on ettevõtja ja probleemide lahendamise entusiast. Ta naudib muusikat ja vabal ajal suhtlemist.

Johan Olivier on Capiteci mudeliplatvormi masinõppe vaneminsener. Ta on ettevõtja ja probleemide lahendamise entusiast. Ta naudib muusikat ja vabal ajal suhtlemist.

Sudipta Bagchi on Amazon Web Services'i lahenduste vanemspetsialist. Tal on üle 12-aastane kogemus andmete ja analüütika vallas ning ta aitab klientidel kavandada ja luua skaleeritavaid ja suure jõudlusega analüüsilahendusi. Väljaspool tööd armastab ta joosta, reisida ja kriketit mängida. Ühendage temaga LinkedIn.

Sudipta Bagchi on Amazon Web Services'i lahenduste vanemspetsialist. Tal on üle 12-aastane kogemus andmete ja analüütika vallas ning ta aitab klientidel kavandada ja luua skaleeritavaid ja suure jõudlusega analüüsilahendusi. Väljaspool tööd armastab ta joosta, reisida ja kriketit mängida. Ühendage temaga LinkedIn.

Syed Humair on Amazon Web Servicesi (AWS) vanemanalüüsispetsialisti lahenduste arhitekt. Tal on üle 17-aastane kogemus ettevõttearhitektuuris, mis keskendub andmetele ja AI/ML-ile, aidates AWS-i klientidel kogu maailmas täita oma äri- ja tehnilisi nõudeid. Saate temaga ühendust võtta LinkedIn.

Syed Humair on Amazon Web Servicesi (AWS) vanemanalüüsispetsialisti lahenduste arhitekt. Tal on üle 17-aastane kogemus ettevõttearhitektuuris, mis keskendub andmetele ja AI/ML-ile, aidates AWS-i klientidel kogu maailmas täita oma äri- ja tehnilisi nõudeid. Saate temaga ühendust võtta LinkedIn.

Vuyisa Maswana on Kaplinnas asuva AWSi vanemlahenduste arhitekt. Vuyisa keskendub tugevalt sellele, et aidata klientidel luua tehnilisi lahendusi äriprobleemide lahendamiseks. Ta on toetanud Capitecit nende AWS-i teekonnal alates 2019. aastast.

Vuyisa Maswana on Kaplinnas asuva AWSi vanemlahenduste arhitekt. Vuyisa keskendub tugevalt sellele, et aidata klientidel luua tehnilisi lahendusi äriprobleemide lahendamiseks. Ta on toetanud Capitecit nende AWS-i teekonnal alates 2019. aastast.

- SEO-põhise sisu ja PR-levi. Võimenduge juba täna.

- PlatoData.Network Vertikaalne generatiivne Ai. Jõustage ennast. Juurdepääs siia.

- PlatoAiStream. Web3 luure. Täiustatud teadmised. Juurdepääs siia.

- PlatoESG. Süsinik, CleanTech, Energia, Keskkond päikeseenergia, Jäätmekäitluse. Juurdepääs siia.

- PlatoTervis. Biotehnoloogia ja kliiniliste uuringute luureandmed. Juurdepääs siia.

- Allikas: https://aws.amazon.com/blogs/big-data/simplifying-data-processing-at-capitec-with-amazon-redshift-integration-for-apache-spark/

- :on

- :on

- $ UP

- 06

- 1

- 10

- 100

- 12

- 16

- 17

- 19

- 20

- 2019

- 30

- 7

- a

- Võimalik

- juurdepääs

- juurdepääsetav

- saavutatud

- üle

- Täiendavad lisad

- Tooteinfo

- Lisaks

- aadress

- aadressid

- kinni pidades

- Vastuvõtmine

- taskukohane

- AI / ML

- Eesmärk

- Eesmärgid

- Lubades

- võimaldab

- Ka

- Amazon

- Amazon Web Services

- Amazon Web Services (AWS)

- vahel

- an

- analytics

- ja

- Apache

- Apache Spark

- taotlus

- rakendused

- kehtib

- lähenemine

- arhitektuur

- OLEME

- valdkondades

- AS

- At

- automatiseerima

- automaatselt

- AWS

- AWS liim

- Pank

- Pangandus

- põhineb

- sest

- käitumine

- kasu

- Kasu

- BEST

- Parem

- vahel

- suurim

- Kiirendatud

- mõlemad

- laiem

- ehitama

- Ehitus

- ehitatud

- äri

- by

- CAN

- võimeid

- neem

- kaart

- kataloog

- muutuv

- klient

- kliendid

- Cluster

- CO

- kood

- Veerg

- Veerud

- kombineerimine

- keeruline

- komponendid

- arvutamine

- Võta meiega ühendust

- ühendus

- järjepidev

- sisaldab

- kontekst

- Konverteerimine

- konverteeriva

- looma

- loomine

- volikiri

- krediit

- krediitkaart

- kriket

- otsustav

- tava

- Kliendid

- iga päev

- andmed

- andmejärv

- andmetöötlus

- andmekogus

- andmekogumid

- Detsentraliseeritud

- vaikimisi

- määratletud

- näitama

- Disain

- projekteerimine

- detailid

- arendama

- arendaja

- Arendajad

- & Tarkvaraarendus

- erinev

- mõõde

- mõõdud

- arutama

- arutatud

- jagatud

- mitu

- kergesti

- ökosüsteemi

- tõhusalt

- tõhusus

- efektiivsus

- tõhus

- sundimatult

- kõrvaldatud

- rõhutas

- võimaldab

- võimaldades

- insener

- Inseneriteadus

- Inseneride

- suurendama

- suurendamine

- rikastatud

- rikastav

- tagama

- tagades

- ettevõte

- entusiast

- Ettevõtja

- keskkond

- oluline

- Eeter (ETH)

- olemasolevate

- Laiendama

- laieneb

- kogemus

- hõlbustada

- hõlbustatakse

- asjaolu

- faktor

- andmed

- KIIRE

- tunnusjoon

- FUNKTSIOONID

- fail

- finants-

- finantsteenused

- leiab

- Keskenduma

- keskendunud

- keskendumine

- Järel

- eest

- formaat

- edasi

- sage

- Alates

- funktsioonid

- edasi

- kasu

- põlvkond

- saama

- GitHub

- Ülemaailmselt

- Käsitsemine

- Olema

- he

- aitama

- aidates

- aitab

- teda

- tema

- Kuidas

- HTML

- http

- HTTPS

- IAM

- Identifitseerimine

- Identity

- rakendada

- rakendatud

- import

- tähtsus

- paranenud

- parandusi

- in

- lisatud

- hõlmab

- kasvanud

- info

- integreerima

- integratsioon

- terviklikkuse

- suhtlemist

- Interface

- sisemine

- sisse

- küsimustes

- IT

- ITS

- Java

- töö

- liituma

- liitunud

- teekond

- järv

- Keeled

- suur

- suuremahuline

- viima

- õppimine

- lahkus

- raamatukogud

- Raamatukogu

- nagu

- elama

- koormus

- laen

- kohad

- armastab

- masin

- masinõpe

- säilitamine

- hooldus

- Tegemine

- viis

- käsitsi

- mehhanism

- mehhanismid

- miljon

- minimeerimine

- protokoll

- ML

- mudel

- mudelid

- modulaarne

- järelevalve

- igakuine

- rohkem

- tõhusam

- mitmekordne

- muusika

- vajalik

- of

- Pakkumised

- Oliiv

- on

- ainult

- avatud

- avatud lähtekoodiga

- Operations

- optimaalselt

- optimeerima

- optimeeritud

- et

- väljaspool

- üle

- üldine

- pandas

- eriti

- Parool

- kohta

- jõudlus

- kava

- plaanid

- inimesele

- Platon

- Platoni andmete intelligentsus

- PlatoData

- mängima

- mängimine

- mängib

- populaarne

- tulenevad

- võimalused

- post

- tavad

- ennustav

- eelmine

- põhimõte

- Probleem

- probleemi lahendamine

- probleeme

- protsess

- töötlemine

- Toode

- Produktsioon

- tootlikkus

- edendama

- anda

- tingimusel

- Python

- päringud

- kiiresti

- R

- valik

- Lugenud

- Lugemine

- reaalajas

- rekord

- andmed

- korduv

- Lühendatud

- viitama

- usaldusväärsus

- Tuntud

- nõudma

- nõutav

- Nõuded

- lahendama

- Vahendid

- kaasa

- tulemuseks

- jaemüük

- Jaepangandus

- Roll

- jooks

- jooksmine

- palk

- SC

- Scala

- skaalautuvia

- ulatus

- SDK

- sujuv

- sujuvalt

- saladusi

- Osa

- vaata

- väljavalitud

- valides

- selektiivne

- vanem

- Teenused

- Komplektid

- mitu

- jagatud

- esitlus

- märkimisväärne

- lihtne

- lihtsustama

- lihtsustamine

- alates

- Aeglaselt

- sujuvam

- Snapshot

- So

- suhtlemine

- lahendus

- Lahendused

- LAHENDAGE

- Lahendab

- allikas

- Allikad

- Allhange

- Lõuna

- Säde

- spetsialist

- kasutatud

- SQL

- alustatud

- Sammud

- ladustamine

- ladustatud

- kiirendama

- Sujuvamaks

- nöör

- tugev

- esitatud

- edukas

- Edukalt

- Toetatud

- Toetab

- süsteem

- tabel

- meeskond

- Tehniline

- ajutine

- Testimine

- et

- .

- Allikas

- oma

- Neile

- SIIS

- Need

- nad

- see

- Läbi

- aeg

- et

- kokku

- töövahendid

- linn

- tehinguline

- Reisimine

- URL

- kasutama

- Kasutatud

- kasutamine

- kasulikkus

- kasutatud

- kasutades

- väärtuslik

- kaudu

- Ladu

- oli

- Tee..

- we

- web

- veebiteenused

- olid

- kuigi

- koos

- jooksul

- Töö

- koos töötama

- töövoog

- Töövoogud

- töö

- kirjutama

- aastat

- andis järele

- sa

- Sinu

- sephyrnet

- null