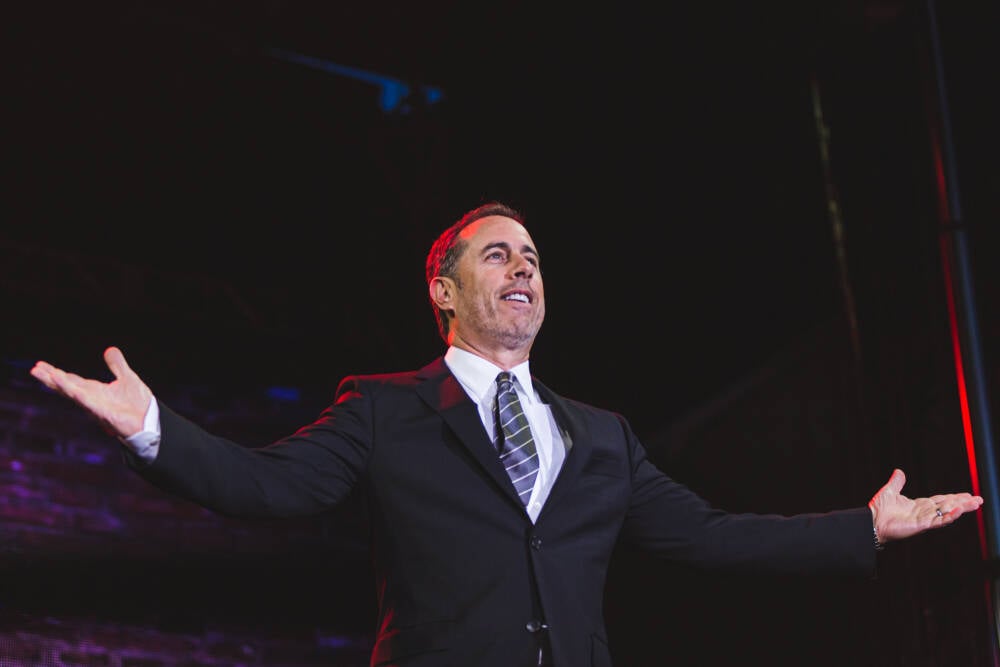

Video La parodia de Seinfeld Nothing, Forever, una comedia de situación desarrollada con inteligencia artificial generativa, ha sido prohibida temporalmente en Twitch después de que uno de los personajes arrojara accidentalmente blasfemias transfóbicas.

el extraño espectáculo fue noticia la semana pasada por usar IA para improvisar imágenes y guiones de un episodio interminable de Seinfeld. En comedia imitando arte, sitcom 30 Rock previsto algo así hace más de 15 años.

Los personajes, inspirados en los personajes de la icónica serie de comedia Jerry, George, Elaine y Kramer, pronuncian un diálogo completamente inventado utilizando los modelos de lenguaje GPT-3 de OpenAI. El texto se traduce a audio utilizando algoritmos de texto a voz y los fondos y las escenas también se generan con IA. Nothing, Forever se transmite en Twitch las 24 horas del día, los 7 días de la semana y ha atraído a muchos seguidores desde que comenzó a transmitirse el año pasado en diciembre.

Pero el canal presentar el programa fue cancelado el lunes por violando Políticas de contenido de Twitch. Skyler Hartle, cofundadora de Mismatch Media y una de las creadoras de Nothing, Forever, dijo El registro la prohibición se emitió debido a que el personaje principal, Larry Feinberg, hizo comentarios ofensivos diciendo que las personas transgénero están "arruinando el tejido de la sociedad", que ser transgénero es una enfermedad mental y que "todos los liberales son secretamente homosexuales".

Puedes ver la mala escena de stand-up a continuación.

Hartle dijo que el guión del programa se desvió cuando sus creadores cambiaron de usar el modelo Davinci modelo GPT-3 de OpenAI a una versión menos poderosa y más barata llamada Curie, y no implementaron funciones de software para moderar su contenido.

“Tuvimos un problema con nuestra conexión con Davinci anoche y tuvimos que cambiar al modelo Curie mientras el problema se resolvía solo. Fue entonces cuando se generó el texto inapropiado y lo cerramos de inmediato. Investigamos más a fondo el problema y descubrimos que no estábamos aprovechando correctamente las herramientas de moderación de contenido de OpenAI”, nos dijo.

Hartle confirmó que la prohibición es temporal y debería durar 14 días. Mismatch Media ahora está trabajando para implementar las herramientas de moderación de contenido de OpenAI y también está considerando un sistema secundario para rastrear los resultados del modelo.

“El texto que generamos fue un error, nos da mucha vergüenza, y que el contenido generativo creado de ninguna manera refleje los valores u opiniones de nuestro personal. Lamentamos mucho que esto haya sucedido y esperamos estar de vuelta en el aire pronto, con todas las salvaguardas apropiadas”, dijo.

Los modelos de lenguaje extenso como GPT-3 se entrenan a partir de texto extraído de Internet y pueden generar lenguaje inapropiado y ofensivo. Los filtros de contenido pueden minimizar el peor texto, pero los fragmentos seguirán filtrándose incluso con medidas de seguridad.

Un portavoz de Twitch envió El registro las pautas comunitarias de la compañía que tratan con la conducta de odio, y dijo:

"No comentamos sobre violaciones específicas por razones de privacidad, pero tomamos las medidas adecuadas cuando tenemos evidencia de que un canal ha violado nuestras Pautas de la comunidad o los Términos de servicio". ®

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://go.theregister.com/feed/www.theregister.com/2023/02/07/twitch_ai_seinfeld/

- 15 años

- a

- la columna Acción

- Después

- AI

- AIRE

- algoritmos

- Todos

- y

- adecuado

- Arte

- atraído

- audio

- Atrás

- antecedentes

- Malo

- Prohibición

- prohibido

- Prohíbe

- detrás de

- "Ser"

- a continuación

- Channel

- personaje

- personajes

- más barato

- Co-founder

- Comedia

- comentario

- comentarios

- vibrante e inclusiva

- compañía

- completamente

- Conducir

- Confirmado

- conexión

- en vista de

- contenido

- moderación de contenido

- creado

- creadores

- Días

- tratar

- Diciembre

- desplegar

- desarrollado

- Diálogo

- HIZO

- descubierto CRISPR

- DE INSCRIPCIÓN

- Éter (ETH)

- Incluso

- evidencia sólida

- experimentado

- material

- Caracteristicas

- Feinberg

- filtros

- hacia

- en

- promover

- generar

- generado

- generativo

- IA generativa

- George

- orientaciones

- pasó

- esperanza

- hosting

- HTTPS

- icónico

- enfermedad

- inmediatamente

- implementar

- in

- Internet

- Emitido

- IT

- sí mismo

- Label

- idioma

- Apellido

- El año pasado

- aprovechando

- hecho

- Inicio

- Realizar

- muchos

- Medios

- mental

- Enfermedad mental

- Error

- modelo

- modelos

- moderación

- Lunes

- Llamado

- noche

- ofensiva

- ONE

- OpenAI

- Opiniones

- Personas

- Colocar

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- políticas

- poderoso

- política de privacidad

- razones

- refleja

- lamentar

- resuelto

- Rock

- Said

- escena

- Escenas

- secundario

- Serie

- de coches

- tienes

- Mostrar

- desde

- furtivamente

- Sociedades

- Software

- algo

- Pronto

- soluciones y

- portavoz

- Staff

- fundó

- Sin embargo

- streaming

- súper

- Switch

- conmutada

- te

- ¡Prepárate!

- temporal

- términos

- Términos de servicio

- Texto a voz

- El

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a

- demasiado

- seguir

- entrenado

- transgénero

- Twitch

- us

- Valores

- versión

- INCUMPLIMIENTO

- Violaciónes

- Ver ahora

- semana

- mientras

- Wikipedia

- seguirá

- trabajando

- Peor

- año

- años

- zephyrnet