Esta publicación fue coescrita con Greg Benson, científico jefe; Aaron Kesler, director sénior de productos; y Rich Dill, arquitecto de soluciones empresariales de SnapLogic.

Muchos clientes están creando aplicaciones de IA generativa en lecho rocoso del amazonas y Código de Amazon Whisperer para crear artefactos de código basados en lenguaje natural. Este caso de uso destaca cómo los modelos de lenguajes grandes (LLM) pueden convertirse en traductores entre lenguajes humanos (inglés, español, árabe y más) y lenguajes interpretables por máquinas (Python, Java, Scala, SQL, etc.), junto con sofisticados razonamiento interno. Esta capacidad emergente en los LLM ha obligado a los desarrolladores de software a utilizar los LLM como una herramienta de automatización y mejora de UX que transforma el lenguaje natural en un lenguaje de dominio específico (DSL): instrucciones del sistema, solicitudes de API, artefactos de código y más. En este post te mostramos cómo SnapLogic, un cliente de AWS, utilizó Amazon Bedrock para impulsar su complementoGPT producto mediante la creación automatizada de estos complejos artefactos DSL a partir del lenguaje humano.

Cuando los clientes crean objetos DSL a partir de LLM, el DSL resultante es una réplica exacta o un derivado de un esquema y datos de interfaz existente que forma el contrato entre la interfaz de usuario y la lógica empresarial en el servicio de respaldo. Este patrón es particularmente tendencia entre los proveedores de software independientes (ISV) y los ISV de software como servicio (SaaS) debido a su forma única de representar configuraciones a través de código y el deseo de simplificar la experiencia del usuario para sus clientes. Los casos de uso de ejemplo incluyen:

La forma más sencilla de crear y escalar aplicaciones de texto a canalización con LLM en AWS es utilizar Amazon Bedrock. Amazon Bedrock es la forma más sencilla de crear y escalar aplicaciones de IA generativa con modelos básicos (FM). Es un servicio totalmente administrado que ofrece acceso a una selección de FM básicos de alto rendimiento de la IA líder a través de una única API, junto con un amplio conjunto de capacidades que necesita para crear aplicaciones de IA generativa con privacidad y seguridad. Anthropic, un laboratorio de investigación y seguridad de IA que construye sistemas de IA confiables, interpretables y orientables, es una de las empresas líderes en IA que ofrece acceso a su LLM de última generación, Claude, en Amazon Bedrock. Claude es un LLM que se destaca en una amplia gama de tareas, desde diálogo reflexivo, creación de contenido, razonamiento complejo, creatividad y codificación. Anthropic ofrece los modelos Claude y Claude Instant, todos los cuales están disponibles a través de Amazon Bedrock. Claude ha ganado rápidamente popularidad en estas aplicaciones de texto a canalización debido a su capacidad de razonamiento mejorada, que le permite sobresalir en la resolución de problemas técnicos ambiguos. Claude 2 en Amazon Bedrock admite una ventana de contexto de 100,000 tokens, lo que equivale a unas 200 páginas de texto en inglés. Esta es una característica particularmente importante en la que puede confiar al crear aplicaciones de texto a canalización que requieren razonamiento complejo, instrucciones detalladas y ejemplos completos.

Fondo de SnapLogic

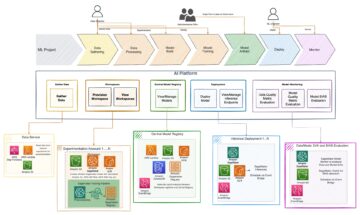

SnapLogic es un cliente de AWS con la misión de llevar la automatización empresarial al mundo. La plataforma de integración inteligente (IIP) SnapLogic permite a las organizaciones realizar una automatización en toda la empresa conectando todo su ecosistema de aplicaciones, bases de datos, big data, máquinas y dispositivos, API y más con conectores inteligentes prediseñados llamados Snaps. SnapLogic lanzó recientemente una función llamada complementoGPT, que proporciona una interfaz de texto donde puede escribir el canal de integración que desea crear en un lenguaje humano simple. SnapGPT utiliza el modelo Claude de Anthropic a través de Amazon Bedrock para automatizar la creación de estos canales de integración como código, que luego se utilizan a través de la solución de integración insignia de SnapLogic. Sin embargo, el viaje de SnapLogic hacia SnapGPT ha sido la culminación de muchos años operando en el espacio de la IA.

El viaje de la IA de SnapLogic

En el ámbito de las plataformas de integración, SnapLogic ha estado constantemente a la vanguardia, aprovechando el poder transformador de la inteligencia artificial. A lo largo de los años, el compromiso de la empresa por innovar con la IA se ha hecho evidente, especialmente cuando rastreamos el viaje desde Iris a Autoenlazar.

Los humildes comienzos con Iris

En 2017, SnapLogic presentó Iris, el primer asistente de integración impulsado por IA en la industria. Iris fue diseñada para utilizar algoritmos de aprendizaje automático (ML) para predecir los próximos pasos en la construcción de una canalización de datos. Al analizar millones de elementos de metadatos y flujos de datos, Iris podría hacer sugerencias inteligentes a los usuarios, democratizando la integración de datos y permitiendo que incluso aquellos sin una formación técnica profunda creen flujos de trabajo complejos.

AutoLink: ganando impulso

Aprovechando el éxito y los aprendizajes de Iris, SnapLogic presentó AutoLink, una función destinada a simplificar aún más el proceso de mapeo de datos. La tediosa tarea de mapear manualmente campos entre los sistemas de origen y de destino se volvió muy sencilla con AutoLink. Utilizando IA, AutoLink identificó y sugirió automáticamente posibles coincidencias. Integraciones que antes llevaban horas se pueden ejecutar en cuestión de minutos.

El salto generativo con SnapGPT

La última incursión de SnapLogic en IA nos trae SnapGPT, cuyo objetivo es revolucionar aún más la integración. Con SnapGPT, SnapLogic presenta la primera solución de integración generativa del mundo. No se trata sólo de simplificar los procesos existentes, sino de reinventar por completo cómo se diseñan las integraciones. El poder de la IA generativa puede crear procesos de integración completos desde cero, optimizando el flujo de trabajo en función del resultado deseado y las características de los datos.

SnapGPT tiene un gran impacto para los clientes de SnapLogic porque pueden reducir drásticamente la cantidad de tiempo necesario para generar su primer canal de SnapLogic. Tradicionalmente, los clientes de SnapLogic necesitaban pasar días o semanas configurando canales de integración desde cero. Ahora, estos clientes pueden simplemente pedirle a SnapGPT que, por ejemplo, "cree un canal que trasladará a todos mis clientes SFDC activos a WorkDay". Se crea automáticamente un primer borrador funcional de una canalización para este cliente, lo que reduce drásticamente el tiempo de desarrollo necesario para la creación de la base de su canalización de integración. Esto permite que el cliente final dedique más tiempo a concentrarse en lo que tiene un verdadero impacto comercial para él en lugar de trabajar en configuraciones de un canal de integración. El siguiente ejemplo muestra cómo un cliente de SnapLogic puede ingresar una descripción en la función SnapGPT para generar rápidamente una canalización, utilizando lenguaje natural.

AWS y SnapLogic han colaborado estrechamente durante la creación de este producto y han aprendido mucho a lo largo del camino. El resto de esta publicación se centrará en los aprendizajes técnicos que AWS y SnapLogic han obtenido sobre el uso de LLM para aplicaciones de texto a canalización.

Resumen de la solución

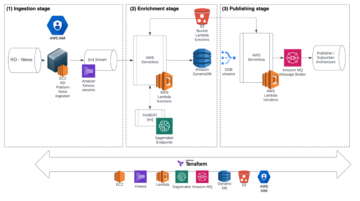

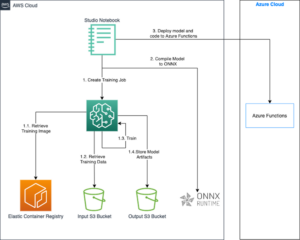

Para resolver este problema de texto a canalización, AWS y SnapLogic diseñaron una solución integral que se muestra en la siguiente arquitectura.

Una solicitud a SnapGPT pasa por el siguiente flujo de trabajo:

- Un usuario envía una descripción a la aplicación.

- SnapLogic utiliza un enfoque de recuperación de generación aumentada (RAG) para recuperar ejemplos relevantes de canalizaciones de SnapLogic que son similares a la solicitud del usuario.

- Estos ejemplos relevantes extraídos se combinan con la entrada del usuario y pasan por un preprocesamiento de texto antes de enviarlos a Claude en Amazon Bedrock.

- Claude produce un artefacto JSON que representa una canalización SnapLogic.

- El artefacto JSON está directamente integrado en la plataforma de integración principal de SnapLogic.

- La canalización de SnapLogic se presenta al usuario de una manera visualmente amigable.

A través de diversos experimentos entre AWS y SnapLogic, hemos descubierto que el rápido paso de ingeniería del diagrama de solución es extremadamente importante para generar resultados de alta calidad para estos resultados de texto a canalización. La siguiente sección profundiza en algunas técnicas específicas utilizadas con Claude en este espacio.

Experimentación inmediata

A lo largo de la fase de desarrollo de SnapGPT, AWS y SnapLogic descubrieron que la iteración rápida de las indicaciones enviadas a Claude era una tarea de desarrollo fundamental para mejorar la precisión y relevancia de las salidas de texto a canalización en las salidas de SnapLogic. Mediante el uso Estudio Amazon SageMaker cuadernos interactivos, el equipo de AWS y SnapLogic pudieron trabajar rápidamente en diferentes versiones de indicaciones mediante el uso de Conexión del SDK de Boto3 a Amazon Bedrock. El desarrollo basado en portátiles permitió a los equipos crear rápidamente conexiones del lado del cliente con Amazon Bedrock, incluir descripciones basadas en texto junto con código Python para enviar mensajes a Amazon Bedrock y realizar sesiones conjuntas de ingeniería de mensajes en las que se realizaron iteraciones rápidamente entre varias personas.

Métodos de ingeniería rápida de Claude antrópico

En esta sección, describimos algunas de las técnicas iterativas que utilizamos para crear un mensaje de alto rendimiento basado en una solicitud de usuario ilustrativa: "Cree una canalización que utilice la base de datos de EjemploCompany que recupere todos los clientes activos". Tenga en cuenta que este ejemplo no es el esquema que utiliza SnapGPT y solo se utiliza para ilustrar una aplicación de texto a canalización.

Para basar nuestra ingeniería de avisos, utilizamos el siguiente aviso original:

Cree una canalización que utilice la base de datos de EjemploCompany que recupere todos los clientes activos.

El resultado esperado es el siguiente:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Mejora n.º 1: uso de las anotaciones humana y asistente

El procedimiento de capacitación de Claude le enseña al FM a comprender el diálogo entre un humano y un asistente en su estructura de indicaciones. Los usuarios de Claude pueden aprovechar esta estructura al finalizar su mensaje en el Asistente:, lo que hará que Claude comience a generar la respuesta a una consulta basada en lo que dijo el humano. Tenga en cuenta que, dado que Claude seguirá generando texto hasta que se le indique que se detenga, asegúrese de utilizar una secuencia de detención de nnHuman: en la solicitud de API a Amazon Bedrock cuando utilice Claude. Esto asegurará que solo reciba la respuesta del asistente y no la siguiente respuesta prevista del humano en la cadena de diálogo. Estos indicadores nnHumano y nnAsistente no solo ayudan a limitar la respuesta de Claude a información relevante, sino que también ayudan a proporcionar una demarcación clara entre las entradas humanas primarias y las respuestas del asistente de otras interacciones. Esto ayuda especialmente en una configuración de mensajes de pocas tomas donde puede tener múltiples consultas y respuestas con consultas etiquetadas con nnHuman y respuestas anteriores etiquetadas con nnAssistant. Veamos el mensaje mejorado y la llamada API ilustrativa asociada a Amazon Bedrock a través del SDK de Boto3.

Utilizamos el siguiente mensaje:

Humano: cree una canalización que utilice la base de datos de EjemploCompany que recupere todos los clientes activos.

Asistente:

El resultado es el siguiente:

Aquí hay una canalización de MongoDB para recuperar todos los clientes activos de la base de datos de EjemploCompany:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)Los pasos clave son:

– `$match` para filtrar los documentos solo a aquellos en la base de datos de EjemploCompany y con estado igual a “activo”.

– `db.customers.aggregate()` ejecuta la canalización en la colección de clientes y devuelve los resultados filtrados.

Entonces esto devolverá todos los documentos del cliente de la base de datos de EjemploCompany donde el campo de estado está configurado como "activo".

Observe cómo en el resultado, Claude inventa una respuesta a nuestra pregunta sin ningún contexto. La respuesta es potencialmente útil, pero no es específica del problema que intentamos resolver porque no cuenta con suficiente contexto. También es importante tener en cuenta que Anthropic requiere este formato humano y de asistente cuando utiliza los modelos de Claude; Si no incluye este paso, Amazon Bedrock devolverá un error.

° 2: incluya un contexto hiperespecífico para Claude antes de que le digan qué hacer

Claude se desempeña mejor cuando se le brinda un buen contexto sobre lo que necesita lograr y cómo se supone que debe realizar esa tarea. Aquí hay algunos ejemplos de cosas que puedes incluir como contexto para Claude antes de decirle la tarea:

- Describe la función laboral que deseas que cumpla Claude. Al hacer esto, estás haciendo que Claude piense en el papel de alguien que trabaja en ese trabajo, o más bien en el de alguien que acaba de ser contratado para ese puesto de trabajo específico. Esto ayudará a Claude a formular la respuesta desde la perspectiva de ese puesto de trabajo específico, reduciendo las alucinaciones y la aleatoriedad en la respuesta.

- Incluya detalles técnicos sobre el formato de salida. Los modelos básicos generalmente son buenos para seguir acciones, por lo que pedirle a Claude que genere el resultado en un formato o esquema específico con uno o algunos ejemplos ayudará a Claude a proporcionar la respuesta en el formato correcto, lo que reducirá la necesidad de filtrar y posprocesar el resultado. El ejemplo del siguiente mensaje muestra un esquema ficticio que coincide con el resultado esperado.

Combinemos estas sugerencias para mejorar nuestro mensaje original:

Humano: su trabajo es actuar como un experto en canalizaciones ETL. Específicamente, su trabajo es crear una representación JSON de una canalización ETL que resolverá la solicitud del usuario que se le proporcionó.

La salida JSON debe seguir el siguiente formato:

Esta es su tarea: crear una canalización que utilice la base de datos de EjemploCompany que recupere todos los clientes activos.

Asistente:

El resultado es el siguiente:

Aquí hay una representación JSON de una canalización ETL para recuperar todos los clientes activos de la base de datos de EjemploCompany:

Esta canalización utiliza la base de datos de EjemploCompany y una consulta SQL para seleccionar todos los registros de la tabla de clientes cuyo estado es "activo".

Con la adición de contexto, el modelo ahora puede recorrer la mayor parte del camino hasta nuestra respuesta. Ahora sabe cómo estructurar la salida y comprende que necesita escribir una declaración SQL para resolver la tarea. Sin embargo, notará que el modelo no utiliza correctamente la nomenclatura ec_prod.customers que esperamos. ¡Margen de mejora! También tenga en cuenta que, en la práctica, deberá incluir mucho más contexto que el que proporcionamos en este ejemplo para obtener resultados de alta calidad en casos de uso de texto a canalización.

Mejora n.º 3: incluir ejemplos en etiquetas XML

El aprendizaje de pocas tomas es una forma popular de aumentar la precisión con los FM donde tiene ejemplos relevantes para guiar al FM en su tarea. Esto es particularmente importante cuando se trabaja en aplicaciones de texto a canalización porque estas salidas de canalización hiperespecíficas generalmente no se incluyen en ningún conjunto de datos público porque son específicas de la representación de datos de un cliente individual. Al utilizar Claude, puede aprovechar su conocimiento innato de etiquetas XML arbitrarias para proporcionar estos ejemplos en un formato de pocas tomas. En el siguiente mensaje mejorado, observe la adición de ejemplos incluidos en Etiquetas XML. Además, puedes usar abreviaturas de humano y asistente con H y A para brindarle contexto a Claude sin que parezca que se trata de partes específicas del diálogo que ya ocurrieron.

Utilizamos el siguiente mensaje:

Humano: su trabajo es actuar como un experto en canalizaciones ETL. Específicamente, su trabajo es crear una representación JSON de una canalización ETL que resolverá la solicitud del usuario que se le proporcionó.

La salida JSON debe seguir el siguiente formato:

A continuación se muestran algunos ejemplos de solicitudes de usuarios y artefactos JSON de salida asociados que resuelven correctamente la tarea proporcionada. Asegúrese de utilizar la misma nomenclatura que se proporciona en los ejemplos si utiliza las mismas bases de datos.

H: consulte la base de datos de EjemploCompany para ver si hay pedidos activos para el cliente n.° 1234

A:

El motivo de esta consulta es que el cliente n.º 1234 está filtrado y estamos buscando en la tabla "pedidos" cualquier registro existente después del filtro "activo".

H: eliminar todos los clientes de la base de datos de EjemploCompany que no hayan estado activos en el último mes

A:

El razonamiento de esta consulta es que la tabla “ec_prod.customers” es la única tabla en la base de datos de EjemploCompany que contiene registros de clientes.

Esta es su tarea: crear una canalización que utilice la base de datos de EjemploCompany que recupere todos los clientes activos.

Asistente:

El resultado es el siguiente:

Aquí está la representación JSON de una canalización ETL para recuperar todos los clientes activos de la base de datos de EjemploCompany:

El razonamiento es:

La base de datos de EjemploCompany se especifica como la base de datos a utilizar

La tabla ec_prod.customers contiene los datos del cliente.

El campo de estado indica si un cliente está activo, por lo que la consulta filtra solo para clientes activos.

Esto debería recuperar todos los registros de clientes activos de la base de datos de EjemploCompany. ¡Avíseme si necesita alguna aclaración o tiene requisitos adicionales para el proceso ETL!

La salida JSON ahora tiene la nomenclatura de base de datos correcta, que Claude pudo usar gracias a los ejemplos que proporcionamos. Combinar indicadores humanos y de asistente con etiquetas XML hace que a Claude le resulte más fácil comprender cuál es la tarea y cuál fue la respuesta en ejemplos similares con una separación muy clara entre varios ejemplos de pocas tomas. Cuanto más fácil sea de entender para Claude, mejor y más relevante será la respuesta, lo que reducirá aún más la posibilidad de que el modelo alucine y proporcione respuestas aleatorias irrelevantes.

Mejora n.º 4: Activar a Claude para que comience la generación JSON con etiquetas XML

Un pequeño desafío con las aplicaciones de texto a canalización que utilizan FM es la necesidad de analizar exactamente una salida del texto resultante para que pueda interpretarse como código en una aplicación posterior. Una forma de resolver esto con Claude es aprovechar su comprensión de etiquetas XML y combinarlo con una secuencia de parada personalizada. En el siguiente mensaje, le hemos indicado a Claude que incluya la salida en Etiquetas XML. Luego, hemos agregado el etiqueta hasta el final del mensaje. Esto garantiza que el primer texto que salga de Claude será el comienzo de la salida JSON. Si no hace esto, Claude a menudo responde con algún texto conversacional y luego la respuesta en código verdadero. Al indicarle a Claude que comience a generar la salida inmediatamente, puede detener fácilmente la generación cuando vea el cierre. etiqueta. Esto se muestra en la llamada API Boto3 actualizada. Los beneficios de esta técnica son dobles. Primero, puede analizar exactamente la respuesta del código de Claude. En segundo lugar, puede reducir los costos porque Claude solo genera salidas de código y no texto adicional. Esto reduce el costo en Amazon Bedrock porque se le cobra por cada token que se produce como resultado de todos los FM.

Utilizamos el siguiente mensaje:

Humano: su trabajo es actuar como un experto en canalizaciones ETL. Específicamente, su trabajo es crear una representación JSON de una canalización ETL que resolverá la solicitud del usuario que se le proporcionó.

La salida JSON debe seguir el siguiente formato:

A continuación se muestran algunos ejemplos de solicitudes de usuarios y artefactos JSON de salida asociados que resuelven correctamente la tarea proporcionada. Asegúrese de utilizar la misma nomenclatura que se proporciona en los ejemplos si utiliza las mismas bases de datos.

H: consulte la base de datos de EjemploCompany para ver si hay pedidos activos para el cliente n.° 1234

A:

El motivo de esta consulta es que el cliente n.º 1234 está filtrado y estamos buscando en la tabla "pedidos" cualquier registro existente después del filtro "activo".

H: eliminar todos los clientes de la base de datos de EjemploCompany que no hayan estado activos en el último mes

A:

El razonamiento de esta consulta es que la tabla “ec_prod.customers” es la única tabla en la base de datos de EjemploCompany que contiene registros de clientes.

Recuerde siempre incluir sus salidas JSON en etiquetas.

Esta es su tarea: crear una canalización que utilice la base de datos de EjemploCompany que recupere todos los clientes activos.

Asistente:

Usamos el siguiente código:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model(

body=body,

modelId='anthropic.claude-v2'

)El resultado es el siguiente:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

¡Ahora hemos llegado al resultado esperado con solo el objeto JSON devuelto! Al utilizar este método, podemos generar un artefacto técnico utilizable de inmediato y reducir el costo de generación al reducir los tokens de salida.

Conclusión

Para comenzar hoy con SnapGPT, solicite una prueba gratuita de SnapLogic or solicitar una demostración del producto. Si desea utilizar estos conceptos para crear aplicaciones hoy en día, le recomendamos experimentando de forma práctica con la sección de ingeniería rápida de esta publicación, utilizando el mismo flujo en un caso de uso de generación de DSL diferente que se adapte a su negocio y profundizando en el Funciones de RAG que están disponibles a través de Amazon Bedrock.

SnapLogic y AWS han podido asociarse de manera efectiva para crear un traductor avanzado entre el lenguaje humano y el complejo esquema de los canales de integración de SnapLogic impulsados por Amazon Bedrock. A lo largo de este viaje, hemos visto cómo la salida generada con Claude se puede mejorar en aplicaciones de texto a canalización utilizando técnicas de ingeniería rápida específicas. AWS y SnapLogic están entusiasmados de continuar esta asociación en IA generativa y esperan futuras colaboraciones e innovación en este espacio en rápida evolución.

Acerca de los autores

greg benson es profesor de Ciencias de la Computación en la Universidad de San Francisco y científico jefe de SnapLogic. Se incorporó al Departamento de Ciencias de la Computación de la USF en 1998 y ha impartido cursos de pregrado y posgrado que incluyen sistemas operativos, arquitectura de computadoras, lenguajes de programación, sistemas distribuidos e introducción a la programación. Greg ha publicado investigaciones en las áreas de sistemas operativos, computación paralela y sistemas distribuidos. Desde que se unió a SnapLogic en 2010, Greg ha ayudado a diseñar e implementar varias características clave de la plataforma, incluido el procesamiento de clústeres, el procesamiento de big data, la arquitectura de la nube y el aprendizaje automático. Actualmente trabaja en IA generativa para la integración de datos.

greg benson es profesor de Ciencias de la Computación en la Universidad de San Francisco y científico jefe de SnapLogic. Se incorporó al Departamento de Ciencias de la Computación de la USF en 1998 y ha impartido cursos de pregrado y posgrado que incluyen sistemas operativos, arquitectura de computadoras, lenguajes de programación, sistemas distribuidos e introducción a la programación. Greg ha publicado investigaciones en las áreas de sistemas operativos, computación paralela y sistemas distribuidos. Desde que se unió a SnapLogic en 2010, Greg ha ayudado a diseñar e implementar varias características clave de la plataforma, incluido el procesamiento de clústeres, el procesamiento de big data, la arquitectura de la nube y el aprendizaje automático. Actualmente trabaja en IA generativa para la integración de datos.

Aaron Kesler Como gerente senior de productos y servicios de IA en SnapLogic, Aaron aplica más de diez años de experiencia en gestión de productos para ser pionero en el desarrollo de productos de IA/ML y evangelizar los servicios en toda la organización. Es autor del próximo libro "¿Cuál es tu problema?" destinado a guiar a los nuevos gerentes de productos a lo largo de la carrera de gestión de productos. Su viaje empresarial comenzó con su startup universitaria, STAK, que luego fue adquirida por Carvertise y Aaron contribuyó significativamente a su reconocimiento como Startup tecnológica del año 2015 en Delaware. Más allá de sus actividades profesionales, Aaron disfruta jugando golf con su padre, explorando nuevas culturas y comidas en sus viajes y practicando el ukelele.

Aaron Kesler Como gerente senior de productos y servicios de IA en SnapLogic, Aaron aplica más de diez años de experiencia en gestión de productos para ser pionero en el desarrollo de productos de IA/ML y evangelizar los servicios en toda la organización. Es autor del próximo libro "¿Cuál es tu problema?" destinado a guiar a los nuevos gerentes de productos a lo largo de la carrera de gestión de productos. Su viaje empresarial comenzó con su startup universitaria, STAK, que luego fue adquirida por Carvertise y Aaron contribuyó significativamente a su reconocimiento como Startup tecnológica del año 2015 en Delaware. Más allá de sus actividades profesionales, Aaron disfruta jugando golf con su padre, explorando nuevas culturas y comidas en sus viajes y practicando el ukelele.

Eneldo Rico es un arquitecto principal de soluciones con amplia experiencia en múltiples áreas de especialización. Un historial de éxito que abarca software empresarial multiplataforma y SaaS. Bien conocido por convertir la defensa del cliente (que actúa como la voz del cliente) en nuevas funciones y productos que generan ingresos. Capacidad comprobada para impulsar productos de vanguardia al mercado y proyectos hasta su finalización a tiempo y por debajo del presupuesto en entornos terrestres y marinos de ritmo rápido. Una manera sencilla de describirme: la mente de un científico, el corazón de un explorador y el alma de un artista.

Eneldo Rico es un arquitecto principal de soluciones con amplia experiencia en múltiples áreas de especialización. Un historial de éxito que abarca software empresarial multiplataforma y SaaS. Bien conocido por convertir la defensa del cliente (que actúa como la voz del cliente) en nuevas funciones y productos que generan ingresos. Capacidad comprobada para impulsar productos de vanguardia al mercado y proyectos hasta su finalización a tiempo y por debajo del presupuesto en entornos terrestres y marinos de ritmo rápido. Una manera sencilla de describirme: la mente de un científico, el corazón de un explorador y el alma de un artista.

arcilla elmore es un arquitecto de soluciones especializado en IA/ML en AWS. Después de pasar muchas horas en un laboratorio de investigación de materiales, rápidamente dejó atrás su experiencia en ingeniería química para dedicarse a su interés en el aprendizaje automático. Ha trabajado en aplicaciones de aprendizaje automático en muchas industrias diferentes, desde el comercio de energía hasta el marketing hotelero. El trabajo actual de Clay en AWS se centra en ayudar a los clientes a llevar prácticas de desarrollo de software a cargas de trabajo de IA generativa y aprendizaje automático, lo que les permite crear soluciones repetibles y escalables en estos entornos complejos. En su tiempo libre, Clay disfruta esquiar, resolver los cubos de Rubik, leer y cocinar.

arcilla elmore es un arquitecto de soluciones especializado en IA/ML en AWS. Después de pasar muchas horas en un laboratorio de investigación de materiales, rápidamente dejó atrás su experiencia en ingeniería química para dedicarse a su interés en el aprendizaje automático. Ha trabajado en aplicaciones de aprendizaje automático en muchas industrias diferentes, desde el comercio de energía hasta el marketing hotelero. El trabajo actual de Clay en AWS se centra en ayudar a los clientes a llevar prácticas de desarrollo de software a cargas de trabajo de IA generativa y aprendizaje automático, lo que les permite crear soluciones repetibles y escalables en estos entornos complejos. En su tiempo libre, Clay disfruta esquiar, resolver los cubos de Rubik, leer y cocinar.

Sina Sojoodi es un ejecutivo de tecnología, ingeniero de sistemas, líder de producto, exfundador y asesor de startups. Se unió a AWS en marzo de 2021 como arquitecto principal de soluciones. Sina es actualmente el arquitecto de soluciones líder del área ISV de EE. UU. Oeste. Trabaja con empresas de software SaaS y B2B para construir y hacer crecer sus negocios en AWS. Antes de su puesto en Amazon, Sina fue ejecutivo de tecnología en VMware y Pivotal Software (IPO en 2018, VMware M&A en 2020) y desempeñó múltiples funciones de liderazgo, incluido el de ingeniero fundador en Xtreme Labs (adquisición de Pivotal en 2013). Sina ha dedicado los últimos 15 años de su experiencia laboral a crear plataformas y prácticas de software para empresas, negocios de software y el sector público. Es un líder de la industria con pasión por la innovación. Sina tiene una licenciatura de la Universidad de Waterloo, donde estudió Ingeniería Eléctrica y Psicología.

Sina Sojoodi es un ejecutivo de tecnología, ingeniero de sistemas, líder de producto, exfundador y asesor de startups. Se unió a AWS en marzo de 2021 como arquitecto principal de soluciones. Sina es actualmente el arquitecto de soluciones líder del área ISV de EE. UU. Oeste. Trabaja con empresas de software SaaS y B2B para construir y hacer crecer sus negocios en AWS. Antes de su puesto en Amazon, Sina fue ejecutivo de tecnología en VMware y Pivotal Software (IPO en 2018, VMware M&A en 2020) y desempeñó múltiples funciones de liderazgo, incluido el de ingeniero fundador en Xtreme Labs (adquisición de Pivotal en 2013). Sina ha dedicado los últimos 15 años de su experiencia laboral a crear plataformas y prácticas de software para empresas, negocios de software y el sector público. Es un líder de la industria con pasión por la innovación. Sina tiene una licenciatura de la Universidad de Waterloo, donde estudió Ingeniería Eléctrica y Psicología.

Sandeep Rohilla es arquitecto senior de soluciones en AWS y brinda soporte a clientes ISV en la región oeste de EE. UU. Se centra en ayudar a los clientes a diseñar soluciones que aprovechen los contenedores y la IA generativa en la nube de AWS. A Sandeep le apasiona comprender los problemas comerciales de los clientes y ayudarlos a alcanzar sus objetivos a través de la tecnología. Se unió a AWS después de trabajar más de una década como arquitecto de soluciones, aportando sus 17 años de experiencia. Sandeep tiene una maestría. en Ingeniería de Software de la Universidad del Oeste de Inglaterra en Bristol, Reino Unido.

Sandeep Rohilla es arquitecto senior de soluciones en AWS y brinda soporte a clientes ISV en la región oeste de EE. UU. Se centra en ayudar a los clientes a diseñar soluciones que aprovechen los contenedores y la IA generativa en la nube de AWS. A Sandeep le apasiona comprender los problemas comerciales de los clientes y ayudarlos a alcanzar sus objetivos a través de la tecnología. Se unió a AWS después de trabajar más de una década como arquitecto de soluciones, aportando sus 17 años de experiencia. Sandeep tiene una maestría. en Ingeniería de Software de la Universidad del Oeste de Inglaterra en Bristol, Reino Unido.

Dr. Farooq Sabir es arquitecto sénior de soluciones especialista en inteligencia artificial y aprendizaje automático en AWS. Tiene un doctorado y una maestría en ingeniería eléctrica de la Universidad de Texas en Austin y una maestría en informática del Instituto de Tecnología de Georgia. Tiene más de 15 años de experiencia laboral y también le gusta enseñar y asesorar a estudiantes universitarios. En AWS, ayuda a los clientes a formular y resolver sus problemas comerciales en ciencia de datos, aprendizaje automático, visión artificial, inteligencia artificial, optimización numérica y dominios relacionados. Con sede en Dallas, Texas, a él y a su familia les encanta viajar y hacer viajes largos por carretera.

Dr. Farooq Sabir es arquitecto sénior de soluciones especialista en inteligencia artificial y aprendizaje automático en AWS. Tiene un doctorado y una maestría en ingeniería eléctrica de la Universidad de Texas en Austin y una maestría en informática del Instituto de Tecnología de Georgia. Tiene más de 15 años de experiencia laboral y también le gusta enseñar y asesorar a estudiantes universitarios. En AWS, ayuda a los clientes a formular y resolver sus problemas comerciales en ciencia de datos, aprendizaje automático, visión artificial, inteligencia artificial, optimización numérica y dominios relacionados. Con sede en Dallas, Texas, a él y a su familia les encanta viajar y hacer viajes largos por carretera.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- :posee

- :es

- :no

- :dónde

- $ UP

- 10

- 100

- 121

- 14

- 15 años

- 15%

- 150

- 17

- 1998

- 200

- 2010

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- capacidad

- Poder

- Nuestra Empresa

- de la máquina

- lograr

- la exactitud

- Lograr

- adquirido

- adquisición

- a través de

- Actúe

- la columna Acción

- acciones

- lector activo

- adicional

- adición

- Adicionales

- avanzado

- Ventaja

- tutor

- defensa

- Después

- AI

- Sistemas de IA

- Alimentado por IA

- AI / ML

- Dirigido

- paquete de capacitación DWoVH

- algoritmos

- Todos

- permitido

- Permitir

- permite

- a lo largo de

- junto al

- ya haya utilizado

- también

- Amazon

- Amazon Web Services

- cantidad

- an

- el análisis de

- y

- https://www.youtube.com/watch?v=xB-eutXNUMXJtA&feature=youtu.be

- respuestas

- Antrópico

- cualquier

- abejas

- API

- Aplicación

- aplicaciones

- se aplica

- enfoque

- aplicaciones

- Arábica

- arquitectura

- somos

- Reservada

- áreas

- en torno a

- llegado

- Arte

- artificial

- inteligencia artificial

- Inteligencia Artificial y Aprendizaje Automático

- artista

- AS

- contacta

- pidiendo

- Legal

- asociado

- At

- aumentado

- Austin

- autor

- automatizado

- Confirmación de Viaje

- automáticamente

- Automatización

- Hoy Disponibles

- AWS

- Cliente de AWS

- B2B

- fondo

- apoyo

- bases

- basado

- Base

- BE

- Tenga

- se convirtió en

- porque

- a las que has recomendado

- esto

- antes

- comenzó

- comenzar

- detrás de

- "Ser"

- beneficios

- MEJOR

- mejores

- entre

- Más allá de

- Big

- Big Data

- primer libro

- ambas

- llevar

- Trayendo

- Trae

- bristol

- general

- en general

- presupuesto

- build

- Construir la

- construye

- construido

- impacto de negocios

- negocios

- pero

- by

- llamar al

- , que son

- PUEDEN

- capacidades

- Propósito

- case

- cases

- Centros

- cadena

- Reto

- oportunidad

- características

- cargado

- químico

- jefe

- manera?

- limpiar

- de cerca

- cierre

- Soluciones

- Médico

- código

- Codificación

- colaborado

- colaboración

- --

- Financiamiento para la

- combinar

- combinado

- proviene

- compromiso

- Empresas

- De la empresa

- obligado

- terminación

- integraciones

- exhaustivo

- computadora

- Ciencias de la Computación

- Visión por computador

- informática

- conceptos

- Configurando

- Conectándote

- conexión

- Conexiones

- consecuentemente

- Contenedores

- contiene

- contenido

- creación de contenido

- contexto

- continue

- contrato

- contribuyendo

- conversacional

- cocinar

- Core

- correcta

- correctamente

- Cost

- podría

- cursos

- Para crear

- creado

- creación

- creatividad

- crítico

- Current

- En la actualidad

- personalizado

- cliente

- Clientes

- corte

- innovador

- Dallas

- datos

- integración de datos

- proceso de datos

- Ciencia de los datos

- Base de datos

- bases de datos

- Días

- década

- disminuir

- a dedicados

- profundo

- más profundo

- Delaware

- De demostración

- Democratizando

- Departamento

- derivado

- describir

- descripción

- Diseño

- diseñado

- deseo

- deseado

- detallado

- detalles

- desarrolladores

- Desarrollo

- Dispositivos

- Diálogo

- una experiencia diferente

- directamente

- distribuidos

- sistemas distribuidos

- Cursos de Buceo

- do

- documentos

- No

- "Hacer"

- dominios

- No

- DE INSCRIPCIÓN

- borrador

- drásticamente,

- el lado de la transmisión

- dos

- cada una

- más fácil

- fácil

- pasan fácilmente

- ecosistema

- de manera eficaz

- ya sea

- Ingenieria Eléctrica

- elementos

- permite

- final

- fin

- energía

- ingeniero

- Ingeniería

- England

- Inglés

- Estrategias orientadas

- suficientes

- garantizar

- asegura

- Participar

- Empresa

- software empresarial

- Soluciones Empresariales

- empresas

- Todo

- enteramente

- emprendedores

- ambientes

- igual

- Equivalente a

- error

- especialmente

- Éter (ETH)

- Incluso

- evidente

- exactamente

- ejemplo

- ejemplos

- Excel

- excitado

- ejecutivos

- existente

- esperado

- esperando

- experience

- experto

- Experiencia

- explorador

- Explorar

- extra

- extremadamente

- familia

- rápido

- de ritmo rápido

- Feature

- Caracteristicas

- pocos

- campo

- Terrenos

- filtrar

- filtración

- filtros

- encuentra

- Nombre

- buque insignia

- de tus señales

- Flujos

- Focus

- se centra

- enfoque

- seguir

- siguiendo

- siguiente

- comidas

- Incursión

- primer plano

- formato

- Formularios

- adelante

- encontrado

- Fundación

- la fundación de

- Francisco

- amigable

- Desde

- Cumplir

- completamente

- función

- promover

- futuras

- ganado

- en general

- generar

- generado

- genera

- la generación de

- generación de AHSS

- generativo

- IA generativa

- Georgia

- Instituto de Tecnología de Georgia

- obtener

- gif

- dado

- Go

- Goals

- Va

- candidato

- graduados

- Crecer

- guía

- tenido

- mano

- Aprovechamiento

- Tienen

- he

- Corazón

- ayuda

- ayudado

- serviciales

- ayudando

- ayuda

- esta página

- alto rendimiento

- alta calidad

- destacados

- su

- mantener

- mantiene

- hospitalidad

- HORAS

- Cómo

- Como Hacer

- Sin embargo

- HTML

- HTTPS

- humana

- humilde

- no haber aun identificado una solucion para el problema

- if

- ilustrar

- inmediatamente

- Impacto

- impactante

- implementar

- importante

- mejorar

- mejorado

- la mejora de

- in

- incluir

- incluido

- Incluye

- aumente

- independientes

- Indica

- indicadores

- INSTRUMENTO individual

- industrias

- energético

- líder de la industria

- información

- innatas

- innovando

- Innovation

- Las opciones de entrada

- entradas

- instantáneo

- Innovadora

- Instrucciones

- COMPLETAMENTE

- integración

- integraciones

- Intelligence

- De Operación

- intención

- interacciones

- interactivo

- intereses

- Interfaz

- interno

- dentro

- Introducido

- Presenta

- tips para

- OPV

- Isv

- IT

- iteración

- iteraciones

- SUS

- Java

- Trabajos

- se unió a

- unión

- articulación

- alegría

- jpg

- json

- solo

- Clave

- Saber

- especialistas

- conocido

- sabe

- el lab

- labs

- idioma

- Idiomas

- large

- Apellido

- luego

- más reciente

- Lead

- líder

- Liderazgo

- líder

- Saltar

- aprendido

- aprendizaje

- izquierda

- dejar

- aprovechando

- como

- Me gusta

- lógica

- Largo

- Mira

- Lote

- amar

- FANTASMA

- máquina

- máquina de aprendizaje

- Máquinas

- hecho

- para lograr

- HACE

- Realizar

- gestionado

- Management

- gerente

- Managers

- manera

- a mano

- muchos

- cartografía

- Marzo

- Mercado

- Marketing

- cerillas

- materiales

- me

- mentor

- mero

- metadatos

- Método

- millones

- mente

- minutos

- misión

- ML

- modelo

- modelos

- MongoDB

- más,

- MEJOR DE TU

- movimiento

- MS

- Multiplataforma

- múltiples

- my

- nombre

- Natural

- Lenguaje natural

- ¿ Necesita ayuda

- Nuevo

- Nuevas características

- producto nuevo

- Next

- no

- nota

- ordenadores portátiles

- Aviso..

- ahora

- objeto

- objetos

- se produjo

- of

- Ofertas

- a menudo

- on

- una vez

- ONE

- , solamente

- funcionamiento

- sistemas operativos

- optimización

- optimizando

- or

- solicite

- en pedidos de venta.

- organización

- para las fiestas.

- reconocida por

- Otro

- nuestros

- salir

- Resultado

- salida

- salidas

- Más de

- paginas

- Paralelo

- particularmente

- Socio

- Consorcio

- pasión

- apasionado

- pasado

- Patrón de Costura

- realiza

- la perspectiva

- fase

- Doctor en Filosofía

- piezas

- pionero

- industrial

- esencial

- Colocar

- plataforma

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Popular

- popularidad

- Publicación

- posible

- la posibilidad

- industria

- alimentado

- prácticas

- predecir

- previsto

- anterior

- primario

- Director de la escuela

- política de privacidad

- Privacidad y Seguridad

- Problema

- problemas

- procedimientos

- en costes

- tratamiento

- producido

- produce

- Producto

- desarrollo de productos

- gestión de producto

- gerente de producto

- Productos

- Productos y Servicios

- Profesional

- Profesor

- Programación

- lenguajes de programación

- proyecta

- ideas

- probado

- proporcionar

- previsto

- proporciona un

- proporcionando

- Psicología

- público

- publicado

- Investigación publicada

- perseguir

- Python

- consultas

- pregunta

- con rapidez

- azar

- aleatoriedad

- distancia

- que van

- rápido

- Reading

- darse cuenta de

- reino

- recepción

- recientemente

- reconocimiento

- recomiendan

- grabar

- archivos

- reducir

- reduce

- la reducción de

- con respecto a

- región

- reinventar

- relacionado

- liberado

- confianza

- confiar

- recordarlo

- remove

- prestados

- repetible

- responder

- representación

- que representa

- representa

- solicita

- solicitudes

- exigir

- Requisitos

- Requisitos

- requiere

- la investigación

- respuesta

- respuestas

- RESTO

- resultante

- Resultados

- volvemos

- devoluciones

- revolucionar

- Rico

- Derecho

- carretera

- Función

- También soy miembro del cuerpo docente de World Extreme Medicine (WEM) y embajadora europea de igualdad para The Transformational Travel Council (TTC). En mi tiempo libre, soy una incansable aventurera, escaladora, patrona de día, buceadora y defensora de la igualdad de género en el deporte y la aventura. En XNUMX, fundé Almas Libres, una ONG nacida para involucrar, educar y empoderar a mujeres y niñas a través del deporte urbano, la cultura y la tecnología.

- Conferencia

- Ejecutar

- corre

- SaaS

- Safety

- sabio

- Said

- mismo

- San

- San Francisco

- Scala

- escalable

- Escala

- programa

- Ciencia:

- Científico

- rayar

- Sdk

- búsqueda

- Segundo

- Sección

- sector

- EN LINEA

- ver

- visto

- selecciona

- enviando

- mayor

- expedido

- Secuencia

- servido

- de coches

- Servicios

- servicio

- sesiones

- set

- pólipo

- Varios

- tienes

- Mostrar

- mostrado

- Shows

- significativamente

- similares

- sencillos

- simplificar

- simplificando

- simplemente

- desde

- soltero

- chica

- So

- Software

- software como servicio

- Desarrolladores de software

- Desarrollo de software ad-hoc

- Ingeniería de software

- a medida

- Soluciones

- RESOLVER

- Resolver

- algo

- Alguien

- sofisticado

- Soul

- Fuente

- Espacio

- Español

- abarcando

- especialista

- soluciones y

- específicamente

- especificado

- pasar

- Gastos

- SQL

- comienzo

- fundó

- inicio

- Posicionamiento

- Estado

- paso

- pasos

- Detener

- sencillo

- estructura

- Estudiantes

- estudiado

- comercial

- Apoyar

- soportes

- Supuesto

- seguro

- te

- Todas las funciones a su disposición

- mesa

- ETIQUETA

- ¡Prepárate!

- Target

- Tarea

- tareas

- enseñó

- equipo

- equipos

- tecnología

- startup de tecnología

- Técnico

- la técnica

- técnicas

- Tecnología

- les digas

- diez

- Texas

- texto

- que

- esa

- La

- El oeste

- el mundo

- su

- Les

- luego

- Estas

- ellos

- cosas

- pensar

- así

- aquellos

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- a lo largo de

- equipo

- a

- hoy

- ficha

- Tokens

- les dijo a

- se

- del IRS

- rastrear

- seguir

- Plataforma de

- tradicionalmente

- Formación

- transformador

- transformadas

- la traducción

- viajes

- viajes

- tendencias

- juicio

- detonante

- desencadenando

- verdadero

- Código verdadero

- tratando de

- Turning

- tipo

- ui

- Uk

- bajo

- entender

- comprensión

- entiende

- único

- universidad

- hasta

- dio a conocer

- próximos

- actualizado

- a

- us

- usable

- utilizan el

- caso de uso

- usado

- Usuario

- experiencia como usuario

- usuarios

- usos

- usando

- generalmente

- ux

- diversos

- vendedores

- muy

- vía

- visión

- visual

- vmware

- Voz

- quieres

- fue

- Camino..

- we

- web

- servicios web

- Semanas

- WELL

- tuvieron

- West

- ¿

- Que es

- cuando

- que

- amplio

- Amplia gama

- seguirá

- ventana

- sin

- Actividades:

- trabajado

- flujo de trabajo

- flujos de trabajo

- trabajando

- funciona

- mundo

- mundo

- se

- escribir

- XML

- año

- años

- Usted

- tú

- Youtube

- zephyrnet