Η τεχνητή νοημοσύνη (AI) έχει φέρει επανάσταση σε διάφορους κλάδους, προσφέροντας πολλά οφέλη και ευκαιρίες. Ωστόσο, έχουν προκύψει ανησυχίες σχετικά με τη δυνατότητα της τεχνητής νοημοσύνης να διαιωνίσει τις διακρίσεις και τις προκαταλήψεις. Αυτό το άρθρο διερευνά το θέμα της διάκρισης της τεχνητής νοημοσύνης, ρίχνοντας φως στις προκλήσεις του εντοπισμού και της αντιμετώπισης προκαταλήψεων που ενσωματώνονται στα συστήματα τεχνητής νοημοσύνης. Οι γνώστες του κλάδου εκφράζουν αμφιβολίες για τις ηθικές και ηθικές συνέπειες της τεχνητής νοημοσύνης, επικαλούμενοι ανησυχίες για παραπληροφόρηση, προκαταλήψεις στους αλγόριθμους και τη δημιουργία παραπλανητικού περιεχομένου. Καθώς οι συζητήσεις γύρω από την τεχνητή νοημοσύνη εντείνονται, υπάρχει μια αυξανόμενη έκκληση για ουσιαστική ρύθμιση για τη διασφάλιση της διαφάνειας, της λογοδοσίας και της προστασίας των θεμελιωδών δικαιωμάτων.

Προκλήσεις για τις χρηματοοικονομικές βιομηχανίες με AI

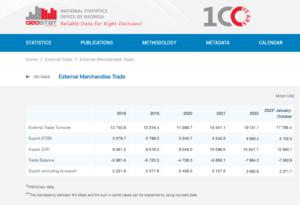

Σύμφωνα με τον Nabil Manji, επικεφαλής κρυπτογράφησης και Web3 στο Worldpay by FIS, η αποτελεσματικότητα των προϊόντων τεχνητής νοημοσύνης εξαρτάται σε μεγάλο βαθμό από την ποιότητα του υλικού πηγής που χρησιμοποιείται για εκπαίδευση. Σε συνέντευξή του στο CNBC, ο Manji εξήγησε ότι δύο κύριοι παράγοντες συμβάλλουν στην απόδοση της τεχνητής νοημοσύνης: τα δεδομένα στα οποία έχει πρόσβαση και οι δυνατότητες του μεγάλου γλωσσικού μοντέλου.

Για να καταδείξει τη σημασία των δεδομένων, ο Manji ανέφερε ότι εταιρείες όπως η Reddit έχουν δηλώσει δημόσια περιορισμούς στην απόσυρση δεδομένων, απαιτώντας πληρωμή για πρόσβαση. Στον τομέα των χρηματοοικονομικών υπηρεσιών, τόνισε την πρόκληση των κατακερματισμένων συστημάτων δεδομένων σε διάφορες γλώσσες και μορφές. Αυτή η έλλειψη ενοποίησης και εναρμόνισης περιορίζει την αποτελεσματικότητα των προϊόντων που βασίζονται στην τεχνητή νοημοσύνη, ειδικά σε σύγκριση με βιομηχανίες με τυποποιημένη και εκσυγχρονισμένη υποδομή δεδομένων.

Σύμφωνα με τον Manji, η χρήση της τεχνολογίας blockchain ή κατανεμημένου καθολικού μπορεί να προσφέρει μια πιθανή λύση για την αντιμετώπιση αυτού του προβλήματος. Αυτή η καινοτόμος προσέγγιση μπορεί να προσφέρει αυξημένη διαφάνεια στα κατακερματισμένα δεδομένα που αποθηκεύονται στα περίπλοκα συστήματα των συμβατικών τραπεζών. Ωστόσο, αναγνώρισε ότι η εξαιρετικά ρυθμιζόμενη και αργή φύση των τραπεζών ενδέχεται να εμποδίσει την ικανότητά τους να υιοθετούν γρήγορα νέα εργαλεία τεχνητής νοημοσύνης, σε αντίθεση με τις πιο ευέλικτες εταιρείες τεχνολογίας όπως η Microsoft και η Google, που πρωτοστατούν στην προώθηση της καινοτομίας τα τελευταία λίγα. δεκαετίες.

Λαμβάνοντας υπόψη αυτούς τους παράγοντες, γίνεται προφανές ότι ο χρηματοοικονομικός κλάδος αντιμετωπίζει μοναδικές προκλήσεις όσον αφορά τη μόχλευση της τεχνητής νοημοσύνης λόγω της πολυπλοκότητας της ενοποίησης δεδομένων και της εγγενούς φύσης του τραπεζικού τομέα.

Σύμφωνα με τον Rumman Chowdhury, πρώην επικεφαλής ηθικής μηχανικής μάθησης, διαφάνειας και λογοδοσίας στο Twitter, ο δανεισμός είναι ένα αξιοσημείωτο παράδειγμα του πώς η μεροληψία στα συστήματα τεχνητής νοημοσύνης μπορεί να επηρεάσει αρνητικά τις περιθωριοποιημένες κοινότητες. Μιλώντας σε μια συζήτηση στο Άμστερνταμ, ο Chowdhury τόνισε την ιστορική πρακτική της «κόκκινης γραμμής» στο Σικάγο κατά τη δεκαετία του 1930. Το Redlining περιελάμβανε άρνηση δανείων σε γειτονιές κυρίως αφροαμερικανών με βάση τα φυλετικά δημογραφικά στοιχεία.

Ο Chowdhury εξήγησε ότι αν και οι σύγχρονοι αλγόριθμοι μπορεί να μην περιλαμβάνουν ρητά τη φυλή ως σημείο δεδομένων, οι προκαταλήψεις μπορούν ακόμα να κωδικοποιηθούν έμμεσα. Κατά την ανάπτυξη αλγορίθμων για την αξιολόγηση της επικινδυνότητας περιοχών και ατόμων για σκοπούς δανεισμού, τα ιστορικά δεδομένα που περιέχουν προκαταλήψεις μπορούν άθελά τους να διαιωνίσουν τις διακρίσεις.

Ο Angle Bush, ο οραματιστής πίσω από τις Μαύρες Γυναίκες στην Τεχνητή Νοημοσύνη, τόνισε τη σημασία της αναγνώρισης των κινδύνων που σχετίζονται με την αναπαραγωγή προκαταλήψεων που ενσωματώνονται σε ιστορικά δεδομένα όταν χρησιμοποιούν συστήματα AI για την έγκριση των δανείων. Μια τέτοια πρακτική μπορεί να οδηγήσει στην αυτόματη απόρριψη αιτήσεων δανείου από περιθωριοποιημένες κοινότητες, διαιωνίζοντας έτσι τις φυλετικές ή έμφυλες ανισότητες.

Ο Frost Li, ένας έμπειρος προγραμματιστής AI, επεσήμανε τις προκλήσεις της εξατομίκευσης Ενσωμάτωση AI. Η επιλογή «βασικών χαρακτηριστικών» για την εκπαίδευση μοντέλων AI μπορεί μερικές φορές να περιλαμβάνει άσχετους παράγοντες που μπορεί να οδηγήσουν σε μεροληπτικά αποτελέσματα. Ο Λι παρείχε ένα παράδειγμα για το πώς οι νεοσύστατες εταιρείες fintech που στοχεύουν ξένους μπορεί να αντιμετωπίσουν διαφορετικά κριτήρια αξιολόγησης της πιστοληπτικής ικανότητας σε σύγκριση με τις τοπικές τράπεζες, οι οποίες είναι πιο εξοικειωμένες με τα τοπικά σχολεία και κοινότητες.

Ο Niklas Guske, ο COO της Taktile, μιας startup που ειδικεύεται στην αυτοματοποίηση της λήψης αποφάσεων για fintechs, διευκρίνισε ότι η γενετική τεχνητή νοημοσύνη δεν χρησιμοποιείται συνήθως για τη δημιουργία πιστωτικών βαθμολογιών ή τη βαθμολογία κινδύνου των καταναλωτών. Αντίθετα, η δύναμή του έγκειται στην προεπεξεργασία μη δομημένων δεδομένων, όπως τα αρχεία κειμένου, για τη βελτίωση της ποιότητας των δεδομένων για τα συμβατικά μοντέλα αναδοχής.

Συνοπτικά, η χρήση της τεχνητής νοημοσύνης στον δανεισμό και τις χρηματοοικονομικές υπηρεσίες εγείρει ανησυχίες σχετικά με την προκατάληψη και τις διακρίσεις. Οι ιστορικές προκαταλήψεις που ενσωματώνονται στα δεδομένα και η επιλογή άσχετων χαρακτηριστικών κατά τη διάρκεια της εκπαίδευσης σε τεχνητή νοημοσύνη μπορεί να οδηγήσουν σε άδικα αποτελέσματα. Είναι σημαντικό για τις τράπεζες και τα χρηματοπιστωτικά ιδρύματα να αναγνωρίσουν και να αντιμετωπίσουν αυτά τα ζητήματα για να αποτρέψουν την ακούσια διαιώνιση των διακρίσεων κατά την εφαρμογή λύσεων τεχνητής νοημοσύνης.

Απόδειξη AI-Discrimination

Η απόδειξη των διακρίσεων που βασίζονται στην τεχνητή νοημοσύνη μπορεί να είναι πρόκληση, όπως υπογραμμίζεται από παραδείγματα όπως η υπόθεση που αφορά την Apple και την Goldman Sachs. Το Υπουργείο Οικονομικών Υπηρεσιών της Πολιτείας της Νέας Υόρκης απέρριψε τους ισχυρισμούς για την επιβολή χαμηλότερων ορίων στην Apple Card για γυναίκες, επικαλούμενος έλλειψη τεκμηριωμένων στοιχείων.

Ο Kim Smouter, διευθυντής του Ευρωπαϊκού Δικτύου κατά του Ρατσισμού, επισημαίνει ότι η μαζική ανάπτυξη της τεχνητής νοημοσύνης προκαλεί αδιαφάνεια στις διαδικασίες λήψης αποφάσεων, καθιστώντας δύσκολο για τα άτομα να εντοπίσουν και να αντιμετωπίσουν τις διακρίσεις.

Ο Smouter εξηγεί ότι τα άτομα συχνά έχουν περιορισμένη γνώση του τρόπου λειτουργίας των συστημάτων AI, γεγονός που καθιστά δύσκολο τον εντοπισμό περιπτώσεων διακρίσεων ή συστημικών προκαταλήψεων. Γίνεται ακόμη πιο περίπλοκο όταν η διάκριση αποτελεί μέρος ενός ευρύτερου ζητήματος που επηρεάζει πολλά άτομα. Ο Smouter αναφέρεται στο ολλανδικό σκάνδαλο παιδικής μέριμνας, όπου ένας μεγάλος αριθμός αξιώσεων επιδομάτων χαρακτηρίστηκε λανθασμένα ως δόλιες λόγω θεσμικής μεροληψίας. Η ανακάλυψη τέτοιων δυσλειτουργιών είναι πρόκληση και η αποζημίωση μπορεί να είναι δύσκολη και χρονοβόρα, οδηγώντας σε σημαντική και μερικές φορές μη αναστρέψιμη βλάβη.

Αυτά τα παραδείγματα απεικονίζουν τις εγγενείς δυσκολίες στην τεκμηρίωση των διακρίσεων που βασίζονται στην τεχνητή νοημοσύνη και στην εξασφάλιση επανορθωτικών μέτρων όταν συμβαίνει μια τέτοια διάκριση. Η πολυπλοκότητα των συστημάτων τεχνητής νοημοσύνης και η έλλειψη διαφάνειας στις διαδικασίες λήψης αποφάσεων μπορεί να καταστήσει δύσκολο για τα άτομα να αναγνωρίσουν και να αντιμετωπίσουν αποτελεσματικά περιπτώσεις διάκρισης.

Σύμφωνα με τον Chowdhury, υπάρχει επιτακτική ανάγκη για έναν παγκόσμιο ρυθμιστικό φορέα παρόμοιο με τα Ηνωμένα Έθνη για την αντιμετώπιση των κινδύνων που σχετίζονται με την τεχνητή νοημοσύνη. Ενώ η τεχνητή νοημοσύνη έχει δείξει αξιοσημείωτη καινοτομία, τεχνολόγοι και ηθικολόγοι έχουν εκφράσει ανησυχίες σχετικά με τις ηθικές και δεοντολογικές της επιπτώσεις. Αυτές οι ανησυχίες περιλαμβάνουν ζητήματα όπως η παραπληροφόρηση, οι ενσωματωμένες φυλετικές και έμφυλες προκαταλήψεις σε αλγόριθμους τεχνητής νοημοσύνης και η δημιουργία παραπλανητικού περιεχομένου από εργαλεία όπως το ChatGPT.

Ο Chowdhury εκφράζει την ανησυχία του για την είσοδο σε έναν κόσμο μετά την αλήθεια όπου οι διαδικτυακές πληροφορίες, συμπεριλαμβανομένου κειμένου, βίντεο και ήχου, γίνονται αναξιόπιστες λόγω της τεχνητής νοημοσύνης που δημιουργείται. Αυτό εγείρει ερωτήματα σχετικά με το πώς μπορούμε να διασφαλίσουμε την ακεραιότητα των πληροφοριών και πώς μπορούμε να βασιστούμε σε αυτές για τη λήψη τεκμηριωμένων αποφάσεων. Με παράδειγμα τον νόμο AI της Ευρωπαϊκής Ένωσης, η ουσιαστική ρύθμιση της τεχνητής νοημοσύνης είναι ζωτικής σημασίας αυτή τη στιγμή. Ωστόσο, υπάρχουν ανησυχίες σχετικά με το μακρύ χρονοδιάγραμμα που απαιτείται για να γίνουν αποτελεσματικές οι ρυθμιστικές προτάσεις, γεγονός που ενδεχομένως καθυστερεί τις απαραίτητες ενέργειες.

Ο Smouter τονίζει την ανάγκη για μεγαλύτερη διαφάνεια και υπευθυνότητα στους αλγόριθμους AI. Αυτό περιλαμβάνει το να γίνουν οι αλγόριθμοι πιο κατανοητοί για μη ειδικούς, η διεξαγωγή δοκιμών και η δημοσίευση αποτελεσμάτων, η δημιουργία ανεξάρτητων διαδικασιών παραπόνων, η διενέργεια περιοδικών ελέγχων και η υποβολή εκθέσεων και η συμμετοχή φυλετικών κοινοτήτων στο σχεδιασμό και την ανάπτυξη της τεχνολογίας. Η επιβολή του νόμου περί τεχνητής νοημοσύνης, ο οποίος έχει μια προοπτική των θεμελιωδών δικαιωμάτων και εισάγει έννοιες όπως η έννομη προστασία, αναμένεται να ξεκινήσει σε περίπου δύο χρόνια. Η μείωση αυτού του χρονοδιαγράμματος θα ήταν επωφελής για τη διατήρηση της διαφάνειας και της λογοδοσίας ως αναπόσπαστες πτυχές της καινοτομίας.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Αυτοκίνητο / EVs, Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- BlockOffsets. Εκσυγχρονισμός της περιβαλλοντικής αντιστάθμισης ιδιοκτησίας. Πρόσβαση εδώ.

- πηγή: https://www.forexnewsnow.com/fintech/the-urgency-of-addressing-ai-discrimination-transparency-accountability-and-regulatory-timelines/

- :έχει

- :είναι

- :δεν

- :που

- a

- ικανότητα

- ΠΛΗΡΟΦΟΡΙΕΣ

- πρόσβαση

- ευθύνη

- αναγνώρισε

- Πράξη

- ενεργειών

- διεύθυνση

- διευθυνσιοδότηση

- ενστερνίζομαι

- επωφελής

- αρνητικά

- επηρεάζουν

- αφρικανικός

- κατά

- ευκίνητος

- AI

- AI Act

- Συστήματα AI

- Εκπαίδευση AI

- αλγόριθμοι

- Ισχυρισμοί

- Αν και

- Αμερικανικη

- Άμστερνταμ

- an

- και

- Πρόβλεψη

- Apple

- Κάρτα Apple

- εφαρμογές

- πλησιάζω

- έγκριση

- περίπου

- ΕΙΝΑΙ

- άρθρο

- τεχνητός

- τεχνητή νοημοσύνη

- AS

- πτυχές

- εκτιμώ

- εκτίμηση

- συσχετισμένη

- At

- ήχου

- έλεγχοι

- Αυτόματο

- αυτοματοποίηση

- Τράπεζες

- τραπεζικός τομέας

- Τράπεζες

- βασίζονται

- BE

- γίνονται

- γίνεται

- ήταν

- πίσω

- όφελος

- οφέλη

- προκατάληψη

- μεροληπτική

- μεροληψίες

- Μαύρη

- blockchain

- σώμα

- Φέρνει

- ευρύτερη

- by

- κλήση

- CAN

- δυνατότητες

- κάρτα

- περίπτωση

- πρόκληση

- προκλήσεις

- πρόκληση

- ChatGPT

- Σικάγο

- παιδί

- αξιώσεις

- διευκρινίστηκε

- CNBC

- Κοινοτήτων

- Εταιρείες

- σύγκριση

- καταγγελία

- συγκρότημα

- πολυπλοκότητα

- περίπλοκο

- έννοιες

- Πιθανά ερωτήματα

- Διεξαγωγή

- ενοποίηση

- Καταναλωτές

- Περιέχει

- περιεχόμενο

- αντίθετος

- συμβάλλει

- συμβατικός

- ερωτολογώ

- δημιουργία

- μονάδες

- κριτήρια

- κρίσιμος

- κρυπτο

- κινδύνους

- ημερομηνία

- υποδομή δεδομένων

- ολοκλήρωση δεδομένων

- την ποιότητα των δεδομένων

- συζητήσεις

- δεκαετίες

- Λήψη Αποφάσεων

- αποφάσεις

- Δημογραφικά στοιχεία

- Τμήμα

- εξαρτάται

- ανάπτυξη

- Υπηρεσίες

- Εργολάβος

- ανάπτυξη

- διαφορετικές

- δύσκολος

- δυσκολίες

- Διευθυντής

- ανακάλυψη

- Διάκριση

- συζήτηση

- διανέμονται

- Κατανεμημένος Λογαριασμός

- διανεμημένη τεχνολογία λογιστικών βιβλίων

- οδήγηση

- δυο

- κατά την διάρκεια

- Ολλανδικά

- Αποτελεσματικός

- αποτελεσματικά

- αποτελεσματικότητα

- ενσωματωμένο

- προέκυψαν

- τονίζει

- περικυκλώ

- επιβολή

- ενίσχυση

- ενισχυμένη

- εξασφαλίζω

- εισερχόμενοι

- ειδικά

- δημιουργία

- ηθικά

- δεοντολογία

- ευρωπαϊκός

- Even

- απόδειξη

- εμφανές

- παράδειγμα

- παραδείγματα

- έμπειρος

- εξήγησε

- Εξηγεί

- διερευνά

- ρητή

- Πρόσωπο

- πρόσωπα

- παράγοντες

- οικείος

- Χαρακτηριστικά

- λίγοι

- Αρχεία

- οικονομικός

- χρηματοπιστωτικές βιομηχανίες

- Χρηματοπιστωτικά ιδρύματα

- των χρηματοπιστωτικών υπηρεσιών

- fintech

- fintech ξεκινήματα

- fintechs

- FIS

- Για

- Πρώτη γραμμή

- Πρώην

- κατακερματισμένος

- απατηλός

- από

- θεμελιώδης

- Φύλο

- γενεά

- γενετική

- Παραγωγική τεχνητή νοημοσύνη

- Παγκόσμιο

- χρυσός

- Goldman Sachs

- μεγαλύτερη

- Μεγαλώνοντας

- βλάψει

- Έχω

- he

- κεφάλι

- βαριά

- Τόνισε

- υψηλά

- ιστορικών

- Πως

- Ωστόσο

- HTTPS

- προσδιορίσει

- προσδιορισμό

- εκτελεστικών

- επιπτώσεις

- σπουδαιότητα

- επιβλητικός

- in

- περιλαμβάνουν

- περιλαμβάνει

- Συμπεριλαμβανομένου

- ανεξάρτητος

- άτομα

- βιομηχανίες

- βιομηχανία

- ανισότητες

- πληροφορίες

- ενημερώνεται

- Υποδομή

- συμφυής

- Καινοτομία

- καινοτόμες

- Θεσμική

- ιδρυμάτων

- ολοκλήρωμα

- ολοκλήρωση

- ακεραιότητα

- Νοημοσύνη

- συνέντευξη

- σε

- Εισάγει

- εμπλέκω

- συμμετέχουν

- συμμετοχή

- ζήτημα

- θέματα

- IT

- ΤΟΥ

- γνώση

- Έλλειψη

- Γλώσσα

- Γλώσσες

- large

- οδηγήσει

- που οδηγεί

- μάθηση

- Καθολικό

- δανεισμός

- μόχλευσης

- li

- βρίσκεται

- φως

- Μου αρέσει

- Περιωρισμένος

- όρια

- δάνειο

- Δάνεια

- τοπικός

- ΤΟΠΙΚΕΣ ΤΡΑΠΕΖΕΣ

- χαμηλότερα

- μηχανή

- μάθηση μηχανής

- Κυρίως

- κάνω

- Κατασκευή

- Μάζα

- υλικό

- Ενδέχεται..

- νόημα

- που αναφέρθηκαν

- Microsoft

- ενδέχεται να

- Κακή πληροφορία

- αποπλανητικός

- μοντέλο

- μοντέλα

- ΜΟΝΤΕΡΝΑ

- στιγμή

- ηθικός

- περισσότερο

- πολλαπλούς

- Εθνών

- Φύση

- απαραίτητος

- Ανάγκη

- δίκτυο

- Νέα

- Νέα Υόρκη

- Το κράτος της Νέας Υόρκης

- Υπουργείο Εξωτερικών της Νέας Υόρκης

- μη ειδικούς

- αξιοσημείωτο

- αριθμός

- πολυάριθμες

- πολυάριθμα οφέλη

- την απόκτηση

- of

- προσφορά

- προσφορά

- συχνά

- on

- διαδικτυακά (online)

- λειτουργούν

- Ευκαιρίες

- or

- έξω

- αποτελέσματα

- πίνακας

- Συζήτηση

- μέρος

- Το παρελθόν

- πληρωμή

- επίδοση

- περιοδικός

- εξατομίκευση

- προοπτική

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- Σημείο

- σημεία

- δυναμικού

- ενδεχομένως

- πρακτική

- κυρίως

- πιέζοντας

- πρόληψη

- Πρόβλημα

- Διεργασίες

- Προϊόντα

- Προτάσεις

- προστασία

- παρέχουν

- παρέχεται

- δημοσίως

- Δημοσιεύσεις

- σκοποί

- ποιότητα

- Ερωτήσεις

- Αγώνας

- ρατσισμός

- εγείρει

- αυξήσεις

- αναγνωρίζω

- μείωση

- αναφορές

- σχετικά με

- ρυθμίζονται

- Ρυθμιστικές Αρχές

- ρυθμιστές

- βασίζονται

- αξιοσημείωτος

- Αναφορά

- περιορισμούς

- Αποτελέσματα

- επανάσταση

- δικαιώματα

- Κίνδυνος

- κινδύνους

- Sachs

- σκάνδαλο

- Σχολεία

- αποτελέσματα

- βαθμολόγησης

- απόξεση

- τομέας

- επιλογή

- επιλογή

- Υπηρεσίες

- παρουσιάζεται

- σημασία

- σημαντικός

- παρόμοιες

- λύση

- Λύσεις

- Πηγή

- ομιλία

- ειδικευμένη

- εκκίνηση

- Startups

- Κατάσταση

- Στέιτ Ντιπάρτμεντ

- Ακόμη

- αποθηκεύονται

- δύναμη

- τέτοιος

- ΠΕΡΙΛΗΨΗ

- περιβάλλων

- ταχέως

- συστήματος

- συστήματα

- ανυψωτήρ

- παίρνει

- στόχευση

- tech

- tech εταιρείες

- τεχνολόγους

- Τεχνολογία

- δοκιμές

- ότι

- Η

- Η Πηγη

- τους

- Εκεί.

- εκ τούτου

- Αυτοί

- αυτό

- χρονοβόρος

- χρονοδιάγραμμα

- χρονοδιαγράμματα

- προς την

- εργαλεία

- τοπικός

- Εκπαίδευση

- Διαφάνεια

- Τουίτερ

- δύο

- συνήθως

- κατανοητός

- αναδοχή

- άδικος

- μοναδικός

- Ενωμένος

- Ηνωμένα Έθνη

- διαφορετικός

- Υποστηρίζω

- επείγον

- χρήση

- μεταχειρισμένος

- διάφορα

- Βίντεο

- οραματιστής

- we

- Web3

- Ευημερία

- ήταν

- πότε

- Ποιό

- ενώ

- με

- εντός

- Γυναίκες

- κόσμος

- WorldPay

- ανησυχία

- θα

- χρόνια

- Υόρκη

- zephyrnet