Ο κόσμος της τεχνητής νοημοσύνης (AI) εξελίσσεται ραγδαία, φέρνοντας στο προσκήνιο τεράστιες δυνατότητες και ηθικές προκλήσεις. Σε αυτό το πλαίσιο, είναι σημαντικό να θυμόμαστε ότι η ευφυΐα, όταν χρησιμοποιείται κακώς, μπορεί να είναι πιο σοβαρή από το να μην την έχεις καθόλου. Καθώς οι τεχνολογίες τεχνητής νοημοσύνης κλιμακώνονται και αποκτούν ολοένα μεγαλύτερη επιρροή σε διάφορους τομείς, η υπεύθυνη διακυβέρνηση καθίσταται υψίστης σημασίας για την αξιοποίηση των οφελών τους, ενώ παράλληλα μετριάζεται η πιθανή βλάβη. Η έλευση του γενετική AI, αν και πολλά υποσχόμενο, έχει περιοριστεί σε μεγάλο βαθμό στον πειραματισμό και στα περιθώρια. Για την ανάπτυξη αυτών των τεχνολογιών σε κλίμακα, υπάρχει ανάγκη για αξιόπιστα και ελεγχόμενα πλαίσια, τα οποία καθοδηγούνται από καλά καθορισμένους κανόνες που επιτρέπουν ή αποτρέπουν ανεπιθύμητες ενέργειες, επιβάλλουν μέτρα ασφαλείας, προσαρμόζονται στα αναδυόμενα ρυθμιστικά πλαίσια και διασφαλίζουν βιωσιμότητα τόσο από άποψη κόστους όσο και από αντίκτυπο στις ανθρώπινες ικανότητες και στους περιβαλλοντικούς, κοινωνικούς και διακυβέρνησης παράγοντες (ESG).

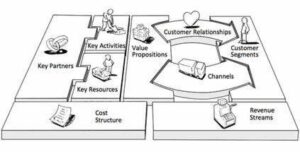

Προκειμένου οι επιχειρήσεις να αξιοποιήσουν πραγματικά τις τεράστιες δυνατότητες που παρουσιάζει η τεχνητή νοημοσύνη σε κλίμακα, πρέπει να δώσουν προτεραιότητα στην υπεύθυνη διακυβέρνηση στο ευρύτερο πλαίσιο του κλάδου. Μια υπεύθυνη προσέγγιση επιχειρεί να αντιμετωπίσει αυτή τη βασική πτυχή, επιτρέποντας στις επιχειρήσεις να κάνουν ουσιαστική χρήση της τεχνολογίας AI, διατηρώντας παράλληλα τα ηθικά πρότυπα.

Ηθικές ανησυχίες στην τεχνητή νοημοσύνη

Οι τεχνολογίες AI φέρνουν μαζί τους μια σειρά από ηθικές ανησυχίες που δεν μπορούν να αγνοηθούν. Αυτές οι ανησυχίες περιλαμβάνουν Προστασία προσωπικών δεδομένων, μεροληψία αλγορίθμου, πιθανή κακή χρήση και συμμόρφωση με τους κανονισμούς.

Η συλλογή, η αποθήκευση και η χρήση προσωπικών δεδομένων έχουν εγείρει σημαντικά ζητήματα απορρήτου. Ο λανθασμένος χειρισμός δεδομένων μπορεί να έχει σοβαρές συνέπειες και να παραβιάζει τα δικαιώματα των ατόμων. Επιπλέον, τα συστήματα τεχνητής νοημοσύνης δεν είναι απρόσβλητα από μεροληψία και μπορούν ακούσια να διαιωνίσουν τις υπάρχουσες ανισότητες ή στερεότυπα. Η αντιμετώπιση της αλγοριθμικής μεροληψίας είναι ζωτικής σημασίας για τη διασφάλιση της δικαιοσύνης και της ισότητας.

Η κακή χρήση τεχνολογιών τεχνητής νοημοσύνης μπορεί επίσης να έχει εκτεταμένο αντίκτυπο, οδηγώντας σε μια σειρά από κοινωνικά και ηθικά ζητήματα, συμπεριλαμβανομένης της παραπληροφόρησης, της επιτήρησης και της ακούσιας βλάβης. Αυτό επιδεινώνεται περαιτέρω από τους αναδυόμενους κανονισμούς, οι οποίοι αν και είναι απαραίτητοι για τη διατήρηση των ηθικών προτύπων, μπορεί να είναι δύσκολο να πλοηγηθούν. Η προσαρμογή σε αυτά τα εξελισσόμενα ρυθμιστικά πλαίσια είναι μια κρίσιμη πτυχή της υπεύθυνης τεχνητής νοημοσύνης.

Η υπεύθυνη διακυβέρνηση της τεχνητής νοημοσύνης είναι μια πολύπλευρη προσπάθεια, η οποία περιλαμβάνει:

- Ηθικά πλαίσια: Οι οργανισμοί πρέπει να δημιουργήσουν σαφή ηθικά πλαίσια που να καθοδηγούν την ανάπτυξη και την ανάπτυξη της τεχνητής νοημοσύνης, διασφαλίζοντας ότι η τεχνολογία σέβεται τα ατομικά δικαιώματα και τις κοινωνικές αξίες.

- Αλγοριθμική δικαιοσύνη: Η εφαρμογή μέτρων για τον εντοπισμό και τη διόρθωση της μεροληψίας στους αλγόριθμους τεχνητής νοημοσύνης είναι ζωτικής σημασίας για τη διασφάλιση της δικαιοσύνης και των δίκαιων αποτελεσμάτων.

- Αξιόπιστες συναλλαγές: Για να κλιμακωθούν αποτελεσματικά οι τεχνολογίες τεχνητής νοημοσύνης, πρέπει να δημιουργηθούν αξιόπιστες συναλλαγές, επιτρέποντας στους χρήστες να βασίζονται σε αποφάσεις που βασίζονται στην τεχνητή νοημοσύνη με σιγουριά.

- Μέτρα ασφαλείας: Ισχυρά πρωτόκολλα ασφαλείας είναι απαραίτητα για την προστασία των συστημάτων τεχνητής νοημοσύνης από απειλές στον κυβερνοχώρο και τη διασφάλιση του απορρήτου των δεδομένων.

- Ικανότητα προσαρμογής: Τα συστήματα τεχνητής νοημοσύνης θα πρέπει να σχεδιάζονται ώστε να προσαρμόζονται στα εξελισσόμενα ρυθμιστικά τοπία, διασφαλίζοντας τη συνεχή συμμόρφωση με τα ηθικά και νομικά πρότυπα.

- Βιωσιμότητα κόστους: Η σχέση κόστους-αποτελεσματικότητας είναι ζωτικής σημασίας για να διασφαλιστεί ότι η ανάπτυξη της τεχνητής νοημοσύνης παραμένει οικονομικά βιώσιμη, καθιστώντας την προσβάσιμη σε ένα ευρύτερο φάσμα οργανισμών.

- Ανθρώπινες ικανότητες και αντίκτυπος ESG: Η τεχνητή νοημοσύνη θα πρέπει να ενισχύσει τις ανθρώπινες ικανότητες, ενώ παράλληλα θα επηρεάσει θετικά τους Περιβαλλοντικούς, Κοινωνικούς και Διακυβέρνησης παράγοντες (ESG), συμβάλλοντας σε μια πιο βιώσιμη και δίκαιη κοινωνία.

Καθώς οι τεχνολογίες τεχνητής νοημοσύνης συνεχίζουν να αναδιαμορφώνουν τις βιομηχανίες και την κοινωνία, η υπεύθυνη διακυβέρνηση της τεχνητής νοημοσύνης δεν είναι πλέον προαιρετική. είναι επιτακτική ανάγκη. Η υπεύθυνη προσέγγιση τοποθετεί την ηθική και τη λογοδοσία στον πυρήνα της ανάπτυξης και ανάπτυξης της τεχνητής νοημοσύνης, επιτρέποντας στους οργανισμούς να εκμεταλλευτούν τα οφέλη της τεχνολογίας ενώ αντιμετωπίζουν ηθικά ζητήματα όπως το απόρρητο δεδομένων, η μεροληψία αλγορίθμων και η πιθανή κακή χρήση. Με αυτόν τον τρόπο, μπορούμε να διασφαλίσουμε ότι η δύναμη της τεχνητής νοημοσύνης αξιοποιείται υπεύθυνα, προς όφελος τόσο των επιχειρήσεων όσο και της κοινωνίας.

- SEO Powered Content & PR Distribution. Ενισχύστε σήμερα.

- PlatoData.Network Vertical Generative Ai. Ενδυναμώστε τον εαυτό σας. Πρόσβαση εδώ.

- PlatoAiStream. Web3 Intelligence. Ενισχύθηκε η γνώση. Πρόσβαση εδώ.

- PlatoESG. Ανθρακας, Cleantech, Ενέργεια, Περιβάλλον, Ηλιακός, Διαχείριση των αποβλήτων. Πρόσβαση εδώ.

- PlatoHealth. Ευφυΐα βιοτεχνολογίας και κλινικών δοκιμών. Πρόσβαση εδώ.

- πηγή: https://www.dataversity.net/responsible-first-ai-governance-addressing-ethical-concerns-for-scalable-adoption/

- :έχει

- :είναι

- :δεν

- a

- προσιτός

- ευθύνη

- ενεργειών

- προσαρμόσει

- διεύθυνση

- διευθυνσιοδότηση

- Υιοθεσία

- έλευση

- AI

- Διακυβέρνηση AI

- Συστήματα AI

- αλγόριθμος

- αλγοριθμικός

- αλγοριθμική προκατάληψη

- αλγόριθμοι

- Όλα

- Επιτρέποντας

- Επίσης

- an

- και

- ΕΙΝΑΙ

- τεχνητός

- τεχνητή νοημοσύνη

- Τεχνητή νοημοσύνη (AI)

- AS

- άποψη

- At

- Προσπάθειες

- BE

- γίνονται

- γίνεται

- ήταν

- ωφελώντας

- οφέλη

- προκατάληψη

- και οι δύο

- φέρω

- Φέρνοντας

- ευρύτερη

- επιχειρήσεις

- by

- CAN

- δεν μπορώ

- δυνατότητες

- ικανότητα

- προκλήσεις

- πρόκληση

- καθαρός

- συλλογή

- Συμμόρφωση

- Πιθανά ερωτήματα

- εμπιστοσύνη

- Συνέπειες

- συμφραζόμενα

- ΣΥΝΕΧΕΙΑ

- συνέχισε

- συμβάλλοντας

- πυρήνας

- διορθώσει

- Κόστος

- κρίσιμος

- στον κυβερνοχώρο

- ημερομηνία

- Προστασία προσωπικών δεδομένων

- ΔΕΔΟΜΕΝΟΤΗΤΑ

- αποφάσεις

- παρατάσσω

- ανάπτυξη

- σχεδιασμένα

- ανίχνευση

- Ανάπτυξη

- πράξη

- οδηγείται

- αποτελεσματικά

- σμυριδόπετρα

- ενεργοποιήσετε

- ενεργοποίηση

- περιλαμβάνει

- προσπάθεια

- επιβάλλω

- ενίσχυση

- εξασφαλίζω

- εξασφαλίζοντας

- επιχειρήσεις

- περιβάλλοντος

- δίκαιος

- δικαιοσύνη

- ΕΙΝΑΙ Γ

- ουσιώδης

- εγκαθιδρύω

- εγκατεστημένος

- ηθικά

- δεοντολογία

- εξελίσσεται

- υφιστάμενα

- παράγοντες

- δικαιοσύνη

- εκτεταμένη

- οικονομικά

- Για

- Πρώτη γραμμή

- πλαισίων

- από

- περαιτέρω

- διακυβέρνησης

- διέπεται

- καθοδηγήσει

- βλάψει

- ιπποσκευή

- αξιοποιηθεί

- Έχω

- που έχει

- οικοδεσπότης

- HTTPS

- ανθρώπινος

- τεράστια

- ανοσοποιητικό

- Επίπτωση

- επιπτώσεις

- επιτακτικός

- εκτελεστικών

- in

- περιλαμβάνουν

- Συμπεριλαμβανομένου

- όλο και περισσότερο

- ατομικές

- βιομηχανίες

- βιομηχανία

- ανισότητες

- Με επιρροή

- Νοημοσύνη

- θέματα

- IT

- Κλειδί

- σε μεγάλο βαθμό

- που οδηγεί

- Νομικά

- Μόχλευση

- πλέον

- Η διατήρηση

- κάνω

- Κατασκευή

- νόημα

- μέτρα

- κακομεταχείριση

- Κακή πληροφορία

- κακή χρήση

- μετριασμός

- περισσότερο

- πολύπλευρη

- πρέπει

- Πλοηγηθείτε

- απαραίτητος

- Ανάγκη

- Όχι.

- of

- on

- or

- οργανώσεις

- αποτελέσματα

- κυρίαρχος

- προσωπικός

- προσωπικά δεδομένα

- προοπτική

- Μέρη

- Πλάτων

- Πληροφορία δεδομένων Plato

- Πλάτωνα δεδομένα

- θετικώς

- δυναμικού

- δύναμη

- δώρα

- πρόληψη

- Δώστε προτεραιότητα

- μυστικότητα

- υποσχόμενος

- πρωτόκολλα

- εγείρει

- σειρά

- ταχέως

- κανονισμοί

- ρυθμιστές

- Κανονιστική Συμμόρφωση

- βασίζονται

- λείψανα

- θυμάμαι

- αναπλάσσω

- σέβη

- υπεύθυνος

- αξιοπίστως

- δικαιώματα

- κανόνες

- επεκτάσιμη

- Κλίμακα

- κλίμακα αι

- Τομείς

- ασφάλεια

- Μέτρα ασφαλείας

- αυστηρός

- θα πρέπει να

- σημαντικός

- So

- Μ.Κ.Δ

- κοινωνικο

- Κοινωνία

- πρότυπα

- χώρος στο δίσκο

- τέτοιος

- επιτήρηση

- Βιωσιμότητα

- βιώσιμης

- συστήματα

- Τεχνολογίες

- Τεχνολογία

- από

- ότι

- Η

- τους

- Τους

- Εκεί.

- Αυτοί

- αυτοί

- αυτό

- αν και?

- απειλές

- προς την

- Συναλλαγές

- όντως

- Έμπιστος

- επάνω σε

- χρήση

- Χρήστες

- Αξίες

- διάφορα

- βιώσιμος

- ζωτικής σημασίας

- we

- καλά καθορισμένη

- πότε

- Ποιό

- ενώ

- με

- εντός

- κόσμος

- zephyrnet