![]()

In den letzten zwölf Monaten haben wir die Entwicklung einer großen Zahl neuer KI-Organisationen erlebt, die sich die neuesten Fortschritte bei Grundmodellen, Technologie und Nachfrage zunutze machen. Obwohl KI oft eher als „Co-Pilot“ denn als „Autopilot“ gesehen wird, kann sie im Vergleich zum klassischen Computing dennoch viele bemerkenswerte Leistungen vollbringen. Wir haben in letzter Zeit Startups gesehen, die unter anderem präzise Text-in-Gebärdensprache, mehrsprachige Transkription und automatische Sprachvideogenerierung mit realistischen Avataren anbieten können.

Allerdings stehen diese neuen Organisationen, wie alle Start-ups und Scale-ups, vor vielen Herausforderungen; Einige sind spezifisch für die KI-Branche, andere gelten für alle Wachstumsmarken. Aber mit dem richtigen Maß an Unterstützung können Gründer gedeihen und dazu beitragen, die Branche – und die Menschheit – voranzubringen.

Hohe Rechenleistung zum Training von KI-Modellen

Eine der größten Herausforderungen für KI-Organisationen ist die Schulung. Das Training von KI-Modellen erfordert eine erhebliche Menge an Rechenleistung, was für Deep-Tech-Unternehmen, die eher auf Opex- als auf Capex-Basis arbeiten, eine Herausforderung darstellen kann. Deep-Learning-Algorithmen wie neuronale Netze erfordern eine große Anzahl von Iterationen und Anpassungen, um optimale Ergebnisse zu erzielen. Ohne Zugriff auf leistungsstarke Rechenressourcen kann dies zeitaufwändig und kostspielig sein. Darüber hinaus müssen diese Daten irgendwo gespeichert werden, was in der Anschaffung zu kostspielig und in der Wartung teuer sein kann.

Flexibilität bei der Ressourcenzuweisung und dem Kostenmanagement

Der Ressourcenbedarf für das Training und den Einsatz von KI-Modellen kann je nach Komplexität des Modells und Größe des Datensatzes stark variieren. Wie bei den meisten Startups kann sich die Ausrichtung des Unternehmens fast über Nacht ändern und sowohl für die Mitarbeiter als auch für die Technologieinfrastruktur eine Herausforderung darstellen. Folglich sind die meisten KI-Startups standardmäßig Cloud-nativ, um den Umstieg auf neue Hardware zu erleichtern, wenn sich die Dinge in eine andere Richtung bewegen.

Abwärtskompatibilitätsprobleme

KI-Frameworks wie TensorFlow und PyTorch werden kontinuierlich aktualisiert und verbessert, einige dieser Framework-Iterationen waren jedoch nicht abwärtskompatibel mit früheren Versionen. Dies setzt Unternehmen erheblich unter Druck, mit dem neuesten Framework auf dem Laufenden zu bleiben, andernfalls riskieren sie Funktionsprobleme oder sogar Ausfallzeiten. Obwohl Benutzer häufig damit rechnen, dass Startups Startschwierigkeiten haben, können große Ausfallzeiten das Vertrauen dramatisch untergraben.

Wie haben bestehende, erfolgreiche KI-Startups angesichts dieser Probleme ihre Herausforderungen gemeistert?

KI in der Praxis: OVHcloud unterstützt die wesentlichen Funktionen von Customs Bridge

Customs Bridge ist ein „Deep-Tech“-Startup, das Algorithmen der künstlichen Intelligenz nutzt, um eine automatische Produktklassifizierungsmaschine für europäische Importeure zu entwickeln. Die Mission des Unternehmens besteht darin, eine möglichst zuverlässige Produktklassifizierungsmaschine zu entwickeln, um einem Produkt, dessen Beschreibung nicht vollständig formalisiert ist, den richtigen Zollcode zuzuweisen.

Allerdings stand Customs Bridge beim Training seiner KI-Modelle vor großen Herausforderungen. Sie hatten eine begrenzte Infrastruktur vor Ort, umfangreiche Datenverarbeitungsanforderungen und den Bedarf an hochmodernen KI-Frameworks. Ihre bestehende Infrastruktur reichte nicht aus, um ihre KI-Modelle effektiv zu trainieren und einzusetzen, und sie hatten Schwierigkeiten, auf große Datenmengen zuzugreifen und diese zu verarbeiten, die für das Training ihrer Modelle erforderlich waren.

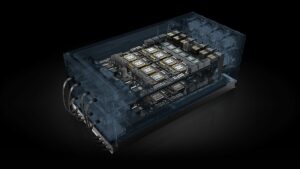

Um diese Herausforderungen zu meistern, wandte sich Customs Bridge an Die KI- und maschinellen Lernlösungen von OVHcloud. Das Team implementierte die Modellschulungslösung AI Training von OVHcloud und nutzte OVHcloud-Instanzen, um Modelle in der Produktion bereitzustellen und die Daten-Power-Pipeline zu unterstützen. Dadurch konnte Customs Bridge große Datenmengen verarbeiten, seine KI-Modelle verbessern und seine Gesamtproduktivität und Effizienz verbessern.

Customs Bridge konnte die Ressourcen von OVHcloud für die Datenverbesserung und das fortgeschrittene Training von KI-Modellen nutzen. Sie verließen sich beim Training ihrer ersten Transformers-Modelle auf rund 2.5 TB Daten, und das Training von Transformers auf 250,000 Leitungen dauerte dank der von OVHcloud bereitgestellten NVIDIA V30-GPUs nur etwa 100 Minuten Rechenzeit. Dies war sowohl schnell als auch kostengünstig und ermöglichte es Customs Bridge, sein Datenvolumen zu skalieren, ohne seine Infrastruktur einzuschränken. Der cloudbasierte Ansatz gab dem Unternehmen viel Freiheit zum Experimentieren, bis es das erforderliche Volumen gefunden hatte, um die gewünschte Präzision zu erreichen.

Neben der verbesserten Flexibilität und Skalierbarkeit für das Training von KI-Modellen profitierte Customs Bridge auch von einer kostengünstigen und effizienten Ressourcenzuweisung, einer vereinfachten Implementierung und Bereitstellung von KI-Frameworks sowie der Möglichkeit, Innovationen und Experimente für optimale Ergebnisse zu ermöglichen. Durch den Einsatz der KI- und maschinellen Lernlösungen von OVHcloud konnte Customs Bridge seine Herausforderungen meistern und eine innovative und effektive Produktklassifizierungsmaschine aufbauen.

Weiterentwicklung von Deep Tech mit spezialisierten Cloud-Diensten

Einer der ersten Schritte für ein wachsendes KI-Startup besteht darin, sein Ökosystem zu verstehen – und zwar nicht nur im Hinblick auf das Verständnis der Konkurrenz. Es gibt viele Organisationen, die Inkubatoren, Beschleuniger und Unterstützungsprogramme anbieten, die entweder direkt mit Mentoring und Managementunterstützung oder, wie im obigen Beispiel, mit der Unterstützung der Technologieinfrastruktur helfen können.

Cloud-Dienste bieten eine flexible Ressourcenzuteilung und Kostenverwaltung, sodass Deep-Tech-Unternehmen ihre Ressourcen anpassen können, wenn sich der Bedarf ändert. Diese Anpassungsfähigkeit garantiert, dass Unternehmen nur für die Ressourcen zahlen, die sie benötigen, wodurch sie ihre Ressourcen effizienter einsetzen und auf Opex- statt auf Capex-Basis arbeiten können.

Erweiterbare Speicherlösungen sind ebenfalls ein wichtiger Bestandteil des Cloud-Services-Modells. Mit diesen Lösungen können Deep-Tech-Unternehmen große Datenmengen verarbeiten und speichern und so ihre KI-Modelle trainieren. Diese Lösungen lassen sich leicht skalieren und stellen sicher, dass KI-Unternehmen ihr Datenvolumen ohne Betriebsunterbrechung erhöhen können – im Gegensatz zu physischem Speicher, bei dem die Installation und Verwaltung neuer Laufwerke eine Reihe von Problemen bereiten kann.

Wir treiben die Branche voran

Deep-Tech-KI-Unternehmen haben mit vielen der gleichen Probleme zu kämpfen wie Start-ups in anderen Branchen, aber auch mit einigen einzigartigen Herausforderungen. Die riesigen Datensätze, die zum Beispiel zum Trainieren von KI-Modellen erforderlich sind, gehen mit einem entsprechenden Bedarf an leistungsstarken Rechen- und Speicherkapazitäten einher, die für junge Organisationen, die über Startkapital verfügen, oft unerreichbar sind.

Aus diesem Grund sind viele KI-Unternehmen standardmäßig Cloud-nativ. Mit der Cloud können Organisationen wie diese einfacher skalieren, ohne im Voraus für die Infrastruktur bezahlen zu müssen, ganz zu schweigen davon, dass sie von verwalteten Lösungen profitieren, die den Gründern und ihren Teams die Notwendigkeit der täglichen Verwaltung ersparen. Allerdings müssen Startups beim Abschluss ihres Cloud-Services-Vertrags aufmerksam sein und darauf achten, sowohl steigende als auch versteckte Kosten zu vermeiden; Die falsche Einrichtung oder der falsche Anbieter – beispielsweise zu hohe Gebühren für Ingress-/Egress-Kosten – können zu einer technischen Belastung führen. Aber mit dem richtigen Partner, der richtigen Lösung und einem wirklich kollaborativen Ansatz können Startups die administrativen Details vergessen und sich stattdessen auf ihre Hauptaufgabe konzentrieren: die Schaffung einer neuen Welt der KI.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoAiStream. Web3-Datenintelligenz. Wissen verstärkt. Hier zugreifen.

- Die Zukunft prägen mit Adryenn Ashley. Hier zugreifen.

- Kaufen und verkaufen Sie Anteile an PRE-IPO-Unternehmen mit PREIPO®. Hier zugreifen.

- Quelle: https://dataconomy.com/2023/05/24/who-co-pilots-the-co-pilots-why-ai-needs-cloud-support/

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 250

- 30

- a

- Fähigkeit

- Fähig

- Über Uns

- oben

- Beschleuniger

- Zugang

- Zugriff

- erreichen

- genau

- Erreichen

- über

- Handlung

- Zusatz

- Anpassungen

- administrativ

- advanced

- Vorschüsse

- Vorteil

- Zustimmung

- AI

- KI & Maschinelles Lernen

- KI-Training

- gezielt

- Algorithmen

- Alle

- Zuteilung

- Zulassen

- erlaubt

- ebenfalls

- Obwohl

- Betrag

- Beträge

- an

- und

- jedem

- Ansatz

- SIND

- um

- künstlich

- künstliche Intelligenz

- AS

- Hilfe

- At

- Aufmerksamkeit

- automatische

- Avatare

- vermeiden

- Grundlage

- BE

- war

- Sein

- profitieren

- beide

- Marken

- BRIDGE

- bauen

- Last

- aber

- by

- CAN

- Fähigkeiten

- österreichische Unternehmen

- Häuser

- Verursachen

- Herausforderungen

- herausfordernd

- Übernehmen

- Einstufung

- Cloud

- Cloud-Services

- Code

- kollaborative

- wie die

- gemeinsam

- Unternehmen

- Unternehmen

- Unternehmen

- verglichen

- Kompatibilität

- kompatibel

- Wettbewerb

- Komplexität

- Rechenleistung

- Berechnen

- Computing

- Folglich

- Inhalt

- ständig

- und beseitigen Muskelschwäche

- Dazugehörigen

- Kosten

- Kostenmanagement

- kostengünstiger

- teuer werden

- Kosten

- erstellen

- erstellt

- Erstellen

- Zoll

- technische Daten

- Datenverarbeitung

- Datensatz

- Datensätze

- Datum

- Täglich, von Tag zu Tag

- tief

- tiefe Lernen

- Deep Tech

- Standard

- Demand

- Abhängig

- einsetzen

- Bereitstellen

- Einsatz

- Beschreibung

- Details

- entwickeln

- anders

- Schwierigkeiten

- Richtung

- Direkt

- do

- Ausfallzeit

- Dramatisch

- Antrieb

- leicht

- Ökosystem

- Effektiv

- effektiv

- Effizienz

- effizient

- effizient

- entweder

- befähigt

- ermöglichen

- Ende

- Motor

- zu steigern,

- Erweiterung

- Gewährleistung

- Äther (ETH)

- Europäische

- Sogar

- Beispiel

- vorhandenen

- erwarten

- teuer

- ERFAHRUNGEN

- Experiment

- Gesicht

- konfrontiert

- FAST

- wenige

- Firmen

- Vorname

- erste Schritte

- Flexibilität

- flexibel

- gedeihen

- Setzen Sie mit Achtsamkeit

- Aussichten für

- gefunden

- Gründer

- Unser Ansatz

- Gerüste

- Freiheit

- für

- voll

- Funktionalität

- Finanzierung

- Außerdem

- Generation

- GPUs

- sehr

- persönlichem Wachstum

- Wachstum

- Garantien

- hätten

- Hardware

- Haben

- Kopfschmerzen

- Hilfe

- Unternehmen

- versteckt

- Hohe Leistungsfähigkeit

- Ultraschall

- aber

- HTTPS

- Menschlichkeit

- Implementierung

- umgesetzt

- wichtig

- zu unterstützen,

- verbessert

- in

- Erhöhung

- Gründerzentren

- Branchen

- Energiegewinnung

- Infrastruktur

- Innovation

- innovativ

- Installation

- beantragen müssen

- Intelligenz

- in

- Probleme

- IT

- Iterationen

- SEINE

- jpg

- nur

- Behalten

- Sprache

- grosse

- großflächig

- Nachname

- neueste

- lernen

- Niveau

- Hebelwirkung

- Nutzung

- Gefällt mir

- Limitiert

- Linien

- Los

- kostengünstig

- Maschine

- Maschinelles Lernen

- Main

- halten

- verwaltet

- Management

- viele

- max-width

- Mentoring

- Geist / Bewusstsein

- Minuten

- Ziel

- Modell

- für

- ändern

- Monat

- mehr

- vor allem warme

- schlauer bewegen

- sollen

- Name

- Need

- erforderlich

- Bedürfnisse

- Netzwerke

- Neural

- Neuronale Netze

- Neu

- neue Hardware

- Anzahl

- Nvidia

- of

- bieten

- vorgenommen,

- on

- einzige

- betreiben

- optimal

- or

- Organisationen

- Andere

- Anders

- Gesamt-

- Überwinden

- über Nacht

- Teil

- Partner

- AUFMERKSAMKEIT

- zahlen

- Personen

- physikalisch

- Pipeline

- Drehpunkt

- Plato

- Datenintelligenz von Plato

- PlatoData

- möglich

- Werkzeuge

- Praxis

- Präzision

- Druck

- früher

- Probleme

- Prozessdefinierung

- Verarbeitung

- Produkt

- Produktion

- PRODUKTIVITÄT

- vorausgesetzt

- Versorger

- Kauf

- Versetzt

- Pytorch

- lieber

- erreichen

- realistisch

- kürzlich

- zuverlässig

- bemerkenswert

- entfernen

- erfordern

- falls angefordert

- Voraussetzungen:

- erfordert

- Ressourcen

- Downloads

- Folge

- Die Ergebnisse

- Recht

- Risiko

- Laufen

- gleich

- Skalierbarkeit

- Skalieren

- Scale-Ups

- Regelungen

- Samen

- Saatgutfinanzierung

- gesehen

- Lösungen

- kompensieren

- Einstellung

- signifikant

- vereinfachte

- Größe

- Lösung

- Lösungen

- einige

- irgendwo

- spezialisiert

- spezifisch

- Rede

- Anfang

- Anfang

- Startups

- State-of-the-art

- Shritte

- Immer noch

- Lagerung

- speichern

- gelagert

- erfolgreich

- so

- ausreichend

- Support

- Nehmen

- Einnahme

- Team

- Teams

- Tech

- Tech-Unternehmen

- Technologie

- Technologie-Infrastruktur

- Tensorfluss

- AGB

- als

- dank

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- Dort.

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- Zeit

- Zeitaufwendig

- zu

- nahm

- Training

- Ausbildung

- Transformer

- wirklich

- Vertrauen

- Turned

- verstehen

- Verständnis

- einzigartiges

- nicht wie

- bis

- aktualisiert

- Nutzer

- seit

- riesig

- Video

- Volumen

- Volumen

- wollte

- wurde

- we

- wann

- welche

- WHO

- deren

- warum

- mit

- ohne

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Falsch

- jung

- Zephyrnet