Bild vom Herausgeber

Große Sprachmodelle (LLMs) wie GPT-3 von OpenAI, BERT von Google und LLaMA von Meta revolutionieren verschiedene Sektoren mit ihrer Fähigkeit, ein breites Spektrum an Texten zu generieren – von Marketingtexten über Data-Science-Skripte bis hin zu Gedichten.

Auch wenn die intuitive Benutzeroberfläche von ChatGPT heutzutage auf den Geräten der meisten Menschen zu finden ist, gibt es immer noch ein riesiges ungenutztes Potenzial für den Einsatz von LLMs in verschiedenen Softwareintegrationen.

Das Hauptproblem?

Die meisten Anwendungen erfordern eine flüssigere und nativere Kommunikation mit LLMs.

Und genau hier setzt LangChain an!

Wenn Sie sich für generative KI und LLMs interessieren, ist dieses Tutorial genau das Richtige für Sie.

So lass uns anfangen!

Nur für den Fall, dass Sie in einer Höhle gelebt haben und in letzter Zeit keine Neuigkeiten erhalten haben, erkläre ich kurz Large Language Models oder LLMs.

Ein LLM ist ein hochentwickeltes künstliches Intelligenzsystem, das das menschenähnliche Verständnis und die Generierung von Texten nachahmt. Durch das Training an riesigen Datensätzen erkennen diese Modelle komplizierte Muster, erfassen sprachliche Feinheiten und erzeugen kohärente Ergebnisse.

Wenn Sie sich fragen, wie Sie mit diesen KI-gestützten Modellen interagieren können, gibt es zwei Möglichkeiten:

- Der gebräuchlichste und direkteste Weg ist das Gespräch oder Chatten mit dem Model. Dabei geht es darum, eine Eingabeaufforderung zu erstellen, diese an das KI-gestützte Modell zu senden und als Antwort eine textbasierte Ausgabe zu erhalten.

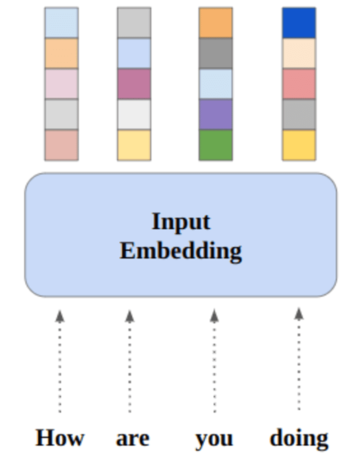

- Eine andere Methode ist die Umwandlung von Text in numerische Arrays. Bei diesem Prozess wird eine Eingabeaufforderung für die KI erstellt und im Gegenzug ein numerisches Array erhalten. Was allgemein als „Einbettung“ bekannt ist. Es hat in letzter Zeit einen Aufschwung bei Vektordatenbanken und der semantischen Suche erlebt.

Und genau diese beiden Hauptprobleme versucht LangChain anzugehen. Wenn Sie sich für die Hauptprobleme der Interaktion mit LLMs interessieren, können Sie diesen Artikel lesen hier.

LangChain ist ein Open-Source-Framework, das auf LLMs basiert. Es bietet ein Arsenal an Tools, Komponenten und Schnittstellen, die die Architektur von LLM-gesteuerten Anwendungen rationalisieren.

Mit LangChain wird die Auseinandersetzung mit Sprachmodellen, die Verknüpfung verschiedener Komponenten und die Einbindung von Ressourcen wie APIs und Datenbanken zum Kinderspiel. Dieses intuitive Framework vereinfacht die Entwicklung von LLM-Anwendungen erheblich.

Die Kernidee von Long Chain besteht darin, dass wir verschiedene Komponenten oder Module, auch Ketten genannt, miteinander verbinden können, um anspruchsvollere LLM-basierte Lösungen zu schaffen.

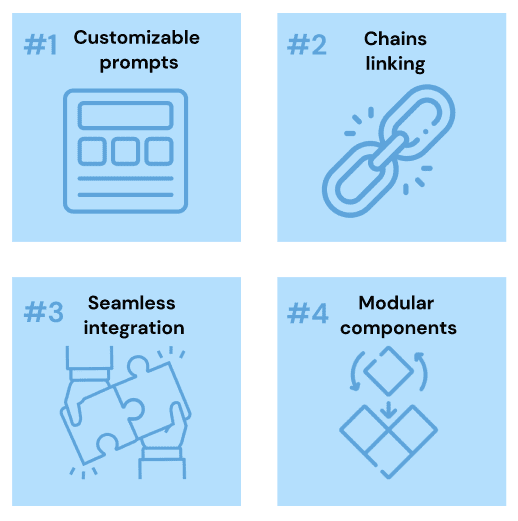

Hier sind einige herausragende Funktionen von LangChain:

- Anpassbare Eingabeaufforderungsvorlagen zur Standardisierung unserer Interaktionen.

- Kettengliedkomponenten, maßgeschneidert für anspruchsvolle Anwendungsfälle.

- Nahtlose Integration mit führenden Sprachmodellen, einschließlich der GPTs von OpenAI und denen auf HuggingFace Hub.

- Modulare Komponenten für einen Mix-and-Match-Ansatz zur Bewertung spezifischer Probleme oder Aufgaben.

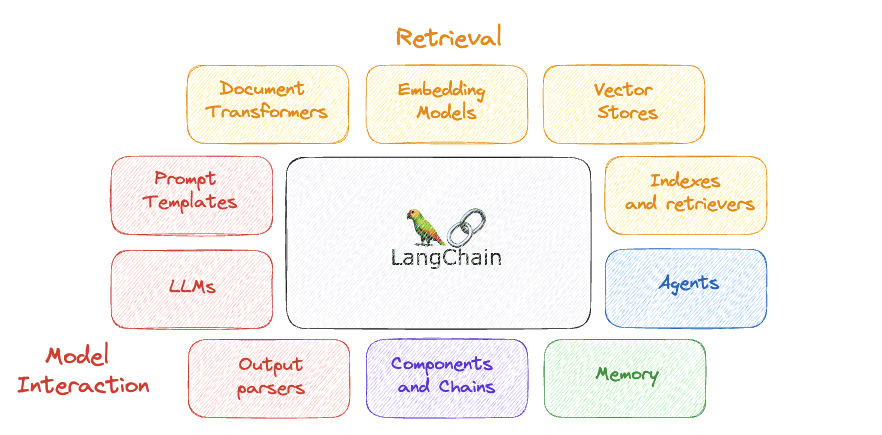

Bild vom Autor

LangChain zeichnet sich durch seinen Fokus auf Anpassungsfähigkeit und modularen Aufbau aus.

Die Hauptidee von LangChain besteht darin, die Verarbeitungssequenz natürlicher Sprache in einzelne Teile zu zerlegen, sodass Entwickler Arbeitsabläufe entsprechend ihren Anforderungen anpassen können.

Diese Vielseitigkeit macht LangChain zur ersten Wahl für die Entwicklung von KI-Lösungen in verschiedenen Situationen und Branchen.

Einige seiner wichtigsten Komponenten sind…

Bild vom Autor

1. LLMs

LLMs sind grundlegende Komponenten, die große Mengen an Trainingsdaten nutzen, um menschenähnliche Texte zu verstehen und zu generieren. Sie bilden den Kern vieler Vorgänge innerhalb von LangChain und stellen die notwendigen Sprachverarbeitungsfunktionen bereit, um Texteingaben zu analysieren, zu interpretieren und darauf zu reagieren.

Verwendung: Betrieb von Chatbots, Generierung menschenähnlicher Texte für verschiedene Anwendungen, Unterstützung beim Informationsabruf und Durchführung anderer Sprachverarbeitungen

2. Eingabeaufforderungsvorlagen

Eingabeaufforderungen sind für die Interaktion mit LLM von grundlegender Bedeutung und bei der Arbeit an bestimmten Aufgaben ist ihre Struktur in der Regel ähnlich. Eingabeaufforderungsvorlagen, bei denen es sich um voreingestellte Eingabeaufforderungen handelt, die kettenübergreifend verwendet werden können, ermöglichen die Standardisierung von „Eingabeaufforderungen“ durch Hinzufügen spezifischer Werte. Dies erhöht die Anpassungsfähigkeit und Individualisierung jedes LLM.

Verwendung: Standardisierung des Prozesses der Interaktion mit LLMs.

3. Ausgabeparser

Ausgabeparser sind Komponenten, die die Rohausgabe einer vorhergehenden Stufe in der Kette übernehmen und in ein strukturiertes Format konvertieren. Diese strukturierten Daten können dann in nachfolgenden Phasen effektiver genutzt oder als Antwort an den Endbenutzer bereitgestellt werden.

Verwendung: In einem Chatbot könnte beispielsweise ein Ausgabeparser die Rohtextantwort aus einem Sprachmodell übernehmen, wichtige Informationen extrahieren und sie in eine strukturierte Antwort formatieren.

4. Komponenten und Ketten

In LangChain fungiert jede Komponente als Modul, das für eine bestimmte Aufgabe in der Sprachverarbeitungssequenz verantwortlich ist. Diese Komponenten können zu Form verbunden werden Ketten für individuelle Arbeitsabläufe.

Verwendung: Generieren von Stimmungserkennungs- und Antwortgeneratorketten in einem bestimmten Chatbot.

5. Erinnerung

Speicher bezieht sich in LangChain auf eine Komponente, die einen Speicher- und Abrufmechanismus für Informationen innerhalb eines Workflows bereitstellt. Diese Komponente ermöglicht die temporäre oder dauerhafte Speicherung von Daten, auf die während der Interaktion mit dem LLM von anderen Komponenten zugegriffen und diese manipuliert werden können.

Verwendung: Dies ist in Szenarien nützlich, in denen Daten über verschiedene Verarbeitungsstufen hinweg aufbewahrt werden müssen, beispielsweise beim Speichern des Gesprächsverlaufs in einem Chatbot, um kontextbezogene Antworten bereitzustellen.

6. Agenten

Agenten sind autonome Komponenten, die auf der Grundlage der von ihnen verarbeiteten Daten Maßnahmen ergreifen können. Sie können mit anderen Komponenten, externen Systemen oder Benutzern interagieren, um bestimmte Aufgaben innerhalb eines LangChain-Workflows auszuführen.

Verwendung: Beispielsweise könnte ein Agent Benutzerinteraktionen abwickeln, eingehende Anfragen verarbeiten und den Datenfluss durch die Kette koordinieren, um entsprechende Antworten zu generieren.

7. Indizes und Retriever

Indizes und Retriever spielen eine entscheidende Rolle bei der effizienten Verwaltung und beim Zugriff auf Daten. Indizes sind Datenstrukturen, die Informationen und Metadaten aus den Trainingsdaten des Modells enthalten. Andererseits sind Retriever Mechanismen, die mit diesen Indizes interagieren, um relevante Daten basierend auf bestimmten Kriterien abzurufen und es dem Modell zu ermöglichen, durch die Bereitstellung relevanten Kontexts besser zu antworten.

Verwendung: Sie tragen dazu bei, schnell relevante Daten oder Dokumente aus einem großen Datensatz abzurufen, was für Aufgaben wie den Informationsabruf oder die Beantwortung von Fragen unerlässlich ist.

8. Dokumenttransformatoren

In LangChain sind Document Transformers spezielle Komponenten, die darauf ausgelegt sind, Dokumente so zu verarbeiten und umzuwandeln, dass sie für die weitere Analyse oder Verarbeitung geeignet sind. Diese Transformationen können Aufgaben wie Textnormalisierung, Merkmalsextraktion oder die Konvertierung von Text in ein anderes Format umfassen.

Verwendung: Vorbereiten von Textdaten für nachfolgende Verarbeitungsschritte, wie z. B. die Analyse durch maschinelle Lernmodelle oder die Indizierung für einen effizienten Abruf.

9. Modelle einbetten

Sie werden verwendet, um Textdaten in einem hochdimensionalen Raum in numerische Vektoren umzuwandeln. Diese Modelle erfassen semantische Beziehungen zwischen Wörtern und Phrasen und ermöglichen so eine maschinenlesbare Darstellung. Sie bilden die Grundlage für verschiedene nachgelagerte NLP-Aufgaben (Natural Language Processing) innerhalb des LangChain-Ökosystems.

Verwendung: Erleichterung semantischer Suchen, Ähnlichkeitsvergleiche und anderer maschineller Lernaufgaben durch Bereitstellung einer numerischen Darstellung von Text.

10. Vector-Stores

Art von Datenbanksystem, das auf die Speicherung und Suche von Informationen über Einbettungen spezialisiert ist und im Wesentlichen numerische Darstellungen textähnlicher Daten analysiert. VectorStore dient als Speicher für diese Einbettungen.

Verwendung: Ermöglicht eine effiziente Suche basierend auf semantischer Ähnlichkeit.

Installation mit PIP

Als Erstes müssen wir sicherstellen, dass LangChain in unserer Umgebung installiert ist.

pip install langchain

Umgebung einrichten

Die Nutzung von LangChain bedeutet in der Regel die Integration verschiedener Modellanbieter, Datenspeicher, APIs und anderer Komponenten. Und wie Sie bereits wissen, ist wie bei jeder Integration die Bereitstellung der relevanten und korrekten API-Schlüssel für den Betrieb von LangChain von entscheidender Bedeutung.

Stellen Sie sich vor, wir möchten unsere OpenAI-API verwenden. Wir können dies leicht auf zwei Arten erreichen:

- Schlüssel als Umgebungsvariable einrichten

OPENAI_API_KEY="..."

or

import os

os.environ['OPENAI_API_KEY'] = “...”

Wenn Sie keine Umgebungsvariable einrichten möchten, haben Sie die Möglichkeit, den Schlüssel direkt über den benannten Parameter openai_api_key bereitzustellen, wenn Sie die OpenAI-LLM-Klasse initiieren:

- Richten Sie den Schlüssel direkt in der entsprechenden Klasse ein.

from langchain.llms import OpenAI

llm = OpenAI(openai_api_key="...")Der Wechsel zwischen LLMs wird unkompliziert

LangChain bietet eine LLM-Klasse, die es uns ermöglicht, mit verschiedenen Sprachmodellanbietern wie OpenAI und Hugging Face zu interagieren.

Der Einstieg in jedes LLM ist recht einfach, da die grundlegendste und am einfachsten zu implementierende Funktionalität eines LLM lediglich die Textgenerierung ist.

Allerdings ist es nicht so einfach, die gleiche Eingabeaufforderung gleichzeitig an verschiedene LLMs zu senden.

Hier setzt LangChain an …

Um auf die einfachste Funktionalität aller LLMs zurückzukommen: Wir können mit LangChain ganz einfach eine Anwendung erstellen, die eine Zeichenfolgenaufforderung erhält und die Ausgabe unseres festgelegten LLM zurückgibt.

Code nach Autor

Wir können einfach dieselbe Eingabeaufforderung verwenden und innerhalb weniger Codezeilen die Antwort von zwei verschiedenen Modellen erhalten!

Code nach Autor

Beeindruckend... oder?

Strukturieren Sie unsere Eingabeaufforderungen mit Eingabeaufforderungsvorlagen

Ein häufiges Problem bei Sprachmodellen (LLMs) ist ihre Unfähigkeit, komplexe Anwendungen zu eskalieren. LangChain begegnet diesem Problem, indem es eine Lösung zur Rationalisierung des Prozesses zur Erstellung von Eingabeaufforderungen bietet, der oft komplizierter ist als nur die Definition einer Aufgabe, da er die Darstellung der Persona der KI und die Gewährleistung sachlicher Genauigkeit erfordert. Ein wesentlicher Teil davon besteht aus sich wiederholenden Textbausteinen. LangChain mildert dieses Problem, indem es Eingabeaufforderungsvorlagen anbietet, die automatisch Textbausteine in neue Eingabeaufforderungen einschließen und so die Erstellung von Eingabeaufforderungen vereinfachen und die Konsistenz über verschiedene Aufgaben hinweg sicherstellen.

Code nach Autor

Erhalten Sie strukturierte Antworten mit Ausgabeparsern

Bei chatbasierten Interaktionen besteht die Ausgabe des Modells lediglich aus Text. Bei Softwareanwendungen ist jedoch eine strukturierte Ausgabe vorzuziehen, da sie weitere Programmieraktionen ermöglicht. Wenn Sie beispielsweise einen Datensatz generieren, ist es erwünscht, die Antwort in einem bestimmten Format wie CSV oder JSON zu erhalten. Vorausgesetzt, dass eine Eingabeaufforderung so gestaltet werden kann, dass sie eine konsistente und entsprechend formatierte Antwort von der KI hervorruft, sind Tools zur Verwaltung dieser Ausgabe erforderlich. LangChain erfüllt diese Anforderung, indem es Ausgabeparser-Tools anbietet, um die strukturierte Ausgabe effektiv zu verarbeiten und zu nutzen.

Code nach Autor

Sie können den gesamten Code auf meinem überprüfen GitHub.

Vor nicht allzu langer Zeit haben uns die erweiterten Funktionen von ChatGPT in Erstaunen versetzt. Doch das technologische Umfeld verändert sich ständig und jetzt stehen uns Tools wie LangChain zur Verfügung, die es uns ermöglichen, in nur wenigen Stunden herausragende Prototypen von unseren PCs aus zu erstellen.

LangChain, eine frei verfügbare Python-Plattform, bietet Benutzern die Möglichkeit, Anwendungen zu entwickeln, die auf LLMs (Language Model Models) basieren. Diese Plattform bietet eine flexible Schnittstelle zu einer Vielzahl grundlegender Modelle, optimiert die Bearbeitung von Eingabeaufforderungen und fungiert ab der aktuellen Dokumentation als Verknüpfung für Elemente wie Eingabeaufforderungsvorlagen, weitere LLMs, externe Informationen und andere Ressourcen über Agenten.

Stellen Sie sich Chatbots, digitale Assistenten, Sprachübersetzungstools und Dienstprogramme zur Stimmungsanalyse vor. Alle diese LLM-fähigen Anwendungen werden mit LangChain zum Leben erweckt. Entwickler nutzen diese Plattform, um maßgeschneiderte Sprachmodelllösungen zu entwickeln, die unterschiedliche Anforderungen erfüllen.

Während sich der Horizont der Verarbeitung natürlicher Sprache erweitert und ihre Akzeptanz vertieft, scheint der Bereich ihrer Anwendungen grenzenlos zu sein.

Josef Ferrer ist Analytikingenieur aus Barcelona. Er hat einen Abschluss in Physikingenieurwesen und arbeitet derzeit im Bereich Data Science für die menschliche Mobilität. Er ist ein Teilzeit-Content-Creator, der sich auf Data Science und Technologie konzentriert. Sie können ihn unter kontaktieren LinkedIn, Twitter or Medium.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://www.kdnuggets.com/how-to-make-large-language-models-play-nice-with-your-software-using-langchain?utm_source=rss&utm_medium=rss&utm_campaign=how-to-make-large-language-models-play-nice-with-your-software-using-langchain

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 7

- a

- Fähigkeit

- Zugriff

- Zugriff

- erreichen

- Genauigkeit

- über

- Schauspielkunst

- Aktionen

- Handlungen

- Hinzufügen

- Adresse

- Adressen

- Adressierung

- Adoption

- advanced

- Makler

- Agenten

- vor

- AI

- AI-powered

- Alle

- erlauben

- Zulassen

- erlaubt

- bereits

- ebenfalls

- unter

- Beträge

- an

- Analyse

- Analytik

- analysieren

- Analyse

- verankerten

- und

- jedem

- Bienen

- APIs

- Anwendung

- Anwendungsentwicklung

- Anwendungen

- angewandt

- Ansatz

- angemessen

- Architektur

- SIND

- um

- Feld

- Arsenal

- Artikel

- künstlich

- künstliche Intelligenz

- AS

- fragen

- beurteilen

- Details

- Assistenten

- At

- Autonom

- verfügbar

- SCHEU

- Zurück

- Barcelona

- basierend

- basic

- BE

- werden

- wird

- war

- hinter

- Besser

- zwischen

- Grenzenlos

- Bruch

- kurz

- Brings

- bauen

- Building

- erbaut

- by

- CAN

- Fähigkeiten

- fähig

- Erfassung

- Häuser

- Fälle

- Kümmert sich

- Höhle

- Kette

- Ketten

- Chatbot

- Chatbots

- ChatGPT

- Chat

- aus der Ferne überprüfen

- Wahl

- Auswählen

- Klasse

- Code

- KOHÄRENT

- wie die

- gemeinsam

- häufig

- Kommunikation

- Vergleiche

- Komplex

- Komponente

- Komponenten

- Computer

- Vernetz Dich

- Sie

- konsistent

- Kontakt

- Inhalt

- Kontext

- Gespräch

- Umwandlung (Conversion)

- verkaufen

- Umwandlung

- Koordinate

- Kernbereich

- und beseitigen Muskelschwäche

- Handwerk

- Gefertigt

- erstellen

- Erstellen

- Schaffung

- Schöpfer

- Kriterien

- wichtig

- Strom

- Zur Zeit

- Anpassung

- anpassen

- maßgeschneiderte

- technische Daten

- Datenwissenschaft

- Datensätze

- Datenbase

- Datenbanken

- vertieft

- Definition

- geliefert

- liefert

- Design

- bezeichnet

- entworfen

- erwünscht

- Entdeckung

- entwickeln

- Entwickler

- Entwicklung

- Geräte

- anders

- digital

- Direkt

- Direkt

- erkennen

- deutlich

- Distinguished

- verschieden

- do

- Dokument

- Dokumentation

- Unterlagen

- nach unten

- im

- jeder

- einfachste

- leicht

- Einfache

- Ökosystem

- effektiv

- effizient

- effizient

- Elemente

- Einbettung

- ermöglichen

- Ende

- Eingriff

- Ingenieur

- Entwicklung

- Verbessert

- enorm

- Gewährleistung

- Arbeitsumfeld

- eskalieren

- essential

- im Wesentlichen

- etablieren

- Äther (ETH)

- ständig wechselnd

- Beispiel

- dehnt sich aus

- erfahrensten

- Erklären

- extern

- Extrakt

- Extraktion

- Gesicht

- Einrichtung

- Sachliche

- Merkmal

- Eigenschaften

- wenige

- Feld

- Fingerspitzen

- Vorname

- flexibel

- Fluss

- Flüssigkeit

- Setzen Sie mit Achtsamkeit

- konzentriert

- Aussichten für

- unten stehende Formular

- Format

- Foundation

- Grundlegender

- Unser Ansatz

- frei

- für

- Funktionalität

- fundamental

- weiter

- erzeugen

- Erzeugung

- Generation

- generativ

- Generative KI

- Generator

- bekommen

- bekommen

- Go

- Griff

- Pflege

- Griff

- Handling

- Haben

- mit

- he

- ihm

- Geschichte

- Halten

- Horizont

- STUNDEN

- Ultraschall

- Hilfe

- HTTPS

- Nabe

- Umarmendes Gesicht

- human

- KRANK

- Idee

- if

- importieren

- wichtig

- in

- Unfähigkeit

- das

- Einschließlich

- Eingehende

- einarbeiten

- Indizes

- Krankengymnastik

- Branchen

- Information

- Einleiten

- Varianten des Eingangssignals:

- installieren

- Instanz

- instrumental

- Integration

- Integration

- Integrationen

- Intelligenz

- interagieren

- Interaktion

- Interaktion

- Interaktionen

- interessiert

- Schnittstelle

- Schnittstellen

- Verkettung

- in

- kompliziert

- intuitiv

- beinhaltet

- Problem

- IT

- SEINE

- Reise

- JSON

- nur

- KDnuggets

- Wesentliche

- Tasten

- Kicks

- Wissen

- bekannt

- Landschaft

- Sprache

- grosse

- führenden

- lernen

- links

- Hebelwirkung

- Lebensdauer

- Gefällt mir

- Linien

- LINK

- Leben

- Lama

- Lang

- Maschine

- Maschinelles Lernen

- Main

- um

- MACHT

- verwalten

- verwaltet

- flächendeckende Gesundheitsprogramme

- manipuliert

- viele

- Marketing

- Kann..

- Mittel

- Mechanismus

- Mechanismen

- nur

- Metadaten

- Methode

- könnte

- Mobilität

- Modell

- für

- modulare

- Modulen

- Module

- mehr

- vor allem warme

- my

- Namens

- nativen

- Natürliche

- Natürliche Sprache

- Verarbeitung natürlicher Sprache

- notwendig,

- Need

- Bedürfnisse

- Neu

- News

- Verknüpfung

- schön

- Nlp

- jetzt an

- of

- bieten

- vorgenommen,

- on

- einmal

- Open-Source-

- OpenAI

- Betrieb

- Einkauf & Prozesse

- Option

- or

- OS

- Andere

- UNSERE

- Skizzierung

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- hervorragend

- Parameter

- Teil

- besondere

- Teile

- Muster

- Personen

- ausführen

- Durchführung

- persönliche

- Persönliche Computer

- Sätze

- Physik

- Stücke

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- Poesie

- für einige Positionen

- Potenzial

- genau

- bevorzugt

- Prime

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- Verarbeitung

- produziert

- Programmierung

- Eingabeaufforderungen

- Prototypen

- die

- Anbieter

- bietet

- Bereitstellung

- Python

- Frage

- schnell

- ganz

- Roh

- Reich

- Empfang

- kürzlich

- bezieht sich

- Beziehungen

- relevant

- repetitiv

- antworten

- Darstellung

- Zugriffe

- erfordern

- Anforderung

- Voraussetzungen:

- erfordert

- Downloads

- Reagieren

- Antwort

- Antworten

- für ihren Verlust verantwortlich.

- behielt

- Rückkehr

- Rückgabe

- Revolutionierung

- Recht

- Rollen

- s

- gleich

- Szenarien

- Wissenschaft

- Wissenschaft und Technologie

- Skripte

- Suche

- Suchbegriffe

- Sektoren

- scheint

- Sendung

- Gefühl

- Reihenfolge

- dient

- kompensieren

- Sets

- Einstellung

- signifikant

- ähnlich

- Vereinfacht

- Vereinfachung

- einfach

- Umstände

- So

- Software

- Lösung

- Lösungen

- einige

- anspruchsvoll

- Raumfahrt

- spezialisiert

- spezialisiert

- spezifisch

- angegeben

- Stufe

- Stufen

- Standardisierung

- begonnen

- Immer noch

- Lagerung

- speichern

- Läden

- rationalisieren

- Rationalisierung

- Schnur

- Struktur

- strukturierte

- Strukturen

- Folge

- im Wesentlichen

- so

- geeignet

- Zuführung

- sicher

- Schwall

- System

- Systeme und Techniken

- Tabelle

- zugeschnitten

- Nehmen

- Einnahme

- sprechen

- Aufgabe

- und Aufgaben

- technologische

- Technologie

- Vorlagen

- vorübergehend

- neigt dazu

- Text

- textuell

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- Diese

- vom Nutzer definierten

- Ding

- fehlen uns die Worte.

- diejenigen

- obwohl?

- Durch

- So

- zu

- heute

- gemeinsam

- Werkzeuge

- Ausbildung

- Transformieren

- Transformationen

- Transformer

- Übersetzungen

- Lernprogramm

- XNUMX

- typisch

- verstehen

- Verständnis

- ungenutzt

- us

- verwendbar

- -

- benutzt

- Mitglied

- Nutzer

- Verwendung von

- Dienstprogramme

- Nutzen

- Werte

- Variable

- Vielfalt

- verschiedene

- riesig

- Vielseitigkeit

- sehr

- wollen

- Weg..

- Wege

- we

- Was

- Was ist

- wann

- welche

- ganze

- breit

- mit

- .

- Wunder

- Worte

- Arbeitsablauf.

- Workflows

- arbeiten,

- noch

- U

- Ihr

- Zephyrnet