Einleitung

Selbstfahrende Autos und Flugzeuge sind nicht mehr die Zukunft. Allein in der Stadt San Francisco haben zwei Taxiunternehmen bis August 8 insgesamt 2023 Millionen Meilen autonomes Fahren zurückgelegt. Und in den Vereinigten Staaten sind mehr als 850,000 autonome Luftfahrzeuge oder Drohnen registriert – die Fahrzeuge des Militärs nicht mitgerechnet.

Es gibt jedoch berechtigte Bedenken hinsichtlich der Sicherheit. Beispielsweise in einem Zeitraum von 10 Monaten, der im Mai 2022 endete, die National Highway Traffic Safety Administration berichtet Fast 400 Unfälle, an denen Autos beteiligt waren, die irgendeine Form der autonomen Steuerung nutzten. Bei diesen Unfällen kamen sechs Menschen ums Leben, fünf wurden schwer verletzt.

Der übliche Weg, dieses Problem anzugehen – manchmal auch „Testen durch Erschöpfung“ genannt – besteht darin, diese Systeme zu testen, bis Sie überzeugt sind, dass sie sicher sind. Sie können jedoch nie sicher sein, dass dieser Prozess alle potenziellen Mängel aufdeckt. „Die Leute führen Tests durch, bis ihre Ressourcen und Geduld erschöpft sind“, sagte er Sajan Mitra, Informatiker an der University of Illinois, Urbana-Champaign. Tests allein können jedoch keine Garantien bieten.

Mitra und seine Kollegen können. Seinem Team ist es gelungen beweisen Sicherheit von Spurverfolgungsfunktionen für Autos und Landesysteme für autonome Flugzeuge. Ihre Strategie wird nun genutzt, um die Landung von Drohnen auf Flugzeugträgern zu unterstützen, und Boeing plant, sie in diesem Jahr an einem Versuchsflugzeug zu testen. „Ihre Methode, durchgängige Sicherheitsgarantien zu bieten, ist sehr wichtig“, sagte er Corina Pasareanu, ein Forschungswissenschaftler an der Carnegie Mellon University und dem Ames Research Center der NASA.

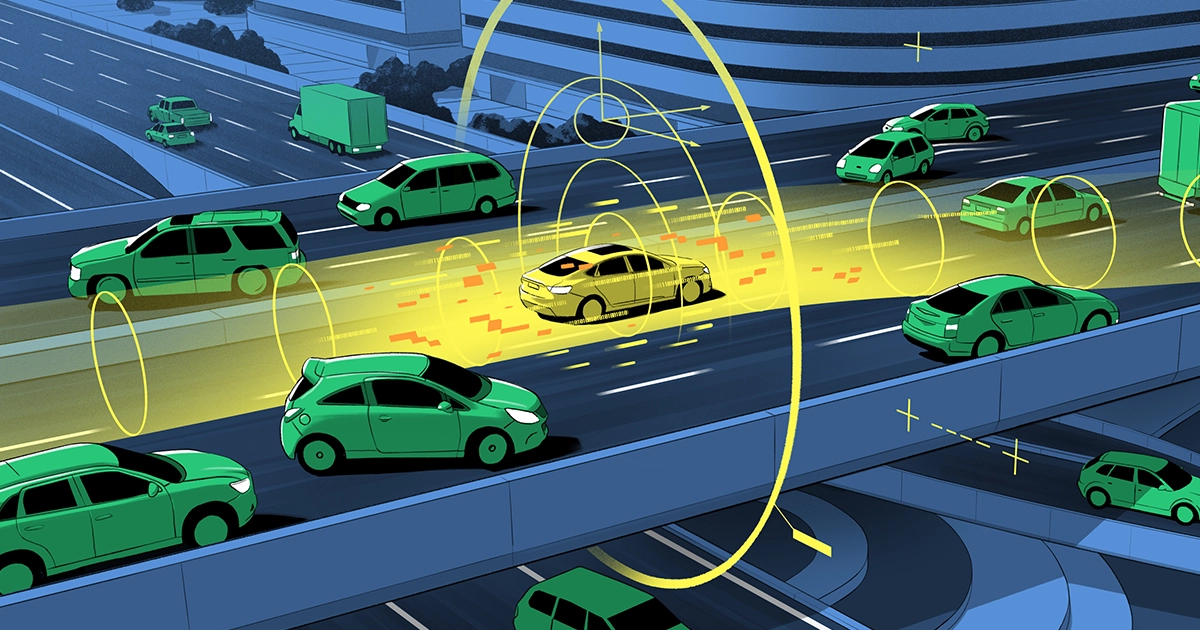

Ihre Aufgabe besteht darin, die Ergebnisse der maschinellen Lernalgorithmen zu garantieren, die zur Information autonomer Fahrzeuge eingesetzt werden. Auf hoher Ebene bestehen viele autonome Fahrzeuge aus zwei Komponenten: einem Wahrnehmungssystem und einem Steuerungssystem. Das Wahrnehmungssystem sagt Ihnen beispielsweise, wie weit Ihr Auto von der Mitte der Fahrspur entfernt ist oder in welche Richtung ein Flugzeug fliegt und welchen Winkel es zum Horizont hat. Das System funktioniert, indem es Rohdaten von Kameras und anderen sensorischen Werkzeugen an maschinelle Lernalgorithmen weiterleitet, die auf neuronalen Netzen basieren und die Umgebung außerhalb des Fahrzeugs nachbilden.

Diese Bewertungen werden dann an ein separates System, das Kontrollmodul, gesendet, das entscheidet, was zu tun ist. Steht beispielsweise ein Hindernis bevor, entscheidet es, ob es bremst oder umfährt. Entsprechend Luca Carlone, ein außerordentlicher Professor am Massachusetts Institute of Technology, erklärt, dass das Steuerungsmodul zwar auf bewährter Technologie basiert, „aber es trifft Entscheidungen auf der Grundlage der Wahrnehmungsergebnisse, und es gibt keine Garantie dafür, dass diese Ergebnisse korrekt sind.“

Um eine Sicherheitsgarantie zu bieten, arbeitete Mitras Team daran, die Zuverlässigkeit des Wahrnehmungssystems des Fahrzeugs sicherzustellen. Sie gingen zunächst davon aus, dass Sicherheit gewährleistet werden kann, wenn eine perfekte Abbildung der Außenwelt vorliegt. Anschließend ermittelten sie, wie viel Fehler das Wahrnehmungssystem bei der Nachbildung der Fahrzeugumgebung verursacht.

Der Schlüssel zu dieser Strategie besteht darin, die damit verbundenen Unsicherheiten zu quantifizieren, die als Fehlerband bezeichnet werden – oder die „bekannten Unbekannten“, wie Mitra es ausdrückte. Diese Berechnung basiert auf dem, was er und sein Team einen Wahrnehmungsvertrag nennen. In der Softwareentwicklung ist ein Vertrag eine Verpflichtung, dass für eine bestimmte Eingabe in ein Computerprogramm die Ausgabe innerhalb eines bestimmten Bereichs liegt. Es ist nicht einfach, diesen Bereich herauszufinden. Wie genau sind die Sensoren des Autos? Wie viel Nebel, Regen oder Blendung verträgt eine Drohne? Aber wenn Sie das Fahrzeug innerhalb eines bestimmten Unsicherheitsbereichs halten können und die Bestimmung dieses Bereichs ausreichend genau ist, hat Mitras Team bewiesen, dass Sie seine Sicherheit gewährleisten können.

Einleitung

Für jeden mit einem ungenauen Tacho ist das eine vertraute Situation. Wenn Sie wissen, dass das Gerät nie mehr als 5 Meilen pro Stunde abweicht, können Sie Geschwindigkeitsüberschreitungen dennoch vermeiden, indem Sie immer 5 Meilen pro Stunde unter der Geschwindigkeitsbegrenzung bleiben (wie von Ihrem nicht vertrauenswürdigen Tacho angezeigt). Ein Wahrnehmungsvertrag bietet eine ähnliche Garantie für die Sicherheit eines unvollständigen Systems, das auf maschinellem Lernen basiert.

„Man braucht keine perfekte Wahrnehmung“, sagte Carlone. „Man möchte nur, dass es gut genug ist, um die Sicherheit nicht zu gefährden.“ Die größten Beiträge des Teams seien, sagte er, „die Einführung der gesamten Idee von Wahrnehmungsverträgen“ und die Bereitstellung der Methoden zu deren Konstruktion. Dazu griffen sie auf Techniken aus dem Zweig der Informatik zurück, die als formale Verifikation bezeichnet werden und eine mathematische Methode zur Bestätigung bieten, dass das Verhalten eines Systems eine Reihe von Anforderungen erfüllt.

„Auch wenn wir nicht genau wissen, wie das neuronale Netzwerk tut, was es tut“, sagte Mitra, zeigten sie, dass es immer noch möglich ist, numerisch zu beweisen, dass die Unsicherheit der Ausgabe eines neuronalen Netzwerks innerhalb bestimmter Grenzen liegt. Und wenn das der Fall ist, dann ist das System sicher. „Wir können dann eine statistische Garantie dafür liefern, ob (und in welchem Ausmaß) ein bestimmtes neuronales Netzwerk diese Grenzen tatsächlich einhält.“

Das Luft- und Raumfahrtunternehmen Sierra Nevada testet diese Sicherheitsgarantien derzeit bei der Landung einer Drohne auf einem Flugzeugträger. Aufgrund der zusätzlichen Dimension, die das Fliegen mit sich bringt, ist dieses Problem in mancher Hinsicht komplizierter als das Autofahren. „Bei der Landung gibt es zwei Hauptaufgaben“, sagte er Dragos Margineantu, KI-Cheftechnologe bei Boeing, „richtet das Flugzeug auf die Landebahn aus und stellt sicher, dass die Landebahn frei von Hindernissen ist.“ Bei unserer Zusammenarbeit mit Sayan geht es darum, Garantien für diese beiden Funktionen zu erhalten.“

„Simulationen mit Sayans Algorithmus zeigen, dass sich die Ausrichtung [eines Flugzeugs vor der Landung] tatsächlich verbessert“, sagte er. Der nächste Schritt, der für später in diesem Jahr geplant ist, besteht darin, diese Systeme bei der tatsächlichen Landung eines Boeing-Versuchsflugzeugs einzusetzen. Eine der größten Herausforderungen, so Margineantu, werde darin bestehen, herauszufinden, was wir nicht wissen – „die Unsicherheit in unseren Schätzungen zu bestimmen“ – und zu sehen, wie sich das auf die Sicherheit auswirkt. „Die meisten Fehler passieren, wenn wir Dinge tun, von denen wir glauben, dass wir sie wissen – und es stellt sich heraus, dass wir das nicht tun.“

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://www.quantamagazine.org/how-to-guarantee-the-safety-of-autonomous-vehicles-20240116/

- :hast

- :Ist

- :nicht

- ][P

- 000

- 2022

- 2023

- 400

- 8

- a

- Über Uns

- Unfälle

- Nach

- genau

- ACM

- berührt das Schneidwerkzeug

- Adressierung

- Verwaltung

- Luft- und Raumfahrt

- AI

- Flugzeug

- Flugzeug

- Algorithmus

- Algorithmen

- Ausrichtung

- Alle

- allein

- immer

- an

- und

- jemand

- Bewerbung

- SIND

- um

- AS

- Einschätzungen

- Partnerschaftsräte

- angenommen

- At

- AUGUST

- Automobile

- Autonom

- autonome Fahrzeuge

- verfügbar

- vermeiden

- BAND

- basierend

- BE

- weil

- Verhalten

- Sein

- unten

- Größte

- Boeing

- Beschränkt

- Filiale

- aber

- by

- Berechnung

- rufen Sie uns an!

- namens

- Kameras

- CAN

- kann keine

- Fähigkeiten

- Auto

- Carnegie Mellon

- Carnegie Mellon Universität

- Träger

- tragen

- Autos

- Häuser

- Center

- sicher

- Herausforderungen

- Chef

- Stadt

- CMU

- Kopien

- gemeinsam

- kommt

- Engagement

- Unternehmen

- Unternehmen

- kompliziert

- Komponenten

- Computer

- Computerwissenschaften

- Bedenken

- Bau

- Vertrag

- Beiträge

- Smartgeräte App

- und beseitigen Muskelschwäche

- Zählen

- Zur Zeit

- technische Daten

- Entscheidungen

- Grad

- hängt

- Bestimmung

- entschlossen

- Gerät

- DID

- gestorben

- Abmessungen

- Richtung

- do

- die

- Nicht

- Zeichnung

- Fahren

- Drohne

- Drohnen

- Einfache

- End-to-End

- beendet

- Entwicklung

- genug

- gewährleisten

- Gewährleistung

- Ganz

- Arbeitsumfeld

- Fehler

- Fehler

- genau

- Beispiel

- experimentell

- extra

- Fallen

- vertraut

- weit

- Fütterung

- Vorname

- fünf

- Mängel

- Fliegen

- Nebel

- Aussichten für

- unten stehende Formular

- formal

- Francisco cisco~~POS=HEADCOMP

- Frei

- für

- Funktionen

- Zukunft

- bekommen

- gegeben

- gut

- Garantie

- Garantien

- passieren

- Haben

- he

- Überschrift

- Hilfe

- GUTE

- Autobahn

- seine

- Horizont

- Stunde

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- Idee

- IEEE

- if

- Illinois

- wichtig

- zu unterstützen,

- in

- angegeben

- informieren

- Varianten des Eingangssignals:

- Instanz

- Institut

- in

- Stellt vor

- beteiligt

- beinhaltet

- Beteiligung

- Problem

- IT

- SEINE

- nur

- Behalten

- Wesentliche

- Wissen

- bekannt

- Land

- Landung

- Spur

- später

- lernen

- legitim

- Niveau

- liegt

- LIMIT

- protokolliert

- länger

- Maschine

- Maschinelles Lernen

- Zeitschrift

- Main

- Making

- verwaltet

- viele

- Massachusetts

- Massachusetts Institute of Technology

- mathematisch

- Kann..

- Triff

- Mellon

- Methode

- Methoden

- Militär

- Million

- MIT

- Modulen

- mehr

- viel

- National

- fast

- Need

- Netzwerk

- Netzwerke

- Neural

- neuronale Netzwerk

- Neuronale Netze

- NEVADA

- hört niemals

- weiter

- nicht

- bekannt

- jetzt an

- Hindernis

- Hindernisse

- of

- WOW!

- on

- EINEM

- arbeitet

- or

- Andere

- UNSERE

- Möglichkeiten für das Ausgangssignal:

- aussen

- Besitz

- Geduld ist eine Tugend

- Personen

- für

- Wahrnehmung

- perfekt

- Zeit

- Ebene

- Flugzeuge

- geplant

- Pläne

- Plato

- Datenintelligenz von Plato

- PlatoData

- möglich

- Potenzial

- Vor

- Aufgabenstellung:

- Prozessdefinierung

- Professor

- Programm

- Belegen

- erwies sich

- die

- bietet

- Bereitstellung

- setzen

- REGEN

- Angebot

- Roh

- Rohdaten

- eingetragen

- Zuverlässigkeit

- Rendering

- Voraussetzungen:

- Forschungsprojekte

- Downloads

- Umwelt und Kunden

- Folge

- Die Ergebnisse

- Risiko

- Landebahn

- Safe

- Sicherheit

- Said

- San

- San Francisco

- zufrieden

- Wissenschaft

- Wissenschaftler

- Sehen

- Sensoren

- geschickt

- getrennte

- ernst

- kompensieren

- erklären

- zeigte

- ähnlich

- Situation

- SIX

- So

- Software

- Softwareentwicklung

- Solar-

- einige

- manchmal

- angegeben

- Geschwindigkeit

- Staaten

- statistisch

- bleiben

- steuern

- Schritt

- Immer noch

- Strategie

- sicher

- System

- Systeme und Techniken

- und Aufgaben

- Team

- Techniken

- Technologe

- Technologie

- erzählt

- Test

- Testen

- Tests

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- ihr

- Sie

- dann

- Dort.

- Diese

- vom Nutzer definierten

- think

- fehlen uns die Worte.

- dieses Jahr

- diejenigen

- obwohl?

- Durch

- zu

- Werkzeuge

- der Verkehr

- Drehungen

- XNUMX

- Unsicherheiten

- Unsicherheit

- aufdecken

- Vereinigt

- USA

- Universität

- bis

- anstehende

- benutzt

- Verwendung von

- üblich

- Fahrzeug

- Fahrzeuge

- Verification

- sehr

- wollen

- Weg..

- Wege

- we

- webp

- waren

- Was

- wann

- ob

- welche

- während

- werden wir

- mit

- .

- Arbeiten

- gearbeitet

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Jahr

- U

- Ihr

- Zephyrnet