Buchmetadaten und Cover-Abruf mit OCR und Google Books API

Mit KNIME wird das Extrahieren wichtiger Informationen aus Bildern zum Kinderspiel.

By Roberto Cadili, Datenwissenschaftler, KNIME & Lada Rudnitckaia, Datenwissenschaftler, KNIME

Abbildung 1: Beispiele für Buchausgabehinweise, bei denen Informationen dank OCR extrahiert werden können.

Meistens sind die Rohdaten, die wir für unser Data-Science-Projekt benötigen, nicht in einer übersichtlichen, gut strukturierten und aufschlussreichen Tabelle organisiert. Vielmehr wird dies manchmal als Text in einem gescannten Dokument gespeichert. Anschließend müssen die Wörter im Dokument einzeln extrahiert werden, um eine textformatierte Datenzelle zu bilden. Diese Aufgabe übernimmt die optische Zeichenerkennung (OCR).

Wenn Sie die Wörter dieses Artikels lesen, sei es Text oder Zahl, sind Ihre Augen in der Lage, sie zu verarbeiten, indem sie helle und dunkle Muster erkennen, aus denen Zeichen bestehen (z. B. Buchstaben, Zahlen, Satzzeichen usw.). Ihr Gehirn entschlüsselt dann die verschiedenen Kombinationen von Zeichen und Mustern, um die Bedeutung der Wörter zu erfassen. In diesem Sinne sind Ihre Augen und Ihr Gehirn die fortschrittlichste und raffinierteste OCR-Engine, die Sie sich vorstellen können, und sie funktionieren, ohne dass Sie es überhaupt bemerken.

Computer verfügen über ähnliche Fähigkeiten, müssen jedoch eine entscheidende Einschränkung bewältigen: das Fehlen von Augen. Wenn wir möchten, dass Computer ein physisches Textdokument sehen und lesen können, müssen wir eine Grafikdatei eingeben, die entweder mit einem optischen Scanner oder einer Digitalkamera erstellt wurde. Was Computer betrifft, gibt es keinen Unterschied zwischen einem Dokument, das mit einer dieser Optionen erstellt wurde, und einem Foto des Eiffelturms: Beide werden als bedeutungslose Ansammlungen farbiger Quadrate – auch Pixel genannt – betrachtet, die jedes Computergrafikbild darstellen. Letzteres ist somit lediglich ein Bild des Textes, den wir lesen möchten, und nicht der Text selbst.

Hier kann OCR nützlich sein. Diese leistungsstarke Technologie ist in der Lage, gedruckte, getippte oder handgeschriebene Daten, seien es Rechnungen, Visitenkarten, Rechtstexte oder Ausdrucke, zu extrahieren und in ein durchsuchbares und bearbeitbares digitales Format umzuwandeln. Obwohl OCR viele Jahre lang als teurer Dienst galt, den sich nur sehr wenige große Unternehmen leisten konnten, sind die Kosten seit Mitte der 2000er Jahre allmählich gesunken, während sich seine Genauigkeit und Fähigkeiten weiterentwickelt haben und heute mehrere hundert Sprachen und Zeichenkodierungen unterstützen , von UTF-8 bis GB2312.

Der Vorteil, Text aus Bildern suchen und extrahieren zu können, kann von unschätzbarem Wert sein. Beispielsweise kann es in der Rechts- oder Buchhaltungsbranche eine erhebliche Kosten- und Zeitersparnis bedeuten, da es das Abrufen von Textteilen oder Zahlen in Artikeln oder Finanzberichten in Sekundenschnelle ermöglicht. Vergleicht man diesen Prozess mit den Kosten für die Einstellung einer Gruppe von Mitarbeitern, die Tausende von Dokumenten durchlesen, nur um eine einzige, wichtige Information zu finden, erhält man eine Vorstellung davon, welchen Nutzen OCR für Unternehmen haben kann.

In jüngerer Zeit erlebt die OCR-Technologie eine stille Revolution, da Anbieter dieses Dienstes sie mit KI kombinieren. Dadurch werden nicht nur Daten erfasst, durchsuchbar und bearbeitbar gemacht, sondern das KI-System versteht den Inhalt tatsächlich, um bestimmte Aufgaben auszuführen. Beispielsweise kann die KI nach der OCR-Prüfung eines Textes dessen Übersetzung mittels neuronaler maschineller Übersetzung mit minimalem menschlichen Eingriff bereitstellen. Ein weiteres klassisches Beispiel stammt aus dem Prüfungsbereich, wo betrügerische Rechnungen nach OCR-Erkennung des Inhalts des PDF-Dokuments mithilfe von Techniken zur Erkennung von Ausreißern erkannt werden können. Und so weiter. Diese Synergie vereint das Beste aus beiden Welten, um Prozesse zu rationalisieren und die Produktivität für Unternehmen und Kunden zu steigern.

In dem in diesem Artikel beschriebenen Anwendungsfall wird OCR verwendet, um ein Buch zu identifizieren und dann die Metadaten des Buchs aus dem Google Books-Repository abzurufen.

Genauer gesagt werden wir einen Blick auf Folgendes werfen:

- Wie OCR durchgeführt werden kann KNIME Analytics-Plattform.

- Wie wir den OCR-Prozessor von KNIME und die Google Books-API für den Anwendungsfall des Abrufens von Buchmetadaten und -covern integrieren können.

OCR in der KNIME Analytics-Plattform

Die OCR-Erstellung eines Bildes mit Text in KNIME ist eine sehr einfache Aufgabe. Es ist lediglich die Installation erforderlich KNIME-Bildverarbeitung – Tess4J-Integration Nebenstelle in Ihrer Nähe KNIME Analytics-Plattform, und zum Drag&Drop Tess4J Knoten in Ihren Workflow-Editor.

Der Tess4J-Knoten integriert die Tesseract OCR-Bibliothek, einer der am weitesten verbreiteten und genauesten verfügbaren Open-Source-OCR-Prozessoren. Tesseract wurde ursprünglich in den frühen 1990er Jahren von Hewlett-Packard Laboratories als proprietäre Software entwickelt und 2005 als Open Source freigegeben. Seitdem hat Google das Projekt übernommen und seine Entwicklung gefördert.

Der Tess4J-Knoten läuft auf Tesseract 3, das durch die Erkennung von Zeichenmustern in einem Zwei-Durchgangs-Verfahren funktioniert.

- Im ersten Durchgang versucht die Engine, jedes einzelne Zeichen zu erkennen. Anschließend werden die Zeichen, die im ersten Durchgang mit hoher Sicherheit erkannt wurden, als Trainingsdaten an einen adaptiven Klassifikator übergeben. Auf diese Weise hat der adaptive Klassifikator die Möglichkeit zu lernen, nachfolgende Texte genauer zu erkennen.

- Allerdings kann es vorkommen, dass der adaptive Klassifikator nützliche Informationen zu spät erfährt, um einen sinnvollen Beitrag zu leisten. Um dieses Problem zu lösen und das vom adaptiven Klassifikator erworbene Wissen zu nutzen, führt die Engine einen zweiten Durchgang durch, in dem Zeichen, die nicht gut genug erkannt wurden, erneut erkannt werden [1].

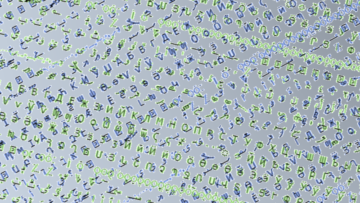

Tesseract 3 verarbeitet alle Unicode-Zeichen (codiert mit UTF-8) und kann Text in verschiedenen Sprachen und Schreiblayouts verarbeiten: von links nach rechts (z. B. Englisch, Italienisch, Russisch usw.), von rechts nach links (z. B. Arabisch, Hebräisch, Urdu usw.) und von oben nach unten (z. B. Japanisch, Koreanisch, Chinesisch usw.) [2].

Disclaimer. Mac-Benutzer können den Tess4J-Knoten derzeit nicht verwenden. KNIME-Entwickler arbeiten daran, den reibungslosen Betrieb wiederherzustellen.

Anwendungsfall: Abrufen von Buchmetadaten und Buchumschlägen

Nachdem wir nun ein grundlegendes Verständnis dafür gewonnen haben, wie OCR in der KNIME Analytics Platform funktioniert, werfen wir einen Blick auf einen interessanten Anwendungsfall. Angenommen, wir haben Bilder gesammelt, die die Ausgabehinweise mehrerer Bücher veranschaulichen, und möchten mit diesen Informationen Buchmetadaten und Cover abrufen. Die abgerufenen Daten könnten dann beispielsweise zum Aufbau einer maßgeschneiderten digitalen Bibliothek und zum Trainieren eines Buchempfehlungssystems verwendet werden.

Der Arbeitsablauf in Abbildung 2 deckt alle Schritte ab: vom Bildlesen, OCRing, Textverarbeitung und ISBN-Referenzextraktion bis hin zu Buchmetadaten und dem Abrufen und Visualisieren von Umschlägen. Schauen wir uns die einzelnen Schritte im Detail an.

Abbildung 2: Dies Arbeitsablauf. Führt eine einfache OCR-Aufgabe für Buchausgabehinweise durch und ruft Buchmetadaten und Cover mithilfe der Google Books-API ab.

1 – Bilddaten lesen

Der erste Schritt besteht darin, die Bilder der Buchausgabehinweise in KNIME zu importieren. Der Ausgabehinweis ist die Seite in einem Buch, die Informationen über die aktuelle Ausgabe enthält, z. B. einen Urheberrechtshinweis, rechtliche Hinweise, Veröffentlichungsinformationen, Druckhistorie und einen ISBN-Code (Abbildung 1).

Der Metaknoten „Bilddaten lesen“ erledigt dies auf einfache und programmatische Weise (Abbildung 3). Wir identifizieren den Ort, an dem Bilddateien gespeichert sind, mit dem Dateien/Ordner auflisten Knoten und verwenden Sie die Bildleser (Tabelle) Knoten, um die Bilder ordnungsgemäß zu importieren. Im Knoten Image Reader (Table) müssen wir lediglich die „File Input Column“ angeben, also die Spalte mit den Pfaden zu den Dateien, in denen unsere Bilder gespeichert sind. Alle anderen Konfigurationen können als Standard beibehalten werden.

Der Image Reader (Table) ist Teil des KNINE-Bildverarbeitung Erweiterung und bietet wie andere Knoten in dieser Erweiterung eine interaktive Ansicht mit dem Bild und seinen Metadaten, indem Sie einfach mit der rechten Maustaste auf den Knoten klicken, „Ansicht: Bildbetrachter“ auswählen und auf ein beliebiges Bild in der Tabellenansicht doppelklicken.

Abbildung 3: Im Metaknoten „Bilddaten lesen“. Der Knoten „Bildleser (Tabelle)“ importiert Bilder in den Workflow und ermöglicht es uns, sie in seiner Ansicht interaktiv zu erkunden.

2 – OCR

Nachdem wir die Bilddateien der Buchausgabehinweise eingelesen haben, können wir sie per OCR erfassen.

Die Konfiguration des Tess4J-Knotens ist sehr einfach und erfordert nur wenige Klicks (Abbildung 4). Im Einstellungen Auf der Registerkarte „Eingabebilder entzerren“ bietet der Knoten die Möglichkeit, Drehungen oder verzerrte Bilder zu korrigieren, indem im Abschnitt „Vorverarbeitung“ des Konfigurationsdialogs das Kästchen „Eingabebilder entzerren“ ausgewählt wird. Dies wird normalerweise empfohlen, da Grafikdateien möglicherweise nicht richtig ausgerichtet sind. Darüber hinaus erzeugt der Tess4J-Knoten hinter der Haube automatisch ein binarisiertes Bild.

Als nächstes wählen wir den „Tessdata Path“ aus. Standardmäßig ist dies auf „Intern verwenden“ eingestellt, wodurch wir dann die Sprache des Textes auswählen können, den wir verarbeiten möchten. In dieser Konfiguration ist Englisch die Standardsprache, aber der Tess4J-Knoten unterstützt andere natürliche Sprachen wie Dänisch, Italienisch, Spanisch, Russisch, Griechisch, Slowakisch, Deutsch und Französisch. Es ist erwähnenswert, dass wir durch Auswahl von „Extern verwenden“ die Funktionen des Tess4J-Knotens erweitern können, um Sprachen einzuschließen, die intern nicht unterstützt werden. Tatsächlich können wir unsere eigenen, extern trainierten Datensprachenmodelle auswählen, indem wir das Verzeichnis angeben, in dem sie gespeichert sind. Wir wählen „Intern verwenden“, da wir für unsere englischen Dokumente lieber auf die internen Modelle von Tess4J zurückgreifen.

Im Abschnitt „Erkennungskonfiguration“ finden wir die beiden wichtigsten Dropdown-Listenkonfigurationen, nämlich den „Seitensegmentierungsmodus“ und den „OCR-Engine-Modus“. Der erste definiert, wie unsere Seite segmentiert ist.

In Abbildung 4 wählen wir „Full Auto Pageseg“, was eine vollautomatische Seitensegmentierung gewährleistet. Je nach konkretem Anwendungsfall könnte die Auswahl eines anderen der 13 verfügbaren Modi (z. B. „Einzelne Spalte“ oder „Sparse Text“) die geeignetere Option sein.

Die zweite Einstellung fordert uns auf, die OCR-Engine auszuwählen. Hier wählen wir „Nur Tesseract“, was die schnellste Ausführung gewährleistet. Zu den weiteren Optionen gehört „Cube Only“ – ein alternativer Erkennungsmodus für Tesseract – der langsamer ist, aber oft bessere Ergebnisse liefert; oder „Tesseract And Cube“, das das Beste aus beiden Welten vereint. Die Wahl der einen oder anderen Engine hängt stark von der Qualität des Bildes und der Komplexität des Textes ab, den wir verarbeiten möchten.

Zusätzlich zu den Grundeinstellungen bietet der Tess4J-Knoten eine Erweiterte Konfiguration Registerkarte, auf der wir eine Reihe von definieren können Regelparameter. Diese Registerkarte macht den Knoten äußerst flexibel und hilft erfahrenen Benutzern, die Tesseract OCR-Engine an ihre spezifischen Bedürfnisse anzupassen und zu optimieren. Aber keine Sorge, in den meisten Fällen werden Sie mit den Grundkonfigurationen weit kommen!

Abbildung 4: Konfigurationsdialog des Tess4J-Knotens.

Neben der Anpassung der Konfigurationen des Tess4J-Knotens an den jeweiligen Anwendungsfall empfiehlt es sich, Eingabebilder bei Bedarf gründlich vorzuverarbeiten. Insbesondere funktioniert Tesseract am besten, wenn Bilder ausreichend skaliert sind, sodass die Pixelzahl der x-Höhe von Zeichen mindestens 20 Pixel beträgt; Bilder sind korrekt ausgerichtet und haben eine ausreichend hohe Auflösung; und alle dunklen Ränder werden entfernt, sonst könnten sie als Zeichen fehlinterpretiert werden [3]. Der KNINE-Bildverarbeitung Die Erweiterung umfasst mehrere Knoten zur Bildbereinigung, -manipulation und -transformation und vieles mehr Beispiel-Workflows kann auf die gefunden werden KNIME-Hub.

Die Ausgabe des Tess4J-Knotens ist eine Tabelle, die den extrahierten Text als String-Datentyp enthält und als solcher durchsucht und bearbeitet werden kann.

3 – Textverarbeitung für die ISBN-Extraktion

Sobald die Bilder mit OCR bearbeitet wurden, kann endlich auf den darin enthaltenen Text zugegriffen und nützliche Informationen abgerufen werden.

Insbesondere wird in Editionshinweisen in der Regel der dem Buch zugeordnete ISBN-Code angegeben. Der ISBN-Code ist eine eindeutige, 13-stellige (vor 10 waren es 2007-stellige) kommerzielle Buchkennung und wird als solche jeder einzelnen Ausgabe und Variation einer Publikation zugeordnet. Das Extrahieren des ISBN-Codes ermöglicht es uns, jedes Buch eindeutig zu referenzieren, wenn wir Metainformationen abrufen möchten. Um dies zu erreichen, können wir uns auf die darin enthaltenen Knoten verlassen KNIME – Textverarbeitung Erweiterung, von denen einige im Metaknoten „ISBN-Extraktion“ verwendet werden (Abbildung 5).

Im Metaknoten „Textreinigung“ beginnen wir mit der Umwandlung des OCR-Textes vom Datentyp „String“ in den Datentyp „Dokument“. Als Nächstes konvertieren wir den Text in Kleinbuchstaben, entfernen Satzzeichen, Leerzeichen und Bindestriche und ersetzen die Buchstaben „o“ durch „0“ (Nullen), um falsch erkannte Zeichen in den ISBN-Codes zu korrigieren.

Wir extrahieren die ISBN-Codes, indem wir die 13 Zeichen, die auf die Zeichenfolge „isbn“ folgen, isolieren und verwenden Regel-Engine Knoten, um zu überprüfen, ob die extrahierten Zeichen keine fehlenden Werte enthalten und eine erwartete Länge von 13 Zeichen haben. Anschließend nutzen wir die Fähigkeit dieses Knotens, eine Spalte anzuhängen, die eine erfolgreiche Extraktion als 1 und eine fehlgeschlagene Extraktion als 0 kennzeichnet.

Abbildung 5: Im Metaknoten „ISBN-Extraktion“.

4 – Metainformationsabruf und -visualisierung

Im letzten Schritt verwenden wir die ISBN-Codes, um Buchmetainformationen und Cover aus der Google Books API abzurufen. Dafür sorgt der Metaknoten „Buchmetadaten und Cover abrufen“ (Abbildung 6). Der Abruf der Metadaten ist jedoch nur möglich, wenn die ISBN-Codes erfolgreich extrahiert wurden. Um eine reibungslose Abwicklung erfolgreicher/nicht erfolgreicher ISBN-Extraktion zu gewährleisten, integrieren wir mehrere Workflow-Kontrollknoten. Einen aufschlussreichen Überblick finden Sie im Spickzettel: Kontrolle und Orchestrierung mit der KNIME Analytics-Plattform.

Wenn der ISBN-Code erfolgreich extrahiert wurde, verwenden wir den GET-Anfrage Knoten, an den eine GET-Anfrage gesendet werden soll Google Books-API, ein kostenloser RESTful-Webdienst von Google, der den Abruf verschiedener Metainformationen wie Buchtitel, Untertitel, Autoren, Veröffentlichungsdatum, Beschreibung, Seitenzahl, Sprache, durchschnittliche Bewertung, Bewertungsanzahl und Cover ermöglicht. Darüber hinaus erfordert dieser RESTful-Webdienst nicht die Erstellung eines Entwicklerkontos. Die Konfiguration des GET-Request-Knotens ist sehr einfach. Es erfordert die einfache Auswahl einer aussagekräftigen „URL-Spalte“, die wir im erstellen String-Manipulation Knoten durch Beitritt zum URL der Google Books-API mit dem ISBN-Code jedes Editionshinweises. Alle anderen Konfigurationen können als Standard beibehalten werden.

Anschließend analysieren wir die JSON-Ausgabe des GET-Request-Knotens mithilfe von JSON-Pfad Knoten und verknüpfen extrahierte Metainformationen mit Buchumschlägen, bevor die endgültigen Ergebnisse erfasst werden.

Abschließend erstellen wir die Komponente „Buchmetadaten und -cover visualisieren“ für eine übersichtliche Visualisierung der abgerufenen Buchmetainformationen und -cover.

In die Komponente packen wir das ein Interaktives Bereichsschieberegler-Filter-Widget Knoten zum Aktivieren der dynamischen Buchfilterung basierend auf der durchschnittlichen Bewertungszahl (0-schrecklich; 5-fantastisch), die von Lesern bei Google Books zugewiesen wurde, und der Kachelansicht Knoten, um die Ergebnisse anzuzeigen.

Die Komponente erhält dann eine Ansicht, die den Schieberegler zur Auswahl der Bücher basierend auf der durchschnittlichen Bewertung sowie eine Tabelle mit den Covern und Beschreibungen der ausgewählten Bücher enthält. Für diesen Artikel haben wir ausgewählt, Bücher mit Bewertungen zwischen 3 und 5 zu extrahieren. Die Ergebnisse werden in Abbildung 6 angezeigt.

Abbildung 6: Abgerufene Metainformationen und Buchcover für Bücher mit einer Bewertung über 3.

Zusammenfassung

In diesem Artikel haben wir dargestellt, wie OCR einfach in der KNIME Analytics Platform durchgeführt werden kann. Zu diesem Zweck haben wir den Tess4J-Knoten vorgestellt und Details zur Funktionsweise der Tesseract OCR-Bibliothek bereitgestellt, auf der dieser Knoten basiert.

Darüber hinaus haben wir einen einfachen Anwendungsfall gezeigt, bei dem OCR eine leistungsstarke und nützliche Ressource sein kann. Wir haben Informationen aus Buchausgabehinweisen – insbesondere die ISBN-Codes – extrahiert, um eine GET-Anfrage an den RESTful-Webdienst von Google Books zu senden. Dies hat es uns ermöglicht, Buchmetadaten und Cover abzurufen.

Mit KNIME wird das OCRing von Bildern zum Extrahieren wichtiger Informationen zum Kinderspiel. Probieren Sie es selbst aus! Was ist Ihr OCR-Anwendungsfall?

Der in diesem Artikel vorgestellte Workflow kann kostenlos heruntergeladen werden KNIME-Hub.

Bibliographie

[1] Smith, R. (2007). „Ein Überblick über die Tesseract OCR Engine“. Neunte Internationale Konferenz zur Dokumentenanalyse und -erkennung (ICDAR 2007), S. 629–633. Erreichbar unter:

https://static.googleusercontent.com/media/research.google.com/en//pubs/archive/33418.pdf

[Abgerufen: 15.07.2021].

[2] Tesseract OCR-Projekt auf GitHub – https://github.com/tesseract-ocr/tesseract

[3] Tesseract OCR-Dokumentation auf GitHub – https://tesseract-ocr.github.io/tessdoc/

Roberto Cadili ist Datenwissenschaftler bei KNIME, NLP-Enthusiast und Geschichtsliebhaber. Herausgeber für Low Code für Advanced Data Science.

Lada Rudnitckaia ist Data Scientist bei KNIME.

Als Erstveröffentlichung in Low Code für fortgeschrittene Datenwissenschaft.

Original. Mit Genehmigung erneut veröffentlicht.

Related:

Quelle: https://www.kdnuggets.com/2021/11/book-metadata-cover-retrieval-ocr-google-books-api.html

- "

- &

- 2021

- Konto

- Buchhaltung

- AI

- Alle

- Analyse

- Analytik

- Bienen

- Artikel

- Artikel

- Autoren

- Auto

- BESTE

- Bücher

- Box

- bauen

- Geschäft

- Unternehmen

- österreichische Unternehmen

- Karriere

- Fälle

- Zeichenerkennung

- chinesisch

- Einstufung

- Reinigung

- Kunden

- Code

- Das Sammeln

- Kolonne

- kommerziell

- Unternehmen

- Komponente

- Computer

- Konferenz

- Vertrauen

- Konfiguration

- Inhalt

- Urheberrecht

- Strom

- Armaturenbrett

- technische Daten

- Datenwissenschaft

- Datenwissenschaftler

- Detail

- Entdeckung

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- digital

- Unterlagen

- Drop

- Früh

- Herausgeber

- Ingenieur

- Englisch

- etc

- Ausführung

- Erweitern Sie die Funktionalität der

- Ausnutzen

- Extraktion

- Abbildung

- Endlich

- Revolution

- Vorname

- folgen

- unten stehende Formular

- Format

- Frei

- Französisch

- GitHub

- gut

- Gruppe an

- Handling

- praktisch

- hier

- High

- Verleih

- Geschichte

- Hosting

- Ultraschall

- Hilfe

- HTTPS

- Idee

- identifizieren

- Image

- Einschließlich

- Einkommen

- Erhöhung

- Energiegewinnung

- Information

- interaktive

- International

- IT

- join

- Wissen

- Koreanisch

- Etiketten

- Sprache

- Sprachen

- grosse

- LERNEN

- lernen

- Rechtlich

- Hebelwirkung

- Bibliothek

- !

- Liste

- Standorte

- Lang

- Maschinelles Lernen

- Maschinenübersetzung

- Manipulation

- mittlere

- nämlich

- Ordentlich

- Neural

- Nlp

- Fiber Node

- Zahlen

- OCR

- Angebote

- XNUMXh geöffnet

- Open-Source-

- optische Zeichenerkennung

- Option

- Optionen

- Andere

- Personen

- physikalisch

- ein Bild

- Pixel

- Plattform

- PRODUKTIVITÄT

- Projekt

- Python

- Qualität

- Angebot

- Bewertungen

- Roh

- Rohdaten

- Leser

- Leser

- Lesebrillen

- berichten

- Ressourcen

- Die Ergebnisse

- Wissenschaft

- Suche

- ausgewählt

- Sinn

- kompensieren

- Einstellung

- Einfacher

- So

- Software

- LÖSEN

- Spanisch

- Sponsored

- Anfang

- Geschichten

- erfolgreich

- Support

- Unterstützte

- Unterstützt

- System

- Techniken

- Technologie

- Tesserakt

- Zeit

- Top

- Ausbildung

- Transformation

- Transformieren

- Übersetzungen

- Unicode

- us

- Nutzer

- Anzeigen

- Visualisierung

- Netz

- Was ist

- Worte

- Arbeiten

- Arbeitsablauf.

- Werk

- wert

- Schreiben

- X

- Jahr