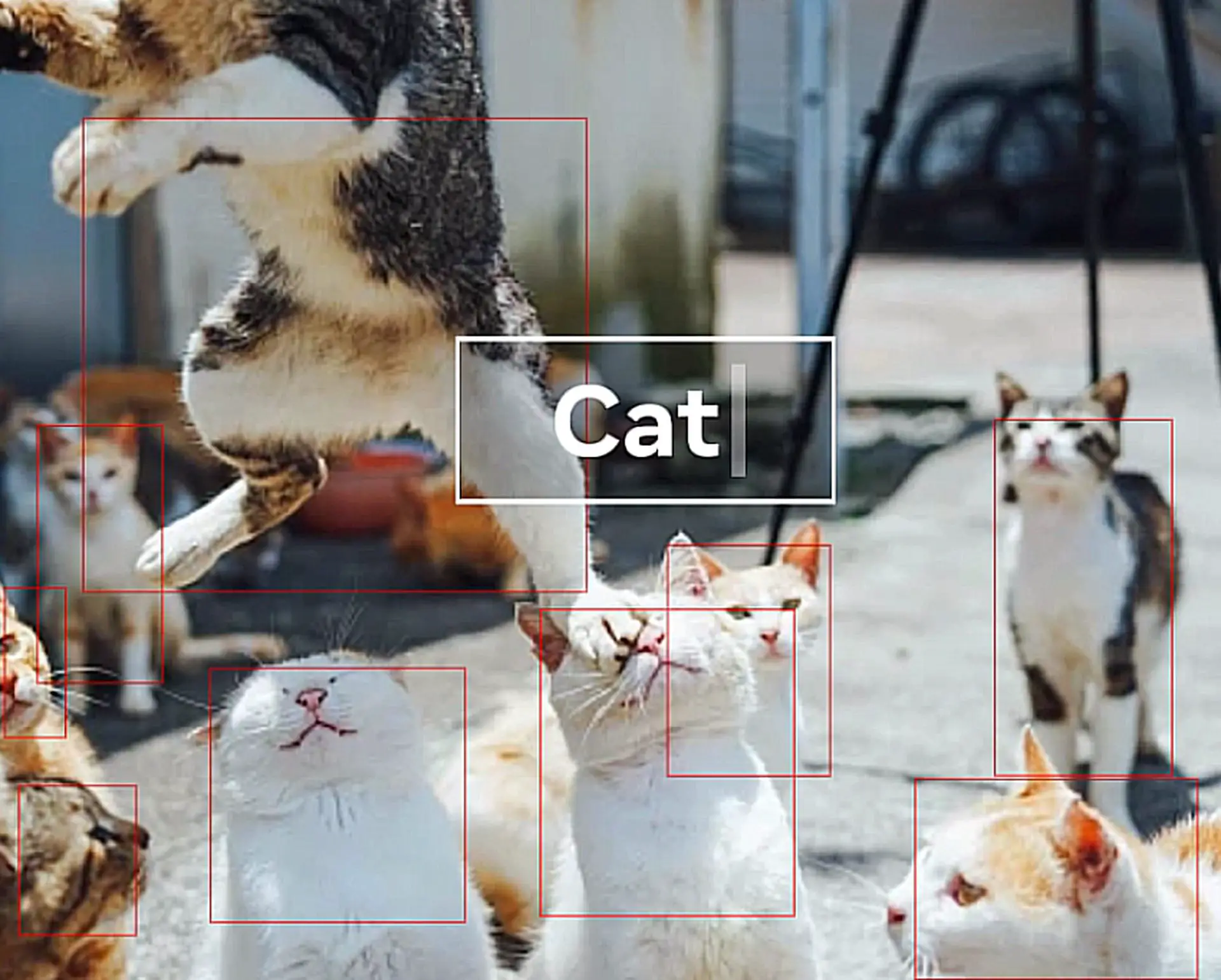

Metas nye Segment Anything Model blev afsløret. SAM-modellen er en ny måde at skabe masker af høj kvalitet til billedsegmentering på.

Påmindelse: Billedsegmentering er en grundlæggende opgave inden for computersyn, der har til formål at opdele et billede i områder, der svarer til forskellige objekter eller semantiske kategorier, og har mange applikationer, såsom objektdetektering, sceneforståelse, billedredigering og videoanalyse.

Billedsegmentering er dog også et udfordrende problem, især når man har at gøre med komplekse scener, der indeholder flere objekter med varierende former, størrelser og udseende. Desuden kræver de fleste eksisterende billedsegmenteringsmetoder store mængder annoterede data til træning, hvilket kan være dyrt og tidskrævende at opnå. Meta ønsker at løse dette problem med SAM-modellen.

SAM-model: Hvad er Metas nye Segment Anything-model?

Segment Anything Model (SAM) er en ny og kraftfuld kunstig intelligens-model, der kan segmentere ethvert objekt i et billede eller en video med høj kvalitet og effektivitet. Segmentering er processen med at adskille et objekt fra dets baggrund eller andre objekter og skabe en maske, der skitserer dets form og grænser. Med SAM-modellen bliver dine redigerings-, sammensætnings-, sporings-, genkendelses- og analyseopgaver nemmere.

SAM adskiller sig fra andre segmenteringsmodeller på flere måder, såsom:

- SAM er promptbar, hvilket betyder, at det kan tage forskellige inputprompter, såsom punkter eller bokse, for at angive, hvilket objekt der skal segmenteres. For eksempel kan du tegne en boks rundt om en persons ansigt, og Segment Anything Model genererer en maske til ansigtet. Du kan også give flere prompter for at segmentere flere objekter på én gang. SAM-modellen kan håndtere komplekse scener med okklusioner, refleksioner og skygger.

- SAM er trænet på et massivt datasæt på 11 millioner billeder og 1.1 milliarder masker, hvilket er det største segmenteringsdatasæt til dato. Dette datasæt dækker en bred vifte af objekter og kategorier, såsom dyr, planter, køretøjer, møbler, mad og meget mere. SAM kan segmentere objekter, som den aldrig har set før, takket være dens generaliseringsevne og datadiversitet.

- SAM har en stærk nul-skuds ydeevne på en række segmenteringsopgaver. Zero-shot betyder, at SAM kan segmentere objekter uden yderligere træning eller finjustering på en specifik opgave eller domæne. For eksempel kan SAM segmentere ansigter, hænder, hår, tøj og tilbehør uden forudgående viden eller overvågning. SAM kan også segmentere objekter i forskellige modaliteter, såsom infrarøde billeder eller dybdekort.

SAM-modellen opnår imponerende resultater på forskellige billedsegmenteringsbenchmarks, såsom COCO. SAM udkonkurrerer eller matcher også tidligere fuldt overvågede metoder på flere nul-shot segmenteringsopgaver, såsom segmentering af logoer, tekst, ansigter eller skitser. Det demonstrerer sin alsidighed og robusthed på tværs af forskellige domæner og scenarier.

I fremtiden: Projektet Segment Anything Model (SAM-model) er stadig i sine tidlige dage. Ifølge Meta er disse nogle af de fremtidige anvendelser af Segment Anything-modellen:

- Fremtidige AR-briller kan bruge SAM til at genkende almindelige genstande og give nyttige påmindelser og instruktioner.

- SAM har evnen til at påvirke mange andre områder, såsom landbrug og biologi. En dag kan det endda gavne landmænd og videnskabsmænd.

SAM-modellen kan være et gennembrud inden for computersyn og forskning i kunstig intelligens. Det demonstrerer potentialet i grundmodeller for vision, som er modeller, der kan lære af data i stor skala og overføres til nye opgaver og domæner.

Segment Anything Model (SAM-model) funktioner

Her er nogle af SAM-modellens muligheder:

- Ved at bruge SAM-modellen kan brugere hurtigt og nemt segmentere objekter ved at vælge individuelle punkter, der skal inkluderes eller udelades fra segmenteringen. En grænseboks kan også bruges som stikord til modellen.

- Når der er usikkerhed om emnet, der segmenteres, kan SAM-modellen producere mange gyldige masker, en afgørende og kritisk færdighed til at løse segmentering i den virkelige verden.

- Automatisk objektdetektering og maskering er nu enkel med Segment Anything-modellen.

- Efter forudberegning af billedindlejringen kan Segment Anything-modellen give en segmenteringsmaske for enhver prompt øjeblikkeligt, hvilket muliggør realtidsinteraktion med modellen.

Imponerende, ikke? Så hvad er teknologien bag?

Hvordan fungerer SAM-modellen?

En af de mest spændende opdagelser inden for NLP og for nylig inden for computervision er brugen af "prompting"-tilgange til at muliggøre nul-skuds- og få-skuds-læring på nye datasæt og opgaver ved hjælp af fundamentmodeller. Meta fandt motivation i dette felt.

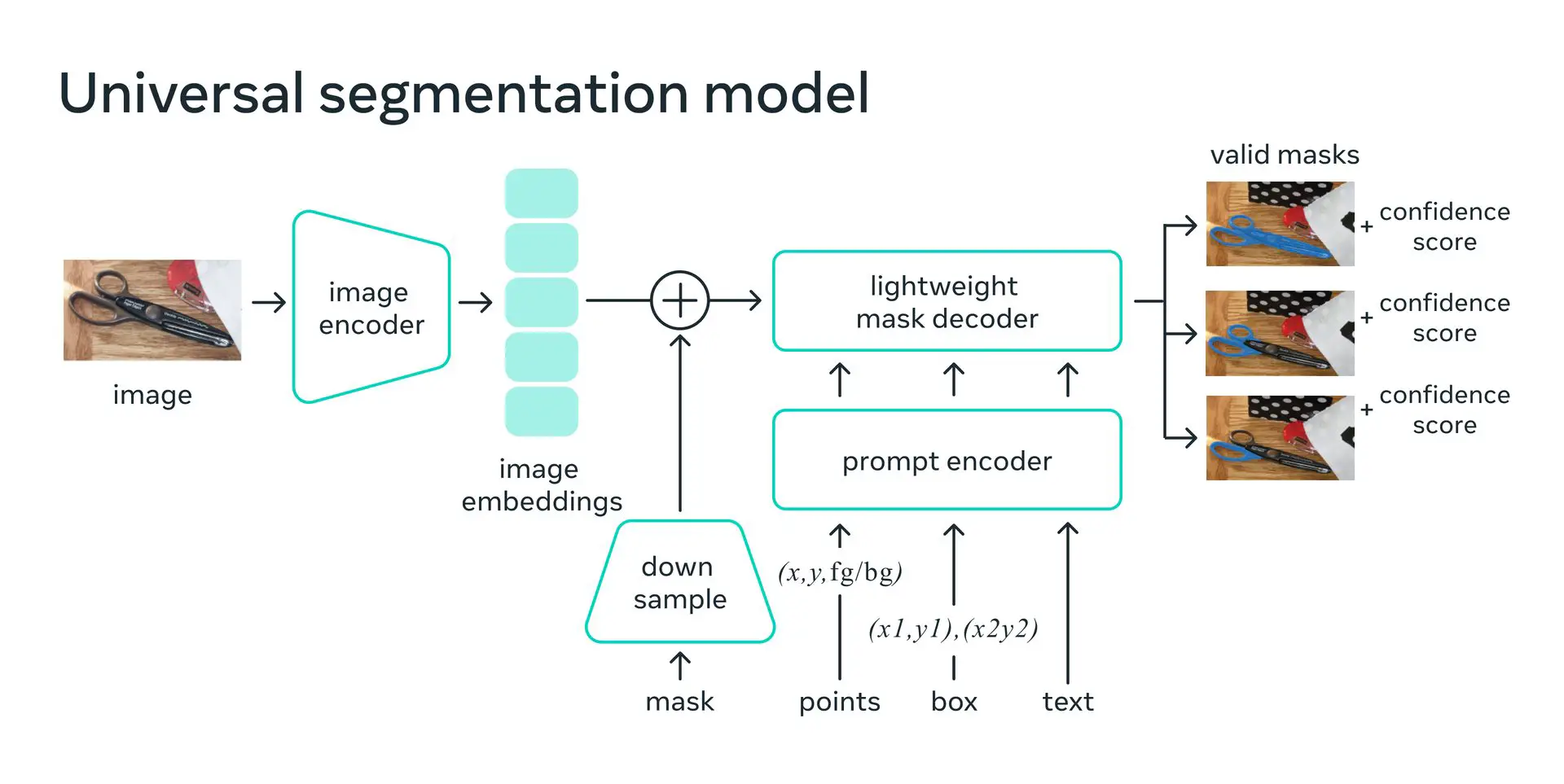

Hvis der gives forgrunds-/baggrundspunkter, en grov boks eller maske, friteksttekst eller ethvert andet input, der angiver, hvad der skal segmenteres i et billede, lærte Meta AI-teamet Segment Anything-modellen at generere en ordentlig segmenteringsmaske. Behovet for en ordentlig maske indebærer blot, at outputtet skal være en passende maske for en af de ting, som prompten kan referere til (for eksempel kan et punkt på en skjorte repræsentere enten skjorten eller personen, der bærer den). Denne opgave bruges til modelforuddannelse og til at vejlede løsningen af generiske downstream-segmenteringsproblemer.

Meta bemærkede, at fortræningsopgaven og den interaktive dataindsamling satte visse begrænsninger på modelkonstruktionen. Især skal deres annotatorer være i stand til at bruge Segment Anything Model i en browser, interaktivt, i realtid, på en CPU, for at den er effektiv. På trods af at der skal være et kompromis mellem kvalitet og hastighed for at opfylde kravet om køretid, opdager de, at en ligetil tilgang giver tilfredsstillende resultater.

På bagsiden skaber en billedkoder en unik indlejring af billedet, mens en letvægtskoder øjeblikkeligt kan transformere enhver forespørgsel til en indlejringsvektor. En letvægtsdekoder bruges derefter til at flette disse to datakilder for at forudse segmenteringsmasker. Efter at billedindlejringen er blevet beregnet, kan SAM svare på hver forespørgsel i en webbrowser med et segment på omkring 50 ms.

SAM er et nyttigt værktøj for kreative fagfolk og entusiaster, der ønsker at redigere billeder og videoer med lethed og fleksibilitet. Men først skal du lære, hvordan du får adgang til og bruger det.

Hvordan bruger man Segment Anything Model (SAM-modellen)?

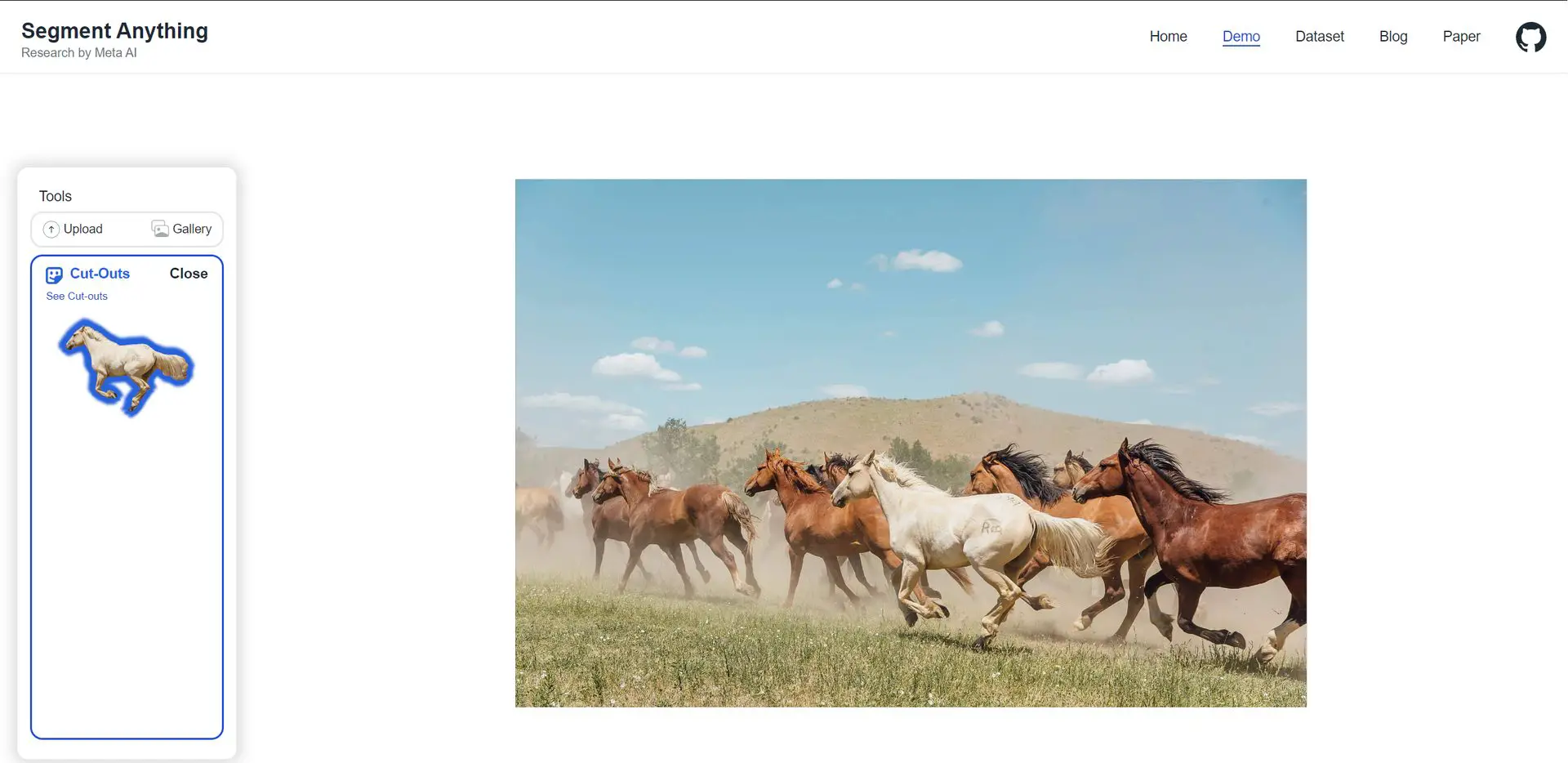

SAM er udviklet af Meta AI Research (tidligere Facebook AI Research), og det er offentligt tilgængeligt på GitHub. Du kan også prøve SAM online med en demo eller download datasættet (SA-1B) med 1 milliard masker og 11 millioner billeder. Modellen er ret nem at bruge; bare følg disse trin:

- Download demoen eller gå til Segment Anything Model-demoen.

- Upload et billede eller vælg et i galleriet.

- Tilføj og emneområder

- Masker områder ved at tilføje punkter. Vælg Tilføj område, og vælg derefter objektet. Forfin masken ved at vælge Fjern område, og vælg derefter området.

Så fuldfør din opgave, som du vil!

For mere information, klik link..

Billede høflighed: Meta

AI 101

Er du ny til AI? Du kan stadig komme på AI-toget! Vi har lavet en detaljeret AI-ordliste for de mest almindeligt anvendte kunstig intelligens udtryk og forklare grundlæggende om kunstig intelligens samt risici og fordele ved kunstig intelligens. Brug dem gerne. Læring hvordan man bruger AI er en game changer! AI modeller vil ændre verden.

AI-værktøjer, vi har gennemgået

Næsten hver dag dukker et nyt værktøj, model eller funktion op og ændrer vores liv, som det nye OpenAI ChatGPT plugins, og vi har allerede gennemgået nogle af de bedste:

- Tekst-til-tekst AI-værktøjer

Vil du lære hvordan bruger man ChatGPT effektivt? Vi har nogle tips og tricks til dig uden at skifte til Chat GPT Plus! Når du vil bruge AI-værktøjet, kan du få fejl som "ChatGPT har kapacitet lige nu" , "for mange anmodninger på 1 time prøv igen senere". Ja, de er virkelig irriterende fejl, men bare rolig; vi ved, hvordan vi løser dem. Er ChatGPT plagiat gratis? Det er et svært spørgsmål at finde et enkelt svar. Hvis du er bange for plagiat, er du velkommen til at bruge AI plagiat checkers. Du kan også tjekke andre AI chatbots , AI essay forfattere for bedre resultater.

- Tekst-til-billede AI-værktøjer

Mens der stadig er nogle debatter om kunstig intelligens-genererede billeder, folk leder stadig efter bedste AI-kunstgeneratorer. Vil AI erstatte designere? Fortsæt med at læse og find ud af det.

- Andre AI-værktøjer

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://dataconomy.com/2023/04/sam-model-meta-segment-anything-model-mask/

- :er

- $OP

- 1

- 11

- a

- evne

- I stand

- Om

- adgang

- tilbehør

- Ifølge

- opnår

- tværs

- Yderligere

- påvirke

- Efter

- Landbrug

- AI

- ai kunst

- ai forskning

- AI-drevne

- målsætninger

- algoritmer

- allerede

- beløb

- beløb

- analyse

- analysere

- ,

- dyr

- besvare

- foregribe

- optrædener

- applikationer

- tilgang

- tilgange

- passende

- AR

- AR-briller

- ER

- OMRÅDE

- områder

- omkring

- Kunst

- kunstig

- kunstig intelligens

- AS

- At

- Automatisering

- til rådighed

- tilbage

- baggrund

- BE

- før

- bag

- være

- Benchmarks

- gavner det dig

- fordele

- BEDSTE

- Bedre

- mellem

- Billion

- biologi

- grænser

- Boks

- kasser

- gennembrud

- browser

- by

- beregnet

- CAN

- Kan få

- kapaciteter

- Kapacitet

- kategorier

- vis

- udfordrende

- lave om

- Ændringer

- ChatGPT

- kontrollere

- Vælg

- klik

- tøj

- Indsamling

- almindeligt

- fuldføre

- komplekse

- kompromis

- computer

- Computer Vision

- opbygge

- kunne

- dækker

- CPU

- skabe

- oprettet

- skaber

- Oprettelse af

- Kreativ

- kritisk

- afgørende

- data

- datasæt

- Dato

- dag

- Dage

- beskæftiger

- Tilbud

- Demo

- demonstrerer

- dybde

- Trods

- detaljeret

- Detektion

- udviklet

- forskellige

- opdage

- Mangfoldighed

- domæne

- Domæner

- Dont

- downloade

- Tidligt

- lettere

- nemt

- redigering

- Effektiv

- effektivt

- effektivitet

- indsats

- enten

- muliggøre

- muliggør

- entusiaster

- miljøer

- fejl

- især

- HISTORIE

- Ether (ETH)

- Endog

- Hver

- hver dag

- eksempel

- eksisterende

- eksisterer

- Forklar

- Ansigtet

- ansigter

- landmænd

- Feature

- Funktionalitet

- felt

- Fields

- Finde

- Fornavn

- Fix

- Fleksibilitet

- følger

- mad

- Til

- tidligere

- fundet

- Foundation

- Gratis

- fra

- fuldt ud

- fundamental

- fremtiden

- Galleri

- spil

- spil

- generere

- få

- Giv

- given

- briller

- Go

- vejlede

- Hår

- håndtere

- hænder

- Hård Ost

- Have

- hjælpe

- hjælpsom

- Høj

- høj kvalitet

- Hvordan

- How To

- HTTPS

- menneskelig

- identificere

- billede

- billedsegmentering

- billeder

- pålagt

- imponerende

- in

- omfatter

- angiver

- individuel

- oplysninger

- indgang

- anvisninger

- Intelligens

- interaktion

- interaktiv

- spørgsmål

- IT

- ITS

- jpg

- Holde

- Kend

- viden

- stor

- storstilet

- største

- LÆR

- læring

- letvægt

- ligesom

- begrænsninger

- Lives

- leder

- mange

- Maps

- maske

- Masker

- massive

- max-bredde

- midler

- Mød

- blot

- Flet

- Meta

- metoder

- måske

- million

- model

- modeller

- mere

- Desuden

- mest

- Motivation

- MS

- flere

- Behov

- Ny

- NLP

- roman

- objekt

- Objektdetektion

- objekter

- opnå

- of

- on

- ONE

- online

- ordrer

- Andet

- konturer

- udkonkurrerer

- output

- særlig

- Mennesker

- ydeevne

- person,

- planter

- plato

- Platon Data Intelligence

- PlatoData

- Punkt

- punkter

- Pops

- potentiale

- vigtigste

- Forud

- Problem

- problemer

- behandle

- producere

- professionelle partnere

- projekt

- passende

- give

- offentligt

- formål

- kvalitet

- spørgsmål

- hurtigt

- rækkevidde

- Læsning

- ægte

- virkelige verden

- realtid

- realistisk

- for nylig

- anerkendelse

- genkende

- reducere

- raffinere

- Reflektioner

- om

- regioner

- Fjern

- erstatte

- repræsentere

- anmodninger

- kræver

- påkrævet

- krav

- forskning

- Svar

- Resultater

- Revealed

- revideret

- revolutionere

- robusthed

- s

- Sam

- scenarier

- scene

- scener

- forskere

- segment

- segmentering

- udvælgelse

- adskille

- flere

- Shape

- former

- bør

- Simpelt

- simulation

- enkelt

- størrelser

- dygtighed

- So

- løsninger

- SOLVE

- Løsning

- nogle

- Kilder

- specifikke

- hastighed

- Steps

- Stadig

- ligetil

- stærk

- emne

- sådan

- tilsyn

- Tag

- Opgaver

- opgaver

- hold

- Teknologier

- at

- Området

- Fremtiden

- Galleriet

- verdenen

- deres

- Them

- Disse

- ting

- tidskrævende

- tips

- tips og tricks

- til

- værktøj

- værktøjer

- Sporing

- uddannet

- Kurser

- overførsel

- Transform

- Usikkerhed

- forståelse

- enestående

- brug

- brugere

- udnytte

- række

- forskellige

- Køretøjer

- video

- Videoer

- Virtual

- vision

- Vej..

- måder

- web

- webbrowser

- GODT

- Hvad

- Hvad er

- som

- mens

- WHO

- bred

- Bred rækkevidde

- vilje

- med

- uden

- Arbejde

- world

- Din

- zephyrnet