Billede fra Bing Image Creator

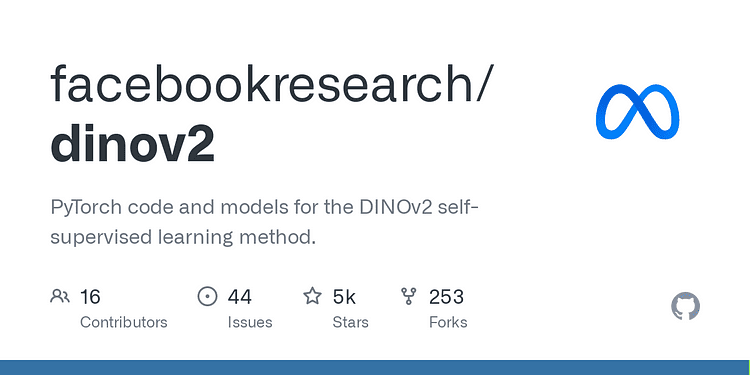

Meta AI har netop udgivet open source DINOv2 modeller den første metode, der bruger selvovervåget læring til at træne computersynsmodeller. DINOv2-modellerne opnår resultater, der matcher eller er endnu bedre end standardtilgangen og modellerne på området.

Modellerne opnåede stærk ydeevne uden behov for at finjustere, hvilket er et perfekt valg til mange forskellige computervisionsopgaver og applikationer. DINOv2 kan lære af forskellige samlinger af billeder og funktioner såsom dybdevurdering uden behov for eksplicit træning takket være den selvovervågede træningsmetode.

Figur 1: DINOv2: Self-Supervised Computer Vision Models af Meta AI

1.1. Der kræves ingen finjustering

Selvovervåget læring er en kraftfuld metode, der bruges til at træne maskinlæringsmodeller uden behov for store mængder mærkede data. DINOv2-modeller kan trænes på billedkorpus uden behov for relaterede metadata, specifik hashtag eller billedtekst. DinoV2-modeller kræver, i modsætning til flere nyere selvovervågede læringstilgange, ikke finjustering og producerer således højtydende funktioner til forskellige computervisionsapplikationer.

1.2. Overvinde menneskelige annoteringsbegrænsninger

I løbet af de sidste par år, billed-tekst fortræning er blevet den fremherskende metode til forskellige computersynsapplikationer. Men på grund af sin afhængighed af menneskemærkede billedtekster for at lære den semantiske betydning af billeder. Denne tilgang overser ofte afgørende information, som ikke er eksplicit inkluderet i disse billedtekster. For eksempel kan en menneskelig etikettekst af et billede af et rødt bord i et gult rum være "Et rødt træbord". Denne billedtekst vil savne nogle vigtige oplysninger om baggrunden, placeringen og størrelsen af bordet. Dette vil forårsage en manglende forståelse af lokal information og vil resultere i dårlig ydeevne på opgaver, der kræver detaljerede lokaliseringsoplysninger.

Behovet for menneskelige etiketter og annoteringer vil også begrænse mængden af data, som vi kan indsamle for at træne modellerne. Dette bliver meget sværere for visse applikationer, for eksempel at kommentere en celle kræver et vist niveau af menneskelig ekspertise, som ikke vil være tilgængelig i den krævede skala. Brug af en selvovervåget træningstilgang til cellulære billeder åbner vejen for en mere grundlæggende model og vil som følge heraf forbedre biologisk opdagelse. Det samme gælder for lignende avancerede felter som estimeringen af dyretæthed.

At flytte fra DINO til DINOv2 krævede at overvinde flere udfordringer som f.eks

- Oprettelse af et stort og kurateret træningsdatasæt

- Forbedring af træningsalgoritmen og implementeringen

- Design af en funktionel destillationsrørledning.

Figur 2: DINO v1 vs v2 sammenligning af segmenteringspræcision

2.1. Oprettelse af et stort, kurateret og mangfoldigt billeddatasæt

Et af hovedtrinene til at bygge DINOv2 er at træne større arkitekturer og modeller for at forbedre modellens ydeevne. Men større modeller kræver store datasæt for at blive effektivt trænet. Da der ikke var store datasæt tilgængelige, der opfylder kravene, udnyttede forskere offentligt crawlede webdata og byggede en pipeline til kun at vælge nyttige data som i LASER.

Der bør dog udføres to hovedopgaver for at kunne bruge disse datasæt:

- Balancer dataene på tværs af forskellige koncepter og opgaver

- Fjern irrelevante billeder

Da denne opgave kan udføres manuelt, kurerede de et sæt frøbilleder fra cirka 25 tredjepartsdatasæt og udvidede det ved at hente billeder, der er tæt relateret til disse frøbilleder. Denne tilgang tillod dem at producere et tilhørende datasæt på i alt 142 millioner billeder ud af 1.2 milliarder billeder.

2.2. Algoritmiske og tekniske forbedringer

Selvom brug af større modeller og datasæt vil føre til bedre resultater, kommer det med store udfordringer. To af hovedudfordringerne er potentiel ustabilitet og forblive håndterbar under træning. For at gøre træningen mere stabil indeholder DINOv2 yderligere regulariseringsmetoder, som er inspireret af lighedssøgning , klassificering litteratur.

Træningsprocessen i DINOv2 integrerer de seneste blandet præcision og distribuerede træningsimplementeringer leveret af banebrydende PyTorch 2. Dette tillod hurtigere implementering af koderne og brug af den samme hardware til træning af DINO-modeller resulterede i dobbelt hastighed og en tredjedel af hukommelsesforbruget, hvilket tillod skalering i data og modelstørrelse.

2.3. Formindskelse af inferenstiden ved hjælp af modeldestillation

At køre store modeller i inferens kræver kraftfuld hardware, som vil begrænse den praktiske brug af metoderne til forskellige anvendelsestilfælde. For at overvinde dette problem brugte forskere modeldestillation til at komprimere viden om de store modeller til mindre. Ved at bruge denne tilgang var forskere i stand til at kondensere højtydende arkitekturer til mindre med ubetydelige ydeevneomkostninger. Dette resulterede i stærke ViT-Small, ViT-Base og ViT-Large modeller.

Trænings- og evalueringskoden kræver PyTorch 2.0 og xFormere 0.0.18 samt mange andre 3. parts pakker og også koden forventer et Linux miljø. Følgende instruktioner beskriver, hvordan du konfigurerer alle nødvendige afhængigheder til trænings- og evalueringsformål:

- Installer PyTorch ved hjælp af instruktionen link.. Det anbefales at installere PyTorch med CUDA-understøttelse.

- Hent Conda

- Klon DINOv2-lageret ved hjælp af følgende kommando:

Kode efter forfatter

- Fortsæt med at oprette og aktivere et Conda-miljø med navnet "dinov2" ved at bruge den medfølgende miljødefinition:

Kode efter forfatter

- For at installere de afhængigheder, der kræves til dette projekt, skal du bruge den medfølgende requirements.txt-fil.

Kode efter forfatter

- Endelig kan du indlæse modellerne ved hjælp af koden nedenfor:

Kode efter forfatter

Som konklusion markerer udgivelsen af DINOv2-modeller af Meta AI en væsentlig milepæl. Den selvovervågede læringstilgang, der bruges af DINOv2-modeller, giver en effektiv måde at træne maskinlæringsmodeller på uden behov for store mængder mærkede data. Med evnen til at opnå høj nøjagtighed uden behov for finjustering, er disse modeller velegnede til forskellige computervisionsopgaver og -applikationer. Desuden kan DINOv2 lære af forskellige samlinger af billeder og kan lære af funktioner såsom dybdeestimering uden eksplicit træning. Tilgængeligheden af DINOv2 som en open source-model åbner dørene for, at forskere og udviklere kan udforske nye muligheder inden for computervisionsopgaver og -applikationer.

Referencer

Youssef Rafaat er computersynsforsker og dataforsker. Hans forskning fokuserer på udvikling af computervisionsalgoritmer i realtid til sundhedsapplikationer. Han arbejdede også som dataforsker i mere end 3 år inden for marketing, økonomi og sundhedsområdet.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoAiStream. Web3 Data Intelligence. Viden forstærket. Adgang her.

- Udmøntning af fremtiden med Adryenn Ashley. Adgang her.

- Køb og sælg aktier i PRE-IPO-virksomheder med PREIPO®. Adgang her.

- Kilde: https://www.kdnuggets.com/2023/05/dinov2-selfsupervised-computer-vision-models-meta-ai.html?utm_source=rss&utm_medium=rss&utm_campaign=dinov2-self-supervised-computer-vision-models-by-meta-ai

- :har

- :er

- :ikke

- 1

- 1.2 milliarder

- 3.

- a

- evne

- I stand

- Om

- gennemført

- opnå

- opnået

- tværs

- Yderligere

- fremskreden

- AI

- algoritme

- algoritmisk

- algoritmer

- Alle

- også

- beløb

- beløb

- an

- ,

- dyr

- applikationer

- tilgang

- tilgange

- cirka

- ER

- AS

- At

- tilgængelighed

- til rådighed

- baggrund

- BE

- bliver

- bliver

- jf. nedenstående

- Bedre

- Billion

- Bing

- Bygning

- bygget

- by

- CAN

- billedtekster

- tilfælde

- Årsag

- vis

- udfordringer

- valg

- nøje

- kode

- indsamler

- samlinger

- kommer

- sammenligning

- computer

- Computer Vision

- Computer Vision applikationer

- begreber

- konklusion

- Omkostninger

- skabe

- Oprettelse af

- afgørende

- kurateret

- data

- dataforsker

- datasæt

- Efterspørgsel

- afhængighed

- dybde

- detaljeret

- udviklere

- udvikling

- forskellige

- distribueret

- distribueret træning

- forskelligartede

- do

- domæne

- færdig

- døre

- fordoble

- grund

- i løbet af

- effektivt

- forbedre

- Miljø

- Ether (ETH)

- evaluering

- Endog

- eksempel

- udvidet

- forventer

- ekspertise

- udforske

- hurtigere

- Funktionalitet

- få

- felt

- Fields

- File (Felt)

- finansiere

- Fornavn

- fokuserer

- efter

- Til

- fra

- funktionel

- gif

- Hardware

- hashtag

- he

- sundhedspleje

- Høj

- Høj ydeevne

- hans

- Hvordan

- How To

- Men

- HTML

- HTTPS

- menneskelig

- billede

- billeder

- implementering

- vigtigt

- in

- medtaget

- omfatter

- oplysninger

- inspirerede

- ustabilitet

- installere

- anvisninger

- Integrerer

- ind

- IT

- ITS

- lige

- KDnuggets

- viden

- etiket

- Etiketter

- Mangel

- stor

- større

- seneste

- føre

- LÆR

- læring

- Niveau

- GRÆNSE

- linux

- litteratur

- belastning

- lokale

- Lokalisering

- maskine

- machine learning

- Main

- større

- lave

- maerker

- manuelt

- mange

- Marketing

- Match

- betyder

- Mød

- Hukommelse

- Meta

- Metadata

- metode

- metoder

- måske

- milepæl

- million

- model

- modeller

- mere

- Desuden

- meget

- Som hedder

- nødvendig

- Behov

- Ny

- ingen

- of

- tit

- on

- dem

- kun

- open source

- åbner

- or

- Andet

- ud

- skitse

- Overvind

- pakker

- part

- forbi

- perfekt

- ydeevne

- PHP

- billede

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- fattige

- position

- muligheder

- potentiale

- vigtigste

- Praktisk

- Problem

- behandle

- producere

- projekt

- forudsat

- giver

- offentligt

- formål

- pytorch

- realtid

- nylige

- Rød

- relaterede

- frigive

- frigivet

- resterende

- Repository

- kræver

- påkrævet

- Krav

- Kræver

- forskning

- forsker

- forskere

- resultere

- Resultater

- Værelse

- s

- samme

- Scale

- skalering

- Videnskabsmand

- frø

- segmentering

- sæt

- flere

- bør

- signifikant

- lignende

- siden

- Størrelse

- mindre

- nogle

- specifikke

- hastighed

- stabil

- standard

- Steps

- stærk

- sådan

- egnede

- support

- bord

- Opgaver

- opgaver

- Teknisk

- end

- tak

- at

- Them

- Der.

- Disse

- de

- Tredje

- tredjepart

- denne

- dem

- tid

- til

- I alt

- Tog

- uddannet

- Kurser

- to

- forståelse

- I modsætning til

- Brug

- brug

- anvendte

- ved brug af

- udnytte

- Ved hjælp af

- v1

- forskellige

- vision

- vs

- Vej..

- we

- web

- GODT

- var

- som

- vilje

- med

- uden

- træ

- arbejdede

- år

- dig

- zephyrnet