I dagens verden er vi omgivet af forskellige kilder til skriftlig information, information som vi generelt antager er skrevet af andre mennesker. Uanset om det er i form af bøger, blogs, nyhedsartikler, forumindlæg, feedback på en produktside eller diskussionerne på sociale medier og i kommentarfelter, er antagelsen, at den tekst, vi læser, er skrevet af en anden person. Men gennem årene er denne antagelse blevet mere og mere tilbøjelig til at være falsk, senest på grund af store sprogmodeller (LLM'er) såsom GPT-2 og GPT-3, der kan udskille plausible afsnit om stort set ethvert emne, når de bliver bedt om det.

Dette rejser spørgsmålet om, hvorvidt vi er ved at nå et punkt, hvor vi ikke længere kan være nogenlunde sikre på, at en onlinekommentar, en nyhedsartikel eller endda hele bøger og filmmanuskripter ikke blev trukket ud af en algoritme, eller måske endda hvor en online chat med en ny sydende kamp viser sig at være lige dig, der får det på med en følelsesløs samling af kode, der er trænet og tilpasset til maksimalt engagement med kunderne. (Redaktørens note: nej, vi spiller ikke det spil her.)

Efterhånden som sådan maskingenereret indhold og interaktioner begynder at spille en stadig større rolle, rejser det både spørgsmålet om, hvordan du kan opdage sådant genereret indhold, samt om det har betydning, at indholdet er genereret af en algoritme i stedet for af et menneske .

Kedsomhed versus ondskab

I George Orwells Nitten Fireogfirs, Winston Smith beskriver en afdeling inden for Sandhedsministeriet kaldet Fiction Department, hvor maskiner konstant udsender frisk genererede romaner baseret på bestemte temaer. I mellemtiden i musikafdelingen bliver ny musik genereret af et andet system kaldet en versificator.

Men hvor dystopisk denne fiktive verden end er, er dette maskingenererede indhold i det væsentlige harmløst, som Winston bemærker senere i bogen, da han observerer en kvinde i byens prole-område synge det seneste ord og tilføjer sin egen følelsesmæssige intensitet til en kærlighedssang, der blev spyttet ud af en følelsesløs, utænksom maskine. Dette bringer os til den mest almindelige brug af maskingenereret indhold, som mange vil hævde blot er en form for automatisering.

Det omfattende udtryk her er 'automatiseret journalistik', og har været i brug med respekterede journalistiske medier som Reuters, AP og andre i årevis nu. Anvendelsestilfældene her er enkle og ligetil: disse er systemer, der er konfigureret til at tage oplysninger om aktieresultater, på virksomhedens kvartalsrapporter, om resultaterne af sportskampe eller lokale valg og udskrive en artikel efter et forudindstillet mønster. Den åbenlyse fordel er, at lokaler fulde af journalister, der kedelig kopierer scores og præstationsmålinger til artikelskabeloner, kan erstattes af en computeralgoritme.

I disse tilfælde erstattes arbejde, der involverer den journalistiske eller kunstneriske ækvivalent af at vende burgere på en fastfood-joint, af en algoritme, der aldrig keder sig eller bliver distraheret, mens mennesker kan udføre mere intellektuelt udfordrende arbejde. Få vil hævde, at der er et problem med denne form for automatisering, da den dybest set gør præcis, hvad vi blev lovet, den ville gøre.

Der, hvor tingene bliver lyssky, er, når det bruges til uhyggelige formål, såsom at tiltrække søgetrafik med maskinfremstillede artikler der forsøger at sælge læseren noget. Selvom dette for nylig har ført til betydelig forargelse i tilfældet CNET er sagen, at dette er en utrolig profitabel tilgang, så vi kan se mere af det i fremtiden. En stor sprogmodel kan trods alt generere en hel stak artikler i den tid, det tager en menneskelig forfatter at lægge et par tekstafsnit ned.

Mere en gråzone er, hvor det drejer sig om at hjælpe en menneskelig forfatter, hvilket er ved at blive et problem i den videnskabelige udgivelsesverden, som for nylig dækket by The Guardian, som selv lavede lidt af et stunt i september 2020, da de offentliggjorde en artikel der var blevet genereret af GPT-3 LLM. Forbeholdet der var, at det ikke var det direkte output fra LLM, men hvad en menneskelig redaktør havde puslet sammen fra flere output genereret af GPT-3. Dette er ret vejledende for, hvordan LLM'er generelt bruges, og antyder nogle af deres største svagheder.

Ingen forkerte svar

I sin kerne en LLM som GPT-3 er en stærkt sammenkoblet database med værdier, der blev genereret ud fra inputtekster, der udgør træningsdatasættet. I tilfælde af GPT-3 giver dette en database (model), der er omkring 800 GB i størrelse. For at søge i denne database er der angivet en forespørgselsstreng – generelt som et spørgsmål eller en ledende sætning – som efter bearbejdning danner input til en kurvetilpasningsalgoritme. Dette bestemmer i det væsentlige sandsynligheden for, at inputforespørgslen er relateret til en sektion af modellen.

Når et sandsynligt match er fundet, kan output genereres baseret på, hvad der er den mest sandsynlige næste forbindelse i modellens database. Dette giver en LLM mulighed for at finde specifik information inden for et stort datasæt og at skabe teoretisk uendeligt lange tekster. Hvad den imidlertid ikke kan gøre, er at afgøre, om inputforespørgslen giver mening, eller om det output, den genererer, giver logisk mening. Det eneste algoritmen kan afgøre er, om den følger den mest sandsynlige kurs, med muligvis en vis induceret variation for at blande outputtet.

Noget, der stadig betragtes som et problem med LLM-genererede tekster, er gentagelse, selvom dette kan løses med nogle tweaks, der giver outputtet en 'hukommelse' for at skære ned på antallet af gange, et bestemt ord bruges. Det, der er sværere at løse, er den absolutte tillid til LLM-output, da det ikke har nogen måde at fastslå, om det bare producerer nonsens og gladeligt vil blive ved med at pludre.

Men på trods af dette, når menneskelige forsøgspersoner udsættes for GPT-3- og GPT-2-genererede tekster som i en 2021 undersøgelse af Elizabeth Clark et al., overstiger sandsynligheden for, at de genkender tekster genereret af disse LLM'er – selv efter noget træning – ikke 55 %, hvilket gør det nogenlunde beslægtet med ren tilfældighed. Hvorfor er det lige, at mennesker er så forfærdelige til at genkende disse LLM-genererede tekster, og kan computere måske hjælpe os her?

Statistik versus intuition

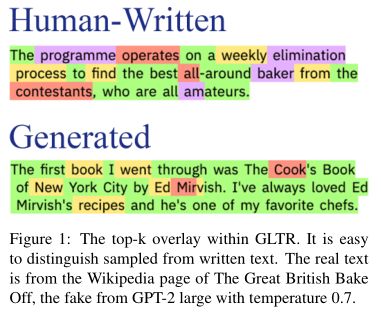

(Kredit: Gehrmann et al., 2019)

Når et menneske bliver spurgt, om en given tekst er skabt af et menneske eller genereret af en maskine, vil de sandsynligvis gætte baseret på deres egne erfaringer, en 'mavefornemmelse' og muligvis en række spor. I en 2019 papir af Sebastian Gehrmann et al., foreslås en statistisk tilgang til at detektere maskingenereret tekst, ud over at identificere en række uhyggelige forekomster af autogenereret tekst. Disse omfatter falske kommentarer i modsætning til amerikansk netneutralitet og vildledende anmeldelser.

Den statistiske tilgang beskrevet af Gehrmann et al. kaldes Giant Language model Test Room (GLTR, GitHub kilde) involverer at analysere en given tekst for dens forudsigelighed. Dette er en egenskab, der ofte beskrives af læsere som 'overfladiskhed' i en maskingenereret tekst, idet den bliver ved med at ævle i afsnit uden egentlig at sige meget. Med et værktøj som GLTR vil en sådan tekst lyse mest grønt i den visuelle repræsentation, da den bruger et begrænset og forudsigeligt ordforråd.

In et papir fremlagt af Daphne Ippolito et al. (PDF) på 2020-mødet i Association for Computational Linguistics, er de forskellige tilgange til detektering af maskingenereret tekst dækket sammen med effektiviteten af disse metoder, der anvendes isoleret versus på en kombineret måde. Top-k-analysemetoden, der anvendes af GLTR, er inkluderet i disse metoder, med de alternative tilgange til nucleus sampling (top-p) og andre også behandlet.

I sidste ende scorede de menneskelige forsøgspersoner i denne undersøgelse en median på 74 % ved klassificering af GPT-2-tekster, hvor det automatiserede diskriminatorsystem generelt scorede bedre. Bemærkelsesværdigt er undersøgelsen af Ari Holtzman et al. der henvises til i konklusionen, hvori det bemærkes, at menneskeskreven tekst generelt har en kadence, der dykker ind og ud af en lav sandsynlighedszone. Dette gør ikke kun det, der gør en tekst interessant at læse, men giver også et fingerpeg om, hvad der får tekst til at virke naturlig for en menneskelig læser.

Med moderne LLM'er som GPT-3, en tilgang som nucleus sampling foreslået af Holtzman et al. er det, der giver den mere naturlige kadence, der ville forventes af en tekst skrevet af et menneske. I stedet for at vælge fra en top-k-liste over muligheder, vælger man i stedet fra en pulje af kandidater i dynamisk størrelse: sandsynlighedsmassen. Den resulterende liste over muligheder, top-p, giver så et meget rigere output end med top-k tilgangen, der blev brugt med GPT-2 og kin.

Hvad dette også betyder er, at der i den automatiske analyse af en tekst skal overvejes flere tilgange. For en menneskelig læsers analyse vil forskellen mellem en top-k (GPT-2) og top-p (GPT-3) tekst være skarp, hvor sidstnævnte type sandsynligvis vil blive identificeret som skrevet af et menneske.

Usikker Times

Det ser således ud til, at svaret på spørgsmålet om, hvorvidt en given tekst er genereret af et menneske eller ej, er et endegyldigt 'måske'. Selvom statistisk analyse kan give nogle hints om sandsynligheden for, at en tekst er genereret af en LLM, ville den endelige dom i sidste ende være hos et menneske, som ikke kun kan afgøre, om teksten passerer semantisk og kontekstuelt, men også kontrollere den formodede kilde til en tekst for at være ægte.

Der er naturligvis masser af situationer, hvor det måske er lige meget, hvem der har skrevet en tekst, så længe oplysningerne i den er faktuelt korrekte. Men når der muligvis er ufarlige hensigter, eller hensigten om at bedrage, er det nødvendigt at praktisere rettidig omhu. Selv med auto-detekteringsalgoritmer på plads og med en trænet og forsigtig bruger, forbliver det læserens ansvar at krydshenvise information og konstatere, om en erklæring fra en tilfældig konto på sociale medier kan være ægte.

(Redaktørens note: Dette indlæg om OpenAIs forsøg på at opdage sin egen prosa kom ud mellem at denne artikel blev skrevet og publiceret. Deres resultater er ikke så gode, og som med alt fra "Open" AI, er deres metoder ikke offentliggjort. Du kan dog prøve klassificeringen.)

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://hackaday.com/2023/02/01/detecting-machine-generated-content-an-easier-task-for-machine-or-human/

- 1

- 2019

- 2020

- a

- Om

- absolutte

- Konto

- Desuden

- Fordel

- Efter

- algoritme

- algoritmer

- Alle

- tillader

- Skønt

- analyse

- analysere

- ,

- En anden

- besvare

- tilgang

- tilgange

- OMRÅDE

- argumentere

- omkring

- artikel

- artikler

- kunstnerisk

- Association

- antagelse

- Automatiseret

- Automatisk Ur

- Automation

- baseret

- I bund og grund

- Bears

- bliver

- blive

- være

- Bedre

- mellem

- større

- Største

- Bit

- blogs

- bog

- Bøger

- Bored

- Bringer

- kadence

- kaldet

- kandidater

- kan ikke

- tilfælde

- tilfælde

- forsigtig

- vis

- udfordrende

- chance

- karakteristisk

- kontrollere

- By

- CNET

- kode

- samling

- kombineret

- KOMMENTAR

- kommentarer

- Fælles

- selskab

- computer

- computere

- Bekymringer

- konklusion

- tillid

- tilslutning

- betragtes

- konstant

- indhold

- kopiering

- Core

- kursus

- dækket

- skabe

- oprettet

- kredit

- skøger

- Kunder

- Klip

- data

- datasæt

- Database

- endelige

- Afdeling

- beskrevet

- Trods

- detaljeret

- Bestem

- bestemmer

- diligence

- diskussioner

- Er ikke

- ned

- dystopisk

- lettere

- editor

- effektivitet

- Valg

- omfatter

- engagement

- Hele

- Ækvivalent

- væsentlige

- Ether (ETH)

- Endog

- NOGENSINDE

- at alt

- præcist nok

- overstige

- forventet

- Oplevelser

- falsk

- Mode

- FAST

- tilbagemeldinger

- få

- Fiktion

- fiktive

- Film

- endelige

- Finde

- montering

- efter

- følger

- mad

- Forbes

- formular

- formularer

- forum

- fundet

- fra

- fuld

- fremtiden

- spil

- generelt

- generere

- genereret

- genererer

- George

- få

- få

- kæmpe

- Giv

- given

- stor

- Grøn

- have

- stærkt

- hjælpe

- link.

- hints

- Hvordan

- Men

- HTTPS

- menneskelig

- Mennesker

- identificeret

- identificere

- in

- omfatter

- medtaget

- utroligt

- oplysninger

- indgang

- i stedet

- hensigt

- interaktioner

- sammenkoblet

- interessant

- isolation

- spørgsmål

- IT

- fælles

- Journalister

- Holde

- Kin

- Venlig

- Sprog

- stor

- seneste

- førende

- Led

- lys

- Sandsynlig

- Limited

- lingvistik

- Liste

- lokale

- Lang

- længere

- kærlighed

- Lav

- maskine

- Maskiner

- lavet

- maerker

- Making

- mange

- Masse

- Match

- Matter

- Matters

- max-bredde

- maksimal

- midler

- I mellemtiden

- Medier

- møde

- blot

- metoder

- Metrics

- måske

- ministerium

- model

- modeller

- Moderne

- mere

- mest

- flere

- Musik

- Natural

- netto

- netneutralitet

- Ny

- nyheder

- næste

- bemærkede

- nummer

- Observerer

- Obvious

- ONE

- online

- modstand

- Indstillinger

- ordrer

- Andet

- Andre

- Outlets

- egen

- Papir

- gennemløb

- Mønster

- ydeevne

- måske

- person,

- Place

- plato

- Platon Data Intelligence

- PlatoData

- plausibel

- Leg

- spiller

- Masser

- Punkt

- pool

- Indlæg

- Indlæg

- praksis

- Forudsigelig

- forelagt

- sandsynlighed

- Problem

- forarbejdning

- Produkt

- rentabel

- lovede

- foreslog

- give

- forudsat

- giver

- offentligt

- offentliggjort

- Publicering

- formål

- sætte

- spørgsmål

- rejser

- tilfældig

- rækkevidde

- nå

- Læs

- Læser

- læsere

- Læsning

- for nylig

- relaterede

- resterne

- udskiftes

- Rapporter

- repræsentation

- anmodet

- løst

- respekteret

- resulterer

- Resultater

- Reuters

- Anmeldelser

- roller

- Værelse

- Rum

- groft

- scoring

- scripts

- Søg

- Sektion

- sektioner

- sælger

- forstand

- september

- sæt

- Simpelt

- situationer

- Størrelse

- So

- Social

- sociale medier

- nogle

- noget

- Kilde

- Kilder

- specifikke

- Sport

- stable

- skarp

- Statement

- statistiske

- Stadig

- bestand

- lige

- ligetil

- Studere

- sådan

- omgivet

- systemet

- Systemer

- Tag

- tager

- Opgaver

- skabeloner

- prøve

- Fremtiden

- oplysninger

- verdenen

- deres

- selv

- ting

- tid

- gange

- til

- nutidens

- sammen

- værktøj

- emne

- Trafik

- uddannet

- Kurser

- Ultimativt

- us

- brug

- Bruger

- Værdier

- forskellige

- versus

- Hvad

- Hvad er

- hvorvidt

- som

- mens

- WHO

- Wikipedia

- vilje

- inden for

- uden

- kvinde

- ord

- Arbejde

- world

- ville

- forfatter

- skriftlig

- Forkert

- år

- zephyrnet