Blandt de vigtigste nyere innovationer til forbedring af værdien og pålideligheden af store sprogmodeller er Chain-of-Thought og dets derivater inklusive Tanketræ , Graf-of-Thought.

Disse strukturer er også ekstremt værdifulde til at designe effektivt Mennesker + AI arbejdsgange for bedre tænkning.

I denne artikel vil jeg give et overblik over Chain-of-Thought på højt niveau og derefter se på applikationer til AI-forøget menneskelig intelligens.

Chain-of-Thought

Store sprogmodeller (LLM'er) er generelt fremragende til tekstgenerering, men dårlige til alle opgaver, der involverer sekventiel ræsonnement.

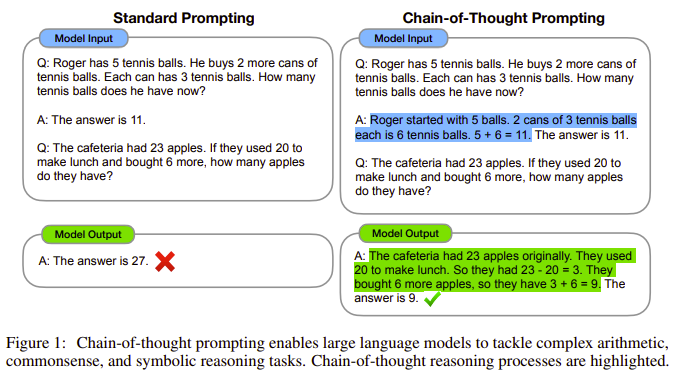

Det skelsættende papir fra januar 2022 Tankekæde-fremkaldelse fremkalder ræsonnement i store sprogmodeller redegjort for, hvordan en tankekæde - "en række mellemliggende ræsonnementtrin" - væsentligt kunne forbedre LLM-præstationer ved ræsonnementopgaver, herunder matematik og almindelige gåder.

Du har sandsynligvis set dette billede fra papiret gør runderne.

Dette koncept blev hurtigt tilpasset til andre applikationer, herunder tidsmæssigt ræsonnement, visuelle sprogmodeller, genfinding udvidet ræsonnement, og mange andre måder at forbedre AI-modellernes ydeevne på.

Chain-of-thought har vist sig at være særlig værdifuld i praktiske problemløsningsapplikationer. Oplagte eksempler inkluderer medicin, lovog uddannelse.

Googles PaLM og Med-PaLM inkorporerer chain-of-thought-strukturer, og det gør OpenAI's GPT-4 meget sandsynligt, hvilket betyder, at når du bruger en LLM, er disse tilgange allerede indbygget.

Alligevel berømt prompten "Lad os løse dette trin for trin for at være sikker på, at vi har det rigtige svar" eller variationer af dette give den bedste LLM-ydelse til mange slags opgaver.

Udvikling af Chain-of-Thought

En række innovationer er opstået ved at bygge videre på Chain-of-Thought.

Effektive ræsonnementprocesser følger ikke nødvendigvis en enkelt bane. Dette fører til Tanketræ strukturer, beskrevet i Tankernes træ: Bevidst problemløsning med store sprogmodeller.

Som vist i dette diagram fra papiret, kan Chain-of-Thought udvikle sig først til at vælge den mest hyppige vej fra flere output, og derefter vælge fra den bedste af flere veje gennem tankeprocessen.

Nyere udviklinger på Chain-of-Thought inkluderer de meget lovende Graf-of-Thought samt Hypergraph-of-Thought.

Nye "tænke"-strukturer vil være centrale for generative AI-fremskridt

Chain-of-Thought og relaterede teknikker blev skabt for at adressere begrænsningerne ved LLM'er og forbedre deres muligheder.

Den fortsatte fremgang af generative AI-modeller vil i langt højere grad stole på disse former for strukturerede tænkningsteknikker end beregningskapacitet eller modelstørrelse. Disse tilgange har allerede aktiveret små, effektive LLM'er for at opnå ydeevne som kan nærme sig de største modellers.

Chain-of-Thought og lignende modeller fører også direkte til multi-agent kæder, hvor kæder eller tankenetværk er lagt ud på tværs af flere opgaveoptimerede modeller for at skabe langt overlegne ræsonnementer og resultater, end der kan opnås inden for en enkelt model.

Augmented intelligens er vigtigere end kunstig generel intelligens

"Teknologi bør ikke sigte mod at erstatte mennesker, snarere at forstærke menneskelige evner." — Doug Engelbart

Drivkraften bag næsten al AI-udvikling ser ud til at være at skabe maskiner, der kan efterligne og potentielt overgå menneskelig intelligens og evner.

Det er en forståelig ambition.

Men jeg er langt, langt mere interesseret i hvordan AI kan øge menneskelig intelligens.

Vi kan arbejde på begge domæner på én gang.

Men i alle mulige scenarier for fremskridt hen imod kunstig generel intelligens vil vi være bedre stillet, hvis vi har lagt mindst lige meget energi i opbygning, læring og anvendelse af menneskelige + AI-tænkningsstrukturer.

Humans + AI Thinking Workflows

Begrebet Mennesker + AI er kernen i mit arbejde.

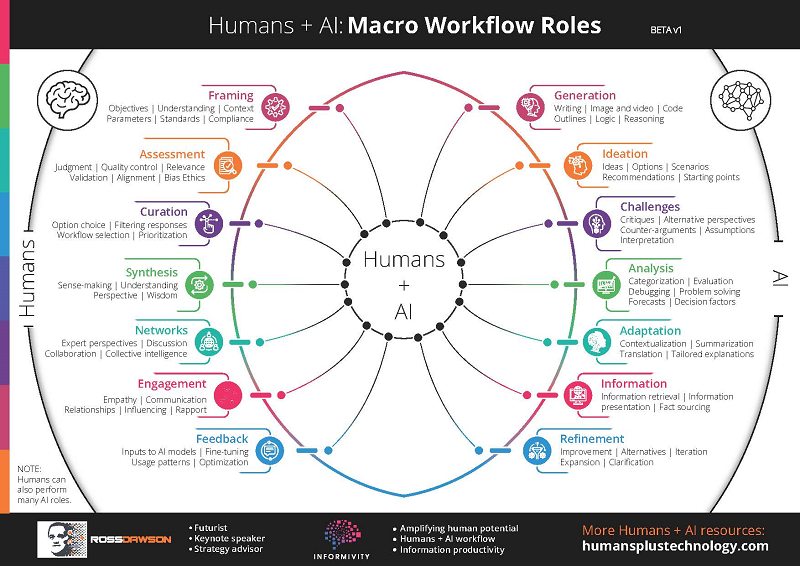

Rammen nedenfor, jeg oprettede for et år siden, viser min tidlige indramning af "Mennesker + AI arbejdsgange“, hvor mennesker og AI sekventielt løser de opgaver, som de er bedst egnede til.

Hvis det er veldesignet, genererer dette uundgåeligt resultater, der er bedre end, hvad hver enkelt kunne alene.

Siden da har jeg gravet langt mere detaljeret i, hvad der specifikt er de bedste Humans + AI-tænkningsstrukturer.

Disse vil være grundlaget for den næste fase af øget menneskelig intelligens.

Chain-of-Thought til AI-forbedret menneskelig tænkning

Koncepterne fra Chain-of-Thought blev udviklet for at forbedre de selvstændige muligheder for LLM'er.

Men de viser sig også at være uhyre værdifulde til at maksimere værdien af, at mennesker og AI arbejder sammen.

Der er en række teknikker til at anvende Chain-of-Thought-strukturer på mennesker + AI-tænkning.

AI-koncepter anvendt til øget intelligens

LLM'er kan bruges til at foreslå, hvordan opgaver kan dekomponeres i sekventielle (eller netværks-) elementer, hvor enten mennesker eller AI identificerer, hvor menneskelige eller AI-evner kan være bedst egnede.

En specifik tilgang er beskrevet i Menneske-i-løkken gennem Chain-of-Thought, hvor "manuel korrektion af sub-logikker i rationaler kan forbedre LLM's ræsonnement ydeevne."

At "ramme" målene, opgaven og strukturen, som vist i Humans + AI workflow-diagrammet, driver kvaliteten af resultaterne. Dette overvåges normalt bedst af mennesker ved hjælp af flows såsom AI, der foreslår eller vurderer parametre.

Jeg inkorporerer disse og andre tilgange i et sæt "AI-Enhanced Thinking Patterns".

Mere generelt kan en lang række AI-fremskridt, ikke kun Chain-of-Thought, anvendes ekstremt nyttigt til at øge menneskelig intelligens.

Jeg agter at skrive en lignende artikel om anvendelse af begreberne Generative kontradiktoriske netværk til Human-AI symbiotisk intelligens strukturer.

Kursus om AI-forbedret tænkning og beslutningstagning

Mit fulde fokus i 2024 er, hvordan AI kan forstærke mennesker.

En af mine centrale aktiviteter er at køre et almindeligt kohortekursus om Maven: AI-forbedret tænkning og beslutningstagning. Tjek linket for flere detaljer.

Næste årgang starter 8. februar Som tak fordi du læser med til slutningen af denne artikel, kan du få 30% rabat ved at bruge kuponen: COTARTICLE 🙂.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://rossdawson.com/applying-chain-of-thought-to-ai-enhanced-human-thinking/

- :har

- :er

- :ikke

- :hvor

- 2022

- 2024

- 8

- a

- Om

- opnå

- opnået

- tværs

- aktiviteter

- tilpasset

- adresse

- fremme

- fremskridt

- kontradiktorisk

- siden

- AI

- AI modeller

- sigte

- Alle

- næsten

- alene

- allerede

- også

- am

- ambition

- forstærke

- an

- ,

- enhver

- applikationer

- anvendt

- Anvendelse

- tilgang

- tilgange

- ER

- artikel

- kunstig

- kunstig generel intelligens

- AS

- Vurdering

- At

- forøge

- augmented

- BE

- været

- bag

- jf. nedenstående

- BEDSTE

- Bedre

- både

- Bygning

- bygget

- men

- by

- CAN

- Kan få

- kapaciteter

- Kapacitet

- central

- kæde

- kæder

- kontrollere

- kohorte

- fuldføre

- Compute

- Konceptet

- begreber

- fortsatte

- kunne

- kupon

- kursus

- skabe

- oprettet

- Derivater

- beskrevet

- designe

- detail

- detaljer

- udviklet

- Udvikling

- udvikling

- direkte

- Rabat

- do

- gør

- gør

- Domæner

- Doug

- drev

- kørsel

- hver

- Tidligt

- Effektiv

- effektiv

- enten

- elementer

- opstået

- aktiveret

- ende

- energi

- forbedre

- lige

- Ether (ETH)

- Hver

- eksempler

- overstige

- fremragende

- ekstremt

- berømt

- langt

- februar

- Fornavn

- Flowing

- strømme

- Fokus

- følger

- Til

- Tving

- Fonde

- Framework

- hyppig

- fra

- Generelt

- generel intelligens

- generelt

- genererer

- generation

- generative

- Generativ AI

- få

- Have

- Hjerte

- højt niveau

- Hvordan

- HTTPS

- menneskelig

- menneskelig intelligens

- Mennesker

- i

- SYG

- identificere

- if

- billede

- uhyre

- vigtigt

- Forbedre

- forbedring

- in

- omfatter

- Herunder

- indarbejde

- inkorporering

- uundgåeligt

- innovationer

- Intelligens

- hensigt

- interesseret

- Mellem

- ind

- involvere

- ITS

- januar

- lige

- Labs

- vartegn

- Sprog

- stor

- største

- føre

- Leads

- læring

- mindst

- Sandsynlig

- begrænsninger

- LINK

- Se

- Maskiner

- mange

- Maven

- max-bredde

- maksimere

- Kan..

- betyder

- model

- modeller

- mere

- mest

- flere

- my

- nødvendigvis

- net

- NeurIPS

- næste

- nummer

- målsætninger

- Obvious

- of

- off

- on

- engang

- or

- Andet

- ud

- udfald

- udgange

- håndflade

- Papir

- parametre

- især

- sti

- stier

- Mennesker

- ydeevne

- fase

- plato

- Platon Data Intelligence

- PlatoData

- fattige

- mulig

- potentielt

- Praktisk

- Problem

- problemløsning

- behandle

- Processer

- Progress

- lovende

- foreslå

- Bevise

- bevist

- give

- sætte

- Puslespil

- kvalitet

- hurtigt

- rækkevidde

- hellere

- Læsning

- nylige

- fast

- relaterede

- pålidelighed

- stole

- erstatte

- højre

- runder

- kører

- scenarie

- synes

- set

- udvælgelse

- Series

- sæt

- bør

- vist

- Shows

- lignende

- enkelt

- Størrelse

- So

- Løsning

- specifikke

- specifikt

- starter

- Trin

- struktur

- struktureret

- strukturer

- væsentligt

- sådan

- tyder

- overlegen

- sikker

- symbiotisk

- Opgaver

- opgaver

- teknikker

- tekst

- tekstgenerering

- end

- takke

- at

- deres

- derefter

- Disse

- de

- Tænker

- denne

- tænkte

- Gennem

- til

- sammen

- mod

- bane

- forståelig

- brug

- anvendte

- ved brug af

- sædvanligvis

- Værdifuld

- værdi

- variationer

- række

- meget

- Specifikation

- var

- Vej..

- måder

- we

- GODT

- var

- Hvad

- hvornår

- som

- bred

- vilje

- med

- inden for

- Arbejde

- workflow

- arbejdsgange

- arbejder

- skriver

- år

- dig

- zephyrnet