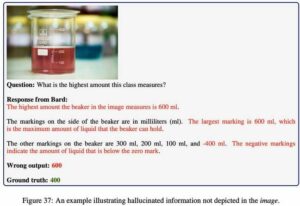

ইউনিভার্সিটি অফ শিকাগো বফিনস এই সপ্তাহে নাইটশেড 1.0 প্রকাশ করেছে, যা মেশিন লার্নিং মডেলের অসাধু নির্মাতাদের শাস্তি দেওয়ার জন্য তৈরি একটি টুল যারা প্রথমে অনুমতি না নিয়েই ডেটাতে তাদের সিস্টেমকে প্রশিক্ষণ দেয়।

নিদ্রা উদ্রেককর লতা একটি আক্রমণাত্মক ডেটা বিষক্রিয়ার সরঞ্জাম, যাকে বলা হয় একটি প্রতিরক্ষামূলক শৈলী সুরক্ষা সরঞ্জামের সহচর৷ চকচকে, যা নিবন্ধনকর্মী আবৃত গত বছরের ফেব্রুয়ারিতে।

নাইটশেড ইমেজ ফাইলগুলিকে বিষাক্ত করে যাতে মডেলগুলিকে বদহজম হয় যেগুলি অনুমতি ছাড়াই ডেটা গ্রহণ করে৷ এটি সেই প্রশিক্ষণের ইমেজ-ভিত্তিক মডেলগুলিকে তাদের কাজের ব্যবহার সম্পর্কে বিষয়বস্তু নির্মাতাদের ইচ্ছাকে সম্মান করার উদ্দেশ্যে করা হয়েছে।

"নাইটশেডকে একটি মাল্টি-অবজেক্টিভ অপ্টিমাইজেশান হিসাবে গণনা করা হয় যা মূল ছবিতে দৃশ্যমান পরিবর্তনগুলিকে কমিয়ে দেয়," বলেছেন প্রকল্পের জন্য দায়ী দল।

"উদাহরণস্বরূপ, মানুষের চোখ একটি সবুজ মাঠে একটি গরুর ছায়াযুক্ত ছবি দেখতে পারে যা অনেকটাই অপরিবর্তিত, কিন্তু একটি এআই মডেল ঘাসের মধ্যে একটি বড় চামড়ার পার্স দেখতে পারে। "

নাইটশেডটি শিকাগো বিশ্ববিদ্যালয়ের ডক্টরাল ছাত্র শন শান, ওয়েনক্সিন ডিং এবং জোসেফাইন পাসান্তি এবং অধ্যাপক হিদার ঝেং এবং বেন ঝাও দ্বারা তৈরি করা হয়েছিল, যাদের মধ্যে কেউ কেউ গ্লেজের সাথেও সহায়তা করেছিলেন।

বর্ণিত গবেষণা পত্র 2023 সালের অক্টোবরে, নাইটশেড একটি প্রম্পট-নির্দিষ্ট বিষের আক্রমণ। একটি ইমেজকে বিষাক্ত করার জন্য একটি লেবেল (যেমন একটি বিড়াল) বাছাই করা জড়িত যেটি বর্ণনা করে যে বাস্তবে কী চিত্রিত করা হয়েছে যাতে সেই ধারণাটির সীমানা ঝাপসা করা যায় যখন ছবিটি মডেল প্রশিক্ষণের জন্য গ্রহণ করা হয়।

তাই নাইটশেড বিষাক্ত চিত্রগুলিতে প্রশিক্ষণপ্রাপ্ত একটি মডেলের ব্যবহারকারী একটি বিড়ালের জন্য একটি প্রম্পট জমা দিতে পারে এবং একটি কুকুর বা মাছের একটি চিত্রের বিজ্ঞপ্তি পেতে পারে৷ এই ধরণের অপ্রত্যাশিত প্রতিক্রিয়া টেক্সট-টু-ইমেজ মডেলগুলিকে উল্লেখযোগ্যভাবে কম উপযোগী করে তোলে, যার মানে মডেল নির্মাতাদের একটি প্রণোদনা নিশ্চিত করার জন্য যে তারা শুধুমাত্র অবাধে অফার করা ডেটার উপর প্রশিক্ষণ দেয়।

"নাইটশেড কন্টেন্ট মালিকদের মডেল প্রশিক্ষকদের বিরুদ্ধে তাদের বৌদ্ধিক সম্পত্তি রক্ষা করার জন্য একটি শক্তিশালী হাতিয়ার প্রদান করতে পারে যারা কপিরাইট নোটিশ, স্ক্র্যাপ/ক্রল করার নির্দেশনা এবং অপ্ট-আউট তালিকাগুলিকে উপেক্ষা করে বা উপেক্ষা করে," লেখক তাদের গবেষণাপত্রে বলেছেন।

শিল্পকর্ম নির্মাতা এবং মালিকদের ইচ্ছা বিবেচনা করতে ব্যর্থতা একটি মামলার দিকে পরিচালিত করে গত বছর দায়ের করা হয়েছে, AI ব্যবসার সুবিধার জন্য ডেটার অনুমতিহীন সংগ্রহের বিরুদ্ধে একটি বিস্তৃত পুশব্যাকের অংশ। স্ট্যাবিলিটি এআই, ডেভিয়েন্ট আর্ট এবং মিডজার্নির বিরুদ্ধে বেশ কয়েকজন শিল্পীর পক্ষে করা লঙ্ঘনের দাবি, অভিযোগ করা হয়েছে যে বিবাদী সংস্থাগুলি দ্বারা ব্যবহৃত স্টেবল ডিফিউশন মডেল অনুমতি ছাড়াই শিল্পীদের কাজকে অন্তর্ভুক্ত করে। মামলাটি, 2023 সালের নভেম্বরে একটি নতুন বিবাদী, রানওয়ে এআইকে অন্তর্ভুক্ত করার জন্য সংশোধন করা হয়েছিল। চলতে মামলা করা

লেখকরা সতর্ক করেছেন যে নাইটশেডের কিছু সীমাবদ্ধতা রয়েছে। বিশেষত, সফ্টওয়্যার দিয়ে প্রক্রিয়া করা ছবিগুলি মূল থেকে সূক্ষ্মভাবে আলাদা হতে পারে, বিশেষ করে আর্টওয়ার্ক যা সমতল রঙ এবং মসৃণ ব্যাকগ্রাউন্ড ব্যবহার করে। এছাড়াও, তারা পর্যবেক্ষণ করে যে নাইটশেডকে পূর্বাবস্থায় ফিরিয়ে আনার কৌশলগুলি বিকশিত হতে পারে, যদিও তারা বিশ্বাস করে যে তারা তাদের সফ্টওয়্যারগুলিকে পাল্টা ব্যবস্থার সাথে তাল মিলিয়ে চলতে পারে।

আলবার্টা বিশ্ববিদ্যালয়ের কম্পিউটার বিজ্ঞানের সহকারী অধ্যাপক ম্যাথিউ গুজডিয়াল একটি সামাজিক যোগাযোগ মাধ্যমে বলেছেন পোস্ট, “এটি দুর্দান্ত এবং সময়োপযোগী কাজ! কিন্তু আমি উদ্বিগ্ন যে এটি সমাধান হিসাবে অতিরিক্ত হাইপড হচ্ছে। এটি শুধুমাত্র CLIP-ভিত্তিক মডেলগুলির সাথে কাজ করে এবং লেখকদের মতে, LAION মডেলগুলির জন্য অনুরূপ ছবি তৈরিতে উল্লেখযোগ্য প্রভাব ফেলতে 8 মিলিয়ন ছবি 'বিষাক্ত' প্রয়োজন।"

গ্লেজ, যা গত জুনে 1.0 এ পৌঁছেছে একটি ওয়েব সংস্করণ, এবং এখন তার উপর আছে 1.1.1 রিলিজ, সেই চিত্রগুলিতে প্রশিক্ষিত মডেলগুলিকে শিল্পীর ভিজ্যুয়াল শৈলীর প্রতিলিপি করা থেকে বিরত রাখতে চিত্রগুলিকে পরিবর্তন করে৷

শৈলীর অনুকরণ - মিডজার্নির মতো বন্ধ পাঠ্য-টু-ইমেজ পরিষেবাগুলির মাধ্যমে এবং স্থির ডিফিউশনের মতো ওপেন-সোর্স মডেলগুলির মাধ্যমে উপলব্ধ - কেবলমাত্র একটি নির্দিষ্ট শিল্পীর শৈলীতে একটি চিত্র তৈরি করার জন্য একটি পাঠ্য-টু-ইমেজ মডেলকে অনুরোধ করার মাধ্যমে সম্ভব।

দলটি বিশ্বাস করে যে শিল্পীদের তাদের চাক্ষুষ শৈলীর ক্যাপচার এবং পুনরুত্পাদন রোধ করার একটি উপায় থাকা উচিত।

"শৈলীর অনুকরণ অনেকগুলি ক্ষতিকারক ফলাফল তৈরি করে যা প্রথম নজরে স্পষ্ট নাও হতে পারে," বফিন বলে। “যে শিল্পীদের শৈলী ইচ্ছাকৃতভাবে অনুলিপি করা হয়, তারা কেবল কমিশন এবং মৌলিক আয়ের ক্ষতিই দেখেন না, কিন্তু অনলাইনে ছড়িয়ে ছিটিয়ে থাকা নিম্নমানের সিন্থেটিক কপিগুলি তাদের ব্র্যান্ড এবং খ্যাতি কমিয়ে দেয়। সবচেয়ে বড় কথা, শিল্পীরা তাদের শৈলীকে তাদের পরিচয়ের সাথে যুক্ত করে।

তারা শৈলীর অনুকরণকে পরিচয় চুরির সাথে তুলনা করে এবং বলে যে এটি উচ্চাকাঙ্ক্ষী শিল্পীদের নতুন কাজ তৈরি করতে নিরুৎসাহিত করে।

দলটি সুপারিশ করে যে শিল্পীরা নাইটশেড এবং গ্লেজ উভয়ই ব্যবহার করেন। বর্তমানে দুটি টুল আলাদাভাবে ডাউনলোড এবং ইনস্টল করতে হবে, তবে একটি সম্মিলিত সংস্করণ তৈরি করা হচ্ছে। ®

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://go.theregister.com/feed/www.theregister.com/2024/01/20/nightshade_ai_images/

- : আছে

- : হয়

- :না

- 1

- 2023

- 8

- a

- সম্পর্কে

- প্রকৃতপক্ষে

- খাপ খাওয়ানো

- বিরুদ্ধে

- AI

- আলবার্তো

- অভিযোগ

- এছাড়াও

- an

- এবং

- রয়েছি

- শিল্প

- শিল্পী

- শিল্পী

- আর্টওয়ার্ক

- AS

- উচ্চাকাঙ্ক্ষী

- সহায়ক

- সহযোগী

- At

- আক্রমণ

- লেখক

- সহজলভ্য

- ব্যাকগ্রাউন্ড

- মৌলিক

- মৌলিক আয়

- BE

- হয়েছে

- পক্ষ

- হচ্ছে

- বিশ্বাস করা

- বেন

- সুবিধা

- দাগ

- উভয়

- সীমানা

- তরবার

- বৃহত্তর

- নির্মিত

- ব্যবসা

- কিন্তু

- by

- নামক

- CAN

- গ্রেপ্তার

- কেস

- ক্যাট

- সাবধানতা

- পরিবর্তন

- শিকাগো

- দাবি

- বন্ধ

- CO

- মিলিত

- কমিশন

- সহচর

- কম্পিউটার

- কম্পিউটার বিজ্ঞান

- ধারণা

- বিবেচনা

- বিষয়বস্তু

- কন্টেন্ট সৃষ্টিকর্তা

- বিষয়বস্তুর মালিকরা

- শীতল

- কপি

- কপিরাইট

- সৃষ্টি

- স্রষ্টাগণ

- cs

- উপাত্ত

- আত্মরক্ষামূলক

- বর্ণনা

- উন্নত

- বিভিন্ন

- আশ্লেষ

- নির্দেশনা

- do

- না

- কুকুর

- e

- প্রতি

- নিশ্চিত করা

- থার (eth)

- উদাহরণ

- চোখ

- ব্যর্থতা

- ফেব্রুয়ারি

- ক্ষেত্র

- নথি পত্র

- সংস্থাগুলো

- প্রথম

- মাছ

- ফ্ল্যাট

- জন্য

- অবাধে

- থেকে

- উৎপাদিত

- পেয়ে

- দাও

- এক পলক দেখা

- ঘাস

- Green

- ক্ষতিকর

- ফসল

- আছে

- সাহায্য

- এইচটিএমএল

- HTTPS দ্বারা

- মানবীয়

- i

- পরিচয়

- পরিচয় প্রতারণা

- উপেক্ষা করা

- ভাবমূর্তি

- চিত্র

- প্রভাব

- গুরুত্বপূর্ণভাবে

- in

- উদ্দীপক

- অন্তর্ভুক্ত করা

- আয়

- অন্তর্ভুক্ত

- লঙ্ঘন

- বুদ্ধিজীবী

- বুদ্ধিজীবী সম্পত্তি

- অভিপ্রেত

- ইচ্ছাকৃতভাবে

- জড়িত

- IT

- এর

- JPG

- জুন

- রাখা

- লেবেল

- বড়

- মূলত

- গত

- গত বছর

- মামলা

- শিক্ষা

- বরফ

- কম

- মত

- সীমাবদ্ধতা

- পাখি

- ক্ষতি

- কম

- মেশিন

- মেশিন লার্নিং

- প্রণীত

- করা

- প্রস্তুতকর্তা

- মে..

- মানে

- মিডিয়া

- মিডজার্নি

- হতে পারে

- মিলিয়ন

- ছোট

- অপব্যবহার

- মডেল

- মডেল

- সেতু

- অবশ্যই

- নতুন

- প্রজ্ঞাপন

- নভেম্বর

- এখন

- সংখ্যা

- মান্য করা

- সুস্পষ্ট

- অক্টোবর

- of

- আক্রমণাত্মক

- প্রদত্ত

- on

- অনলাইন

- কেবল

- ওপেন সোর্স

- অপ্টিমাইজেশান

- or

- ক্রম

- মূল

- ফলাফল

- মালিকদের

- গতি

- কাগজ

- অংশ

- বিশেষত

- প্রতি

- অনুমতি

- অনুমতিহীন

- অবচয়

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- বিষ

- সম্ভব

- ক্ষমতাশালী

- বর্তমানে

- প্রতিরোধ

- প্রক্রিয়াজাত

- উৎপাদন করা

- উত্পাদন করে

- অধ্যাপক

- প্রকল্প

- সম্পত্তি

- রক্ষা করা

- রক্ষা

- প্রদান

- টাকার থলি

- গুণ

- পৌঁছেছে

- গ্রহণ করা

- বিশেষ পরামর্শ দেওয়া হচ্ছে

- মুক্ত

- প্রতিলিপি

- খ্যাতি

- প্রয়োজন

- সম্মান

- প্রতিক্রিয়া

- দায়ী

- বিমানের নির্মিত পথ

- s

- বলেছেন

- বলা

- বিক্ষিপ্ত

- বিজ্ঞান

- দেখ

- সেবা

- বিভিন্ন

- শন

- উচিত

- গুরুত্বপূর্ণ

- উল্লেখযোগ্যভাবে

- অনুরূপ

- কেবল

- মসৃণ

- সামাজিক

- সামাজিক মাধ্যম

- সফটওয়্যার

- সমাধান

- কিছু

- নির্দিষ্ট

- বিশেষভাবে

- স্থায়িত্ব

- স্থিতিশীল

- রাষ্ট্র

- শিক্ষার্থীরা

- শৈলী

- শৈলী

- জমা

- কৃত্রিম

- সিস্টেম

- টীম

- প্রযুক্তি

- যে

- সার্জারির

- চুরি

- তাদের

- তারা

- এই

- এই সপ্তাহ

- সেগুলো

- যদিও?

- দ্বারা

- সময়োপযোগী

- থেকে

- টুল

- সরঞ্জাম

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- দুই

- বিশ্ববিদ্যালয়

- শিকাগো বিশ্ববিদ্যালয়

- অনিশ্চিত

- ব্যবহার

- ব্যবহৃত

- দরকারী

- ব্যবহারকারী

- ব্যবহারসমূহ

- সংস্করণ

- খুব

- দৃশ্যমান

- চাক্ষুষ

- ছিল

- উপায়..

- ওয়েব

- সপ্তাহান্তিক কাল

- কি

- কখন

- যে

- হু

- যাদের

- যাহার

- ইচ্ছাকে

- সঙ্গে

- ছাড়া

- হয়া যাই ?

- কাজ

- চিন্তা

- would

- বছর

- zephyrnet

- ঝাও