এই পোস্টে, আমরা মডেলের কর্মক্ষমতা উন্নত করতে এবং অনুমানের সময় কমাতে একটি সূক্ষ্ম-টিউনড BERT মডেলকে সংকুচিত করতে কীভাবে নিউরাল আর্কিটেকচার সার্চ (NAS) ভিত্তিক কাঠামোগত ছাঁটাই ব্যবহার করতে হয় তা প্রদর্শন করি। প্রাক-প্রশিক্ষিত ভাষা মডেলগুলি (PLMs) উত্পাদনশীলতা সরঞ্জাম, গ্রাহক পরিষেবা, অনুসন্ধান এবং সুপারিশ, ব্যবসায়িক প্রক্রিয়া অটোমেশন এবং সামগ্রী তৈরির ক্ষেত্রে দ্রুত বাণিজ্যিক এবং এন্টারপ্রাইজ গ্রহণের মধ্য দিয়ে যাচ্ছে। PLM ইনফারেন্স এন্ডপয়েন্ট স্থাপন করা সাধারণত উচ্চতর লেটেন্সি এবং উচ্চ পরিকাঠামো খরচের সাথে যুক্ত থাকে কারণ গণনার প্রয়োজনীয়তা এবং সংখ্যক পরামিতির কারণে কম্পিউটেশনাল দক্ষতা কমে যায়। একটি PLM ছাঁটাই তার ভবিষ্যদ্বাণী করার ক্ষমতা বজায় রেখে মডেলের আকার এবং জটিলতা হ্রাস করে। ছাঁটাই করা PLMগুলি একটি ছোট মেমরির পদচিহ্ন এবং কম লেটেন্সি অর্জন করে। আমরা একটি PLM ছাঁটাই করে এবং একটি নির্দিষ্ট টার্গেট টাস্কের জন্য প্যারামিটার গণনা এবং বৈধতা ত্রুটি ট্রেড করার মাধ্যমে প্রদর্শন করি এবং বেস PLM মডেলের তুলনায় দ্রুত প্রতিক্রিয়ার সময় অর্জন করতে সক্ষম।

মাল্টি-অবজেক্টিভ অপ্টিমাইজেশান হল সিদ্ধান্ত গ্রহণের একটি ক্ষেত্র যা একাধিক উদ্দেশ্যমূলক ফাংশন যেমন মেমরি খরচ, প্রশিক্ষণের সময় এবং গণনা সংস্থানগুলিকে একই সাথে অপ্টিমাইজ করার জন্য অপ্টিমাইজ করে। স্ট্রাকচারাল প্রুনিং হল মডেলের নির্ভুলতা রক্ষা করার চেষ্টা করার সময় স্তর বা নিউরন/নোড ছাঁটাই করে পিএলএম-এর আকার এবং গণনাগত প্রয়োজনীয়তা হ্রাস করার একটি কৌশল। স্তরগুলি অপসারণ করে, কাঠামোগত ছাঁটাই উচ্চ কম্প্রেশন হার অর্জন করে, যা হার্ডওয়্যার-বান্ধব কাঠামোগত স্প্যার্সিটির দিকে নিয়ে যায় যা রানটাইম এবং প্রতিক্রিয়া সময় হ্রাস করে। একটি PLM মডেলে একটি কাঠামোগত ছাঁটাই কৌশল প্রয়োগ করার ফলে একটি কম মেমরির ফুটপ্রিন্ট সহ একটি হালকা-ওজন মডেল তৈরি হয় যা, যখন SageMaker-এ একটি অনুমান শেষ পয়েন্ট হিসাবে হোস্ট করা হয়, তখন মূল সূক্ষ্ম-টিউনড PLM-এর সাথে তুলনা করলে উন্নত সম্পদ দক্ষতা এবং কম খরচ হয়৷

এই পোস্টে চিত্রিত ধারণাগুলি PLM বৈশিষ্ট্যগুলি ব্যবহার করে এমন অ্যাপ্লিকেশনগুলিতে প্রয়োগ করা যেতে পারে, যেমন সুপারিশ সিস্টেম, অনুভূতি বিশ্লেষণ এবং অনুসন্ধান ইঞ্জিন। বিশেষভাবে, আপনি এই পদ্ধতিটি ব্যবহার করতে পারেন যদি আপনার ডেডিকেটেড মেশিন লার্নিং (ML) এবং ডেটা সায়েন্স টিম থাকে যারা ডোমেন-নির্দিষ্ট ডেটাসেট ব্যবহার করে তাদের নিজস্ব PLM মডেলগুলিকে সূক্ষ্ম-সুরিয়ে তোলে এবং ব্যবহার করে বিপুল সংখ্যক অনুমান শেষ পয়েন্ট স্থাপন করে আমাজন সেজমেকার. একটি উদাহরণ হল একজন অনলাইন খুচরা বিক্রেতা যিনি পাঠ্য সংক্ষিপ্তকরণ, পণ্যের ক্যাটালগ শ্রেণীবিভাগ, এবং পণ্য প্রতিক্রিয়া অনুভূতি শ্রেণীবিভাগের জন্য বিপুল সংখ্যক অনুমান শেষ পয়েন্ট স্থাপন করেন। আরেকটি উদাহরণ হতে পারে একজন স্বাস্থ্যসেবা প্রদানকারী যিনি ক্লিনিকাল ডকুমেন্টের শ্রেণীবিভাগের জন্য PLM ইনফারেন্স এন্ডপয়েন্ট ব্যবহার করেন, মেডিক্যাল রিপোর্ট, মেডিকেল চ্যাটবট এবং রোগীর ঝুঁকি স্তরবিন্যাস থেকে নামকৃত সত্তা স্বীকৃতি।

সমাধান ওভারভিউ

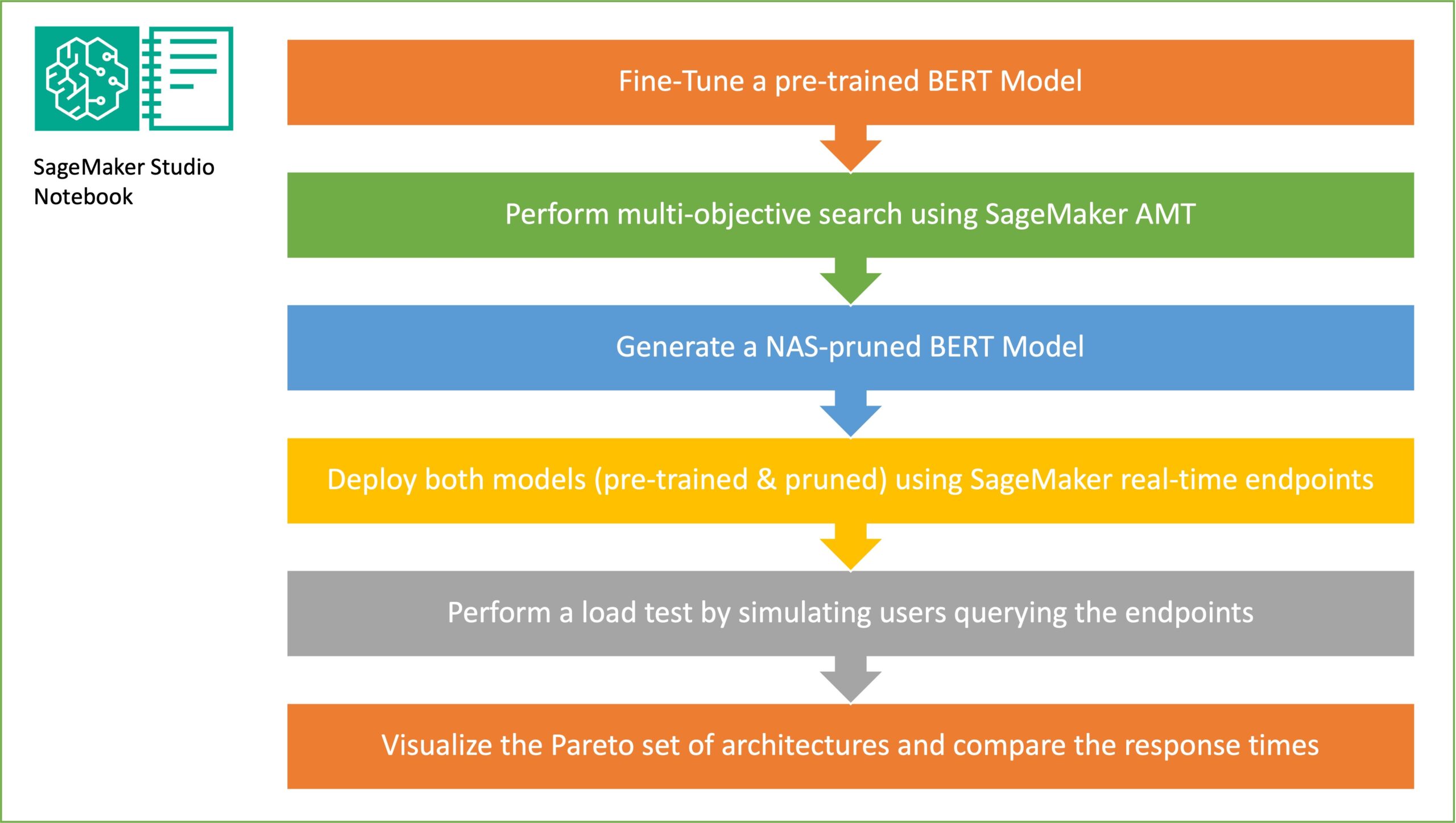

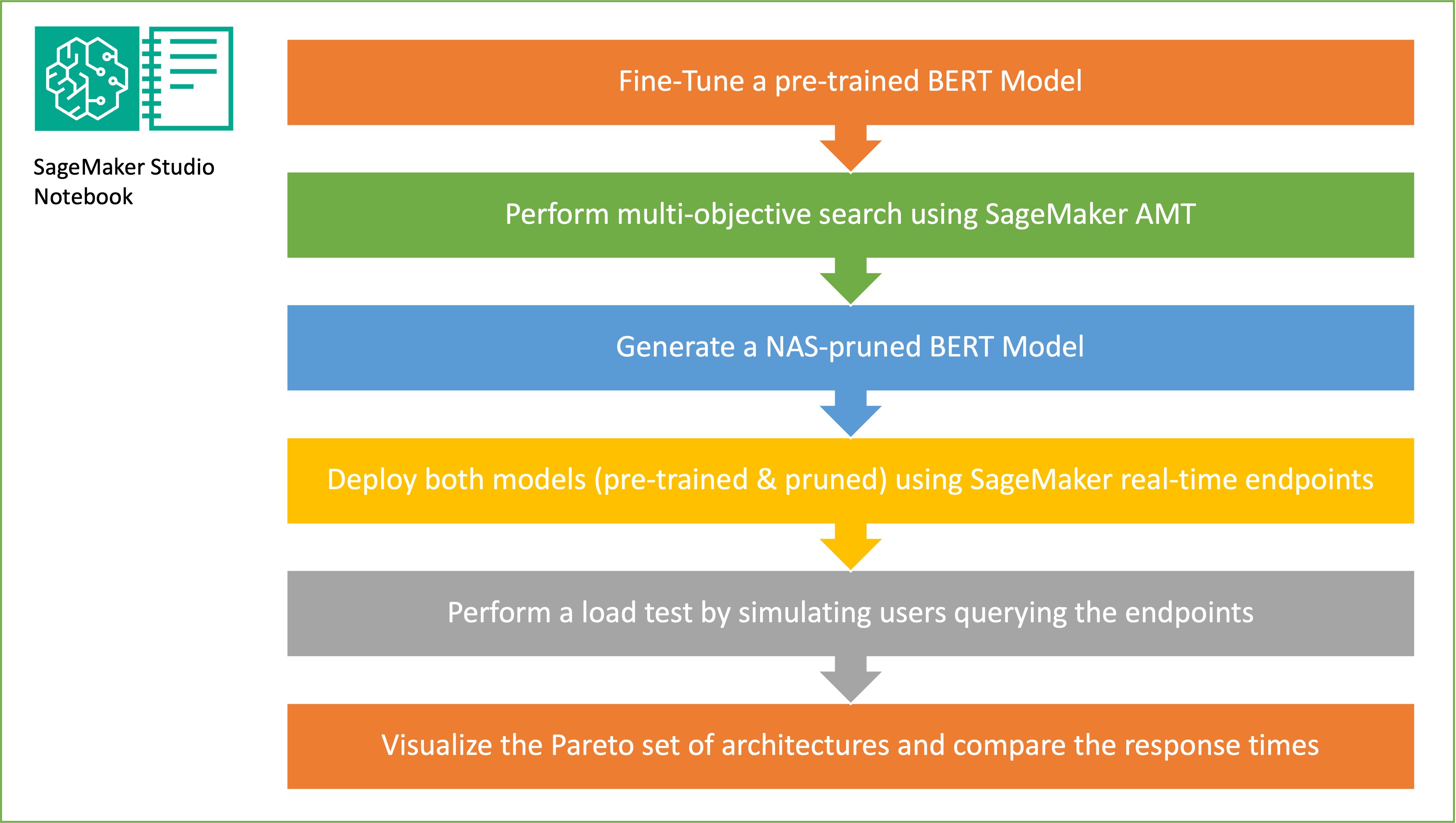

এই বিভাগে, আমরা সামগ্রিক কর্মপ্রবাহ উপস্থাপন করি এবং পদ্ধতির ব্যাখ্যা করি। প্রথমত, আমরা একটি ব্যবহার করি অ্যামাজন সেজমেকার স্টুডিও নোটবই একটি ডোমেন-নির্দিষ্ট ডেটাসেট ব্যবহার করে লক্ষ্য টাস্কে একটি প্রাক-প্রশিক্ষিত BERT মডেলকে সূক্ষ্ম-টিউন করতে। বার্ট (ট্রান্সফরমার থেকে দ্বিমুখী এনকোডার প্রতিনিধিত্ব) একটি প্রাক-প্রশিক্ষিত ভাষার মডেল ট্রান্সফরমার আর্কিটেকচার প্রাকৃতিক ভাষা প্রক্রিয়াকরণ (NLP) কাজের জন্য ব্যবহৃত হয়। নিউরাল আর্কিটেকচার সার্চ (NAS) হল কৃত্রিম নিউরাল নেটওয়ার্কের ডিজাইন স্বয়ংক্রিয় করার জন্য একটি পদ্ধতি এবং এটি হাইপারপ্যারামিটার অপ্টিমাইজেশনের সাথে ঘনিষ্ঠভাবে সম্পর্কিত, যা মেশিন লার্নিং এর ক্ষেত্রে একটি বহুল ব্যবহৃত পদ্ধতি। NAS-এর লক্ষ্য হল গ্রেডিয়েন্ট-মুক্ত অপ্টিমাইজেশন বা পছন্দসই মেট্রিক্স অপ্টিমাইজ করার মতো কৌশলগুলি ব্যবহার করে প্রার্থী আর্কিটেকচারের একটি বড় সেট অনুসন্ধান করে প্রদত্ত সমস্যার জন্য সর্বোত্তম আর্কিটেকচার খুঁজে বের করা। স্থাপত্যের কর্মক্ষমতা সাধারণত মেট্রিক্স ব্যবহার করে পরিমাপ করা হয় যেমন বৈধতা ক্ষতি। সেজমেকার স্বয়ংক্রিয় মডেল টিউনিং (AMT) এমএল মডেলের হাইপারপ্যারামিটারের সর্বোত্তম সংমিশ্রণ খুঁজে বের করার ক্লান্তিকর এবং জটিল প্রক্রিয়াটিকে স্বয়ংক্রিয় করে যা সেরা মডেলের কর্মক্ষমতা প্রদান করে। AMT বুদ্ধিমান অনুসন্ধান অ্যালগরিদম ব্যবহার করে এবং আপনার নির্দিষ্ট করা হাইপারপ্যারামিটারের একটি পরিসর ব্যবহার করে পুনরাবৃত্তিমূলক মূল্যায়ন করে। এটি হাইপারপ্যারামিটার মানগুলি বেছে নেয় যা একটি মডেল তৈরি করে যা সর্বোত্তম কার্য সম্পাদন করে, যেমন নির্ভুলতা এবং F-1 স্কোরের মতো পারফরম্যান্স মেট্রিক্স দ্বারা পরিমাপ করা হয়।

এই পোস্টে বর্ণিত ফাইন-টিউনিং পদ্ধতিটি জেনেরিক এবং যেকোনো পাঠ্য-ভিত্তিক ডেটাসেটে প্রয়োগ করা যেতে পারে। BERT PLM-এর জন্য নির্ধারিত কাজটি একটি পাঠ্য-ভিত্তিক কাজ হতে পারে যেমন অনুভূতি বিশ্লেষণ, পাঠ্য শ্রেণিবিন্যাস বা প্রশ্নোত্তর। এই ডেমোতে, টার্গেট টাস্ক হল একটি বাইনারি ক্লাসিফিকেশন সমস্যা যেখানে BERT একটি ডেটাসেট থেকে শনাক্ত করতে ব্যবহৃত হয় যেটি টেক্সট ফ্র্যাগমেন্টের জোড়ার সংগ্রহ নিয়ে গঠিত, একটি টেক্সট ফ্র্যাগমেন্টের অর্থ অন্য খণ্ড থেকে অনুমান করা যায় কিনা। আমরা ব্যবহার করি পাঠ্য এনটেইলমেন্ট ডেটাসেট স্বীকৃতি GLUE বেঞ্চমার্কিং স্যুট থেকে। আমরা সাব-নেটওয়ার্কগুলি সনাক্ত করতে সেজমেকার AMT ব্যবহার করে একটি মাল্টি-অবজেক্টিভ অনুসন্ধান করি যা লক্ষ্য কাজের জন্য প্যারামিটার গণনা এবং পূর্বাভাস নির্ভুলতার মধ্যে সর্বোত্তম ট্রেড-অফ অফার করে। একটি বহু-উদ্দেশ্য অনুসন্ধান সম্পাদন করার সময়, আমরা সঠিকতা এবং পরামিতি গণনাকে উদ্দেশ্য হিসাবে সংজ্ঞায়িত করে শুরু করি যা আমরা অপ্টিমাইজ করার লক্ষ্য রাখি।

BERT PLM নেটওয়ার্কের মধ্যে, মডুলার, স্বয়ংসম্পূর্ণ সাব-নেটওয়ার্ক থাকতে পারে যা মডেলটিকে ভাষা বোঝা এবং জ্ঞান উপস্থাপনের মতো বিশেষ ক্ষমতা থাকতে দেয়। BERT PLM একটি বহুমুখী স্ব-মনোযোগ সাব-নেটওয়ার্ক এবং একটি ফিড-ফরোয়ার্ড সাব-নেটওয়ার্ক ব্যবহার করে। একটি বহুমুখী, স্ব-মনোযোগ স্তর BERT-কে একটি একক অনুক্রমের বিভিন্ন অবস্থানের সাথে সম্পর্ক স্থাপন করতে দেয় যাতে একাধিক হেডকে একাধিক প্রসঙ্গ সংকেতে উপস্থিত থাকার অনুমতি দিয়ে অনুক্রমের একটি উপস্থাপনা গণনা করা যায়। ইনপুটটিকে একাধিক সাবস্পেসে বিভক্ত করা হয় এবং প্রতিটি সাবস্পেসে আলাদাভাবে স্ব-মনোযোগ প্রয়োগ করা হয়। একটি ট্রান্সফরমার PLM-এ একাধিক হেড মডেলটিকে যৌথভাবে বিভিন্ন প্রতিনিধিত্বমূলক সাবস্পেস থেকে তথ্যে উপস্থিত থাকতে দেয়। একটি ফিড-ফরোয়ার্ড সাব-নেটওয়ার্ক হল একটি সাধারণ নিউরাল নেটওয়ার্ক যা মাল্টি-হেডেড সেলফ-অ্যাটেনশন সাব-নেটওয়ার্ক থেকে আউটপুট নেয়, ডেটা প্রক্রিয়া করে এবং চূড়ান্ত এনকোডার উপস্থাপনা প্রদান করে।

র্যান্ডম সাব-নেটওয়ার্ক স্যাম্পলিংয়ের লক্ষ্য হল ছোট BERT মডেলগুলিকে প্রশিক্ষণ দেওয়া যা লক্ষ্য কাজগুলিতে যথেষ্ট ভাল করতে পারে। আমরা ফাইন-টিউনড বেস BERT মডেল থেকে 100টি র্যান্ডম সাব-নেটওয়ার্কের নমুনা করি এবং একই সাথে 10টি নেটওয়ার্ক মূল্যায়ন করি। প্রশিক্ষিত সাব-নেটওয়ার্কগুলি উদ্দেশ্য মেট্রিক্সের জন্য মূল্যায়ন করা হয় এবং উদ্দেশ্য মেট্রিক্সের মধ্যে পাওয়া ট্রেড-অফের উপর ভিত্তি করে চূড়ান্ত মডেলটি বেছে নেওয়া হয়। আমরা কল্পনা পারেতো সামনে নমুনাযুক্ত সাব-নেটওয়ার্কগুলির জন্য, যাতে ছাঁটাই করা মডেল রয়েছে যা মডেলের সঠিকতা এবং মডেলের আকারের মধ্যে সর্বোত্তম ট্রেড-অফ প্রদান করে। আমরা যে মডেলের আকার এবং মডেল নির্ভুলতার উপর ভিত্তি করে প্রার্থী সাব-নেটওয়ার্ক (NAS-প্রুনড BERT মডেল) নির্বাচন করি যা আমরা ট্রেড অফ করতে ইচ্ছুক। এরপরে, আমরা সেজমেকার ব্যবহার করে এন্ডপয়েন্ট, প্রাক-প্রশিক্ষিত BERT বেস মডেল এবং NAS-প্রুনড BERT মডেল হোস্ট করি। লোড টেস্টিং করতে, আমরা ব্যবহার করি পঙ্গপাল, একটি ওপেন সোর্স লোড টেস্টিং টুল যা আপনি পাইথন ব্যবহার করে বাস্তবায়ন করতে পারেন। আমরা পঙ্গপাল ব্যবহার করে উভয় প্রান্তে লোড পরীক্ষা চালাই এবং উভয় মডেলের প্রতিক্রিয়ার সময় এবং যথার্থতার মধ্যে ট্রেড-অফ চিত্রিত করার জন্য প্যারেটো ফ্রন্ট ব্যবহার করে ফলাফলগুলি কল্পনা করি। নিম্নলিখিত চিত্রটি এই পোস্টে ব্যাখ্যা করা কর্মপ্রবাহের একটি ওভারভিউ প্রদান করে।

পূর্বশর্ত

এই পোস্টের জন্য, নিম্নলিখিত পূর্বশর্ত প্রয়োজন:

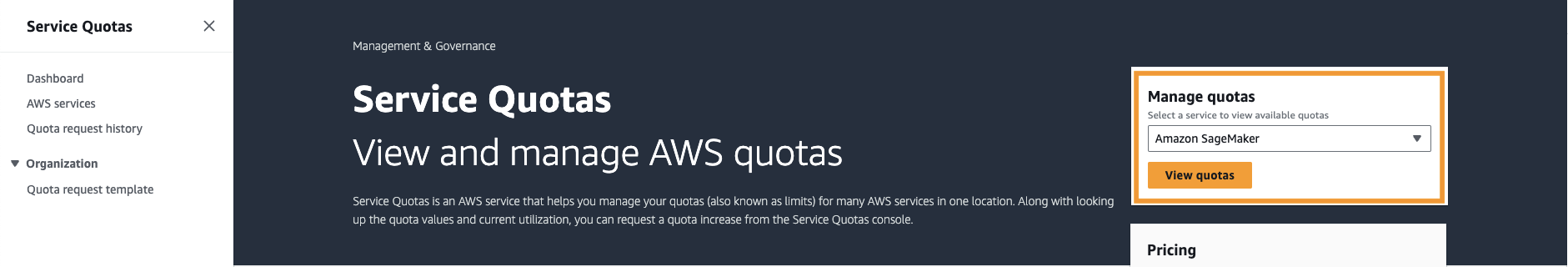

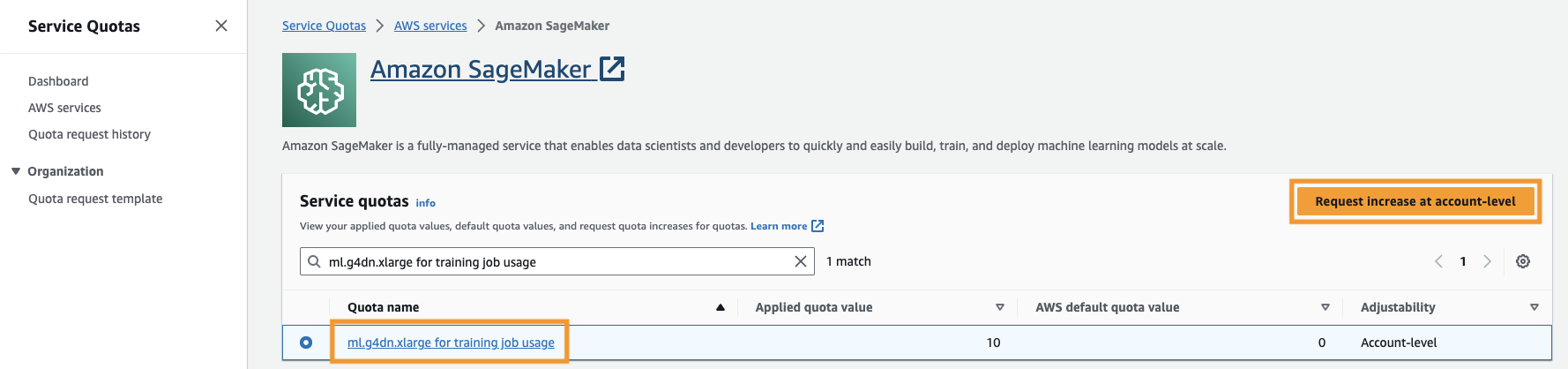

আপনাকেও বাড়াতে হবে সেবা কোটা SageMaker-এ ml.g4dn.xlarge ইনস্ট্যান্সের অন্তত তিনটি ইনস্ট্যান্স অ্যাক্সেস করতে। ইন্সট্যান্স টাইপ ml.g4dn.xlarge হল সাশ্রয়ী GPU ইন্সট্যান্স যা আপনাকে PyTorch নেটিভভাবে চালানোর অনুমতি দেয়। পরিষেবা কোটা বাড়ানোর জন্য, নিম্নলিখিত পদক্ষেপগুলি সম্পূর্ণ করুন:

- কনসোলে, পরিষেবা কোটাতে নেভিগেট করুন।

- জন্য কোটা পরিচালনা করুননির্বাচন আমাজন সেজমেকার, তাহলে বেছে নাও কোটা দেখুন.

- "প্রশিক্ষণ কাজের ব্যবহারের জন্য ml-g4dn.xlarge" অনুসন্ধান করুন এবং কোটা আইটেমটি নির্বাচন করুন।

- বেছে নিন অ্যাকাউন্ট-স্তরে বৃদ্ধির অনুরোধ করুন.

- জন্য কোটার মান বাড়ান, 5 বা তার বেশি মান লিখুন।

- বেছে নিন অনুরোধ.

অ্যাকাউন্টের অনুমতির উপর নির্ভর করে অনুরোধ করা কোটা অনুমোদন সম্পূর্ণ হতে কিছু সময় লাগতে পারে।

- SageMaker কনসোল থেকে SageMaker স্টুডিও খুলুন।

- বেছে নিন সিস্টেম টার্মিনাল অধীনে ইউটিলিটি এবং ফাইল.

- ক্লোন করতে নিম্নলিখিত কমান্ডটি চালান গিটহুব রেপো সেজমেকার স্টুডিও উদাহরণে:

- নেভিগেট করুন

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - ফাইলটি খুলুন

nas_for_llm_with_amt.ipynb. - একটি সঙ্গে পরিবেশ সেট আপ

ml.g4dn.xlargeউদাহরণ এবং চয়ন করুন নির্বাচন করা.

প্রাক-প্রশিক্ষিত BERT মডেল সেট আপ করুন

এই বিভাগে, আমরা ডেটাসেট লাইব্রেরি থেকে রিকগনিজিং টেক্সচুয়াল এনটেইলমেন্ট ডেটাসেট আমদানি করি এবং ডেটাসেটটিকে প্রশিক্ষণ এবং বৈধতা সেটে বিভক্ত করি। এই ডেটাসেট বাক্য জোড়া নিয়ে গঠিত। BERT PLM-এর কাজ হল দুটি টেক্সট ফ্র্যাগমেন্টের স্বীকৃতি দেওয়া, একটি টেক্সট ফ্র্যাগমেন্টের অর্থ অন্য টুকরো থেকে অনুমান করা যায় কিনা। নিম্নলিখিত উদাহরণে, আমরা দ্বিতীয় বাক্যাংশ থেকে প্রথম বাক্যাংশের অর্থ অনুমান করতে পারি:

আমরা থেকে পাঠ্য স্বীকৃত এনটেইলমেন্ট ডেটাসেট লোড করি আঠা মাধ্যমে বেঞ্চমার্কিং স্যুট ডেটাসেট লাইব্রেরি আমাদের প্রশিক্ষণ স্ক্রিপ্টের মধ্যে আলিঙ্গন মুখ থেকে (./training.py) আমরা GLUE থেকে মূল প্রশিক্ষণ ডেটাসেটকে একটি প্রশিক্ষণ এবং বৈধতা সেটে বিভক্ত করেছি। আমাদের পদ্ধতিতে, আমরা প্রশিক্ষণ ডেটাসেট ব্যবহার করে বেস BERT মডেলটিকে সূক্ষ্ম-টিউন করি, তারপরে আমরা উপ-নেটওয়ার্কগুলির সেট সনাক্ত করতে একটি বহু-উদ্দেশ্য অনুসন্ধান করি যা উদ্দেশ্য মেট্রিক্সের মধ্যে সর্বোত্তমভাবে ভারসাম্য বজায় রাখে। আমরা প্রশিক্ষণ ডেটাসেটটি একচেটিয়াভাবে ব্যবহার করি BERT মডেলকে ফাইন-টিউন করার জন্য। যাইহোক, আমরা হোল্ডআউট বৈধতা ডেটাসেটে নির্ভুলতা পরিমাপ করে বহু-উদ্দেশ্য অনুসন্ধানের জন্য বৈধতা ডেটা ব্যবহার করি।

একটি ডোমেন-নির্দিষ্ট ডেটাসেট ব্যবহার করে BERT PLM-কে ফাইন-টিউন করুন

একটি কাঁচা BERT মডেলের জন্য সাধারণ ব্যবহারের ক্ষেত্রে পরবর্তী বাক্য ভবিষ্যদ্বাণী বা মুখোশযুক্ত ভাষা মডেলিং অন্তর্ভুক্ত। টেক্সচুয়াল রিকগনিজিং এনটেইলমেন্টের মতো ডাউনস্ট্রিম কাজের জন্য বেস BERT মডেল ব্যবহার করার জন্য, আমাদেরকে একটি ডোমেন-নির্দিষ্ট ডেটাসেট ব্যবহার করে মডেলটিকে আরও সূক্ষ্ম-টিউন করতে হবে। আপনি সিকোয়েন্স শ্রেণীবিভাগ, প্রশ্নের উত্তর এবং টোকেন শ্রেণীবিভাগের মতো কাজের জন্য একটি সূক্ষ্ম-টিউনড BERT মডেল ব্যবহার করতে পারেন। যাইহোক, এই ডেমোর উদ্দেশ্যে, আমরা বাইনারি শ্রেণীবিভাগের জন্য ফাইন-টিউনড মডেল ব্যবহার করি। নিম্নলিখিত হাইপারপ্যারামিটার ব্যবহার করে আমরা পূর্বে প্রস্তুতকৃত প্রশিক্ষণ ডেটাসেটের সাথে প্রাক-প্রশিক্ষিত BERT মডেলকে সূক্ষ্ম-টিউন করি:

আমরা একটি মডেল প্রশিক্ষণ চেকপয়েন্ট সংরক্ষণ আমাজন সিম্পল স্টোরেজ সার্ভিস (Amazon S3) বালতি, যাতে মডেলটি NAS-ভিত্তিক বহু-উদ্দেশ্য অনুসন্ধানের সময় লোড করা যায়। আমরা মডেলটি প্রশিক্ষণ দেওয়ার আগে, আমরা মেট্রিক্স যেমন যুগ, প্রশিক্ষণের ক্ষতি, পরামিতির সংখ্যা এবং বৈধতা ত্রুটি সংজ্ঞায়িত করি:

ফাইন-টিউনিং প্রক্রিয়া শুরু হওয়ার পরে, প্রশিক্ষণের কাজটি সম্পূর্ণ হতে প্রায় 15 মিনিট সময় লাগে।

সাব-নেটওয়ার্ক নির্বাচন করতে এবং ফলাফলগুলি কল্পনা করতে একটি বহু-উদ্দেশ্য অনুসন্ধান করুন৷

পরবর্তী ধাপে, আমরা সেজমেকার এএমটি ব্যবহার করে র্যান্ডম সাব-নেটওয়ার্কের নমুনা করে সূক্ষ্ম-টিউনড বেস BERT মডেলে একটি বহু-উদ্দেশ্য অনুসন্ধান করি। সুপার-নেটওয়ার্কের মধ্যে একটি সাব-নেটওয়ার্ক অ্যাক্সেস করতে (সূক্ষ্ম-টিউনড BERT মডেল), আমরা PLM-এর সমস্ত উপাদানগুলিকে মুখোশ করে রাখি যেগুলি সাব-নেটওয়ার্কের অংশ নয়। একটি PLM-এ সাব-নেটওয়ার্কগুলি খুঁজে পেতে একটি সুপার-নেটওয়ার্ককে মাস্ক করা একটি কৌশল যা মডেলের আচরণের ধরণগুলিকে আলাদা করতে এবং সনাক্ত করতে ব্যবহৃত হয়। মনে রাখবেন যে হাগিং ফেস ট্রান্সফরমারের হেডের সংখ্যার একাধিক হওয়ার জন্য লুকানো আকার প্রয়োজন। একটি ট্রান্সফরমার PLM-এ লুকানো আকার লুকানো স্টেট ভেক্টর স্পেসের আকার নিয়ন্ত্রণ করে, যা ডেটাতে জটিল উপস্থাপনা এবং প্যাটার্ন শেখার মডেলের ক্ষমতাকে প্রভাবিত করে। একটি BERT PLM-এ, লুকানো অবস্থা ভেক্টর একটি নির্দিষ্ট আকারের (768)। আমরা লুকানো আকার পরিবর্তন করতে পারি না, এবং তাই মাথার সংখ্যা [1, 3, 6, 12] হতে হবে।

একক-উদ্দেশ্য অপ্টিমাইজেশানের বিপরীতে, বহু-উদ্দেশ্য সেটিংয়ে, আমাদের সাধারণত একটি একক সমাধান নেই যা একই সাথে সমস্ত উদ্দেশ্যগুলিকে অপ্টিমাইজ করে। পরিবর্তে, আমরা সমাধানের একটি সেট সংগ্রহ করার লক্ষ্য রাখি যা কমপক্ষে একটি উদ্দেশ্যের (যেমন বৈধকরণ ত্রুটি) অন্যান্য সমস্ত সমাধানকে প্রাধান্য দেয়। এখন আমরা যে মেট্রিকগুলি কমাতে চাই তা সেট করে AMT-এর মাধ্যমে বহু-উদ্দেশ্য অনুসন্ধান শুরু করতে পারি (বৈধকরণ ত্রুটি এবং প্যারামিটারের সংখ্যা)। র্যান্ডম সাব-নেটওয়ার্কগুলি পরামিতি দ্বারা সংজ্ঞায়িত করা হয় max_jobs এবং একযোগে কাজের সংখ্যা প্যারামিটার দ্বারা সংজ্ঞায়িত করা হয় max_parallel_jobs. মডেল চেকপয়েন্ট লোড করার এবং সাব-নেটওয়ার্ক মূল্যায়ন করার কোডটি পাওয়া যায় evaluate_subnetwork.py লিপি.

AMT টিউনিং কাজটি চালানোর জন্য প্রায় 2 ঘন্টা এবং 20 মিনিট সময় লাগে৷ AMT টিউনিং কাজ সফলভাবে চালানোর পরে, আমরা কাজের ইতিহাস পার্স করি এবং সাব-নেটওয়ার্কের কনফিগারেশন সংগ্রহ করি, যেমন হেডের সংখ্যা, স্তরের সংখ্যা, ইউনিটের সংখ্যা এবং সংশ্লিষ্ট মেট্রিক্স যেমন যাচাইকরণ ত্রুটি এবং প্যারামিটারের সংখ্যা। নিম্নলিখিত স্ক্রিনশটটি একটি সফল AMT টিউনার কাজের সারাংশ দেখায়।

এরপরে, আমরা একটি প্যারেটো সেট (প্যারেটো ফ্রন্টিয়ার বা পেরেটো অপ্টিমাল সেট নামেও পরিচিত) ব্যবহার করে ফলাফলগুলি কল্পনা করি, যা আমাদের উপ-নেটওয়ার্কের সর্বোত্তম সেটগুলি সনাক্ত করতে সাহায্য করে যা উদ্দেশ্য মেট্রিকের অন্যান্য সমস্ত সাব-নেটওয়ার্কগুলিতে আধিপত্য করে (বৈধকরণ ত্রুটি):

প্রথমত, আমরা AMT টিউনিং কাজ থেকে ডেটা সংগ্রহ করি। তারপরে আমরা প্যারেটো সেট ব্যবহার করে প্লট করি matplotlob.pyplot x অক্ষে প্যারামিটারের সংখ্যা এবং y অক্ষে বৈধতা ত্রুটি সহ। এটি বোঝায় যে আমরা যখন প্যারেটো সেটের একটি সাব-নেটওয়ার্ক থেকে অন্যটিতে চলে যাই, তখন আমাদের অবশ্যই কর্মক্ষমতা বা মডেলের আকার ত্যাগ করতে হবে তবে অন্যটিকে উন্নত করতে হবে। পরিশেষে, প্যারেটো সেট আমাদের পছন্দের জন্য সবচেয়ে উপযুক্ত সাব-নেটওয়ার্ক বেছে নেওয়ার নমনীয়তা প্রদান করে। আমরা সিদ্ধান্ত নিতে পারি যে আমরা আমাদের নেটওয়ার্কের আকার কতটা কমাতে চাই এবং আমরা কতটা কর্মক্ষমতা ত্যাগ করতে ইচ্ছুক।

সেজমেকার ব্যবহার করে ফাইন-টিউনড BERT মডেল এবং NAS-অপ্টিমাইজ করা সাব-নেটওয়ার্ক মডেল স্থাপন করুন

এরপরে, আমরা আমাদের প্যারেটো সেটে সবচেয়ে বড় মডেল স্থাপন করি যা কর্মক্ষমতার অবনতির দিকে নিয়ে যায় সেজমেকার এন্ডপয়েন্ট. আমাদের ব্যবহারের ক্ষেত্রে যাচাইকরণ ত্রুটি এবং পরামিতিগুলির সংখ্যার মধ্যে একটি সর্বোত্তম ট্রেড-অফ প্রদান করে সেরা মডেল।

মডেল তুলনা

আমরা একটি প্রাক-প্রশিক্ষিত বেস BERT মডেল নিয়েছি, একটি ডোমেন-নির্দিষ্ট ডেটাসেট ব্যবহার করে এটিকে সূক্ষ্ম-টিউন করেছি, উদ্দেশ্য মেট্রিক্সের উপর ভিত্তি করে প্রভাবশালী সাব-নেটওয়ার্কগুলি সনাক্ত করতে একটি NAS অনুসন্ধান চালিয়েছি এবং একটি সেজমেকার এন্ডপয়েন্টে ছাঁটাই করা মডেলটি স্থাপন করেছি। উপরন্তু, আমরা প্রাক-প্রশিক্ষিত বেস BERT মডেল নিয়েছি এবং বেস মডেলটিকে দ্বিতীয় সেজমেকার এন্ডপয়েন্টে স্থাপন করেছি। এর পরে, আমরা দৌড়ে গেলাম লোড পরীক্ষার উভয় অনুমান শেষ পয়েন্টে পঙ্গপাল ব্যবহার করে এবং প্রতিক্রিয়া সময়ের পরিপ্রেক্ষিতে কর্মক্ষমতা মূল্যায়ন করে।

প্রথমত, আমরা প্রয়োজনীয় Locust এবং Boto3 লাইব্রেরি আমদানি করি। তারপরে আমরা একটি অনুরোধ মেটাডেটা তৈরি করি এবং লোড পরীক্ষার জন্য ব্যবহার করা শুরুর সময় রেকর্ড করি। তারপরে পেলোডটি প্রকৃত ব্যবহারকারীর অনুরোধগুলি অনুকরণ করার জন্য বোটোক্লায়েন্টের মাধ্যমে সেজমেকার এন্ডপয়েন্ট ইনভোক এপিআইতে প্রেরণ করা হয়। আমরা একাধিক ভার্চুয়াল ব্যবহারকারীদের সমান্তরালভাবে অনুরোধ পাঠাতে এবং লোডের অধীনে শেষ পয়েন্টের কার্যকারিতা পরিমাপ করতে পঙ্গপাল ব্যবহার করি। পরীক্ষাগুলি যথাক্রমে দুটি প্রান্তের প্রতিটির জন্য ব্যবহারকারীর সংখ্যা বাড়িয়ে চালানো হয়। পরীক্ষাগুলি সম্পন্ন হওয়ার পরে, Locust প্রতিটি স্থাপন করা মডেলের জন্য একটি অনুরোধ পরিসংখ্যান CSV ফাইল আউটপুট করে।

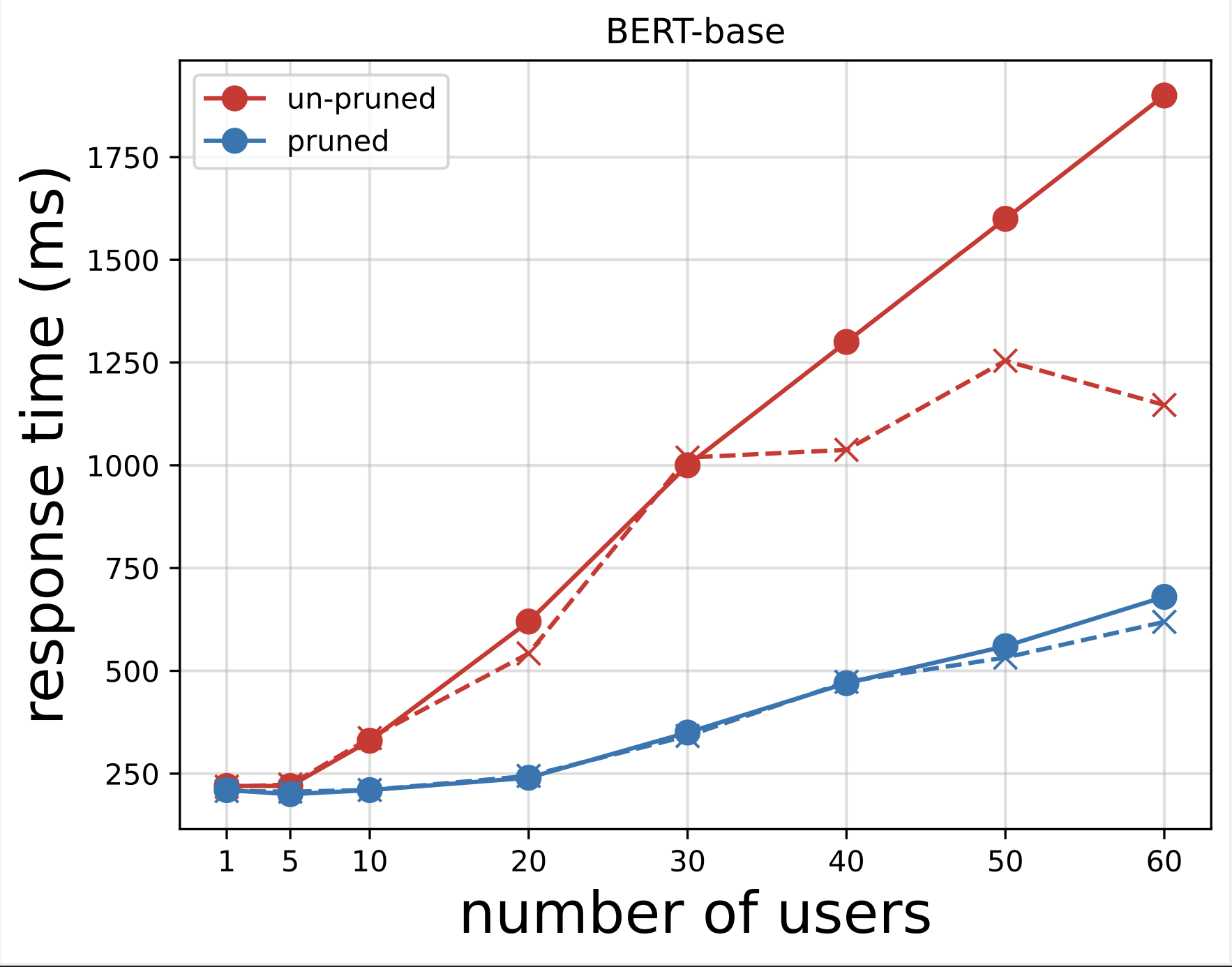

এর পরে, আমরা পঙ্গপালের সাথে পরীক্ষা চালানোর পরে ডাউনলোড করা CSV ফাইলগুলি থেকে প্রতিক্রিয়া সময় প্লট তৈরি করি। প্রতিক্রিয়া সময় বনাম ব্যবহারকারীর সংখ্যা প্লট করার উদ্দেশ্য হল মডেল শেষ পয়েন্টগুলির প্রতিক্রিয়া সময়ের প্রভাব কল্পনা করে লোড পরীক্ষার ফলাফলগুলি বিশ্লেষণ করা। নিম্নলিখিত চার্টে, আমরা দেখতে পাচ্ছি যে NAS-প্রুনড মডেল এন্ডপয়েন্ট বেস BERT মডেল এন্ডপয়েন্টের তুলনায় কম রেসপন্স টাইম অর্জন করে।

দ্বিতীয় চার্টে, যা প্রথম চার্টের একটি এক্সটেনশন, আমরা লক্ষ্য করি যে প্রায় 70 জন ব্যবহারকারীর পরে, সেজমেকার বেস BERT মডেলের শেষ পয়েন্ট থ্রোটল করতে শুরু করে এবং একটি ব্যতিক্রম ছুড়ে দেয়। যাইহোক, এনএএস-প্রুনড মডেল এন্ডপয়েন্টের জন্য, থ্রটলিং 90-100 জন ব্যবহারকারীর মধ্যে এবং কম প্রতিক্রিয়া সময় সহ ঘটে।

দুটি চার্ট থেকে, আমরা লক্ষ্য করি যে ছাঁটাই করা মডেলের একটি দ্রুত প্রতিক্রিয়ার সময় রয়েছে এবং ছাঁটাই করা মডেলের তুলনায় আরও ভাল স্কেল রয়েছে। যেহেতু আমরা অনুমান শেষ পয়েন্টের সংখ্যা স্কেল করি, যেমন ব্যবহারকারীরা তাদের PLM অ্যাপ্লিকেশনের জন্য প্রচুর সংখ্যক অনুমান শেষ পয়েন্ট স্থাপন করে, খরচের সুবিধা এবং কর্মক্ষমতা উন্নতি বেশ উল্লেখযোগ্য হতে শুরু করে।

পরিষ্কার কর

ফাইন-টিউনড বেস BERT মডেল এবং NAS-প্রুনড মডেলের জন্য SageMaker এন্ডপয়েন্ট মুছে ফেলতে, নিম্নলিখিত ধাপগুলি সম্পূর্ণ করুন:

- সেজমেকার কনসোলে, নির্বাচন করুন অনুমিতি এবং সমাপ্তি নেভিগেশন ফলকে।

- শেষ বিন্দু নির্বাচন করুন এবং এটি মুছুন।

বিকল্পভাবে, সেজমেকার স্টুডিও নোটবুক থেকে, শেষ পয়েন্টের নাম প্রদান করে নিম্নলিখিত কমান্ডগুলি চালান:

উপসংহার

এই পোস্টে, আমরা আলোচনা করেছি কিভাবে NAS ব্যবহার করে একটি সূক্ষ্ম-টিউনড BERT মডেল ছাঁটাই করতে হয়। আমরা প্রথমে ডোমেন-নির্দিষ্ট ডেটা ব্যবহার করে একটি বেস BERT মডেলকে প্রশিক্ষণ দিয়েছিলাম এবং এটিকে সেজমেকার এন্ডপয়েন্টে স্থাপন করেছি। আমরা একটি টার্গেট টাস্কের জন্য SageMaker AMT ব্যবহার করে ফাইন-টিউনড বেস BERT মডেলে একটি বহু-উদ্দেশ্য অনুসন্ধান করেছি। আমরা পেরেটো ফ্রন্টটি ভিজ্যুয়ালাইজ করেছি এবং পেরেটো সর্বোত্তম এনএএস-প্রুনড BERT মডেলটি নির্বাচন করেছি এবং মডেলটিকে দ্বিতীয় সেজমেকার এন্ডপয়েন্টে স্থাপন করেছি। আমরা লক্সট ব্যবহার করে লোড টেস্টিং করেছি যাতে ব্যবহারকারীরা উভয় প্রান্তের বিন্দুতে অনুসন্ধান করে এবং একটি CSV ফাইলে প্রতিক্রিয়ার সময় পরিমাপ করে এবং রেকর্ড করে। আমরা উভয় মডেলের জন্য ব্যবহারকারীর সংখ্যা বনাম প্রতিক্রিয়া সময় প্লট করেছি।

আমরা লক্ষ্য করেছি যে ছাঁটাই করা BERT মডেল প্রতিক্রিয়া সময় এবং উদাহরণ থ্রোটলিং থ্রেশহোল্ড উভয় ক্ষেত্রেই উল্লেখযোগ্যভাবে ভাল পারফর্ম করেছে। আমরা উপসংহারে পৌঁছেছি যে এনএএস-প্রুনড মডেলটি এন্ডপয়েন্টে বর্ধিত লোডের জন্য আরও স্থিতিস্থাপক ছিল, একটি কম প্রতিক্রিয়ার সময় বজায় রাখে এমনকি যত বেশি ব্যবহারকারী বেস BERT মডেলের তুলনায় সিস্টেমের উপর জোর দেয়। আপনি এই পোস্টে বর্ণিত NAS কৌশলটি যে কোনও বড় ভাষার মডেলে প্রয়োগ করতে পারেন একটি ছাঁটাই করা মডেল খুঁজে পেতে যা উল্লেখযোগ্যভাবে কম প্রতিক্রিয়া সময়ের সাথে লক্ষ্য কাজটি সম্পাদন করতে পারে। আপনি বৈধতা হারানোর পাশাপাশি প্যারামিটার হিসাবে লেটেন্সি ব্যবহার করে পদ্ধতিটিকে আরও অপ্টিমাইজ করতে পারেন।

যদিও আমরা এই পোস্টে NAS ব্যবহার করি, কোয়ান্টাইজেশন হল আরেকটি সাধারণ পদ্ধতি যা PLM মডেলগুলিকে অপ্টিমাইজ এবং সংকুচিত করতে ব্যবহৃত হয়। কোয়ান্টাইজেশন একটি প্রশিক্ষিত নেটওয়ার্কে ওজন এবং অ্যাক্টিভেশনের নির্ভুলতাকে 32-বিট ফ্লোটিং পয়েন্ট থেকে কম বিট প্রস্থ যেমন 8-বিট বা 16-বিট পূর্ণসংখ্যা পর্যন্ত হ্রাস করে, যার ফলে একটি সংকুচিত মডেল হয় যা দ্রুত অনুমান তৈরি করে। পরিমাপকরণ প্যারামিটারের সংখ্যা কমায় না; পরিবর্তে এটি একটি সংকুচিত মডেল পেতে বিদ্যমান পরামিতিগুলির নির্ভুলতা হ্রাস করে। NAS ছাঁটাই একটি PLM-তে অপ্রয়োজনীয় নেটওয়ার্কগুলিকে সরিয়ে দেয়, যা কম পরামিতি সহ একটি স্পার্স মডেল তৈরি করে। সাধারণত, NAS ছাঁটাই এবং কোয়ান্টাইজেশন মডেলের নির্ভুলতা বজায় রাখতে, কার্যকারিতা উন্নত করার সময় বৈধতা ক্ষতি কমাতে এবং মডেলের আকার কমাতে বড় PLM গুলিকে সংকুচিত করতে একসাথে ব্যবহার করা হয়। PLM-এর আকার কমাতে অন্যান্য সাধারণভাবে ব্যবহৃত কৌশলগুলির মধ্যে রয়েছে জ্ঞান পাতন, ম্যাট্রিক্স ফ্যাক্টরাইজেশন, এবং পাতন ক্যাসকেড.

ব্লগপোস্টে প্রস্তাবিত পদ্ধতিটি সেই দলগুলির জন্য উপযুক্ত যারা SageMaker ব্যবহার করে ডোমেন-নির্দিষ্ট ডেটা ব্যবহার করে মডেলগুলিকে প্রশিক্ষণ এবং সূক্ষ্ম-টিউন করে এবং অনুমান তৈরি করতে শেষ পয়েন্টগুলি স্থাপন করে। আপনি যদি একটি সম্পূর্ণরূপে পরিচালিত পরিষেবা খুঁজছেন যা জেনারেটিভ এআই অ্যাপ্লিকেশন তৈরির জন্য প্রয়োজনীয় উচ্চ-পারফর্মিং ফাউন্ডেশন মডেলগুলির একটি পছন্দ অফার করে, তাহলে ব্যবহার করার কথা বিবেচনা করুন আমাজন বেডরক. আপনি যদি বিস্তৃত ব্যবসায়িক ব্যবহারের ক্ষেত্রে প্রাক-প্রশিক্ষিত, ওপেন সোর্স মডেল খুঁজছেন এবং সমাধান টেমপ্লেট এবং উদাহরণ নোটবুক অ্যাক্সেস করতে চান, তাহলে ব্যবহার বিবেচনা করুন আমাজন সেজমেকার জাম্পস্টার্ট. হাগিং ফেস BERT বেস কেসড মডেলের একটি প্রাক-প্রশিক্ষিত সংস্করণ যা আমরা এই পোস্টে ব্যবহার করেছি সেজমেকার জাম্পস্টার্ট থেকেও উপলব্ধ।

লেখক সম্পর্কে

অপরাজিতা বৈদ্যনাথন AWS-এর একজন প্রধান এন্টারপ্রাইজ সলিউশন আর্কিটেক্ট। তিনি একজন ক্লাউড আর্কিটেক্ট যার 24+ বছরের এন্টারপ্রাইজ, বড় আকারের এবং বিতরণ করা সফ্টওয়্যার সিস্টেম ডিজাইন এবং বিকাশের অভিজ্ঞতা রয়েছে। তিনি জেনারেটিভ এআই এবং মেশিন লার্নিং ডেটা ইঞ্জিনিয়ারিংয়ে বিশেষজ্ঞ। তিনি একজন উচ্চাকাঙ্ক্ষী ম্যারাথন দৌড়বিদ এবং তার শখের মধ্যে রয়েছে হাইকিং, বাইক চালানো এবং তার স্ত্রী এবং দুই ছেলের সাথে সময় কাটানো।

অপরাজিতা বৈদ্যনাথন AWS-এর একজন প্রধান এন্টারপ্রাইজ সলিউশন আর্কিটেক্ট। তিনি একজন ক্লাউড আর্কিটেক্ট যার 24+ বছরের এন্টারপ্রাইজ, বড় আকারের এবং বিতরণ করা সফ্টওয়্যার সিস্টেম ডিজাইন এবং বিকাশের অভিজ্ঞতা রয়েছে। তিনি জেনারেটিভ এআই এবং মেশিন লার্নিং ডেটা ইঞ্জিনিয়ারিংয়ে বিশেষজ্ঞ। তিনি একজন উচ্চাকাঙ্ক্ষী ম্যারাথন দৌড়বিদ এবং তার শখের মধ্যে রয়েছে হাইকিং, বাইক চালানো এবং তার স্ত্রী এবং দুই ছেলের সাথে সময় কাটানো।

হারুন ক্লিন ডিপ নিউরাল নেটওয়ার্কের জন্য স্বয়ংক্রিয় মেশিন লার্নিং পদ্ধতিতে কাজ করা AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী।

হারুন ক্লিন ডিপ নিউরাল নেটওয়ার্কের জন্য স্বয়ংক্রিয় মেশিন লার্নিং পদ্ধতিতে কাজ করা AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী।

জ্যাসেক গোলেবিওস্কি AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী।

জ্যাসেক গোলেবিওস্কি AWS-এর একজন সিনিয়র ফলিত বিজ্ঞানী।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- : আছে

- : হয়

- :না

- :কোথায়

- [পৃ

- $ ইউপি

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 20

- 26

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- ক্ষমতা

- সক্ষম

- প্রবেশ

- হিসাব

- সঠিকতা

- অর্জন করা

- জাতিসংঘের

- সক্রিয়করণ

- যোগ

- গ্রহণ

- পর

- AI

- লক্ষ্য

- লক্ষ্য

- আলগোরিদিম

- সব

- অনুমতি

- অনুমতি

- অনুমতি

- এছাড়াও

- মর্দানী স্ত্রীলোক

- অ্যামাজন ওয়েব সার্ভিসেস

- পরিমাণ

- an

- বিশ্লেষণ

- বৈশ্লেষিক ন্যায়

- বিশ্লেষণ করা

- এবং

- অন্য

- উত্তর

- কোন

- API

- অ্যাপ্লিকেশন

- ফলিত

- প্রয়োগ করা

- প্রয়োগ করা হচ্ছে

- অভিগমন

- অনুমোদন

- আন্দাজ

- স্থাপত্য

- রয়েছি

- এলাকায়

- এলাকার

- আর্গুমেন্ট

- কাছাকাছি

- কৃত্রিম

- কৃত্রিম নিউরাল নেটওয়ার্ক

- AS

- উচ্চাকাঙ্ক্ষী

- নির্ধারিত

- যুক্ত

- At

- প্রচেষ্টা

- পরিচর্যা করা

- অটোমেটেড

- স্বয়ংক্রিয় মেশিন শেখা

- স্বয়ংক্রিয়

- স্বয়ংক্রিয়

- স্বয়ংক্রিয়করণ

- স্বয়ংক্রিয়তা

- সহজলভ্য

- ডেস্কটপ AWS

- অক্ষ

- ভারসাম্য

- ভিত্তি

- ভিত্তি

- BE

- পরিণত

- আগে

- আচরণ

- মাপকাঠিতে

- সুবিধা

- সর্বোত্তম

- উত্তম

- মধ্যে

- বিট

- শরীর

- উভয়

- নির্মাণ করা

- ব্যবসায়

- ব্যবসা প্রক্রিয়া

- ব্যবসায় প্রক্রিয়া অটোমেশন

- কিন্তু

- by

- CAN

- প্রার্থী

- ক্ষমতা

- কেস

- মামলা

- তালিকা

- পরিবর্তন

- তালিকা

- চার্ট

- chatbots

- পছন্দ

- বেছে নিন

- মনোনীত

- শ্রেণী

- শ্রেণীবিন্যাস

- রোগশয্যা

- ঘনিষ্ঠভাবে

- মেঘ

- কোড

- সংগ্রহ করা

- সংগ্রহ

- সমন্বয়

- ব্যবসায়িক

- সাধারণ

- সাধারণভাবে

- তুলনা

- সম্পূর্ণ

- সম্পন্ন হয়েছে

- জটিল

- জটিলতা

- উপাদান

- গণনা

- গনা

- ধারণা

- পর্যবসিত

- বিবেচনা

- গঠিত

- কনসোল

- সীমাবদ্ধতার

- গঠন করা

- খরচ

- ধারণ

- বিষয়বস্তু

- বিষয়বস্তু-সৃষ্টি

- প্রসঙ্গ

- অবিরত

- বিপরীত হত্তয়া

- নিয়ন্ত্রণগুলি

- অনুরূপ

- মূল্য

- খরচ

- গণনা

- সৃষ্টি

- সৃষ্টি

- সৃষ্টি

- ক্রেতা

- গ্রাহক সেবা

- উপাত্ত

- তথ্য বিজ্ঞান

- ডেটাসেট

- DATETIME

- সিদ্ধান্ত নেন

- সিদ্ধান্ত মেকিং

- নিবেদিত

- গভীর

- গভীর নিউরাল নেটওয়ার্ক

- নির্ধারণ করা

- সংজ্ঞায়িত

- সংজ্ঞা

- ডেমো

- প্রদর্শন

- নির্ভর করে

- স্থাপন

- মোতায়েন

- মোতায়েন

- স্থাপন

- বর্ণিত

- নকশা

- ফন্দিবাজ

- আকাঙ্ক্ষিত

- উন্নয়নশীল

- বিভিন্ন

- আলোচনা

- বণ্টিত

- দলিল

- না

- প্রভাবশালী

- আয়ত্ত করা

- Dont

- কারণে

- সময়

- e

- প্রতি

- দক্ষতা

- দক্ষ

- পারেন

- শেষপ্রান্ত

- এন্ড পয়েন্ট

- প্রকৌশল

- ইঞ্জিন

- যথেষ্ট

- প্রবেশ করান

- উদ্যোগ

- এন্টারপ্রাইজ গ্রহণ

- এন্টারপ্রাইজ সলিউশন

- সত্তা

- প্রবেশ

- পরিবেশ

- কাল

- ভুল

- থার (eth)

- মূল্যায়ন

- মূল্যায়ন

- মূল্যায়ন

- এমন কি

- ঘটনাবলী

- উদাহরণ

- ছাড়া

- ব্যতিক্রম

- কেবলমাত্র

- বিদ্যমান

- অভিজ্ঞতা

- ব্যাখ্যা করা

- ব্যাখ্যা

- প্রসার

- মুখ

- মিথ্যা

- দ্রুত

- বৈশিষ্ট্য

- প্রতিক্রিয়া

- কম

- ক্ষেত্র

- ফাইল

- নথি পত্র

- চূড়ান্ত

- আবিষ্কার

- আবিষ্কার

- প্রথম

- স্থায়ী

- নমনীয়তা

- নির্দলীয়

- অনুসরণ

- পদাঙ্ক

- জন্য

- পাওয়া

- ভিত

- থেকে

- সদর

- সীমান্ত

- সম্পূর্ণরূপে

- ক্রিয়া

- অধিকতর

- উত্পাদন করা

- উত্পন্ন

- সৃজক

- জেনারেটিভ এআই

- পাওয়া

- প্রদত্ত

- লক্ষ্য

- জিপিইউ

- ধূসর

- এরকম

- আছে

- he

- মাথা

- মাথা

- স্বাস্থ্যসেবা

- সাহায্য

- গোপন

- উচ্চ দক্ষতা

- ঊর্ধ্বতন

- হাইকিং

- তার

- ইতিহাস

- শখ

- নিমন্ত্রণকর্তা

- হোস্ট

- ঘন্টার

- কিভাবে

- কিভাবে

- যাহোক

- এইচটিএমএল

- HTTP

- HTTPS দ্বারা

- জড়িয়ে আছে

- হাইপারপ্যারামিটার অপ্টিমাইজেশান

- হাইপারপ্যারামিটার টিউনিং

- i

- সনাক্ত করা

- IDX

- if

- চিত্রিত করা

- প্রভাব

- প্রভাব

- বাস্তবায়ন

- আমদানি

- উন্নত করা

- উন্নত

- উন্নতি

- উন্নতি

- in

- অন্তর্ভুক্ত করা

- বৃদ্ধি

- বর্ধিত

- ক্রমবর্ধমান

- তথ্য

- পরিকাঠামো

- ইনপুট

- উদাহরণ

- দৃষ্টান্ত

- পরিবর্তে

- বুদ্ধিমান

- মধ্যে

- IT

- এর

- কাজ

- জবস

- JPG

- JSON

- জ্ঞান

- পরিচিত

- ভাষা

- বড়

- বড় আকারের

- বৃহত্তম

- অদৃশ্যতা

- স্তর

- স্তর

- বিশালাকার

- শিখতে

- শিক্ষা

- অন্তত

- দিন

- লাইব্রেরি

- লাইব্রেরি

- লাইন

- বোঝা

- লগ ইন করুন

- লগিং

- খুঁজছি

- ক্ষতি

- লোকসান

- নিম্ন

- মেশিন

- মেশিন লার্নিং

- বজায় রাখা

- বজায় রাখার

- এক

- পরিচালিত

- সহ্যশক্তির পরীক্ষা

- মাস্ক

- matplotlib

- সর্বাধিক

- মে..

- অর্থ

- মাপ

- মাপা

- পরিমাপ

- চিকিৎসা

- সম্মেলন

- স্মৃতি

- মেটাডাটা

- পদ্ধতি

- ছন্দোময়

- ছন্দোবিজ্ঞান

- হতে পারে

- কমান

- মিনিট

- ML

- মডেল

- মূর্তিনির্মাণ

- মডেল

- মডুলার

- অধিক

- পদক্ষেপ

- অনেক

- বহু

- অবশ্যই

- নাম

- নামে

- নাম

- Nas

- প্রাকৃতিক

- স্বভাবিক ভাষা

- স্বাভাবিক ভাষা প্রক্রিয়াকরণ

- নেভিগেট করুন

- ন্যাভিগেশন

- প্রয়োজনীয়

- প্রয়োজন

- প্রয়োজন

- চাহিদা

- নেটওয়ার্ক

- নেটওয়ার্ক

- নিউরাল

- স্নায়বিক নেটওয়ার্ক

- নিউরাল নেটওয়ার্ক

- পরবর্তী

- NLP

- না

- বিঃদ্রঃ

- নোটবই

- নোটবুক

- এখন

- সংখ্যা

- লক্ষ্য

- উদ্দেশ্য

- উদ্দেশ্য

- মান্য করা

- বিলোকিত

- of

- বন্ধ

- অর্পণ

- অফার

- on

- ONE

- অনলাইন

- অনলাইন খুচরা বিক্রেতা

- কেবল

- খোলা

- ওপেন সোর্স

- অনুকূল

- অপ্টিমাইজেশান

- অপ্টিমিজ

- অপ্টিমাইজ

- সেরা অনুকূল রূপ

- সর্বোচ্চকরন

- or

- ক্রম

- মূল

- অন্যান্য

- আমাদের

- বাইরে

- আউটপুট

- আউটপুট

- শেষ

- সামগ্রিক

- ওভারভিউ

- নিজের

- জোড়া

- শার্সি

- সমান্তরাল

- স্থিতিমাপ

- পরামিতি

- Pareto

- অংশ

- গৃহীত

- পথ

- রোগী

- নিদর্শন

- সম্পাদন করা

- কর্মক্ষমতা

- সম্পাদিত

- করণ

- সঞ্চালিত

- অনুমতি

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- বিন্দু

- পয়েন্ট

- অবস্থানের

- পোস্ট

- স্পষ্টতা

- ভবিষ্যদ্বাণী

- ভবিষ্যদ্বাণীপূর্ণ

- Predictor

- পছন্দগুলি

- প্রস্তুত

- পূর্বশর্ত

- বর্তমান

- পূর্বে

- অধ্যক্ষ

- সমস্যা

- প্রক্রিয়া

- প্রক্রিয়া অটোমেশন

- প্রসেস

- প্রক্রিয়াজাতকরণ

- পণ্য

- প্রমোদ

- উত্পাদনশীলতা সরঞ্জাম

- প্রস্তাবিত

- প্রদানকারী

- উপলব্ধ

- প্রদানের

- কাছে

- pulls

- উদ্দেশ্য

- উদ্দেশ্য

- পাইথন

- পাইটার্চ

- প্রশ্ন ও উত্তর

- প্রশ্ন

- পুরোপুরি

- এলোমেলো

- পরিসর

- দ্রুত

- হার

- কাঁচা

- বাস্তব

- স্বীকার

- চেনা

- স্বীকৃতি

- সুপারিশ

- সুপারিশ

- নথি

- নথিভুক্ত

- লাল

- হ্রাস করা

- হ্রাসপ্রাপ্ত

- হ্রাস

- প্রত্যাগতি

- সংশ্লিষ্ট

- অপসারণ

- সরানোর

- প্রতিবেদন

- প্রতিনিধিত্ব

- অনুরোধ

- অনুরোধ

- অনুরোধ

- প্রয়োজনীয়

- আবশ্যকতা

- স্থিতিস্থাপক

- সংস্থান

- Resources

- যথাক্রমে

- প্রতিক্রিয়া

- ফলাফল

- খুচরা বিক্রেতা

- ধারনকারী

- আয়

- অশ্বচালনা

- ঝুঁকি

- সারিটি

- চালান

- চর

- দৌড়

- রান

- s

- বলিদান

- ঋষি নির্মাতা

- সেজমেকার ইনফারেন্স

- সংরক্ষণ করুন

- স্কেল

- দাঁড়িপাল্লা

- বিজ্ঞান

- বিজ্ঞানী

- স্কোর

- লিপি

- সার্চ

- সার্চ ইঞ্জিন

- অনুসন্ধানের

- দ্বিতীয়

- অধ্যায়

- দেখ

- নির্বাচন করা

- নির্বাচিত

- আত্ম

- পাঠান

- বাক্য

- অনুভূতি

- ক্রম

- সেবা

- সেবা

- সেশন

- সেট

- সেট

- বিন্যাস

- শো

- সংকেত

- উল্লেখযোগ্যভাবে

- সহজ

- যুগপত

- এককালে

- একক

- আয়তন

- ক্ষুদ্রতর

- So

- সফটওয়্যার

- সমাধান

- সলিউশন

- কিছু

- উৎস

- স্থান

- ডিম

- বিশেষজ্ঞ

- বিশেষ

- নির্দিষ্ট

- বিশেষভাবে

- খরচ

- বিভক্ত করা

- শুরু

- শুরু

- রাষ্ট্র

- পরিসংখ্যান

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- স্টোরেজ

- কাঠামোগত

- কাঠামোবদ্ধ

- চিত্রশালা

- সারগর্ভ

- সফল

- সফলভাবে

- এমন

- উপযুক্ত

- অনুসরণ

- সংক্ষিপ্তসার

- পদ্ধতি

- সিস্টেম

- T

- গ্রহণ করা

- লাগে

- লক্ষ্য

- কার্য

- কাজ

- দল

- প্রযুক্তি

- প্রযুক্তি

- টেমপ্লেট

- শর্তাবলী

- পরীক্ষামূলক

- পরীক্ষা

- পাঠ

- পাঠ্য শ্রেণিবিন্যাস

- পাঠগত

- চেয়ে

- যে

- সার্জারির

- তাদের

- তারপর

- সেখানে।

- অতএব

- এইগুলো

- এই

- তিন

- গোবরাট

- দ্বারা

- সময়

- বার

- থেকে

- একসঙ্গে

- টোকেন

- গ্রহণ

- টুল

- সরঞ্জাম

- বাণিজ্য

- লেনদেন

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- ট্রান্সফরমার

- ট্রান্সফরমার

- সত্য

- চেষ্টা

- দুই

- আদর্শ

- ধরনের

- টিপিক্যাল

- সাধারণত

- পরিণামে

- অধীনে

- চলমান

- বোধশক্তি

- ইউনিট

- us

- ব্যবহার

- ব্যবহার ক্ষেত্রে

- ব্যবহৃত

- ব্যবহারকারী

- ব্যবহারকারী

- ব্যবহারসমূহ

- ব্যবহার

- বৈধতা

- মূল্য

- মানগুলি

- সংস্করণ

- মাধ্যমে

- ভার্চুয়াল

- ঠাহর করা

- vs

- প্রয়োজন

- ছিল

- we

- ওয়েব

- ওয়েব সার্ভিস

- আমরা একটি

- কখন

- কিনা

- যে

- যখন

- হু

- ব্যাপক

- প্রশস্ত পরিসর

- ব্যাপকভাবে

- স্ত্রী

- উইকিপিডিয়া

- ইচ্ছা

- ইচ্ছুক

- সঙ্গে

- মধ্যে

- হয়া যাই ?

- কর্মপ্রবাহ

- কাজ

- X

- বছর

- উত্পাদ

- আপনি

- আপনার

- zephyrnet