OpenAI হুইস্পার এমআইটি লাইসেন্স সহ একটি উন্নত স্বয়ংক্রিয় স্পিচ রিকগনিশন (ASR) মডেল। ASR প্রযুক্তি ট্রান্সক্রিপশন পরিষেবা, ভয়েস সহকারী এবং শ্রবণ প্রতিবন্ধী ব্যক্তিদের জন্য অ্যাক্সেসযোগ্যতা বৃদ্ধিতে উপযোগিতা খুঁজে পায়। এই অত্যাধুনিক মডেলটি ওয়েব থেকে সংগৃহীত বহুভাষিক এবং বহুমুখী তত্ত্বাবধানে থাকা ডেটার বিশাল এবং বৈচিত্র্যময় ডেটাসেটের উপর প্রশিক্ষিত। এর উচ্চ নির্ভুলতা এবং অভিযোজনযোগ্যতা এটিকে ভয়েস-সম্পর্কিত কাজগুলির বিস্তৃত অ্যারের জন্য একটি মূল্যবান সম্পদ করে তোলে।

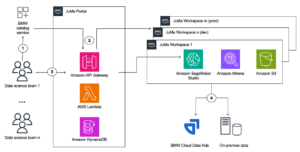

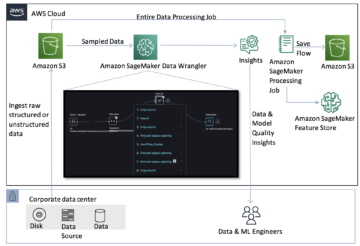

মেশিন লার্নিং এবং কৃত্রিম বুদ্ধিমত্তার ক্রমবর্ধমান ল্যান্ডস্কেপে, আমাজন সেজমেকার একটি ব্যাপক ইকোসিস্টেম প্রদান করে। SageMaker ডেটা বিজ্ঞানী, বিকাশকারী এবং সংস্থাগুলিকে মেশিন লার্নিং মডেলগুলি বিকাশ, প্রশিক্ষণ, স্থাপন এবং পরিচালনা করার ক্ষমতা দেয়। বিস্তৃত সরঞ্জাম এবং ক্ষমতা প্রদান করে, এটি সম্পূর্ণ মেশিন লার্নিং ওয়ার্কফ্লোকে সহজ করে, ডেটা প্রাক-প্রসেসিং এবং মডেল ডেভেলপমেন্ট থেকে অনায়াসে স্থাপনা এবং পর্যবেক্ষণ পর্যন্ত। SageMaker-এর ব্যবহারকারী-বান্ধব ইন্টারফেস এটিকে AI এর পূর্ণ সম্ভাবনা আনলক করার জন্য একটি গুরুত্বপূর্ণ প্ল্যাটফর্ম করে তোলে, এটিকে কৃত্রিম বুদ্ধিমত্তার ক্ষেত্রে একটি গেম পরিবর্তনকারী সমাধান হিসাবে প্রতিষ্ঠিত করে।

এই পোস্টে, আমরা সেজমেকারের ক্ষমতাগুলির একটি অন্বেষণ শুরু করি, বিশেষত হুইস্পার মডেল হোস্ট করার উপর ফোকাস করে। আমরা এটি করার জন্য দুটি পদ্ধতির গভীরে ডুব দেব: একটি হুইস্পার পাইটর্চ মডেল ব্যবহার করে এবং অন্যটি হুইস্পার মডেলের আলিঙ্গন মুখ বাস্তবায়ন ব্যবহার করে৷ উপরন্তু, আমরা গতি, খরচ, পেলোডের আকার এবং স্কেলেবিলিটির মতো পরামিতি জুড়ে সেজমেকারের অনুমান বিকল্পগুলির একটি গভীরভাবে পরীক্ষা পরিচালনা করব। এই বিশ্লেষণ ব্যবহারকারীদের তাদের নির্দিষ্ট ব্যবহারের ক্ষেত্রে এবং সিস্টেমে হুইস্পার মডেলগুলিকে একীভূত করার সময় সচেতন সিদ্ধান্ত নেওয়ার ক্ষমতা দেয়।

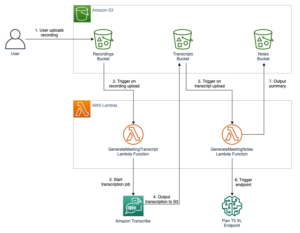

সমাধান ওভারভিউ

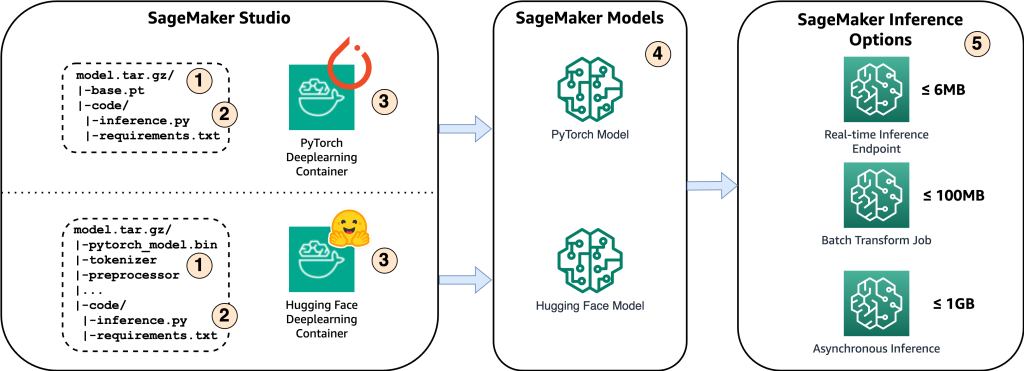

নিম্নলিখিত চিত্রটি এই সমাধানের প্রধান উপাদানগুলি দেখায়।

- অ্যামাজন সেজমেকারে মডেলটি হোস্ট করার জন্য, প্রথম পদক্ষেপটি হল মডেলের নিদর্শনগুলি সংরক্ষণ করা। এই নিদর্শনগুলি স্থাপনা এবং পুনঃপ্রশিক্ষণ সহ বিভিন্ন অ্যাপ্লিকেশনের জন্য প্রয়োজনীয় একটি মেশিন লার্নিং মডেলের প্রয়োজনীয় উপাদানগুলির উল্লেখ করে। তারা মডেল প্যারামিটার, কনফিগারেশন ফাইল, প্রাক-প্রসেসিং উপাদান, সেইসাথে মেটাডেটা অন্তর্ভুক্ত করতে পারে, যেমন সংস্করণের বিবরণ, লেখকত্ব, এবং এর কার্যকারিতা সম্পর্কিত যেকোনো নোট। এটি লক্ষ করা গুরুত্বপূর্ণ যে PyTorch এবং Hugging Face বাস্তবায়নের জন্য Whisper মডেলগুলি বিভিন্ন মডেলের শিল্পকর্ম নিয়ে গঠিত।

- এরপরে, আমরা কাস্টম ইনফারেন্স স্ক্রিপ্ট তৈরি করি। এই স্ক্রিপ্টগুলির মধ্যে, আমরা কীভাবে মডেলটি লোড করা উচিত তা সংজ্ঞায়িত করি এবং অনুমান প্রক্রিয়াটি নির্দিষ্ট করি। এখানেও আমরা প্রয়োজন অনুযায়ী কাস্টম প্যারামিটার অন্তর্ভুক্ত করতে পারি। অতিরিক্তভাবে, আপনি প্রয়োজনীয় পাইথন প্যাকেজ তালিকা করতে পারেন a

requirements.txtফাইল মডেলের স্থাপনার সময়, এই পাইথন প্যাকেজগুলি প্রাথমিক পর্যায়ে স্বয়ংক্রিয়ভাবে ইনস্টল করা হয়। - তারপরে আমরা PyTorch বা Hugging Face ডিপ লার্নিং কন্টেইনার (DLC) নির্বাচন করে ডেস্কটপ AWS. এই কন্টেইনারগুলি গভীর শিক্ষার ফ্রেমওয়ার্ক এবং অন্যান্য প্রয়োজনীয় পাইথন প্যাকেজ সহ প্রাক-নির্মিত ডকার চিত্র। আরও তথ্যের জন্য, আপনি এটি পরীক্ষা করতে পারেন লিংক.

- মডেল আর্টিফ্যাক্ট, কাস্টম ইনফারেন্স স্ক্রিপ্ট এবং নির্বাচিত ডিএলসি সহ, আমরা যথাক্রমে PyTorch এবং Hugging Face-এর জন্য Amazon SageMaker মডেল তৈরি করব।

- অবশেষে, মডেলগুলি সেজমেকারে স্থাপন করা যেতে পারে এবং নিম্নলিখিত বিকল্পগুলির সাথে ব্যবহার করা যেতে পারে: রিয়েল-টাইম ইনফারেন্স এন্ডপয়েন্ট, ব্যাচ ট্রান্সফর্ম জব এবং অ্যাসিঙ্ক্রোনাস ইনফারেন্স এন্ডপয়েন্ট। আমরা এই পোস্টে পরে আরও বিস্তারিতভাবে এই বিকল্পগুলিতে ডুব দেব।

এই সমাধানের জন্য উদাহরণ নোটবুক এবং কোড এটি উপলব্ধ GitHub সংগ্রহস্থল.

চিত্র 1. মূল সমাধান উপাদানগুলির ওভারভিউ

walkthrough

Amazon SageMaker-এ হুইস্পার মডেল হোস্ট করা

এই বিভাগে, আমরা যথাক্রমে PyTorch এবং Hugging Face Frameworks ব্যবহার করে Amazon SageMaker-এ হুইস্পার মডেল হোস্ট করার পদক্ষেপগুলি ব্যাখ্যা করব। এই সমাধানটি পরীক্ষা করার জন্য, আপনার একটি AWS অ্যাকাউন্ট এবং Amazon SageMaker পরিষেবাতে অ্যাক্সেস প্রয়োজন৷

PyTorch ফ্রেমওয়ার্ক

- মডেল নিদর্শন সংরক্ষণ করুন

মডেলটি হোস্ট করার প্রথম বিকল্পটি ব্যবহার করা হয় হুইস্পার অফিসিয়াল পাইথন প্যাকেজ, যা ব্যবহার করে ইনস্টল করা যেতে পারে pip install openai-whisper. এই প্যাকেজটি একটি PyTorch মডেল প্রদান করে। স্থানীয় সংগ্রহস্থলে মডেল আর্টিফ্যাক্টগুলি সংরক্ষণ করার সময়, প্রথম পদক্ষেপটি হল মডেলের শেখার যোগ্য প্যারামিটারগুলি, যেমন মডেলের ওজন এবং নিউরাল নেটওয়ার্কের প্রতিটি স্তরের পক্ষপাত, একটি 'pt' ফাইল হিসাবে সংরক্ষণ করা। আপনি বিভিন্ন মডেলের আকার থেকে বেছে নিতে পারেন, যার মধ্যে রয়েছে ‘ক্ষুদ্র,’ ‘বেস,’ ‘ছোট,’ ‘মাঝারি,’ এবং ‘বড়।’ বড় মডেলের মাপ উচ্চতর নির্ভুলতার কার্যকারিতা অফার করে, কিন্তু দীর্ঘ অনুমান বিলম্বের খরচে আসে। অতিরিক্তভাবে, আপনাকে মডেল স্টেট ডিকশনারি এবং ডাইমেনশন ডিকশনারি সংরক্ষণ করতে হবে, যেটিতে একটি পাইথন ডিকশনারী রয়েছে যা PyTorch মডেলের প্রতিটি স্তর বা প্যারামিটারকে অন্যান্য মেটাডেটা এবং কাস্টম কনফিগারেশনের সাথে তার সংশ্লিষ্ট শিখনযোগ্য প্যারামিটারে ম্যাপ করে। নিচের কোডটি দেখায় কিভাবে Whisper PyTorch আর্টিফ্যাক্ট সংরক্ষণ করতে হয়।

- DLC নির্বাচন করুন

পরবর্তী ধাপ হল এটি থেকে প্রি-বিল্ট ডিএলসি সিলেক্ট করা লিংক. নিম্নলিখিত সেটিংস বিবেচনা করে সঠিক ছবি নির্বাচন করার সময় সতর্কতা অবলম্বন করুন: ফ্রেমওয়ার্ক (PyTorch), ফ্রেমওয়ার্ক সংস্করণ, টাস্ক (অনুমান), পাইথন সংস্করণ এবং হার্ডওয়্যার (যেমন, GPU)। যখনই সম্ভব ফ্রেমওয়ার্ক এবং পাইথনের জন্য সর্বশেষ সংস্করণগুলি ব্যবহার করার পরামর্শ দেওয়া হয়, কারণ এর ফলে ভাল কার্যকারিতা পাওয়া যায় এবং পূর্ববর্তী রিলিজগুলি থেকে পরিচিত সমস্যা এবং বাগগুলি সমাধান করা হয়।

- Amazon SageMaker মডেল তৈরি করুন

পরবর্তী, আমরা ব্যবহার সেজমেকার পাইথন এসডিকে PyTorch মডেল তৈরি করতে। একটি PyTorch মডেল তৈরি করার সময় পরিবেশের ভেরিয়েবল যোগ করার কথা মনে রাখা গুরুত্বপূর্ণ। ডিফল্টরূপে, টর্চসার্ভ শুধুমাত্র 6MB পর্যন্ত ফাইলের আকার প্রক্রিয়া করতে পারে, ব্যবহার করা অনুমান প্রকার নির্বিশেষে।

নিম্নলিখিত সারণী বিভিন্ন PyTorch সংস্করণের জন্য সেটিংস দেখায়:

| ফ্রেমওয়ার্ক | পরিবেশ পরিবর্তনশীল |

| PyTorch 1.8 (TorchServe এর উপর ভিত্তি করে) | 'TS_MAX_REQUEST_SIZE': '100000000'' TS_MAX_RESPONSE_SIZE': '100000000'' TS_DEFAULT_RESPONSE_TIMEOUT': '1000' |

| PyTorch 1.4 (MMS এর উপর ভিত্তি করে) | 'MMS_MAX_REQUEST_SIZE': '1000000000'' MMS_MAX_RESPONSE_SIZE': '1000000000'' MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- inference.py-এ মডেল লোডিং পদ্ধতি সংজ্ঞায়িত করুন

প্রথায় inference.py স্ক্রিপ্ট, আমরা প্রথমে একটি CUDA-সক্ষম GPU-এর উপলব্ধতা পরীক্ষা করি। যদি এই ধরনের একটি GPU পাওয়া যায়, তাহলে আমরা বরাদ্দ করি 'cuda' ডিভাইস থেকে DEVICE পরিবর্তনশীল; অন্যথায়, আমরা বরাদ্দ করি 'cpu' যন্ত্র. এই পদক্ষেপটি নিশ্চিত করে যে মডেলটি দক্ষ গণনার জন্য উপলব্ধ হার্ডওয়্যারে স্থাপন করা হয়েছে। আমরা Whisper Python প্যাকেজ ব্যবহার করে PyTorch মডেল লোড করি।

আলিঙ্গন মুখ ফ্রেমওয়ার্ক

- মডেল নিদর্শন সংরক্ষণ করুন

দ্বিতীয় বিকল্পটি ব্যবহার করা হয় আলিঙ্গন করা মুখের ফিসফিস বাস্তবায়ন. মডেলটি ব্যবহার করে লোড করা যেতে পারে AutoModelForSpeechSeq2Seq ট্রান্সফরমার ক্লাস। শেখার যোগ্য প্যারামিটারগুলি ব্যবহার করে একটি বাইনারি (বিন) ফাইলে সংরক্ষণ করা হয় save_pretrained পদ্ধতি আলিঙ্গন মুখ মডেল সঠিকভাবে কাজ করে তা নিশ্চিত করতে টোকেনাইজার এবং প্রিপ্রসেসরকে আলাদাভাবে সংরক্ষণ করতে হবে। বিকল্পভাবে, আপনি দুটি পরিবেশ ভেরিয়েবল সেট করে সরাসরি আলিঙ্গন ফেস হাব থেকে Amazon SageMaker-এ একটি মডেল স্থাপন করতে পারেন: HF_MODEL_ID এবং HF_TASK. আরও তথ্যের জন্য, অনুগ্রহ করে এটি পড়ুন ওয়েবপেজ.

- DLC নির্বাচন করুন

PyTorch ফ্রেমওয়ার্কের মতো, আপনি একই থেকে একটি প্রাক-নির্মিত আলিঙ্গন মুখ DLC চয়ন করতে পারেন লিংক. একটি DLC নির্বাচন করা নিশ্চিত করুন যা সর্বশেষ হাগিং ফেস ট্রান্সফরমার সমর্থন করে এবং এতে GPU সমর্থন অন্তর্ভুক্ত রয়েছে।

- Amazon SageMaker মডেল তৈরি করুন

একইভাবে, আমরা ব্যবহার করি সেজমেকার পাইথন এসডিকে আলিঙ্গন মুখ মডেল তৈরি করতে. Hugging Face Whisper মডেলের একটি ডিফল্ট সীমাবদ্ধতা রয়েছে যেখানে এটি শুধুমাত্র 30 সেকেন্ড পর্যন্ত অডিও সেগমেন্ট প্রক্রিয়া করতে পারে। এই সীমাবদ্ধতা মোকাবেলা করতে, আপনি অন্তর্ভুক্ত করতে পারেন chunk_length_s Hugging Face মডেল তৈরি করার সময় এনভায়রনমেন্ট ভেরিয়েবলে প্যারামিটার এবং পরে মডেল লোড করার সময় কাস্টম ইনফারেন্স স্ক্রিপ্টে এই প্যারামিটারটি পাস করুন। পরিশেষে, পেলোডের আকার বাড়ানোর জন্য পরিবেশের ভেরিয়েবল সেট করুন এবং হাগিং ফেস কন্টেইনারের জন্য প্রতিক্রিয়ার সময়সীমা।

| ফ্রেমওয়ার্ক | পরিবেশ পরিবর্তনশীল |

|

HuggingFace ইনফারেন্স ধারক (MMS এর উপর ভিত্তি করে) |

'MMS_MAX_REQUEST_SIZE': '2000000000'' MMS_MAX_RESPONSE_SIZE': '2000000000'' MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- inference.py-এ মডেল লোডিং পদ্ধতি সংজ্ঞায়িত করুন

হাগিং ফেস মডেলের জন্য কাস্টম ইনফারেন্স স্ক্রিপ্ট তৈরি করার সময়, আমরা একটি পাইপলাইন ব্যবহার করি, যা আমাদের পাস করতে দেয় chunk_length_s একটি পরামিতি হিসাবে। এই প্যারামিটারটি অনুমানের সময় দীর্ঘ অডিও ফাইলগুলিকে দক্ষতার সাথে প্রক্রিয়া করতে মডেলটিকে সক্ষম করে।

অ্যামাজন সেজমেকারে বিভিন্ন অনুমান বিকল্পগুলি অন্বেষণ করা হচ্ছে

অনুমান বিকল্পগুলি নির্বাচন করার পদক্ষেপগুলি PyTorch এবং Hugging Face মডেল উভয়ের জন্যই একই, তাই আমরা নীচে তাদের মধ্যে পার্থক্য করব না। যাইহোক, এটি লক্ষণীয় যে, এই পোস্টটি লেখার সময়, সার্ভারহীন অনুমান SageMaker থেকে বিকল্প GPU সমর্থন করে না, এবং ফলস্বরূপ, আমরা এই ব্যবহারের ক্ষেত্রে এই বিকল্পটি বাদ দিই।

আমরা মডেলটিকে একটি রিয়েল-টাইম এন্ডপয়েন্ট হিসাবে স্থাপন করতে পারি, মিলিসেকেন্ডে প্রতিক্রিয়া প্রদান করতে পারি। যাইহোক, এটি মনে রাখা গুরুত্বপূর্ণ যে এই বিকল্পটি 6 MB এর নিচে ইনপুট প্রক্রিয়াকরণের জন্য সীমাবদ্ধ। আমরা সিরিয়ালাইজারকে একটি অডিও সিরিয়ালাইজার হিসাবে সংজ্ঞায়িত করি, যা ইনপুট ডেটাকে স্থাপন করা মডেলের জন্য একটি উপযুক্ত বিন্যাসে রূপান্তর করার জন্য দায়ী। আমরা অনুমানের জন্য একটি GPU দৃষ্টান্ত ব্যবহার করি, অডিও ফাইলগুলির দ্রুত প্রক্রিয়াকরণের অনুমতি দেয়। অনুমান ইনপুট একটি অডিও ফাইল যা স্থানীয় সংগ্রহস্থল থেকে।

দ্বিতীয় অনুমান বিকল্পটি হল ব্যাচ ট্রান্সফর্ম জব, যা 100 MB পর্যন্ত ইনপুট পেলোড প্রক্রিয়াকরণ করতে সক্ষম। যাইহোক, এই পদ্ধতিতে কয়েক মিনিট দেরি হতে পারে। প্রতিটি দৃষ্টান্ত একবারে শুধুমাত্র একটি ব্যাচ অনুরোধ পরিচালনা করতে পারে এবং দৃষ্টান্ত শুরু এবং শাটডাউনের জন্যও কয়েক মিনিটের প্রয়োজন হয়। অনুমানের ফলাফলগুলি একটি অ্যামাজন সিম্পল স্টোরেজ সার্ভিসে সংরক্ষিত হয় (আমাজন S3) ব্যাচ রূপান্তর কাজ সমাপ্তির উপর বালতি.

ব্যাচ ট্রান্সফরমার কনফিগার করার সময়, অন্তর্ভুক্ত করতে ভুলবেন না max_payload = 100 কার্যকরভাবে বড় পেলোড পরিচালনা করতে। অনুমান ইনপুটটি একটি অডিও ফাইলের Amazon S3 পাথ হওয়া উচিত বা একটি Amazon S3 বাকেট ফোল্ডার যাতে অডিও ফাইলগুলির একটি তালিকা থাকে, প্রতিটির আকার 100 MB-এর থেকে ছোট৷

ব্যাচ ট্রান্সফর্ম কী দ্বারা ইনপুটে Amazon S3 অবজেক্টকে পার্টিশন করে এবং Amazon S3 অবজেক্টকে উদাহরণে ম্যাপ করে। উদাহরণস্বরূপ, যখন আপনার একাধিক অডিও ফাইল থাকে, তখন একটি উদাহরণ input1.wav প্রক্রিয়া করতে পারে, এবং অন্য একটি উদাহরণ স্কেলযোগ্যতা বাড়াতে input2.wav নামের ফাইলটি প্রক্রিয়া করতে পারে। ব্যাচ ট্রান্সফর্ম আপনাকে কনফিগার করতে দেয় max_concurrent_transforms প্রতিটি পৃথক ট্রান্সফরমার কন্টেইনারে করা HTTP অনুরোধের সংখ্যা বৃদ্ধি করতে। যাইহোক, এটি লক্ষ করা গুরুত্বপূর্ণ যে এর মান (max_concurrent_transforms* max_payload) 100 MB অতিক্রম করা উচিত নয়।

অবশেষে, অ্যামাজন সেজমেকার অ্যাসিঙ্ক্রোনাস ইনফারেন্স একযোগে একাধিক অনুরোধ প্রক্রিয়াকরণের জন্য আদর্শ, মাঝারি লেটেন্সি অফার করে এবং 1 জিবি পর্যন্ত ইনপুট পেলোড সমর্থন করে। এই বিকল্পটি চমৎকার স্কেলেবিলিটি প্রদান করে, শেষ পয়েন্টের জন্য একটি অটোস্কেলিং গ্রুপের কনফিগারেশন সক্ষম করে। যখন অনুরোধের সংখ্যা বৃদ্ধি পায়, তখন ট্র্যাফিক পরিচালনা করার জন্য এটি স্বয়ংক্রিয়ভাবে স্কেল করে এবং একবার সমস্ত অনুরোধ প্রসেস হয়ে গেলে, খরচ বাঁচাতে এন্ডপয়েন্ট 0-এ নেমে আসে।

অ্যাসিঙ্ক্রোনাস ইনফারেন্স ব্যবহার করে, ফলাফলগুলি স্বয়ংক্রিয়ভাবে একটি Amazon S3 বালতিতে সংরক্ষিত হয়৷ মধ্যে AsyncInferenceConfig, আপনি সফল বা ব্যর্থ সমাপ্তির জন্য বিজ্ঞপ্তি কনফিগার করতে পারেন। ইনপুট পাথ অডিও ফাইলের একটি Amazon S3 অবস্থান নির্দেশ করে। অতিরিক্ত বিবরণের জন্য, অনুগ্রহ করে কোডটি পড়ুন GitHub.

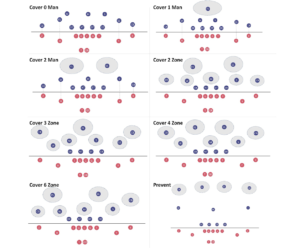

ঐচ্ছিক: পূর্বে উল্লিখিত হিসাবে, আমাদের কাছে অ্যাসিঙ্ক্রোনাস ইনফারেন্স এন্ডপয়েন্টের জন্য একটি অটোস্কেলিং গ্রুপ কনফিগার করার বিকল্প রয়েছে, যা এটিকে অনুমান অনুরোধে আকস্মিক বৃদ্ধি পরিচালনা করতে দেয়। একটি কোড উদাহরণ এই দেওয়া হয় GitHub সংগ্রহস্থল. নিম্নলিখিত ডায়াগ্রামে, আপনি দুটি মেট্রিক্স প্রদর্শন করে একটি লাইন চার্ট পর্যবেক্ষণ করতে পারেন অ্যামাজন ক্লাউডওয়াচ: ApproximateBacklogSize এবং ApproximateBacklogSizePerInstance. প্রাথমিকভাবে, যখন 1000টি অনুরোধ ট্রিগার করা হয়েছিল, শুধুমাত্র একটি উদাহরণ অনুমান পরিচালনা করার জন্য উপলব্ধ ছিল। তিন মিনিটের জন্য, ব্যাকলগের আকার ধারাবাহিকভাবে তিনটি অতিক্রম করেছে (দয়া করে মনে রাখবেন যে এই সংখ্যাগুলি কনফিগার করা যেতে পারে), এবং অটোস্কেলিং গ্রুপটি ব্যাকলগটি দক্ষতার সাথে পরিষ্কার করার জন্য অতিরিক্ত দৃষ্টান্তগুলি ঘোরানোর মাধ্যমে প্রতিক্রিয়া জানায়। এর ফলে উল্লেখযোগ্য পরিমাণ কমেছে ApproximateBacklogSizePerInstance, ব্যাকলগ অনুরোধগুলি প্রাথমিক পর্যায়ের তুলনায় অনেক দ্রুত প্রক্রিয়া করার অনুমতি দেয়।

চিত্র 2. লাইন চার্ট অ্যামাজন ক্লাউডওয়াচ মেট্রিক্সে সাময়িক পরিবর্তনগুলি চিত্রিত করে

অনুমান বিকল্পগুলির জন্য তুলনামূলক বিশ্লেষণ

বিভিন্ন অনুমান বিকল্পগুলির তুলনা সাধারণ অডিও প্রক্রিয়াকরণ ব্যবহারের ক্ষেত্রের উপর ভিত্তি করে। রিয়েল-টাইম ইনফারেন্স দ্রুততম ইনফারেন্স স্পিড অফার করে কিন্তু পেলোড সাইজ 6 MB পর্যন্ত সীমাবদ্ধ করে। এই অনুমান টাইপ অডিও কমান্ড সিস্টেমের জন্য উপযুক্ত, যেখানে ব্যবহারকারীরা ভয়েস কমান্ড বা কথ্য নির্দেশাবলী ব্যবহার করে ডিভাইস বা সফ্টওয়্যার নিয়ন্ত্রণ বা ইন্টারঅ্যাক্ট করে। ভয়েস কমান্ডগুলি সাধারণত আকারে ছোট হয় এবং ট্রান্সক্রিপ্ট করা কমান্ডগুলি অবিলম্বে পরবর্তী অ্যাকশনগুলিকে ট্রিগার করতে পারে তা নিশ্চিত করার জন্য কম অনুমান লেটেন্সি অত্যন্ত গুরুত্বপূর্ণ। ব্যাচ ট্রান্সফর্ম নির্ধারিত অফলাইন কাজের জন্য আদর্শ, যখন প্রতিটি অডিও ফাইলের আকার 100 MB-এর কম হয় এবং দ্রুত অনুমান প্রতিক্রিয়া সময়ের জন্য কোনও নির্দিষ্ট প্রয়োজন নেই৷ অ্যাসিঙ্ক্রোনাস ইনফারেন্স 1 GB পর্যন্ত আপলোড করার অনুমতি দেয় এবং মাঝারি অনুমান লেটেন্সি অফার করে। এই অনুমান টাইপটি চলচ্চিত্র, টিভি সিরিজ এবং রেকর্ড করা কনফারেন্সের প্রতিলিপি করার জন্য উপযুক্ত যেখানে বড় অডিও ফাইলগুলি প্রক্রিয়া করা প্রয়োজন।

রিয়েল-টাইম এবং অ্যাসিঙ্ক্রোনাস ইনফরেন্স উভয় বিকল্পই স্বয়ংক্রিয়ভাবে স্কেলিং ক্ষমতা প্রদান করে, যা অনুরোধের ভলিউমের উপর ভিত্তি করে স্বয়ংক্রিয়ভাবে এন্ডপয়েন্ট ইন্সট্যান্সকে স্কেল আপ বা কম করার অনুমতি দেয়। কোনও অনুরোধ ছাড়াই, অটোস্কেলিং অপ্রয়োজনীয় দৃষ্টান্তগুলিকে সরিয়ে দেয়, যা সক্রিয়ভাবে ব্যবহার করা হয় না এমন ব্যবস্থা করা দৃষ্টান্তগুলির সাথে সম্পর্কিত খরচগুলি এড়াতে সহায়তা করে৷ যাইহোক, রিয়েল-টাইম ইনফরেন্সের জন্য, অন্তত একটি স্থায়ী দৃষ্টান্ত বজায় রাখতে হবে, যা শেষবিন্দু ক্রমাগত কাজ করলে উচ্চ খরচ হতে পারে। বিপরীতে, অ্যাসিঙ্ক্রোনাস ইনফারেন্স ব্যবহার না করার সময় ইনস্ট্যান্স ভলিউমকে 0 এ কমাতে দেয়। একটি ব্যাচ ট্রান্সফর্ম কাজ কনফিগার করার সময়, কাজটি প্রক্রিয়া করার জন্য একাধিক দৃষ্টান্ত ব্যবহার করা এবং একাধিক অনুরোধ পরিচালনা করতে একটি উদাহরণ সক্ষম করতে max_concurrent_transforms সামঞ্জস্য করা সম্ভব। অতএব, তিনটি অনুমান বিকল্পই দুর্দান্ত স্কেলেবিলিটি অফার করে।

পরিষ্কার আপ

একবার আপনি সমাধানটি ব্যবহার করা শেষ করলে, অতিরিক্ত খরচ রোধ করতে সেজমেকারের শেষ পয়েন্টগুলি সরিয়ে ফেলা নিশ্চিত করুন। আপনি যথাক্রমে রিয়েল-টাইম এবং অ্যাসিঙ্ক্রোনাস ইনফারেন্স এন্ডপয়েন্ট মুছে ফেলার জন্য প্রদত্ত কোড ব্যবহার করতে পারেন।

উপসংহার

এই পোস্টে, আমরা আপনাকে দেখিয়েছি কিভাবে অডিও প্রক্রিয়াকরণের জন্য মেশিন লার্নিং মডেলগুলি স্থাপন করা বিভিন্ন শিল্পে ক্রমবর্ধমান প্রয়োজনীয় হয়ে উঠেছে। হুইস্পার মডেলটিকে একটি উদাহরণ হিসাবে গ্রহণ করে, আমরা দেখিয়েছি কিভাবে PyTorch বা Hugging Face অ্যাপ্রোচ ব্যবহার করে Amazon SageMaker-এ ওপেন-সোর্স ASR মডেলগুলি হোস্ট করতে হয়। অন্বেষণটি অ্যামাজন সেজমেকারে বিভিন্ন অনুমান বিকল্পগুলিকে অন্তর্ভুক্ত করে, দক্ষতার সাথে অডিও ডেটা পরিচালনা, ভবিষ্যদ্বাণী করা এবং কার্যকরভাবে খরচ পরিচালনা করার অন্তর্দৃষ্টি প্রদান করে। এই পোস্টটির লক্ষ্য হল অডিও-সম্পর্কিত কাজগুলির জন্য হুইস্পার মডেলের সুবিধা নিতে আগ্রহী গবেষক, বিকাশকারী এবং ডেটা বিজ্ঞানীদের জন্য জ্ঞান প্রদান করা এবং অনুমান কৌশল সম্পর্কে অবগত সিদ্ধান্ত নেওয়া।

SageMaker এ মডেল স্থাপনের বিষয়ে আরো বিস্তারিত তথ্যের জন্য, অনুগ্রহ করে এটি পড়ুন বিকাশকারী গাইড. অতিরিক্তভাবে, হুইস্পার মডেলটি সেজমেকার জাম্পস্টার্ট ব্যবহার করে স্থাপন করা যেতে পারে। অতিরিক্ত বিবরণের জন্য, অনুগ্রহ করে চেক করুন স্বয়ংক্রিয় বক্তৃতা শনাক্তকরণের জন্য হুইস্পার মডেলগুলি এখন Amazon SageMaker JumpStart-এ উপলব্ধ৷ পোস্ট।

এই প্রকল্পের জন্য নোটবুক এবং কোড চেক আউট নির্দ্বিধায় GitHub এবং আমাদের সাথে আপনার মন্তব্য শেয়ার করুন.

লেখক সম্পর্কে

ইং হাউ, পিএইচডি, AWS-এর একজন মেশিন লার্নিং প্রোটোটাইপিং আর্কিটেক্ট। GenAI, কম্পিউটার ভিশন, NLP, এবং টাইম সিরিজ ডেটা ভবিষ্যদ্বাণীতে ফোকাস সহ তার আগ্রহের প্রাথমিক ক্ষেত্রগুলি গভীর শিক্ষাকে অন্তর্ভুক্ত করে। তার অবসর সময়ে, তিনি তার পরিবারের সাথে মানসম্পন্ন মুহূর্ত কাটাতে, উপন্যাসে নিজেকে নিমজ্জিত করতে এবং যুক্তরাজ্যের জাতীয় উদ্যানগুলিতে হাইকিং করতে পছন্দ করেন।

ইং হাউ, পিএইচডি, AWS-এর একজন মেশিন লার্নিং প্রোটোটাইপিং আর্কিটেক্ট। GenAI, কম্পিউটার ভিশন, NLP, এবং টাইম সিরিজ ডেটা ভবিষ্যদ্বাণীতে ফোকাস সহ তার আগ্রহের প্রাথমিক ক্ষেত্রগুলি গভীর শিক্ষাকে অন্তর্ভুক্ত করে। তার অবসর সময়ে, তিনি তার পরিবারের সাথে মানসম্পন্ন মুহূর্ত কাটাতে, উপন্যাসে নিজেকে নিমজ্জিত করতে এবং যুক্তরাজ্যের জাতীয় উদ্যানগুলিতে হাইকিং করতে পছন্দ করেন।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- : আছে

- : হয়

- :না

- :কোথায়

- $ ইউপি

- 1

- 10

- 100

- 12

- 14

- 16

- 19

- 30

- 32

- 8

- a

- দ্রুততর

- প্রবেশ

- অভিগম্যতা

- হিসাব

- সঠিকতা

- দিয়ে

- স্টক

- সক্রিয়ভাবে

- যোগ

- অতিরিক্ত

- উপরন্তু

- ঠিকানা

- সমন্বয় করা

- অগ্রসর

- AI

- লক্ষ্য

- সব

- অনুমতি

- অনুমতি

- বরাবর

- এছাড়াও

- মর্দানী স্ত্রীলোক

- আমাজন সেজমেকার

- অ্যামাজন ওয়েব সার্ভিসেস

- an

- বিশ্লেষণ

- এবং

- অন্য

- কোন

- অ্যাপ্লিকেশন

- পন্থা

- রয়েছি

- এলাকার

- বিন্যাস

- কৃত্রিম

- কৃত্রিম বুদ্ধিমত্তা

- AS

- সম্পদ

- সহায়ক

- যুক্ত

- At

- অডিও

- কৃতি

- স্বয়ংক্রিয়

- স্বয়ংক্রিয়ভাবে

- উপস্থিতি

- সহজলভ্য

- এড়াতে

- ডেস্কটপ AWS

- ভিত্তি

- ভিত্তি

- BE

- পরিণত

- নিচে

- উত্তম

- মধ্যে

- গোঁড়ামির

- বিন

- উভয়

- বাগ

- কিন্তু

- by

- CAN

- ক্ষমতা

- সক্ষম

- সাবধান

- মামলা

- পরিবর্তন

- তালিকা

- চেক

- বেছে নিন

- নির্বাচন

- শ্রেণী

- পরিষ্কার

- কোড

- আসা

- মন্তব্য

- সাধারণ

- তুলনা

- তুলনা

- সম্পন্ন হয়েছে

- পরিপূরণ

- উপাদান

- ব্যাপক

- গণনা

- কম্পিউটার

- কম্পিউটার ভিশন

- আচার

- সম্মেলন

- কনফিগারেশন

- কনফিগার

- কনফিগার করার

- বিবেচনা করা

- ধারাবাহিকভাবে

- ধারণ করা

- আধার

- কন্টেনারগুলি

- একটানা

- বিপরীত হত্তয়া

- নিয়ন্ত্রণ

- রূপান্তর

- ঠিক

- অনুরূপ

- মূল্য

- খরচ

- পারা

- সিপিইউ

- সৃষ্টি

- তৈরি করা হচ্ছে

- কঠোর

- প্রথা

- উপাত্ত

- সিদ্ধান্ত

- হ্রাস

- গভীর

- গভীর জ্ঞানার্জন

- ডিফল্ট

- নির্ধারণ করা

- প্রদর্শিত

- স্থাপন

- মোতায়েন

- মোতায়েন

- বিস্তৃতি

- বিস্তারিত

- বিশদ

- বিস্তারিত

- বিকাশ

- ডেভেলপারদের

- উন্নয়ন

- যন্ত্র

- ডিভাইস

- বিভিন্ন

- ভেদ করা

- মাত্রা

- সরাসরি

- প্রদর্শক

- ডুব

- বিচিত্র

- ডকশ্রমিক

- না

- করছেন

- নিচে

- সময়

- e

- প্রতি

- পূর্বে

- বাস্তু

- কার্যকরীভাবে

- দক্ষ

- দক্ষতার

- অনায়াস

- পারেন

- আর

- যাত্রা

- ক্ষমতা

- সক্ষম করা

- সম্ভব

- সক্রিয়

- পরিবেষ্টন করা

- শেষপ্রান্ত

- এন্ড পয়েন্ট

- উন্নত করা

- বর্ধনশীল

- নিশ্চিত করা

- নিশ্চিত

- সমগ্র

- পরিবেশ

- অপরিহার্য

- প্রতিষ্ঠার

- থার (eth)

- পরীক্ষা

- উদাহরণ

- অতিক্রম করা

- ছাড়িয়ে

- চমত্কার

- পরীক্ষা

- ব্যাখ্যা করা

- অন্বেষণ

- এক্সপ্লোরিং

- মুখ

- ব্যর্থ

- মিথ্যা

- পরিবার

- দ্রুত

- দ্রুত

- দ্রুততম

- কয়েক

- ফাইল

- নথি পত্র

- খুঁজে বের করে

- প্রথম

- কেন্দ্রবিন্দু

- মনোযোগ

- অনুসরণ

- জন্য

- বিন্যাস

- ফ্রেমওয়ার্ক

- অবকাঠামো

- বিনামূল্যে

- থেকে

- সম্পূর্ণ

- জিপিইউ

- জিপিইউ

- মহান

- গ্রুপ

- হাতল

- হ্যান্ডলিং

- হার্ডওয়্যারের

- আছে

- শ্রবণ

- সাহায্য

- তার

- উচ্চ

- ঊর্ধ্বতন

- হাইকিং

- নিমন্ত্রণকর্তা

- হোস্টিং

- কিভাবে

- কিভাবে

- যাহোক

- এইচটিএমএল

- HTTP

- HTTPS দ্বারা

- নাভি

- জড়িয়ে আছে

- i

- আদর্শ

- if

- ব্যাখ্যা

- ভাবমূর্তি

- চিত্র

- বাস্তবায়ন

- বাস্তবায়নের

- আমদানি

- গুরুত্বপূর্ণ

- in

- গভীর

- অন্তর্ভুক্ত করা

- অন্তর্ভুক্ত

- সুদ্ধ

- নিগমবদ্ধ

- বৃদ্ধি

- ক্রমবর্ধমানভাবে

- স্বতন্ত্র

- ব্যক্তি

- শিল্প

- তথ্য

- অবগত

- প্রারম্ভিক

- প্রাথমিকভাবে

- দীক্ষা

- ইনপুট

- ইনপুট

- অর্ন্তদৃষ্টি

- ইনস্টল

- উদাহরণ

- দৃষ্টান্ত

- নির্দেশাবলী

- একীভূত

- বুদ্ধিমত্তা

- গর্ভনাটিকা

- স্বার্থ

- আগ্রহী

- ইন্টারফেস

- মধ্যে

- সমস্যা

- IT

- এর

- কাজ

- জবস

- JPG

- চাবি

- জ্ঞান

- পরিচিত

- ভূদৃশ্য

- বৃহত্তর

- সর্বশেষে

- অদৃশ্যতা

- পরে

- সর্বশেষ

- স্তর

- নেতৃত্ব

- শিক্ষা

- অন্তত

- উপজীব্য

- লাইসেন্স

- সীমাবদ্ধতা

- সীমিত

- লাইন

- তালিকা

- বোঝা

- বোঝাই

- স্থানীয়

- অবস্থান

- দীর্ঘ

- আর

- কম

- মেশিন

- মেশিন লার্নিং

- প্রণীত

- প্রধান

- করা

- তৈরি করে

- মেকিং

- পরিচালনা করা

- পরিচালক

- মানচিত্র

- মে..

- উল্লিখিত

- মেটাডাটা

- পদ্ধতি

- পদ্ধতি

- ছন্দোবিজ্ঞান

- হতে পারে

- মিলিসেকেন্ড

- মিনিট

- এমআইটি

- ML

- মডেল

- মডেল

- মধ্যপন্থী

- মারার

- পর্যবেক্ষণ

- অধিক

- চলচ্চিত্র

- অনেক

- বহু

- অবশ্যই

- নামে

- জাতীয়

- জাতীয় উদ্যান

- প্রয়োজনীয়

- প্রয়োজন

- প্রয়োজন

- নেটওয়ার্ক

- নিউরাল

- স্নায়বিক নেটওয়ার্ক

- পরবর্তী

- NLP

- না।

- বিঃদ্রঃ

- নোটবই

- নোট

- প্রজ্ঞাপন

- বিজ্ঞপ্তি

- লক্ষ

- এখন

- সংখ্যা

- সংখ্যার

- লক্ষ্য

- বস্তু

- মান্য করা

- of

- অর্পণ

- নৈবেদ্য

- অফার

- কর্মকর্তা

- অফলাইন

- on

- একদা

- ONE

- কেবল

- ওপেন সোর্স

- পরিচালনা

- পছন্দ

- অপশন সমূহ

- or

- ক্রম

- সংগঠন

- OS

- অন্যান্য

- অন্যভাবে

- বাইরে

- ওভারভিউ

- প্যাকেজ

- প্যাকেজ

- স্থিতিমাপ

- পরামিতি

- পার্ক

- পাস

- পথ

- সম্পাদন করা

- কর্মক্ষমতা

- ফেজ

- পাইপলাইন

- কেঁদ্রগত

- স্থাপিত

- মাচা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- দয়া করে

- পয়েন্ট

- সম্ভব

- পোস্ট

- সম্ভাব্য

- ভবিষ্যদ্বাণী

- ভবিষ্যতবাণী

- প্রতিরোধ

- আগে

- প্রাথমিক

- প্রক্রিয়া

- প্রক্রিয়াজাত

- প্রক্রিয়াজাতকরণ

- প্রসেসর

- প্রকল্প

- সঠিকভাবে

- প্রোটোটাইপিং

- প্রদান

- প্রদত্ত

- উপলব্ধ

- প্রদানের

- পাইথন

- পাইটার্চ

- গুণ

- পরিসর

- প্রকৃত সময়

- রাজত্ব

- স্বীকার

- সুপারিশ করা

- নথিভুক্ত

- হ্রাসপ্রাপ্ত

- পড়ুন

- তথাপি

- সংশ্লিষ্ট

- রিলিজ

- মনে রাখা

- অপসারণ

- অপসারণ

- সংগ্রহস্থলের

- অনুরোধ

- অনুরোধ

- প্রয়োজন

- প্রয়োজনীয়

- প্রয়োজন

- গবেষকরা

- যথাক্রমে

- প্রতিক্রিয়া

- প্রতিক্রিয়া

- দায়ী

- ফল

- প্রসূত

- ফলাফল

- অপরিবর্তিত রাখা

- পুনরায়োজন

- প্রত্যাবর্তন

- ঋষি নির্মাতা

- একই

- সংরক্ষণ করুন

- সংরক্ষিত

- রক্ষা

- স্কেলেবিলিটি

- স্কেল

- দাঁড়িপাল্লা

- তালিকাভুক্ত

- বিজ্ঞানীরা

- লিপি

- স্ক্রিপ্ট

- দ্বিতীয়

- সেকেন্ড

- অধ্যায়

- অংশ

- নির্বাচন করা

- নির্বাচিত

- নির্বাচন

- ক্রম

- সেবা

- সেবা

- সেট

- বিন্যাস

- সেটিংস

- শেয়ার

- সে

- উচিত

- দেখিয়েছেন

- শো

- শাটডাউন

- গুরুত্বপূর্ণ

- সহজ

- সরলীকৃত

- আয়তন

- মাপ

- ছোট

- ক্ষুদ্রতর

- So

- সফটওয়্যার

- সমাধান

- নির্দিষ্ট

- বিশেষভাবে

- নিদিষ্ট

- বক্তৃতা

- কন্ঠ সনান্তকরণ

- স্পীড

- খরচ

- উচ্চারিত

- শুরু

- রাষ্ট্র

- রাষ্ট্র-এর-শিল্প

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- স্টোরেজ

- কৌশল

- পরবর্তী

- সফল

- এমন

- আকস্মিক

- উপযুক্ত

- সমর্থন

- সমর্থক

- সমর্থন

- নিশ্চিত

- দেখা দেয় দুটো কারণে

- সিস্টেম

- টেবিল

- গ্রহণ করা

- গ্রহণ

- কার্য

- কাজ

- প্রযুক্তিঃ

- চেয়ে

- যে

- সার্জারির

- যুক্তরাজ্য

- তাদের

- তাহাদিগকে

- তারপর

- সেখানে।

- অতএব

- এইগুলো

- তারা

- এই

- তিন

- সময়

- সময় সিরিজ

- বার

- থেকে

- সরঞ্জাম

- মশাল

- ট্রাফিক

- রেলগাড়ি

- প্রশিক্ষিত

- রুপান্তর

- ট্রান্সফরমার

- ট্রান্সফরমার

- ট্রিগার

- আলোড়ন সৃষ্টি

- tv

- টিভি সিরিজ

- দুই

- আদর্শ

- সাধারণত

- Uk

- অধীনে

- উদ্ঘাটন

- উপরে

- us

- ব্যবহার

- ব্যবহৃত

- ব্যবহারকারী বান্ধব

- ব্যবহারকারী

- ব্যবহার

- উপযোগ

- সদ্ব্যবহার করা

- ব্যবহার

- দামি

- মূল্য

- পরিবর্তনশীল

- বিভিন্ন

- সুবিশাল

- সংস্করণ

- দৃষ্টি

- কণ্ঠস্বর

- কণ্ঠ নির্দেশ

- আয়তন

- অপেক্ষা করুন

- প্রয়োজন

- ছিল

- we

- ওয়েব

- ওয়েব সার্ভিস

- আমরা একটি

- ছিল

- কখন

- যখনই

- যে

- ফিস্ ফিস্ শব্দ

- ব্যাপক

- প্রশস্ত পরিসর

- সঙ্গে

- মধ্যে

- কর্মপ্রবাহ

- কাজ

- মূল্য

- লেখা

- আপনি

- আপনার

- zephyrnet