ভূমিকা

লামা এবং মিস্ট্রাল মডেল প্রকাশের পর, ওপেন-সোর্স এলএলএমগুলি ওপেনএআই থেকে লাইমলাইট নিয়েছিল। তারপর থেকে, GPT-3.5 Turbo, Claude, Gemini, ইত্যাদির মত মালিকানাধীন মডেলের সমতুল্য পারফর্ম করে, Llama এবং Mistral স্থাপত্যের উপর ভিত্তি করে একাধিক মডেল প্রকাশ করা হয়েছে। তবে, এই মডেলগুলি ভোক্তা হার্ডওয়্যারে ব্যবহার করার জন্য খুব বড়।

কিন্তু সম্প্রতি, এলএলএম-এর একটি নতুন শ্রেণির আবির্ভাব ঘটেছে। এগুলি হল সাব-7বি প্যারামিটার বিভাগে এলএলএম৷ কম পরামিতিগুলি 7B মডেলের সাথে তুলনীয় দক্ষতা বজায় রেখে ভোক্তা হার্ডওয়্যারে চালানোর জন্য যথেষ্ট কমপ্যাক্ট করে। Tiny-Llama-1B, Microsoft-এর Phi-2, এবং Alibaba-এর Qwen-3b-এর মতো মডেলগুলি স্থানীয়ভাবে চালানো বা প্রান্তে স্থাপনের জন্য বড় মডেলগুলির জন্য দুর্দান্ত বিকল্প হতে পারে। একই সময়ে, যে কোনো ডাউনস্ট্রিম কাজের জন্য যেকোনো বেস মডেল থেকে সেরাটা আনতে ফাইন-টিউনিং অত্যন্ত গুরুত্বপূর্ণ।

এখানে, আমরা অন্বেষণ করব কিভাবে একটি বেস ফাইন-টিউন করা যায় ছোট-লামা মডেল একটি পরিষ্কার আলপাকা ডেটাসেটে।

শিক্ষার উদ্দেশ্য

- ফাইন-টিউনিং এবং এর বিভিন্ন পদ্ধতি বুঝুন।

- দক্ষ সূক্ষ্ম-টিউনিংয়ের জন্য সরঞ্জাম এবং কৌশল সম্পর্কে জানুন।

- প্রশিক্ষণ লগ লগ করার জন্য WandB সম্পর্কে জানুন।

- Colab-এর আলপাকা ডেটাসেটে টিনি-লামাকে সূক্ষ্ম সুর করুন।

এই নিবন্ধটি একটি অংশ হিসাবে প্রকাশিত হয়েছিল ডেটা সায়েন্স ব্লগাথন।

সুচিপত্র

এলএলএম ফাইন-টিউনিং কি?

ফাইন-টিউনিং হল একটি প্রাক-প্রশিক্ষিত মডেলকে নতুন জ্ঞান শেখার প্রক্রিয়া। প্রাক-প্রশিক্ষিত মডেল হল একটি সাধারণ-উদ্দেশ্য মডেল যা প্রচুর পরিমাণে ডেটার উপর প্রশিক্ষিত। যাইহোক, বেশিরভাগ ক্ষেত্রে, তারা উদ্দেশ্য অনুযায়ী কাজ করতে ব্যর্থ হয়, এবং সূক্ষ্ম-টিউনিং হল মডেলটিকে নির্দিষ্ট ব্যবহারের ক্ষেত্রে খাপ খাওয়ানোর সবচেয়ে কার্যকর উপায়। উদাহরণস্বরূপ, বেস এলএলএম একক-টার্ন QA-তে টেক্সট জেনারেশনে ভালো করুন কিন্তু চ্যাট মডেলের মতো মাল্টি-টার্ন কথোপকথনের সাথে লড়াই করুন।

বহুমুখী কথোপকথন রাখতে সক্ষম হওয়ার জন্য বেস মডেলগুলিকে সংলাপের প্রতিলিপিতে প্রশিক্ষণ দেওয়া দরকার। প্রাক-প্রশিক্ষিত মডেলকে বিভিন্ন অবতারে ঢালাই করার জন্য ফাইন-টিউনিং অপরিহার্য। ফাইন-টিউনড মডেলের গুণমান ডেটার গুণমান এবং বেস মডেলের ক্ষমতার উপর নির্ভর করে। সূক্ষ্ম-টিউনিং মডেল করার একাধিক উপায় রয়েছে, যেমন LoRA, QLoRA, ইত্যাদি।

আসুন সংক্ষিপ্তভাবে এই ধারণাগুলির মধ্য দিয়ে যাওয়া যাক।

LoRA

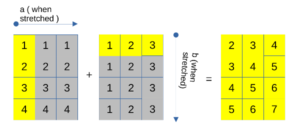

LoRA হল নিম্ন-র্যাঙ্ক অ্যাডাপ্টেশন, একটি জনপ্রিয় ফাইন-টিউনিং কৌশল যেখানে আমরা মূল ওজন ম্যাট্রিক্সের নিম্ন-র্যাঙ্কের আনুমানিকতার মাধ্যমে সমস্ত পরামিতি আপডেট করার পরিবর্তে কয়েকটি প্রশিক্ষণযোগ্য প্যারামিটার নির্বাচন করি। LoRA মডেল কম কম্পিউট-ইনটেনসিভ হার্ডওয়্যারে দ্রুত ফাইন-টিউন করা যেতে পারে।

QLoRA

QLoRA বা কোয়ান্টাইজড LoRA হল LoRA থেকে এক ধাপ এগিয়ে। একটি সম্পূর্ণ-নির্ভুল মডেলের পরিবর্তে, এটি LoRA প্রয়োগ করার আগে ফ্লোটিং পয়েন্ট নির্ভুলতা কম করার জন্য মডেলের ওজনের পরিমাণ নির্ধারণ করে। কোয়ান্টাইজেশন হল উচ্চতর বিট মানকে নিম্নতর মানগুলিতে নামিয়ে আনার প্রক্রিয়া। একটি 4-বিট কোয়ান্টাইজেশন প্রক্রিয়ার মধ্যে 16-বিট ওজনকে 4-বিট ফ্লোট মানগুলিতে পরিমাপ করা জড়িত।

মডেলের পরিমাপ মূল মডেলের সাথে তুলনাযোগ্য নির্ভুলতার সাথে মডেলের আকারে উল্লেখযোগ্য হ্রাসের দিকে নিয়ে যায়। QLoRA-তে, আমরা একটি কোয়ান্টাইজড মডেল নিই এবং এতে LoRA প্রয়োগ করি। মডেলগুলিকে একাধিক উপায়ে পরিমাপ করা যেতে পারে, যেমন llama.cpp, AWQ, bitsandbytes ইত্যাদির মাধ্যমে।

আনস্লথের সাথে ফাইন-টিউনিং

আনস্লথ হল একটি ওপেন সোর্স প্ল্যাটফর্ম যা জনপ্রিয় বড় ভাষার মডেলগুলিকে দ্রুত সূক্ষ্ম-টিউন করার জন্য। এটি Llama-2 এবং Mistral সহ জনপ্রিয় LLM এবং তাদের ডেরিভেটিভ যেমন Yi, Open-harmes ইত্যাদি সমর্থন করে। এটি মডেল প্রশিক্ষণের গতি উন্নত করতে কাস্টম ট্রিটন কার্নেল এবং একটি ম্যানুয়াল ব্যাক-প্রপ ইঞ্জিন প্রয়োগ করে।

এখানে, আমরা আনস্লথকে ফাইন-টিউন করার জন্য একটি বেস 4-বিট কোয়ান্টাইজড টিনি-লামা মডেল ব্যবহার করব আলপাকা ডেটাসেট মডেলটি বিট এবং বাইট দিয়ে পরিমাপ করা হয় এবং কার্নেলগুলি OpenAI এর Triton এর সাথে অপ্টিমাইজ করা হয়।

WandB এর সাথে লগিং করা

মেশিন লার্নিং-এ, প্রশিক্ষণ এবং মূল্যায়ন মেট্রিক্স লগ করা অত্যন্ত গুরুত্বপূর্ণ। এটি আমাদের ট্রেন চালানোর একটি সম্পূর্ণ চিত্র দেয়। ওজন এবং পক্ষপাত (WandB) হল একটি ওপেন সোর্স লাইব্রেরি যা মেশিন লার্নিং এক্সপেরিমেন্টগুলিকে ভিজ্যুয়ালাইজ করার এবং ট্র্যাক করার জন্য। রিয়েল-টাইমে প্রশিক্ষণের মেট্রিক্স ভিজ্যুয়ালাইজ করার জন্য এটিতে একটি ডেডিকেটেড ওয়েব অ্যাপ রয়েছে। এটি আমাদের কেন্দ্রীয়ভাবে উত্পাদন মডেল পরিচালনা করতে দেয়। আমরা আমাদের Tiny-Llama ফাইন-টিউনিং রান ট্র্যাক করতে শুধুমাত্র WandB ব্যবহার করব।

WandB ব্যবহার করতে, একটি বিনামূল্যে অ্যাকাউন্টের জন্য সাইন আপ করুন এবং একটি তৈরি করুন৷ API কী.

এখন, আমাদের মডেল ফাইন-টিউনিং শুরু করা যাক।

টিনি-লামাকে কীভাবে সূক্ষ্ম-টিউন করবেন?

ফাইন-টিউনিং একটি গণনা-ভারী কাজ। এটির জন্য 10-15 GB VRAM সহ একটি মেশিন প্রয়োজন, অথবা আপনি Colab-এর বিনামূল্যে Tesla T4 GPU রানটাইম ব্যবহার করতে পারেন।

এখন Unsloth এবং WandB ইনস্টল করুন

%%capture

import torch

major_version, minor_version = torch.cuda.get_device_capability()

!pip install wandb

if major_version >= 8:

# Use this for new GPUs like Ampere, Hopper GPUs (RTX 30xx, RTX 40xx, A100, H100, L40)

!pip install "unsloth[colab_ampere] @ git+https://github.com/unslothai/unsloth.git"

else:

# Use this for older GPUs (V100, Tesla T4, RTX 20xx)

!pip install "unsloth[colab] @ git+https://github.com/unslothai/unsloth.git"

passপরবর্তী জিনিসটি আনস্লথের সাথে 4-বিট কোয়ান্টাইজড প্রাক-প্রশিক্ষিত মডেল লোড করা।

from unsloth import FastLanguageModel

import torch

max_seq_length = 4096 # Choose any! We auto support RoPE Scaling internally!

dtype = None # None for auto detection. Float16 for Tesla T4, V100, Bfloat16 for Ampere+

load_in_4bit = True # Use 4bit quantization to reduce memory usage. Can be False.

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "unsloth/tinyllama-bnb-4bit", # "unsloth/tinyllama" for 16bit loading

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)এটি স্থানীয়ভাবে মডেলটি ইনস্টল করবে। 4-বিট মডেলের আকার প্রায় 760 MB হবে।

এখন আবেদন করুন পিইএফটি 4-বিট টিনি-লামা মডেলে।

model = FastLanguageModel.get_peft_model(

model,

r = 32, # Choose any number > 0 ! Suggested 8, 16, 32, 64, 128

target_modules = ["q_proj", "k_proj", "v_proj", "o_proj",

"gate_proj", "up_proj", "down_proj",],

lora_alpha = 32,

lora_dropout = 0, # Currently only supports dropout = 0

bias = "none", # Currently only supports bias = "none"

use_gradient_checkpointing = True, # @@@ IF YOU GET OUT OF MEMORY - set to True @@@

random_state = 3407,

use_rslora = False, # We support rank stabilized LoRA

loftq_config = None, # And LoftQ

)ডেটা প্রস্তুত করুন

পরবর্তী ধাপ হল সূক্ষ্ম-টিউনিংয়ের জন্য ডেটাসেট প্রস্তুত করা। আমি আগে উল্লেখ করেছি, আমরা একটি পরিষ্কার ব্যবহার করব আলপাকা ডেটাসেট. এটি মূল আলপাকা ডেটাসেটের একটি পরিষ্কার সংস্করণ। এটি নির্দেশ-ইনপুট-প্রতিক্রিয়া বিন্যাস অনুসরণ করে। এখানে আলপাকা ডেটার একটি উদাহরণ

এখন, আমাদের তথ্য প্রস্তুত করা যাক.

@title prepare data

#alpaca_prompt = """Below is an instruction that describes a task, paired with an input that

provides further context.

Write a response that appropriately completes the request.

### Instruction:

{}

### Input:

{}

### Response:

{}"""

EOS_TOKEN = tokenizer.eos_token

def formatting_prompts_func(examples):

instructions = examples["instruction"]

inputs = examples["input"]

outputs = examples["output"]

texts = []

for instruction, input, output in zip(instructions, inputs, outputs):

# Must add EOS_TOKEN, otherwise your generation will go on forever!

text = alpaca_prompt.format(instruction, input, output) + EOS_TOKEN

texts.append(text)

return { "text" : texts, }

pass

from datasets import load_dataset

dataset = load_dataset("yahma/alpaca-cleaned", split = "train")

dataset = dataset.map(formatting_prompts_func, batched = True,)এখন, ট্রেন এবং eval ডেটাতে ডেটা ভাগ করুন। আমি ছোট ইভাল ডেটা নিয়েছি কারণ বড় ইভাল ডেটা প্রশিক্ষণকে ধীর করে দেয়।

dataset_dict = dataset.train_test_split(test_size=0.004)WandB কনফিগার করুন

এখন, আপনার বর্তমান রানটাইমে ওজন এবং পক্ষপাতগুলি কনফিগার করুন।

# @title wandb init

import wandb

wandb.login()অনুরোধ করা হলে WandB-তে লগ ইন করতে API কী প্রদান করুন।

পরিবেশের ভেরিয়েবল সেট আপ করুন।

%env WANDB_WATCH=all

%env WANDB_SILENT=trueট্রেনের মডেল

এখন পর্যন্ত, আমরা 4-বিট মডেল লোড করেছি, LoRA কনফিগারেশন তৈরি করেছি, ডেটাসেট প্রস্তুত করেছি এবং WandB কনফিগার করেছি। পরবর্তী ধাপ হল ডেটার উপর মডেলকে প্রশিক্ষণ দেওয়া। এর জন্য, আমাদের Trl লাইব্রেরি থেকে একজন প্রশিক্ষককে সংজ্ঞায়িত করতে হবে। আমরা Trl থেকে SFTrainer ব্যবহার করব। কিন্তু তার আগে, WandB শুরু করুন এবং উপযুক্ত প্রশিক্ষণ আর্গুমেন্ট সংজ্ঞায়িত করুন।

import os

from trl import SFTTrainer

from transformers import TrainingArguments

from transformers.utils import logging

import wandb

logging.set_verbosity_info()

project_name = "tiny-llama"

entity = "wandb"

# os.environ["WANDB_LOG_MODEL"] = "checkpoint"

wandb.init(project=project_name, name = "tiny-llama-unsloth-sft")প্রশিক্ষণ আর্গুমেন্ট

args = TrainingArguments(

per_device_train_batch_size = 2,

per_device_eval_batch_size=2,

gradient_accumulation_steps = 4,

evaluation_strategy="steps",

warmup_ratio = 0.1,

num_train_epochs = 1,

learning_rate = 2e-5,

fp16 = not torch.cuda.is_bf16_supported(),

bf16 = torch.cuda.is_bf16_supported(),

optim = "adamw_8bit",

weight_decay = 0.1,

lr_scheduler_type = "linear",

seed = 3407,

output_dir = "outputs",

report_to="wandb", # enable logging to W&B

# run_name="tiny-llama-alpaca-run", # name of the W&B run (optional)

logging_steps=1, # how often to log to W&B

logging_strategy = 'steps',

save_total_limit=2,

)এটি প্রশিক্ষণের জন্য গুরুত্বপূর্ণ। জিপিইউ ব্যবহার কম রাখতে ট্রেন, ইভাল ব্যাচ এবং গ্রেডিয়েন্ট অ্যাকমিউলেটিং স্টেপ কম রাখুন। logging_steps হল WandB-তে মেট্রিক্স লগ করার আগে কতগুলি ধাপ।

এখন, SFTTrainer আরম্ভ করুন।

trainer = SFTTrainer(

model = model,

tokenizer = tokenizer,

train_dataset = dataset_dict["train"],

eval_dataset=dataset_dict["test"],

dataset_text_field = "text",

max_seq_length = max_seq_length,

dataset_num_proc = 2,

packing = True, # Packs short sequences together to save time!

args = args,

)এখন, প্রশিক্ষণ শুরু করুন।

trainer_stats = trainer.train()

wandb.finish()প্রশিক্ষণ চলাকালীন, WandB প্রশিক্ষণ এবং ইভাল মেট্রিক্স ট্র্যাক করবে। আপনি প্রদত্ত ড্যাশবোর্ড লিঙ্কে যান এবং রিয়েল-টাইমে এটি দেখুন।

এটি একটি Colab নোটবুকে আমার চালানোর একটি স্ক্রিনশট।

প্রশিক্ষণের গতি একাধিক কারণের উপর নির্ভর করবে, যার মধ্যে রয়েছে প্রশিক্ষণ এবং ইভাল ডেটার আকার, ট্রেন এবং ইভাল ব্যাচের আকার এবং যুগের সংখ্যা। আপনি যদি GPU ব্যবহারের সমস্যার সম্মুখীন হন, তাহলে ব্যাচ এবং গ্রেডিয়েন্ট অ্যাকমিউলেশন স্টেপ সাইজ কমানোর চেষ্টা করুন। ট্রেনের ব্যাচের আকার = ব্যাচ_সাইজ_প্রতি_ডিভাইস * গ্রেডিয়েন্ট_সঞ্চয়_পদক্ষেপ। এবং অপ্টিমাইজেশন ধাপের সংখ্যা = মোট প্রশিক্ষণ ডেটা/ব্যাচের আকার। আপনি পরামিতিগুলির সাথে খেলতে পারেন এবং দেখতে পারেন কোনটি ভাল কাজ করে।

আপনি WandB ড্যাশবোর্ডে আপনার প্রশিক্ষণের প্রশিক্ষণ এবং মূল্যায়ন ক্ষতি কল্পনা করতে পারেন।

ট্রেন লস

ইভাল লস

অনুমান

আপনি স্থানীয়ভাবে LoRA অ্যাডাপ্টারগুলি সংরক্ষণ করতে পারেন বা তাদের HuggingFace সংগ্রহস্থলে ঠেলে দিতে পারেন।

model.save_pretrained("lora_model") # Local saving

# model.push_to_hub("your_name/lora_model", token = "...") # Online savingআপনি ডিস্ক থেকে সংরক্ষিত মডেলটি লোড করতে পারেন এবং অনুমান করার জন্য এটি ব্যবহার করতে পারেন।

if False:

from unsloth import FastLanguageModel

model, tokenizer = FastLanguageModel.from_pretrained(

model_name = "lora_model", # YOUR MODEL YOU USED FOR TRAINING

max_seq_length = max_seq_length,

dtype = dtype,

load_in_4bit = load_in_4bit,

)

inputs = tokenizer(

[

alpaca_prompt.format(

"capital of France?", # instruction

"", # input

"", # output - leave this blank for a generation!

)

]*1, return_tensors = "pt").to("cuda")

outputs = model.generate(**inputs, max_new_tokens = 64, use_cache = True)

tokenizer.batch_decode(outputs)মডেল প্রতিক্রিয়া স্ট্রিমিং জন্য.

from transformers import TextStreamer

text_streamer = TextStreamer(tokenizer)

_ = model.generate(**inputs, streamer = text_streamer, max_new_tokens = 64)সুতরাং, এটি ছিল ওয়ান্ডবি লগিং সহ একটি টিনি-লামা মডেলকে সূক্ষ্ম-টিউন করার বিষয়ে।

এখানে কোলাব নোটবুক একই কারনে.

উপসংহার

ছোট এলএলএমগুলি কম্পিউট-সীমাবদ্ধ হার্ডওয়্যার যেমন ব্যক্তিগত কম্পিউটার, মোবাইল ফোন এবং অন্যান্য পরিধানযোগ্য জিনিসপত্রে স্থাপনের জন্য উপকারী হতে পারে। ফাইন-টিউনিং এই মডেলগুলিকে ডাউনস্ট্রিম কাজগুলিতে আরও ভাল সম্পাদন করতে দেয়। এই নিবন্ধে, আমরা শিখেছি কিভাবে একটি ডেটাসেটে একটি বেস ল্যাঙ্গুয়েজ মডেল ফাইন-টিউন করা যায়।

কী Takeaways

- ফাইন-টিউনিং হল একটি প্রাক-প্রশিক্ষিত মডেলকে একটি নির্দিষ্ট নতুন কাজের সাথে খাপ খাইয়ে নেওয়ার প্রক্রিয়া।

- Tiny-Llama হল শুধুমাত্র 1.1 বিলিয়ন প্যারামিটার সহ একটি LLM এবং 3 ট্রিলিয়ন টোকেনে প্রশিক্ষিত।

- এলএলএমগুলিকে ফাইন-টিউন করার বিভিন্ন উপায় রয়েছে, যেমন LoRA এবং QLoRA।

- আনস্লথ হল একটি ওপেন সোর্স প্ল্যাটফর্ম যা CUDA-অপ্টিমাইজ করা এলএলএমগুলিকে ফাইন-টিউনিং এলএলএমগুলিকে দ্রুততর করার জন্য প্রদান করে৷

- ওজন এবং পক্ষপাত (WandB) হল ML পরীক্ষাগুলি ট্র্যাকিং এবং সংরক্ষণ করার জন্য একটি টুল।

সচরাচর জিজ্ঞাস্য

উ: মেশিন লার্নিং এর প্রেক্ষাপটে ফাইন-টিউনিং, বিশেষ করে ডিপ লার্নিং হল এমন একটি কৌশল যেখানে আপনি একটি প্রাক-প্রশিক্ষিত মডেল নেন এবং এটিকে একটি নতুন, নির্দিষ্ট কাজের সাথে খাপ খাইয়ে নেন।

উ: QLoRA-এর সাহায্যে টেসলা T4 GPU-এর মাধ্যমে Colab-এ বিনামূল্যে ছোট LLMগুলিকে ফাইন-টিউন করা সম্ভব।

A. ফাইন-টিউনিং LLM-এর ক্ষমতাকে ব্যাপকভাবে বৃদ্ধি করে ডাউনস্ট্রিম কাজগুলি যেমন ভূমিকা পালন, কোড জেনারেশন ইত্যাদি।

উ: 3 ট্রিলিয়ন টোকেনে প্রশিক্ষিত ক্ষুদ্র-লামা হল 1.1B প্যারামিটার সহ একটি LLM৷ মডেলটি আসল লামা-2 আর্কিটেকচার গ্রহণ করে।

উ: আনস্লথ হল একটি ওপেন-সোর্স টুল যা ট্রাইটনের সাথে GPU কার্নেল অপ্টিমাইজ করে দ্রুত এবং আরও দক্ষ LLM ফাইন-টিউনিং প্রদান করে।

এই নিবন্ধে দেখানো মিডিয়া Analytics বিদ্যার মালিকানাধীন নয় এবং লেখকের বিবেচনার ভিত্তিতে ব্যবহার করা হয়।

সংশ্লিষ্ট

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://www.analyticsvidhya.com/blog/2024/02/fine-tuning-a-tiny-llama-model-with-unsloth/

- : আছে

- : হয়

- :না

- :কোথায়

- $ ইউপি

- 1

- 11

- 12

- 15%

- 16

- 1b

- 258

- 32

- 7

- 8

- a

- A100

- সক্ষম

- সম্পর্কে

- হিসাব

- আহরণ

- সঠিকতা

- খাপ খাওয়ানো

- অভিযোজন

- যোগ

- সব

- অনুমতি

- এছাড়াও

- পরিমাণ

- an

- বৈশ্লেষিক ন্যায়

- বিশ্লেষণ বিদ্যা

- এবং

- কোন

- API

- অ্যাপ্লিকেশন

- প্রয়োগ করা

- প্রয়োগ করা হচ্ছে

- যথাযথ

- উপযুক্তভাবে

- স্থাপত্য

- রয়েছি

- আর্গুমেন্ট

- কাছাকাছি

- প্রবন্ধ

- AS

- At

- গাড়ী

- অবতার

- b

- ভিত্তি

- ভিত্তি

- BE

- হয়েছে

- আগে

- নিচে

- উপকারী

- সুবিধা

- সর্বোত্তম

- উত্তম

- পক্ষপাত

- গোঁড়ামির

- বিলিয়ন

- বিট

- বিট

- ফাঁকা

- ব্লগাথন

- সংক্ষেপে

- আনা

- কিন্তু

- by

- CAN

- ক্ষমতা

- সামর্থ্য

- রাজধানী

- মামলা

- বিভাগ

- চ্যাট

- বেছে নিন

- শ্রেণী

- কোড

- নিচ্ছিদ্র

- তুলনীয়

- সম্পূর্ণ

- সমাপ্ত

- কম্পিউটার

- ধারণা

- কনফিগারেশন

- কনফিগার

- ভোক্তা

- গ্রাহক হার্ডওয়্যার

- প্রসঙ্গ

- কথোপকথন

- সৃষ্টি

- নির্মিত

- কঠোর

- বর্তমান

- এখন

- প্রথা

- হানাহানি

- ড্যাশবোর্ড

- উপাত্ত

- ডেটাসেট

- নিবেদিত

- গভীর

- গভীর জ্ঞানার্জন

- নির্ধারণ করা

- নির্ভর

- নির্ভর করে

- স্থাপন

- মোতায়েন

- ডেরিভেটিভস

- বর্ণনা

- সনাক্তকরণ

- সংলাপ

- বিভিন্ন

- বিচক্ষণতা

- do

- নিচে

- পূর্বে

- প্রান্ত

- কার্যকর

- দক্ষতা

- দক্ষ

- আর

- উত্থান

- সক্ষম করা

- সাক্ষাৎ

- ইঞ্জিন

- বাড়ায়

- যথেষ্ট

- সত্তা

- পরিবেশ

- পর্বগুলি

- বিশেষত

- অপরিহার্য

- ইত্যাদি

- থার (eth)

- মূল্যায়ন

- উদাহরণ

- উদাহরণ

- পরীক্ষা-নিরীক্ষা

- অন্বেষণ করুণ

- কারণের

- ব্যর্থ

- মিথ্যা

- এ পর্যন্ত

- দ্রুত

- কয়েক

- কম

- ভাসা

- নির্দলীয়

- অনুসরণ

- জন্য

- বিন্যাস

- ফ্রান্স

- বিনামূল্যে

- থেকে

- অধিকতর

- মিথুনরাশি

- সাধারন ক্ষেত্রে

- প্রজন্ম

- পাওয়া

- git

- প্রদত্ত

- দেয়

- Go

- গুগল

- জিপিইউ

- জিপিইউ

- মহান

- হার্ডওয়্যারের

- আছে

- এখানে

- উচ্চ

- ঊর্ধ্বতন

- রাখা

- কিভাবে

- কিভাবে

- যাহোক

- HTTPS দ্বারা

- জড়িয়ে আছে

- i

- if

- সরঁজাম

- আমদানি

- গুরুত্বপূর্ণ

- উন্নত করা

- in

- সুদ্ধ

- ইনপুট

- ইনপুট

- ইনস্টল

- পরিবর্তে

- নির্দেশাবলী

- অভিপ্রেত

- মধ্যে

- জড়িত

- সমস্যা

- IT

- JPG

- রাখা

- পালন

- চাবি

- জ্ঞান

- কুমার

- ভাষা

- বড়

- বৃহত্তর

- বিশালাকার

- শিখতে

- জ্ঞানী

- শিক্ষা

- ত্যাগ

- কম

- যাক

- লাইব্রেরি

- মত

- খ্যাতির ছটা

- রৈখিক

- LINK

- শিখা

- এলএলএম

- বোঝা

- বোঝাই

- স্থানীয়

- স্থানীয়ভাবে

- লগ ইন করুন

- লগ

- লগিং

- ক্ষতি

- কম

- নিম্ন

- মেশিন

- মেশিন লার্নিং

- করা

- মেকিং

- পরিচালনা করা

- ম্যানুয়াল

- সর্বোচ্চ প্রস্থ

- মিডিয়া

- স্মৃতি

- উল্লিখিত

- পদ্ধতি

- ছন্দোবিজ্ঞান

- ML

- মোবাইল

- মোবাইল ফোন গুলো

- মডেল

- মডেল

- অধিক

- আরো দক্ষ

- সেতু

- বহু

- অবশ্যই

- my

- নাম

- প্রয়োজন

- নতুন

- পরবর্তী

- না

- নোটবই

- সংখ্যা

- of

- প্রায়ই

- পুরোনো

- on

- অনলাইন

- কেবল

- ওপেন সোর্স

- OpenAI

- অপ্টিমাইজেশান

- অপ্টিমাইজ

- সর্বোচ্চকরন

- or

- মূল

- OS

- অন্যান্য

- অন্যভাবে

- আমাদের

- বাইরে

- আউটপুট

- আউটপুট

- শেষ

- মালিক হয়েছেন

- প্যাক

- জোড়া

- স্থিতিমাপ

- পরামিতি

- অংশ

- পাস

- সম্পাদন করা

- করণ

- ব্যক্তিগত

- ব্যক্তিগত কম্পিউটার

- ফোন

- ছবি

- মাচা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- খেলা

- বিন্দু

- জনপ্রিয়

- সম্ভব

- স্পষ্টতা

- প্রস্তুত করা

- প্রস্তুত

- প্রক্রিয়া

- উত্পাদনের

- মালিকানা

- উপলব্ধ

- প্রকাশিত

- ধাক্কা

- প্রশ্ন ও উত্তর

- গুণ

- R

- মর্যাদাক্রম

- প্রকৃত সময়

- হ্রাস করা

- হ্রাস

- হ্রাস

- মুক্ত

- সংগ্রহস্থলের

- অনুরোধ

- প্রয়োজন

- গবেষণা

- প্রতিক্রিয়া

- প্রতিক্রিয়া

- প্রত্যাবর্তন

- ভূমিকা

- rtx

- চালান

- একই

- সংরক্ষণ করুন

- সংরক্ষিত

- রক্ষা

- আরোহী

- বিজ্ঞান

- দেখ

- বীজ

- নির্বাচন করা

- সেট

- সংক্ষিপ্ত

- প্রদর্শিত

- চিহ্ন

- থেকে

- আয়তন

- মাপ

- গতি

- ছোট

- ক্ষুদ্রতর

- নির্দিষ্ট

- স্পীড

- বিভক্ত করা

- ব্রিদিং

- শুরু

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- স্ট্রিমিং

- সংগ্রাম

- সারগর্ভ

- এমন

- সমর্থন

- সমর্থন

- গ্রহণ করা

- ধরা

- কার্য

- কাজ

- প্রযুক্তি

- প্রযুক্তি

- টেসলা

- পরীক্ষা

- পাঠ

- পাঠ্য প্রজন্ম

- চেয়ে

- যে

- সার্জারির

- তাদের

- তাহাদিগকে

- তারপর

- সেখানে।

- এইগুলো

- তারা

- জিনিস

- এই

- দ্বারা

- সময়

- থেকে

- একসঙ্গে

- টোকেন

- টোকেন

- অত্যধিক

- গ্রহণ

- টুল

- সরঞ্জাম

- মশাল

- মোট

- পথ

- অনুসরণকরণ

- রেলগাড়ি

- প্রশিক্ষিত

- প্রশিক্ষণ

- ট্রান্সফরমার

- দশ সহস্রের ত্রিঘাত

- Triton,

- সত্য

- চেষ্টা

- আপডেট

- us

- ব্যবহার

- ব্যবহার

- ব্যবহৃত

- মানগুলি

- সংস্করণ

- মাধ্যমে

- দেখুন

- ঠাহর করা

- ছিল

- উপায়..

- উপায়

- we

- পরিধেয়সমূহের

- ওয়েব

- webp

- ওজন

- আমরা একটি

- ছিল

- কি

- কখন

- যে

- যখন

- ইচ্ছা

- সঙ্গে

- কাজ

- লেখা

- আপনি

- আপনার

- zephyrnet