আপাতদৃষ্টিতে শিল্প জুড়ে LLM-এর অপ্রতিরোধ্য গ্রহণ সত্ত্বেও, তারা একটি বিস্তৃত প্রযুক্তি ইকোসিস্টেমের একটি উপাদান যা নতুন AI তরঙ্গকে শক্তিশালী করছে। অনেক কথোপকথনমূলক AI ব্যবহারের ক্ষেত্রে ব্যবহারকারীর প্রশ্নের উত্তর দেওয়ার জন্য Llama 2, Flan T5 এবং Bloom-এর মতো LLM-এর প্রয়োজন হয়। এই মডেলগুলি প্রশ্নের উত্তর দিতে প্যারামেট্রিক জ্ঞানের উপর নির্ভর করে। মডেল প্রশিক্ষণের সময় এই জ্ঞান শেখে এবং মডেল প্যারামিটারে এনকোড করে। এই জ্ঞান আপডেট করার জন্য, আমাদের অবশ্যই এলএলএমকে পুনরায় প্রশিক্ষণ দিতে হবে, যার জন্য অনেক সময় এবং অর্থ লাগে।

সৌভাগ্যবশত, আমরা আমাদের এলএলএমগুলিকে জানাতে উৎস জ্ঞানও ব্যবহার করতে পারি। উৎস জ্ঞান হল একটি ইনপুট প্রম্পটের মাধ্যমে এলএলএম-এ তথ্য প্রদান করা। উৎস জ্ঞান প্রদানের একটি জনপ্রিয় পদ্ধতি হল পুনরুদ্ধার অগমেন্টেড জেনারেশন (RAG)। RAG ব্যবহার করে, আমরা একটি বাহ্যিক ডেটা উত্স থেকে প্রাসঙ্গিক তথ্য পুনরুদ্ধার করি এবং সেই তথ্যগুলিকে LLM-এ ফিড করি৷

এই ব্লগ পোস্টে, আমরা কীভাবে অ্যামাজন সেজমেকার জাম্পস্টার্ট ব্যবহার করে Llama-2-এর মতো LLM গুলি স্থাপন করব এবং AI হ্যালুসিনেশন প্রতিরোধ করার জন্য Pinecone ভেক্টর ডাটাবেস ব্যবহার করে Retrieval Augmented Generation (RAG) এর মাধ্যমে প্রাসঙ্গিক তথ্যের সাথে আমাদের LLMগুলিকে আপ টু ডেট রাখব। .

অ্যামাজন সেজমেকারে পুনরুদ্ধার অগমেন্টেড জেনারেশন (RAG)

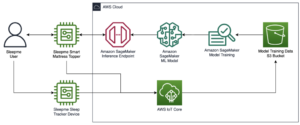

পাইনকোন RAG-এর পুনরুদ্ধার উপাদান পরিচালনা করবে, তবে আপনার আরও দুটি গুরুত্বপূর্ণ উপাদান প্রয়োজন: কোথাও LLM অনুমান চালানোর জন্য এবং কোথাও এমবেডিং মডেল চালানোর জন্য।

Amazon SageMaker Studio একটি ইন্টিগ্রেটেড ডেভেলপমেন্ট এনভায়রনমেন্ট (IDE) যা একটি একক ওয়েব-ভিত্তিক ভিজ্যুয়াল ইন্টারফেস প্রদান করে যেখানে আপনি সমস্ত মেশিন লার্নিং (ML) ডেভেলপমেন্ট করার জন্য উদ্দেশ্য-নির্মিত টুলগুলি অ্যাক্সেস করতে পারেন। এটি সেজমেকার জাম্পস্টার্ট প্রদান করে যা একটি মডেল হাব যেখানে ব্যবহারকারীরা তাদের নিজস্ব সেজমেকার অ্যাকাউন্টে একটি নির্দিষ্ট মডেল সনাক্ত করতে, পূর্বরূপ দেখতে এবং চালু করতে পারে। এটি ফাউন্ডেশন মডেল সহ বিস্তৃত ধরণের সমস্যার জন্য প্রাক-প্রশিক্ষিত, সর্বজনীনভাবে উপলব্ধ এবং মালিকানাধীন মডেল সরবরাহ করে।

অ্যামাজন সেজমেকার স্টুডিও RAG-সক্ষম এলএলএম পাইপলাইন তৈরির জন্য আদর্শ পরিবেশ প্রদান করে। প্রথমে, AWS কনসোল ব্যবহার করে, Amazon SageMaker-এ যান এবং একটি SageMaker Studio ডোমেন তৈরি করুন এবং একটি Jupyter Studio নোটবুক খুলুন।

পূর্বশর্ত

নিম্নলিখিত পূর্বশর্ত পদক্ষেপগুলি সম্পূর্ণ করুন:

- Amazon SageMaker স্টুডিও সেট আপ করুন।

- একটি Amazon SageMaker ডোমেনে অনবোর্ড।

- একটি ফ্রি-টায়ার পাইনকোন ভেক্টর ডাটাবেসের জন্য সাইন আপ করুন।

- পূর্বশর্ত লাইব্রেরি: SageMaker Python SDK, Pinecone ক্লায়েন্ট

সমাধান ওয়াকথ্রু

SageMaker স্টুডিও নোটবুক ব্যবহার করে, আমাদের প্রথমে পূর্বশর্ত লাইব্রেরি ইনস্টল করতে হবে:

একটি এলএলএম স্থাপন করা হচ্ছে

এই পোস্টে, আমরা এলএলএম স্থাপনের দুটি পদ্ধতি নিয়ে আলোচনা করি। প্রথমটি এর মাধ্যমে HuggingFaceModel বস্তু আপনি সরাসরি Hugging Face মডেল হাব থেকে LLM (এবং এমবেডিং মডেল) স্থাপন করার সময় এটি ব্যবহার করতে পারেন।

উদাহরণস্বরূপ, আপনি এর জন্য একটি স্থাপনযোগ্য কনফিগার তৈরি করতে পারেন google/flan-t5-xl নিম্নলিখিত স্ক্রীন ক্যাপচারে দেখানো মডেল:

হাগিং ফেস থেকে সরাসরি মডেল স্থাপন করার সময়, শুরু করুন my_model_configuration নিম্নলিখিত সঙ্গে:

- An

envconfig আমাদের বলে যে আমরা কোন মডেলটি ব্যবহার করতে চাই এবং কোন কাজের জন্য। - আমাদের সেজমেকার মৃত্যুদন্ড

roleআমাদের মডেল স্থাপন করার অনুমতি দেয়। - An

image_uriআলিঙ্গন মুখ থেকে এলএলএম স্থাপনের জন্য বিশেষভাবে একটি ইমেজ কনফিগারেশন।

বিকল্পভাবে, সেজমেকারের মডেলের একটি সেট রয়েছে যা একটি সহজের সাথে সরাসরি সামঞ্জস্যপূর্ণ JumpStartModel বস্তু অনেক জনপ্রিয় LLM যেমন Llama 2 এই মডেল দ্বারা সমর্থিত, যা নিম্নলিখিত স্ক্রীন ক্যাপচারে দেখানো হিসাবে শুরু করা যেতে পারে:

উভয় সংস্করণের জন্য my_model, নিম্নলিখিত স্ক্রীন ক্যাপচারে দেখানো হিসাবে তাদের স্থাপন করুন:

আমাদের সূচনাকৃত এলএলএম এন্ডপয়েন্টের সাথে, আপনি প্রশ্ন করা শুরু করতে পারেন। আমাদের প্রশ্নের বিন্যাস পরিবর্তিত হতে পারে (বিশেষ করে কথোপকথন এবং অ-কথোপকথনমূলক এলএলএমগুলির মধ্যে), তবে প্রক্রিয়াটি সাধারণত একই। আলিঙ্গন মুখ মডেলের জন্য, নিম্নলিখিতগুলি করুন:

আপনি সমাধান খুঁজে পেতে পারেন GitHub সংগ্রহস্থল.

আমরা এখানে যে উত্পন্ন উত্তর পাচ্ছি তা খুব বেশি অর্থবোধ করে না - এটি একটি হ্যালুসিনেশন।

এলএলএম-এ অতিরিক্ত প্রসঙ্গ প্রদান করা

Llama 2 শুধুমাত্র অভ্যন্তরীণ প্যারামেট্রিক জ্ঞানের উপর ভিত্তি করে আমাদের প্রশ্নের উত্তর দেওয়ার চেষ্টা করে। স্পষ্টতই, মডেল প্যারামিটারগুলি সেজমেকারে পরিচালিত স্পট প্রশিক্ষণের মাধ্যমে আমরা কোন উদাহরণগুলি করতে পারি সে সম্পর্কে জ্ঞান সংরক্ষণ করে না।

এই প্রশ্নের সঠিক উত্তর দিতে, আমাদের অবশ্যই উৎস জ্ঞান ব্যবহার করতে হবে। অর্থাৎ, আমরা প্রম্পটের মাধ্যমে এলএলএমকে অতিরিক্ত তথ্য দিই। মডেলের জন্য অতিরিক্ত প্রসঙ্গ হিসাবে সরাসরি সেই তথ্য যোগ করা যাক।

আমরা এখন প্রশ্নের সঠিক উত্তর দেখতে পাচ্ছি; এটা সহজ ছিলো! যাইহোক, একজন ব্যবহারকারী তাদের প্রম্পটে প্রসঙ্গ সন্নিবেশ করার সম্ভাবনা কম, তারা ইতিমধ্যেই তাদের প্রশ্নের উত্তর জানতে পারবে।

ম্যানুয়ালি একটি একক প্রসঙ্গ সন্নিবেশ করার পরিবর্তে, তথ্যের আরও বিস্তৃত ডাটাবেস থেকে স্বয়ংক্রিয়ভাবে প্রাসঙ্গিক তথ্য সনাক্ত করুন। এর জন্য, আপনার প্রয়োজন হবে পুনরুদ্ধার অগমেন্টেড জেনারেশন।

পুনরুদ্ধার অগমেন্টেড জেনারেশন

পুনরুদ্ধার অগমেন্টেড জেনারেশনের সাথে, আপনি তথ্যের একটি ডাটাবেসকে একটি ভেক্টর স্পেসে এনকোড করতে পারেন যেখানে ভেক্টরগুলির মধ্যে প্রক্সিমিটি তাদের প্রাসঙ্গিকতা/অর্থবোধক সাদৃশ্যকে উপস্থাপন করে। এই ভেক্টর স্থানটিকে জ্ঞানের ভিত্তি হিসাবে ব্যবহার করে, আপনি একটি নতুন ব্যবহারকারীর ক্যোয়ারী রূপান্তর করতে পারেন, এটিকে একই ভেক্টর স্পেসে এনকোড করতে পারেন এবং পূর্বে সূচীকৃত সবচেয়ে প্রাসঙ্গিক রেকর্ডগুলি পুনরুদ্ধার করতে পারেন৷

এই প্রাসঙ্গিক রেকর্ডগুলি পুনরুদ্ধার করার পরে, তাদের কয়েকটি নির্বাচন করুন এবং অতিরিক্ত প্রসঙ্গ হিসাবে LLM প্রম্পটে অন্তর্ভুক্ত করুন, LLM-কে অত্যন্ত প্রাসঙ্গিক উত্স জ্ঞান প্রদান করে। এটি একটি দ্বি-পদক্ষেপ প্রক্রিয়া যেখানে:

- সূচীকরণ একটি ডেটাসেট থেকে তথ্য সহ ভেক্টর সূচককে পপুলেট করে।

- পুনরুদ্ধার একটি প্রশ্নের সময় ঘটে এবং যেখানে আমরা ভেক্টর সূচক থেকে প্রাসঙ্গিক তথ্য পুনরুদ্ধার করি।

উভয় ধাপেই আমাদের মানব-পাঠযোগ্য প্লেইন টেক্সটকে সিমেন্টিক ভেক্টর স্পেসে অনুবাদ করার জন্য একটি এমবেডিং মডেলের প্রয়োজন। নিম্নোক্ত স্ক্রীন ক্যাপচারে দেখানো হিসাবে Hugging Face থেকে অত্যন্ত দক্ষ MiniLM বাক্য ট্রান্সফরমার ব্যবহার করুন। এই মডেলটি একটি LLM নয় এবং তাই আমাদের Llama 2 মডেলের মতো একইভাবে আরম্ভ করা হয়নি৷

মধ্যে hub_config, উপরের স্ক্রীন ক্যাপচারে দেখানো মডেল আইডি নির্দিষ্ট করুন কিন্তু কাজের জন্য, বৈশিষ্ট্য-নিষ্কাশন ব্যবহার করুন কারণ আমরা ভেক্টর এম্বেডিং তৈরি করছি আমাদের LLM-এর মতো পাঠ্য নয়। এটি অনুসরণ করে, এর সাথে মডেল কনফিগারেশন শুরু করুন HuggingFaceModel আগের মতই, কিন্তু এবার এলএলএম ইমেজ ছাড়া এবং কিছু ভার্সন প্যারামিটার সহ।

আপনি আবার সঙ্গে মডেল স্থাপন করতে পারেন deploy, এর ছোট (কেবল CPU) উদাহরণ ব্যবহার করে ml.t2.large. MiniLM মডেলটি ছোট, তাই এটির অনেক মেমরির প্রয়োজন হয় না এবং একটি GPU প্রয়োজন হয় না কারণ এটি একটি CPU-তেও দ্রুত এম্বেডিং তৈরি করতে পারে। যদি পছন্দ হয়, আপনি GPU তে মডেলটি দ্রুত চালাতে পারেন।

এমবেডিং তৈরি করতে, ব্যবহার করুন predict পদ্ধতি এবং এর মাধ্যমে এনকোড করতে প্রসঙ্গগুলির একটি তালিকা পাস করুন inputs দেখানো হিসাবে কী:

দুটি ইনপুট প্রসঙ্গ পাস করা হয়েছে, দেখানো হয়েছে দুটি প্রসঙ্গ ভেক্টর এম্বেডিং ফিরিয়ে দিচ্ছে:

len(out)

2

MiniLM মডেলের এমবেডিং মাত্রা 384 যার মানে প্রতিটি ভেক্টর এমবেডিং MiniLM আউটপুটের একটি মাত্রিকতা থাকা উচিত 384. যাইহোক, আমাদের এম্বেডিংয়ের দৈর্ঘ্যের দিকে তাকিয়ে আপনি নিম্নলিখিতগুলি দেখতে পাবেন:

len(out[0]), len(out[1])

(8, 8)

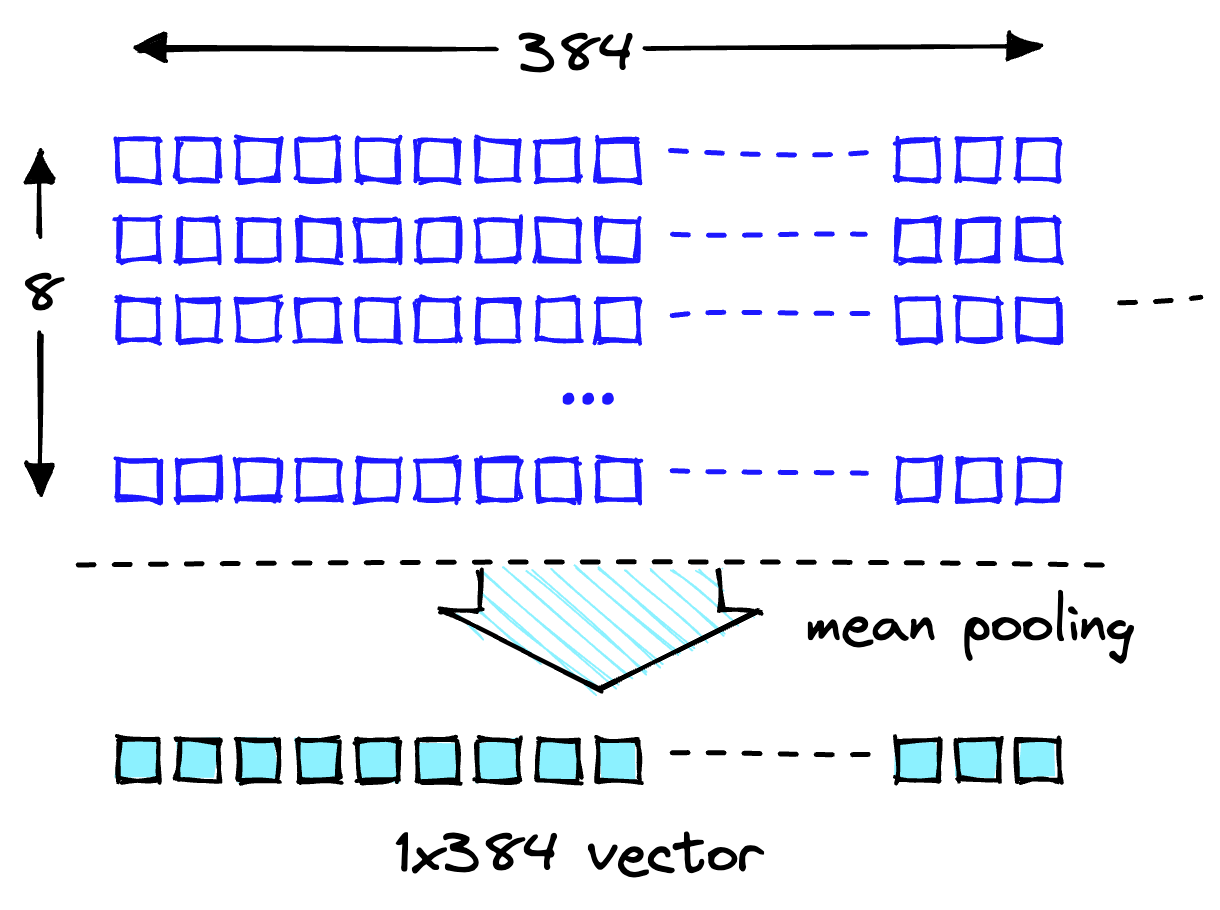

দুটি তালিকায় আটটি আইটেম রয়েছে। MiniLM প্রথমে একটি টোকেনাইজেশন ধাপে পাঠ্য প্রক্রিয়া করে। এই টোকেনাইজেশন আমাদের মানব-পাঠযোগ্য প্লেইন টেক্সটকে মডেল-পঠনযোগ্য টোকেন আইডিগুলির একটি তালিকায় রূপান্তরিত করে। মডেলের আউটপুট বৈশিষ্ট্যগুলিতে, আপনি টোকেন-স্তরের এম্বেডিংগুলি দেখতে পারেন। এই এমবেডিংগুলির একটি প্রত্যাশিত মাত্রা দেখায় 384 হিসাবে দেখানো হয়েছে:

len(out[0][0])

384

প্রতিটি ভেক্টর মাত্রা জুড়ে গড় মান ব্যবহার করে এই টোকেন-স্তরের এম্বেডিংগুলিকে নথি-স্তরের এম্বেডিং-এ রূপান্তর করুন, যেমনটি নিম্নলিখিত চিত্রে দেখানো হয়েছে।

একটি একক 384-মাত্রিক ভেক্টর পেতে পুলিং অপারেশন গড়।

দুটি 384-মাত্রিক ভেক্টর এম্বেডিং সহ, প্রতিটি ইনপুট পাঠ্যের জন্য একটি। আমাদের জীবনকে সহজ করতে, এনকোডিং প্রক্রিয়াটিকে একটি একক ফাংশনে মোড়ানো করুন যেমনটি নিম্নলিখিত স্ক্রিন ক্যাপচারে দেখানো হয়েছে:

ডেটাসেট ডাউনলোড করা হচ্ছে

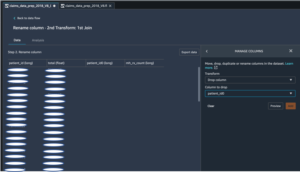

প্রশ্ন এবং উত্তর কলাম উভয়ই রয়েছে এমন ডেটা পেতে জ্ঞানের ভিত্তি হিসাবে Amazon SageMaker FAQs ডাউনলোড করুন।

Amazon SageMaker FAQs ডাউনলোড করুন

অনুসন্ধান করার সময়, শুধুমাত্র উত্তরগুলি সন্ধান করুন, যাতে আপনি প্রশ্ন কলামটি ফেলে দিতে পারেন। বিস্তারিত জানার জন্য নোটবুক দেখুন.

আমাদের ডেটাসেট এবং এম্বেডিং পাইপলাইন প্রস্তুত। এখন আমাদের যা দরকার তা হল সেই এমবেডিংগুলিকে সংরক্ষণ করার জন্য।

ইন্ডেক্সিং

পাইনকোন ভেক্টর ডাটাবেস ভেক্টর এমবেডিং সঞ্চয় করে এবং দক্ষতার সাথে স্কেলে অনুসন্ধান করে। একটি ডাটাবেস তৈরি করতে, আপনার Pinecone থেকে একটি বিনামূল্যে API কী প্রয়োজন হবে।

আপনি পাইনেকোন ভেক্টর ডাটাবেসের সাথে সংযুক্ত হওয়ার পরে, একটি একক ভেক্টর সূচক তৈরি করুন (প্রথাগত ডিবিগুলির একটি টেবিলের মতো)। সূচকের নাম দিন retrieval-augmentation-aws এবং সূচকটি সারিবদ্ধ করুন dimension এবং metric এমবেডিং মডেলের জন্য প্রয়োজনীয় প্যারামিটার (এই ক্ষেত্রে MiniLM)।

ডেটা সন্নিবেশ করা শুরু করতে, নিম্নলিখিতটি চালান:

আপনি এই পোস্টের আগে থেকে প্রশ্ন সহ সূচী অনুসন্ধান শুরু করতে পারেন।

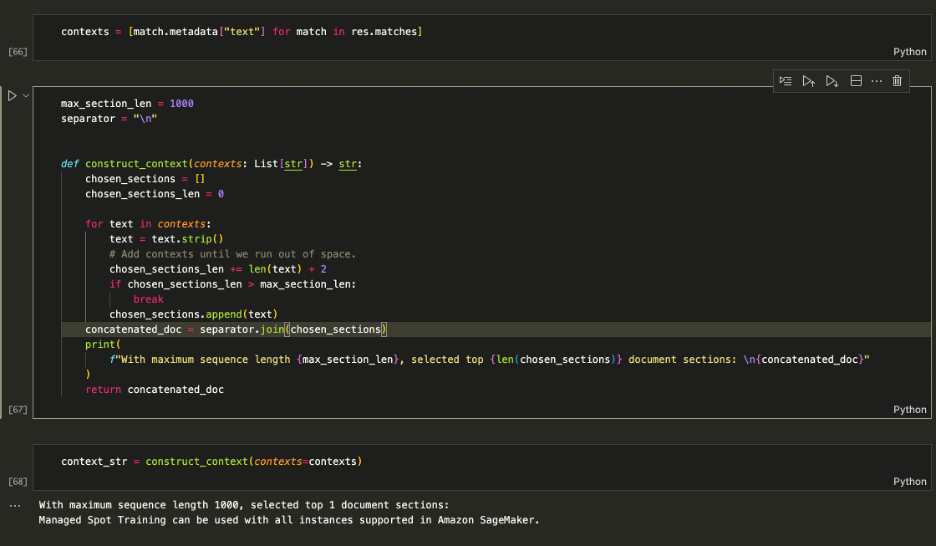

উপরের আউটপুট দেখায় যে আমরা আমাদের প্রশ্নের উত্তর দিতে সাহায্য করার জন্য প্রাসঙ্গিক প্রসঙ্গ ফিরিয়ে দিচ্ছি। যেহেতু আমরা top_k = 1, index.query মেটাডেটার পাশে শীর্ষ ফলাফলটি ফেরত দিয়েছে যা পড়ে Managed Spot Training can be used with all instances supported in Amazon.

প্রম্পট বৃদ্ধি

প্রম্পট বাড়ানোর জন্য পুনরুদ্ধার করা প্রসঙ্গগুলি ব্যবহার করুন এবং LLM-এ ফিড করার জন্য সর্বাধিক পরিমাণ প্রসঙ্গে সিদ্ধান্ত নিন। ব্যবহার 1000 আপনি বিষয়বস্তুর দৈর্ঘ্য অতিক্রম না করা পর্যন্ত অক্ষরগুলি প্রম্পটে প্রতিটি প্রত্যাবর্তিত প্রসঙ্গ যোগ করার জন্য পুনরাবৃত্তিমূলকভাবে সীমাবদ্ধ করে।

প্রম্পট বৃদ্ধি

খাওয়ান context_str নিম্নলিখিত স্ক্রীন ক্যাপচারে দেখানো হিসাবে এলএলএম প্রম্পটে:

[ইনপুট]: সেজমেকারে ম্যানেজড স্পট ট্রেনিং এর সাথে আমি কোন দৃষ্টান্তগুলি ব্যবহার করতে পারি? [আউটপুট]: প্রদত্ত প্রসঙ্গের উপর ভিত্তি করে, আপনি Amazon SageMaker-এ সমর্থিত সমস্ত দৃষ্টান্ত সহ পরিচালিত স্পট প্রশিক্ষণ ব্যবহার করতে পারেন। অতএব, উত্তর হল: সমস্ত দৃষ্টান্ত অ্যামাজন সেজমেকারে সমর্থিত।

যুক্তি কাজ করে, তাই জিনিসগুলি পরিষ্কার রাখতে এটি একটি একক ফাংশনে মোড়ানো।

আপনি এখন নিম্নলিখিত প্রশ্নগুলির মতো প্রশ্ন জিজ্ঞাসা করতে পারেন:

পরিষ্কার কর

কোনো অবাঞ্ছিত চার্জ নেওয়া বন্ধ করতে, মডেল এবং শেষ পয়েন্ট মুছুন।

উপসংহার

এই পোস্টে, আমরা আপনাকে SageMaker-এ ওপেন-অ্যাক্সেস এলএলএম সহ RAG-এর সাথে পরিচয় করিয়ে দিয়েছি। আমরা আরও দেখিয়েছি কিভাবে Llama 2 এর সাথে Amazon SageMaker জাম্পস্টার্ট মডেল, Flan T5 এর সাথে Hugging Face LLMs, এবং MiniLM এর সাথে এমবেডিং মডেলগুলি স্থাপন করা যায়।

আমরা আমাদের ওপেন-অ্যাক্সেস মডেল এবং একটি পাইনকোন ভেক্টর সূচক ব্যবহার করে একটি সম্পূর্ণ এন্ড-টু-এন্ড RAG পাইপলাইন বাস্তবায়ন করেছি। এটি ব্যবহার করে, আমরা দেখিয়েছি কীভাবে হ্যালুসিনেশন কমানো যায়, এবং এলএলএম জ্ঞানকে আপ টু ডেট রাখা যায় এবং শেষ পর্যন্ত ব্যবহারকারীর অভিজ্ঞতা এবং আমাদের সিস্টেমে বিশ্বাস বাড়াতে হয়।

এই উদাহরণটি নিজে থেকে চালানোর জন্য, এই GitHub সংগ্রহস্থলটি ক্লোন করুন এবং পূর্ববর্তী ধাপগুলি ব্যবহার করে চলুন GitHub এ প্রশ্নের উত্তরের নোটবুক.

লেখক সম্পর্কে

বেদান্ত জৈন একজন সিনিয়র এআই/এমএল বিশেষজ্ঞ, কৌশলগত জেনারেটিভ এআই উদ্যোগ নিয়ে কাজ করছেন। AWS-এ যোগদানের আগে, বেদান্ত বিভিন্ন কোম্পানি যেমন Databricks, Hortonworks (এখন Cloudera) এবং JP Morgan Chase-এ ML/Data Science Speciality পদে অধিষ্ঠিত ছিলেন। তার কাজের বাইরে, বেদান্ত সঙ্গীত তৈরি, রক ক্লাইম্বিং, অর্থপূর্ণ জীবন যাপনের জন্য বিজ্ঞান ব্যবহার করে এবং বিশ্বজুড়ে রান্নার অন্বেষণের প্রতি আগ্রহী।

বেদান্ত জৈন একজন সিনিয়র এআই/এমএল বিশেষজ্ঞ, কৌশলগত জেনারেটিভ এআই উদ্যোগ নিয়ে কাজ করছেন। AWS-এ যোগদানের আগে, বেদান্ত বিভিন্ন কোম্পানি যেমন Databricks, Hortonworks (এখন Cloudera) এবং JP Morgan Chase-এ ML/Data Science Speciality পদে অধিষ্ঠিত ছিলেন। তার কাজের বাইরে, বেদান্ত সঙ্গীত তৈরি, রক ক্লাইম্বিং, অর্থপূর্ণ জীবন যাপনের জন্য বিজ্ঞান ব্যবহার করে এবং বিশ্বজুড়ে রান্নার অন্বেষণের প্রতি আগ্রহী।

জেমস ব্রিগস পাইনকোনে একজন স্টাফ ডেভেলপার অ্যাডভোকেট, ভেক্টর অনুসন্ধান এবং এআই/এমএল বিশেষজ্ঞ। তিনি ডেভেলপার এবং ব্যবসায়িকদের অনলাইন শিক্ষার মাধ্যমে তাদের নিজস্ব GenAI সলিউশন তৈরি করতে গাইড করেন। পিনকোন-এর আগে জেমস প্রতিষ্ঠিত ফাইন্যান্স কর্পোরেশনগুলিতে ছোট টেক স্টার্টআপের জন্য এআই-তে কাজ করেছিলেন। কাজের বাইরে, সার্ফিং এবং স্কুবা থেকে মুয়ে থাই এবং বিজেজে পর্যন্ত ভ্রমণ এবং নতুন অ্যাডভেঞ্চার গ্রহণ করার জন্য জেমসের একটি আবেগ রয়েছে।

জেমস ব্রিগস পাইনকোনে একজন স্টাফ ডেভেলপার অ্যাডভোকেট, ভেক্টর অনুসন্ধান এবং এআই/এমএল বিশেষজ্ঞ। তিনি ডেভেলপার এবং ব্যবসায়িকদের অনলাইন শিক্ষার মাধ্যমে তাদের নিজস্ব GenAI সলিউশন তৈরি করতে গাইড করেন। পিনকোন-এর আগে জেমস প্রতিষ্ঠিত ফাইন্যান্স কর্পোরেশনগুলিতে ছোট টেক স্টার্টআপের জন্য এআই-তে কাজ করেছিলেন। কাজের বাইরে, সার্ফিং এবং স্কুবা থেকে মুয়ে থাই এবং বিজেজে পর্যন্ত ভ্রমণ এবং নতুন অ্যাডভেঞ্চার গ্রহণ করার জন্য জেমসের একটি আবেগ রয়েছে।

জিন হুয়াং Amazon SageMaker JumpStart এবং Amazon SageMaker বিল্ট-ইন অ্যালগরিদমের জন্য একজন সিনিয়র ফলিত বিজ্ঞানী। তিনি স্কেলেবল মেশিন লার্নিং অ্যালগরিদম বিকাশের দিকে মনোনিবেশ করেন। তার গবেষণার আগ্রহ প্রাকৃতিক ভাষা প্রক্রিয়াকরণের ক্ষেত্রে, ট্যাবুলার ডেটার উপর ব্যাখ্যাযোগ্য গভীর শিক্ষা এবং নন-প্যারামেট্রিক স্পেস-টাইম ক্লাস্টারিংয়ের শক্তিশালী বিশ্লেষণ। তিনি এসিএল, আইসিডিএম, কেডিডি কনফারেন্স এবং রয়্যাল স্ট্যাটিস্টিক্যাল সোসাইটি: সিরিজ এ-তে অনেক গবেষণাপত্র প্রকাশ করেছেন।

জিন হুয়াং Amazon SageMaker JumpStart এবং Amazon SageMaker বিল্ট-ইন অ্যালগরিদমের জন্য একজন সিনিয়র ফলিত বিজ্ঞানী। তিনি স্কেলেবল মেশিন লার্নিং অ্যালগরিদম বিকাশের দিকে মনোনিবেশ করেন। তার গবেষণার আগ্রহ প্রাকৃতিক ভাষা প্রক্রিয়াকরণের ক্ষেত্রে, ট্যাবুলার ডেটার উপর ব্যাখ্যাযোগ্য গভীর শিক্ষা এবং নন-প্যারামেট্রিক স্পেস-টাইম ক্লাস্টারিংয়ের শক্তিশালী বিশ্লেষণ। তিনি এসিএল, আইসিডিএম, কেডিডি কনফারেন্স এবং রয়্যাল স্ট্যাটিস্টিক্যাল সোসাইটি: সিরিজ এ-তে অনেক গবেষণাপত্র প্রকাশ করেছেন।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- PlatoData.Network উল্লম্ব জেনারেটিভ Ai. নিজেকে ক্ষমতায়িত করুন। এখানে প্রবেশ করুন.

- প্লেটোএআইস্ট্রিম। Web3 ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- প্লেটোইএসজি। কার্বন, ক্লিনটেক, শক্তি, পরিবেশ সৌর, বর্জ্য ব্যবস্থাপনা. এখানে প্রবেশ করুন.

- প্লেটো হেলথ। বায়োটেক এবং ক্লিনিক্যাল ট্রায়াল ইন্টেলিজেন্স। এখানে প্রবেশ করুন.

- উত্স: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- : আছে

- : হয়

- :না

- :কোথায়

- $ ইউপি

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- 90

- a

- সম্পর্কে

- উপরে

- প্রবেশ

- অনুযায়ী

- হিসাব

- দিয়ে

- যোগ

- অতিরিক্ত

- অতিরিক্ত তথ্য

- গ্রহণ

- এডভেন্ঞার ট্যুরিজম

- উকিল

- আবার

- AI

- এআই ব্যবহারের ক্ষেত্রে

- এআই / এমএল

- আলগোরিদিম

- শ্রেণীবদ্ধ করা

- সব

- বরাবর

- ইতিমধ্যে

- এছাড়াও

- মর্দানী স্ত্রীলোক

- আমাজন সেজমেকার

- আমাজন সেজমেকার জাম্পস্টার্ট

- অ্যামাজন সেজমেকার স্টুডিও

- অ্যামাজন ওয়েব সার্ভিসেস

- পরিমাণ

- an

- বিশ্লেষণ

- এবং

- উত্তর

- উত্তর

- কোন

- API

- অ্যাপ্লিকেশন

- ফলিত

- অভিগমন

- পন্থা

- রয়েছি

- এলাকায়

- কাছাকাছি

- AS

- জিজ্ঞাসা করা

- At

- প্রচেষ্টা

- বৃদ্ধি

- উদ্দীপিত

- গাড়ী

- স্বয়ংক্রিয়ভাবে

- সহজলভ্য

- ডেস্কটপ AWS

- ভিত্তি

- ভিত্তি

- BE

- কারণ

- আগে

- শুরু করা

- মধ্যে

- ব্লগ

- পুষ্প

- উভয়

- বৃহত্তর

- নির্মাণ করা

- বিল্ট-ইন

- ব্যবসা

- কিন্তু

- by

- CAN

- গ্রেপ্তার

- কেস

- মামলা

- অক্ষর

- চার্জ

- মৃগয়া

- পরিষ্কার

- পরিষ্কারভাবে

- আরোহণ

- Cloudera

- থলোথলো

- স্তম্ভ

- কলাম

- কোম্পানি

- উপযুক্ত

- সম্পূর্ণ

- উপাদান

- উপাদান

- সম্মেলন

- সংযুক্ত

- কনসোল

- ধারণ করা

- ধারণ

- বিষয়বস্তু

- প্রসঙ্গ

- প্রসঙ্গ

- কথ্য

- কথোপকথন এআই

- রূপান্তর

- করপোরেশনের

- ঠিক

- সঠিকভাবে

- সিপিইউ

- সৃষ্টি

- সংকটপূর্ণ

- এখন

- উপাত্ত

- ডেটাবেস

- ডেটাব্রিক্স

- তারিখ

- আবার DBS

- সিদ্ধান্ত নেন

- গভীর

- গভীর জ্ঞানার্জন

- স্থাপন

- মোতায়েন

- বিকাশকারী

- ডেভেলপারদের

- উন্নয়নশীল

- উন্নয়ন

- মাত্রা

- সরাসরি

- আলোচনা করা

- do

- না

- doesn

- না

- ডোমেইন

- ডন

- ড্রপ

- সময়

- প্রতি

- পূর্বে

- সহজ

- বাস্তু

- প্রশিক্ষণ

- দক্ষ

- দক্ষতার

- এম্বেডিং

- প্রাচুর্যময়

- এনকোডিং

- শেষ

- সর্বশেষ সীমা

- শেষপ্রান্ত

- উন্নত করা

- পরিবেশ

- প্রতিষ্ঠিত

- থার (eth)

- এমন কি

- উদাহরণ

- অতিক্রম করা

- ফাঁসি

- প্রত্যাশিত

- অভিজ্ঞতা

- অন্বেষণ করুণ

- এক্সপ্লোরিং

- ব্যাপক

- বহিরাগত

- নির্যাস

- মুখ

- দ্রুত

- বৈশিষ্ট্য

- প্রতিপালিত

- কয়েক

- অর্থ

- আবিষ্কার

- শেষ

- প্রথম

- ভাসা

- গুরুত্ত্ব

- অনুসরণ

- জন্য

- বিন্যাস

- ভিত

- বিনামূল্যে

- থেকে

- ক্রিয়া

- সাধারণত

- উত্পন্ন

- উৎপাদিত

- প্রজন্ম

- সৃজক

- জেনারেটিভ এআই

- পাওয়া

- GitHub

- দাও

- প্রদত্ত

- দেয়

- Go

- Goes

- জিপিইউ

- নির্দেশিকা

- হাতল

- এরকম

- আছে

- he

- দখলী

- সাহায্য

- এখানে

- অত্যন্ত

- তার

- কিভাবে

- কিভাবে

- যাহোক

- HTTPS দ্বারা

- হুয়াং

- নাভি

- জড়িয়ে আছে

- মানব পাঠযোগ্য

- i

- আমি

- ID

- আদর্শ

- সনাক্ত করা

- আইডি

- if

- ভাবমূর্তি

- বাস্তবায়িত

- আমদানি

- in

- অন্তর্ভুক্ত করা

- সুদ্ধ

- বৃদ্ধি

- সূচক

- সূচীবদ্ধ

- শিল্প

- জানান

- তথ্য

- উদ্যোগ

- ইনপুট

- ইনপুট

- ইনস্টল

- উদাহরণ

- দৃষ্টান্ত

- সংহত

- মধ্যে রয়েছে

- ইন্টারফেস

- অভ্যন্তরীণ

- মধ্যে

- উপস্থাপিত

- IT

- আইটেম

- জেমস

- যোগদান

- জে পি মরগ্যান

- জেপি মরগান চেজ

- JPG

- রাখা

- চাবি

- জানা

- জ্ঞান

- ভাষা

- বড়

- বৃহত্তর

- শুরু করা

- নেতৃত্ব

- শিক্ষা

- লম্বা

- লাইব্রেরি

- জীবন

- মত

- LIMIT টি

- তালিকা

- পাখি

- লাইভস

- শিখা

- যুক্তিবিদ্যা

- দেখুন

- খুঁজছি

- অনেক

- মেশিন

- মেশিন লার্নিং

- করা

- মেকিং

- পরিচালিত

- ম্যানুয়ালি

- অনেক

- ম্যাচ

- ম্যাচ

- সর্বাধিক

- সর্বোচ্চ পরিমাণ

- মে..

- গড়

- অর্থপূর্ণ

- মানে

- স্মৃতি

- মেটাডাটা

- পদ্ধতি

- কমান

- প্রশমিত করা

- ML

- মডেল

- মডেল

- টাকা

- অধিক

- মরগান

- সেতু

- অনেক

- বহু

- সঙ্গীত

- অবশ্যই

- নাম

- প্রাকৃতিক

- স্বভাবিক ভাষা

- স্বাভাবিক ভাষা প্রক্রিয়াকরণ

- প্রয়োজন

- চাহিদা

- নতুন

- পরবর্তী

- NLP

- নোটবই

- এখন

- অসাড়

- লক্ষ্য

- of

- on

- ONE

- অনলাইন

- অনলাইন শিক্ষা

- কেবল

- খোলা

- অপারেশন

- or

- ক্রম

- OS

- অন্যভাবে

- আমাদের

- বাইরে

- আউটপুট

- আউটপুট

- বাহিরে

- নিজের

- কাগজপত্র

- পরামিতি

- বিশেষ

- বিশেষত

- পাস

- গৃহীত

- আবেগ

- কামুক

- সম্পাদন করা

- করণ

- অনুমতি

- ছবি

- পাইপলাইন

- সমভূমি

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- জনপ্রিয়

- অবস্থানের

- পোস্ট

- powering

- ভবিষ্যদ্বাণী

- ভবিষ্যতবাণী

- Predictor

- পছন্দের

- প্রতিরোধ

- প্রি

- আগে

- পূর্বে

- পূর্বে

- সমস্যা

- প্রক্রিয়া

- প্রসেস

- প্রক্রিয়াজাতকরণ

- প্রোফাইল

- অনুরোধ জানানো

- মালিকানা

- প্রদত্ত

- উপলব্ধ

- প্রদানের

- প্রকাশ্যে

- প্রকাশিত

- পাইথন

- পাইটার্চ

- প্রশ্নের

- প্রশ্ন

- প্রশ্ন

- দ্রুত

- পরিসর

- রেঞ্জিং

- প্রস্তুত

- গ্রহণ

- রেকর্ড

- অঞ্চল

- প্রাসঙ্গিক

- নির্ভর করা

- সংগ্রহস্থলের

- প্রতিনিধিত্ব করে

- প্রয়োজন

- প্রয়োজনীয়

- গবেষণা

- প্রতিক্রিয়া

- ফল

- ফলাফল

- প্রত্যাবর্তন

- ফিরতি

- শক্তসমর্থ

- শিলা

- ভূমিকা

- রাজকীয়

- চালান

- রান

- ঋষি নির্মাতা

- একই

- বলা

- মাপযোগ্য

- স্কেল

- বিজ্ঞান

- বিজ্ঞানী

- স্কোর

- স্ক্রিন

- SDK

- সার্চ

- অনুসন্ধান

- দেখ

- নির্বাচন করা

- জ্যেষ্ঠ

- অনুভূতি

- বাক্য

- ক্রম

- সিরিজ এ

- সেবা

- সেট

- উচিত

- প্রদর্শনী

- দেখিয়েছেন

- প্রদর্শিত

- শো

- পাশ

- অনুরূপ

- থেকে

- একক

- আয়তন

- ছোট

- ক্ষুদ্রতর

- So

- সমাজ

- কেবলমাত্র

- সমাধান

- সলিউশন

- কিছু

- কোথাও

- উৎস

- স্থান

- বিশেষজ্ঞ

- বিশেষজ্ঞ

- বিশিষ্টতা

- বিশেষভাবে

- অকুস্থল

- দণ্ড

- প্রারম্ভ

- পরিসংখ্যানসংক্রান্ত

- ধাপ

- প্রারম্ভিক ব্যবহারের নির্দেশাবলী

- থামুন

- দোকান

- দোকান

- কৌশলগত

- স্ট্রিং

- চিত্রশালা

- এমন

- সমর্থন

- সমর্থিত

- সমর্থন

- পদ্ধতি

- সিস্টেম

- T

- টেবিল

- লাগে

- কার্য

- প্রযুক্তি

- প্রযুক্তি স্টার্টআপস

- প্রযুক্তিঃ

- বলে

- পাঠ

- থাই

- চেয়ে

- যে

- সার্জারির

- ক্ষেত্র

- বিশ্ব

- তাদের

- তাহাদিগকে

- অতএব

- এইগুলো

- তারা

- কিছু

- এই

- সেগুলো

- দ্বারা

- সময়

- থেকে

- টোকেন

- টোকেনাইজেশন

- অত্যধিক

- সরঞ্জাম

- শীর্ষ

- ঐতিহ্যগত

- প্রশিক্ষণ

- ট্রান্সফরমার

- ট্রান্সফরমার

- রূপান্তরগুলির

- অনুবাদ

- ভ্রমণ

- আস্থা

- দুই

- ধরনের

- পরিণামে

- অসম্ভাব্য

- অপ্রতিরোধ্য.

- পর্যন্ত

- অনাবশ্যক

- আপডেট

- কোনো URI

- us

- ব্যবহার

- ব্যবহৃত

- ব্যবহারকারী

- ব্যবহারকারীর অভিজ্ঞতা

- ব্যবহারকারী

- ব্যবহার

- মানগুলি

- বিভিন্ন

- সংস্করণ

- মাধ্যমে

- চাক্ষুষ

- অপেক্ষা করুন

- , walkthrough

- প্রয়োজন

- ছিল

- তরঙ্গ

- উপায়..

- we

- ওয়েব

- ওয়েব সার্ভিস

- ওয়েব ভিত্তিক

- কি

- কখন

- যে

- যখন

- ব্যাপক

- প্রশস্ত পরিসর

- ইচ্ছা

- সঙ্গে

- ছাড়া

- হয়া যাই ?

- কাজ করছে

- কাজ

- কাজ

- বিশ্ব

- would

- মোড়ানো

- X

- হাঁ

- আপনি

- আপনার

- zephyrnet