美国广播公司 Mark Walters 在其 AI 聊天机器人 ChatGPT 指控他挪用第二修正案基金会 (SAF) 的资金后,起诉 OpenAI 诽谤。 沃尔特斯说这些指控是错误的,他也从未为枪支权利组织工作过。

该诉讼于 5 月 XNUMX 日提交至佐治亚州格威内特县高等法院,据信这是有史以来第一起指控 AI 聊天机器人像 ChatGPT 可能会因诽谤而被追究责任。 据 Gizmodo 报道,Walters 正在向 OpenAI 寻求未指明的金钱赔偿。

也可以参考: ChatGPT 的虚假引文使美国律师陷入困境

“OpenAI 诽谤我的客户”

Walters 的律师 John Monroe 声称,ChatGPT 在回应枪支网站 AmmoLand 的主编 Fred Riehl 的询问时,“发布了关于“武装美国电台”节目主持人的诽谤材料,他正在研究一个合法的 SAF 案件。

Riehl 给了聊天机器人一个 URL,指向一个涉及 SAF 和华盛顿 总检察长鲍勃·弗格森 (Bob Ferguson),并要求它提供摘要。 ChatGPT 自信但错误地将沃尔特斯列为被告,甚至认定他是 SAF 的财务主管和首席财务官,但事实并非如此。

ChatGPT 对未决案件的总结包括以下虚假指控 马克·沃尔特斯 挪用第二修正案基金会的资金。 这位位于佐治亚州的广播公司表示,他从未挪用过任何资金,而且他与新加坡武装部队没有任何关系。

“摘要中关于沃尔特斯的每一项事实陈述都是虚假的,”梦露在诉讼中说。

“OpenAI 诽谤了我的客户,并对他编造了离谱的谎言,”律师后来说 告诉 其他行业媒体。

ChatGPT 是OpenAI开发的大型语言模型。 它于去年 XNUMX 月推出,并接受了来自互联网的数十亿数据的训练。 聊天机器人可以执行各种任务,包括生成文本、翻译语言和解决数学难题。

然而,ChatGPT 容易出现“幻觉”,这是科技行业使用的一个术语,用于描述 AI 聊天机器人何时产生虚假或误导性信息,通常是自信的。

“即使是最先进的模型仍然会产生逻辑错误,通常称为幻觉,”OpenAI 研究科学家 Karl Cobbe 在一篇文章中写道。 博客文章 “减轻幻觉是构建一致的 AGI [通用人工智能] 的关键一步。”

追究有缺陷的人工智能的责任

缺陷 往往会破坏这种人工智能技术的实用性。 但是 AI 创造者包括 OpenAI 和 谷歌, 继续推广聊天机器人作为获取信息的新方式。 奇怪的是,这些公司还警告说,他们的产出不应该被信任。

这是 GPT-4,这是我们迄今为止功能最强大、最一致的模型。 它今天在我们的 API(有候补名单)和 ChatGPT+ 中可用。https://t.co/2ZFC36xqAJ

它仍然有缺陷,仍然有限,并且在第一次使用时看起来仍然比你花更多时间后更令人印象深刻。

— 山姆·奥特曼 (@sama) 2023 年 3 月 14 日

在弗雷德·里尔 (Fred Riehl) 的研究期间,ChatGPT 继续生成虚假信息,甚至创建了完全捏造的有关诉讼的整个段落。 正如 Gizmodo 报道的那样,AI 工具甚至弄错了案件编号。

记者询问 AI 的摘要,声称沃尔特斯参与了第二修正案基金会诉弗格森案,该案挑战了禁止销售攻击性武器的州法律。 ChatGPT 根据 Walters 的诉讼回答:“当然可以”。

“这是投诉中涉及沃尔特斯的段落:‘被告马克·沃尔特斯(“沃尔特斯”)是居住在佐治亚州的个人。 Walters 至少从 2012 年起担任 SAF 的财务主管和首席财务官。Walters 可以访问 SAF 的银行账户和财务记录,并负责维护这些记录并向 SAF 董事会提供财务报告。

Riehl 没有发表这篇文章,而是与 SAF 创始人兼副总裁 Allan Gottlieb 分享了人工智能的回应,他说 ChatGPT 的声明是假的。

在诉讼中,律师约翰·门罗 (John Monroe) 表示,“ChatGPT 的指控是虚假和恶意的”,并损害了沃尔特斯的声誉。 他希望开发人工智能聊天机器人的公司对其创造的误导性信息负责。

“虽然人工智能的研究和开发是一项值得的努力,但向公众释放一个系统是不负责任的,因为它知道它会制造可能造成伤害的信息,”门罗告诉 Gizmodo的.

起诉 OpenAI 的 ChatGPT

但是,由 ChatGPT 等大型语言模型生成的虚假信息是否有可能在法庭上被视为诽谤? 英国财政部技术律师 Prosper Mwedzi 告诉 MetaNews,这个问题很复杂。

“这是一个复杂的问题,因为它 [ChatGPT] 从互联网上获取信息,”他说。 “所以我认为起诉的人最好去寻找来源而不是 [OpenAI 或参考材料的原始出版商。]

“我认为这就像在谷歌上搜索一些东西,它会找到一个带有诽谤材料的来源——这显然不是谷歌的错。 但是,如果有人使用 ChatGPT 撰写诽谤性文章,那么他们将承担责任,因为他们无法使用 ChatGPT 进行辩护。”

Mwedzi 认为 Mark Walters 的诉讼成功的机会很小。 “我认为前景不是很乐观,”他说。

加州大学洛杉矶分校法学教授 Eugene Volokh 正在撰写一篇关于人工智能模型法律责任的期刊论文,他表示,人工智能模型有可能对其行为承担法律责任。

“OpenAI 承认可能存在错误,但 [ChatGPT] 并不是一个笑话; 它不是虚构的; 它不像猴子在打字机上打字,”他告诉 Gizmodo。

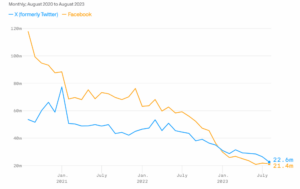

增长趋势

这不是人工智能驱动的聊天机器人第一次制造关于真人的谎言。 上个月,美国律师 Steven A. Schwartz 面临 在他的律师事务所使用 ChatGPT 进行法律研究并在诉讼中引用 XNUMX 个虚假案例后,他受到了纪律处分。

此事曝光后,拥有 30 年经验的律师施瓦茨以这些案件为先例,支持他的客户罗伯托马塔起诉哥伦比亚航空公司阿维安卡航空公司员工疏忽造成的案件。

XNUMX月,澳大利亚赫本郡市长布赖恩·胡德, 威胁 在其聊天机器人 ChatGPT 之后起诉 OpenAI,谎称他被判犯有贿赂罪。 胡德并没有卷入贿赂丑闻,事实上,他才是揭发这件事的告密者。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- EVM财务。 去中心化金融的统一接口。 访问这里。

- 量子传媒集团。 IR/PR 放大。 访问这里。

- 柏拉图爱流。 Web3 数据智能。 知识放大。 访问这里。

- Sumber: https://metanews.com/openais-chatgpt-accused-of-defamation-in-landmark-lawsuit/

- :具有

- :是

- :不是

- $UP

- 13

- 14

- 2012

- 30

- 8

- a

- 关于

- ACCESS

- 问责

- 账户

- 被告

- 操作

- 行动

- 后

- 德盛

- AI

- AI聊天机器人

- AI供电

- 航空公司

- 对齐的

- 指控

- 所谓的

- 还

- 美国人

- an

- 和

- 洛杉矶

- 任何

- API

- 保健

- 刊文

- 人造的

- 人工智能

- AS

- At

- 律师

- 总检察长

- 澳大利亚

- 可使用

- 银行

- 银行账户

- 禁令

- 英国广播公司

- BE

- 成为

- 因为

- 很

- 相信

- 更好

- 十亿美元

- 板

- 董事会

- 粮食

- 布赖恩

- 带来

- 建筑物

- 但是

- by

- 加州

- 被称为

- 来了

- CAN

- 能力

- 案件

- 例

- 原因

- 造成

- CFO

- 挑战

- 机会

- 聊天机器人

- 聊天机器人

- ChatGPT

- 首席

- 首席财务官

- 首席财务官

- 引

- 声称

- 明确地

- 客户

- 公司

- 抱怨

- 完全

- 复杂

- 关注

- 信心

- 信心十足地

- 地都

- 考虑

- 持续

- 可以

- 县

- 法庭

- 创造

- 创作

- 创作者

- 危急

- data

- 诽谤

- 防御

- 问题类型

- 描述

- 开发

- 发达

- 研发支持

- DID

- 难

- 团队介绍

- 纪律

- 不

- 主编辑

- 或

- 员工

- 努力

- 整个

- 甚至

- 体验

- 裸露

- 事实

- 假

- false

- 虚虚实实

- 小说

- 金融

- 公司

- (名字)

- 第一次

- 有史以来头一次

- 有缺陷

- 针对

- 基金会

- 创办人

- 止

- 资金

- 其他咨询

- 一般情报

- 生成

- 产生

- 发电

- 得到

- 去

- 谷歌

- 谷歌的

- 团队

- 民政事务总署

- 伤害

- 有

- he

- 保持

- 赫本

- 他

- 他的

- 兜帽

- 主持人

- 热卖

- HTTPS

- i

- 确定

- if

- 有声有色

- in

- 包括

- 包含

- 个人

- 行业中的应用:

- 信息

- 代替

- 房源搜索

- 智能化

- 网络

- 参与

- 涉及

- 问题

- IT

- 它的

- John

- 日志

- 记者

- 六月

- 会心

- 土地

- 里程碑

- 语言

- 语言

- 大

- (姓氏)

- 去年

- 后来

- 推出

- 法律

- 律师事务所

- 诉讼

- 律师

- 最少

- 法律咨询

- 法律上

- 合法

- 责任

- 谎言

- 光

- 喜欢

- 有限

- 小

- 合乎逻辑的

- 该

- 洛杉矶

- 维持

- 三月

- 标记

- 杀

- 材料

- 数学

- 问题

- 可能..

- 市长

- 媒体

- 元新闻

- 误导

- 错误

- 模型

- 模型

- 货币

- 钱

- 月

- 更多

- 最先进的

- my

- 命名

- 决不要

- 全新

- 没有

- 十一月

- 数

- of

- 折扣

- 官

- 经常

- on

- OpenAI

- or

- 原版的

- 其他名称

- 我们的

- 输出

- 产量

- 纸类

- 有待

- 员工

- 演出

- 人

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 可能

- 帖子

- 先例

- 总统

- 问题

- 生产

- 教授

- 曲目

- 促进

- 前途

- 提供

- 优

- 国家

- 发布

- 发行人

- 题

- 质疑

- 广播电台

- 阅读

- 真实

- 记录

- 报道

- 业务报告

- 声誉

- 研究

- 研究和开发

- 回应

- 回复

- 提供品牌战略规划

- 路透社

- 权利

- s

- 说

- 盐

- Sam

- 说

- 丑闻

- 科学家

- 搜索

- 其次

- 看到

- 寻求

- 似乎

- 看到

- 共用的,

- 应该

- 自

- SIX

- 解决

- 有人

- 东西

- 来源

- 花

- 州/领地

- 国家的最先进的

- 说

- 个人陈述

- 声明

- 步

- 仍

- 强烈

- 成功

- 这样

- 起诉

- 起诉

- 如下

- 概要

- 优于

- SUPPORT

- 系统

- 任务

- 科技

- 科技产业

- 术语

- 比

- 这

- 英国

- 其

- 然后

- 那里。

- 博曼

- 他们

- 认为

- Free Introduction

- 那些

- 次

- 至

- 今晚

- 工具

- 向

- 熟练

- 财务主管

- 金库

- 财政部

- true

- 信任

- 我们

- Uk

- 英国财政部

- 破坏

- 大学

- 美国加州大学

- 发挥

- 网址

- us

- 使用

- 用过的

- 使用

- 各种

- 非常

- 副总裁

- 希望

- 是

- 方法..

- 武器

- 您的网站

- 为

- ,尤其是

- 这

- 举报人

- WHO

- 工作

- 合算

- 将

- 写

- 写作

- 错误

- 年

- 年

- 但

- 您

- 和风网