07年2023月XNUMX日(Nanowerk新闻)诗歌、散文甚至书籍——还有什么是开放人工智能平台 ChatGPT 处理不了的呢?这些新的人工智能发展激发了代尔夫特理工大学和瑞士洛桑联邦理工大学的研究人员进行更深入的研究:例如,ChatGPT 也可以设计机器人吗?这对于设计过程来说是一件好事还是有风险?

研究人员发表了他们的研究结果 自然机器智能 (“法学硕士如何改变机器人设计流程?”)。

人类未来面临的最大挑战是什么?这是来自代尔夫特理工大学的助理教授 Cosimo Della Santina 和博士生 Francesco Stella 以及来自 EPFL 的 Josie Hughes 向 ChatGPT 提出的第一个问题。 “我们希望 ChatGPT 设计的不仅仅是一款机器人,而是一款真正有用的机器人,”Della Santina 说道。最终,他们选择了食物供应作为挑战,在与 ChatGPT 的交谈中,他们萌生了创造番茄收获机器人的想法。

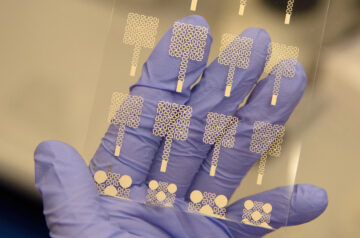

ChatGPT 以及代尔夫特理工大学和洛桑联邦理工学院的研究人员设计的番茄采摘机器人手臂“看着”摄像头。 (图片来源:Adrien Buttier / EPFL)

ChatGPT 以及代尔夫特理工大学和洛桑联邦理工学院的研究人员设计的番茄采摘机器人手臂“看着”摄像头。 (图片来源:Adrien Buttier / EPFL)

ChatGPT 以及代尔夫特理工大学和洛桑联邦理工学院的研究人员设计的番茄采摘机器人手臂“看着”摄像头。 (图片来源:Adrien Buttier / EPFL)

ChatGPT 以及代尔夫特理工大学和洛桑联邦理工学院的研究人员设计的番茄采摘机器人手臂“看着”摄像头。 (图片来源:Adrien Buttier / EPFL)

有用的建议

研究人员遵循 ChatGPT 的所有设计决策。斯特拉表示,事实证明,这些意见在概念阶段特别有价值。 “ChatGPT 将设计师的知识扩展到其他专业领域。例如,聊天机器人告诉我们哪种作物实现自动化最具经济价值。”但 ChatGPT 在实施阶段也提出了有用的建议:“用硅胶或橡胶制作夹具,以避免压碎西红柿”和“Dynamixel 电机是驱动机器人的最佳方式”。人类与人工智能合作的成果是可以收获西红柿的机械臂。ChatGPT 作为研究员

研究人员发现协作设计过程是积极且丰富的。 “然而,我们确实发现我们作为工程师的角色转向执行更多技术任务,”斯特拉说。在《自然机器智能》中,研究人员探索了人类与大型语言模型 (LLM) 之间不同程度的合作,ChatGPT 就是其中之一。在最极端的情况下,人工智能为机器人设计提供所有输入,而人类则盲目跟随。在这种情况下,法学硕士充当研究员和工程师,而人类充当经理,负责指定设计目标。错误信息的风险

对于今天的法学硕士来说,这种极端的情况是不可能发生的。问题是这是否可取。 “事实上,如果未经验证或验证,法学硕士的输出可能会产生误导。人工智能机器人旨在生成问题的“最有可能”答案,因此机器人领域存在错误信息和偏见的风险,”德拉桑蒂纳说。与法学硕士合作还引发了其他重要问题,例如剽窃、可追溯性和知识产权。 Della Santina、Stella 和 Hughes 将继续在机器人研究中使用番茄收获机器人。他们还在继续研究法学硕士,以设计新的机器人。具体来说,他们正在研究人工智能在设计自己身体时的自主性。 “对于我们领域的未来来说,最终的一个悬而未决的问题是如何利用法学硕士来帮助机器人开发人员,同时又不限制机器人应对 21 世纪挑战所需的创造力和创新,”斯特拉总结道。- SEO 支持的内容和 PR 分发。 今天得到放大。

- EVM财务。 去中心化金融的统一接口。 访问这里。

- 量子传媒集团。 IR/PR 放大。 访问这里。

- 柏拉图爱流。 Web3 数据智能。 知识放大。 访问这里。

- Sumber: https://www.nanowerk.com/news2/robotics/newsid=63137.php

- :是

- :不是

- $UP

- 07

- 1

- 10

- 14

- 15%

- 7

- 8

- a

- 根据

- 行为

- 通

- AI

- AI机器人

- 人工智能平台

- 所有类型

- 还

- an

- 和

- 回答

- 什么

- 保健

- 地区

- ARM

- AS

- 协助

- 助理

- At

- 自动化

- 避免

- BE

- 最佳

- 之间

- 偏见

- 盲目

- 机构

- 书籍

- 都

- 机器人

- 但是

- by

- 来了

- 相机

- CAN

- 案件

- Center

- 世纪

- 挑战

- 挑战

- 充

- ChatGPT

- 选择

- 共同

- 概念上的

- 继续

- 继续

- 合作

- 创造

- 创造力

- 作物

- 日期

- 决定

- 更深

- 设计

- 设计过程

- 设计

- 设计师

- 设计

- 开发

- 发展

- DID

- DIG

- 驾驶

- ,我们将参加

- 结束

- 工程师

- 工程师

- 充实

- 甚至

- 例子

- 专门知识

- 探索

- 扩展

- 极端

- 事实

- 部分

- 找到最适合您的地方

- 发现

- 姓氏:

- 其次

- 如下

- 食品

- 食品供应

- 针对

- 发现

- 止

- 未来

- 生成

- 非常好

- 最大的

- 处理

- 收成

- 有

- 创新中心

- HTTPS

- 人

- 人类

- 人类

- 主意

- if

- 图片

- 履行

- 重要

- in

- 創新

- 输入

- 灵感

- 例

- 知识分子

- 知识产权

- 房源搜索

- 问题

- IT

- 它的

- JPG

- 只是

- 知识

- 语言

- 大

- 小

- 寻找

- LOOKS

- 机

- 经理

- 中间

- 误传

- 误导

- 模型

- 更多

- 最先进的

- 电机

- 自然

- 打印车票

- 全新

- 目标

- of

- on

- 一

- 打开

- or

- 其他名称

- 我们的

- 输出

- 产量

- 己

- 尤其

- 合作伙伴

- 执行

- 相

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 积极

- 可能

- 过程

- 教授

- 财产

- 证明

- 提供

- 出版

- 题

- 提高

- 研究

- 研究员

- 研究人员

- 导致

- 上升

- 风险

- 风险

- 机器人

- 机器人

- 机器人

- 角色

- 橡胶

- s

- 说

- 脚本

- 转移

- 硅

- So

- 特别是

- 学生

- 学习

- 这样

- 供应

- 瑞士人

- 任务

- 教

- 文案

- 这

- 未来

- 其

- 那里。

- 博曼

- 他们

- 事

- Free Introduction

- 至

- 今天的

- 向

- 可追溯分析仪

- 改造

- 大学

- us

- 使用

- 用过的

- 验证

- 有价值

- 专利

- 通缉

- 是

- 方法..

- we

- 什么是

- 是否

- 这

- 而

- 将

- 也完全不需要

- 加工

- 将

- 但

- 和风网