ستمبر 20، 2023

فاؤنڈیشن ماڈلز (FMs) میں ایک نئے دور کا آغاز کر رہے ہیں۔ مشین لرننگ (ایم ایل) اور مصنوعی انٹیلی جنس (AI)، جو AI کی تیز تر ترقی کی طرف لے جا رہا ہے جسے نیچے دھارے کے کاموں کی ایک وسیع رینج میں ڈھال لیا جا سکتا ہے اور ایپلی کیشنز کی ایک صف کے لیے ٹھیک بنایا جا سکتا ہے۔

ڈیٹا کی پروسیسنگ کی بڑھتی ہوئی اہمیت کے ساتھ جہاں کام کیا جا رہا ہے، انٹرپرائز کے کنارے پر AI ماڈلز کو پیش کرنا ڈیٹا کی خودمختاری اور رازداری کے تقاضوں کی پابندی کرتے ہوئے، قریب قریب حقیقی وقت کی پیشین گوئیوں کو قابل بناتا ہے۔ کو ملا کر آئی بی ایم واٹسنکس ایج کمپیوٹنگ کے ساتھ ایف ایم کے لیے ڈیٹا اور اے آئی پلیٹ فارم کی صلاحیتیں، انٹرپرائزز آپریشنل ایج پر ایف ایم فائن ٹیوننگ اور انفرنسنگ کے لیے اے آئی ورک لوڈز چلا سکتے ہیں۔ یہ کاروباری اداروں کو اس قابل بناتا ہے کہ وہ کنارے پر AI کی تعیناتیوں کو پیمانہ کر سکے، تیز تر رسپانس ٹائمز کے ساتھ تعیناتی کے وقت اور لاگت کو کم کرتا ہے۔

براہ کرم ایج کمپیوٹنگ پر بلاگ پوسٹس کی اس سیریز میں تمام قسطوں کو دیکھنا یقینی بنائیں:

بنیادی ماڈل کیا ہیں؟

فاؤنڈیشن ماڈلز (FMs)، جو بڑے پیمانے پر بغیر لیبل والے ڈیٹا کے وسیع سیٹ پر تربیت یافتہ ہیں، جدید ترین مصنوعی ذہانت (AI) ایپلی کیشنز چلا رہے ہیں۔ انہیں بہاوی کاموں کی ایک وسیع رینج میں ڈھال لیا جا سکتا ہے اور ایپلی کیشنز کی ایک صف کے لیے ٹھیک بنایا جا سکتا ہے۔ جدید AI ماڈلز، جو ایک ہی ڈومین میں مخصوص کام انجام دیتے ہیں، FMs کو راستہ دے رہے ہیں کیونکہ وہ عام طور پر زیادہ سیکھتے ہیں اور ڈومینز اور مسائل میں کام کرتے ہیں۔ جیسا کہ نام سے پتہ چلتا ہے، ایک FM AI ماڈل کی بہت سی ایپلی کیشنز کی بنیاد بن سکتا ہے۔

FMs دو اہم چیلنجوں سے نمٹتے ہیں جنہوں نے کاروباری اداروں کو AI کو اپنانے سے روک رکھا ہے۔ سب سے پہلے، انٹرپرائزز بغیر لیبل والے ڈیٹا کی ایک بڑی مقدار تیار کرتے ہیں، جس کا صرف ایک حصہ AI ماڈل ٹریننگ کے لیے لیبل لگایا جاتا ہے۔ دوسرا، یہ لیبلنگ اور تشریح کا کام انتہائی انسانی کام ہے، جس میں اکثر ایک موضوع کے ماہر (SME) کے کئی سیکڑوں گھنٹے کی ضرورت ہوتی ہے۔ اس سے استعمال کے کیسز میں پیمائش کرنا لاگت سے ممنوع ہو جاتا ہے کیونکہ اس کے لیے SMEs اور ڈیٹا ماہرین کی فوج درکار ہوتی ہے۔ بغیر لیبل والے ڈیٹا کی بڑی مقدار کو ہضم کرکے اور ماڈل ٹریننگ کے لیے خود زیر نگرانی تکنیکوں کا استعمال کرتے ہوئے، FMs نے ان رکاوٹوں کو دور کر دیا ہے اور پورے انٹرپرائز میں AI کو وسیع پیمانے پر اپنانے کا راستہ کھول دیا ہے۔ ڈیٹا کی یہ بڑی مقدار جو ہر کاروبار میں موجود ہے بصیرت کو چلانے کے لیے جاری کیے جانے کا انتظار کر رہی ہے۔

بڑے زبان کے ماڈل کیا ہیں؟

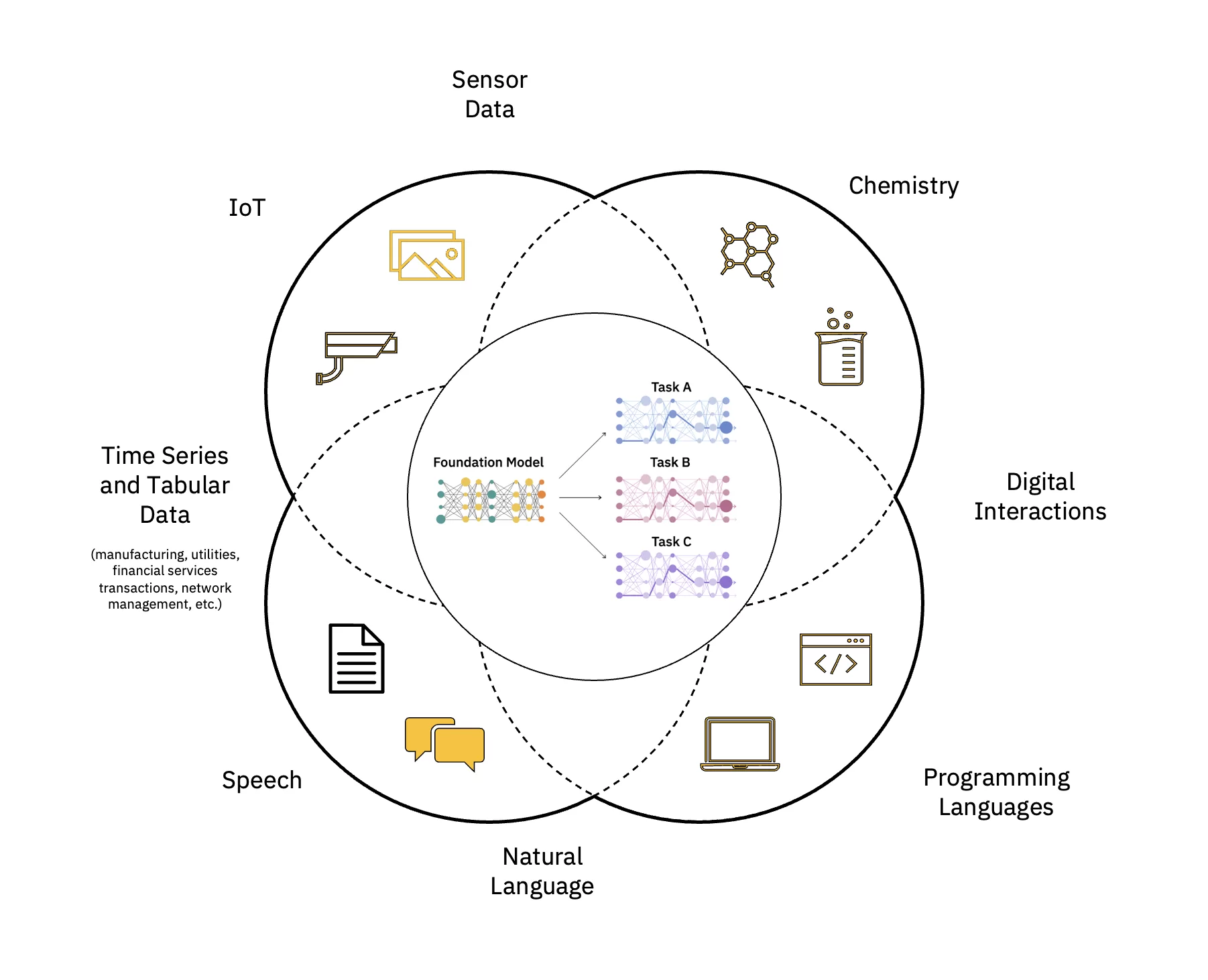

بڑے لینگویج ماڈلز (LLMs) فاؤنڈیشنل ماڈلز (FM) کی ایک کلاس ہیں جو تہوں پر مشتمل ہوتی ہیں۔ نیند نیٹ ورک جنہیں بغیر لیبل والے ڈیٹا کی ان بڑی مقدار پر تربیت دی گئی ہے۔ وہ مختلف قسم کے انجام دینے کے لیے خود زیر نگرانی سیکھنے کے الگورتھم استعمال کرتے ہیں۔ قدرتی زبان پروسیسنگ (NLP) کام ایسے طریقوں سے جو انسانوں کے زبان استعمال کرنے کے طریقے سے ملتے جلتے ہیں (تصویر 1 دیکھیں)۔

AI کے اثرات کو پیمانہ اور تیز کریں۔

فاؤنڈیشنل ماڈل (FM) کی تعمیر اور تعیناتی کے کئی مراحل ہیں۔ ان میں ڈیٹا انجیکشن، ڈیٹا سلیکشن، ڈیٹا پری پروسیسنگ، ایف ایم پری ٹریننگ، ایک یا زیادہ ڈاون اسٹریم ٹاسک کے لیے ماڈل ٹیوننگ، انفرنس سرونگ، اور ڈیٹا اور اے آئی ماڈل گورننس اور لائف سائیکل مینجمنٹ شامل ہیں۔ FMOps.

اس سب میں مدد کرنے کے لیے، IBM کاروباری اداروں کو ان FMs کی طاقت سے فائدہ اٹھانے کے لیے ضروری ٹولز اور صلاحیتیں پیش کر رہا ہے۔ آئی بی ایم واٹسنکس، ایک انٹرپرائز کے لیے تیار AI اور ڈیٹا پلیٹ فارم جس کو ایک انٹرپرائز میں AI کے اثرات کو بڑھانے کے لیے ڈیزائن کیا گیا ہے۔ IBM watsonx مندرجہ ذیل پر مشتمل ہے:

- IBM watsonx.ai نیا لاتا ہے پیدا کرنے والا AI صلاحیتیں—FMs اور روایتی مشین لرننگ (ML) کے ذریعے تقویت یافتہ—ایک طاقتور اسٹوڈیو میں جو AI لائف سائیکل پر محیط ہے۔

- IBM watsonx.data کسی بھی جگہ، آپ کے تمام ڈیٹا کے لیے AI کام کے بوجھ کو پیمانہ کرنے کے لیے ایک کھلے لیک ہاؤس فن تعمیر پر بنایا گیا ایک مناسب مقصد کے لیے ڈیٹا اسٹور ہے۔

- IBM watsonx.governance ایک اینڈ ٹو اینڈ خودکار AI لائف سائیکل گورننس ٹول کٹ ہے جو ذمہ دار، شفاف اور قابل وضاحت AI ورک فلو کو فعال کرنے کے لیے بنائی گئی ہے۔

ایک اور اہم ویکٹر انٹرپرائز کے کنارے پر کمپیوٹنگ کی بڑھتی ہوئی اہمیت ہے، جیسے صنعتی مقامات، مینوفیکچرنگ فلورز، ریٹیل اسٹورز، ٹیلکو ایج سائٹس وغیرہ۔ مزید خاص طور پر، انٹرپرائز ایج پر AI ڈیٹا کی پروسیسنگ کو قابل بناتا ہے جہاں کام کیا جا رہا ہے۔ ریئل ٹائم تجزیہ کے قریب۔ انٹرپرائز ایج وہ جگہ ہے جہاں انٹرپرائز ڈیٹا کی بڑی مقدار تیار کی جا رہی ہے اور جہاں AI قابل قدر، بروقت اور قابل عمل کاروباری بصیرت فراہم کر سکتا ہے۔

AI ماڈلز کو کنارے پر پیش کرنا ڈیٹا کی خودمختاری اور رازداری کے تقاضوں کی پابندی کرتے ہوئے قریب قریب حقیقی وقت کی پیشین گوئیوں کو قابل بناتا ہے۔ یہ انسپکشن ڈیٹا کے حصول، ٹرانسمیشن، ٹرانسفارمیشن اور پروسیسنگ سے وابستہ تاخیر کو نمایاں طور پر کم کرتا ہے۔ کنارے پر کام کرنا ہمیں حساس انٹرپرائز ڈیٹا کی حفاظت کرنے اور تیز تر رسپانس ٹائم کے ساتھ ڈیٹا کی منتقلی کے اخراجات کو کم کرنے کی اجازت دیتا ہے۔

کنارے پر اے آئی کی تعیناتیوں کی پیمائش کرنا، تاہم، ڈیٹا (متضاد، حجم اور ریگولیٹری) اور محدود وسائل (کمپیوٹ، نیٹ ورک کنیکٹیویٹی، اسٹوریج اور یہاں تک کہ آئی ٹی کی مہارت) سے متعلق چیلنجز کے درمیان کوئی آسان کام نہیں ہے۔ ان کو وسیع طور پر دو اقسام میں بیان کیا جا سکتا ہے:

- تعینات کرنے کا وقت/لاگت: ہر تعیناتی ہارڈ ویئر اور سافٹ ویئر کی کئی پرتوں پر مشتمل ہوتی ہے جنہیں تعیناتی سے پہلے انسٹال، کنفیگر اور ٹیسٹ کرنے کی ضرورت ہوتی ہے۔ آج، ایک سروس پروفیشنل انسٹالیشن میں ایک یا دو ہفتے لگ سکتے ہیں۔ ہر مقام پر، سختی سے محدود کرنا کہ کس حد تک تیز رفتار اور لاگت کے ساتھ کاروباری ادارے اپنی تنظیم میں تعیناتیوں کو بڑھا سکتے ہیں۔

- دن 2 کا انتظام: تعینات کناروں کی بڑی تعداد اور ہر تعیناتی کے جغرافیائی محل وقوع کی وجہ سے ان تعیناتیوں کی نگرانی، دیکھ بھال اور اپ ڈیٹ کرنے کے لیے ہر مقام پر مقامی IT سپورٹ فراہم کرنا اکثر مہنگا ہو جاتا ہے۔

ایج اے آئی کی تعیناتیاں

IBM نے ایک ایج فن تعمیر تیار کیا ہے جو AI کی تعیناتیوں کے لیے ایک مربوط ہارڈ ویئر/سافٹ ویئر (HW/SW) آلات ماڈل لا کر ان چیلنجوں کو حل کرتا ہے۔ یہ کئی کلیدی نمونوں پر مشتمل ہے جو AI کی تعیناتیوں کی توسیع پذیری میں مدد کرتے ہیں:

- مکمل سافٹ ویئر اسٹیک کی پالیسی پر مبنی، زیرو ٹچ پروویژننگ۔

- کنارے کے نظام کی صحت کی مسلسل نگرانی

- سافٹ ویئر/سیکیورٹی/کنفیگریشن اپڈیٹس کو متعدد کنارے والے مقامات پر منظم کرنے اور آگے بڑھانے کی صلاحیتیں— یہ سب دن-2 کے انتظام کے لیے مرکزی کلاؤڈ پر مبنی مقام سے ہیں۔

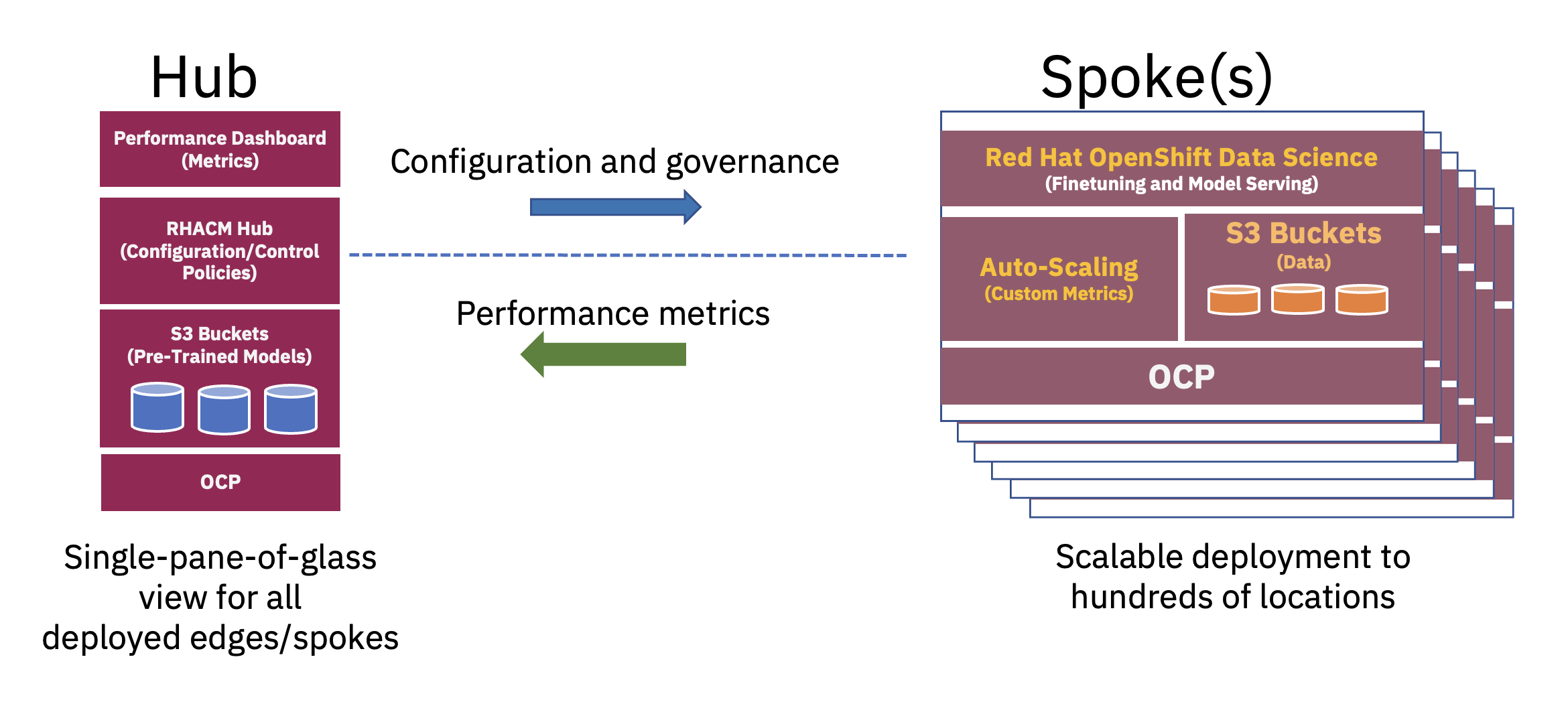

ایک تقسیم شدہ حب اور اسپوک فن تعمیر کو کنارے پر انٹرپرائز AI کی تعیناتیوں کو پیمانے کے لیے استعمال کیا جا سکتا ہے، جس میں ایک مرکزی کلاؤڈ یا انٹرپرائز ڈیٹا سینٹر ایک مرکز کے طور پر کام کرتا ہے اور کنارے کے اندر ایک باکس کا سامان ایک کنارے کے مقام پر اسپوک کے طور پر کام کرتا ہے۔. ہائبرڈ کلاؤڈ اور کنارے کے ماحول میں پھیلا ہوا یہ حب اور اسپاک ماڈل، FM آپریشنز کے لیے درکار وسائل کو بہترین طریقے سے استعمال کرنے کے لیے ضروری توازن کو بہترین انداز میں بیان کرتا ہے (شکل 2 دیکھیں)۔

ان بیس بڑے لینگویج ماڈلز (LLMs) اور دیگر قسم کے فاؤنڈیشن ماڈلز کی پہلے سے تربیت کے لیے وسیع پیمانے پر بغیر لیبل والے ڈیٹاسیٹس پر خود زیر نگرانی تکنیکوں کا استعمال کرتے ہوئے اکثر اہم کمپیوٹ (GPU) وسائل کی ضرورت ہوتی ہے اور یہ ایک مرکز میں بہترین کارکردگی کا مظاہرہ کرتا ہے۔ عملی طور پر لامحدود کمپیوٹ وسائل اور بڑے ڈیٹا کے ڈھیر جو اکثر کلاؤڈ میں محفوظ ہوتے ہیں بڑے پیرامیٹر ماڈلز کی پری ٹریننگ اور ان بنیادی فاؤنڈیشن ماڈلز کی درستگی میں مسلسل بہتری کی اجازت دیتے ہیں۔

دوسری طرف، ان بیس FMs کی ڈاون اسٹریم کاموں کے لیے ٹیوننگ — جس کے لیے صرف چند دسیوں یا سینکڑوں لیبل والے ڈیٹا کے نمونے اور انفرنس سرونگ کی ضرورت ہوتی ہے — کو انٹرپرائز کے کنارے پر صرف چند GPUs کے ساتھ پورا کیا جا سکتا ہے۔ یہ حساس لیبل والے ڈیٹا (یا انٹرپرائز کراؤن جیول ڈیٹا) کو انٹرپرائز آپریشنل ماحول میں محفوظ طریقے سے رہنے کی اجازت دیتا ہے اور ڈیٹا کی منتقلی کے اخراجات کو بھی کم کرتا ہے۔

ایپلیکیشنز کو کنارے پر تعینات کرنے کے لیے ایک مکمل اسٹیک اپروچ کا استعمال کرتے ہوئے، ایک ڈیٹا سائنسدان ماڈلز کی ٹھیک ٹیوننگ، جانچ اور تعیناتی انجام دے سکتا ہے۔ یہ ایک ہی ماحول میں مکمل کیا جا سکتا ہے جبکہ نئے AI ماڈلز کو آخری صارفین تک پہنچانے کے لیے ڈیولپمنٹ لائف سائیکل کو سکڑ کر۔ Red Hat OpenShift Data Science (RHODS) اور حال ہی میں اعلان کردہ Red Hat OpenShift AI جیسے پلیٹ فارمز پروڈکشن کے لیے تیار AI ماڈلز کو تیزی سے تیار کرنے اور تعینات کرنے کے لیے ٹولز فراہم کرتے ہیں۔ تقسیم شدہ بادل اور کنارے کے ماحول۔

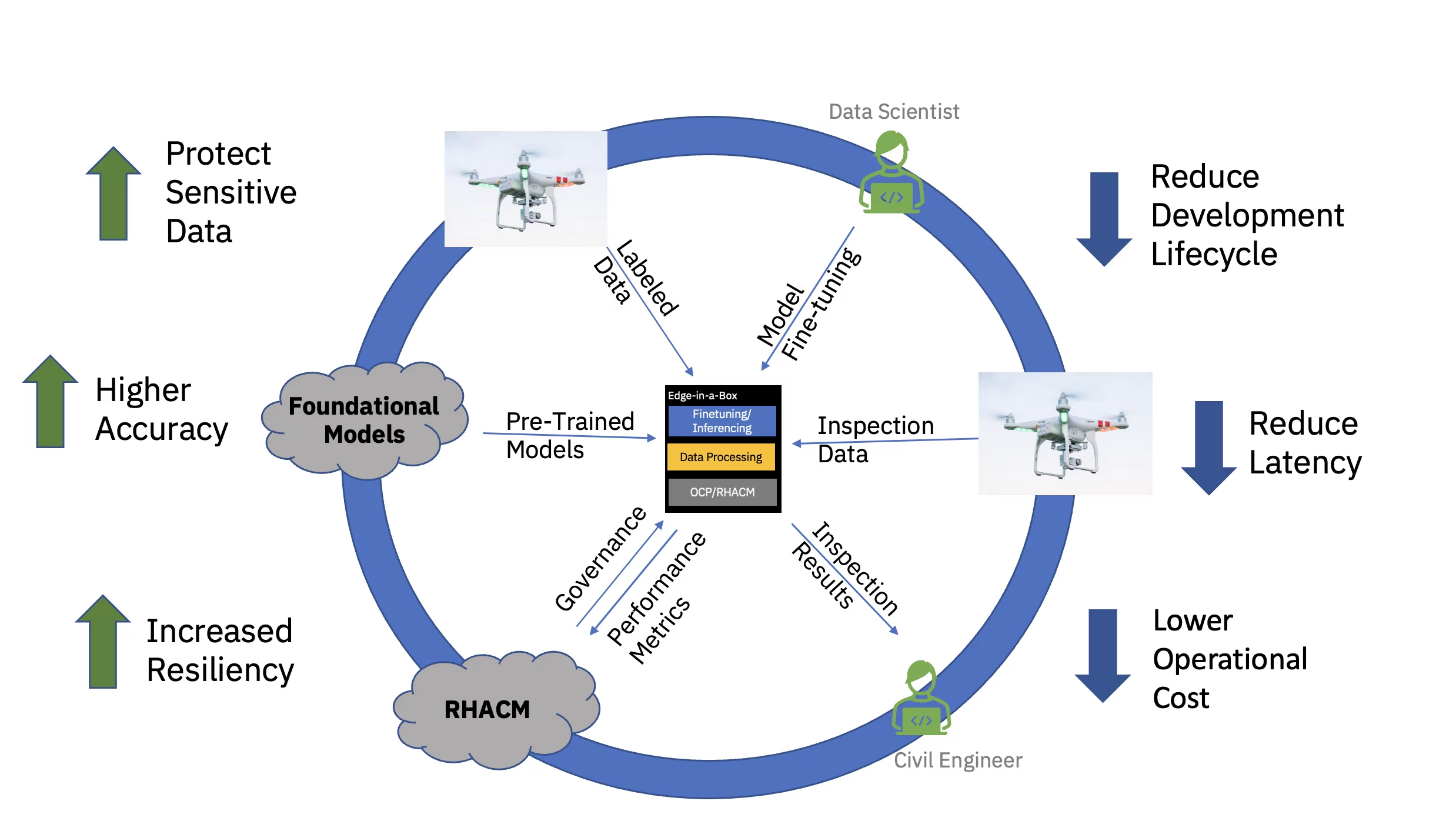

آخر میں، انٹرپرائز کے کنارے پر فائن ٹیونڈ AI ماڈل کی خدمت کرنا ڈیٹا کے حصول، ٹرانسمیشن، ٹرانسفارمیشن اور پروسیسنگ سے وابستہ تاخیر کو نمایاں طور پر کم کرتا ہے۔ کلاؤڈ میں پری ٹریننگ کو ٹھیک ٹیوننگ اور کنارے پر اندازہ لگانے سے مجموعی آپریشنل لاگت کو کم کر کے مطلوبہ وقت اور ڈیٹا کی نقل و حرکت کے اخراجات کو کسی بھی قیاس کام سے منسلک کیا جاتا ہے (شکل 3 دیکھیں)۔

اس قدر کی تجویز کو آخر سے آخر تک ظاہر کرنے کے لیے، سول انفراسٹرکچر کے لیے ایک مثالی وژن-ٹرانسفارمر پر مبنی فاؤنڈیشن ماڈل (عوامی اور کسٹم انڈسٹری کے مخصوص ڈیٹاسیٹس کا استعمال کرتے ہوئے پہلے سے تربیت یافتہ) کو تین نوڈ کنارے پر اندازہ لگانے کے لیے ٹھیک بنایا گیا اور تعینات کیا گیا۔ (بولی) کلسٹر۔ سافٹ ویئر اسٹیک میں Red Hat OpenShift کنٹینر پلیٹ فارم اور Red Hat OpenShift ڈیٹا سائنس شامل ہے۔ یہ ایج کلسٹر ریڈ ہیٹ ایڈوانسڈ کلسٹر مینجمنٹ فار کوبرنیٹس (RHACM) ہب کے کلاؤڈ میں چلنے کی مثال سے بھی منسلک تھا۔

زیرو ٹچ پروویژننگ

پالیسی پر مبنی، زیرو ٹچ پروویژننگ Red Hat Advanced Cluster Management for Kubernetes (RHACM) کے ساتھ پالیسیوں اور پلیسمنٹ ٹیگز کے ذریعے کی گئی تھی، جو مخصوص ایج کلسٹرز کو سافٹ ویئر کے اجزاء اور کنفیگریشنز کے سیٹ سے منسلک کرتے ہیں۔ یہ سافٹ ویئر کے اجزاء—مکمل اسٹیک میں پھیلے ہوئے اور کمپیوٹ، اسٹوریج، نیٹ ورک اور AI کام کے بوجھ کا احاطہ کرتے ہوئے—مختلف OpenShift آپریٹرز، مطلوبہ ایپلیکیشن سروسز کی فراہمی، اور S3 بالٹی (اسٹوریج) کا استعمال کرتے ہوئے انسٹال کیے گئے تھے۔

سول انفراسٹرکچر کے لیے پہلے سے تربیت یافتہ فاؤنڈیشن ماڈل (FM) کو Red Hat OpenShift Data Science (RHODS) کے اندر ایک Jupyter Notebook کے ذریعے کنکریٹ کے پلوں پر پائے جانے والے چھ قسم کے نقائص کی درجہ بندی کرنے کے لیے لیبل والے ڈیٹا کا استعمال کرتے ہوئے ٹھیک بنایا گیا تھا۔ ٹرائٹن سرور کا استعمال کرتے ہوئے اس فائن ٹیونڈ ایف ایم کی انفرنس سرونگ کا بھی مظاہرہ کیا گیا۔ مزید برآں، اس ایج سسٹم کی صحت کی نگرانی کو کلاؤڈ میں موجود مرکزی RHACM ڈیش بورڈ تک پرومیتھیس کے ذریعے ہارڈ ویئر اور سافٹ ویئر کے اجزاء سے مشاہداتی میٹرکس کو جمع کرکے ممکن بنایا گیا۔ سول انفراسٹرکچر انٹرپرائزز ان FMs کو اپنے کنارے والے مقامات پر تعینات کر سکتے ہیں اور ڈرون امیجری کا استعمال قریب قریب حقیقی وقت میں نقائص کا پتہ لگانے کے لیے کر سکتے ہیں- وقت سے بصیرت کو تیز کرتے ہوئے اور ہائی ڈیفینیشن ڈیٹا کی بڑی مقدار کو کلاؤڈ پر اور اس سے منتقل کرنے کی لاگت کو کم کر سکتے ہیں۔

خلاصہ

مرکب آئی بی ایم واٹسنکس ڈیٹا اور AI پلیٹ فارم کی صلاحیتیں فاؤنڈیشن ماڈلز (FMs) کے لیے ایک ایج-اِن-اے-باکس اپلائنس کے ساتھ انٹرپرائزز کو FM فائن ٹیوننگ اور آپریشنل ایج پر انفرنسنگ کے لیے AI ورک لوڈز چلانے کی اجازت دیتی ہے۔ یہ آلات پیچیدہ استعمال کے معاملات کو باکس سے باہر ہینڈل کر سکتا ہے، اور یہ مرکزی انتظام، آٹومیشن اور سیلف سروس کے لیے حب اور اسپوک فریم ورک بناتا ہے۔ Edge FM کی تعیناتیوں کو دہرائی جانے والی کامیابی، اعلیٰ لچک اور سلامتی کے ساتھ ہفتوں سے گھنٹوں تک کم کیا جا سکتا ہے۔

بنیادی ماڈلز کے بارے میں مزید جانیں۔

براہ کرم ایج کمپیوٹنگ پر بلاگ پوسٹس کی اس سیریز میں تمام قسطوں کو دیکھنا یقینی بنائیں:

کلاؤڈ سے مزید

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://www.ibm.com/blog/foundational-models-at-the-edge/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 08

- 1

- 10

- 13

- 15٪

- 20

- 2023

- 22

- 28

- 29

- 30

- 300

- 39

- 400

- 41

- 7

- 70

- 9

- a

- ہمارے بارے میں

- رفتار کو تیز تر

- تک رسائی حاصل

- کامیاب

- درستگی

- حصول

- کے پار

- کام کرتا ہے

- منسلک

- اس کے علاوہ

- پتہ

- پتے

- منہ بولابیٹا بنانے

- اعلی درجے کی

- ترقی

- اشتہار.

- AI

- اے آئی کو اپنانا

- اے آئی ماڈلز

- AI پلیٹ فارم

- امداد

- یلگوردمز

- تمام

- کی اجازت

- کی اجازت دیتا ہے

- بھی

- کے ساتھ

- رقم

- مقدار

- amp

- an

- تجزیہ

- تجزیاتی

- اور

- کا اعلان کیا ہے

- کوئی بھی

- کہیں

- درخواست

- ایپلی کیشنز

- نقطہ نظر

- فن تعمیر

- کیا

- لڑی

- مضمون

- مصنوعی

- مصنوعی ذہانت

- مصنوعی انٹیلی جنس (AI)

- AS

- منسلک

- At

- مصنف

- آٹومیٹڈ

- میشن

- دستیاب

- ایونیو

- واپس

- متوازن

- بینک

- بینکوں

- بیس

- BE

- کیونکہ

- بن

- بننے

- رہا

- شروع

- کیا جا رہا ہے

- یقین ہے کہ

- BEST

- باندھنے

- بلاگ

- بلاگ مراسلات

- بلاگز

- دونوں

- باکس

- پلوں

- آ رہا ہے

- لاتا ہے

- وسیع

- موٹے طور پر

- عمارت

- بناتا ہے

- تعمیر

- کاروبار

- by

- کر سکتے ہیں

- صلاحیتوں

- دارالحکومت

- گرفتاری

- کاربن

- کارڈ

- کارڈ

- مقدمات

- CAT

- اقسام

- کیونکہ

- سینٹر

- مرکزی

- مرکزی بینک

- مرکزی بینک ڈیجیٹل کرنسیوں

- مرکزی

- چین

- چیلنجوں

- تبدیل

- تبدیل کرنے

- چیک کریں

- انتخاب

- حلقوں

- سی آئی ایس

- سول

- طبقے

- درجہ بندی کرنا۔

- واضح

- کلائنٹس

- قریب سے

- بادل

- کلسٹر

- رنگ

- رنگا رنگ

- امتزاج

- مقابلہ

- پیچیدہ

- پیچیدگی

- تعمیل

- اجزاء

- کمپیوٹنگ

- کمپیوٹنگ

- ترتیب

- تشکیل شدہ

- منسلک

- رابطہ

- مشتمل

- کنٹینر

- جاری

- کنٹرول

- قیمت

- اخراجات

- سکتا ہے

- ڈھکنے

- cryptocurrency

- CSS

- کرنسیوں کے لئے منڈی کے اوقات کو واضح طور پر دیکھ پائیں گے۔

- اپنی مرضی کے

- گاہک

- گاہک کا تجربہ

- گاہکوں

- ڈیش بورڈ

- اعداد و شمار

- ڈیٹا سینٹر

- ڈیٹا پلیٹ فارم

- ڈیٹا سائنس

- ڈیٹا سائنسدان

- ڈیٹاسیٹس

- تاریخ

- وقف

- پہلے سے طے شدہ

- تعریفیں

- نجات

- مظاہرہ

- demonstrated,en

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- تعینات

- بیان کیا

- تفصیل

- ڈیزائن

- ترقی

- ترقی یافتہ

- ترقی

- ڈیجیٹل

- ڈیجیٹل کرنسیوں

- ڈیجیٹائزیشن

- خلل

- خلل ڈالنے والا

- خلل ڈالنے والے

- تقسیم کئے

- ضلع

- ڈومین

- ڈومینز

- کیا

- ڈرائیو

- ڈرائیونگ

- ڈرون

- ہر ایک

- آسان

- ماحول

- ایج

- کنارے کمپیوٹنگ

- خاتمہ کریں۔

- بلند

- کو چالو کرنے کے

- کے قابل بناتا ہے

- آخر

- آخر سے آخر تک

- انجینئر

- انجنیئرنگ

- درج

- انٹرپرائز

- اداروں

- آنے والا

- ماحولیات

- ماحول

- دور

- خاص طور پر

- وغیرہ

- Ether (ETH)

- بھی

- واقعات

- ہر کوئی

- وضع

- جانچ کر رہا ہے

- مثال کے طور پر

- عملدرآمد

- وجود

- باہر نکلیں

- مہنگی

- تجربہ

- ماہرین

- قابل وضاحت AI۔

- کی وضاحت

- توسیع

- انتہائی

- عوامل

- فاسٹ

- تیز تر

- چند

- میدان

- اعداد و شمار

- مالی

- مالیاتی ادارے

- فنانسنگ

- پہلا

- فرش

- پر عمل کریں

- کے بعد

- فونٹ

- کے لئے

- سب سے اوپر

- ملا

- فاؤنڈیشن

- کسر

- فریم ورک

- سے

- مکمل

- مکمل اسٹیک

- مزید برآں

- عام طور پر

- پیدا

- جنریٹر

- جغرافیائی

- جیوپولیٹکس

- دے

- گلوبل

- عالمی تجارت

- گورننس

- GPU

- GPUs

- گرڈ

- ہاتھ

- ہینڈل

- ہارڈ ویئر

- ٹوپی

- ہے

- صحت

- اونچائی

- مدد

- مدد

- مدد کرتا ہے

- اعلی معیار

- اعلی

- انتہائی

- تاریخ

- میزبان

- HOURS

- کس طرح

- کیسے

- تاہم

- HTTPS

- حب

- انسان

- سینکڑوں

- ہائبرڈ

- ہائبرڈ بادل

- IBM

- آئی بی ایم کلاؤڈ

- آئی سی او

- آئکن

- وضاحت کرتا ہے

- تصویر

- اثر

- اہمیت

- بہتری

- in

- شامل

- شامل

- اضافہ

- دن بدن

- انڈکس

- صنعتی

- صنعتوں

- صنعت

- صنعت سے متعلق

- افراط زر کی شرح

- افلاک

- نقطہ تصریف

- متاثر ہوا

- انفراسٹرکچر

- انیشی ایٹو

- جدت طرازی

- جدید

- آدانوں

- بصیرت

- مثال کے طور پر

- اداروں

- ضم

- انٹیلی جنس

- اندرونی

- متعارف کرانے

- IT

- انفارمیشن ٹیکنالوجی کی مدد

- سفر

- فوٹو

- کودنے

- Jupyter نوٹ بک

- صرف

- صرف ایک

- رکھی

- کلیدی

- Kubernetes

- لیبل

- زبان

- بڑے

- بڑے پیمانے پر

- تاخیر

- تازہ ترین

- تہوں

- معروف

- جانیں

- سیکھنے

- لیوریج

- زندگی کا دورانیہ

- کی طرح

- لا محدود

- لینکس

- مقامی

- مقامی

- محل وقوع

- مقامات

- لانگ

- دیکھو

- مشین

- مشین لرننگ

- بنا

- برقرار رکھنے کے

- بنا

- بناتا ہے

- انتظام

- انتظام

- مینوفیکچرنگ

- بہت سے

- مارکنگ

- بڑے پیمانے پر

- ماسٹر

- معاملہ

- زیادہ سے زیادہ چوڑائی

- نظام

- طریقوں

- پیمائش کا معیار

- منٹ

- کم سے کم

- منٹ

- ML

- موبائل

- ماڈل

- ماڈل

- جدید

- جدیدیت

- جدید خطوط پر استوار

- کی نگرانی

- نگرانی

- زیادہ

- تحریک

- منتقل

- نام

- سمت شناسی

- قریب

- ضروری

- ضرورت ہے

- ضرورت

- ضروریات

- نیٹ ورک

- نئی

- اگلے

- ویزا

- نوٹ بک

- کچھ بھی نہیں

- اب

- تعداد

- متعدد

- of

- کی پیشکش

- اکثر

- on

- ایک

- صرف

- کھول

- کھول دیا

- آپریشنل

- آپریشنز

- آپریٹرز

- اصلاح

- or

- تنظیم

- دیگر

- ہمارے

- باہر

- مجموعی طور پر

- پیکجوں کے

- صفحہ

- پیرامیٹر

- ادائیگی

- ادائیگی کے طریقوں

- ادائیگی

- انجام دینے کے

- کارکردگی

- پی ایچ پی

- پلیسمیںٹ

- پلیٹ فارم

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- رابطہ بحال کرو

- پوائنٹ

- پالیسیاں

- پالیسی

- پوزیشن

- ممکن

- پوسٹ

- مراسلات

- ممکنہ

- طاقت

- طاقتور

- پیشن گوئی

- پہلے

- کی رازداری

- نجی

- مسائل

- پروسیسنگ

- پیدا

- پیشہ ورانہ

- تجویز

- فراہم

- عوامی

- پش

- رینج

- میں تیزی سے

- پڑھنا

- اصل وقت

- حال ہی میں

- ریکارڈ

- ریکارڈنگ

- ریڈ

- ریڈ ہیٹ

- کو کم

- کم

- کم

- کو کم کرنے

- ضابطے

- ریگولیٹرز

- ریگولیٹری

- متعلقہ

- ہٹا دیا گیا

- بار بار قابل

- کی ضرورت

- ضرورت

- ضروریات

- مطلوبہ

- تحقیق

- وسائل

- جواب

- ذمہ دار

- قبول

- خوردہ

- اضافہ

- روبوٹس

- رن

- چل رہا ہے

- محفوظ طریقے سے

- اسی

- اسکیل ایبلٹی

- پیمانے

- پیمانہ ai

- سکیلنگ

- سائنس

- سائنسدان

- سکرین

- سکرپٹ

- دوسری

- محفوظ طریقے سے

- سیکورٹی

- دیکھنا

- دیکھ کر

- انتخاب

- خود خدمت

- حساس

- SEO

- ستمبر

- سیریز

- سرور

- سروس

- سروسز

- خدمت

- اجلاس

- سیشن

- مقرر

- کئی

- سیکنڈ اور

- دکھائیں

- اہم

- نمایاں طور پر

- اسی طرح

- بعد

- سنگاپور

- ایک

- واحد ماحول

- سائٹ

- سائٹس

- چھ

- مہارت

- چھوٹے

- ئیمایس

- ایس ایم ایز

- سافٹ ویئر کی

- سافٹ ویئر کے اجزاء

- حل

- خود مختاری

- خلا

- تناؤ

- مخصوص

- خاص طور پر

- کی طرف سے سپانسر

- ڈھیر لگانا

- شروع کریں

- ریاستی آرٹ

- رہنا

- مراحل

- ذخیرہ

- ذخیرہ

- ذخیرہ

- پردہ

- طوفان

- سٹوڈیو

- موضوع

- کامیابی

- اس طرح

- پتہ چلتا ہے

- فراہمی

- فراہمی کا سلسلہ

- حمایت

- اس بات کا یقین

- کے نظام

- لے لو

- لیا

- ٹاسک

- کاموں

- تکنیک

- ٹیکنالوجی

- ٹیلکو

- Temenos

- دہلی

- ٹرافیفار

- تجربہ

- ٹیسٹنگ

- کہ

- ۔

- ان

- موضوع

- وہاں.

- یہ

- وہ

- اس

- کے ذریعے

- وقت

- بروقت

- اوقات

- عنوان

- کرنے کے لئے

- آج

- مل کر

- ٹول کٹ

- اوزار

- سب سے اوپر

- تجارت

- روایتی

- ٹرین

- تربیت یافتہ

- ٹریننگ

- منتقل

- تبدیل

- تبدیلی

- تبدیلی

- شفاف

- رخ

- ٹویٹر

- دو

- قسم

- اقسام

- اچھال

- اپ ڈیٹ کریں

- تازہ ترین معلومات

- URL

- us

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- صارفین

- کا استعمال کرتے ہوئے

- استعمال

- استعمال کیا

- قیمتی

- قیمت

- قیمت کی تجویز

- مختلف اقسام کے

- مختلف

- وسیع

- کی طرف سے

- لنک

- بنیادی طور پر

- حجم

- جلد

- W

- انتظار کر رہا ہے

- بٹوے

- تھا

- لہر

- راستہ..

- طریقوں

- we

- ہفتے

- مہینے

- کیا

- کیا ہے

- جب

- جس

- جبکہ

- ڈبلیو

- کیوں

- وسیع

- وسیع رینج

- ساتھ

- کے اندر

- عورت

- WordPress

- کام

- کام کے بہاؤ

- کام کر

- گا

- لکھا

- اور

- زیفیرنیٹ