The rapid growth of generative AI brings promising new innovation, and at the same time raises new challenges. These challenges include some that were common before generative AI, such as bias and explainability, and new ones unique to foundation models (FMs), including hallucination and toxicity. At AWS, we are committed to developing generative AI responsibly, taking a people-centric approach that prioritizes education, science, and our customers, to integrate responsible AI across the end-to-end AI lifecycle.

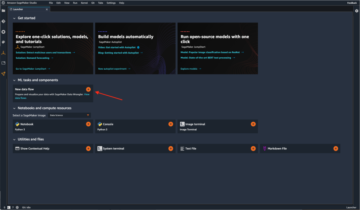

Over the past year, we have introduced new capabilities in our generative AI applications and models such as built-in security scanning in ایمیزون کوڈ وِسپرر, training to detect and block harmful content in ایمیزون ٹائٹن, and data privacy protections in ایمیزون بیڈرک. Our investment in safe, transparent, and responsible generative AI includes collaboration with the global community and policymakers as we encouraged and supported both the White House Voluntary AI commitments اور اے آئی سیفٹی سمٹ in the UK. And we continue to work hand-in-hand with customers to operationalize responsible AI with purpose-built tools like ایمیزون سیج میکر واضح کریں۔, ML Governance with Amazon SageMaker، اور مزید.

Introducing new responsible AI innovation

As generative AI scales to new industries, organizations, and use cases, this growth must be accompanied by a sustained investment in responsible FM development. Customers want their FMs to be built with safety, fairness, and security in mind, so that they can in turn deploy AI responsibly. At AWS re:Invent this year, we are excited to announce new capabilities to foster responsible generative AI innovation across a broad set of capabilities with new built-in tools, customer protections, resources to enhance transparency, and tools to combat disinformation. We aim to provide customers the information they need to evaluate FMs against key responsible AI considerations, like toxicity and robustness, and introduce guardrails to apply safeguards based on customer use cases and responsible AI policies. At the same time, our customers want to be better informed on the safety, fairness, security, and other properties, of AI services and FMs, as they use them within their own organization. We are excited to announce more resources to help customers better understand our AWS AI services and deliver the transparency they are asking for.

Implementing safeguards: Guardrails for Amazon Bedrock

Safety is a priority when it comes to introducing generative AI at scale. Organizations want to promote safe interactions between their customers and generative AI applications that avoid harmful or offensive language and align with company policies. The easiest way to do that is to put consistent safeguards in place across the whole organization so everyone can innovate safely. Yesterday we announced the preview of ایمیزون بیڈرک کے لیے گارڈریلز—a new capability that makes it easy to implement application-specific safeguards based on customer use cases and responsible AI policies.

Guardrails drive consistency in how FMs on Amazon Bedrock respond to undesirable and harmful content within applications. Customers can apply guardrails to large language models on Amazon Bedrock as well as to fine-tuned models and in combination with ایمیزون بیڈرک کے ایجنٹ. Guardrails lets you specify topics to be avoided, and the service automatically detects and prevents queries and responses that fall into restricted categories. Customers can also configure content filter thresholds across categories including hate speech, insults, sexualized language, and violence to filter out harmful content to the desired level. For example, an online banking application can be set up to avoid providing investment advice and limit inappropriate content (such as hate speech, insults, and violence). In the near future, customers will also be able to redact personally identifiable information (PII) in user inputs and FMs’ responses, set profanity filters, and provide a list of custom words to block in interactions between users and FMs, improving compliance and further protecting users. With Guardrails, you can innovate faster with generative AI while maintaining protections and safeguards consistent with company policies.

Identifying the best FM for a specific use case: Model Evaluation in Amazon Bedrock

Today, organizations have a wide range of FM options to power their generative AI applications. To strike the right balance of accuracy and performance for their use case, organizations must efficiently compare models and find the best option based on key responsible AI and quality metrics that are important to them. To evaluate models, organizations must first spend days identifying benchmarks, setting up evaluation tools, and running assessments, all of which requires deep expertise in data science. Furthermore, these tests are not useful for evaluating subjective criteria (e.g., brand voice, relevance, and style) that requires judgment through tedious, time-intensive, human-review workflows. The time, expertise, and resources required for these evaluations—for every new use case —make it difficult for organizations to evaluate models against responsible AI dimensions and make an informed choice around what model will provide the most accurate, safe experience for their customers.

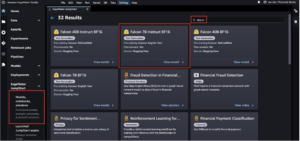

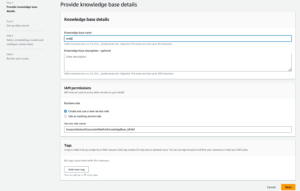

Now available in preview, Model Evaluation on Amazon Bedrock helps customers evaluate, compare, and select the best FMs for their specific use case based on custom metrics, such as accuracy and safety, using either automatic or human evaluations. In the Amazon Bedrock console, customers choose the FMs they want to compare for a given task, such as question-answering or content summarization. For automatic evaluations, customers select predefined evaluation criteria (e.g., accuracy, robustness, and toxicity) and upload their own testing dataset or select from built-in, publicly available datasets. For subjective criteria or nuanced content requiring judgment, customers can easily set up human-based evaluation workflows with just a few clicks. These workflows leverage a customer’s in-house workteam, or use a managed workforce provided by AWS, to evaluate model responses. During human-based evaluations, customers define use case-specific metrics (e.g., relevance, style, and brand voice). Once customers finish the setup process, Amazon Bedrock runs evaluations and generates a report, so customers can easily understand how the model performed across key safety and accuracy criteria and select the best model for their use case.

This ability to evaluate models is not limited to Amazon Bedrock, customers can also use model evaluation in Amazon SageMaker Clarify to easily evaluate, compare, and select the best FM option across key quality and responsibility metrics such as accuracy, robustness, and toxicity – across all FMs.

Combating disinformation: Watermarking in Amazon Titan

آج، ہم نے اعلان کیا ایمیزون ٹائٹن امیج جنریٹر in preview, which empowers customers to rapidly produce and enhance high-quality images at scale. We considered responsible AI during each stage of the model development process, including training data selection, building filtering capabilities to detect and remove inappropriate user inputs and model outputs, and improving demographic diversity of our model outputs. All Amazon Titan-generated images contain an invisible watermark by default, which is designed to help reduce the spread of disinformation by providing a discreet mechanism to identify AI-generated images. AWS is among the first model providers to widely release built-in invisible watermarks that are integrated into image outputs and are designed to be resistant to alterations.

Building trust: Standing behind our models and applications with indemnification

Building customer trust is core to AWS. We have been on a journey with our customers since our inception, and with the growth of generative AI, we remain committed to building innovative technology together. To enable customers to harness the power of our generative AI, they need to know they are protected. AWS offers copyright indemnity coverage for outputs of the following Amazon generative AI services: Amazon Titan Text Express, Amazon Titan Text Lite, Amazon Titan Embeddings, Amazon Titan Multimodal Embeddings, Amazon CodeWhisperer Professional, AWS HealthScribe, ایمیزون لیکس، اور ایمیزون کو ذاتی بنائیں۔. This means that customers who use the services responsibly are protected from third-party claims alleging copyright infringement by the outputs generated by those services (see Section 50.10 of the سروس کی شرائط). In addition, our standard IP indemnity for use of the services protects customers from third-party claims alleging IP infringement by the services and the data used to train them. To put it another way, if you use an Amazon generative AI service listed above and someone sues you for IP infringement, AWS will defend that lawsuit, which includes covering any judgment against you or settlement costs.

We stand behind our generative AI services and work to continually improve them. As AWS launches new services and generative AI continues to evolve, AWS will continue to relentlessly focus on earning and maintaining customer trust.

Enhancing transparency: AWS AI Service Card for Amazon Titan Text

We introduced AWS AI Service Cards at re:Invent 2022 as a transparency resource to help customers better understand our AWS AI services. AI Service Cards are a form of responsible AI documentation that provide customers with a single place to find information on the intended use cases and limitations, responsible AI design choices, and deployment and performance optimization best practices for our AI services. They are part of a comprehensive development process we undertake to build our services in a responsible way that addresses fairness, explainability, veracity and robustness, governance, transparency, privacy and security, safety, and controllability.

At re:Invent this year we are announcing a new AI Service Card for Amazon Titan Text to increase transparency in foundation models. We are also launching four new AI Service Cards including: Amazon Comprehend Detect PII, ایمیزون ٹرانسکرائب زہریلا کا پتہ لگانا, Amazon Rekognition Face Liveness، اور AWS HealthScribe. You can explore each of these cards on the AWS website. As generative AI continues to grow and evolve, transparency on how technology is developed, tested, and used will be a vital component to earn the trust of organizations and their customers alike. At AWS, we are committed to continuing to bring transparency resources like AI Service Cards to the broader community—and to iterate and gather feedback on the best ways forward.

Investing in responsible AI across the entire generative AI lifecycle

We are excited about the new innovations announced at re:Invent this week that gives our customers more tools, resources, and built-in protections to build and use generative AI safely. From model evaluation to guardrails to watermarking, customers can now bring generative AI to their organization faster, while mitigating risk. New protections for customers like IP indemnity coverage and new resources to enhance transparency like additional AI Service Cards are also key examples of our commitment to build trust across technology companies, policymakers, community groups, scientists, and more. We continue to make meaningful investments in responsible AI across the lifecycle of a foundation model—to help our customers scale AI in a safe, secure, and responsible way.

مصنفین کے بارے میں

پیٹر ہیلینن ذمہ دار AI ماہرین کی ایک ٹیم کے ساتھ AWS AI میں ذمہ دار AI کی سائنس اور مشق میں اقدامات کی رہنمائی کرتا ہے۔ اسے AI (پی ایچ ڈی، ہارورڈ) اور انٹرپرینیورشپ (بلائنڈ سائیٹ، ایمیزون کو فروخت) میں گہری مہارت حاصل ہے۔ اس کی رضاکارانہ سرگرمیوں میں اسٹینفورڈ یونیورسٹی اسکول آف میڈیسن میں مشاورتی پروفیسر اور مڈغاسکر میں امریکن چیمبر آف کامرس کے صدر کے طور پر خدمات انجام دینا شامل ہے۔ جب ممکن ہو، وہ اپنے بچوں کے ساتھ پہاڑوں پر جاتا ہے: اسکیئنگ، چڑھنا، پیدل سفر اور رافٹنگ

پیٹر ہیلینن ذمہ دار AI ماہرین کی ایک ٹیم کے ساتھ AWS AI میں ذمہ دار AI کی سائنس اور مشق میں اقدامات کی رہنمائی کرتا ہے۔ اسے AI (پی ایچ ڈی، ہارورڈ) اور انٹرپرینیورشپ (بلائنڈ سائیٹ، ایمیزون کو فروخت) میں گہری مہارت حاصل ہے۔ اس کی رضاکارانہ سرگرمیوں میں اسٹینفورڈ یونیورسٹی اسکول آف میڈیسن میں مشاورتی پروفیسر اور مڈغاسکر میں امریکن چیمبر آف کامرس کے صدر کے طور پر خدمات انجام دینا شامل ہے۔ جب ممکن ہو، وہ اپنے بچوں کے ساتھ پہاڑوں پر جاتا ہے: اسکیئنگ، چڑھنا، پیدل سفر اور رافٹنگ

واسی فلومین is currently the VP of Generative AI at AWS. He leads generative AI efforts including Amazon Bedrock, Amazon Titan, and Amazon CodeWhisperer.

واسی فلومین is currently the VP of Generative AI at AWS. He leads generative AI efforts including Amazon Bedrock, Amazon Titan, and Amazon CodeWhisperer.

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-and-capabilities-to-enable-responsible-ai-innovation/

- : ہے

- : ہے

- : نہیں

- $UP

- 10

- 100

- 125

- 2022

- 50

- a

- کی صلاحیت

- قابلیت

- ہمارے بارے میں

- اوپر

- کے ساتھ

- درستگی

- درست

- کے پار

- سرگرمیوں

- اس کے علاوہ

- ایڈیشنل

- پتے

- مشورہ

- کے خلاف

- AI

- AI خدمات

- مقصد

- سیدھ کریں

- اسی طرح

- تمام

- شانہ بشانہ

- بھی

- ایمیزون

- ایمیزون کوڈ وِسپرر

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- امریکی

- کے درمیان

- an

- اور

- اعلان کریں

- کا اعلان کیا ہے

- اعلان

- ایک اور

- کوئی بھی

- درخواست

- ایپلی کیشنز

- کا اطلاق کریں

- نقطہ نظر

- کیا

- ارد گرد

- AS

- سے پوچھ

- جائزوں

- At

- خودکار

- خود کار طریقے سے

- دستیاب

- سے اجتناب

- سے بچا

- AWS

- AWS re: ایجاد

- متوازن

- بینکنگ

- کی بنیاد پر

- BE

- رہا

- اس سے پہلے

- پیچھے

- معیارات

- BEST

- بہترین طریقوں

- بہتر

- کے درمیان

- تعصب

- بلاک

- دونوں

- برانڈ

- لانے

- لاتا ہے

- وسیع

- وسیع

- تعمیر

- اعتماد قائم کریں

- عمارت

- تعمیر

- تعمیر میں

- by

- کر سکتے ہیں

- صلاحیتوں

- صلاحیت

- کارڈ

- کارڈ

- کیس

- مقدمات

- اقسام

- چیلنجوں

- چیمبر

- بچوں

- انتخاب

- انتخاب

- میں سے انتخاب کریں

- دعوے

- چڑھنا

- تعاون

- کی روک تھام

- مجموعہ

- آتا ہے

- کامرس

- وابستگی

- انجام دیا

- کامن

- کمیونٹی

- کمپنیاں

- کمپنی کے

- موازنہ

- تعمیل

- جزو

- سمجھو

- وسیع

- خیالات

- سمجھا

- متواتر

- کنسول

- مشاورت

- پر مشتمل ہے

- مواد

- مسلسل

- جاری

- جاری ہے

- جاری

- کاپی رائٹ

- کاپی رائٹ کی خلاف ورزی

- کور

- اخراجات

- کوریج

- ڈھکنے

- معیار

- اس وقت

- اپنی مرضی کے

- گاہک

- گاہکوں

- اعداد و شمار

- ڈیٹا کی رازداری

- ڈیٹا سائنس

- ڈیٹاسیٹس

- دن

- گہری

- گہری مہارت

- پہلے سے طے شدہ

- وضاحت

- نجات

- آبادیاتی

- تعیناتی

- تعیناتی

- ڈیزائن

- ڈیزائن

- مطلوبہ

- کا پتہ لگانے کے

- ترقی یافتہ

- ترقی

- مشکل

- طول و عرض

- بے چینی

- تنوع

- do

- دستاویزات

- ڈرائیو

- کے دوران

- e

- ہر ایک

- کما

- کمانا

- سب سے آسان

- آسانی سے

- آسان

- تعلیم

- مؤثر طریقے سے

- کوششوں

- یا تو

- بااختیار بنانا

- کو چالو کرنے کے

- حوصلہ افزائی

- آخر سے آخر تک

- بڑھانے کے

- پوری

- ادیدوستا

- Ether (ETH)

- اندازہ

- کا جائزہ لینے

- تشخیص

- اندازہ

- ہر کوئی

- سب

- تیار

- مثال کے طور پر

- مثال کے طور پر

- بہت پرجوش

- تجربہ

- مہارت

- ماہرین

- وضاحت کی صلاحیت

- تلاش

- ایکسپریس

- چہرہ

- انصاف

- گر

- تیز تر

- آراء

- چند

- فلٹر

- فلٹرنگ

- فلٹر

- مل

- ختم

- پہلا

- توجہ مرکوز

- کے بعد

- کے لئے

- فارم

- آگے

- رضاعی

- فاؤنڈیشن

- چار

- سے

- مزید

- مزید برآں

- مستقبل

- جمع

- پیدا

- پیدا ہوتا ہے

- پیداواری

- پیداواری AI۔

- دی

- فراہم کرتا ہے

- گلوبل

- گورننس

- گروپ کا

- بڑھائیں

- ترقی

- نقصان دہ

- کنٹرول

- ہارورڈ

- نفرت

- نفرت انگیز تقریر

- ہے

- he

- مدد

- مدد کرتا ہے

- اعلی معیار کی

- لمبی پیدل سفر

- ان

- ہاؤس

- کس طرح

- HTTPS

- انسانی

- شناخت

- کی نشاندہی

- if

- تصویر

- تصاویر

- پر عملدرآمد

- اہم

- کو بہتر بنانے کے

- کو بہتر بنانے کے

- in

- آغاز

- شامل

- شامل

- شامل ہیں

- سمیت

- اضافہ

- صنعتوں

- معلومات

- مطلع

- خلاف ورزی

- اقدامات

- اختراعات

- جدت طرازی

- بدعت

- جدید

- جدید ٹیکنالوجی

- آدانوں

- ضم

- ضم

- ارادہ

- بات چیت

- میں

- متعارف کرانے

- متعارف

- متعارف کرانے

- سرمایہ کاری

- سرمایہ کاری

- پوشیدہ

- IP

- IT

- سفر

- فوٹو

- صرف

- کلیدی

- جان

- زبان

- بڑے

- آغاز

- شروع

- مقدمہ

- لیڈز

- آو ہم

- سطح

- لیوریج

- زندگی کا دورانیہ

- کی طرح

- LIMIT

- حدود

- لمیٹڈ

- لسٹ

- فہرست

- برقرار رکھنے

- بنا

- بناتا ہے

- میں کامیاب

- بامعنی

- کا مطلب ہے کہ

- میکانزم

- دوا

- پیمائش کا معیار

- برا

- تخفیف کرنا

- ماڈل

- ماڈل

- زیادہ

- سب سے زیادہ

- ضروری

- قریب

- ضرورت ہے

- نئی

- اب

- of

- بند

- جارحانہ

- تجویز

- on

- ایک بار

- والوں

- آن لائن

- آن لائن بینکنگ

- اصلاح کے

- اختیار

- آپشنز کے بھی

- or

- تنظیم

- تنظیمیں

- دیگر

- ہمارے

- باہر

- نتائج

- خود

- حصہ

- گزشتہ

- کارکردگی

- کارکردگی

- ذاتی طور پر

- پی ایچ ڈی

- PII

- مقام

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پالیسیاں

- پولیسی ساز

- ممکن

- طاقت

- پریکٹس

- طریقوں

- صدر

- روکتا ہے

- پیش نظارہ

- ترجیح دیتا ہے

- ترجیح

- کی رازداری

- پرائیویسی اور سیکورٹی

- عمل

- پیدا

- گستاخیاں

- پیشہ ورانہ

- ٹیچر

- وعدہ

- کو فروغ دینا

- خصوصیات

- محفوظ

- حفاظت

- حفاظت کرتا ہے

- فراہم

- فراہم

- فراہم کرنے والے

- فراہم کرنے

- عوامی طور پر

- ڈال

- معیار

- سوالات

- اٹھاتا ہے

- رینج

- تیزی سے

- میں تیزی سے

- RE

- کو کم

- جاری

- مطابقت

- رہے

- ہٹا

- رپورٹ

- ضرورت

- کی ضرورت ہے

- مزاحم

- وسائل

- وسائل

- جواب

- جوابات

- ذمہ داری

- ذمہ دار

- ذمہ داری سے

- محدود

- ٹھیک ہے

- رسک

- مضبوطی

- چل رہا ہے

- چلتا ہے

- محفوظ

- تحفظات

- محفوظ طریقے سے

- سیفٹی

- sagemaker

- اسی

- پیمانے

- پیمانہ ai

- ترازو

- سکیننگ

- سکول

- سائنس

- سائنسدانوں

- سیکشن

- محفوظ بنانے

- سیکورٹی

- دیکھنا

- منتخب

- انتخاب

- سروس

- سروسز

- خدمت

- مقرر

- قائم کرنے

- تصفیہ

- سیٹ اپ

- بعد

- ایک

- So

- فروخت

- کچھ

- کسی

- مخصوص

- تقریر

- خرچ

- پھیلانے

- اسٹیج

- کھڑے ہیں

- معیار

- کھڑے

- اسٹینفورڈ

- اسٹینفورڈ یونیورسٹی

- ہڑتال

- سٹائل

- اس طرح

- مقدمات

- تائید

- مسلسل

- لینے

- ٹاسک

- ٹیم

- ٹیکنالوجی

- ٹیکنالوجی کمپنیوں

- تجربہ

- ٹیسٹنگ

- ٹیسٹ

- متن

- کہ

- ۔

- کے بارے میں معلومات

- برطانیہ

- ان

- ان

- یہ

- وہ

- تیسری پارٹی

- اس

- اس ہفتے

- اس سال

- ان

- کے ذریعے

- وقت

- ٹائٹین

- کرنے کے لئے

- مل کر

- اوزار

- موضوعات

- ٹرین

- ٹریننگ

- شفافیت

- شفاف

- بھروسہ رکھو

- ٹرن

- Uk

- سمجھ

- شروع

- منفرد

- یونیورسٹی

- استعمال کی شرائط

- استعمال کیس

- استعمال کیا جاتا ہے

- رکن کا

- صارفین

- کا استعمال کرتے ہوئے

- اہم

- وائس

- رضاکارانہ

- رضاکارانہ

- vp

- چاہتے ہیں

- آبی نشان

- Watermarking

- کے watermarks

- راستہ..

- طریقوں

- we

- ویب

- ویب خدمات

- ویب سائٹ

- ہفتے

- اچھا ہے

- تھے

- کیا

- جب

- جس

- جبکہ

- ڈبلیو

- پوری

- وسیع

- وسیع رینج

- بڑے پیمانے پر

- گے

- ساتھ

- کے اندر

- الفاظ

- کام

- کام کے بہاؤ

- افرادی قوت۔

- سال

- کل

- آپ

- زیفیرنیٹ