جوش لوسپینوسو کا پہلا سائبر سیکیورٹی اسٹارٹ اپ 2017 میں Raytheon/Forcepoint نے حاصل کیا تھا۔ اس کا دوسرا، Shift5، امریکی فوج، ریل آپریٹرز اور جیٹ بلیو سمیت ایئر لائنز کے ساتھ کام کرتا ہے۔ 2009 کے ویسٹ پوائنٹ کے گریجویٹ اور روڈس اسکالر، 36 سالہ سابق آرمی کپتان نے ایک دہائی سے زیادہ وقت گزارا تصنیف ہیکنگ ٹولز قومی سلامتی ایجنسی اور امریکی سائبر کمانڈ کے لیے۔

لوسپینوسو نے حال ہی میں سینیٹ کی مسلح خدمات کی ذیلی کمیٹی کو بتایا کہ کس طرح مصنوعی ذہانت فوجی کارروائیوں کے تحفظ میں مدد کر سکتی ہے۔ سی ای او/پروگرامر نے ایسوسی ایٹڈ پریس کے ساتھ اس موضوع پر بات چیت کی اور ساتھ ہی بتایا کہ کس طرح ہتھیاروں کے نظام میں سافٹ ویئر کی کمزوریاں امریکی فوج کے لیے ایک بڑا خطرہ ہیں۔ انٹرویو میں وضاحت اور طوالت کے لیے ترمیم کی گئی ہے۔

س: اپنی گواہی میں، آپ نے AI سے چلنے والی ٹیکنالوجیز کے لیے دو بنیادی خطرات بیان کیے: ایک چوری۔ یہ خود وضاحتی ہے۔ دوسرا ڈیٹا پوائزننگ ہے۔ کیا آپ اس کی وضاحت کر سکتے ہیں؟

A: ڈیٹا پوائزننگ کے بارے میں سوچنے کا ایک طریقہ ڈیجیٹل ڈس انفارمیشن ہے۔ اگر مخالفین اس ڈیٹا کو تیار کرنے کے قابل ہو جاتے ہیں جو AI سے چلنے والی ٹیکنالوجیز دیکھتے ہیں، تو وہ اس ٹیکنالوجی کے کام کرنے کے طریقے پر گہرا اثر ڈال سکتے ہیں۔

سوال: کیا ڈیٹا پوائزننگ ہو رہا ہے؟

ج: ہم اسے وسیع پیمانے پر نہیں دیکھ رہے ہیں۔ لیکن یہ واقع ہوا ہے. سب سے مشہور واقعات میں سے ایک 2016 میں پیش آیا۔ مائیکروسافٹ نے ایک ٹویٹر چیٹ بوٹ جاری کیا جس کا نام Tay تھا جس نے آن لائن ہونے والی گفتگو سے سیکھا۔ بدنیتی پر مبنی صارفین نے اس پر بدسلوکی، جارحانہ زبان ٹویٹ کرنے کی سازش کی۔ ٹائی نے اشتعال انگیز مواد پیدا کرنا شروع کیا۔ مائیکرو سافٹ نے اسے آف لائن لے لیا۔

سوال: AI صرف چیٹ بوٹس نہیں ہے۔ یہ طویل عرصے سے سائبرسیکیوریٹی کے لیے لازمی رہا ہے، ٹھیک ہے؟

A: AI کا استعمال ای میل فلٹرز میں جنک میل اور فشنگ لالچ کو جھنڈا لگانے اور الگ کرنے کی کوشش کرنے کے لیے کیا جاتا ہے۔ ایک اور مثال اینڈ پوائنٹس ہے، جیسے آپ کے لیپ ٹاپ پر اینٹی وائرس پروگرام – یا میلویئر کا پتہ لگانے والا سافٹ ویئر جو نیٹ ورکس پر چلتا ہے۔ یقیناً، جارحانہ ہیکرز ان درجہ بندی کے نظام کو شکست دینے کے لیے AI کا بھی استعمال کرتے ہیں۔ اسے adversarial AI کہا جاتا ہے۔

س: آئیے ملٹری سافٹ ویئر سسٹمز کے بارے میں بات کرتے ہیں۔ ایک خطرناک 2018 حکومتی احتساب دفتر کی رپورٹ انہوں نے کہا کہ تقریباً تمام نئے تیار کردہ ہتھیاروں کے نظام میں مشن کی اہم کمزوریاں تھیں۔ اور پینٹاگون AI کو ایسے سسٹمز میں ڈالنے کے بارے میں سوچ رہا ہے؟

ج: یہاں دو مسائل ہیں۔ سب سے پہلے، ہمیں موجودہ ہتھیاروں کے نظام کو مناسب طریقے سے محفوظ کرنے کی ضرورت ہے۔ یہ ہمارے پاس ایک تکنیکی قرض ہے جس کی ادائیگی میں کافی وقت لگے گا۔ پھر AI الگورتھم کو محفوظ بنانے کا ایک نیا محاذ ہے - نئی چیزیں جنہیں ہم انسٹال کریں گے۔ GAO رپورٹ نے واقعی AI کے بارے میں بات نہیں کی۔ تو ایک سیکنڈ کے لیے AI کو بھول جائیں۔ اگر یہ نظام صرف اسی طرح رہے جس طرح وہ ہیں، وہ اب بھی بہت زیادہ کمزور ہیں۔

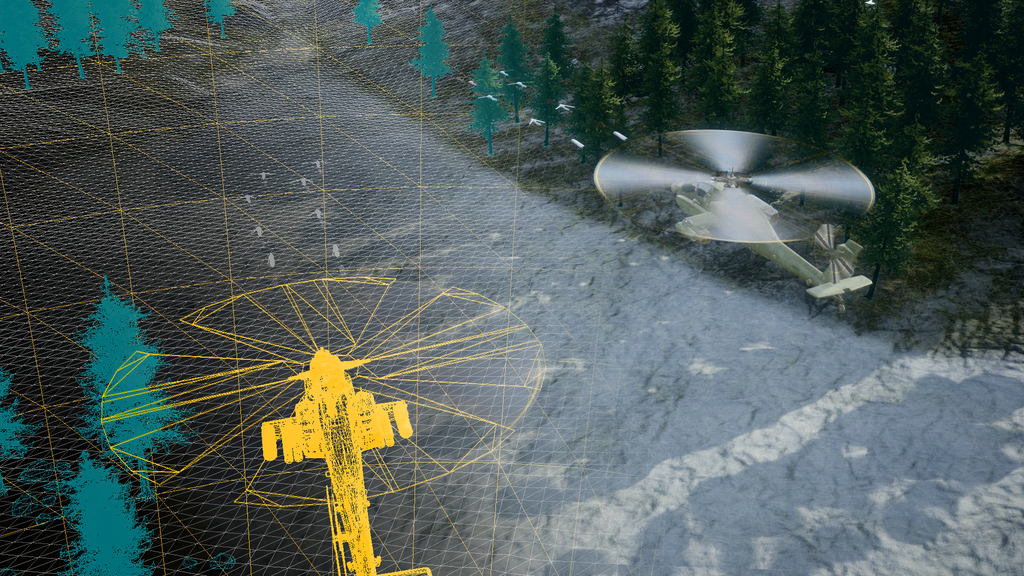

ہم لفافے کو آگے بڑھانے اور بہتر دیکھ بھال اور آپریشنل انٹیلی جنس جیسی چیزوں کے لیے AI سے چلنے والی صلاحیتوں کو شامل کرنے پر بات کر رہے ہیں۔ تمام عظیم. لیکن ہم تاش کے گھر کے اوپر تعمیر کر رہے ہیں۔ بہت سے نظام دہائیوں پرانے ہیں، ڈیجیٹل ٹیکنالوجیز کے ساتھ دوبارہ تیار کیے گئے ہیں۔ ہوائی جہاز، زمینی گاڑیاں، خلائی اثاثے، آبدوزیں۔ وہ اب ایک دوسرے سے جڑے ہوئے ہیں۔ ہم ڈیٹا کو اندر اور باہر تبدیل کر رہے ہیں۔ سسٹم غیر محفوظ ہیں، اپ گریڈ کرنا مشکل ہے، اور حملہ کیا جا سکتا ہے۔ ایک بار جب حملہ آور تک رسائی حاصل کر لیتا ہے، تو یہ کھیل ختم ہو جاتا ہے۔

بعض اوقات موجودہ سسٹمز کے ڈیجیٹل اجزاء کو دوبارہ ڈیزائن کرنے کے بجائے نیا پلیٹ فارم بنانا آسان ہوتا ہے۔ لیکن ان سسٹمز کو محفوظ بنانے میں AI کا کردار ہے۔ اگر کوئی ان سے سمجھوتہ کرنے کی کوشش کرتا ہے تو AI کو دفاع کے لیے استعمال کیا جا سکتا ہے۔

س: آپ نے گواہی دی کہ AI تحقیق کو روکنا، جیسا کہ کچھ لوگوں نے کہا ہے، برا خیال ہوگا کیونکہ یہ چین اور دیگر حریفوں کے حق میں ہوگا۔ لیکن آپ کو AI پروڈکٹس کے لیے طویل رش کے بارے میں بھی خدشات ہیں۔ کیوں؟

A: مجھے مہلک آواز سے نفرت ہے، لیکن ایسا لگتا ہے کہ نام نہاد "برننگ یوز" کیس لاگو ہوتا ہے۔ مارکیٹ میں پہنچائی جانے والی پروڈکٹ اکثر آگ لگ جاتی ہے (ہیک ہو جاتا ہے، ناکام ہو جاتا ہے، غیر ارادی نقصان ہوتا ہے)۔ اور ہم کہتے ہیں، 'لڑکے، ہمیں سیکورٹی میں تعمیر کرنی چاہیے تھی۔' میں امید کرتا ہوں کہ AI کی ترقی کی رفتار میں تیزی آئے گی، اور ہو سکتا ہے کہ ہم اسے محفوظ اور ذمہ دارانہ طریقے سے کرنے کے لیے کافی وقفہ نہ کریں۔ کم از کم وائٹ ہاؤس اور کانگریس ان مسائل پر بات کر رہے ہیں۔

س: ایسا لگتا ہے کہ کمپنیوں کا ایک گروپ – بشمول دفاعی شعبے میں – ہاف بیکڈ AI مصنوعات کا اعلان کرنے کے لیے جلدی کر رہے ہیں۔

A: ہر ٹیک کمپنی اور بہت سی نان ٹیک کمپنیوں نے AI کی طرف تقریباً ایک جھٹکا لگا دیا ہے۔ معاشی بدحالی آرہی ہے۔ کاروباری ماڈلز بنیادی طور پر تبدیل ہونے جا رہے ہیں۔ نقل مکانی پہلے ہی ہو رہی ہے یا افق پر ہے - اور کاروباری رہنما کوشش کر رہے ہیں کہ فلیٹ پیر نہ پکڑے جائیں۔

س: فوجی فیصلہ سازی جیسے ہدف بنانے میں AI کے استعمال کے بارے میں کیا خیال ہے؟

A: میں نہیں، واضح طور پر نہیں سمجھتا کہ مصنوعی ذہانت کے الگورتھم - جو ڈیٹا ہم اکٹھا کر رہے ہیں - مہلک ہتھیاروں کے نظام کے فیصلے کرنے کے لیے پرائم ٹائم کے لیے تیار ہیں۔ ہم اس سے بہت دور ہیں۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹوآئ اسٹریم۔ ویب 3 ڈیٹا انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ایڈریین ایشلے کے ساتھ مستقبل کا نقشہ بنانا۔ یہاں تک رسائی حاصل کریں۔

- PREIPO® کے ساتھ PRE-IPO کمپنیوں میں حصص خریدیں اور بیچیں۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://www.defensenews.com/artificial-intelligence/2023/05/29/adversarial-ai-a-threat-to-military-systems-shift5s-lospinoso-says/

- : ہے

- : ہے

- : نہیں

- 2016

- 2017

- 2018

- 70

- a

- قابلیت

- ہمارے بارے میں

- رفتار کو تیز تر

- تک رسائی حاصل

- احتساب

- حاصل

- انہوں نے مزید کہا

- مناسب

- شکست

- ایجنسی

- AI

- عی تحقیق

- ہوائی جہاز

- ایئر لائنز

- یلگوردمز

- تمام

- پہلے ہی

- بھی

- an

- اور

- اعلان کریں

- ایک اور

- ینٹیوائرس

- کا اطلاق کریں

- کیا

- مسلح

- فوج

- مصنوعی

- مصنوعی ذہانت

- AS

- اثاثے

- منسلک

- At

- برا

- BE

- کیونکہ

- رہا

- شروع ہوا

- موٹے طور پر

- تعمیر

- عمارت

- تعمیر

- گچرچھا

- کاروبار

- لیکن

- by

- کہا جاتا ہے

- کر سکتے ہیں

- صلاحیتوں

- کارڈ

- کیس

- مقدمات

- پکڑے

- تبدیل

- چیٹ بٹ

- چیٹ بٹس

- چین

- وضاحت

- درجہ بندی

- جمع

- آنے والے

- کمپنیاں

- کمپنی کے

- حریف

- اجزاء

- سمجھوتہ

- اندراج

- کانگریس

- مواد

- مکالمات

- سکتا ہے

- کورس

- شلپ

- اہم

- سائبر

- سائبر سیکیورٹی

- اعداد و شمار

- قرض

- دہائی

- دہائیوں

- فیصلہ کرنا

- فیصلے

- دفاع

- بیان کیا

- کھوج

- ترقی یافتہ

- ترقی

- ڈیجیٹل

- بات چیت

- بات چیت

- بے چینی

- do

- کرتا

- آسان

- اقتصادی

- ای میل

- کافی

- ہر کوئی

- مثال کے طور پر

- موجودہ

- توقع ہے

- وضاحت

- ناکام رہتا ہے

- دور

- کی حمایت

- فلٹر

- آگ

- پہلا

- کے لئے

- سابق

- سے

- فرنٹیئر

- بنیادی طور پر

- فوائد

- کھیل ہی کھیل میں

- گاو

- پیدا

- حاصل

- جا

- عظیم

- گراؤنڈ

- ہیک

- ہیکروں

- ہیکنگ

- تھا

- ہوا

- ہو رہا ہے۔

- ہارڈ

- ہے

- سر لمبا

- مدد

- یہاں

- ان

- افق

- ہاؤس

- کس طرح

- HTTPS

- i

- خیال

- if

- تصاویر

- اثر

- بہتر

- in

- سمیت

- انسٹال

- اٹوٹ

- انٹیلی جنس

- باہم منسلک

- انٹرویو

- میں

- مسائل

- IT

- جیٹ بلیو

- صرف

- زبان

- لیپ ٹاپ

- رہنماؤں

- سیکھا ہے

- کم سے کم

- لمبائی

- کی طرح

- لانگ

- طویل وقت

- بنا

- دیکھ بھال

- اہم

- بنانا

- میلویئر

- میلویئر کا پتہ لگانا

- بہت سے

- مارکیٹ

- مائیکروسافٹ

- شاید

- فوجی

- مشن

- ماڈل

- زیادہ

- نامزد

- قومی

- قومی سلامتی

- نیشنل سیکورٹی ایجنسی

- تقریبا

- ضرورت ہے

- نیٹ ورک

- نئی

- نیا پلیٹ فارم

- ناول

- اب

- ہوا

- of

- جارحانہ

- دفتر

- آف لائن

- اکثر

- پرانا

- on

- ایک بار

- ایک

- آن لائن

- چل رہا ہے

- آپریشنل

- آپریشنز

- آپریٹرز

- or

- دیگر

- باہر

- پر

- امن

- روکنے

- ادا

- پینٹاگون

- فشنگ

- محور

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پوائنٹ

- پریس

- وزیر اعظم

- پرنسپل

- مصنوعات

- حاصل

- پروگرام

- حفاظت

- دھکیلنا

- ڈالنا

- ریل

- تیار

- واقعی

- حال ہی میں

- redesign کے

- جاری

- رپورٹ

- تحقیق

- ذمہ دار

- ٹھیک ہے

- کردار

- اچانک حملہ کرنا

- s

- کہا

- کا کہنا ہے کہ

- کا کہنا ہے کہ

- دوسری

- شعبے

- محفوظ بنانے

- محفوظ

- سیکورٹی

- دیکھنا

- دیکھ کر

- لگتا ہے

- سینیٹ

- سروسز

- ہونا چاہئے

- So

- اب تک

- سافٹ ویئر کی

- کچھ

- کسی

- آواز

- خلا

- خرچ

- شروع

- ٹھہرے رہے

- ابھی تک

- ذیلی کمیٹی

- موضوع

- اس طرح

- گماگمن

- کے نظام

- سسٹمز

- لے لو

- بات

- ھدف بندی

- ٹیک

- ٹیک کمپنی

- ٹیکنیکل

- ٹیکنالوجی

- ٹیکنالوجی

- گواہی دی

- گواہی

- سے

- کہ

- ۔

- چوری

- ان

- تو

- وہاں.

- یہ

- وہ

- چیزیں

- لگتا ہے کہ

- سوچنا

- اس

- ان

- خطرہ

- خطرات

- وقت

- کرنے کے لئے

- لیا

- سب سے اوپر

- کی طرف

- کوشش

- پیغامات

- ٹویٹر

- دو

- ہمیں

- اپ گریڈ

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- صارفین

- گاڑیاں

- بہت

- نقصان دہ

- قابل اطلاق

- تھا

- راستہ..

- we

- ہتھیار

- اچھا ہے

- مغربی

- کیا

- سفید

- وائٹ ہاؤس

- کیوں

- ساتھ

- کام کرتا ہے

- گا

- آپ

- اور

- زیفیرنیٹ