Yapay zeka (AI), sayısız fayda ve fırsat sunarak çeşitli endüstrilerde devrim yarattı. Bununla birlikte, AI'nın ayrımcılığı ve önyargıları sürdürme potansiyeline ilişkin endişeler ortaya çıktı. Bu makale, yapay zeka ayrımcılığı konusunu araştırarak, yapay zeka sistemlerine gömülü önyargıları belirleme ve ele alma zorluklarına ışık tutuyor. Sektörün içinden kişiler, yanlış bilgilendirme, algoritmalardaki önyargılar ve yanıltıcı içerik üretimi konusundaki endişelere atıfta bulunarak yapay zekanın ahlaki ve etik sonuçları hakkında şüphelerini dile getiriyor. Yapay zekayı çevreleyen tartışmalar yoğunlaştıkça, şeffaflığı, hesap verebilirliği ve temel hakların korunmasını sağlamak için anlamlı düzenlemelere yönelik artan bir çağrı var.

Yapay Zeka ile Finansal Sektörler İçin Zorluklar

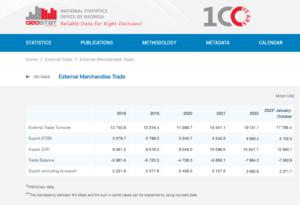

Worldpay by FIS'de kripto ve Web3 başkanı Nabil Manji'ye göre, AI ürünlerinin etkinliği büyük ölçüde eğitim için kullanılan kaynak materyalin kalitesine bağlıdır. CNBC ile yaptığı bir röportajda Manji, yapay zekanın performansına iki ana faktörün katkıda bulunduğunu açıkladı: erişebildiği veriler ve büyük dil modelinin yetenekleri.

Verilerin önemini göstermek için Manji, Reddit gibi şirketlerin erişim için ödeme gerektiren veri kazıma konusunda kamuya açık kısıtlamalar ilan ettiğinden bahsetti. Finansal hizmetler sektöründe, çeşitli dillerde ve formatlarda parçalanmış veri sistemlerinin zorluğunu vurguladı. Bu konsolidasyon ve uyum eksikliği, özellikle standartlaştırılmış ve modernize edilmiş veri altyapısına sahip sektörlerle karşılaştırıldığında, yapay zeka odaklı ürünlerin etkinliğini sınırlar.

Manji'ye göre, blockchain veya dağıtılmış defter teknolojisinin kullanılması, bu sorunun üstesinden gelmek için potansiyel bir çözüm sunabilir. Bu yenilikçi yaklaşım, geleneksel bankaların karmaşık sistemlerinde depolanan parçalanmış verilere ilişkin gelişmiş şeffaflık sağlayabilir. Bununla birlikte, son birkaç yıldır inovasyonu yönlendirmede ön saflarda yer alan Microsoft ve Google gibi daha çevik teknoloji şirketlerinin aksine, bankaların yüksek düzeyde düzenlenmiş ve yavaş hareket eden doğasının yeni AI araçlarını hızla benimseme yeteneklerini engelleyebileceğini kabul etti. onlarca yıl.

Bu faktörler göz önüne alındığında, veri entegrasyonunun karmaşıklığı ve bankacılık sektörünün doğal doğası nedeniyle finans sektörünün yapay zekadan yararlanma konusunda benzersiz zorluklarla karşı karşıya olduğu aşikar hale geliyor.

Twitter'da makine öğrenimi etiği, şeffaflık ve hesap verebilirliğin eski başkanı Rumman Chowdhury'ye göre, borç verme, AI sistemlerindeki önyargının marjinal toplulukları nasıl olumsuz etkileyebileceğinin dikkate değer bir örneğidir. Amsterdam'daki bir panel tartışmasında konuşan Chowdhury, 1930'larda Chicago'da tarihi "yeniden çizme" pratiğine dikkat çekti. Redlining, ırksal demografiye dayalı olarak ağırlıklı olarak Afro-Amerikan mahallelerine kredi vermeyi reddetmeyi içeriyordu.

Chowdhury, modern algoritmaların bir veri noktası olarak ırkı açıkça içermemesine rağmen, önyargıların yine de dolaylı olarak kodlanabileceğini açıkladı. Borç verme amacıyla bölgelerin ve bireylerin riskliliğini değerlendirmek için algoritmalar geliştirirken, önyargılar içeren tarihsel veriler, istemeden ayrımcılığı sürdürebilir.

Yapay Zekada Siyah Kadınların ardındaki vizyoner Angle Bush, kredi onayı belirlemeleri yapmak için yapay zeka sistemlerini kullanırken tarihsel verilere gömülü önyargıları yeniden üretmeyle ilişkili tehlikeleri kabul etmenin önemini vurguladı. Böyle bir uygulama, marjinal topluluklardan gelen kredi başvurularının otomatik olarak reddedilmesine yol açabilir ve böylece ırksal veya cinsiyet eşitsizliklerini sürdürebilir.

Deneyimli bir AI geliştiricisi olan Frost Li, kişiselleştirmenin zorluklarına dikkat çekti. yapay zeka entegrasyonu. AI modellerini eğitmek için "temel özelliklerin" seçilmesi bazen önyargılı sonuçlara yol açabilecek ilgisiz faktörleri içerebilir. Li, yabancıları hedefleyen fintech girişimlerinin, yerel okullara ve topluluklara daha aşina olan yerel bankalara kıyasla nasıl farklı kredi değerlendirme kriterleriyle karşı karşıya kalabileceğine dair bir örnek verdi.

Fintech'ler için karar verme sürecini otomatikleştirme konusunda uzmanlaşmış bir girişim olan Taktile'nin COO'su Niklas Guske, üretken yapay zekanın tipik olarak tüketicilerin kredi puanlarını veya risk puanlamasını oluşturmak için kullanılmadığını açıkladı. Aksine gücü, geleneksel yüklenim modellerinde veri kalitesini artırmak için metin dosyaları gibi yapılandırılmamış verilerin önceden işlenmesinde yatmaktadır.

Özetle, AI'nın borç verme ve finansal hizmetlerde kullanılması, önyargı ve ayrımcılıkla ilgili endişeleri artırıyor. Yapay zeka eğitimi sırasında verilere gömülü tarihsel önyargılar ve ilgisiz özelliklerin seçimi haksız sonuçlara yol açabilir. Yapay zeka çözümlerini uygularken ayrımcılığın istemeden devam etmesini önlemek için bankaların ve finans kurumlarının bu sorunları tanıması ve ele alması çok önemlidir.

Yapay Zeka Ayrımcılığının Kanıtı

Apple ve Goldman Sachs'ın dahil olduğu dava gibi örneklerde vurgulandığı gibi, AI tabanlı ayrımcılığın kanıtlanması zor olabilir. New York Eyaleti Mali Hizmetler Departmanı, Apple Card'a kadınlar için daha düşük limitler getirildiği iddialarını, doğrulayıcı kanıt bulunmadığını öne sürerek reddetti.

Irkçılığa Karşı Avrupa Ağı'nın direktörü Kim Smouter, AI'nın kitlesel olarak konuşlandırılmasının karar verme süreçlerinde şeffaflığa yol açarak bireylerin ayrımcılığı tanımlamasını ve ele almasını zorlaştırdığına dikkat çekiyor.

Smouter, bireylerin genellikle AI sistemlerinin nasıl çalıştığına dair sınırlı bilgiye sahip olduğunu ve bu durumun ayrımcılık veya sistemik önyargı durumlarını tespit etmeyi zorlaştırdığını açıklıyor. Ayrımcılık, birden çok kişiyi etkileyen daha geniş bir sorunun parçası olduğunda daha da karmaşık hale gelir. Smouter, çok sayıda yardım talebinin kurumsal önyargı nedeniyle yanlış bir şekilde hileli olarak etiketlendiği Hollanda'daki çocuk refahı skandalına atıfta bulunuyor. Bu tür işlev bozukluklarının keşfedilmesi zordur ve telafi edilmesi zor ve zaman alıcı olabilir, bu da önemli ve bazen geri döndürülemez zararlara yol açabilir.

Bu örnekler, yapay zekaya dayalı ayrımcılığı kanıtlamanın ve bu tür bir ayrımcılık meydana geldiğinde çare bulmanın doğasında var olan zorlukları göstermektedir. Yapay zeka sistemlerinin karmaşıklığı ve karar verme süreçlerinde şeffaflığın olmaması, bireylerin ayrımcılık vakalarını etkili bir şekilde tanımasını ve ele almasını zorlaştırabilir.

Chowdhury'ye göre, AI ile ilişkili riskleri ele almak için Birleşmiş Milletler benzeri küresel bir düzenleyici kuruma acil bir ihtiyaç var. Yapay zeka dikkate değer bir yenilik gösterse de, teknoloji uzmanları ve etikçiler tarafından bunun ahlaki ve etik sonuçlarıyla ilgili endişeler dile getirildi. Bu endişeler, yanlış bilgilendirme, yapay zeka algoritmalarındaki yerleşik ırk ve cinsiyet önyargıları ve ChatGPT gibi araçlar tarafından yanıltıcı içerik oluşturulması gibi konuları kapsar.

Chowdhury, metin, video ve ses dahil olmak üzere çevrimiçi bilgilerin üretken yapay zeka nedeniyle güvenilmez hale geldiği bir hakikat sonrası dünyaya girme konusundaki endişelerini dile getiriyor. Bu, bilgilerin bütünlüğünü nasıl sağlayabileceğimiz ve bilinçli kararlar almak için ona nasıl güvenebileceğimiz konusunda soruları gündeme getiriyor. Avrupa Birliği'nin AI Yasası örneğinde olduğu gibi, AI'nın anlamlı bir şekilde düzenlenmesi şu anda çok önemlidir. Bununla birlikte, düzenleyici tekliflerin etkili hale gelmesi için gereken uzun sürenin gerekli eylemleri geciktirme potansiyeline sahip olduğu konusunda endişeler var.

Smouter, AI algoritmalarında daha fazla şeffaflık ve hesap verebilirlik ihtiyacını vurguluyor. Bu, algoritmaları uzman olmayanlar için daha anlaşılır hale getirmeyi, testler gerçekleştirmeyi ve sonuçları yayınlamayı, bağımsız şikayet süreçleri oluşturmayı, periyodik denetimler ve raporlama yapmayı ve teknolojinin tasarımına ve dağıtımına ırksallaştırılmış toplulukları dahil etmeyi içerir. Temel haklar perspektifinden hareket eden ve tazmin gibi kavramlar getiren AI Yasası'nın yaklaşık iki yıl içinde yürürlüğe girmesi bekleniyor. Bu zaman çizelgesinin kısaltılması, inovasyonun ayrılmaz bir parçası olarak şeffaflık ve hesap verebilirliği desteklemek açısından avantajlı olacaktır.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. Otomotiv / EV'ler, karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- Blok Ofsetleri. Çevre Dengeleme Sahipliğini Modernleştirme. Buradan Erişin.

- Kaynak: https://www.forexnewsnow.com/fintech/the-urgency-of-addressing-ai-discrimination-transparency-accountability-and-regulatory-timelines/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- a

- kabiliyet

- Hakkımızda

- erişim

- sorumluluk

- kabul etti

- Hareket

- eylemler

- adres

- adresleme

- benimsemek

- avantajlı

- olumsuz

- etkiler

- Afrika

- karşı

- çevik

- AI

- AI Yasası

- AI sistemleri

- AI eğitimi

- algoritmalar

- İddialar

- Rağmen

- Amerikan

- amsterdam

- an

- ve

- beklenen

- Apple

- Elma kartı

- uygulamaları

- yaklaşım

- onay

- yaklaşık olarak

- ARE

- göre

- yapay

- yapay zeka

- AS

- yönleri

- belirlemek

- değerlendirme

- ilişkili

- At

- ses

- denetimler

- Otomatik

- ayrıca otomasyonun

- Bankacılık

- Bankacılık sektörü

- Bankalar

- merkezli

- BE

- müşterimiz

- olur

- olmuştur

- arkasında

- yarar

- faydaları

- önyargı

- önyargılı

- önyargıları

- Siyah

- blockchain

- vücut

- Getiriyor

- Daha geniş

- by

- çağrı

- CAN

- yetenekleri

- kart

- dava

- meydan okuma

- zorluklar

- zor

- ChatGPT

- Chicago

- çocuk

- iddia

- açıklık

- CNBC

- topluluklar

- Şirketler

- karşılaştırıldığında

- şikâyet

- karmaşık

- karmaşıklıklar

- karmaşıklık

- kavramlar

- Endişeler

- iletken

- sağlamlaştırma

- Tüketiciler

- içeren

- içerik

- aksi

- katkıda bulunmak

- geleneksel

- mırıldanmak

- Oluşturma

- kredi

- kriterleri

- çok önemli

- kripto

- tehlikeleri

- veri

- veri altyapısı

- veri entegrasyonu

- veri kalitesi

- tartışmalar

- yıl

- Karar verme

- kararlar

- Demografi

- bölüm

- bağlıdır

- açılma

- Dizayn

- Geliştirici

- gelişen

- farklı

- zor

- zorluklar

- yönetmen

- keşif

- ayırt etme

- tartışma

- dağıtıldı

- Dağıtılmış Defter

- dağıtılmış defter teknolojisi

- sürme

- gereken

- sırasında

- Flemenkçe

- Etkili

- etkili bir şekilde

- etki

- gömülü

- ortaya

- vurgulamaktadır

- kapsamak

- uygulama

- artırmak

- gelişmiş

- sağlamak

- girme

- özellikle

- kurulması

- törel

- etik

- Avrupa

- Hatta

- kanıt

- belirgin

- örnek

- örnekler

- deneyimli

- açıkladı

- açıklar

- araştırıyor

- ekspres

- Yüz

- yüzler

- faktörler

- tanıdık

- Özellikler

- az

- dosyalar

- mali

- finans endüstrileri

- Finansal Kurumlar

- finansal hizmetler

- fintech

- fintech girişimleri

- fintechs

- FIS

- İçin

- Forefront

- Eski

- parçalanmış

- sahte

- itibaren

- temel

- Cinsiyet

- nesil

- üretken

- üretken yapay zeka

- Küresel

- goldman

- Goldman Sachs

- büyük

- Büyüyen

- zarar

- Var

- he

- baş

- ağır şekilde

- Vurgulanan

- büyük ölçüde

- tarihsel

- Ne kadar

- Ancak

- HTTPS

- belirlemek

- belirlenmesi

- uygulanması

- etkileri

- önem

- heybetli

- in

- dahil

- içerir

- Dahil olmak üzere

- bağımsız

- bireyler

- Endüstri

- sanayi

- eşitsizlikler

- bilgi

- bilgi

- Altyapı

- doğal

- Yenilikçilik

- yenilikçi

- Kurumsal

- kurumları

- integral

- bütünleşme

- bütünlük

- İstihbarat

- görüşme

- içine

- Tanıtımlar

- dahil

- ilgili

- içeren

- konu

- sorunlar

- IT

- ONUN

- bilgi

- Eksiklik

- dil

- Diller

- büyük

- öncülük etmek

- önemli

- öğrenme

- Defteri kebir

- borç verme

- kaldıraç

- li

- yalan

- ışık

- sevmek

- Sınırlı

- sınırları

- borç

- Krediler

- yerel

- YEREL BANKALAR

- alt

- makine

- makine öğrenme

- Ana

- yapmak

- Yapımı

- Kitle

- malzeme

- Mayıs..

- anlamlı

- adı geçen

- Microsoft

- olabilir

- yanlış bilgi

- yanıltıcı

- model

- modelleri

- Modern

- an

- manevi

- Daha

- çoklu

- Milletler

- Tabiat

- gerekli

- gerek

- ağ

- yeni

- New York

- New York eyaleti

- New York Eyaleti Finansal Hizmetler Bölümü

- uzman olmayan

- dikkate değer

- numara

- sayısız

- sayısız fayda

- edinme

- of

- teklif

- teklif

- sık sık

- on

- Online

- işletmek

- Fırsatlar

- or

- dışarı

- sonuçlar

- panel

- açık oturum

- Bölüm

- geçmiş

- ödeme

- performans

- periyodik

- Kişiselleştirme

- perspektif

- Platon

- Plato Veri Zekası

- PlatoVeri

- Nokta

- noktaları

- potansiyel

- potansiyel

- uygulama

- ağırlıklı olarak

- presleme

- önlemek

- Sorun

- Süreçler

- Ürünler

- Teklif

- koruma

- sağlamak

- sağlanan

- alenen

- Yayıncılık

- amaçlı

- kalite

- Sorular

- Yarış

- ırkçılık

- yükseltilmiş

- yükseltmeler

- tanımak

- azaltarak

- referanslar

- ilişkin

- düzenlenmekte olan

- Değişiklik Yapıldı

- düzenleyici

- güvenmek

- dikkat çekici

- Raporlama

- kısıtlamaları

- Sonuçlar

- devrim

- haklar

- Risk

- riskler

- Sachs

- Skandal

- Okullar

- skorları

- puanlama

- kazıma

- sektör

- seçme

- seçim

- Hizmetler

- gösterilen

- önem

- önemli

- benzer

- çözüm

- Çözümler

- Kaynak

- konuşma

- uzmanlaşmış

- başlangıç

- Startups

- Eyalet

- Dışişleri bakanlığı

- Yine

- saklı

- kuvvet

- böyle

- ÖZET

- çevreleyen

- hızla

- sistemik

- Sistemler

- ele almak

- alır

- hedefleme

- teknoloji

- teknoloji şirketleri

- teknolojistler

- Teknoloji

- testleri

- o

- The

- Kaynak

- ve bazı Asya

- Orada.

- böylece

- Bunlar

- Re-Tweet

- zaman tükeniyor

- zaman çizelgesi

- zaman çizelgeleri

- için

- araçlar

- konu

- Eğitim

- Şeffaflık

- iki

- tipik

- anlaşılabilir

- sigorta poliçesini imzalama

- haksız

- benzersiz

- Birleşik

- Birleşmiş Milletler

- aksine

- sürdürmek

- aciliyet

- kullanım

- Kullanılmış

- çeşitli

- Video

- düşsel

- we

- Web3

- Refah

- vardı

- ne zaman

- hangi

- süre

- ile

- içinde

- Kadın

- Dünya

- WorldPay

- endişe

- olur

- yıl

- york

- zefirnet