DALL-E3 ile oluşturulan resim

Yapay Zeka teknoloji dünyasında tam bir devrim yarattı.

İnsan zekasını taklit etme ve bir zamanlar yalnızca insanlara ait olduğu düşünülen görevleri yerine getirme yeteneği çoğumuzu hâlâ şaşırtıyor.

Bununla birlikte, bu geç yapay zeka ilerlemeleri ne kadar iyi olursa olsun, her zaman iyileştirmeye yer vardır.

İşte tam da bu noktada hızlı mühendislik devreye giriyor!

Yapay zeka modellerinin verimliliğini önemli ölçüde artırabilecek bu alana girin.

Gelin hep birlikte keşfedelim!

Hızlı mühendislik, yapay zeka içinde dil modellerinin verimliliğini ve etkililiğini artırmaya odaklanan, hızla büyüyen bir alandır. Her şey, yapay zeka modellerini arzu ettiğimiz çıktıları üretmeye yönlendirecek mükemmel istemler oluşturmakla ilgilidir.

Bunu, bir kişiye bir görevi doğru anlayıp yerine getirdiğinden emin olmak için nasıl daha iyi talimatlar verileceğini öğrenmek olarak düşünün.

Hızlı Mühendislik Neden Önemlidir?

- Geliştirilmiş Verimlilik: Yapay zeka modelleri, yüksek kaliteli istemler kullanarak daha doğru ve alakalı yanıtlar üretebilir. Bu, düzeltmelere daha az zaman harcanması ve yapay zekanın yeteneklerinden yararlanmaya daha fazla zaman ayrılması anlamına gelir.

- Maliyet Verimliliği: Yapay zeka modellerinin eğitimi kaynak yoğundur. Hızlı mühendislik, daha iyi istemlerle model performansını optimize ederek yeniden eğitim ihtiyacını azaltabilir.

- Çok yönlülük: İyi hazırlanmış bir bilgi istemi, yapay zeka modellerini daha çok yönlü hale getirerek daha geniş bir görev ve zorluk yelpazesiyle başa çıkmalarına olanak tanıyabilir.

En gelişmiş tekniklere dalmadan önce, en yararlı (ve temel) anlık mühendislik tekniklerinden ikisini hatırlayalım.

“Adım adım düşünelim” ile Sıralı Düşünme

Bugün, “Adım adım düşünelim” kelime dizisinin eklenmesiyle LLM modellerinin doğruluğunun önemli ölçüde arttığı iyi bilinmektedir.

Neden... diye sorabilirsiniz?

Bunun nedeni, modeli herhangi bir görevi birden fazla adıma ayırmaya zorlamamız ve böylece modelin her birini işlemek için yeterli zamana sahip olmasını sağlamamızdır.

Örneğin GPT3.5'e aşağıdaki istemle meydan okuyabilirim:

John'un 5 armudu varsa, 2'sini yerse, 5 tane daha alır ve 3'ünü arkadaşına verirse, kaç armudu vardır?

Model bana hemen bir cevap verecek. Ancak son olarak “Adım adım düşünelim” ifadesini eklersem modeli çok adımlı bir düşünme süreci oluşturmaya zorluyorum.

Az Çekim İstemi

Sıfır adımlı ipucu, modelden herhangi bir bağlam veya önceden bilgi vermeden bir görevi gerçekleştirmesini istemek anlamına gelirken, birkaç adımlı ipucu tekniği, LLM'ye bazı spesifik sorularla birlikte arzu ettiğimiz çıktının birkaç örneğini sunduğumuz anlamına gelir.

Örneğin herhangi bir terimi şiirsel bir üslupla tanımlayan bir model ortaya çıkarmak istiyorsak bunu açıklamak oldukça zor olabilir. Sağ?

Ancak modeli istediğimiz yöne yönlendirmek için aşağıdaki birkaç adımlık komutları kullanabiliriz.

Göreviniz aşağıdaki stile uygun, tutarlı bir tarzda yanıt vermektir.

: Bana dayanıklılığı öğret.

: Direnç rüzgarla eğilen ama asla kırılmayan bir ağaca benzer.

Zorluklardan sonra toparlanma ve ilerlemeye devam etme yeteneğidir.

: Girişiniz buraya.

Henüz denemediyseniz GPT'ye meydan okuyabilirsiniz.

Ancak çoğunuzun bu temel teknikleri zaten bildiğinizden oldukça eminim, sizi bazı ileri tekniklerle zorlamaya çalışacağım.

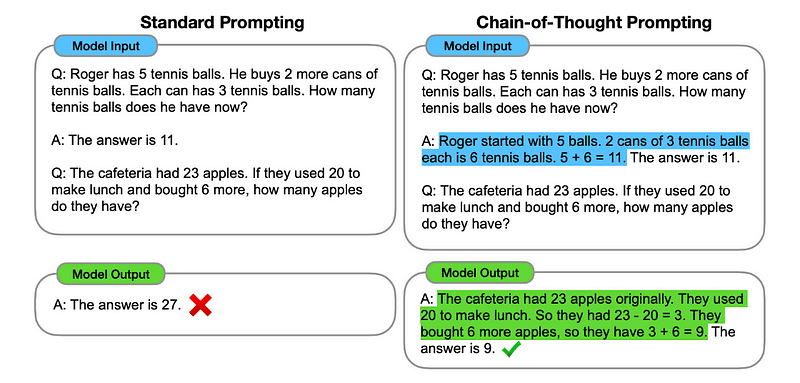

1. Düşünce Zinciri (CoT) Yönlendirmesi

Tarafından tanıtıldı 2022'de GoogleBu yöntem, nihai yanıtı vermeden önce modele çeşitli akıl yürütme aşamalarından geçmesi talimatını içerir.

Tanıdık geliyor değil mi? Eğer öyleyse, tamamen haklısın.

Bu, Ardışık Düşünme ile Birkaç Noktada Yönlendirmeyi birleştirmeye benziyor.

Nasıl?

Temel olarak, CoT yönlendirmesi LLM'yi bilgileri sırayla işlemeye yönlendirir. Bu, ilk problemi birden fazla adımlı akıl yürütmeyle nasıl çözeceğimizi örneklendirdiğimiz ve ardından gerçek görevimizi modele göndererek, çözmesini istediğimiz gerçek sorguya yanıt verirken karşılaştırılabilir bir düşünce zincirini taklit etmesini beklediğimiz anlamına gelir.

Görüntü alınan kâğıt.

Böylece, ilk örneği takip ederek, ilk problemle ilgili bir ipucu ve onun nasıl çözüleceğine dair sıralı bir açıklama sağlayabiliriz. Ardından girdimizi gönderebilir ve sihrin nasıl gerçekleştiğini görebiliriz!

John'un 5 armudu varsa, 2'sini yerse, 5 tane daha alır ve 3'ünü arkadaşına verirse, kaç armudu vardır? Adım adım düşünelim.

Adım adım gidelim. John 5 armutla başlıyor. 2 armut yiyor, yani 5-2 = 3 armudu kaldı. Daha sonra 5 armut daha alır. Yani artık 3 + 5 = 8 armudu var. En sonunda arkadaşına 3 adet armut verir. Bu nedenle elinde 8-3 = 5 armut kalmıştır. Yani tüm bu adımlardan sonra John'un 5 armudu var.

Girişiniz buraya.

Ancak çoğunuz şunu düşünüyor olmalı… ChatGPT'de bir şey sormak istediğimde herhangi bir sorunu çözmek için sıralı bir yol düşünmem gerekiyor mu?

Peki... sen ilk değilsin! Bu da bizi şuna götürüyor:

2. Otomatik Düşünce Zinciri (Auto-CoT)

2022 olarak, Zhang ve meslektaşları bu manuel süreçten kaçınmak için bir yöntem geliştirdiler. Herhangi bir manuel görevden kaçınmanın iki ana nedeni vardır:

- Sıkıcı olabilir.

- Kötü sonuçlar doğurabilir; örneğin zihinsel sürecimiz yanlış olduğunda.

Her gösteri için sırayla akıl yürütme zincirleri üretmek amacıyla Yüksek Lisans'ların "Adım adım düşünelim" istemiyle birlikte kullanılmasını önerdiler.

Bu, ChatGPT'ye herhangi bir sorunu sırayla nasıl çözeceğini sormak ve ardından aynı örneği kullanarak onu başka herhangi bir sorunu nasıl çözeceğini eğitmek anlamına gelir.

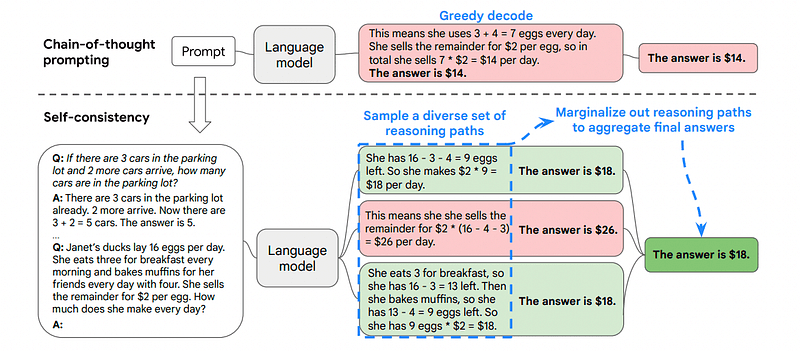

3. Kendi Kendine Tutarlılık

Kendi kendine tutarlılık, daha karmaşık muhakeme problemlerine yol açan düşünce zincirini geliştirmeyi amaçlayan bir başka ilginç ipucu verme tekniğidir.

Peki… temel fark nedir?

Öz Tutarlılık kapsamındaki ana fikir, modeli yanlış bir örnekle eğitebileceğimizin farkında olmaktır. Önceki sorunu yanlış bir zihinsel süreçle çözdüğümü hayal edin:

John'un 5 armudu varsa, 2'sini yerse, 5 tane daha alır ve 3'ünü arkadaşına verirse, kaç armudu vardır? Adım adım düşünelim.

5 armutla başlayın. John 2 armut yiyor. Daha sonra arkadaşına 3 adet armut verir. Bu eylemler birleştirilebilir: 2 (yenen) + 3 (verilen) = toplam 5 armut etkilenir. Şimdi etkilenen toplam armut sayısını ilk 5 armuttan çıkarın: 5 (başlangıç) – 5 (etkilenen) = 0 armut kaldı.

O zaman modele gönderdiğim herhangi bir görev yanlış olacaktır.

Bu nedenle Öz Tutarlılık, her biri bir düşünce zinciri içeren çeşitli akıl yürütme yollarından örneklemeyi ve ardından LLM'nin sorunu çözmek için en iyi ve en tutarlı yolu seçmesine izin vermeyi içerir.

Görüntü alınan kâğıt

Bu durumda, yine ilk örneği takip ederek, modele sorunu çözmenin farklı yollarını gösterebiliriz.

John'un 5 armudu varsa, 2'sini yerse, 5 tane daha alır ve 3'ünü arkadaşına verirse, kaç armudu vardır?

5 armutla başlayın. John 2 armut yer ve elinde 5-2 = 3 armut kalır. 5 armut daha alır ve toplam 3 + 5 = 8 armut olur. Sonunda arkadaşına 3 armut verir, yani elinde 8-3 = 5 armut kalır.

John'un 5 armudu varsa, 2'sini yerse, 5 tane daha alır ve 3'ünü arkadaşına verirse, kaç armudu vardır?

5 armutla başlayın. Daha sonra 5 armut daha alır. John şimdi 2 armut yiyor. Bu eylemler birleştirilebilir: 2 (yenen) + 5 (satın alınan) = toplam 7 armut. Jon'un yediği armudu toplam armut miktarından çıkarın 7 (toplam miktar) – 2 (yenen) = 5 armut kaldı.

Girişiniz buraya.

Ve işte son teknik geliyor.

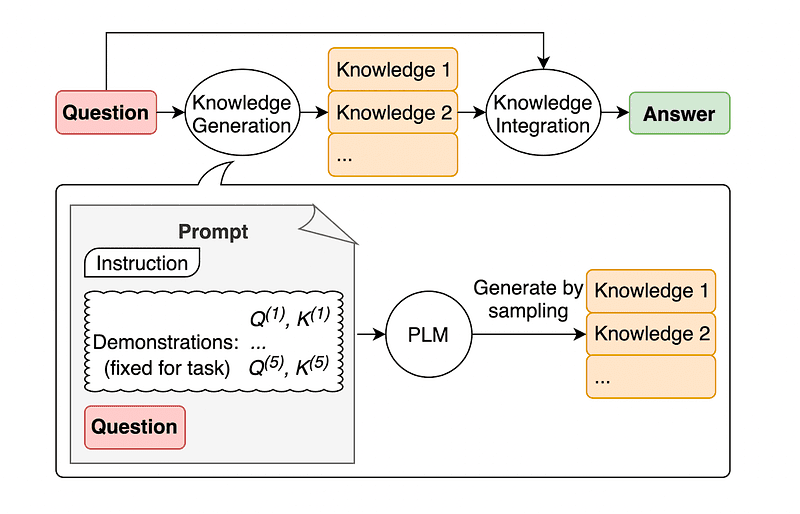

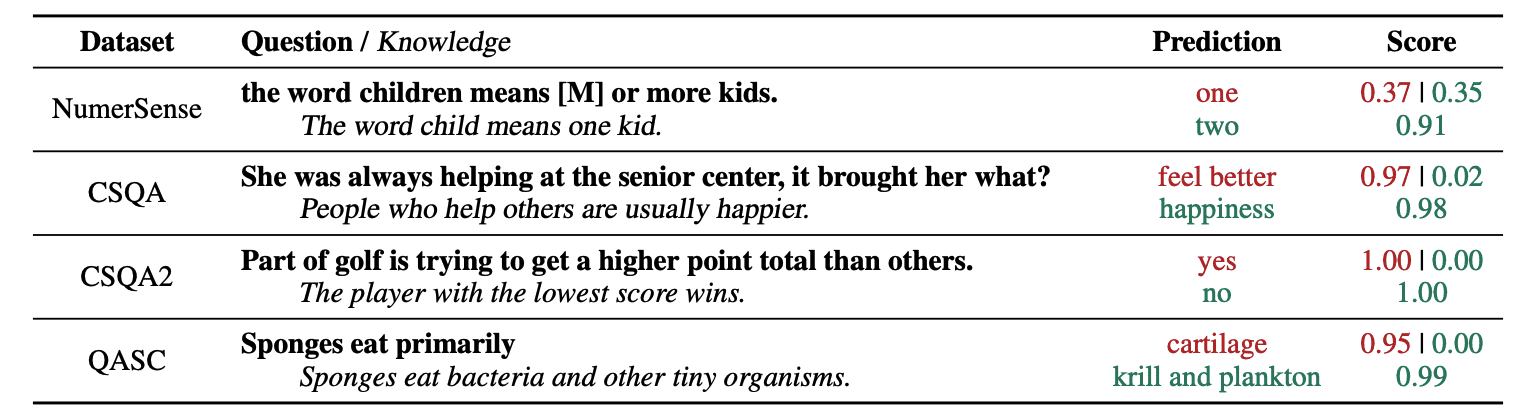

4. Genel Bilgi Yönlendirmesi

Hızlı mühendisliğin yaygın bir uygulaması, son API çağrısını GPT-3 veya GPT-4'e göndermeden önce sorguyu ek bilgilerle genişletmektir.

Göre Jiacheng Liu ve Co, LLM'nin soru hakkında daha iyi bilgi sahibi olması için her zaman herhangi bir talebe biraz bilgi ekleyebiliriz.

Görüntü alınan kâğıt.

Örneğin ChatGPT'ye golfün bir kısmının diğerlerinden daha yüksek puan toplamaya çalışıp çalışmadığını sorduğunuzda bu bizi doğrulayacaktır. Ancak golfün asıl amacı tam tersidir. Bu nedenle “Daha düşük puana sahip olan kazanır” diye bazı ön bilgileri ekleyebiliriz.

Peki modele tam olarak cevabı söylüyorsak işin komik tarafı ne?

Bu durumda bu teknik, LLM'nin bizimle etkileşime girme şeklini geliştirmek için kullanılır.

Bu nedenle, makalenin yazarları, dışarıdan bir veri tabanından ek bağlam almak yerine, Yüksek Lisans'ın kendi bilgisini üretmesini önermektedir. Kendi kendine üretilen bu bilgi daha sonra sağduyulu muhakemeyi desteklemek ve daha iyi çıktılar vermek için yönlendirmeye entegre edilir.

Yüksek Lisans'lar eğitim veri kümesini artırmadan bu şekilde geliştirilebilir!

Hızlı mühendislik, LLM'nin yeteneklerini geliştirmede çok önemli bir teknik olarak ortaya çıkmıştır. İstemleri yineleyerek ve geliştirerek, yapay zeka modelleriyle daha doğrudan iletişim kurabilir ve böylece daha doğru ve bağlamsal olarak daha uygun çıktılar elde ederek hem zamandan hem de kaynaklardan tasarruf sağlayabiliriz.

Teknoloji meraklıları, veri bilimcileri ve içerik oluşturucular için anlık mühendisliği anlamak ve uzmanlaşmak, yapay zekanın tüm potansiyelinden yararlanmada değerli bir varlık olabilir.

Dikkatlice tasarlanmış giriş istemlerini bu daha gelişmiş tekniklerle birleştirerek, istem mühendisliği becerilerine sahip olmak, şüphesiz önümüzdeki yıllarda size bir avantaj sağlayacaktır.

Josep Ferrer Barselona'dan bir analitik mühendisidir. Fizik mühendisliğinden mezun oldu ve şu anda insan hareketliliğine uygulanan Veri Bilimi alanında çalışıyor. Veri bilimi ve teknolojisine odaklanan yarı zamanlı bir içerik oluşturucudur. onunla iletişime geçebilirsin LinkedIn, Twitter or Orta.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://www.kdnuggets.com/some-kick-ass-prompt-engineering-techniques-to-boost-our-llm-models?utm_source=rss&utm_medium=rss&utm_campaign=some-kick-ass-prompt-engineering-techniques-to-boost-our-llm-models

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 10

- 11

- 2022

- 29

- 7

- 8

- a

- kabiliyet

- Hakkımızda

- doğruluk

- doğru

- eylemler

- gerçek

- eklemek

- ekleme

- Ek

- ileri

- Sonra

- tekrar

- AI

- AI modelleri

- Amaçları

- hizalı

- benzer

- Türkiye

- Izin

- boyunca

- zaten

- her zaman

- am

- miktar

- an

- analytics

- ve

- Başka

- cevap

- herhangi

- api

- uygulamalı

- ARE

- AS

- sormak

- soran

- varlık

- Yazarlar

- Otomatik

- önlemek

- farkında

- uzakta

- Arka

- Kötü

- Barcelona

- temel

- BE

- Çünkü

- olmuştur

- önce

- olmak

- İYİ

- Daha iyi

- desteklemek

- artırmak

- Sıkıcı

- her ikisi de

- aldım

- Sıçrama

- mola

- sonları

- Getiriyor

- Daha geniş

- fakat

- Buys

- by

- çağrı

- CAN

- yetenekleri

- dikkatlice

- dava

- zincir

- zincirler

- meydan okuma

- zorluklar

- ChatGPT

- Klinik

- arkadaşları

- kombine

- birleştirme

- nasıl

- geliyor

- gelecek

- ortak

- iletişim kurmak

- karşılaştırılabilir

- tamamlamak

- karmaşık

- kabul

- tutarlı

- UAF ile

- içerik

- içerik oluşturucuları

- bağlam

- Düzeltmeler

- doğru

- olabilir

- çevrimiçi kurslar düzenliyorlar.

- yaratıcı

- yaratıcıları

- Şu anda

- veri

- veri bilimi

- veritabanı

- tanımlar

- teslim

- tasarlanmış

- İstediğiniz

- fark

- farklı

- direkt

- yön

- keşfetmek

- dalış

- do

- yok

- domain

- etki

- aşağı

- her

- kenar

- etki

- verim

- ortaya

- mühendis

- Mühendislik

- artırmak

- artırılması

- yeterli

- sağlamak

- meraklıları

- kesinlikle

- örnek

- örnekler

- yürütmek

- bekliyoruz

- Açıklamak

- açıklama

- tanıdık

- az

- alan

- son

- Nihayet

- Ad

- odaklanmış

- odaklanır

- takip etme

- İçin

- zorlama

- ileri

- arkadaş

- itibaren

- tam

- komik

- genel

- oluşturmak

- almak

- Vermek

- verilmiş

- verir

- Go

- gol

- golf

- Tercih Etmenizin

- rehberlik

- Zor

- Koşum

- Var

- sahip olan

- he

- okuyun

- Yüksek kaliteli

- daha yüksek

- onu

- onun

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTTPS

- insan

- insan zekası

- i

- Fikir

- if

- resim

- iyileştirmek

- gelişmiş

- iyileşme

- geliştirme

- in

- artan

- bilgi

- ilk

- giriş

- örnek

- talimatlar

- entegre

- İstihbarat

- etkileşime

- ilginç

- içine

- tanıttı

- içerir

- IT

- ONUN

- John

- jon

- sadece

- KDNuggets

- tutmak

- tekme

- Kicks

- Bilmek

- bilgi

- bilir

- dil

- Soyad

- Geç

- İlanlar

- Sıçrama

- öğrenme

- ayrılma

- sol

- az

- izin

- icar

- kaldıraç

- sevmek

- alt

- sihirli

- Ana

- yapmak

- Yapımı

- tavır

- Manuel

- çok

- Mastering

- Mesele

- me

- anlamına geliyor

- zihinsel

- birleştirme

- yöntem

- olabilir

- hareketlilik

- model

- modelleri

- Daha

- çoğu

- hareketli

- çoklu

- şart

- gerek

- asla

- yok hayır

- şimdi

- elde etmek

- of

- on

- bir Zamanlar

- karşısında

- optimize

- or

- Diğer

- Diğer

- bizim

- dışarı

- çıktı

- çıkışlar

- dışında

- kendi

- kâğıt

- Bölüm

- yol

- MÜKEMMEL OLAN YERİ BULUN

- yapmak

- performans

- Fizik

- asıl

- Platon

- Plato Veri Zekası

- PlatoVeri

- oyuncu

- Nokta

- potansiyel

- uygulama

- tam

- mevcut

- güzel

- önceki

- Sorun

- sorunlar

- süreç

- üretmek

- verimlilik

- sağlamak

- sağlama

- çeken

- soru

- oldukça

- menzil

- daha doğrusu

- gerçek

- nedenleri

- tavsiye etmek

- azaltmak

- ifade eder

- uygun

- talep

- esneklik

- yoğun kaynak

- Kaynaklar

- yanıt

- yanıt

- yanıtları

- Sonuçlar

- yeniden eğitme

- Devrim

- krallar gibi yaşamaya

- oda

- s

- aynı

- tasarruf

- Bilim

- Bilim ve Teknoloji

- bilim adamları

- Gol

- görmek

- göndermek

- gönderme

- Dizi

- set

- birkaç

- şov

- önemli ölçüde

- beceri

- So

- yalnızca

- ÇÖZMEK

- Çözme

- biraz

- Birisi

- bir şey

- özel

- harcanmış

- aşamaları

- başlama

- başlar

- yönlendirmek

- adım

- Basamaklar

- Yine

- stil

- elbette

- ele almak

- alınan

- Görev

- görevleri

- teknoloji

- teknik

- teknikleri

- Teknoloji

- söyleme

- dönem

- göre

- o

- The

- Onları

- sonra

- Orada.

- bu nedenle

- Bunlar

- onlar

- düşünmek

- Düşünme

- Re-Tweet

- düşünce

- İçinden

- Böylece

- zaman

- için

- TON

- Toplam

- TAMAMEN

- Tren

- Eğitim

- ağaç

- denenmiş

- denemek

- çalışıyor

- iki

- nihai

- altında

- uğramak

- anlamak

- anlayış

- şüphesiz

- us

- kullanım

- Kullanılmış

- kullanma

- DOĞRULA

- Değerli

- çeşitli

- çok yönlü

- çok

- istemek

- Yol..

- yolları

- we

- tanınmış

- vardı

- ne zaman

- hangi

- neden

- irade

- rüzgar

- ile

- içinde

- olmadan

- Word

- çalışma

- Dünya

- Yanlış

- yıl

- henüz

- Yol ver

- sen

- zefirnet