Veri ambarı platformlarında gerçekleştirilen veri ambarlarının ve analitiklerin önemi, birçok işletmenin hem kısa vadeli operasyonel karar verme hem de uzun vadeli stratejik planlama için kritik görev olarak bu sistemlere güvenmeye başlamasıyla birlikte yıllar içinde istikrarlı bir şekilde artmaktadır. Geleneksel olarak, veri ambarları toplu iş döngülerinde, örneğin aylık, haftalık veya günlük olarak yenilenir, böylece işletmeler bunlardan çeşitli içgörüler elde edebilir.

Birçok kuruluş, gelişmiş analitikle birlikte neredeyse gerçek zamanlı veri alımının yeni fırsatlar yarattığını fark ediyor. Örneğin, bir finans kuruluşu, bir kredi kartı işleminin hileli olup olmadığını, bir anormallik algılama programını toplu işlem modu yerine neredeyse gerçek zamanlı modda çalıştırarak tahmin edebilir.

Bu yazıda, nasıl olduğunu gösteriyoruz Amazon Kırmızıya Kaydırma akış alımı ve makine öğrenimi (ML) tahminlerini tek bir platformda sunabilir.

Amazon Redshift, standart SQL kullanarak tüm verilerinizi analiz etmeyi basit ve uygun maliyetli hale getiren, hızlı, ölçeklenebilir, güvenli ve tam olarak yönetilen bir bulut veri ambarıdır.

Amazon Redshift ML veri analistlerinin ve veritabanı geliştiricilerinin Amazon Redshift veri ambarlarındaki tanıdık SQL komutlarını kullanarak makine öğrenimi modelleri oluşturmasını, eğitmesini ve uygulamasını kolaylaştırır.

Lansman için heyecanlıyız Amazon Redshift Akış Alımı için Amazon Kinesis Veri Akışları ve Apache Kafka için Amazon Tarafından Yönetilen Akış (Amazon MSK), verileri bir Kinesis veri akışından veya Kafka konusundan doğrudan almanıza olanak tanır. Amazon Basit Depolama Hizmeti (Amazon S3). Amazon Redshift akış alımı, veri ambarınıza yüzlerce megabayt veri alırken saniyeler mertebesinde düşük gecikme süresi elde etmenizi sağlar.

Bu gönderi, bulut veri ambarı Amazon Redshift'in tanıdık SQL diliyle Amazon Redshift akış alımını ve Redshift ML özelliklerini kullanarak gerçek zamanlıya yakın makine öğrenimi tahminleri oluşturmanıza nasıl olanak tanıdığını gösterir.

Çözüme genel bakış

Bu gönderide özetlenen adımları izleyerek, bir yapımcı yayıncı uygulaması kurabileceksiniz. Amazon Elastik Bilgi İşlem Bulutu Kredi kartı işlemlerini simüle eden ve verileri gerçek zamanlı olarak Kinesis Data Streams'e aktaran (Amazon EC2) bulut sunucusu. Akış verilerinin alındığı Amazon Redshift'te bir Amazon Redshift Akış Alımı gerçekleştirilmiş görünümü ayarlarsınız. Akış verilerine karşı gerçek zamanlı çıkarımlar oluşturmak için bir Redshift ML modeli eğitir ve oluşturursunuz.

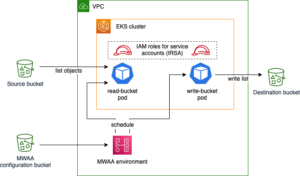

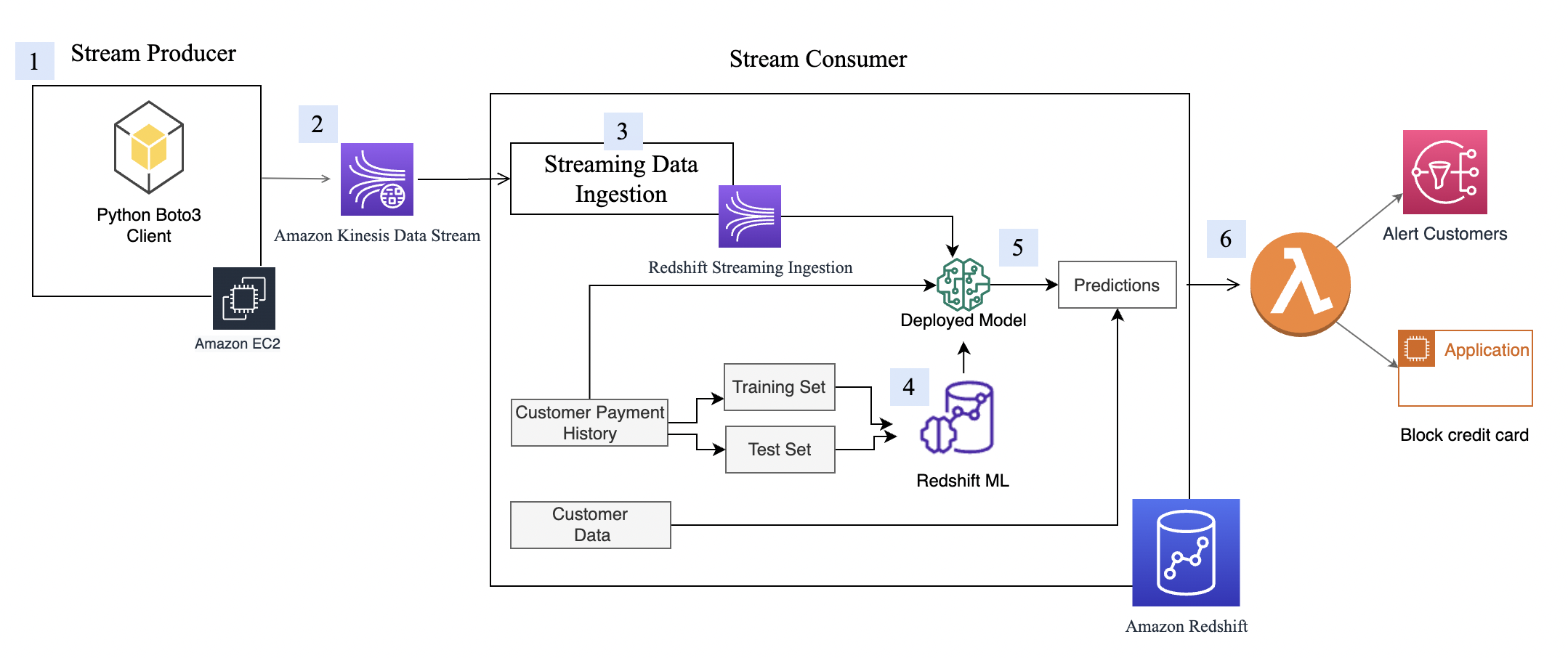

Aşağıdaki diyagram, mimariyi ve süreç akışını göstermektedir.

Adım adım süreç aşağıdaki gibidir:

- EC2 bulut sunucusu, kredi kartı işlemlerini Kinesis veri akışına ekleyen bir kredi kartı işlem uygulamasını simüle eder.

- Veri akışı, gelen kredi kartı işlem verilerini depolar.

- Veri akışının üzerinde, akış verilerini otomatik olarak Amazon Redshift'e alan bir Amazon Redshift Streaming Ingestion somutlaştırılmış görünümü oluşturulur.

- Redshift ML kullanarak bir ML modeli oluşturur, eğitir ve dağıtırsınız. Redshift ML modeli, geçmiş işlem verileri kullanılarak eğitilir.

- Akış verilerini dönüştürür ve makine öğrenimi tahminleri oluşturursunuz.

- Riski azaltmak için müşterileri uyarabilir veya uygulamayı güncelleyebilirsiniz.

Bu izlenecek yol, kredi kartı işlem akış verilerini kullanır. Kredi kartı işlem verileri hayalidir ve bir simülatör. Müşteri veri seti de hayalidir ve bazı rasgele veri fonksiyonlarıyla üretilir.

Önkoşullar

- Amazon Redshift kümesi oluşturun.

- Kümeyi Redshift ML kullanacak şekilde yapılandırın.

- oluşturmak an AWS Kimlik ve Erişim Yönetimi (IAM) kullanıcısı.

- Kinesis veri akışına erişim izinlerini dahil etmek için Redshift kümesine bağlı IAM rolünü güncelleyin. Gerekli politika hakkında daha fazla bilgi için bkz. Akış alımına başlarken.

- Bir m5.4xlarge EC2 bulut sunucusu oluşturun. Üretici uygulamasını m5.4xlarge bulut sunucusuyla test ettik ancak diğer bulut sunucusu türlerini kullanmakta özgürsünüz. Örneği oluştururken, amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 BEN MİYİM.

- Python3'ün EC2 örneğine kurulu olduğundan emin olmak için Python sürümünüzü doğrulamak üzere aşağıdaki komutu çalıştırın (veri çıkarma betiğinin yalnızca Python 3'te çalıştığını unutmayın):

- Simülatör programını çalıştırmak için aşağıdaki bağımlı paketleri kurun:

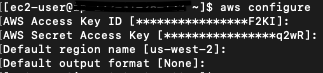

- Yukarıdaki 2. adımda oluşturulan IAM kullanıcısı için oluşturulan AWS kimlik bilgileri gibi değişkenleri kullanarak Amazon EC3'yi yapılandırın. Aşağıdaki ekran görüntüsü kullanılarak bir örnek gösterilmektedir aws yapılandırmak.

Kinesis Veri Akışlarını Kurun

Amazon Kinesis Data Streams, büyük ölçüde ölçeklenebilir ve dayanıklı, gerçek zamanlı bir veri akışı hizmetidir. Web sitesi tıklama akışları, veritabanı olay akışları, finansal işlemler, sosyal medya beslemeleri, BT günlükleri ve konum izleme olayları gibi yüz binlerce kaynaktan saniyede gigabaytlarca veriyi sürekli olarak yakalayabilir. Toplanan veriler, gerçek zamanlı panolar, gerçek zamanlı anormallik tespiti, dinamik fiyatlandırma ve daha fazlası gibi gerçek zamanlı analiz kullanım durumlarını etkinleştirmek için milisaniye cinsinden sunulur. Kullanıma göre ölçeklenebilen sunucusuz bir çözüm olduğu için Kinesis Data Streams kullanıyoruz.

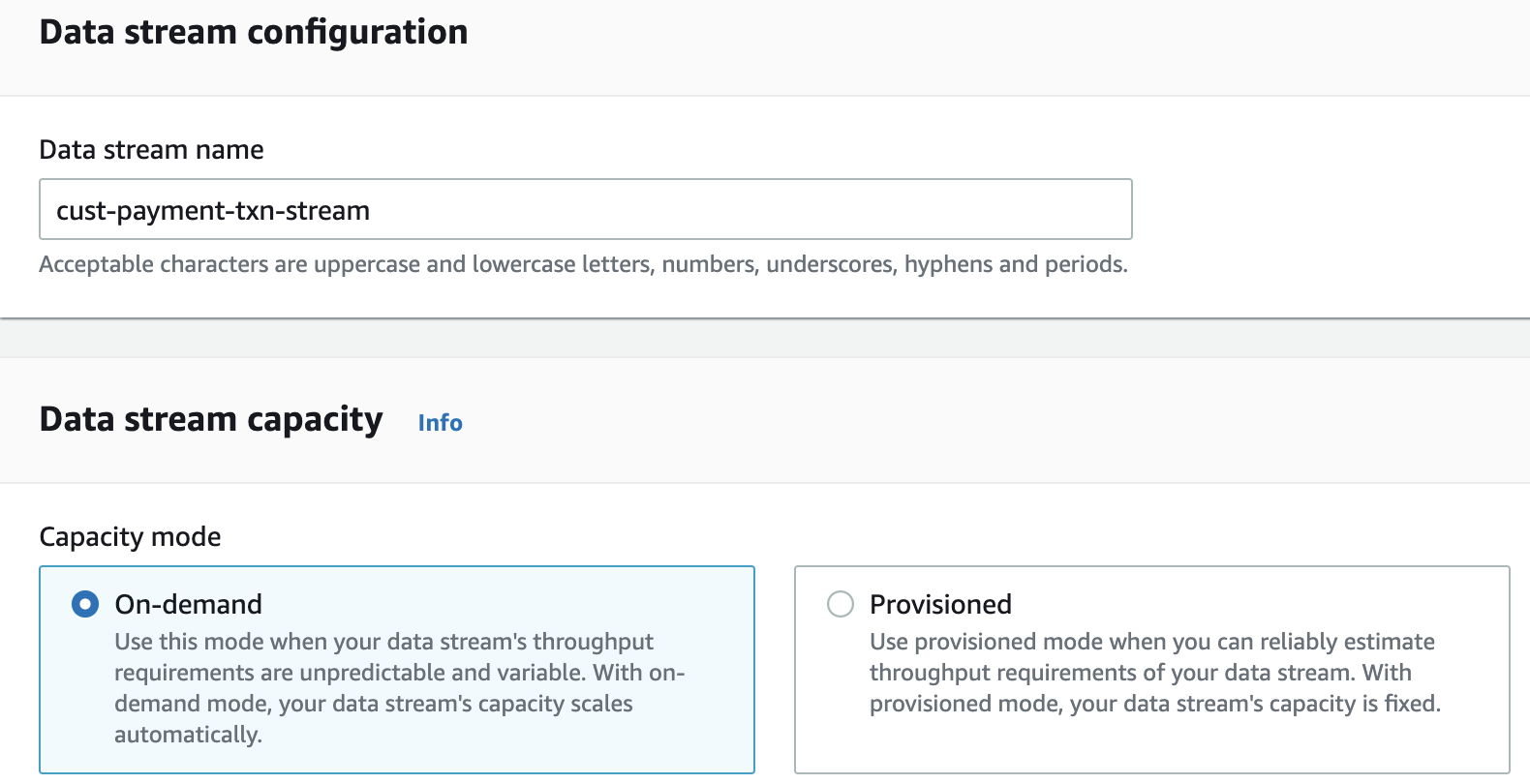

Kinesis veri akışı oluşturun

Öncelikle, akış verilerini almak için bir Kinesis veri akışı oluşturmanız gerekir:

- Amazon Kinesis konsolunda seçin Veri akışları Gezinti bölmesinde.

- Klinik Veri akışı oluşturun.

- İçin Veri akışı adı, girmek

cust-payment-txn-stream. - İçin Kapasite moduseçin Talep üzerine.

- Seçeneklerin geri kalanı için, varsayılan seçenekleri seçin ve kurulumu tamamlamak için istemleri izleyin.

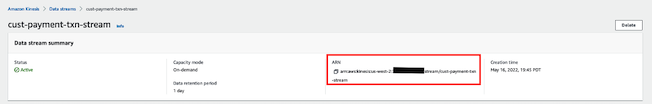

- IAM politikanızı tanımlarken bir sonraki bölümde kullanmak üzere oluşturulan veri akışı için ARN'yi yakalayın.

İzinleri ayarla

Bir akış uygulamasının Kinesis Data Streams'e yazabilmesi için uygulamanın Kinesis'e erişimi olması gerekir. Bir sonraki bölümde kurduğunuz simülatör işlemine veri akışına erişim izni vermek için aşağıdaki ilke bildirimini kullanabilirsiniz. Önceki adımda kaydettiğiniz veri akışının ARN'sini kullanın.

Akış oluşturucuyu yapılandırın

Amazon Redshift'te akış verilerini tüketmeden önce verileri Kinesis veri akışına yazan bir akış veri kaynağına ihtiyacımız var. Bu gönderi, özel olarak oluşturulmuş bir veri oluşturucu kullanır ve Python için AWS SDK (Boto3) verileri veri akışında yayınlamak için. Kurulum talimatları için bkz. Yapımcı Simülatörü. Bu simülatör işlemi, akış verilerini önceki adımda oluşturulan veri akışına yayınlar (cust-payment-txn-stream).

Akış tüketicisini yapılandırma

Bu bölümde, akış tüketicisinin (Amazon Redshift akış alımı görünümü) yapılandırılmasından bahsedilmektedir.

Amazon Redshift Streaming Ingestion, akış verilerinin Kinesis Data Streams'ten Amazon Redshift gerçekleştirilmiş görünümüne düşük gecikmeli, yüksek hızlı alımını sağlar. Amazon Redshift kümenizi akış alımını etkinleştirecek ve SQL deyimlerini kullanarak otomatik yenileme ile gerçekleştirilmiş bir görünüm oluşturacak şekilde yapılandırabilirsiniz. Amazon Redshift'te gerçekleştirilmiş görünümler oluşturma. Otomatik somutlaştırılmış görünüm yenileme işlemi, Kinesis Data Streams'ten Amazon Redshift'e saniyede yüzlerce megabayt veri akışı verisi alır. Bu, hızla yenilenen harici verilere hızlı erişim sağlar.

Gerçekleştirilmiş görünümü oluşturduktan sonra, verilerinize SQL kullanarak veri akışından erişebilir ve doğrudan akışın üstünde gerçekleştirilmiş görünümler oluşturarak veri boru hatlarınızı basitleştirebilirsiniz.

Bir Amazon Redshift akış gerçekleştirilmiş görünümünü yapılandırmak için aşağıdaki adımları tamamlayın:

- IAM konsolunda gezinme bölmesinde politikaları seçin.

- Klinik Politika oluştur.

- adlı yeni bir IAM politikası oluşturun.

KinesisStreamPolicy. Akış ilkesi tanımı için bkz. Akış alımına başlarken. - Gezinti bölmesinde şunu seçin: Roller.

- Rol oluştur'u seçin.

- seç AWS hizmeti Ve seç Redshift ve Redshift özelleştirilebilir.

- adlı yeni bir rol oluşturun.

redshift-streaming-roleve politikayı ekleyinKinesisStreamPolicy. - Kinesis Data Streams ile eşlemek için harici bir şema oluşturun:

Artık akış verilerini tüketmek için gerçekleştirilmiş bir görünüm oluşturabilirsiniz. Yükü olduğu gibi, JSON biçiminde depolamak için SUPER veri türünü kullanabilir veya JSON verilerini ayrı sütunlara ayrıştırmak için Amazon Redshift JSON işlevlerini kullanabilirsiniz. Bu gönderi için, şema iyi tanımlandığı için ikinci yöntemi kullanıyoruz.

- Akış alımı gerçekleştirilmiş görünümünü oluşturun

cust_payment_tx_stream. Aşağıdaki kodda OTOMATİK YENİLEME EVET'i belirterek akış alım görünümünün otomatik olarak yenilenmesini etkinleştirebilirsiniz; bu, veri ardışık düzenleri oluşturmaktan kaçınarak zaman kazandırır:

Bunu not et json_extract_path_text 64 KB'lık bir uzunluk sınırlaması vardır. Ayrıca from_varbye, 65 KB'den büyük kayıtları filtreler.

- Verileri yenileyin.

Amazon Redshift akış materyalize görünümü, Amazon Redshift tarafından sizin için otomatik olarak yenilenir. Bu şekilde, veri eskiliği konusunda endişelenmenize gerek kalmaz. Gerçekleştirilmiş görünüm otomatik yenilemesi ile veriler, akışta kullanılabilir hale geldikçe otomatik olarak Amazon Redshift'e yüklenir. Bu işlemi manuel olarak gerçekleştirmeyi seçerseniz, aşağıdaki komutu kullanın:

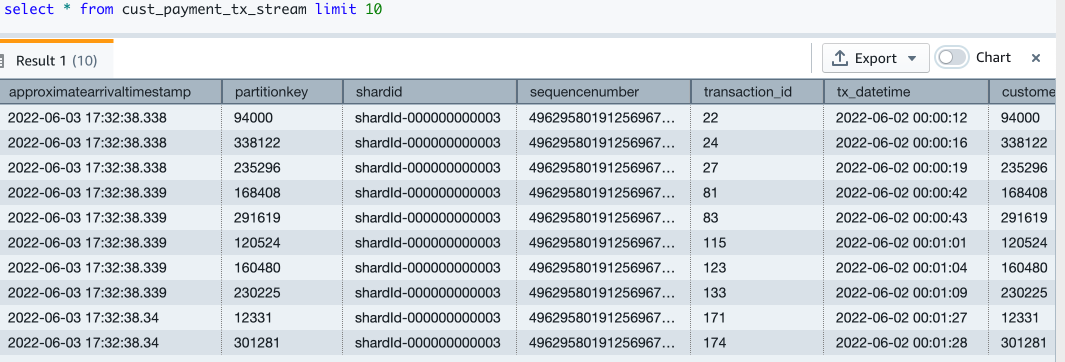

- Şimdi örnek verileri görmek için akış gerçekleştirilmiş görünümünü sorgulayalım:

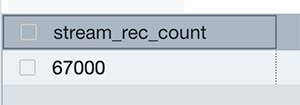

- Şimdi akış görünümünde kaç kayıt olduğunu kontrol edelim:

Artık, gelen kredi kartı işlem verileriyle sürekli olarak güncellenen Amazon Redshift akış alımı görünümünün kurulumunu tamamladınız. Kurulumumda, seçme sayısı sorgumu çalıştırdığımda yaklaşık 67,000 kaydın akış görünümüne çekildiğini görüyorum. Bu sayı sizin için farklı olabilir.

kırmızıya kayma ML

Redshift ML ile önceden eğitilmiş bir ML modeli getirebilir veya yerel olarak oluşturabilirsiniz. Daha fazla bilgi için bkz. Amazon Redshift'te makine öğrenimini kullanma.

Bu gönderide, geçmiş bir veri kümesini kullanarak bir makine öğrenimi modeli eğitiyor ve oluşturuyoruz. Veriler bir tx_fraud geçmiş bir işlemin hileli olup olmadığını işaretleyen alan. Redshift Auto ML kullanarak, bu veri kümesinden öğrenen ve tahmin işlevleri aracılığıyla çalıştırıldığında gelen işlemleri tahmin eden denetimli bir makine öğrenimi modeli oluşturuyoruz.

Aşağıdaki bölümlerde, geçmiş veri kümesinin ve müşteri verilerinin nasıl ayarlanacağını gösteriyoruz.

Geçmiş veri kümesini yükleyin

Geçmiş tablosu, akış veri kaynağının sahip olduğundan daha fazla alana sahiptir. Bu alanlar, akış verilerinin dönüştürülmesiyle hesaplanan hileli işlemlerin sayısı gibi müşterinin en son harcamasını ve terminal risk puanını içerir. Hafta sonu işlemleri veya gece işlemleri gibi kategorik değişkenler de vardır.

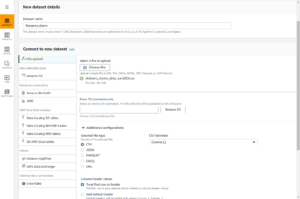

Geçmiş verileri yüklemek için komutları kullanarak çalıştırın. Amazon Redshift sorgu düzenleyicisi.

Aşağıdaki kod ile işlem geçmişi tablosunu oluşturun. DDL ayrıca şu adreste de bulunabilir: GitHub.

Kaç tane işlemin yüklendiğini kontrol edelim:

Aylık dolandırıcılık ve dolandırıcılık dışı işlem trendini kontrol edin:

Müşteri verilerini oluşturun ve yükleyin

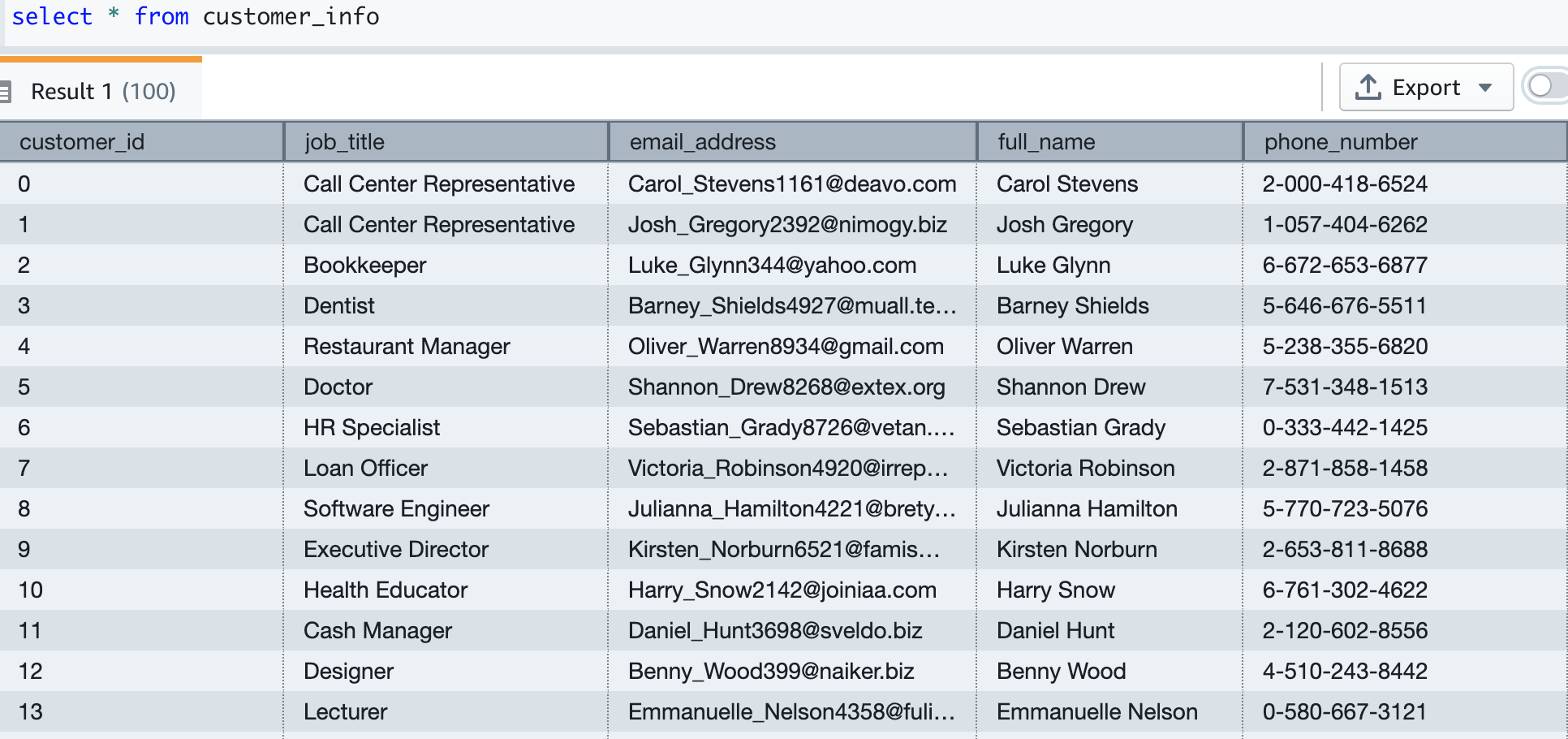

Şimdi müşteri tablosunu oluşturuyoruz ve müşterinin e-posta ve telefon numarasını içeren verileri yüklüyoruz. Aşağıdaki kod tabloyu oluşturur, verileri yükler ve tabloyu örnekler. DDL tablosu şu adreste mevcuttur: GitHub.

Test verilerimiz yaklaşık 5,000 müşteriye sahiptir. Aşağıdaki ekran görüntüsü örnek müşteri verilerini göstermektedir.

Makine öğrenimi modeli oluşturun

Geçmiş kart işlem tablomuz, artık makine öğrenimi modelini eğitmek ve test etmek için kullandığımız 6 aylık verilere sahiptir.

Model aşağıdaki alanları girdi olarak alır:

Alırız tx_fraud çıktı olarak.

Bu verileri eğitim ve test veri kümelerine ayırdık. 2022-04-01 ile 2022-07-31 arasındaki işlemler eğitim seti içindir. Test seti için 2022-08-01 ile 2022-09-30 arasındaki işlemler kullanılmıştır.

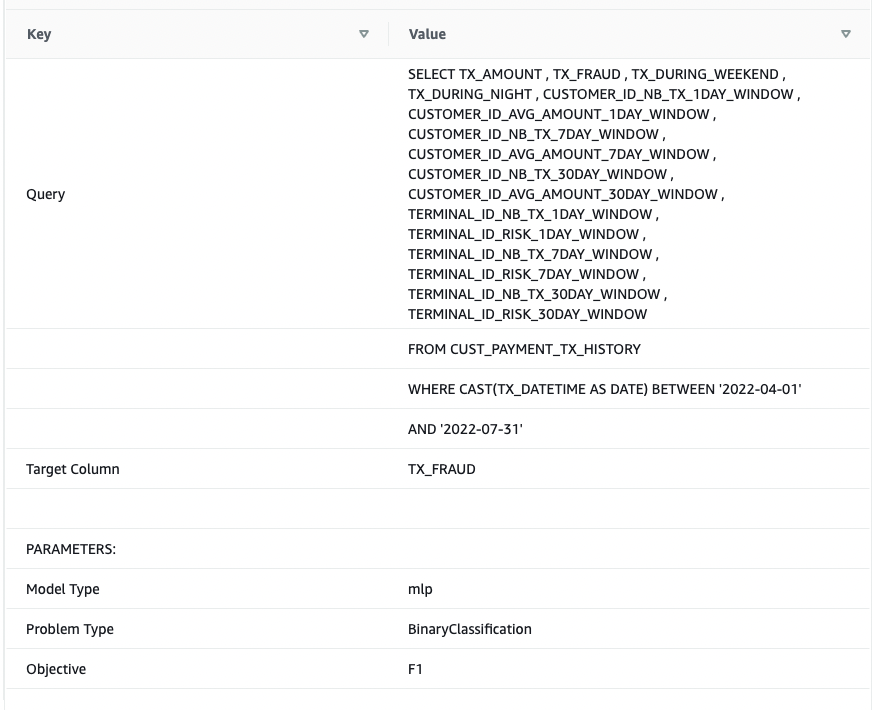

Tanıdık SQL'i kullanarak makine öğrenimi modelini oluşturalım CREATE MODEL ifadesi. Redshift ML komutunun temel bir biçimini kullanıyoruz. Aşağıdaki yöntem kullanır Amazon SageMaker Otomatik Pilotveri hazırlama, özellik mühendisliği, model seçimi ve eğitimi sizin için otomatik olarak gerçekleştiren. Kodu içeren S3 klasörünüzün adını girin.

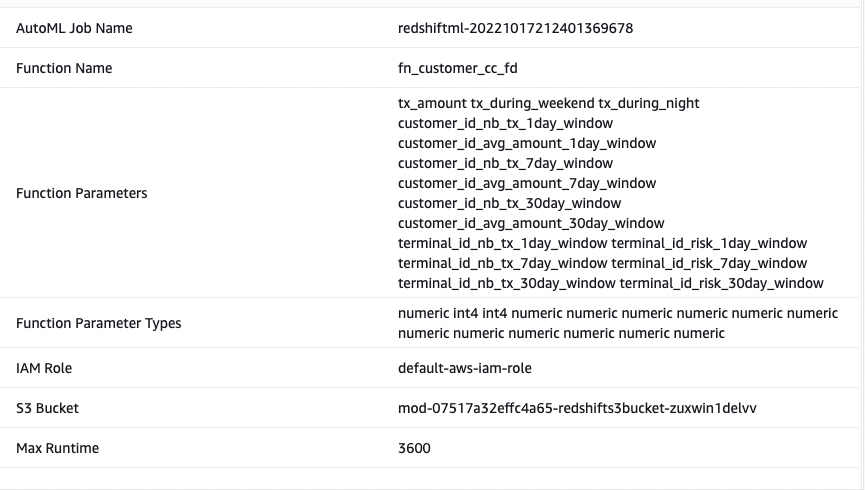

ML modelini şu şekilde adlandırıyorum: Cust_cc_txn_fdve tahmin fonksiyonu olarak fn_customer_cc_fd. FROM yan tümcesi, tarihsel tablodaki girdi sütunlarını gösterir. public.cust_payment_tx_history. Hedef parametre şu şekilde ayarlanır: tx_fraudtahmin etmeye çalıştığımız hedef değişkendir. IAM_Role küme bu rolle yapılandırıldığından varsayılan olarak ayarlanmıştır; değilse, Amazon Redshift kümesi IAM rolü ARN'nizi sağlamanız gerekir. ayarladım max_runtime SageMaker'a işlemi tamamlaması için verdiğimiz süre olan 3,600 saniyeye. Redshift ML, bu zaman diliminde tanımlanan en iyi modeli dağıtır.

Modelin karmaşıklığına ve veri miktarına bağlı olarak modelin kullanılabilir hale gelmesi biraz zaman alabilir. Model seçiminizin tamamlanmadığını fark ederseniz, için değeri artırın. max_runtime. Maksimum değeri 9999 olarak ayarlayabilirsiniz.

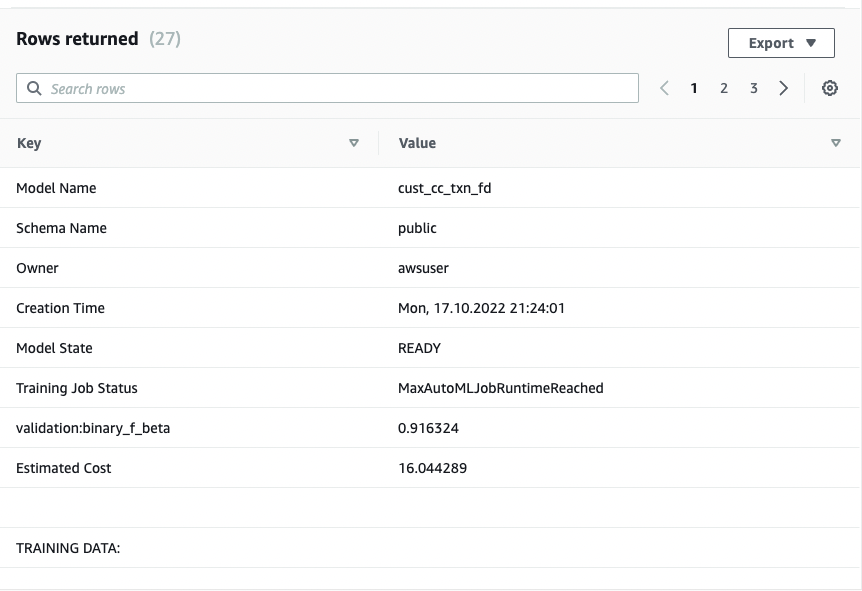

CREATE MODEL komutu eşzamansız olarak çalıştırılır, yani arka planda çalışır. kullanabilirsiniz MODELİ GÖSTER modelin durumunu görmek için komut. Durum Hazır olarak göründüğünde, model eğitilmiş ve konuşlandırılmış demektir.

Aşağıdaki ekran görüntüleri çıktımızı göstermektedir.

Çıktıdan, modelin doğru bir şekilde tanındığını görüyorum. BinaryClassificationve hedef olarak F1 seçilmiştir. bu F1 skoru her ikisini de dikkate alan bir metriktir hassasiyet ve hatırlama. 1 (mükemmel kesinlik ve geri çağırma) ile 0 (mümkün olan en düşük puan) arasında bir değer döndürür. Benim durumumda, 0.91. Değer ne kadar yüksek olursa, model performansı o kadar iyi olur.

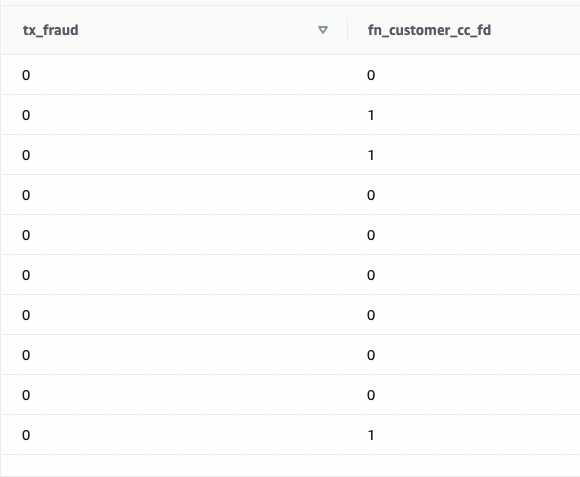

Bu modeli test veri seti ile test edelim. Örnek tahminleri alan aşağıdaki komutu çalıştırın:

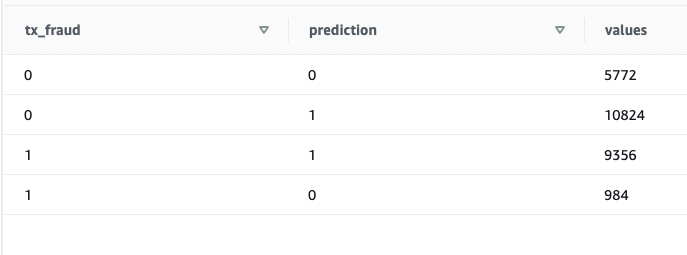

Bazı değerlerin eşleştiğini, bazılarının eşleşmediğini görüyoruz. Tahminleri temel gerçekle karşılaştıralım:

Modelin çalıştığını ve F1 puanının iyi olduğunu onayladık. Akış verileri üzerinde tahminler oluşturmaya geçelim.

Hileli işlemleri tahmin edin

Redshift ML modeli kullanıma hazır olduğundan, akış veri alımına karşı tahminleri çalıştırmak için kullanabiliriz. Geçmiş veri kümesi, akış veri kaynağında sahip olduğumuzdan daha fazla alana sahiptir, ancak bunlar yalnızca müşteri ve dolandırıcılık işlemi için terminal riski etrafındaki yenilik ve sıklık ölçümleridir.

SQL'i görünümlerin içine gömerek, akış verilerinin üzerindeki dönüşümleri çok kolay bir şekilde uygulayabiliriz. Oluştur ilk bakışakış verilerini müşteri düzeyinde toplayan. Sonra oluştur ikinci görüşakış verilerini terminal düzeyinde toplayan ve üçüncü görünümgelen işlem verilerini müşteri ve terminal tarafından birleştirilmiş verilerle birleştiren ve tahmin işlevini tek bir yerde çağıran. Üçüncü görünümün kodu aşağıdaki gibidir:

Görünümde bir SELECT ifadesi çalıştırın:

Siz SELECT ekstresini tekrar tekrar çalıştırdıkça, en son kredi kartı işlemleri, neredeyse gerçek zamanlı olarak dönüşümlerden ve makine öğrenimi tahminlerinden geçer.

Bu, Amazon Redshift'in gücünü gösterir; kullanımı kolay SQL komutlarıyla, karmaşık pencere işlevleri uygulayarak akış verilerini dönüştürebilir ve karmaşık veri ardışık düzenleri oluşturmadan veya oluşturup yönetmeden tek adımda hileli işlemleri tahmin etmek için bir makine öğrenimi modeli uygulayabilirsiniz. ek altyapı.

Çözümü genişlet

Veri akışları ve makine öğrenimi tahminleri neredeyse gerçek zamanlı olarak yapıldığından, müşterinizi uyarmak için iş süreçleri oluşturabilirsiniz. Amazon Basit Bildirim Servisi (Amazon SNS) veya müşterinin kredi kartı hesabını operasyonel bir sistemde kilitleyebilirsiniz.

Bu gönderi, bu işlemlerin ayrıntılarına girmiyor ancak Amazon Redshift kullanarak olay odaklı çözümler oluşturma hakkında daha fazla bilgi edinmek istiyorsanız aşağıdakilere bakın. GitHub deposu.

Temizlemek

İleride ücret alınmasını önlemek için bu gönderinin bir parçası olarak oluşturulan kaynakları silin.

Sonuç

Bu gönderide, bir Kinesis veri akışının nasıl kurulacağını, bir üreticinin nasıl yapılandırılacağını ve akışlara veri yayınlanacağını ve ardından Amazon Redshift'te bir Amazon Redshift Akış Alımı görünümü oluşturulacağını ve verilerin sorgulanacağını gösterdik. Veriler Amazon Redshift kümesine girdikten sonra, bir makine öğrenimi modelinin nasıl eğitileceğini ve bir tahmin işlevinin nasıl oluşturulacağını ve gerçek zamanlıya yakın tahminler oluşturmak için akış verilerine karşı nasıl uygulanacağını gösterdik.

Herhangi bir geri bildiriminiz veya sorunuz varsa, lütfen bunları yorumlarda bırakın.

Yazarlar Hakkında

Bhanu Pittampally Dallas merkezli bir Analitik Uzman Çözüm Mimarıdır. Analitik çözümler oluşturma konusunda uzmanlaşmıştır. Geçmişi veri ambarları-mimari, geliştirme ve yönetim üzerinedir. 15 yılı aşkın bir süredir veri ve analitik alanında çalışmaktadır.

Bhanu Pittampally Dallas merkezli bir Analitik Uzman Çözüm Mimarıdır. Analitik çözümler oluşturma konusunda uzmanlaşmıştır. Geçmişi veri ambarları-mimari, geliştirme ve yönetim üzerinedir. 15 yılı aşkın bir süredir veri ve analitik alanında çalışmaktadır.

Praveen Kadipikonda Dallas merkezli AWS'de Kıdemli Analitik Uzmanı Çözüm Mimarıdır. Müşterilerin verimli, performanslı ve ölçeklenebilir analitik çözümler oluşturmasına yardımcı olur. 15 yılı aşkın bir süredir veritabanları ve veri ambarı çözümleri oluşturma konusunda çalışmaktadır.

Praveen Kadipikonda Dallas merkezli AWS'de Kıdemli Analitik Uzmanı Çözüm Mimarıdır. Müşterilerin verimli, performanslı ve ölçeklenebilir analitik çözümler oluşturmasına yardımcı olur. 15 yılı aşkın bir süredir veritabanları ve veri ambarı çözümleri oluşturma konusunda çalışmaktadır.

Ritesh Kumar Sinha San Francisco merkezli bir Analitik Uzmanı Çözüm Mimarıdır. 16 yılı aşkın bir süredir müşterilerin ölçeklenebilir veri ambarı ve büyük veri çözümleri oluşturmasına yardımcı olmuştur. AWS'de verimli uçtan uca çözümler tasarlamayı ve oluşturmayı seviyor. Boş zamanlarında kitap okumayı, yürümeyi ve yoga yapmayı çok seviyor.

Ritesh Kumar Sinha San Francisco merkezli bir Analitik Uzmanı Çözüm Mimarıdır. 16 yılı aşkın bir süredir müşterilerin ölçeklenebilir veri ambarı ve büyük veri çözümleri oluşturmasına yardımcı olmuştur. AWS'de verimli uçtan uca çözümler tasarlamayı ve oluşturmayı seviyor. Boş zamanlarında kitap okumayı, yürümeyi ve yoga yapmayı çok seviyor.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- Plato blok zinciri. Web3 Metaverse Zekası. Bilgi Güçlendirildi. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 Müşterileri

- 1

- 10

- 100

- 11

- 15 yıl

- 67

- 7

- 9

- a

- Yapabilmek

- Hakkımızda

- yukarıdaki

- erişim

- Hesap

- Başarmak

- Action

- Ek

- yönetim

- ileri

- Sonra

- karşı

- Uyarmak

- Türkiye

- veriyor

- Amazon

- Amazon EC2

- Amazon Kinesis

- miktar

- Analistler

- Analitik

- analytics

- çözümlemek

- ve

- anomali tespiti

- Apache

- Uygulama

- Tamam

- Uygulanması

- mimari

- etrafında

- iliştirmek

- Oto

- Otomatik

- otomatik olarak

- mevcut

- kaçınma

- AWS

- arka fon

- merkezli

- temel

- Çünkü

- olur

- İYİ

- Daha iyi

- arasında

- Büyük

- büyük Veri

- getirmek

- inşa etmek

- bina

- iş

- Iş süreçleri

- işletmeler

- çağrı

- denilen

- aramalar

- ele geçirmek

- kart

- dava

- durumlarda

- karakter

- yükler

- Kontrol

- Klinik

- Şehir

- bulut

- Küme

- kod

- Sütunlar

- biçerdöverler

- gelecek

- yorumlar

- karşılaştırmak

- tamamlamak

- tamamladıktan

- karmaşık

- karmaşıklık

- hesaplamak

- dikkate

- konsolos

- tüketmek

- tüketici

- içeren

- uygun maliyetli

- olabilir

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- oluşturur

- Oluşturma

- Tanıtım

- kredi

- kredi kartı

- müşteri

- müşteri bilgisi

- Müşteriler

- döngüleri

- günlük

- Dallas

- veri

- Veri Hazırlama

- veri ambarı

- veri depoları

- veritabanı

- veritabanları

- veri kümeleri

- Tarih

- Karar verme

- Varsayılan

- tanımlarken

- teslim etmek

- gösterdi

- bağımlı

- dağıtmak

- konuşlandırılmış

- dağıtır

- tarif edilen

- Dizayn

- ayrıntılar

- Bulma

- geliştiriciler

- gelişme

- farklı

- direkt olarak

- Değil

- yapıyor

- Dont

- dow

- dinamik

- kolayca

- kolay kullanımlı

- Efekt

- verimli

- E-posta

- etkinleştirmek

- sağlar

- son uca

- Mühendislik

- Keşfet

- Eter (ETH)

- Etkinlikler

- olaylar

- örnek

- uyarılmış

- dış

- çıkarma

- f1

- tanıdık

- HIZLI

- Özellikler(Hazırlık aşamasında)

- Özellikler

- geribesleme

- alan

- Alanlar

- filtreler

- mali

- bulmak

- bayraklar

- akış

- takip et

- takip etme

- şu

- Airdrop Formu

- biçim

- bulundu

- ÇERÇEVE

- Francisco

- dolandırıcılık

- sahtekarlık tespiti

- Ücretsiz

- Sıklık

- itibaren

- tamamen

- işlev

- fonksiyonlar

- gelecek

- oluşturmak

- oluşturulan

- üreten

- jeneratör

- almak

- Vermek

- Go

- Tercih Etmenizin

- vermek

- Zemin

- grup

- sahip olan

- yardım

- yardımcı olur

- daha yüksek

- Vurgulamak

- tarihsel

- tarih

- Ne kadar

- Nasıl Yapılır

- HTML

- HTTPS

- Yüzlerce

- IAM

- tespit

- Kimlik

- önem

- in

- dahil

- Gelen

- Artırmak

- artan

- bireysel

- bilgi

- Altyapı

- giriş

- Uçlar

- anlayışlar

- kurmak

- örnek

- Enstitü

- talimatlar

- ilgili

- IT

- kaydol

- json

- kafka

- Kinesis Veri Akışları

- dil

- büyük

- Gecikme

- son

- başlatmak

- öğrenme

- Ayrılmak

- uzunluk

- seviye

- LİMİT

- sınırlama

- yük

- yükler

- uzun süreli

- Düşük

- makine

- makine öğrenme

- yapılmış

- yapmak

- YAPAR

- yönetilen

- yönetme

- el ile

- çok

- harita

- kitlesel

- uygun

- matplotlib

- maksimum

- anlamına geliyor

- medya

- yöntem

- metrik

- Metrikleri

- Azaltmak

- ML

- Moda

- model

- modelleri

- aylık

- ay

- Daha

- çoğu

- hareket

- isim

- Navigasyon

- gerek

- ihtiyaçlar

- yeni

- sonraki

- tebliğ

- numara

- dizi

- nesnel

- ONE

- açılır

- operasyon

- işletme

- Operasyon

- Fırsatlar

- Opsiyonlar

- sipariş

- organizasyonlar

- Diğer

- özetlenen

- paketler

- pandalar

- bölmesi

- parametre

- Bölüm

- MÜKEMMEL OLAN YERİ BULUN

- yapmak

- performans

- gerçekleştirir

- izinleri

- telefon

- yer

- planlama

- platform

- Platformlar

- Platon

- Plato Veri Zekası

- PlatoVeri

- Lütfen

- politikaları

- politika

- mümkün

- Çivi

- güç kelimesini seçerim

- Hassas

- tahmin

- tahmin

- Tahminler

- öngörür

- önceki

- fiyatlandırma

- süreç

- Süreçler

- üretici

- Programı

- sağlamak

- sağlar

- halka açık

- yayınlamak

- Python

- Sorular

- hızla

- rasgele

- Okuma

- hazır

- gerçek

- gerçek zaman

- gerçek zamanlı veri

- fark

- teslim almak

- Alınan

- son

- tanınan

- kayıtlar

- DEFALARCA

- değiştirmek

- gereklidir

- kaynak

- Kaynaklar

- DİNLENME

- Sonuçlar

- İade

- Risk

- Rol

- koşmak

- koşu

- sagemaker

- San

- San Francisco

- ölçeklenebilir

- ölçek

- ekran

- sdk

- Seaborn

- İkinci

- saniye

- Bölüm

- bölümler

- güvenli

- seçilmiş

- seçim

- Serverless

- hizmet

- set

- ayar

- ayarlar

- kurulum

- kısa dönem

- şov

- Gösteriler

- Basit

- basitleştirmek

- simülatör

- So

- Sosyal Medya

- sosyal medya

- çözüm

- Çözümler

- biraz

- Kaynak

- kaynaklar

- uzman

- uzmanlaşmış

- geçirmek

- bölmek

- SQL

- Aşama

- standart

- başladı

- Eyalet

- Açıklama

- ifadeleri

- Durum

- adım

- Basamaklar

- hafızası

- mağaza

- mağaza

- Stratejik

- dere

- akış

- akış hizmeti

- dere

- böyle

- harika

- sistem

- Sistemler

- tablo

- Bizi daha iyi tanımak için

- alır

- Görüşmeler

- Hedef

- terminal

- test

- The

- Üçüncü

- Binlerce

- İçinden

- zaman

- zaman damgası

- için

- üst

- konu

- geleneksel

- Tren

- eğitilmiş

- Eğitim

- işlem

- işlemsel

- işlemler

- Dönüştürmek

- dönüşümler

- dönüşüm

- eğilim

- Güncelleme

- güncellenmiş

- kullanım

- kullanım

- kullanıcı

- valide

- değer

- Değerler

- çeşitli

- gerçeklik

- versiyon

- Görüntüle

- Gösterim

- yürüyüş

- örneklerde

- depo

- Depolama

- Web sitesi

- hafta sonu

- haftalık

- Ne

- hangi

- süre

- Vikipedi

- irade

- olmadan

- işlenmiş

- çalışma

- çalışır

- yazmak

- yıl

- Yoga

- zefirnet