Adobe Firefly'dan görüntü

"Sayımız çok fazlaydı. Çok fazla paraya, çok fazla ekipmana erişimimiz vardı ve yavaş yavaş delirmeye başladık.”

Francis Ford Coppola, çok fazla harcayan ve yolunu kaybeden yapay zeka şirketleri için bir metafor yaratmıyordu ama öyle de olabilirdi. kıyamet şimdi destansıydı ama aynı zamanda GPT-4'e çok benzer şekilde yapılması uzun, zor ve pahalı bir projeydi. Yüksek Lisans'ın gelişiminin çok fazla paraya ve çok fazla ekipmana yöneldiğini düşünüyorum. Ve "genel zekayı yeni icat ettik" yanıltıcılığının bir kısmı biraz çılgınca. Ancak şimdi en iyi yaptıkları şeyi yapma sırası açık kaynak topluluklarında: çok daha az para ve ekipman kullanarak ücretsiz rakip yazılımlar sunmak.

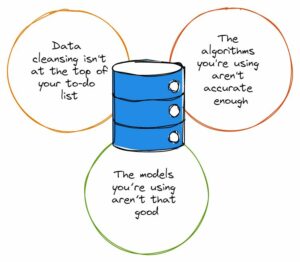

OpenAI, 11 milyar dolardan fazla finansman aldı ve GPT-3.5'in eğitim çalıştırması başına 5-6 milyon dolara mal olduğu tahmin ediliyor. GPT-4 hakkında çok az şey biliyoruz çünkü OpenAI bunu söylemiyor ancak GPT-3.5'ten küçük olmadığını varsaymanın yanlış olmayacağını düşünüyorum. Şu anda dünya çapında bir GPU sıkıntısı var ve bir değişiklik olarak, bunun nedeni en yeni kripto para değil. Üretken AI start-up'ları, ürünlerine güç sağlamak için kullandıkları LLM'nin herhangi bir fikri mülkiyetine sahip olmadıklarında, büyük değerlemelerle 100 milyon ABD Doları'nın üzerinde A Serisi turlar atıyor. LLM kervanı yüksek viteste ve para akıyor.

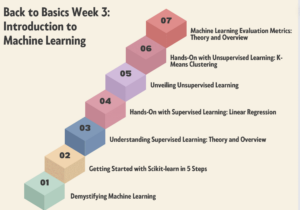

Zar atılmış gibi görünüyordu: Yalnızca Microsoft/OpenAI, Amazon ve Google gibi cebi zengin olan şirketlerin yüz milyarlarca parametreli modeli eğitmeye gücü yetiyordu. Daha büyük modellerin daha iyi modeller olduğu varsayıldı. GPT-3'te bir sorun mu var? Daha büyük bir sürüm çıkana kadar bekleyin, her şey yoluna girecek! Rekabet etmek isteyen daha küçük şirketler, çok daha fazla sermaye toplamak zorunda kaldı ya da ChatGPT pazarında emtia entegrasyonları oluşturmaya devam etmek zorunda kaldı. Araştırma bütçeleri daha da kısıtlı olan akademi bir kenara itildi.

Neyse ki bir grup akıllı insan ve açık kaynak projesi bunu bir kısıtlamadan ziyade bir meydan okuma olarak değerlendirdi. Stanford'daki araştırmacılar, performansı GPT-7'in 3.5 Milyar parametre modeline yaklaşan 175 milyar parametreli bir model olan Alpaca'yı piyasaya sürdü. OpenAI tarafından kullanılan boyutta bir eğitim seti oluşturmak için gerekli kaynaklara sahip olmadıklarından, akıllı bir şekilde eğitimli bir açık kaynak LLM, LLaMA almayı ve bunun yerine bir dizi GPT-3.5 istemi ve çıkışına göre ince ayar yapmayı seçtiler. Temelde model, GPT-3.5'in ne yaptığını öğrendi ve bunun davranışını kopyalamak için çok etkili bir strateji olduğu ortaya çıktı.

Alpaca, açık kaynaklı, ticari olmayan LLaMA modelini kullandığından hem kod hem de veriler açısından ticari olmayan kullanım için lisanslanmıştır ve OpenAI, API'lerinin rakip ürünler oluşturmak için herhangi bir şekilde kullanılmasına açıkça izin vermez. Bu, Alpaca'nın komutlarına ve çıktılarına göre farklı bir açık kaynak Yüksek Lisans Programına ince ayar yapma konusunda cezbedici bir olasılık yaratıyor… farklı lisanslama olanaklarına sahip üçüncü bir GPT-3.5 benzeri model yaratıyor.

Burada başka bir ironi katmanı daha var; tüm büyük LLM'ler internette bulunan telif hakkıyla korunan metin ve görseller konusunda eğitilmiş ve hak sahiplerine bir kuruş bile ödememişler. Şirketler, kullanımın “dönüştürücü” olduğu iddiasıyla ABD telif hakkı yasası kapsamında “adil kullanım” muafiyetini talep ediyor. Ancak konu bedava verilerle oluşturdukları modellerin çıktılarına gelince aslında kimsenin onlara aynı şeyi yapmasını istemiyorlar. Hak sahipleri akıllandıkça bu durumun değişeceğini ve bir noktada mahkemeye çıkabileceğini umuyorum.

Bu, CoPilot gibi Kod ürünlerine yönelik üretken yapay zeka için, lisansa uyulmadığı gerekçesiyle kodlarının eğitim için kullanılmasına itiraz eden, kısıtlayıcı lisanslı açık kaynak yazarları tarafından öne sürülen görüşten ayrı ve farklı bir noktadır. Bireysel açık kaynak yazarları için sorun, ayakta - esaslı kopyalama - ve zarara uğradıklarını göstermeleri gerekmesidir. Modeller çıktı kodunu girdiye (yazarın kaynak kodu satırları) bağlamayı zorlaştırdığından ve ekonomik kayıp olmadığından (ücretsiz olması gerekiyordu), bir örnek oluşturmak çok daha zor. Bu, tüm iş modeli çalışmalarını lisanslamak/satmak olan ve Getty Images gibi önemli miktarda kopyalama gösterebilen toplayıcılar tarafından temsil edilen, kâr amacı güden yaratıcıların (örneğin fotoğrafçıların) aksine.

LLaMA ile ilgili bir diğer ilginç şey ise Meta'dan çıkmış olmasıdır. Başlangıçta sadece araştırmacıların kullanımına sunuldu ve daha sonra BitTorrent aracılığıyla dünyaya sızdırıldı. Meta, OpenAI, Microsoft, Google ve Amazon'dan temel olarak farklı bir iş kolundadır; size bulut hizmetleri veya yazılım satmaya çalışmaz ve dolayısıyla çok farklı teşviklere sahiptir. Geçmişte bilgi işlem tasarımlarını açık kaynaklı hale getirdi (OpenCompute) ve topluluğun bunları geliştirdiğini gördü; açık kaynağın değerini anlıyor.

Meta, açık kaynak yapay zekaya katkıda bulunan en önemli katkılardan biri olabilir. Sadece muazzam kaynaklara sahip olmakla kalmıyor, aynı zamanda büyük üretken yapay zeka teknolojisinin çoğalması durumunda fayda sağlıyor: sosyal medyada para kazanabileceği daha fazla içerik olacak. Meta, üç açık kaynaklı yapay zeka modeli daha yayınladı: ImageBind (çok boyutlu veri indeksleme), DINOv2 (bilgisayar görüşü) ve Segment Everything. İkincisi, görüntülerdeki benzersiz nesneleri tanımlar ve son derece geniş kapsamlı Apache Lisansı kapsamında yayınlanır.

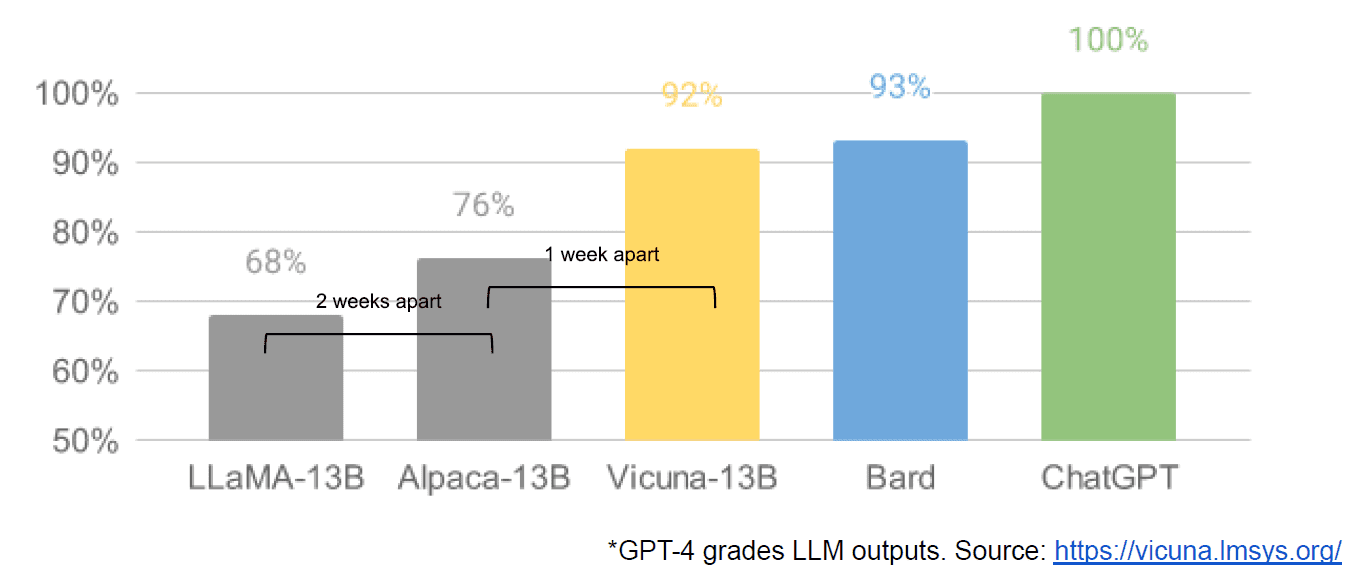

Son olarak, kapalı modeller ile buna yakın veya daha iyi performans gösteren çok daha küçük, daha ucuz modeller üreten toplulukların yenilikçiliğine karşı karamsar bir bakış açısı getiren "Hendekimiz Yok, OpenAI de Yok" adlı dahili bir Google belgesinin sızdırıldığı iddiasını aldık. onların kapalı kaynak muadilleri. İddiaya göre diyorum çünkü yazının kaynağının Google içi olduğunu doğrulamanın bir yolu yok. Ancak şu ilgi çekici grafiği içeriyor:

Dikey eksen, açıkça belirtmek gerekirse, LLM çıktılarının GPT-4'e göre derecelendirilmesidir.

Metinden görüntüleri sentezleyen Stabil Difüzyon, açık kaynaklı üretken yapay zekanın tescilli modellerden daha hızlı ilerleyebildiği yerlerin bir başka örneğidir. Bu projenin (ControlNet) yakın zamanda tekrarlanan versiyonu onu Dall-E2'nin yeteneklerini aşacak şekilde geliştirdi. Bu, dünyanın her yerindeki pek çok tamirat sonucunda ortaya çıktı ve tek bir kurumun ulaşamayacağı bir ilerleme hızıyla sonuçlandı. Bu tamircilerden bazıları, daha ucuz donanım üzerinde eğitim ve çalıştırma için Stabil Difüzyonun nasıl daha hızlı hale getirileceğini ve daha fazla kişi tarafından daha kısa yineleme döngülerine olanak tanıyacağını buldu.

Ve böylece tam bir daire çizdik. Çok fazla paraya ve çok fazla donanıma sahip olmamak, sıradan insanlardan oluşan bir topluluğa kurnaz düzeyde bir yenilik ilhamı verdi. Yapay zeka geliştiricisi olmanın tam zamanı.

Mathew Lodge AI For Code girişimi Diffblue'nun CEO'sudur. Anaconda ve VMware gibi şirketlerde ürün liderliği alanında 25 yıldan fazla çeşitli deneyime sahiptir. Lodge şu anda İyi Hukuk Projesi'nin yönetim kurulunda görev yapmaktadır ve Kraliyet Fotoğraf Derneği Mütevelli Heyeti Başkan Yardımcısıdır.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoAiStream. Web3 Veri Zekası. Bilgi Genişletildi. Buradan Erişin.

- Adryenn Ashley ile Geleceği Basmak. Buradan Erişin.

- PREIPO® ile PRE-IPO Şirketlerinde Hisse Al ve Sat. Buradan Erişin.

- Kaynak: https://www.kdnuggets.com/2023/05/llm-apocalypse-revenge-open-source-clones.html?utm_source=rss&utm_medium=rss&utm_campaign=llm-apocalypse-now-revenge-of-the-open-source-clones

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 9

- a

- Yapabilmek

- Hakkımızda

- Akademi

- erişim

- kerpiç

- ilerlemek

- toplayıcılar

- AI

- Türkiye

- iddia edilen

- iddiaya göre

- Ayrıca

- Amazon

- an

- ve

- Başka

- herhangi

- kimse

- bir şey

- Apache

- API'ler

- ARE

- tartışma

- göre

- AS

- varsayılır

- At

- yazar

- Yazarlar

- mevcut

- eksen

- BE

- Çünkü

- olmuştur

- olmak

- faydaları

- İYİ

- Daha iyi

- büyük

- BitTorrent

- yazı tahtası

- her ikisi de

- Bütçeler

- inşa etmek

- bina

- Demet

- iş

- iş modeli

- fakat

- by

- geldi

- CAN

- yetenekleri

- Başkent

- dava

- ceo

- Sandalye

- meydan okuma

- değişiklik

- ChatGPT

- daha ucuz

- seçti

- Daire

- iddia

- açık

- Kapanış

- kapalı

- bulut

- bulut hizmetleri

- kod

- nasıl

- geliyor

- emtia

- topluluklar

- topluluk

- Şirketler

- zorlayıcı

- yarışmak

- rakip

- hesaplamak

- bilgisayar

- Bilgisayar görüşü

- içerik

- katkıda

- kopyalama

- telif hakkı

- maliyetler

- olabilir

- Mahkeme

- yaratmak

- Oluşturma

- yaratıcıları

- kripto para

- Şu anda

- döngüleri

- veri

- teslim

- milletvekili

- tasarımlar

- Geliştirici

- gelişme

- Ölmek

- farklı

- zor

- Yayılma

- farklı

- çeşitli

- do

- belge

- yok

- Dont

- e

- Ekonomik

- Etkili

- etkinleştirme

- son

- Tüm

- EPİK

- ekipman

- esasen

- tahmini

- Hatta

- örnek

- beklemek

- pahalı

- deneyim

- uzak

- Daha hızlı

- Figürlü

- Akan

- takip

- İçin

- Ford

- Ücretsiz

- itibaren

- tam

- esasen

- finansman

- vites

- genel

- üretken

- üretken yapay zeka

- Tercih Etmenizin

- GPU

- grafik

- harika

- vardı

- Zor

- donanım

- Var

- sahip olan

- he

- okuyun

- Yüksek

- büyük ölçüde

- sahipleri

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTTPS

- Kocaman

- Yutturmaca

- i

- tanımlar

- if

- görüntüleri

- önemli

- iyileştirmek

- gelişmiş

- in

- teşvikler

- bireysel

- Yenilikçilik

- giriş

- Deli

- ilham

- yerine

- Kurumsal

- entegrasyonlar

- ilginç

- iç

- Internet

- İcat edildi

- IP

- alay

- IT

- tekrarlama

- ONUN

- sadece

- KDNuggets

- Bilmek

- iniş

- son

- Kanun

- tabaka

- Liderlik

- öğrendim

- sol

- az

- seviye

- Lisans

- ruhsatlı

- ruhsat verme

- sevmek

- hatları

- LINK

- küçük

- lama

- Uzun

- baktı

- bakıyor

- kaybetmek

- kayıp

- Çok

- büyük

- yapmak

- Yapımı

- çok

- çarşı

- masif

- Maç

- Mayıs..

- medya

- Meta

- Microsoft

- model

- modelleri

- para kazanma

- para

- Daha

- çoğu

- çok

- gerek

- ne

- yok hayır

- Ticari olmayan

- şimdi

- nesne

- nesneler

- of

- on

- ONE

- bir tek

- açık

- açık kaynak

- açık kaynak projeleri

- OpenAI

- or

- sıradan

- aslında

- Diğer

- dışarı

- çıktı

- tekrar

- kendi

- Barış

- parametre

- geçmiş

- İnsanlar

- yapmak

- performans

- Platon

- Plato Veri Zekası

- PlatoVeri

- Nokta

- olanakları

- güç kelimesini seçerim

- Sorun

- PLATFORM

- Ürünler

- proje

- Projeler

- özel

- olasılık

- yükseltmek

- yükseltilmiş

- daha doğrusu

- Gerçekten mi

- son

- serbest

- temsil

- araştırma

- Araştırmacılar

- Kaynaklar

- kısıtlama

- Ortaya çıkan

- haklar

- mermi

- kraliyet

- koşmak

- s

- güvenli

- aynı

- söylemek

- görüldü

- bölüm

- satmak

- ayrı

- Dizi

- A Serisi

- vermektedir

- Hizmetler

- set

- kıtlık

- şov

- beri

- tek

- beden

- daha küçük

- akıllı

- So

- Sosyal Medya

- sosyal medya

- Toplum

- Yazılım

- biraz

- bir şey

- Kaynak

- kaynak kodu

- geçirmek

- kararlı

- stanford

- start-up

- başlangıç

- Stratejileri

- böyle

- önermek

- sözde

- aştı

- Bizi daha iyi tanımak için

- alınan

- alır

- Teknoloji

- göre

- o

- The

- Kaynak

- Dünya

- ve bazı Asya

- Onları

- sonra

- Orada.

- onlar

- şey

- düşünmek

- Üçüncü

- Re-Tweet

- Bu

- üç

- zaman

- için

- çok

- aldı

- Tren

- eğitilmiş

- Eğitim

- DÖNÜŞ

- döner

- altında

- anlar

- benzersiz

- aksine

- kadar

- us

- kullanım

- Kullanılmış

- kullanım

- kullanma

- değerlemeler

- değer

- doğrulamak

- versiyon

- dikey

- çok

- üzerinden

- Görüntüle

- vizyonumuz

- vmware

- vs

- beklemek

- istemek

- oldu

- Yol..

- we

- Kimler

- vardı

- Ne

- ne zaman

- hangi

- DSÖ

- bütün

- kimin

- irade

- WISE

- ile

- İş

- Dünya

- Yanlış

- sen

- zefirnet