AWS'de Otomatik Veri Analitiği (ADA) basit ve sezgisel bir kullanıcı arabirimi aracılığıyla birkaç dakika içinde verilerden anlamlı içgörüler elde etmenizi sağlayan bir AWS çözümüdür. ADA, çeşitli kullanım durumları için veri analistleri tarafından kullanıma hazır, AWS'ye özgü bir veri analitiği platformu sunar. ADA ile ekipler, uzman teknik beceriler gerektirmeden çeşitli veri kaynaklarından çeşitli veri kümelerini alabilir, dönüştürebilir, yönetebilir ve sorgulayabilir. ADA bir dizi sağlar önceden oluşturulmuş konektörler dahil olmak üzere çok çeşitli kaynaklardan veri almak için Amazon Basit Depolama Hizmeti (Amazon S3), Amazon Kinesis Veri Akışları, Amazon Bulut İzleme, Amazon CloudTrail, ve Amazon DinamoDB ve diğerleri gibi.

ADA, veri analistleri tarafından BT, finans, pazarlama, satış ve güvenlik dahil olmak üzere çok çeşitli kullanım durumlarında kullanılabilecek temel bir platform sağlar. ADA'nın kullanıma hazır CloudWatch veri bağlayıcısı, ADA'nın dağıtıldığı aynı AWS hesabındaki CloudWatch günlüklerinden veya farklı bir AWS hesabından veri alımına olanak tanır.

Bu gönderide, bir uygulama geliştiricisinin veya uygulama test uzmanının AWS'de çalışan uygulamalara ilişkin operasyonel içgörüler elde etmek için ADA'yı nasıl kullanabileceğini gösteriyoruz. AWS'de farklı veri kaynaklarına bağlanmak için ADA çözümünü nasıl kullanabileceğinizi de gösteriyoruz. Önce biz ADA çözümünü devreye alın bir AWS hesabına ve ADA çözümünü kurun oluşturarak veri ürünleri veri konektörlerini kullanma. Ardından, ayrı veri kümelerini birleştirmek için ADA Sorgu Tezgahını kullanırız ve içgörüler elde etmek için tanıdık Yapılandırılmış Sorgu Dili (SQL) kullanarak ilişkili verileri sorgularız. Ayrıca, verileri görselleştirmek ve raporlar oluşturmak için ADA'nın Tableau gibi iş zekası (BI) araçlarıyla nasıl entegre edilebileceğini de gösteriyoruz.

Çözüme genel bakış

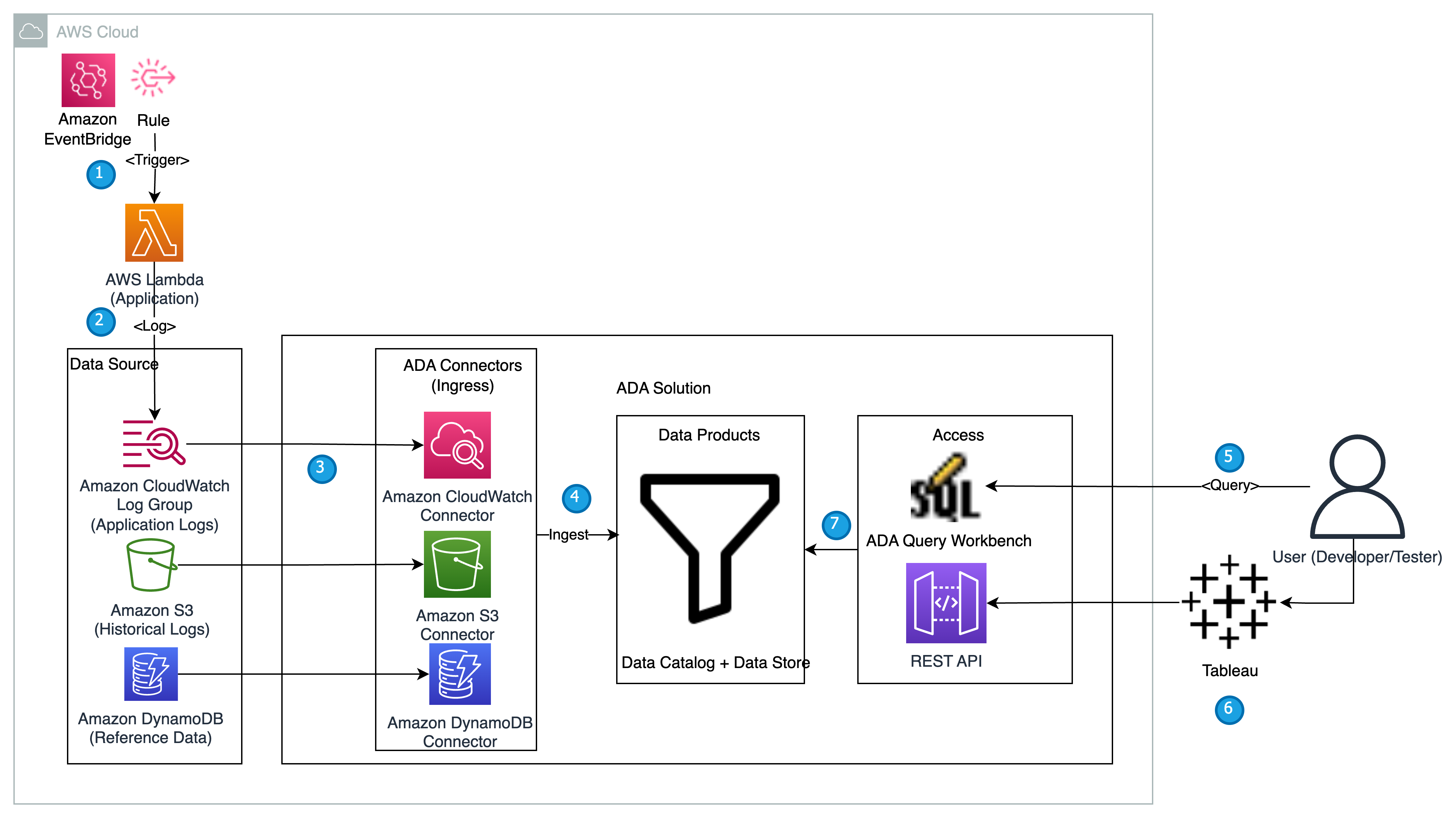

Bu bölümde demo için çözüm mimarisini sunuyor ve iş akışını açıklıyoruz. Gösterim amacıyla, ısmarlama uygulama, bir AWS Lambda günlükleri yayan işlev Apache Günlük Biçimi kullanarak önceden ayarlanmış bir aralıkta Amazon EventBridge. Bu standart format, birçok farklı web sunucusu tarafından üretilebilir ve birçok log analiz programı tarafından okunabilir. Uygulama (Lambda işlevi) günlükleri, bir CloudWatch günlük grubuna gönderilir. Geçmiş uygulama günlükleri, referans ve sorgulama amacıyla bir S3 klasöründe saklanır. listesini içeren bir arama tablosu HTTP durum kodları açıklamalarla birlikte bir DynamoDB tablosunda saklanır. Bu üçü, korelasyon, sorgulama ve analiz için verilerin ADA'ya alındığı kaynaklar olarak hizmet eder. Biz ADA çözümünü devreye alın bir AWS hesabına ve ADA'yı kur. daha sonra oluştururuz veri ürünleri için ADA bünyesinde CloudWatch günlük grubu, S3 kepçe, ve DynamoDB. Veri ürünleri yapılandırılırken, ADA kaynaklardan verileri almak için veri ardışık düzenleri sağlar. ADA Query Workbench ile, uygulamada sorun giderme veya sorun teşhisi için alınan verileri düz SQL kullanarak sorgulayabilirsiniz.

Aşağıdaki diyagram, uygulama günlüklerine ilişkin içgörüler elde etmek için ADA kullanmanın mimarisine ve iş akışına genel bir bakış sağlar.

İş akışı aşağıdaki adımları içerir:

- Bir Lambda işlevi, EventBridge kullanılarak 2 dakikalık aralıklarla tetiklenecek şekilde planlanmıştır.

- Lambda işlevi, altında belirtilen bir CloudWatch günlük grubunda depolanan günlükleri yayar.

/aws/lambda/CdkStack-AdaLogGenLambdaFunction. Uygulama günlükleri, Apache Günlük Biçimi şeması kullanılarak oluşturulur ancak JSON biçiminde CloudWatch günlük grubunda saklanır. - CloudWatch, Amazon S3 ve DynamoDB için veri ürünleri ADA'da oluşturulur. CloudWatch veri ürünü, uygulama (Lambda işlevi) günlüklerinin depolandığı CloudWatch günlük grubuna bağlanır. Amazon S3 bağlayıcısı, geçmiş günlüklerin depolandığı bir S3 klasör klasörüne bağlanır. DynamoDB konektörü, uygulama tarafından başvurulan durum kodlarının ve geçmiş günlüklerin depolandığı bir DynamoDB tablosuna bağlanır.

- ADA, veri ürünlerinin her biri için kaynaklardan veri almak üzere veri boru hattı altyapısını dağıtır. Veri alımı tamamlandığında, ADA Query Workbench aracılığıyla SQL kullanarak sorgular yazabilirsiniz.

- ADA portalında oturum açabilir ve uygulama günlüklerine ilişkin içgörüler elde etmek için Sorgu Workbench'inden SQL sorguları oluşturabilirsiniz. İsteğe bağlı olarak sorguyu kaydedebilir ve sorguyu aynı etki alanındaki diğer ADA kullanıcılarıyla paylaşabilirsiniz. ADA sorgu özelliği tarafından desteklenmektedir Amazon Atinapetabaytlarca veriyi analiz etmek için basitleştirilmiş, esnek bir yol sağlayan, sunucusuz, etkileşimli bir analitik hizmetidir.

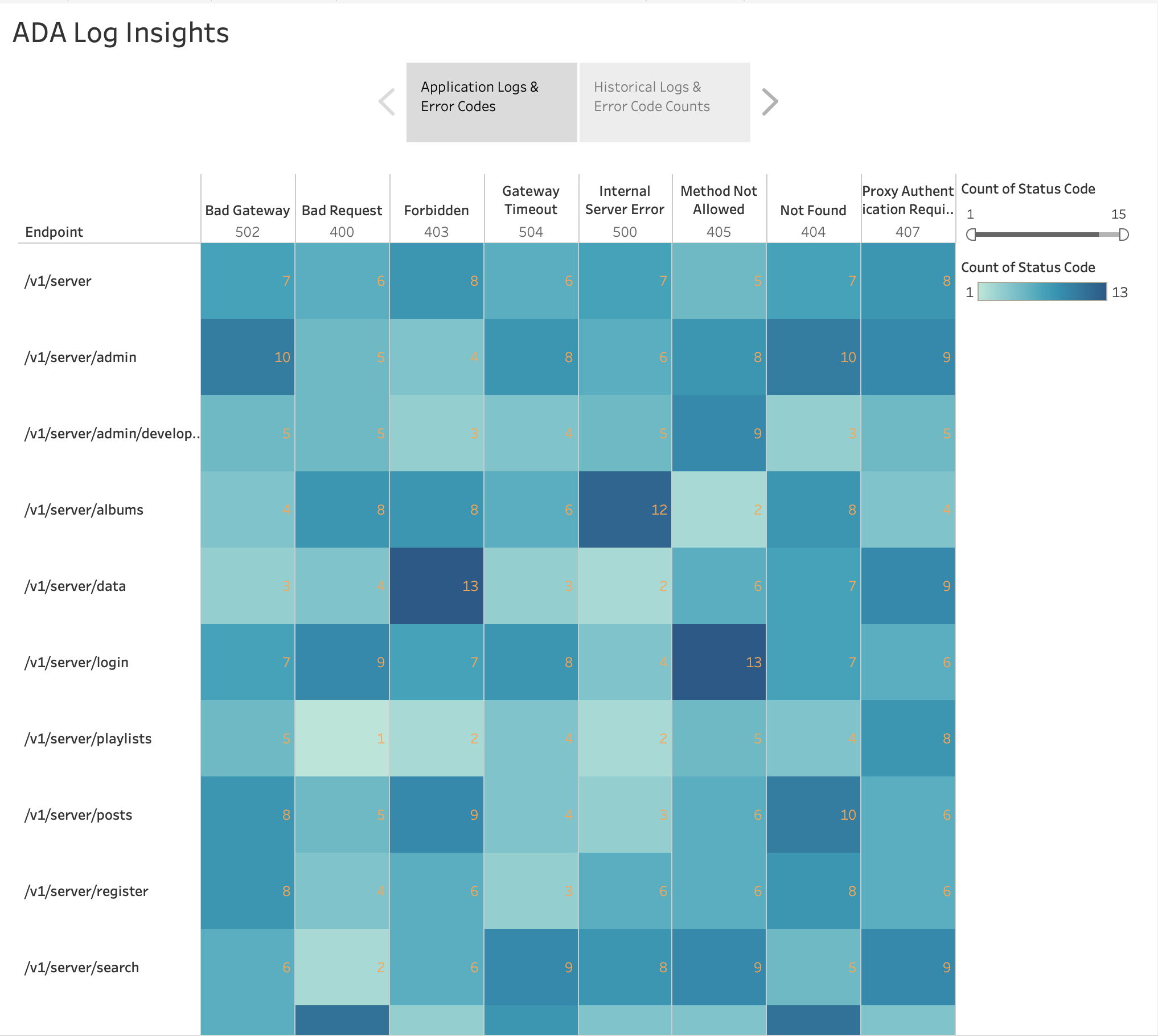

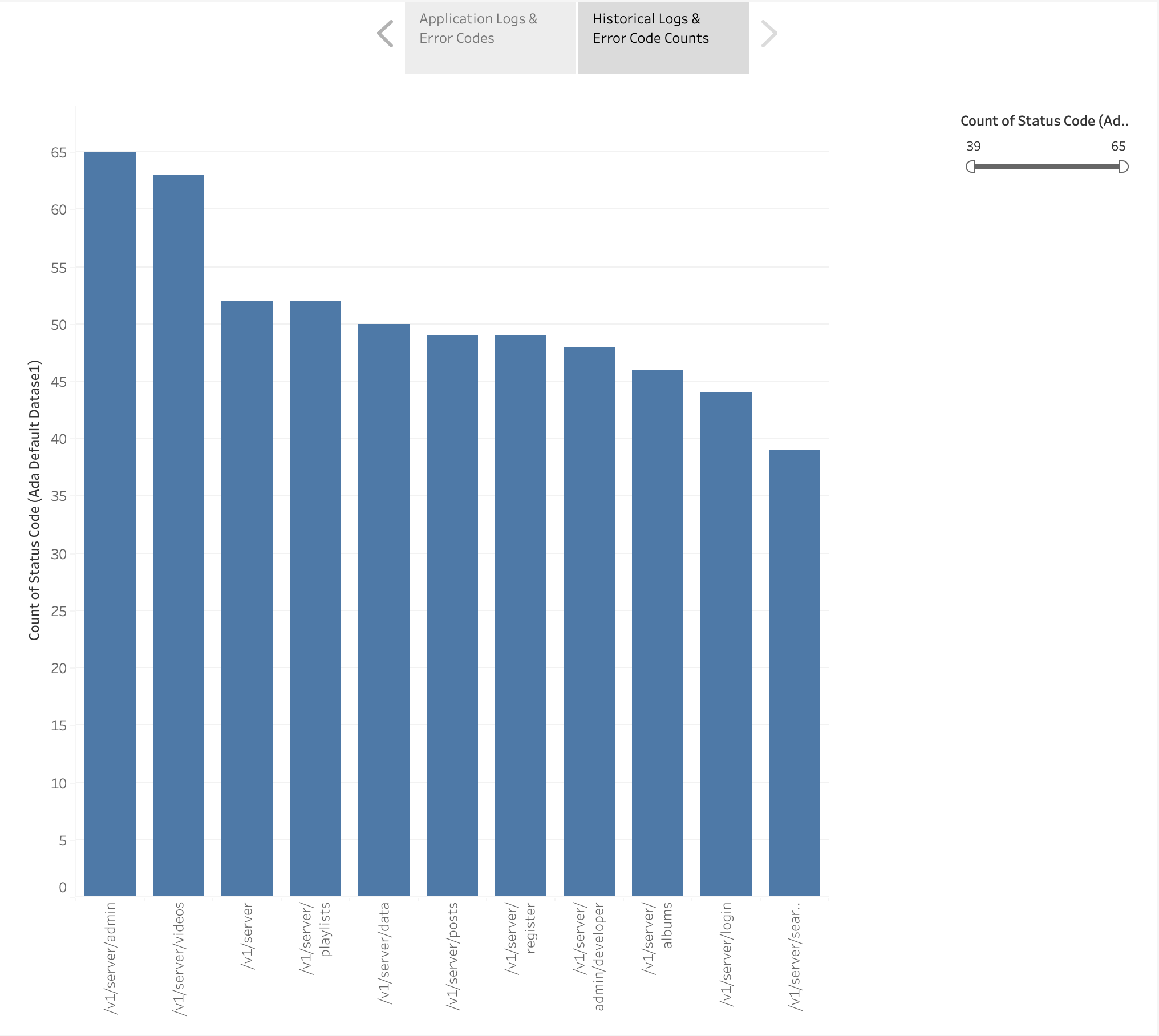

- Tableau, ADA çıkış uç noktaları aracılığıyla ADA veri ürünlerine erişmek için yapılandırılmıştır. Daha sonra iki grafik içeren bir pano oluşturursunuz. İlk grafik, uygulama API uç noktalarıyla ilişkili HTTP hata kodlarının yaygınlığını gösteren bir ısı haritasıdır. İkinci grafik, geçmiş verilerden alınan HTTP hata kodlarının toplam sayısıyla birlikte ilk 10 uygulama API'sini gösteren bir çubuk grafiktir.

Önkoşullar

Bu gönderi için aşağıdaki ön koşulları tamamlamanız gerekir:

- kurmak AWS Komut Satırı Arayüzü (AWS CLI), AWS Bulut Geliştirme Kiti (AWS CDK'sı) önkoşullar, TypeScript'e özgü önkoşullar, ve git.

- Sürüş AWS hesabınızdaki ADA çözümü

us-east-1Bölge.- ADA'yı başlatırken bir yönetici e-postası sağlayın AWS CloudFormation yığın. Bu, ADA'nın kök kullanıcı parolasını göndermesi için gereklidir. Çok faktörlü kimlik doğrulama (MFA) etkinleştirildiyse, tek seferlik bir parola mesajı almak için bir yönetici telefon numarası gerekir. Bu demo için MFA etkin değil.

- Örnek uygulamayı derleyin ve devreye alın ( GitHub repo) çözümü, böylece aşağıdaki kaynaklar hesabınızda

us-east-1Bölge:- Günlük uygulamasını simüle eden bir Lambda işlevi ve uygulama işlevini 2 dakikalık aralıklarla çağıran bir EventBridge kuralı.

- İlgili grup politikalarına sahip bir S3 klasörü ve geçmiş uygulama günlüklerini içeren bir CSV dosyası.

- Arama verilerini içeren bir DynamoDB tablosu.

- uygun AWS Kimlik ve Erişim Yönetimi Hizmetler için gereken (IAM) rolleri ve izinleri.

- İsteğe bağlı olarak yükleyin Tablo Masaüstü, bir üçüncü taraf BI sağlayıcısı. Bu gönderi için Tableau Desktop 2021.2 sürümünü kullanıyoruz. Tableau Desktop uygulamasının lisanslı bir sürümünü kullanmanın bir maliyeti vardır. Ek ayrıntılar için bkz. Tablo lisanslama bilgiler.

ADA'yı dağıtın ve kurun

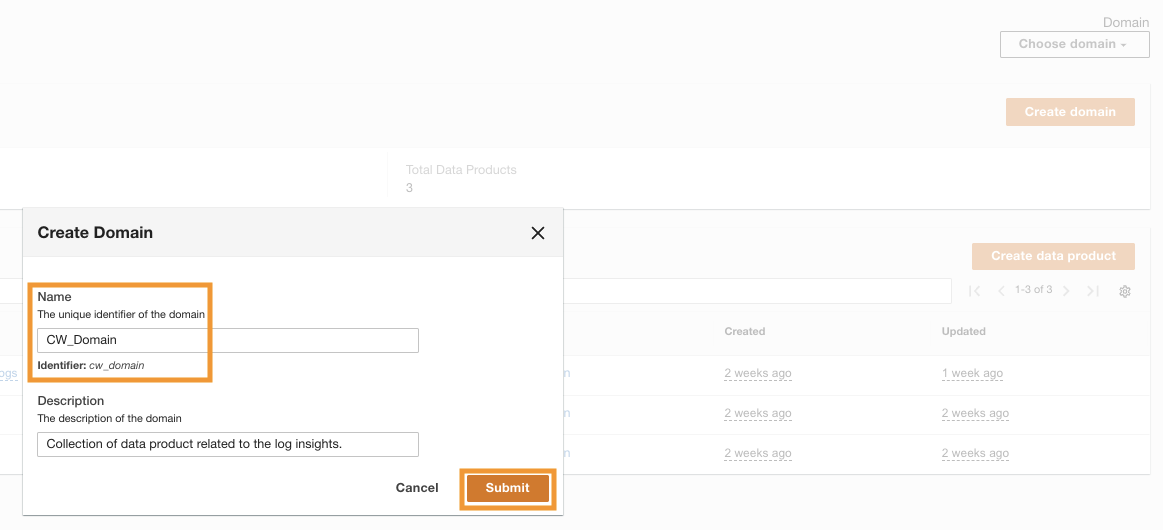

ADA başarıyla dağıtıldıktan sonra şunları yapabilirsiniz: oturum aç kurulum sırasında sağlanan yönetici e-postasını kullanarak. Daha sonra bir domain adlı CW_Domain. Etki alanı, kullanıcı tanımlı bir veri ürünleri koleksiyonudur. Örneğin, bir etki alanı bir ekip veya proje olabilir. Etki alanları, kullanıcıların veri ürünlerini düzenlemeleri ve erişim izinlerini yönetmeleri için yapılandırılmış bir yol sağlar.

- ADA konsolunda seçin Alanlar Gezinti bölmesinde.

- Klinik Alan oluştur.

- İsim girin (

CW_Domain) ve açıklama, ardından seçin Gönder.

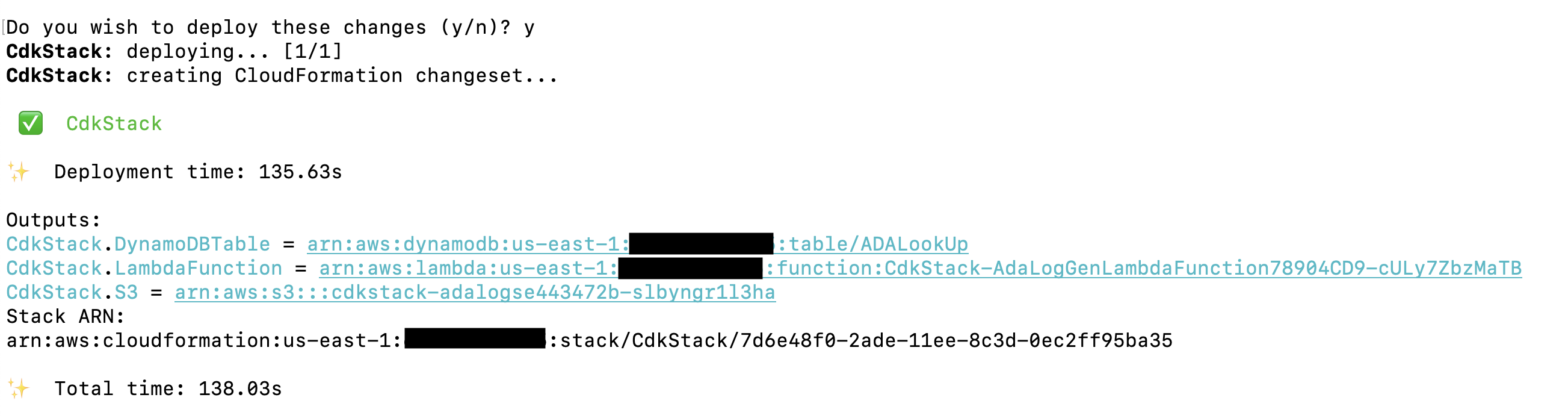

AWS CDK kullanarak örnek uygulama altyapısını kurun

Demo uygulamasını dağıtan AWS CDK çözümü şu adreste barındırılır: GitHub. Depoyu klonlama ve AWS CDK projesini kurma adımları bu bölümde ayrıntılı olarak açıklanmıştır. Bu komutları çalıştırmadan önce, yapılandırmak AWS kimlik bilgileriniz. Bir klasör oluşturun, terminali açın ve AWS CDK çözümünün yüklenmesi gereken klasöre gidin. Aşağıdaki kodu çalıştırın:

Bu adımlar aşağıdaki eylemleri gerçekleştirir:

- Kitaplık bağımlılıklarını yükleyin

- Projeyi inşa edin

- Geçerli bir CloudFormation şablonu oluşturun

- AWS hesabınızda AWS CloudFormation kullanarak yığını dağıtın

Dağıtım yaklaşık 1-2 dakika sürer ve çıktı olarak geçmiş günlük dosyalarını içeren DynamoDB arama tablosunu, Lambda işlevini ve S3 klasörünü oluşturur. Bu değerleri Not Defteri gibi bir metin düzenleme uygulamasına kopyalayın.

ADA veri ürünleri oluşturma

Operasyonel içgörüler elde etmek için sorgulayacağınız her veri kaynağı için bir tane olmak üzere, bu demo için üç farklı veri ürünü oluşturduk. Veri ürünü, ADA'ya başarıyla aktarılan ve sorgulanabilen bir veri kümesidir (tablo veya CSV dosyası gibi bir veri koleksiyonu).

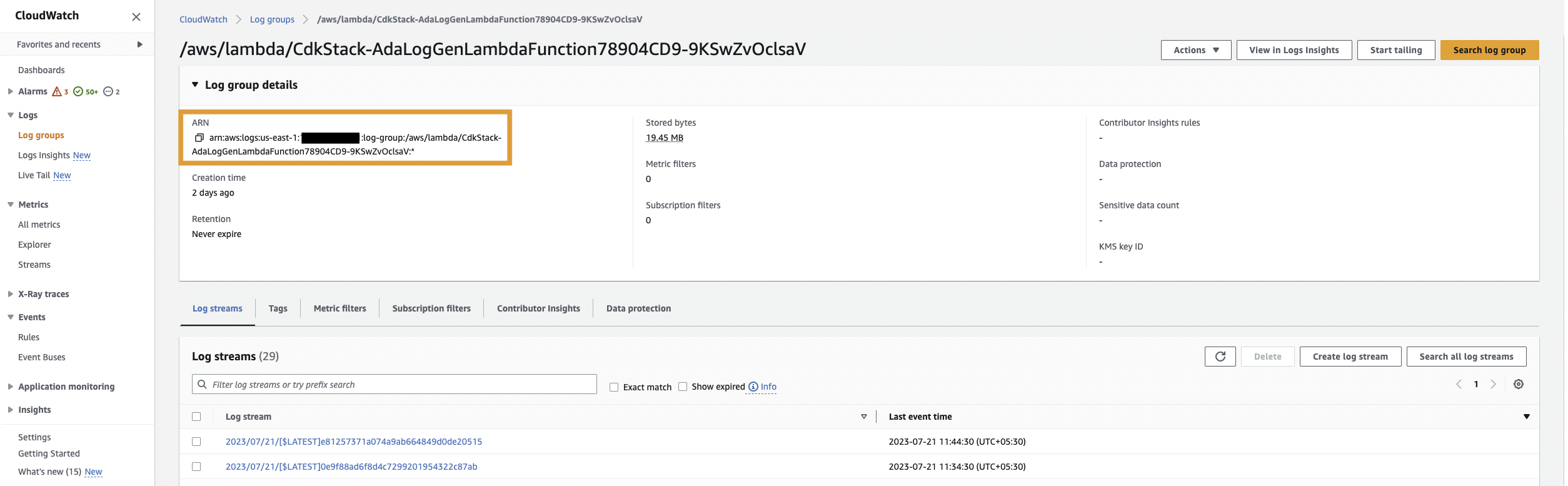

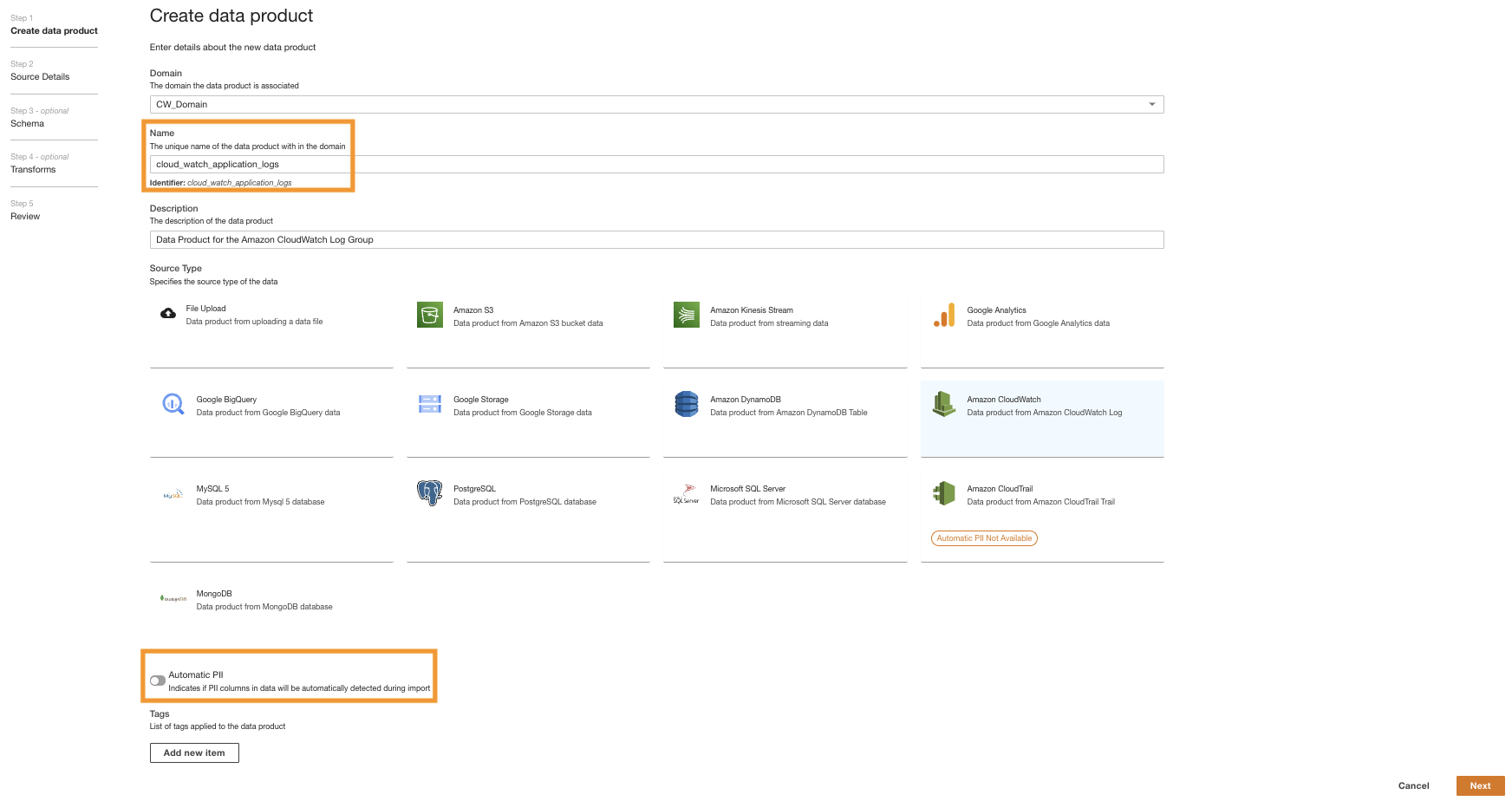

Bir CloudWatch veri ürünü oluşturun

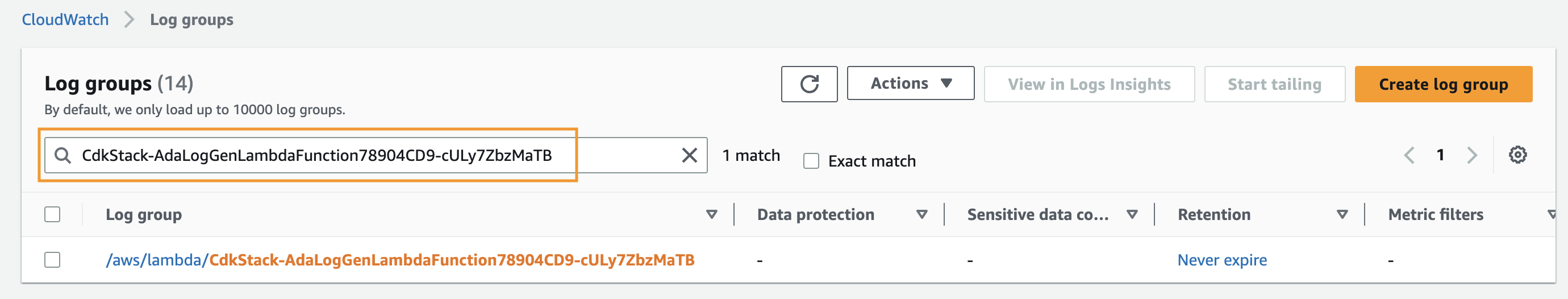

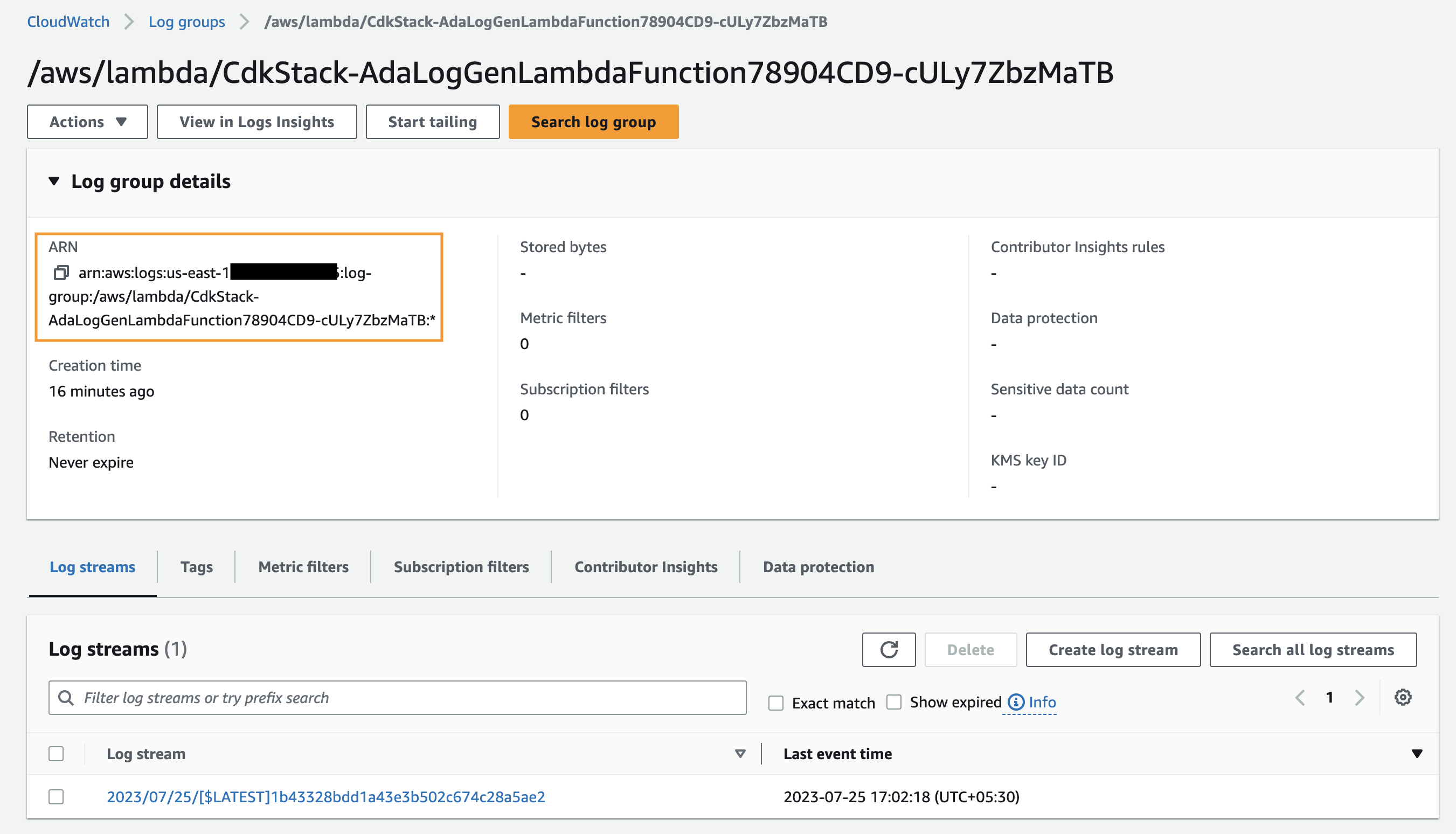

İlk olarak, örnek uygulama (Lambda işlevi) için CloudWatch günlük grubunu almak üzere ADA'yı ayarlayarak uygulama günlükleri için bir veri ürünü oluşturuyoruz. Kullan CdkStack.LambdaFunction Lambda işlevi ARN'sini almak ve CloudWatch konsolunda karşılık gelen CloudWatch günlük grubu ARN'yi bulmak için çıktı.

Ardından aşağıdaki adımları tamamlayın:

- ADA konsolunda ADA etki alanına gidin ve bir CloudWatch veri ürünü oluşturun.

- İçin Nameisim girin.

- İçin Kaynak tipi, seçmek Amazon Bulut İzleme.

- devre dışı bırakmak otomatik kimlik bilgileri.

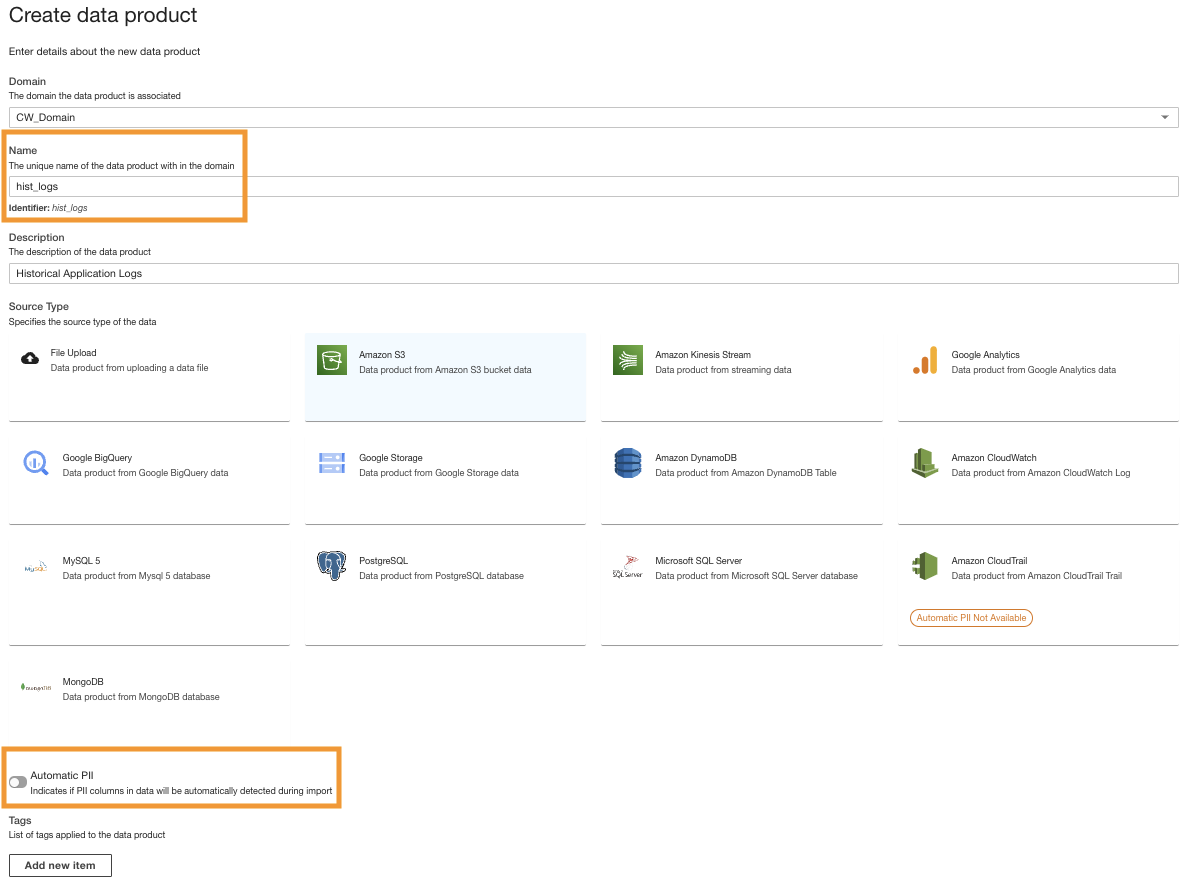

ADA, içe aktarma sırasında kişisel olarak tanımlanabilir bilgileri (PII) verilerini otomatik olarak algılayan ve varsayılan olarak etkinleştirilen bir özelliğe sahiptir. Bu demo için, veri ürünü için bu seçeneği devre dışı bırakıyoruz çünkü PII verilerinin keşfi bu demo kapsamında değildir.

- Klinik Sonraki.

- Önceki adımdan kopyalanan CloudWatch günlük grubu ARN'yi arayın ve seçin.

- ARN günlük grubunu kopyalayın.

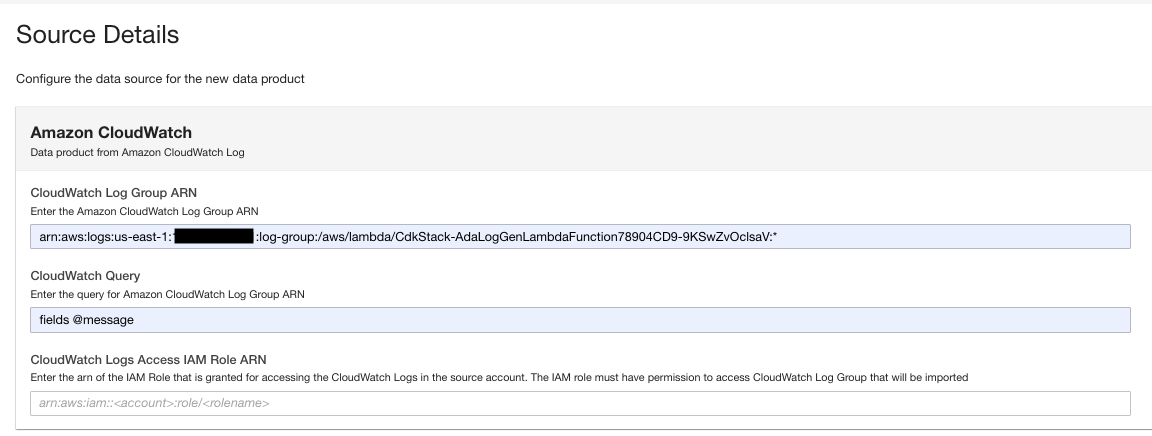

- Veri ürünü sayfasında, ARN günlük grubunu girin.

- İçin CloudWatch Sorgusu, ADA'nın günlük grubundan almasını istediğiniz bir sorgu girin.

Bu demoda, günlük grubundan uygulama günlüklerini almakla ilgilendiğimiz için @message alanını sorguladık.

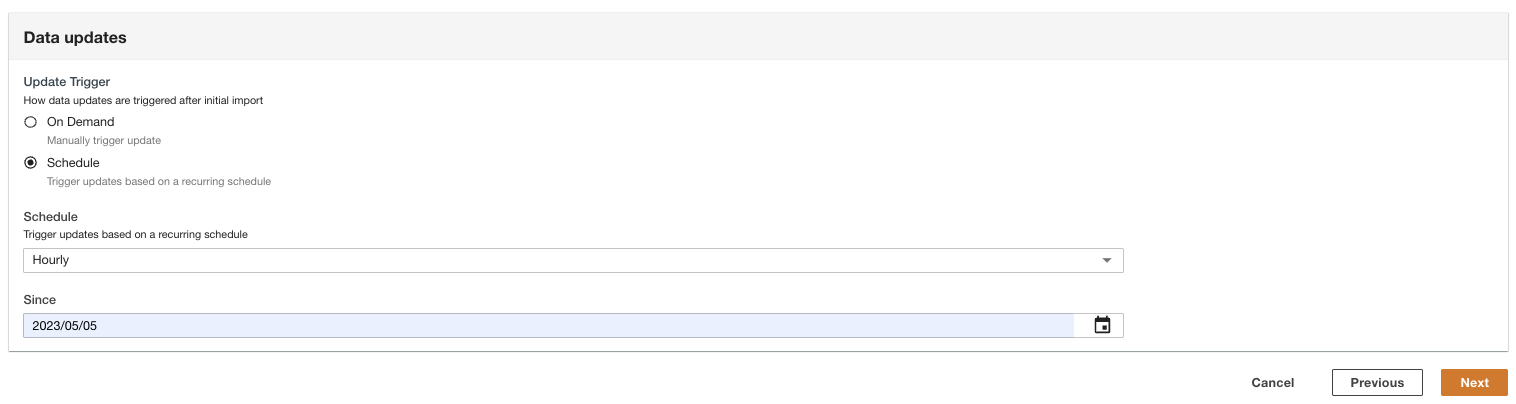

- İlk içe aktarmadan sonra veri güncellemelerinin nasıl tetikleneceğini seçin.

ADA, verileri kaynaktan esnek aralıklarla (en fazla 15 dakika veya daha sonra) veya talep üzerine alacak şekilde yapılandırılabilir. Demo için, veri güncellemelerini saatlik çalışacak şekilde ayarladık.

- Klinik Sonraki.

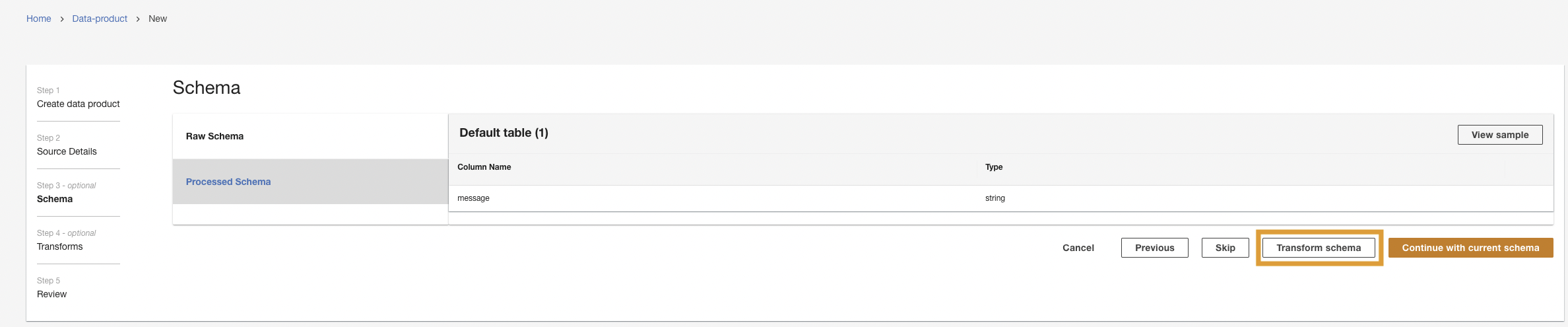

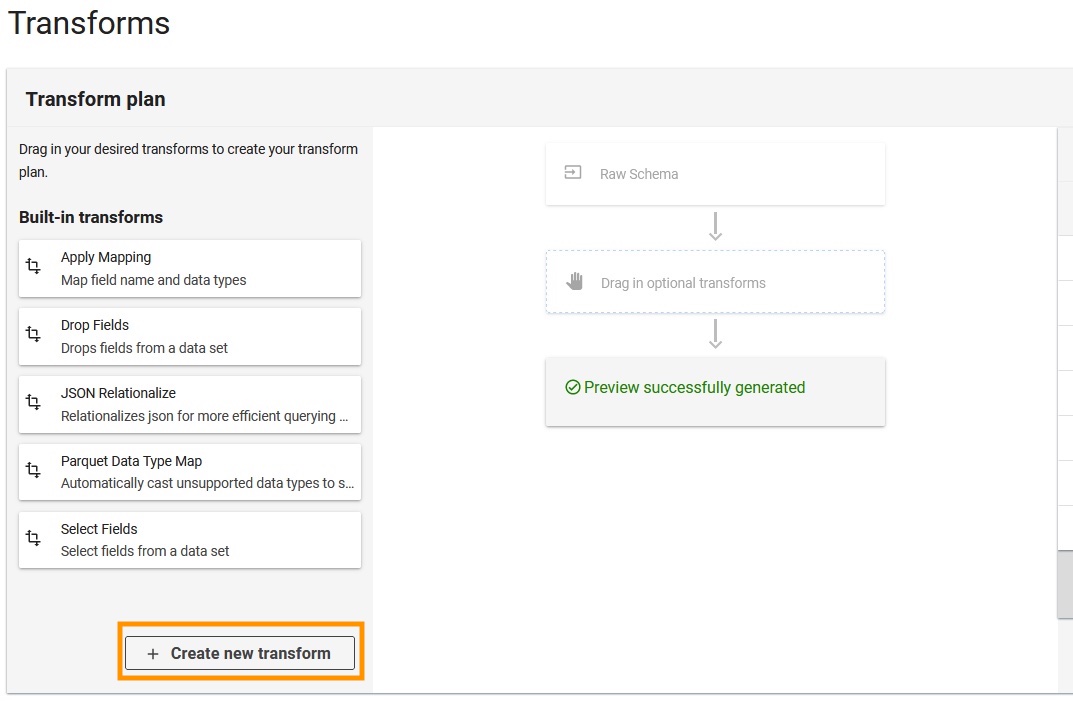

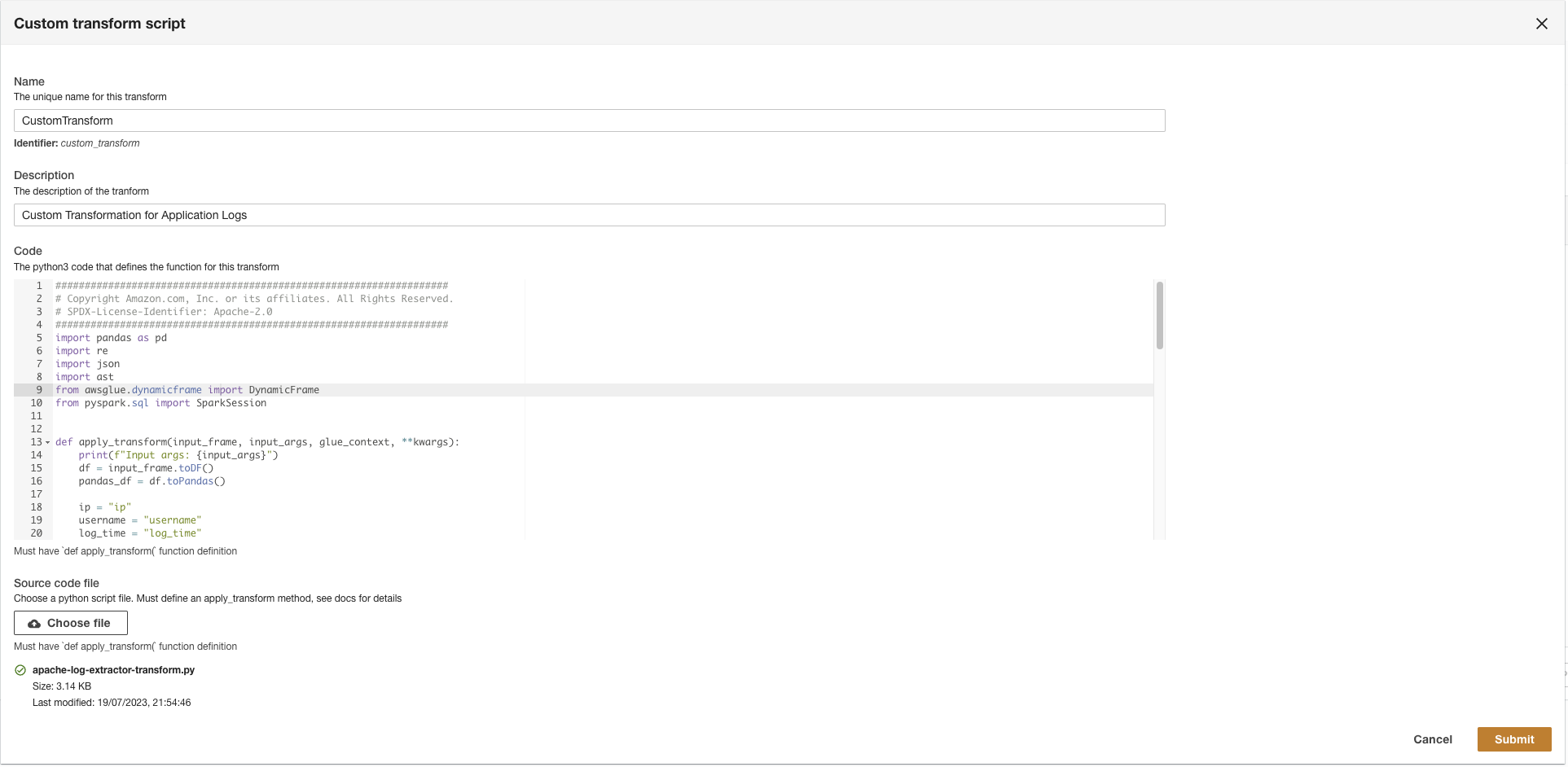

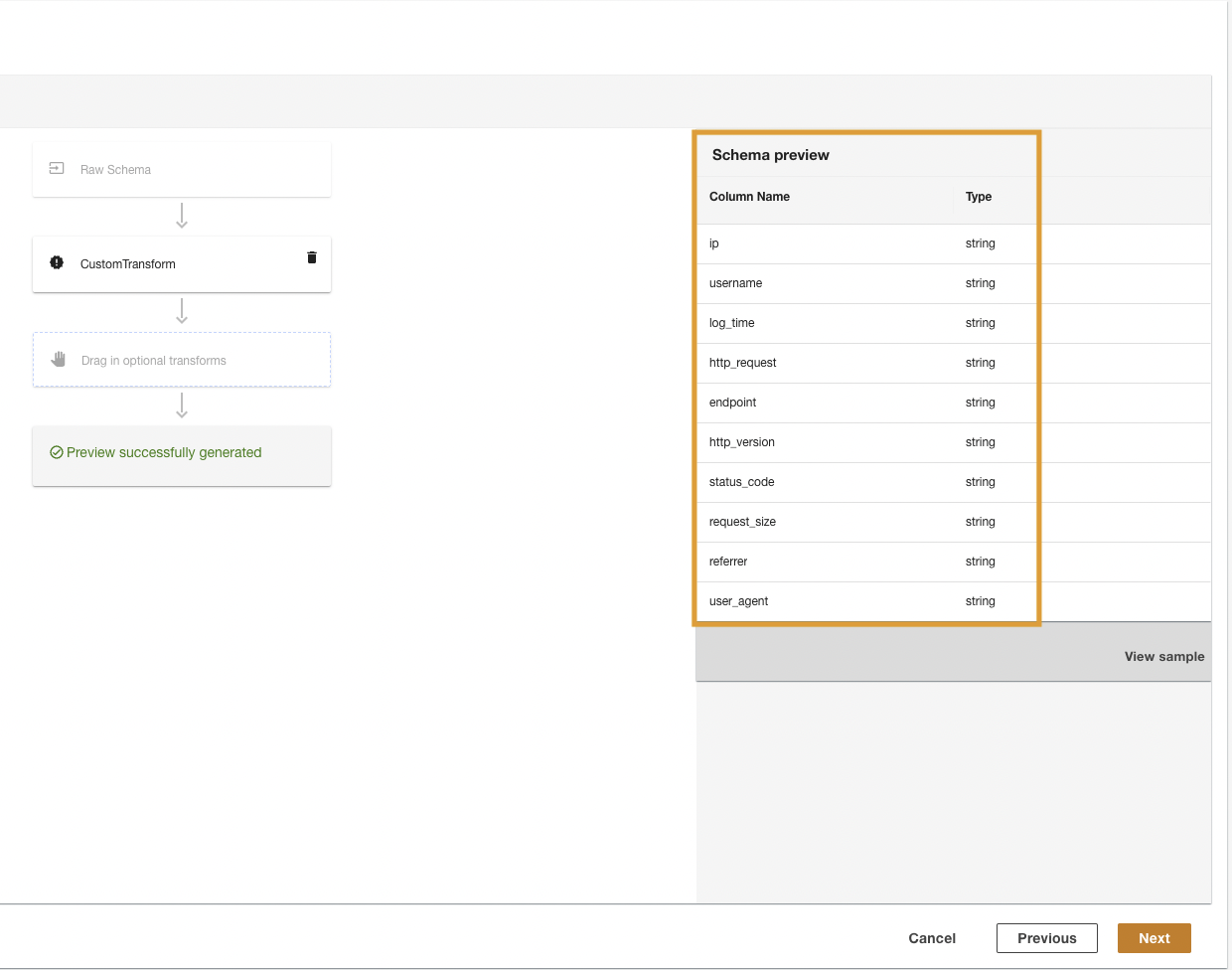

Daha sonra ADA, günlük grubuna bağlanacak ve şemayı sorgulayacaktır. Günlükler Apache Günlük Biçiminde olduğundan, belirli günlük alanlarında sorgular çalıştırabilmemiz için günlükleri ayrı alanlara dönüştürürüz. ADA dört sağlar varsayılan dönüştürmeler ve bir Python betiği aracılığıyla özel dönüştürmeyi destekler. Bu demoda, JSON mesaj alanını Apache Günlük Formatı alanlarına dönüştürmek için özel bir Python betiği çalıştırıyoruz.

- Klinik Şemayı dönüştür.

- Klinik Yeni dönüşüm oluştur.

- Yükle

apache-log-extractor-transform.pygelen komut dosyası/asset/transform_logs/klasör. - Klinik Gönder.

ADA, komut dosyasını kullanarak CloudWatch günlüklerini dönüştürecek ve işlenen şemayı sunacaktır.

- Klinik Sonraki.

- Son adımda, adımları gözden geçirin ve seçin Gönder.

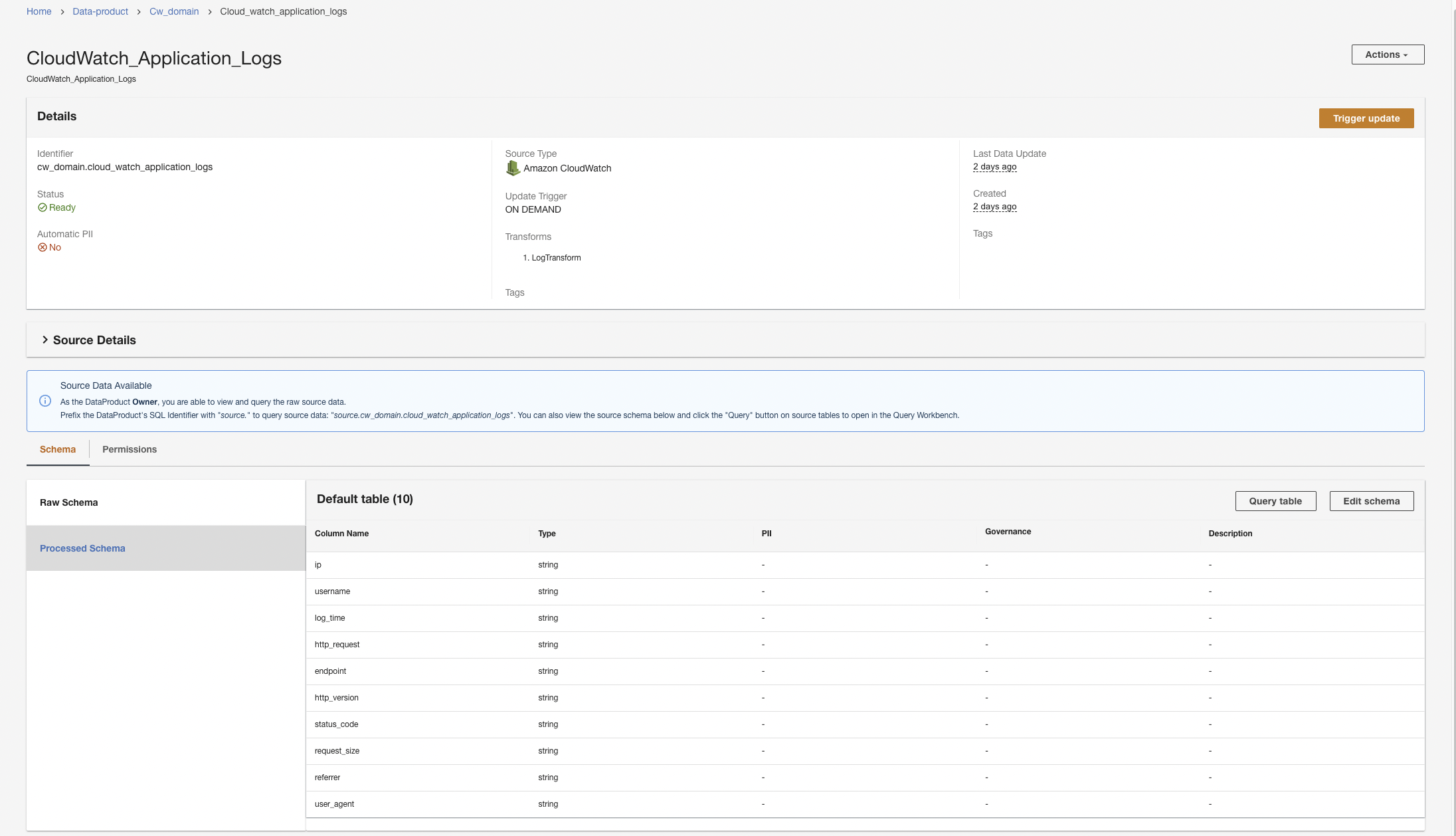

ADA veri işlemeyi başlatacak, veri ardışık düzenlerini oluşturacak ve Query Workbench'ten sorgulanacak CloudWatch günlük gruplarını hazırlayacaktır. Bu işlemin tamamlanması birkaç dakika sürecek ve ADA konsolunda aşağıda gösterilecektir. Veri Ürünleri.

Bir Amazon S3 veri ürünü oluşturun

Amazon S3 veri kaynağından geçmiş günlükleri eklemek ve DynamoDB tablosundan referans verileri aramak için adımları tekrarlıyoruz. Bu iki veri kaynağı için, veri biçimleri CSV (geçmiş günlükler için) ve anahtar nitelikler (referans arama verileri için) olduğundan, özel dönüşümler oluşturmuyoruz.

- ADA konsolunda yeni bir veri ürünü oluşturun.

- İsim girin (

hist_logs) ve Seç Amazon S3.

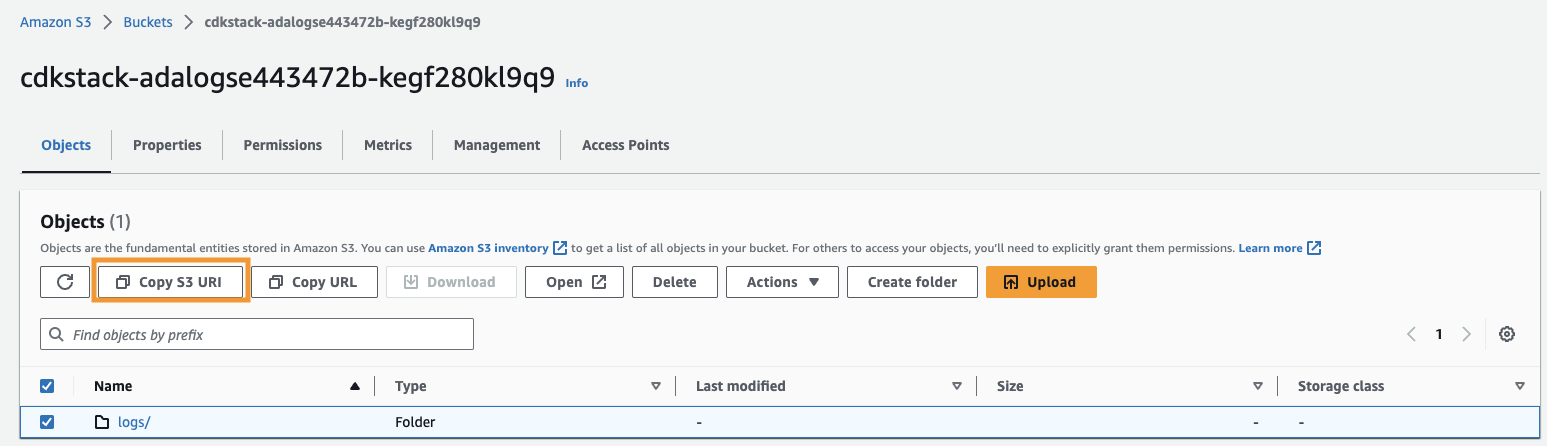

- Amazon S3 URI'sini kopyalayın (sonraki metin

arn:aws:s3:::) DenCdkStack.S3çıkış değişkenini seçin ve Amazon S3 konsoluna gidin. - Arama kutusuna kopyalanan metni girin, S3 klasörünü açın,

/logsklasörünü seçin ve S3 URI'sini Kopyala'yı seçin.

Tarihsel günlükler bu yolda depolanır.

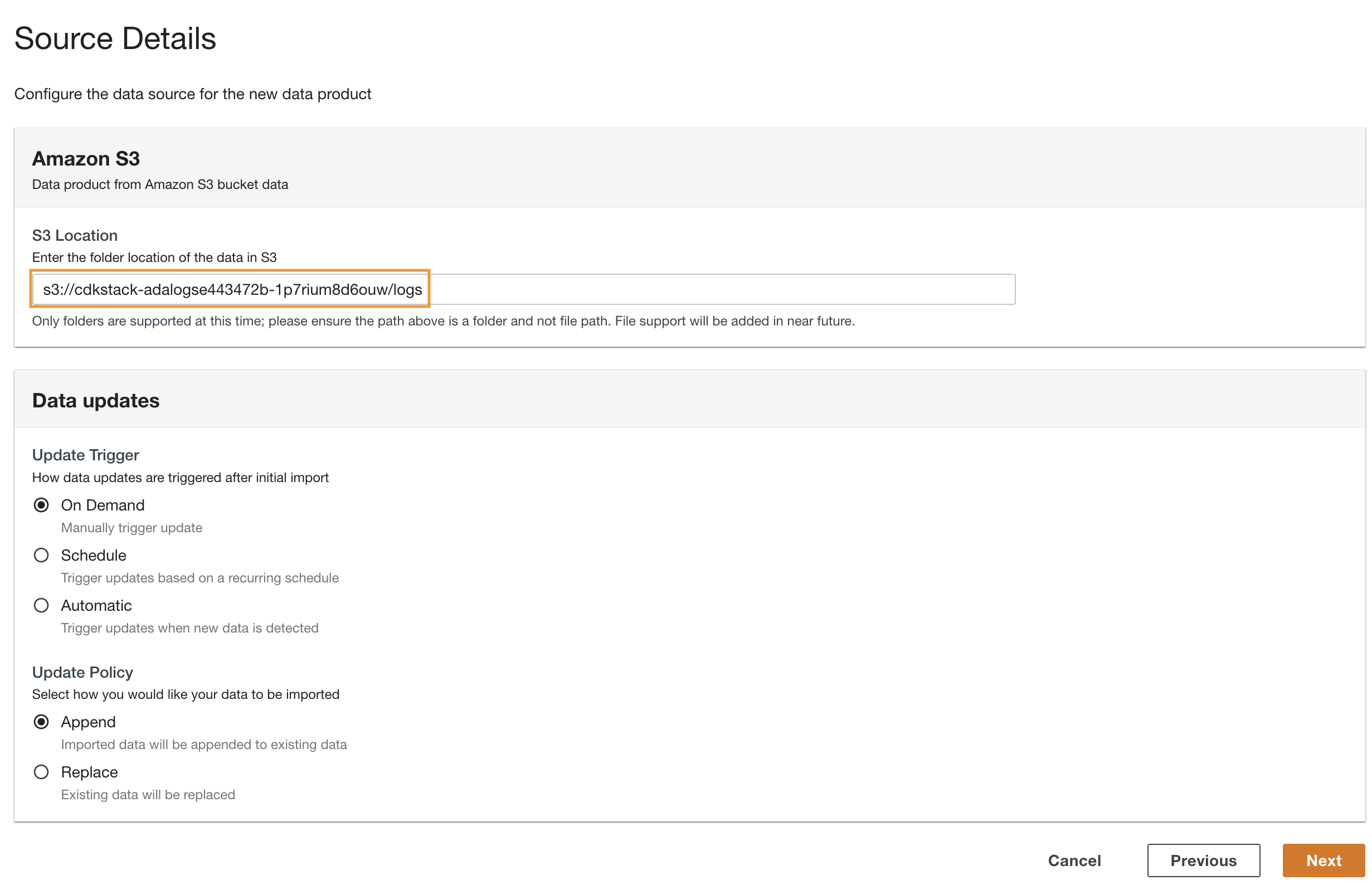

- ADA konsoluna geri gidin ve kopyalanan S3 URI'sini aşağıdakiler için girin: S3 konumu.

- İçin Tetikleyiciyi Güncelleseçin Talep üzerine çünkü tarihsel günlükler belirtilmemiş bir sıklıkta güncellenir.

- İçin Güncelleme Politikasıseçin eklemek yeni içe aktarılan verileri mevcut verilere eklemek için.

- Klinik Sonraki.

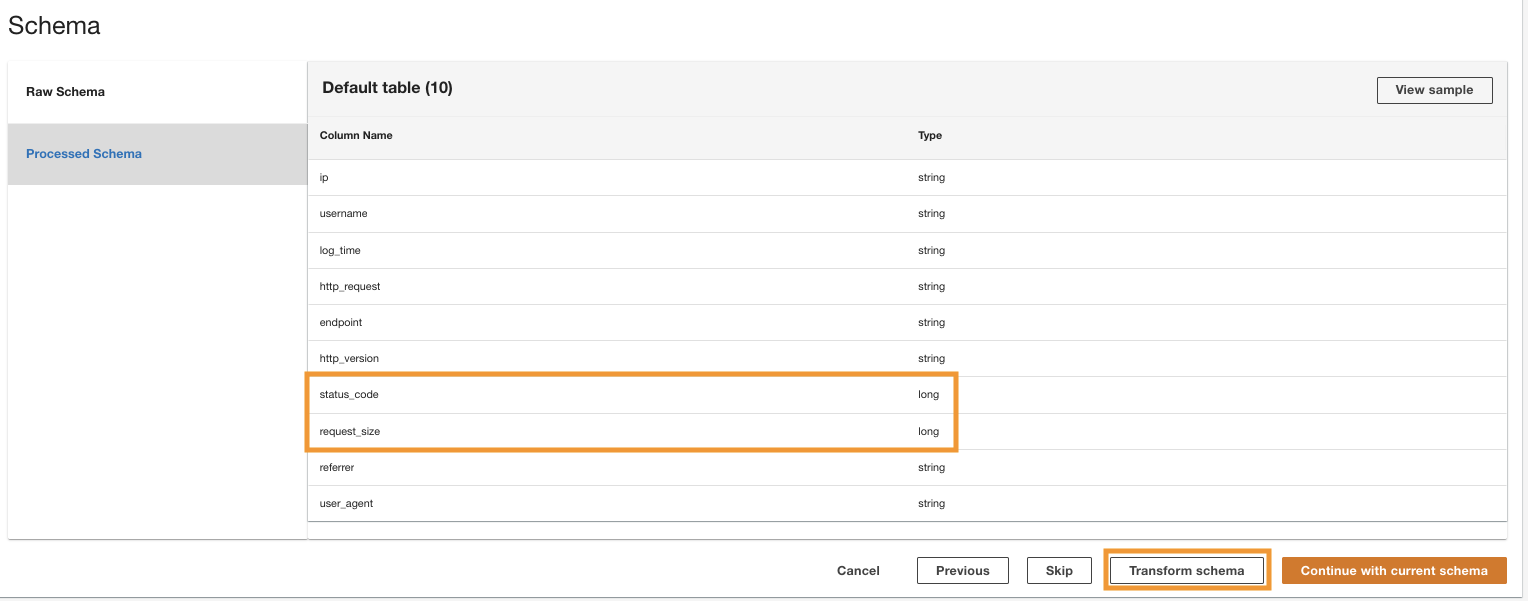

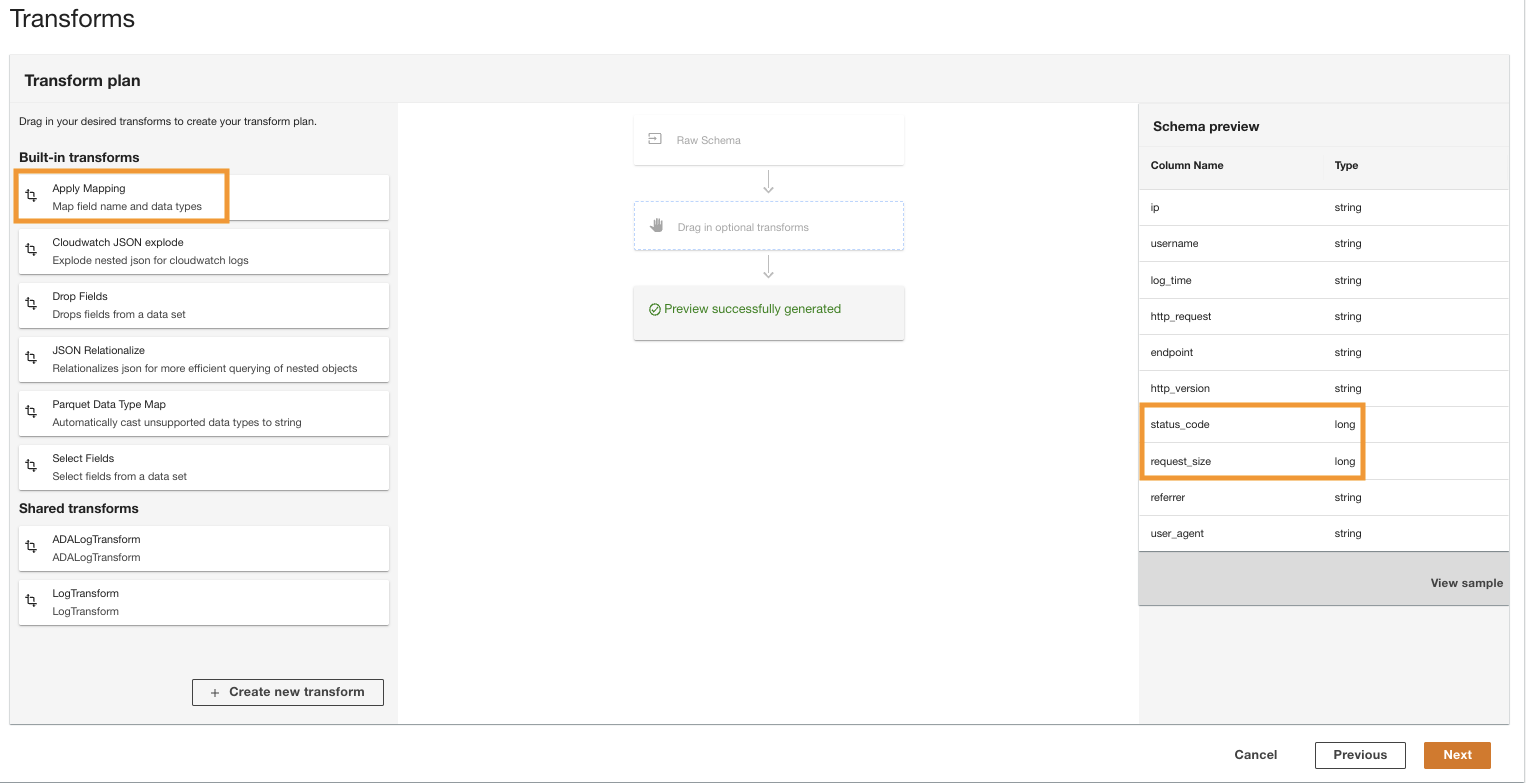

ADA, seçili klasör yolundaki dosyalar için şemayı işler. Günlükler CSV biçiminde olduğundan, ADA sütun adlarını ek dönüşümler gerektirmeden okuyabilir. Ancak, sütunlar status_code ve request_size ADA tarafından uzun tip olarak anlaşılır. Veri tablolarını birleştirip verileri sorgulayabilmemiz için sütun veri türlerini veri ürünleri arasında tutarlı tutmak istiyoruz. Sütun status_code veri tabloları arasında birleştirmeler oluşturmak için kullanılacaktır.

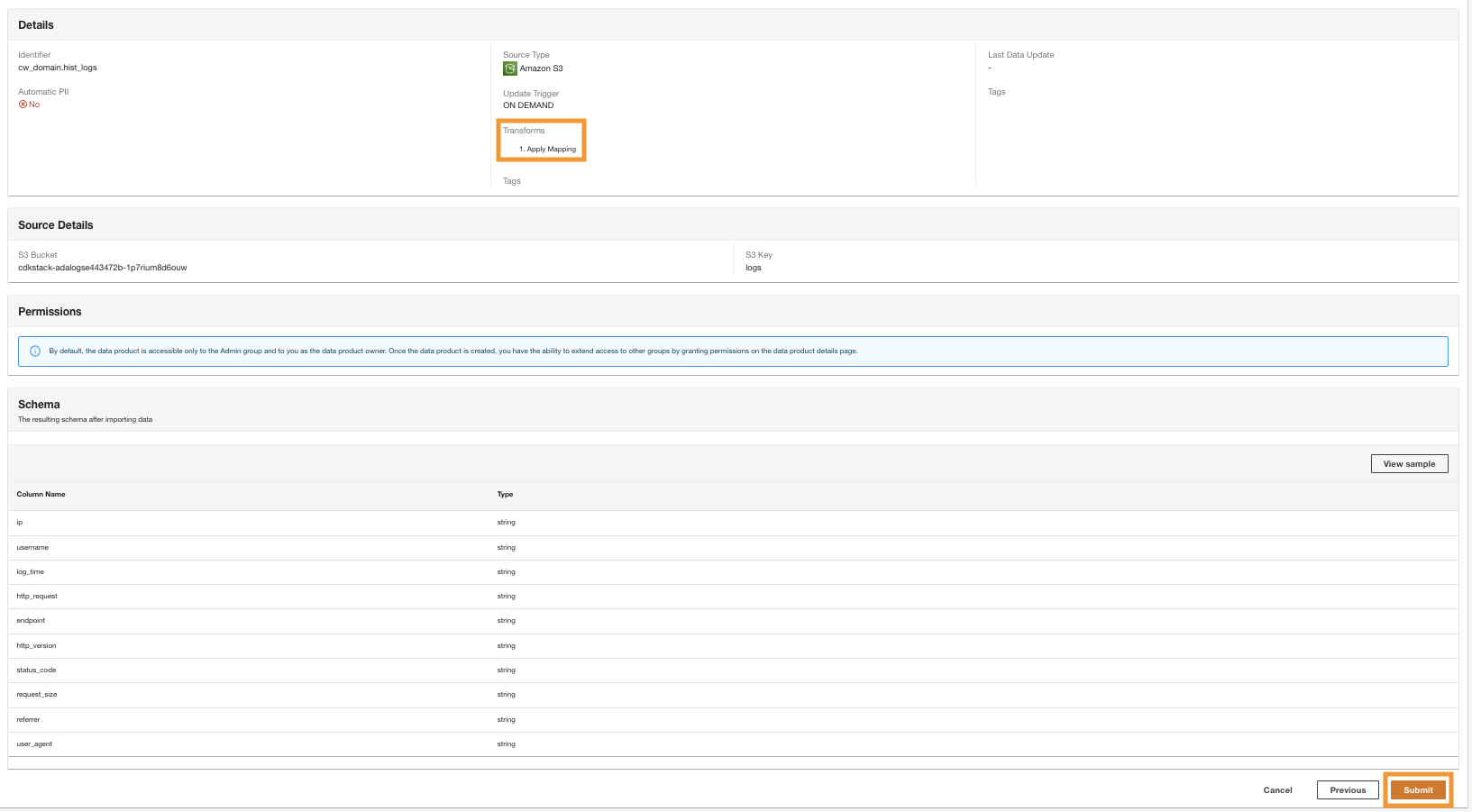

- Klinik Şemayı dönüştür iki sütunun veri türlerini dize veri türüne değiştirmek için.

Vurgulanan sütun adlarını not edin. Şema önizlemesi veri türü dönüşümlerini uygulamadan önce bölmesi.

- içinde Dönüşüm planı bölme, altında Yerleşik dönüşümler, seçmek Eşlemeyi Uygula.

Bu seçenek, veri türünü bir türden diğerine değiştirmenize olanak tanır.

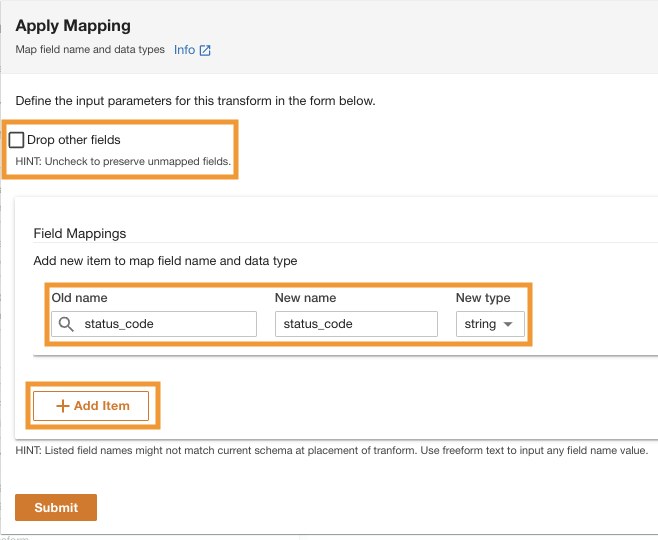

- içinde Eşlemeyi Uygula bölüm, seçimi kaldır Diğer alanları bırakın.

Bu seçenek devre dışı bırakılmazsa, yalnızca dönüştürülen sütunlar korunur ve diğer tüm sütunlar bırakılır. Tüm sütunları korumak istediğimiz için bu seçeneği devre dışı bırakıyoruz.

- Altında Alan Eşlemeleriiçin Eski ad ve Yeni isim, girmek

status_codeve için Yeni tip, girmekstring.

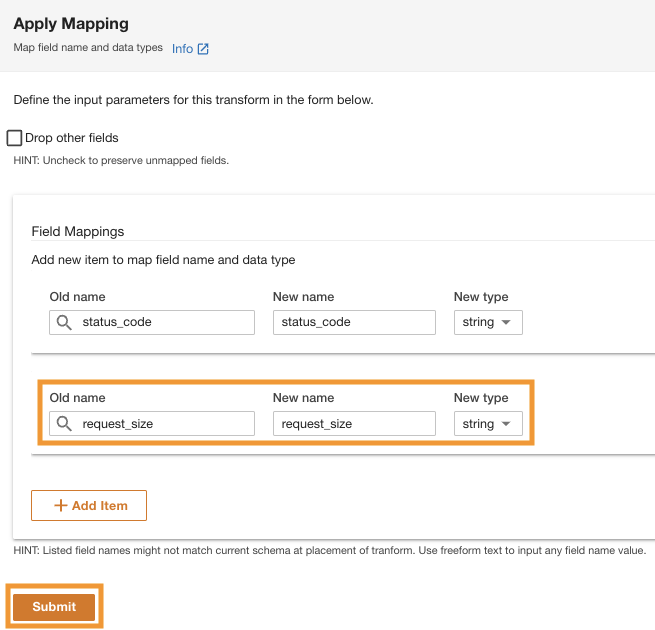

- Klinik Öğe eklemek.

- İçin Eski ad ve Yeni isim¸ request_size girin ve için Yeni veri türü, dizeyi girin.

- Klinik Gönder.

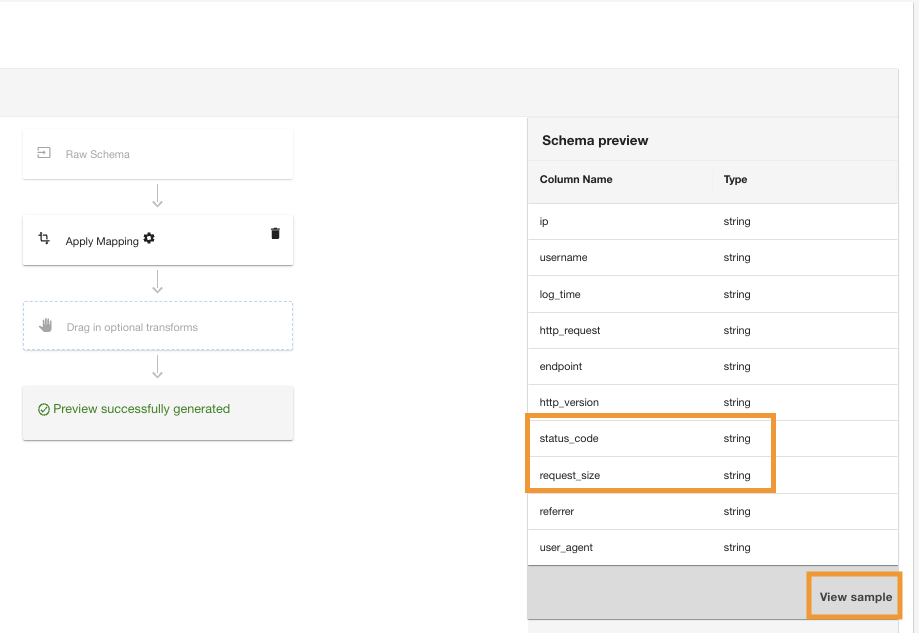

ADA, eşleme dönüşümünü Amazon S3 veri kaynağına uygulayacaktır. sütun türlerini not edin Şema önizlemesi bölmesi.

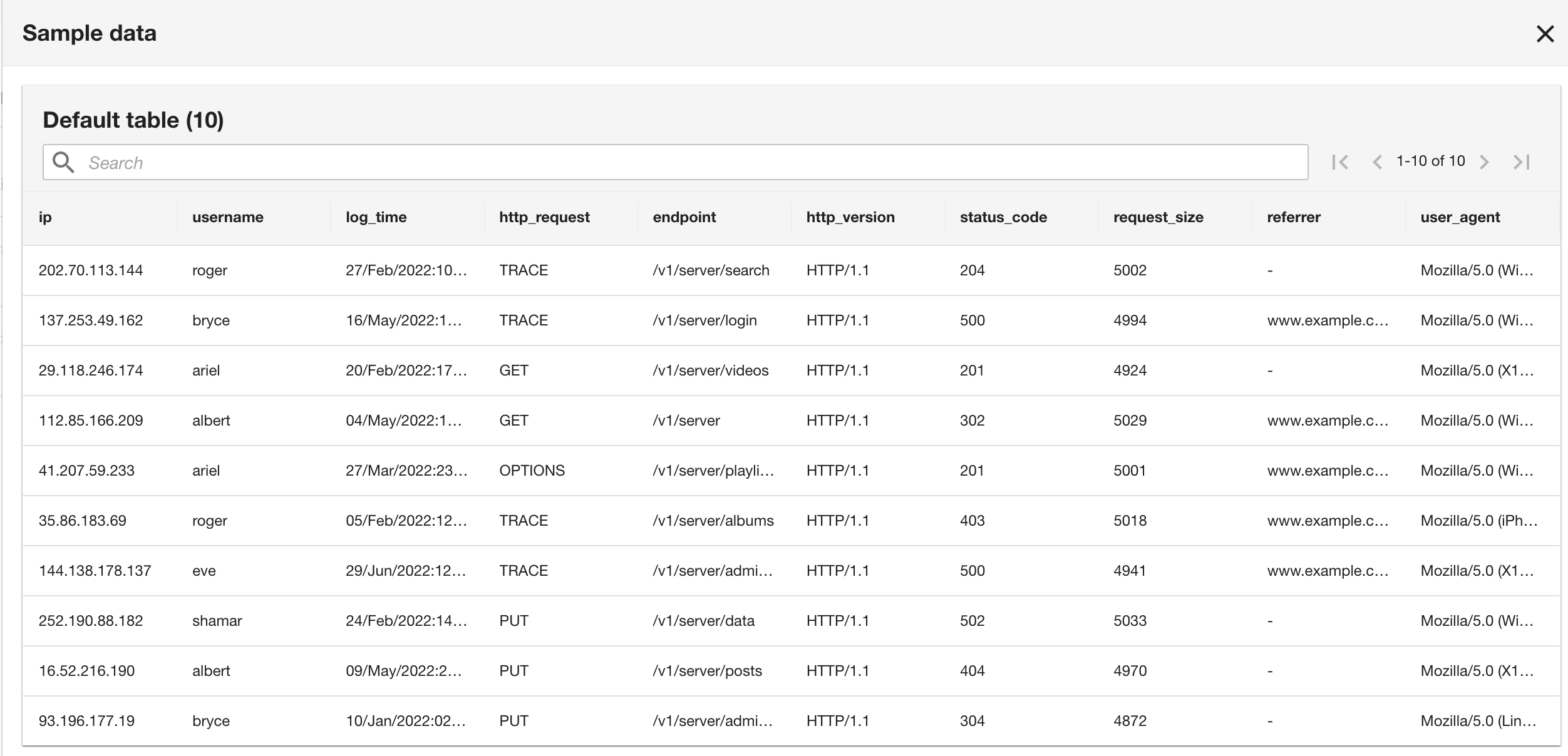

- Klinik Örneği görüntüle uygulanan dönüşümle verileri önizlemek için.

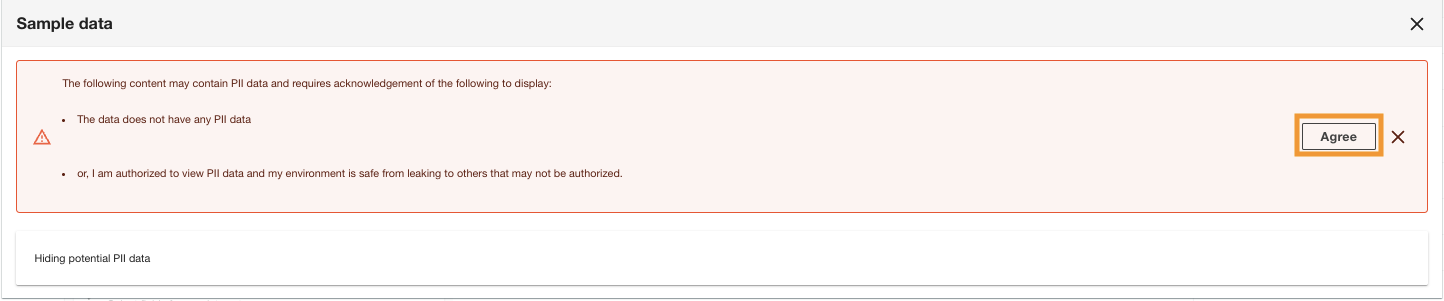

ADA, yalnızca yetkili kullanıcıların verileri görüntüleyebildiğinden veya veri setinin herhangi bir PII verisi içermediğinden emin olmak için PII veri onayını görüntüler.

- Klinik Katılıyorum örnek verileri görüntülemeye devam etmek için

Şemanın CloudWatch günlük grubu şemasıyla aynı olduğunu unutmayın çünkü hem geçerli uygulama hem de geçmiş uygulama günlükleri Apache Günlük Formatındadır.

- Son adımda, yapılandırmayı gözden geçirin ve seçin Gönder.

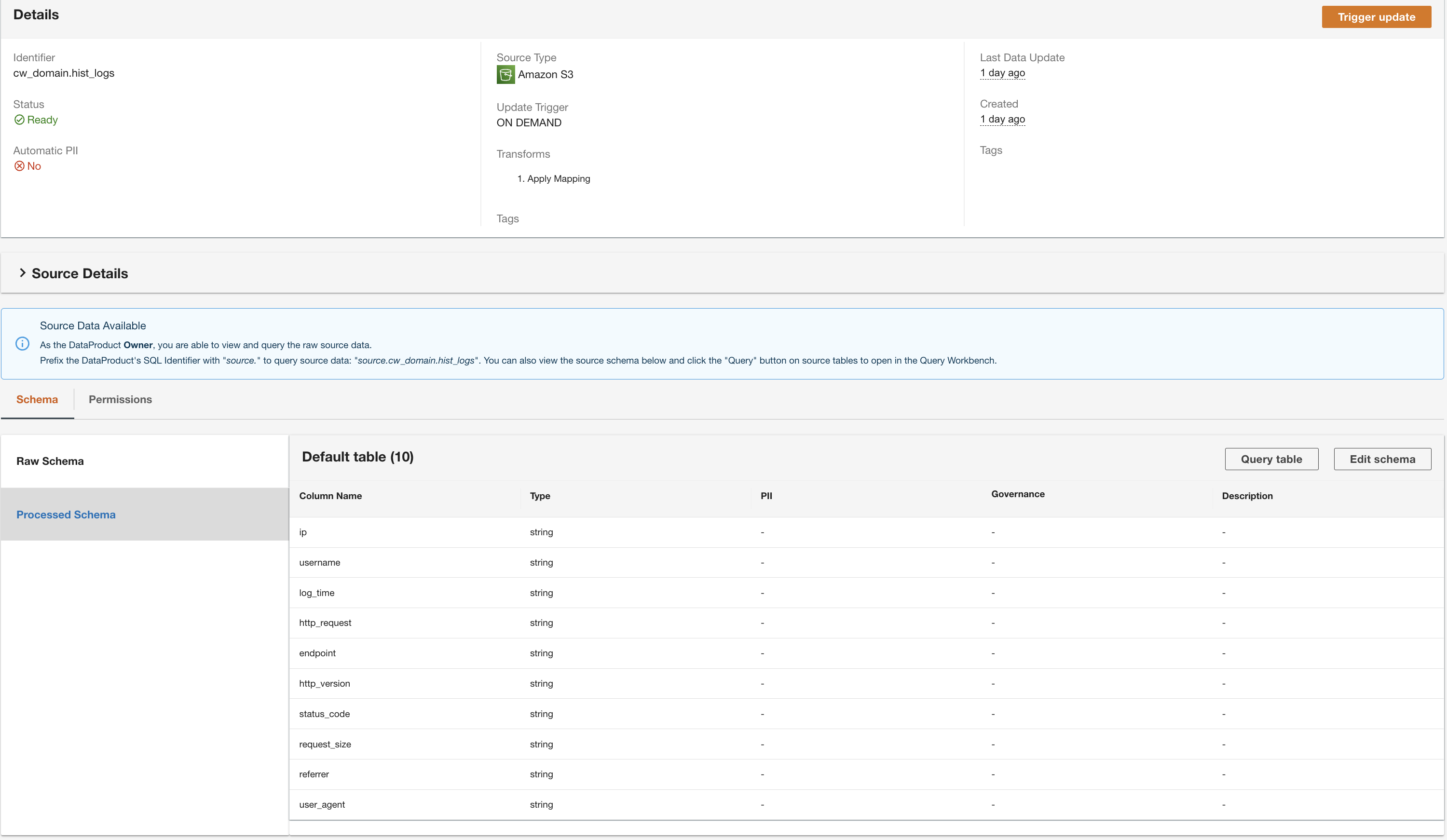

ADA, verileri Amazon S3 kaynağından işlemeye başlar, arka uç altyapısını oluşturur ve veri ürününü hazırlar. Bu işlem, verinin boyutuna bağlı olarak birkaç dakika sürer.

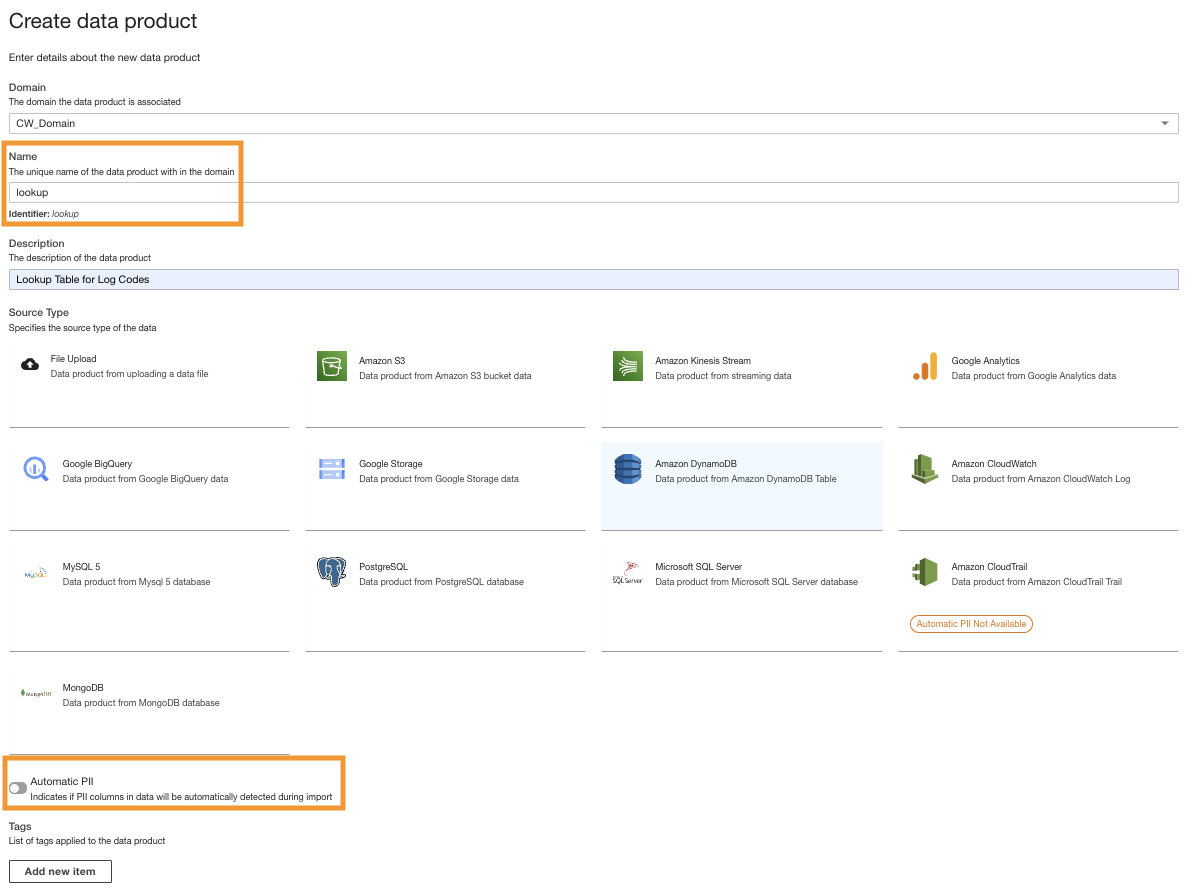

Bir DynamoDB veri ürünü oluşturun

Son olarak, bir DynamoDB veri ürünü oluşturuyoruz. Aşağıdaki adımları tamamlayın:

- ADA konsolunda yeni bir veri ürünü oluşturun.

- İsim girin (

lookup) ve Seç Amazon DinamoDB.

- Girin

Cdk.DynamoDBTableiçin çıkış değişkeni DynamoDB Tablosu ARN.

Bu tablo, bu demoda bir arama tablosu olarak kullanılacak temel nitelikleri içerir. Arama verileri için HTTP kodlarını ve kodların uzun ve kısa açıklamalarını kullanıyoruz. Alternatif olarak PostgreSQL, MySQL veya CSV dosya kaynağını da kullanabilirsiniz.

- İçin Tetikleyiciyi Güncelleseçin On-Demand.

Güncellemeler isteğe bağlı olacaktır çünkü arama çoğunlukla sorgulama sırasında referans amaçlıdır ve arama verilerindeki herhangi bir güncelleme, isteğe bağlı tetikleyiciler kullanılarak ADA'da güncellenebilir.

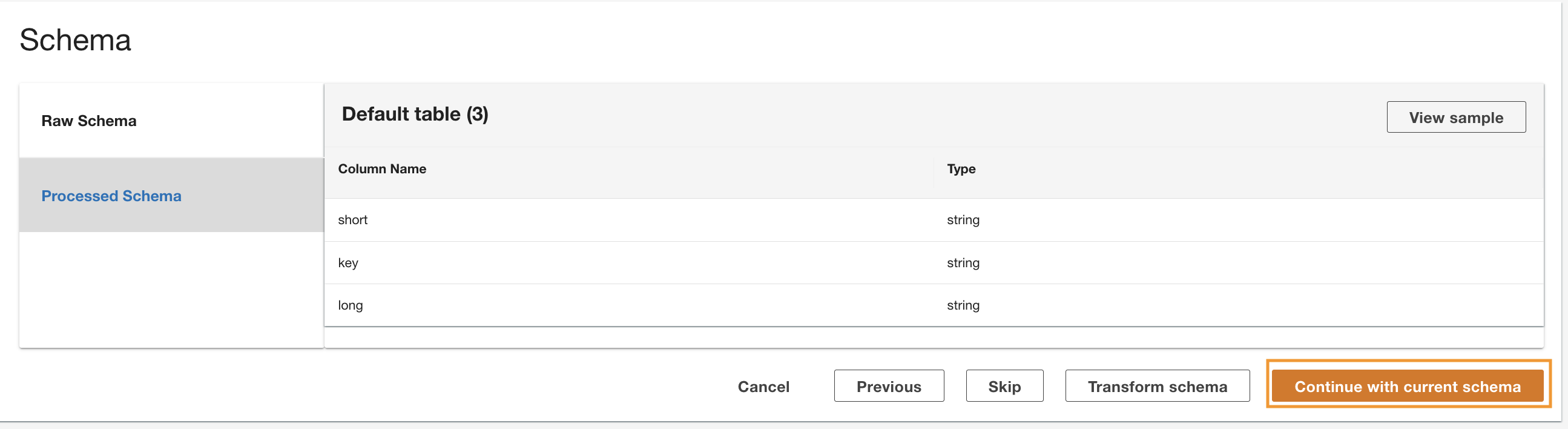

- Klinik Sonraki.

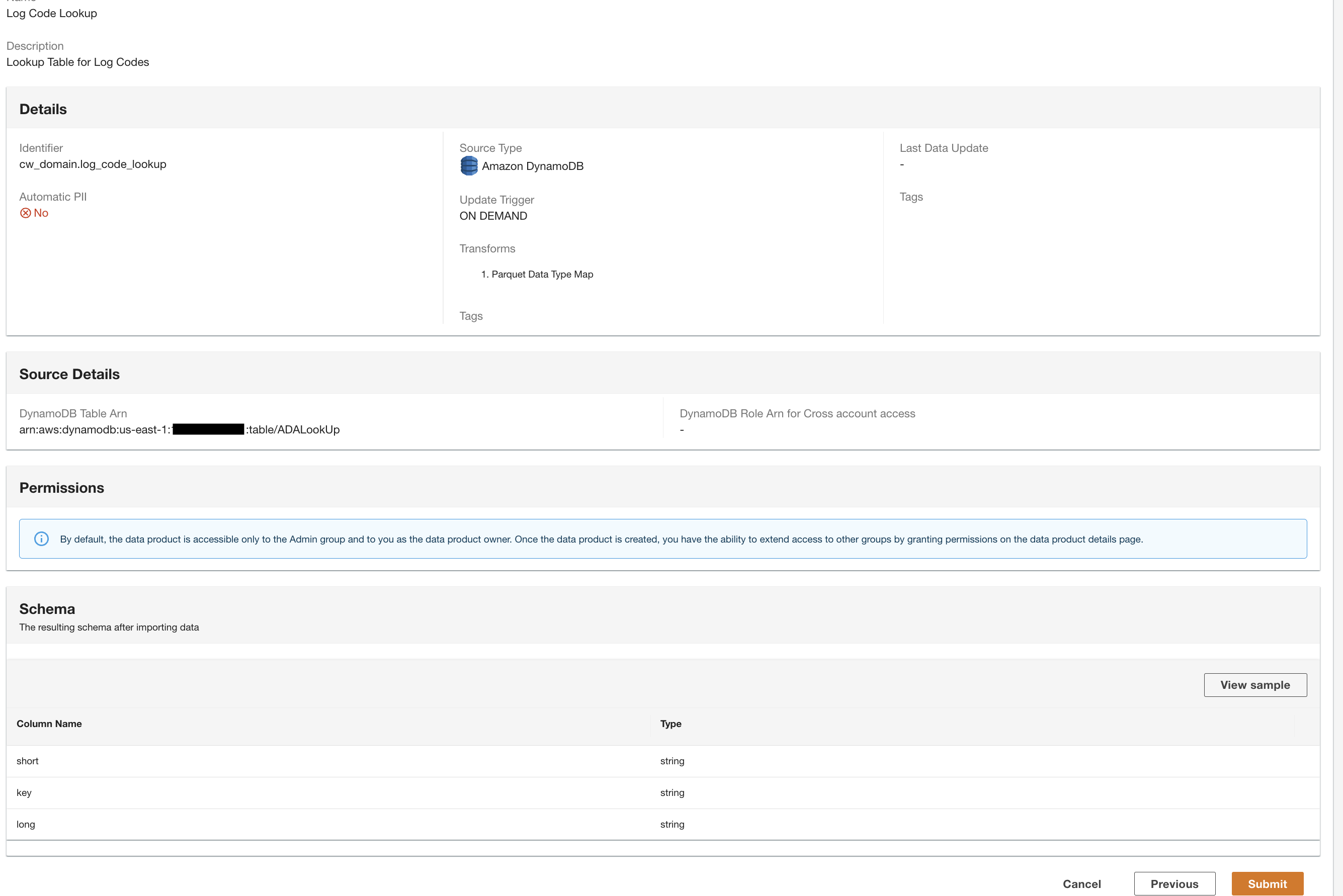

ADA, şemayı altta yatan DynamoDB şemasından okur ve isteğe bağlı dönüşüm için sütun adını ve türünü sunar. Sütun türleri CloudWatch günlük grubu ve Amazon S3 CSV veri kaynağındaki türlerle tutarlı olduğundan, varsayılan şema seçimiyle devam edeceğiz. Veri kaynaklarında tutarlı veri türlerine sahip olmak, sütun alanlarını kullanarak tabloları birleştirerek kayıtları getirmek için sorgular yazmamıza olanak tanır. Örneğin, sütun key DynamoDB şemasında şuna karşılık gelir: status_code Amazon S3 ve CloudWatch veri ürünlerinde. Sütun adını kullanarak üç tabloyu birleştirebilen sorgular yazabiliriz. key. Bir sonraki bölümde bir örnek gösterilmektedir.

- Klinik Mevcut şema ile devam et.

- Yapılandırmayı gözden geçirin ve seçin Gönder.

ADA, DynamoDB tablo veri kaynağındaki verileri işleyecek ve veri ürününü hazırlayacaktır. Verinin boyutuna bağlı olarak, bu işlem birkaç dakika sürer.

Artık ADA tarafından işlenen ve sorguları çalıştırmanız için hazır olan üç veri ürününe sahibiz.

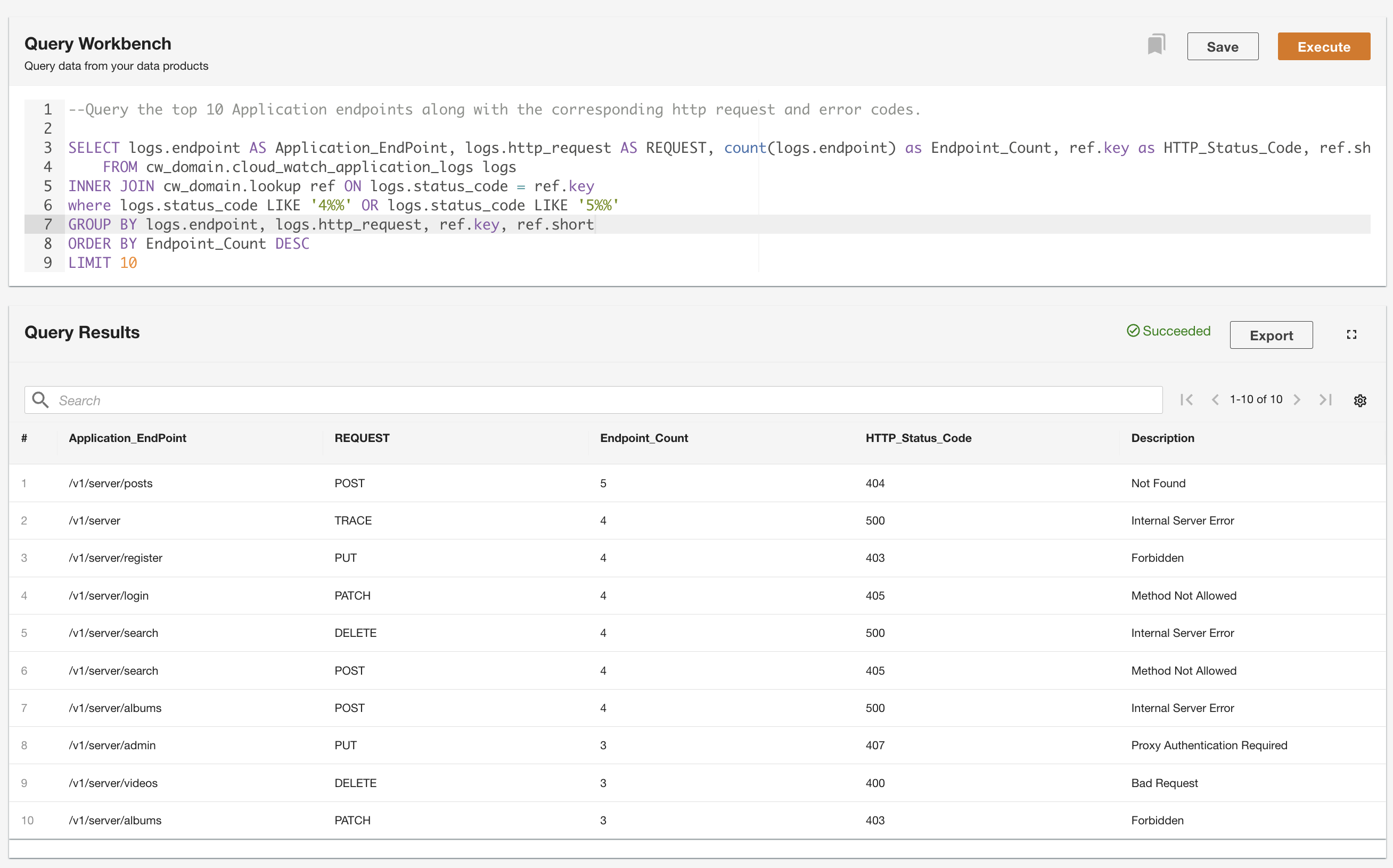

Verileri sorgulamak için Sorgu Workbench'ini kullanın

ADA, veri kaynağını soyutlarken ve SQL'i (Yapılandırılmış Sorgu Dili) kullanarak erişilebilir hale getirirken, veri ürünlerine karşı sorgular çalıştırmanıza olanak tanır. Tıpkı ilişkisel bir veritabanındaki tablolarda sorgu yaptığınız gibi sorgular yazabilir ve tabloları birleştirebilirsiniz. ADA'nın sorgulama yeteneğini iki kullanıcı senaryosu aracılığıyla gösteriyoruz. Her iki senaryoda da, bir uygulama günlüğü veri kümesini hata kodları arama tablosuna ekleriz. İlk kullanım durumunda, karşılık gelen HTTP durum kodlarıyla birlikte en çok erişilen ilk 10 uygulama uç noktasını belirlemek için mevcut uygulama günlüklerini sorgularız:

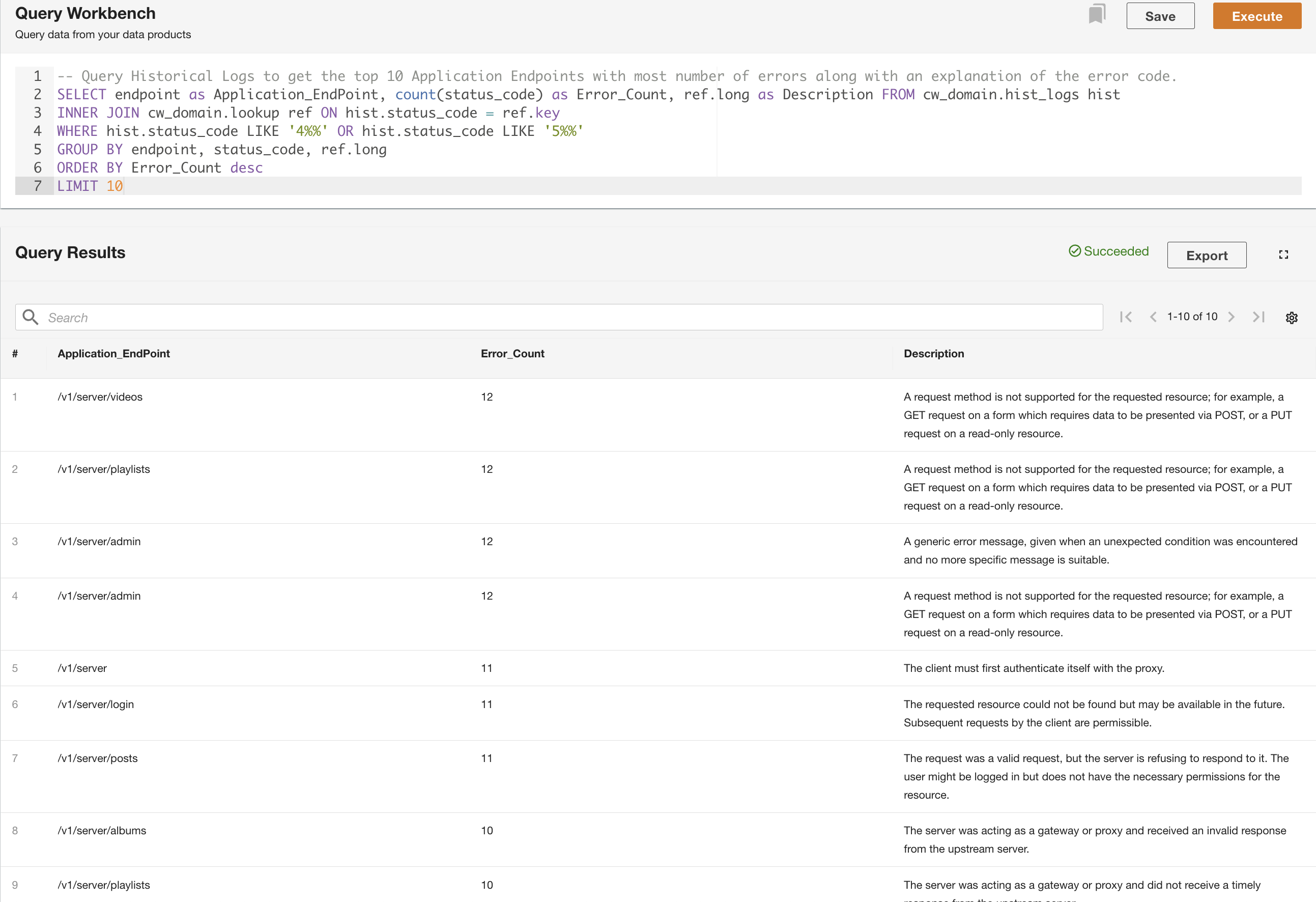

İkinci örnekte, uç nokta çağrı modelini anlamak için en fazla hataya sahip ilk 10 uygulama uç noktasını almak için geçmiş günlük tablosunu sorgularız:

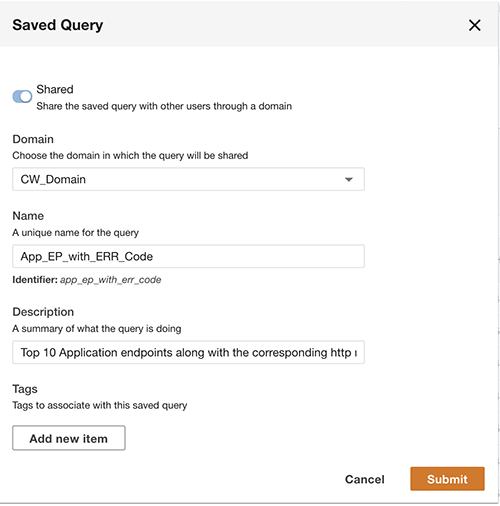

Sorgulamaya ek olarak, isteğe bağlı olarak sorguyu kaydedebilir ve kaydedilen sorguyu aynı etki alanındaki diğer kullanıcılarla paylaşabilirsiniz. Paylaşılan sorgulara doğrudan Sorgu Workbench'inden erişilebilir. Sorgu sonuçları ayrıca CSV biçiminde dışa aktarılabilir.

ADA veri ürünlerini Tableau'da görselleştirin

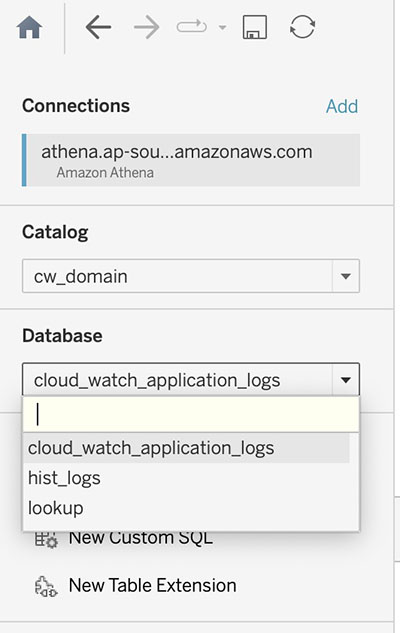

ADA yeteneği sunar bağlamak verileri görselleştirmek ve ADA veri ürünlerinden raporlar oluşturmak için üçüncü taraf BI araçlarına. Bu demoda, daha önce yapılandırdığımız üç veri ürününden gelen verileri görselleştirmek için ADA'nın Tableau ile yerel entegrasyonunu kullanıyoruz. Tableau'nun Athena bağlayıcısını kullanma ve içindeki adımları izleme Tablo yapılandırmasıADA'yı Tableau'da bir veri kaynağı olarak yapılandırabilirsiniz. Tableau ve ADA arasında başarılı bir bağlantı kurulduktan sonra Tableau, Tableau kataloğu altındaki üç veri ürününü dolduracaktır. cw_domain.

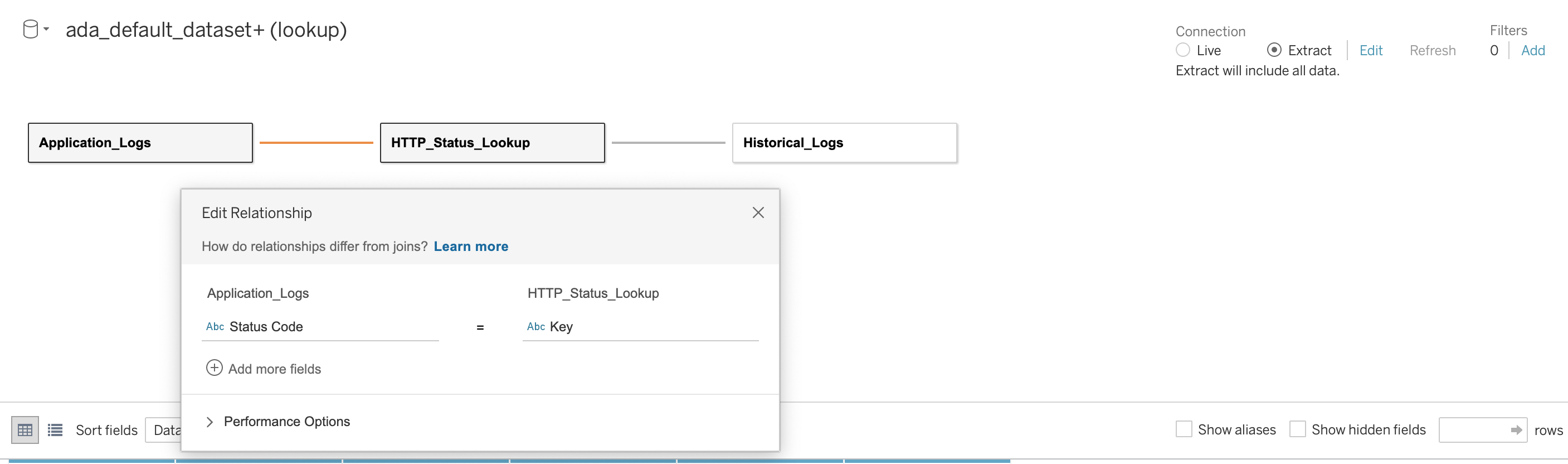

Ardından, aşağıdaki ekran görüntüsünde gösterildiği gibi, birleştirme sütunu olarak HTTP durum kodunu kullanarak üç veritabanı arasında bir ilişki kurarız. Tableau, veri kaynaklarıyla çevrimiçi ve çevrimdışı modda çalışmamızı sağlar. Çevrimiçi modda, Tableau ADA'ya bağlanacak ve veri ürünlerini canlı olarak sorgulayacaktır. Çevrimdışı modda, kullanabiliriz Çıkarmak ADA'dan verileri ayıklama ve Tableau'ya içe aktarma seçeneği. Bu demoda, sorgulamayı daha duyarlı hale getirmek için verileri Tableau'ya aktarıyoruz. Daha sonra Tableau çalışma kitabını kaydediyoruz. Veritabanını seçerek veri kaynaklarından gelen verileri inceleyebiliriz ve Şimdi Güncelle.

Tableau'daki veri kaynağı yapılandırmaları ile ADA veri ürünlerinde özel raporlar, çizelgeler ve görselleştirmeler oluşturabiliriz. Görselleştirmeler için iki kullanım durumunu ele alalım.

Aşağıdaki şekilde gösterildiği gibi, Tableau'nun yerleşik özelliğini kullanarak uygulama uç noktalarına göre HTTP hatalarının sıklığını görselleştirdik. sıcaklık haritası çizelge. HTTP durum kodlarını yalnızca 4xx ve 5xx aralığındaki hata kodlarını içerecek şekilde filtreledik.

Ayrıca, HTTP hata kodlarının sayısına göre sıralanan geçmiş günlüklerinden uygulama uç noktalarını göstermek için bir çubuk grafik oluşturduk. Bu çizelgede şunu görebiliriz ki, /v1/server/admin uç nokta, çoğu HTTP hata durum kodunu oluşturdu.

Temizlemek

Örnek uygulama altyapısının temizlenmesi iki aşamalı bir işlemdir. Öncelikle, bu tanıtımın amaçları doğrultusunda sağlanan altyapıyı kaldırmak için terminalde aşağıdaki komutu çalıştırın:

Aşağıdaki soru için y girin ve AWS CDK demo için dağıtılan kaynakları siler:

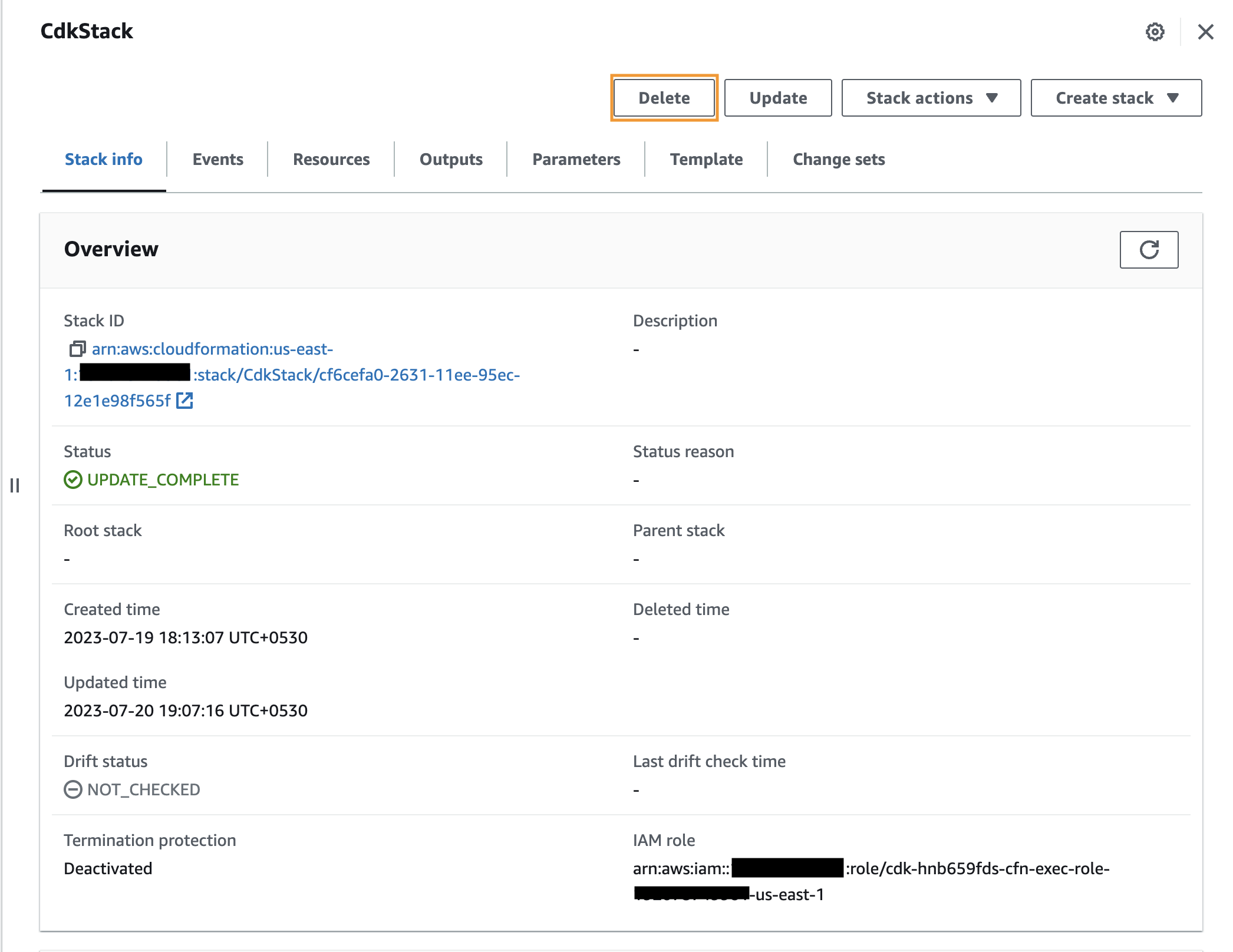

Alternatif olarak, CdkStack yığınına giderek ve AWS CloudFormation konsolu aracılığıyla kaynakları kaldırabilirsiniz. Sil.

İkinci adım, ADA'yı kaldırmaktır. Talimatlar için bkz. Çözümü kaldır.

Sonuç

Bu gönderide, iki farklı veri kaynağında depolanan uygulama günlüklerinden içgörü elde etmek için ADA çözümünün nasıl kullanılacağını gösterdik. Bir AWS hesabına ADA'nın nasıl kurulacağını ve AWS CDK kullanılarak demo bileşenlerinin nasıl dağıtılacağını gösterdik. ADA'da veri ürünleri oluşturduk ve veri ürünlerini, ADA'nın yerleşik veri konektörlerini kullanarak ilgili veri kaynaklarıyla yapılandırdık. Standart SQL sorgularını kullanarak veri ürünlerini nasıl sorgulayacağımızı ve günlük verileri hakkında içgörüler oluşturacağımızı gösterdik. Ayrıca üçüncü taraf bir BI ürünü olan Tableau Desktop istemcisini ADA'ya bağladık ve veri ürünlerine karşı görselleştirmelerin nasıl oluşturulacağını gösterdik.

ADA, çeşitli veri kümelerini alma, dönüştürme, yönetme ve sorgulama sürecini otomatikleştirir ve verilerin yaşam döngüsü yönetimini basitleştirir. ADA'nın önceden oluşturulmuş bağlayıcıları, çeşitli veri kaynaklarından veri almanızı sağlar. AWS ürünleri ve hizmetleri hakkında temel bilgiye sahip yazılım ekipleri, birkaç saat içinde operasyonel bir veri analitiği platformu kurabilecek ve verilere güvenli erişim sağlayabilecek. Veriler daha sonra sezgisel ve bağımsız bir web kullanıcı arabirimi kullanılarak kolay ve hızlı bir şekilde sorgulanabilir.

Verileri kolayca yönetmek ve içgörüler elde etmek için bugün ADA'yı deneyin.

yazarlar hakkında

Aparajithan Vaidyanathan AWS'de Baş Kurumsal Çözümler Mimarıdır. Kurumsal müşterilerin iş yüklerini AWS bulutuna taşımasını ve modernleştirmesini destekler. Kurumsal, büyük ölçekli ve dağıtık yazılım sistemleri tasarlama ve geliştirme konusunda 23 yılı aşkın deneyime sahip bir Bulut Mimarıdır. Veri ve Özellik Mühendisliği alanına odaklanarak Makine Öğrenimi ve Veri Analitiği konusunda uzmanlaşmıştır. Gelecek vadeden bir maraton koşucusu ve hobileri arasında yürüyüş yapmak, bisiklete binmek ve karısı ve iki oğluyla vakit geçirmek yer alıyor.

Aparajithan Vaidyanathan AWS'de Baş Kurumsal Çözümler Mimarıdır. Kurumsal müşterilerin iş yüklerini AWS bulutuna taşımasını ve modernleştirmesini destekler. Kurumsal, büyük ölçekli ve dağıtık yazılım sistemleri tasarlama ve geliştirme konusunda 23 yılı aşkın deneyime sahip bir Bulut Mimarıdır. Veri ve Özellik Mühendisliği alanına odaklanarak Makine Öğrenimi ve Veri Analitiği konusunda uzmanlaşmıştır. Gelecek vadeden bir maraton koşucusu ve hobileri arasında yürüyüş yapmak, bisiklete binmek ve karısı ve iki oğluyla vakit geçirmek yer alıyor.

Rasim Rahman yazılım geliştirme ve mimaride 10 yılı aşkın deneyime sahip, Sidney, Avustralya merkezli bir Yazılım Geliştiricisidir. Öncelikli olarak yaygın müşteri kullanım durumları ve iş sorunları için büyük ölçekli açık kaynaklı AWS çözümleri oluşturmaya çalışıyor. Boş zamanlarında spor yapmaktan ve arkadaşları ve ailesiyle vakit geçirmekten hoşlanır.

Rasim Rahman yazılım geliştirme ve mimaride 10 yılı aşkın deneyime sahip, Sidney, Avustralya merkezli bir Yazılım Geliştiricisidir. Öncelikli olarak yaygın müşteri kullanım durumları ve iş sorunları için büyük ölçekli açık kaynaklı AWS çözümleri oluşturmaya çalışıyor. Boş zamanlarında spor yapmaktan ve arkadaşları ve ailesiyle vakit geçirmekten hoşlanır.

Hafız Saadullah Amazon Web Services'ta Baş Teknik Ürün Yöneticisidir. Hafiz, yaygın iş sorunlarını ve kullanım örneklerini ele alarak müşterilere yardımcı olmak için tasarlanmış AWS Çözümlerine odaklanır.

Hafız Saadullah Amazon Web Services'ta Baş Teknik Ürün Yöneticisidir. Hafiz, yaygın iş sorunlarını ve kullanım örneklerini ele alarak müşterilere yardımcı olmak için tasarlanmış AWS Çözümlerine odaklanır.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. Otomotiv / EV'ler, karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- ChartPrime. Ticaret Oyununuzu ChartPrime ile yükseltin. Buradan Erişin.

- Blok Ofsetleri. Çevre Dengeleme Sahipliğini Modernleştirme. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/big-data/derive-operational-insights-from-application-logs-using-automated-data-analytics-on-aws/

- :vardır

- :dır-dir

- :olumsuzluk

- :Neresi

- $UP

- 10

- 11

- 12

- 14

- %15

- 16

- 160

- 17

- 2021

- 3000

- 500

- 7

- 8

- 9

- a

- kabiliyet

- Yapabilmek

- Hakkımızda

- erişim

- erişilen

- ulaşılabilir

- Hesap

- karşısında

- eylemler

- ADA

- eklemek

- ilave

- Ek

- adresleme

- Gizem

- Sonra

- karşı

- Türkiye

- izin vermek

- veriyor

- boyunca

- Ayrıca

- alternatif

- Amazon

- Amazon Web Servisleri

- arasında

- an

- analiz

- Analistler

- analytics

- çözümlemek

- ve

- Başka

- herhangi

- Apache

- api

- API'ler

- Uygulama

- uygulamaları

- uygulamalı

- Tamam

- Uygulanması

- mimari

- ARE

- AS

- can atan

- At

- öznitelikleri

- Avustralya

- Doğrulama

- yetkili

- Otomatik

- otomata

- otomatik olarak

- mevcut

- AWS

- AWS CloudFormation

- Arka

- Backend

- bar

- merkezli

- temel

- BE

- Çünkü

- olmuştur

- önce

- ısmarlama

- arasında

- her ikisi de

- kutu

- inşa etmek

- bina

- yerleşik

- iş

- iş zekası

- fakat

- by

- çağrı

- CAN

- kabiliyet

- dava

- durumlarda

- katalog

- CD

- değişiklik

- Grafik

- Grafikler

- Klinik

- seçme

- müşteri

- bulut

- kod

- kodları

- Toplamak

- Sütun

- Sütunlar

- ortak

- tamamlamak

- bileşenler

- yapılandırma

- yapılandırılmış

- Sosyal medya

- bağlı

- bağ

- bağlanır

- Düşünmek

- tutarlı

- konsolos

- içeren

- devam etmek

- korelasyon

- Ilişki

- uyan

- tekabül

- Ücret

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- oluşturur

- Oluşturma

- Tanıtım

- akım

- görenek

- müşteri

- Müşteriler

- gösterge paneli

- veri

- Veri Analizi

- veri işleme

- veritabanı

- veritabanları

- veri kümeleri

- Varsayılan

- Talep

- Gösteri

- göstermek

- gösterdi

- bağlı

- dağıtmak

- konuşlandırılmış

- açılma

- dağıtır

- tanım

- tasarlanmış

- tasarım

- masaüstü

- detaylı

- ayrıntılar

- Geliştirici

- gelişen

- gelişme

- tanı

- farklı

- direkt olarak

- özürlü

- keşif

- ekran

- dağıtıldı

- çeşitli

- Değil

- domain

- etki

- Dont

- düştü

- sırasında

- her

- Daha erken

- kolayca

- kurgu

- ya

- E-posta

- etkin

- sağlar

- Son nokta

- son noktalar

- Mühendislik

- sağlamak

- Keşfet

- kuruluş

- kurumsal müşteriler

- Kurumsal Çözümler

- hata

- Hatalar

- kurmak

- kurulmuş

- Eter (ETH)

- örnek

- mevcut

- deneyim

- Açıklamak

- açıklama

- çıkarmak

- veriyi çıkar

- tanıdık

- aile

- Özellikler(Hazırlık aşamasında)

- az

- alan

- Alanlar

- şekil

- fileto

- dosyalar

- son

- maliye

- Ad

- esnek

- odak

- odaklanır

- takip etme

- İçin

- biçim

- dört

- Sıklık

- arkadaşlar

- itibaren

- işlev

- Kazanç

- oluşturmak

- oluşturulan

- almak

- alma

- yöneten

- grup

- Grubun

- Var

- sahip olan

- he

- yardım et

- Vurgulanan

- yürüyüş

- onun

- tarihsel

- Hobiler

- ev sahipliği yaptı

- SAAT

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTML

- http

- HTTPS

- IAM

- özdeş

- belirlemek

- Kimlik

- if

- ithalat

- in

- dahil

- içerir

- Dahil olmak üzere

- bilgi

- Altyapı

- ilk

- anlayışlar

- kurmak

- Kurulum

- talimatlar

- entegre

- bütünleşme

- İstihbarat

- interaktif

- ilgili

- arayüzey

- içine

- sezgisel

- çağırır

- ilgili

- konu

- IT

- kaydol

- birleştirme

- Katıldı

- jpg

- json

- sadece

- tutmak

- anahtar

- bilgi

- dil

- büyük

- büyük ölçekli

- Soyad

- sonra

- fırlatma

- öğrenme

- Kütüphane

- ruhsatlı

- yaşam döngüsü

- sevmek

- LİMİT

- çizgi

- Liste

- yaşamak

- log

- günlüğü

- Uzun

- Bakın

- arama

- makine

- makine öğrenme

- yapmak

- Yapımı

- yönetmek

- yönetim

- müdür

- çok

- harita

- haritalama

- Maraton

- Pazarlama

- Mesele

- anlamlı

- mesaj

- MFA

- olabilir

- göç

- dakika

- Moda

- modernleştirmek

- Daha

- çoğu

- çoğunlukla

- mozilla

- çok faktörlü kimlik doğrulama

- MySQL

- isim

- adlı

- isimleri

- yerli

- Gezin

- gezinme

- Navigasyon

- gerek

- gerekli

- ihtiyaçlar

- yeni

- yeni

- sonraki

- numara

- of

- Teklifler

- çevrimdışı

- Eski

- on

- On-Demand

- ONE

- Online

- bir tek

- açık

- açık kaynak

- işletme

- seçenek

- or

- sipariş

- Diğer

- Diğer

- dışarı

- çıktı

- genel bakış

- Kanal

- bölmesi

- Şifre

- yol

- model

- yapmak

- izinleri

- Şahsen

- telefon

- pii

- boru hattı

- yer

- Sade

- plan

- platform

- Platon

- Plato Veri Zekası

- PlatoVeri

- politikaları

- Portal

- Çivi

- postgreSQL

- powered

- Hazırlamak

- hazırlar

- önkoşullar

- mevcut

- hediyeler

- Önizleme

- önceki

- öncelikle

- Anapara

- Önceki

- sorunlar

- devam etmek

- süreç

- işlenmiş

- Süreçler

- işleme

- Üretilmiş

- PLATFORM

- ürün müdürü

- Ürünler

- Ürünler ve servisler

- Programlar

- proje

- sağlamak

- sağlanan

- sağlayan

- sağlar

- amaç

- amaçlı

- Python

- sorgular

- soru

- hızla

- menzil

- Okumak

- hazır

- teslim almak

- kayıtlar

- Referans

- bölge

- ilişki

- uygun

- Kaldır

- tekrar et

- Raporlar

- talep

- gereklidir

- Kaynaklar

- bu

- duyarlı

- Sonuçlar

- tutmak

- yorum

- binicilik

- rolleri

- kök

- Kural

- koşmak

- koşucu

- koşu

- satış

- aynı

- İndirim

- ölçek

- senaryolar

- tarifeli

- kapsam

- Ara

- İkinci

- Bölüm

- güvenli

- güvenlik

- görmek

- seçilmiş

- seçim

- göndermek

- gönderdi

- ayrı

- hizmet vermek

- Serverless

- hizmet

- Hizmetler

- set

- ayar

- paylaş

- Paylaşılan

- kısa

- gösterilen

- Gösteriler

- Basit

- basitleştirilmiş

- basitleştirilmesi

- beden

- becerileri

- So

- Yazılım

- yazılım geliştirme

- çözüm

- Çözümler

- Kaynak

- kaynaklar

- uzman

- uzmanlaşmış

- özel

- Belirtilen

- Harcama

- Spor

- SQL

- yığın

- bağımsız

- standart

- başlama

- başlar

- Durum

- adım

- Basamaklar

- hafızası

- saklı

- dizi

- yapılandırılmış

- başarılı

- Başarılı olarak

- böyle

- Destekler

- elbette

- sydney

- Sistemler

- tablo

- Tablo

- Bizi daha iyi tanımak için

- alır

- takım

- takım

- Teknik

- teknik beceriler

- terminal

- o

- The

- Kaynak

- ve bazı Asya

- sonra

- Orada.

- Bunlar

- üçüncü şahıslara ait

- Re-Tweet

- üç

- İçinden

- zaman

- için

- bugün

- araçlar

- üst

- Üst 10

- Toplam

- Dönüştürmek

- Dönüşüm

- dönüşümler

- transforme

- dönüşüm

- dönüşümler

- tetiklenir

- iki

- tip

- türleri

- altında

- altında yatan

- anlamak

- güncellenmiş

- Güncellemeler

- üzerine

- URI

- us

- kullanım

- kullanım durumu

- Kullanılmış

- kullanıcı

- Kullanıcı Arayüzü

- kullanıcılar

- kullanma

- Değerler

- değişken

- çeşitlilik

- versiyon

- üzerinden

- Görüntüle

- istemek

- Yol..

- we

- ağ

- web hizmetleri

- İYİ

- ne zaman

- hangi

- süre

- geniş

- Geniş ürün yelpazesi

- eş

- irade

- ile

- içinde

- olmadan

- İş

- iş akışı

- çalışır

- olur

- yazmak

- yıl

- sen

- zefirnet