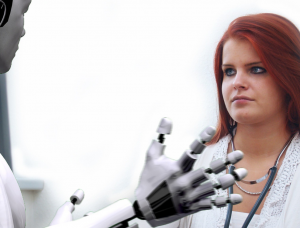

ปัญญาประดิษฐ์ (AI) ได้ปฏิวัติอุตสาหกรรมต่างๆ โดยนำเสนอคุณประโยชน์และโอกาสมากมาย อย่างไรก็ตาม มีความกังวลเกิดขึ้นเกี่ยวกับศักยภาพของ AI ที่จะขยายเวลาการเลือกปฏิบัติและอคติ บทความนี้สำรวจหัวข้อการเลือกปฏิบัติของ AI โดยให้ความกระจ่างเกี่ยวกับความท้าทายในการระบุและจัดการกับอคติที่ฝังอยู่ภายในระบบ AI คนในวงการแสดงความสงสัยเกี่ยวกับผลกระทบทางศีลธรรมและจริยธรรมของ AI โดยอ้างถึงความกังวลเกี่ยวกับข้อมูลที่ผิด อคติในอัลกอริทึม และการสร้างเนื้อหาที่ทำให้เข้าใจผิด ในขณะที่ข้อถกเถียงเกี่ยวกับ AI ทวีความเข้มข้นขึ้น มีการเรียกร้องให้มีกฎระเบียบที่มีความหมายมากขึ้นเพื่อให้เกิดความโปร่งใส ความรับผิดชอบ และการคุ้มครองสิทธิขั้นพื้นฐาน

ความท้าทายสำหรับอุตสาหกรรมการเงินด้วย AI

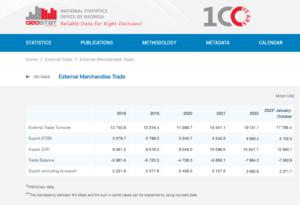

ตามที่ Nabil Manji หัวหน้าฝ่าย crypto และ Web3 ที่ Worldpay โดย FIS กล่าวไว้ ประสิทธิภาพของผลิตภัณฑ์ AI ขึ้นอยู่กับคุณภาพของแหล่งข้อมูลที่ใช้ในการฝึกอบรมเป็นอย่างมาก ในการให้สัมภาษณ์กับ CNBC Manji อธิบายว่าปัจจัยหลักสองประการที่ส่งผลต่อประสิทธิภาพของ AI ได้แก่ ข้อมูลที่สามารถเข้าถึงได้ และความสามารถของโมเดลภาษาขนาดใหญ่

เพื่อแสดงให้เห็นถึงความสำคัญของข้อมูล Manji กล่าวว่าบริษัทอย่าง Reddit ได้ประกาศข้อจำกัดในการคัดลอกข้อมูลต่อสาธารณะ โดยต้องชำระเงินสำหรับการเข้าถึง ในภาคบริการทางการเงิน เขาได้เน้นย้ำถึงความท้าทายของระบบข้อมูลที่กระจัดกระจายในภาษาและรูปแบบต่างๆ การขาดการบูรณาการและการประสานกันนี้จำกัดประสิทธิภาพของผลิตภัณฑ์ที่ขับเคลื่อนด้วย AI โดยเฉพาะอย่างยิ่งเมื่อเปรียบเทียบกับอุตสาหกรรมที่มีโครงสร้างพื้นฐานข้อมูลที่ได้มาตรฐานและทันสมัย

จากข้อมูลของ Manji การใช้ประโยชน์จากบล็อคเชนหรือเทคโนโลยีบัญชีแยกประเภทแบบกระจายอาจเสนอวิธีแก้ปัญหาที่เป็นไปได้ในการแก้ไขปัญหานี้ แนวทางที่เป็นนวัตกรรมนี้สามารถเพิ่มความโปร่งใสในข้อมูลที่กระจัดกระจายซึ่งจัดเก็บไว้ในระบบที่ซับซ้อนของธนาคารทั่วไป อย่างไรก็ตาม เขารับทราบว่าธรรมชาติของธนาคารที่มีการควบคุมอย่างเข้มงวดและเคลื่อนไหวช้าอาจขัดขวางความสามารถในการนำเครื่องมือ AI ใหม่มาใช้อย่างรวดเร็ว ซึ่งแตกต่างจากบริษัทเทคโนโลยีที่มีความคล่องตัวอื่นๆ เช่น Microsoft และ Google ซึ่งอยู่ในแนวหน้าในการขับเคลื่อนนวัตกรรมในช่วงสองสามปีที่ผ่านมา ทศวรรษ

เมื่อพิจารณาปัจจัยเหล่านี้ จะเห็นได้ชัดว่าอุตสาหกรรมการเงินเผชิญกับความท้าทายพิเศษในการใช้ประโยชน์จาก AI เนื่องจากความซับซ้อนของการบูรณาการข้อมูลและลักษณะโดยธรรมชาติของภาคการธนาคาร

ตามคำกล่าวของ Rumman Chowdhury อดีตหัวหน้าฝ่ายจริยธรรมการเรียนรู้ของเครื่อง ความโปร่งใส และความรับผิดชอบของ Twitter การให้ยืมเป็นตัวอย่างที่น่าทึ่งว่าอคติในระบบ AI อาจส่งผลเสียต่อชุมชนชายขอบได้อย่างไร ในการเสวนาที่กรุงอัมสเตอร์ดัม Chowdhury เน้นย้ำถึงแนวปฏิบัติทางประวัติศาสตร์ของ "การลงแดง" ในชิคาโกในช่วงทศวรรษที่ 1930 Redlining เกี่ยวข้องกับการปฏิเสธการให้กู้ยืมเงินแก่ย่านใกล้เคียงที่เป็นแอฟริกันอเมริกันโดยพิจารณาจากข้อมูลประชากรทางเชื้อชาติ

Chowdhury อธิบายว่าแม้ว่าอัลกอริธึมสมัยใหม่อาจไม่ได้รวมเชื้อชาติเป็นจุดข้อมูลอย่างชัดเจน แต่อคติยังสามารถเข้ารหัสโดยปริยายได้ เมื่อมีการพัฒนาอัลกอริทึมเพื่อประเมินความเสี่ยงของเขตและบุคคลเพื่อวัตถุประสงค์ในการกู้ยืม ข้อมูลในอดีตที่มีอคติสามารถทำให้เกิดการเลือกปฏิบัติโดยไม่ตั้งใจได้

Angle Bush ผู้มีวิสัยทัศน์เบื้องหลังผู้หญิงผิวดำในด้านปัญญาประดิษฐ์ เน้นย้ำถึงความสำคัญของการยอมรับอันตรายที่เกี่ยวข้องกับการสร้างอคติที่ฝังอยู่ในข้อมูลในอดีต เมื่อใช้ระบบ AI ในการพิจารณาอนุมัติสินเชื่อ การปฏิบัติดังกล่าวอาจนำไปสู่การปฏิเสธการสมัครขอสินเชื่อจากชุมชนชายขอบโดยอัตโนมัติ ซึ่งส่งผลให้เกิดความไม่เท่าเทียมกันทางเชื้อชาติหรือทางเพศ

Frost Li นักพัฒนา AI ที่มีประสบการณ์ ชี้ให้เห็นถึงความท้าทายของการปรับเปลี่ยนในแบบของคุณ บูรณาการ AI. การเลือก “คุณสมบัติหลัก” สำหรับการฝึกโมเดล AI บางครั้งอาจเกี่ยวข้องกับปัจจัยที่ไม่เกี่ยวข้องซึ่งอาจนำไปสู่ผลลัพธ์ที่มีอคติ Li ยกตัวอย่างว่า บริษัท Fintech Startup ที่กำหนดเป้าหมายไปที่ชาวต่างชาติอาจเผชิญกับเกณฑ์การประเมินเครดิตที่แตกต่างกันอย่างไรเมื่อเปรียบเทียบกับธนาคารในท้องถิ่น ซึ่งคุ้นเคยกับโรงเรียนและชุมชนในท้องถิ่นมากกว่า

Niklas Guske ซีโอโอของ Taktile ซึ่งเป็นสตาร์ทอัพที่เชี่ยวชาญด้านการตัดสินใจอัตโนมัติสำหรับฟินเทค ชี้แจงว่า โดยทั่วไปแล้ว generative AI จะไม่ถูกใช้เพื่อสร้างคะแนนเครดิตหรือคะแนนความเสี่ยงของผู้บริโภค ในทางตรงกันข้าม จุดแข็งอยู่ที่การประมวลผลล่วงหน้าของข้อมูลที่ไม่มีโครงสร้าง เช่น ไฟล์ข้อความ เพื่อปรับปรุงคุณภาพข้อมูลสำหรับโมเดลการรับประกันภัยแบบทั่วไป

โดยสรุป การใช้ AI ในการให้กู้ยืมและบริการทางการเงินทำให้เกิดความกังวลเกี่ยวกับอคติและการเลือกปฏิบัติ อคติในอดีตที่ฝังอยู่ในข้อมูลและการเลือกคุณสมบัติที่ไม่เกี่ยวข้องระหว่างการฝึกอบรม AI อาจนำไปสู่ผลลัพธ์ที่ไม่ยุติธรรม เป็นสิ่งสำคัญสำหรับธนาคารและสถาบันการเงินในการรับรู้และแก้ไขปัญหาเหล่านี้ เพื่อป้องกันการเลือกปฏิบัติโดยไม่ตั้งใจเมื่อใช้โซลูชัน AI

พิสูจน์การเลือกปฏิบัติของ AI

การพิสูจน์ว่าการเลือกปฏิบัติโดยใช้ AI อาจเป็นเรื่องที่ท้าทาย ดังที่เห็นได้จากตัวอย่าง เช่น กรณีที่เกี่ยวข้องกับ Apple และ Goldman Sachs กระทรวงบริการทางการเงินแห่งรัฐนิวยอร์กยกฟ้องข้อกล่าวหาเรื่องการกำหนดขีดจำกัดล่างของ Apple Card สำหรับผู้หญิง โดยอ้างว่าไม่มีหลักฐานที่เป็นรูปธรรม

Kim Smouter ผู้อำนวยการ European Network Against Racism ชี้ให้เห็นว่าการใช้งาน AI จำนวนมากทำให้เกิดความทึบในกระบวนการตัดสินใจ ทำให้ยากสำหรับบุคคลในการระบุและจัดการกับการเลือกปฏิบัติ

Smouter อธิบายว่าบุคคลมักมีความรู้จำกัดเกี่ยวกับวิธีการทำงานของระบบ AI ทำให้การตรวจจับกรณีการเลือกปฏิบัติหรืออคติเชิงระบบเป็นเรื่องที่ท้าทาย มันจะซับซ้อนยิ่งขึ้นเมื่อการเลือกปฏิบัติเป็นส่วนหนึ่งของปัญหาในวงกว้างที่ส่งผลกระทบต่อบุคคลหลายคน Smouter อ้างอิงถึงเรื่องอื้อฉาวด้านสวัสดิการเด็กของชาวดัตช์ ซึ่งการเรียกร้องผลประโยชน์จำนวนมากถูกระบุว่าเป็นการฉ้อโกงเนื่องจากอคติทางสถาบัน การค้นพบความผิดปกติดังกล่าวเป็นเรื่องที่ท้าทาย และการได้รับการเยียวยาอาจเป็นเรื่องยากและใช้เวลานาน ซึ่งนำไปสู่อันตรายที่สำคัญและบางครั้งไม่สามารถรักษาให้หายขาดได้

ตัวอย่างเหล่านี้แสดงให้เห็นถึงความยากลำบากโดยธรรมชาติในการพิสูจน์การเลือกปฏิบัติโดยอาศัย AI และการได้รับการเยียวยาเมื่อการเลือกปฏิบัติดังกล่าวเกิดขึ้น ความซับซ้อนของระบบ AI และการขาดความโปร่งใสในกระบวนการตัดสินใจ ทำให้เกิดความท้าทายสำหรับบุคคลในการรับรู้และจัดการกับกรณีของการเลือกปฏิบัติอย่างมีประสิทธิภาพ

จากข้อมูลของ Chowdhury มีความจำเป็นเร่งด่วนที่หน่วยงานกำกับดูแลระดับโลกที่คล้ายกับสหประชาชาติ จะต้องจัดการกับความเสี่ยงที่เกี่ยวข้องกับ AI ในขณะที่ AI ได้แสดงให้เห็นถึงนวัตกรรมที่น่าทึ่ง นักเทคโนโลยีและนักจริยธรรมก็หยิบยกข้อกังวลเกี่ยวกับผลกระทบทางศีลธรรมและจริยธรรม ข้อกังวลเหล่านี้ครอบคลุมถึงประเด็นต่างๆ เช่น ข้อมูลที่ไม่ถูกต้อง อคติทางเชื้อชาติและเพศที่ฝังอยู่ในอัลกอริทึม AI และการสร้างเนื้อหาที่ทำให้เข้าใจผิดโดยเครื่องมือเช่น ChatGPT

Chowdhury แสดงความกังวลเกี่ยวกับการเข้าสู่โลกหลังความจริงที่ข้อมูลออนไลน์ รวมถึงข้อความ วิดีโอ และเสียง กลายเป็นเรื่องไม่น่าไว้วางใจเนื่องจาก AI กำเนิด สิ่งนี้ทำให้เกิดคำถามว่าเราจะมั่นใจในความสมบูรณ์ของข้อมูลได้อย่างไร และเราจะพึ่งพาข้อมูลดังกล่าวในการตัดสินใจอย่างมีข้อมูลได้อย่างไร ด้วยตัวอย่างพระราชบัญญัติ AI ของสหภาพยุโรป กฎระเบียบที่มีความหมายของ AI จึงมีความสำคัญอย่างยิ่งในขณะนี้ อย่างไรก็ตาม มีความกังวลเกี่ยวกับระยะเวลาที่ยาวกว่าที่ข้อเสนอด้านกฎระเบียบจะมีประสิทธิภาพ ซึ่งอาจส่งผลให้การดำเนินการที่จำเป็นล่าช้าออกไป

Smouter เน้นย้ำถึงความจำเป็นในการเพิ่มความโปร่งใสและความรับผิดชอบในอัลกอริทึม AI ซึ่งรวมถึงการทำให้อัลกอริทึมสามารถเข้าใจได้มากขึ้นสำหรับผู้ที่ไม่ใช่ผู้เชี่ยวชาญ ทำการทดสอบและเผยแพร่ผลลัพธ์ สร้างกระบวนการร้องเรียนที่เป็นอิสระ ดำเนินการตรวจสอบและรายงานเป็นระยะ และเกี่ยวข้องกับชุมชนที่มีเชื้อชาติในการออกแบบและปรับใช้เทคโนโลยี การบังคับใช้พระราชบัญญัติ AI ซึ่งใช้มุมมองด้านสิทธิขั้นพื้นฐานและแนะนำแนวคิดเช่นการชดเชย คาดว่าจะเริ่มได้ในอีกประมาณสองปี การลดระยะเวลานี้จะเป็นประโยชน์ในการรักษาความโปร่งใสและความรับผิดชอบในฐานะที่เป็นองค์ประกอบสำคัญของนวัตกรรม

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://www.forexnewsnow.com/fintech/the-urgency-of-addressing-ai-discrimination-transparency-accountability-and-regulatory-timelines/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- a

- ความสามารถ

- เกี่ยวกับเรา

- เข้า

- ความรับผิดชอบ

- ที่ยอมรับ

- กระทำ

- การปฏิบัติ

- ที่อยู่

- ที่อยู่

- นำมาใช้

- ได้เปรียบ

- ในทางลบ

- มีผลต่อ

- แอฟริกัน

- กับ

- เปรียว

- AI

- พระราชบัญญัติ AI

- ระบบ AI

- การฝึกอบรม AI

- อัลกอริทึม

- ข้อกล่าวหา

- แม้ว่า

- อเมริกัน

- อัมสเตอร์ดัม

- an

- และ

- ที่คาดว่าจะ

- Apple

- แอปเปิลการ์ด

- การใช้งาน

- เข้าใกล้

- การอนุมัติ

- ประมาณ

- เป็น

- บทความ

- เทียม

- ปัญญาประดิษฐ์

- AS

- ด้าน

- ประเมินผล

- การประเมินผล

- ที่เกี่ยวข้อง

- At

- เสียง

- การตรวจสอบ

- อัตโนมัติ

- โดยอัตโนมัติ

- การธนาคาร

- ภาคธนาคาร

- ธนาคาร

- ตาม

- BE

- กลายเป็น

- จะกลายเป็น

- รับ

- หลัง

- ประโยชน์

- ประโยชน์ที่ได้รับ

- อคติ

- ลำเอียง

- อคติ

- Black

- blockchain

- ร่างกาย

- นำ

- ที่กว้างขึ้น

- by

- โทรศัพท์

- CAN

- ความสามารถในการ

- บัตร

- กรณี

- ท้าทาย

- ความท้าทาย

- ท้าทาย

- ChatGPT

- ชิคาโก

- เด็ก

- การเรียกร้อง

- ชี้แจง

- ซีเอ็นบีซี

- ชุมชน

- บริษัท

- เมื่อเทียบกับ

- การร้องเรียน

- ซับซ้อน

- ความซับซ้อน

- ความซับซ้อน

- แนวความคิด

- ความกังวลเกี่ยวกับ

- การดำเนิน

- การรวบรวม

- ผู้บริโภค

- มี

- เนื้อหา

- ตรงกันข้าม

- สนับสนุน

- ตามธรรมเนียม

- ขัน

- การสร้าง

- เครดิต

- เกณฑ์

- สำคัญมาก

- การเข้ารหัสลับ

- อันตราย

- ข้อมูล

- โครงสร้างพื้นฐานข้อมูล

- การรวมข้อมูล

- คุณภาพของข้อมูล

- การอภิปราย

- ทศวรรษที่ผ่านมา

- การตัดสินใจ

- การตัดสินใจ

- ประชากร

- แผนก

- ขึ้นอยู่กับ

- การใช้งาน

- ออกแบบ

- ผู้พัฒนา

- ที่กำลังพัฒนา

- ต่าง

- ยาก

- ความยากลำบาก

- ผู้อำนวยการ

- การค้นพบ

- การแบ่งแยก

- การสนทนา

- กระจาย

- บัญชีแยกประเภทกระจาย

- เทคโนโลยีบัญชีแยกประเภท

- การขับขี่

- สอง

- ในระหว่าง

- Dutch

- มีประสิทธิภาพ

- มีประสิทธิภาพ

- ประสิทธิผล

- ที่ฝัง

- โผล่ออกมา

- เน้น

- ห้อมล้อม

- การบังคับใช้

- เสริม

- ที่เพิ่มขึ้น

- ทำให้มั่นใจ

- การป้อน

- โดยเฉพาะอย่างยิ่ง

- การสร้าง

- ตามหลักจริยธรรม

- จริยธรรม

- ในทวีปยุโรป

- แม้

- หลักฐาน

- ชัดเจน

- ตัวอย่าง

- ตัวอย่าง

- มีประสบการณ์

- อธิบาย

- อธิบาย

- สำรวจ

- ด่วน

- ใบหน้า

- ใบหน้า

- ปัจจัย

- คุ้นเคย

- คุณสมบัติ

- สองสาม

- ไฟล์

- ทางการเงิน

- อุตสาหกรรมการเงิน

- สถาบันการเงิน

- บริการทางการเงิน

- Fintech

- ฟินเทคสตาร์ทอัพ

- fintechs

- FIS

- สำหรับ

- แถวหน้า

- อดีต

- การแยกส่วน

- ฉ้อโกง

- ราคาเริ่มต้นที่

- พื้นฐาน

- เพศ

- รุ่น

- กำเนิด

- กำเนิด AI

- เหตุการณ์ที่

- โกลด์แมน

- แซคส์โกลด์แมน

- มากขึ้น

- การเจริญเติบโต

- อันตราย

- มี

- he

- หัว

- หนัก

- ไฮไลต์

- อย่างสูง

- ทางประวัติศาสตร์

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTTPS

- แยกแยะ

- ระบุ

- การดำเนินการ

- ผลกระทบ

- ความสำคัญ

- การจัดเก็บภาษี

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- อิสระ

- บุคคล

- อุตสาหกรรม

- อุตสาหกรรม

- ความไม่เท่าเทียมกัน

- ข้อมูล

- แจ้ง

- โครงสร้างพื้นฐาน

- โดยธรรมชาติ

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- นวัตกรรม

- สถาบัน

- สถาบัน

- สำคัญ

- บูรณาการ

- ความสมบูรณ์

- Intelligence

- สัมภาษณ์

- เข้าไป

- เปิดตัว

- รวมถึง

- ร่วมมือ

- ที่เกี่ยวข้องกับ

- ปัญหา

- ปัญหา

- IT

- ITS

- ความรู้

- ไม่มี

- ภาษา

- ภาษา

- ใหญ่

- นำ

- ชั้นนำ

- การเรียนรู้

- บัญชีแยกประเภท

- การให้กู้ยืมเงิน

- การใช้ประโยชน์

- li

- ตั้งอยู่

- เบา

- กดไลก์

- ถูก จำกัด

- ขีด จำกัด

- เงินกู้

- เงินให้กู้ยืม

- ในประเทศ

- ธนาคารท้องถิ่น

- ลด

- เครื่อง

- เรียนรู้เครื่อง

- หลัก

- ทำ

- การทำ

- มวล

- วัสดุ

- อาจ..

- มีความหมาย

- กล่าวถึง

- ไมโครซอฟท์

- อาจ

- ข้อมูลที่ผิด

- หลอกตา

- แบบ

- โมเดล

- ทันสมัย

- ขณะ

- คุณธรรม

- ข้อมูลเพิ่มเติม

- หลาย

- เนชั่น

- ธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- เครือข่าย

- ใหม่

- นิวยอร์ก

- รัฐนิวยอร์ก

- รัฐนิวยอร์กกรมบริการทางการเงิน

- ไม่ใช่ผู้เชี่ยวชาญ

- โดดเด่น

- จำนวน

- มากมาย

- ประโยชน์มากมาย

- การได้รับ

- of

- เสนอ

- การเสนอ

- มักจะ

- on

- ออนไลน์

- ทำงาน

- โอกาส

- or

- ออก

- ผลลัพธ์

- แผง

- อภิปราย

- ส่วนหนึ่ง

- อดีต

- การชำระเงิน

- การปฏิบัติ

- เป็นระยะ

- ส่วนบุคคล

- มุมมอง

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- จุด

- ที่มีศักยภาพ

- ที่อาจเกิดขึ้น

- การปฏิบัติ

- อย่างเด่น

- การกด

- ป้องกัน

- ปัญหา

- กระบวนการ

- ผลิตภัณฑ์

- ข้อเสนอ

- การป้องกัน

- ให้

- ให้

- สาธารณชน

- การประกาศ

- วัตถุประสงค์

- คุณภาพ

- คำถาม

- เชื่อชาติ

- ลัทธิชนชาติ

- ยก

- ยก

- รับรู้

- ลด

- การอ้างอิง

- เกี่ยวกับ

- ควบคุม

- การควบคุม

- หน่วยงานกำกับดูแล

- วางใจ

- โดดเด่น

- การรายงาน

- ข้อ จำกัด

- ผลสอบ

- ปฏิวัติ

- สิทธิ

- ความเสี่ยง

- ความเสี่ยง

- แซคส์

- เรื่องอื้อฉาว

- โรงเรียน

- คะแนน

- คะแนน

- การขูด

- ภาค

- การเลือก

- การเลือก

- บริการ

- แสดง

- ความสำคัญ

- สำคัญ

- คล้ายคลึงกัน

- ทางออก

- โซลูชัน

- แหล่ง

- การพูด

- ความเชี่ยวชาญ

- การเริ่มต้น

- startups

- สถานะ

- กระทรวงการต่างประเทศ

- ยังคง

- เก็บไว้

- ความแข็งแรง

- อย่างเช่น

- สรุป

- ที่ล้อมรอบ

- อย่างรวดเร็ว

- เกี่ยวกับระบบ

- ระบบ

- ต่อสู้

- ใช้เวลา

- กำหนดเป้าหมาย

- เทคโนโลยี

- tech บริษัท

- เทคโนโลยี

- เทคโนโลยี

- การทดสอบ

- ที่

- พื้นที่

- ที่มา

- ของพวกเขา

- ที่นั่น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- นี้

- ต้องใช้เวลามาก

- ไทม์ไลน์

- ระยะเวลา

- ไปยัง

- เครื่องมือ

- หัวข้อ

- การฝึกอบรม

- ความโปร่งใส

- พูดเบาและรวดเร็ว

- สอง

- เป็นปกติ

- เข้าใจได้

- การจัดจำหน่าย

- ไม่ยุติธรรม

- เป็นเอกลักษณ์

- พร้อมใจกัน

- สหประชาชาติ

- แตกต่าง

- ส่งเสริม

- การเร่งรีบ

- ใช้

- มือสอง

- ต่างๆ

- วีดีโอ

- จินตนาการ

- we

- Web3

- สวัสดิการ

- คือ

- เมื่อ

- ที่

- ในขณะที่

- กับ

- ภายใน

- ผู้หญิง

- โลก

- WorldPay

- กังวล

- จะ

- ปี

- นิวยอร์ก

- ลมทะเล