โพสต์นี้เขียนร่วมกับ Preshen Goobiah และ Johan Olivier จาก Capitec

Apache Spark เป็นระบบประมวลผลแบบกระจายโอเพ่นซอร์สที่ใช้กันอย่างแพร่หลายและมีชื่อเสียงในด้านการจัดการปริมาณงานข้อมูลขนาดใหญ่ พบแอปพลิเคชันบ่อยครั้งในหมู่นักพัฒนา Spark ที่ร่วมงานด้วย อเมซอน EMR, อเมซอน SageMaker, AWS กาว และแอปพลิเคชั่น Spark แบบกำหนดเอง

อเมซอน Redshift นำเสนอการผสานรวมกับ Apache Spark ได้อย่างราบรื่น ช่วยให้คุณเข้าถึงข้อมูล RedShift ของคุณบนคลัสเตอร์ที่จัดเตรียม Amazon RedShift และ Amazon Redshift แบบไร้เซิร์ฟเวอร์. การผสานรวมนี้ขยายความเป็นไปได้สำหรับโซลูชันการวิเคราะห์ AWS และการเรียนรู้ของเครื่อง (ML) ทำให้คลังข้อมูลสามารถเข้าถึงแอปพลิเคชันที่หลากหลายมากขึ้น

กับ การรวม Amazon Redshift สำหรับ Apache Sparkคุณสามารถเริ่มต้นได้อย่างรวดเร็วและพัฒนาแอปพลิเคชัน Spark ได้อย่างง่ายดายโดยใช้ภาษายอดนิยม เช่น Java, Scala, Python, SQL และ R แอปพลิเคชันของคุณสามารถอ่านและเขียนไปยังคลังข้อมูล Amazon Redshift ของคุณได้อย่างราบรื่น ในขณะที่ยังคงรักษาประสิทธิภาพที่เหมาะสมที่สุดและความสม่ำเสมอในการทำธุรกรรมไว้ นอกจากนี้ คุณจะได้รับประโยชน์จากการปรับปรุงประสิทธิภาพผ่านการเพิ่มประสิทธิภาพแบบกดลง ซึ่งจะช่วยเพิ่มประสิทธิภาพในการดำเนินงานของคุณให้ดียิ่งขึ้น

Capitecซึ่งเป็นธนาคารรายย่อยที่ใหญ่ที่สุดของแอฟริกาใต้ซึ่งมีลูกค้าธนาคารรายย่อยมากกว่า 21 ล้านราย มีเป้าหมายที่จะให้บริการทางการเงินที่เรียบง่าย ราคาไม่แพง และเข้าถึงได้ เพื่อช่วยให้ธนาคารของแอฟริกาใต้ดีขึ้น เพื่อให้พวกเขาสามารถมีชีวิตที่ดีขึ้นได้ ในโพสต์นี้ เราจะพูดคุยเกี่ยวกับการบูรณาการที่ประสบความสำเร็จของตัวเชื่อมต่อ Amazon RedShift แบบโอเพ่นซอร์สโดยทีมงานแพลตฟอร์มฟีเจอร์บริการที่ใช้ร่วมกันของ Capitec ผลจากการใช้การผสานรวม Amazon RedShift สำหรับ Apache Spark ประสิทธิภาพของนักพัฒนาเพิ่มขึ้น 10 เท่า ไปป์ไลน์การสร้างฟีเจอร์ได้รับการปรับปรุงให้มีประสิทธิภาพ และความซ้ำซ้อนของข้อมูลลดลงเหลือศูนย์

โอกาสทางธุรกิจ

มีโมเดลการคาดการณ์ 19 โมเดลในขอบเขตการใช้งานฟีเจอร์ 93 รายการที่สร้างด้วย AWS Glue ทั่วทั้งแผนกสินเชื่อรายย่อยของ Capitec บันทึกคุณสมบัติเต็มไปด้วยข้อเท็จจริงและมิติที่จัดเก็บไว้ใน Amazon RedShift Apache PySpark ได้รับเลือกให้สร้างฟีเจอร์เนื่องจากมีกลไกที่รวดเร็ว กระจายอำนาจ และปรับขนาดได้เพื่อโต้แย้งข้อมูลจากแหล่งที่หลากหลาย

ฟีเจอร์การใช้งานจริงเหล่านี้มีบทบาทสำคัญในการเปิดใช้งานแอปพลิเคชันสินเชื่อระยะเวลาคงที่แบบเรียลไทม์ แอปพลิเคชันบัตรเครดิต การตรวจสอบพฤติกรรมเครดิตรายเดือนเป็นชุด และการระบุเงินเดือนรายวันเป็นชุดภายในธุรกิจ

ปัญหาการจัดหาข้อมูล

เพื่อให้มั่นใจในความน่าเชื่อถือของไปป์ไลน์ข้อมูล PySpark จำเป็นต้องมีข้อมูลระดับบันทึกที่สอดคล้องกันจากทั้งตารางมิติและตารางข้อเท็จจริงที่จัดเก็บไว้ใน Enterprise Data Warehouse (EDW) จากนั้นตารางเหล่านี้จะรวมกับตารางจาก Enterprise Data Lake (EDL) ในขณะรันไทม์

ในระหว่างการพัฒนาฟีเจอร์ วิศวกรข้อมูลจำเป็นต้องมีอินเทอร์เฟซที่ราบรื่นกับ EDW อินเทอร์เฟซนี้ช่วยให้พวกเขาเข้าถึงและรวมข้อมูลที่จำเป็นจาก EDW เข้ากับไปป์ไลน์ข้อมูล ช่วยให้สามารถพัฒนาและทดสอบคุณสมบัติต่างๆ ได้อย่างมีประสิทธิภาพ

กระบวนการแก้ไขปัญหาก่อนหน้า

ในโซลูชันก่อนหน้านี้ วิศวกรข้อมูลของทีมผลิตภัณฑ์ใช้เวลา 30 นาทีต่อการรันหนึ่งครั้งในการเปิดเผยข้อมูล Redshift ไปยัง Spark ด้วยตนเอง ขั้นตอนมีดังต่อไปนี้:

- สร้างแบบสอบถามภาคแสดงใน Python

- ส่ง ยกเลิกการโหลด สอบถามผ่านทาง API ข้อมูลของ Amazon Redshift.

- ข้อมูลแคตตาล็อกใน AWS Glue Data Catalog ผ่าน AWS SDK สำหรับ Pandas โดยใช้การสุ่มตัวอย่าง

แนวทางนี้ก่อให้เกิดปัญหากับชุดข้อมูลขนาดใหญ่ จำเป็นต้องมีการบำรุงรักษาเป็นประจำจากทีมแพลตฟอร์ม และมีความซับซ้อนในการทำให้เป็นอัตโนมัติ

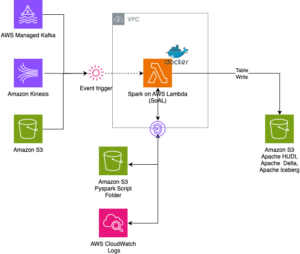

ภาพรวมโซลูชันปัจจุบัน

Capitec สามารถแก้ไขปัญหาเหล่านี้ได้ด้วยการผสานรวม Amazon RedShift สำหรับ Apache Spark ภายในไปป์ไลน์การสร้างฟีเจอร์ สถาปัตยกรรมถูกกำหนดไว้ในแผนภาพต่อไปนี้

เวิร์กโฟลว์ประกอบด้วยขั้นตอนต่อไปนี้:

- ไลบรารีภายในได้รับการติดตั้งในงาน AWS Glue PySpark ผ่านทาง AWS CodeArtifact.

- งาน AWS Glue ดึงข้อมูลรับรองคลัสเตอร์ Redshift ผู้จัดการความลับของ AWS และตั้งค่าการเชื่อมต่อ Amazon RedShift (แทรกข้อมูลรับรองคลัสเตอร์ ตำแหน่งยกเลิกการโหลด รูปแบบไฟล์) ผ่านทางไลบรารีภายในที่ใช้ร่วมกัน การผสานรวม Amazon RedShift สำหรับ Apache Spark ยังรองรับการใช้งานอีกด้วย AWS Identity และการจัดการการเข้าถึง (IAM) ถึง ดึงข้อมูลประจำตัวและเชื่อมต่อกับ Amazon RedShift.

- การสืบค้น Spark ได้รับการแปลเป็นการสืบค้นที่ปรับให้เหมาะสมกับ Amazon RedShift และส่งไปยัง EDW ซึ่งทำได้โดยการผสานรวม Amazon RedShift สำหรับ Apache Spark

- ชุดข้อมูล EDW ถูกยกเลิกการโหลดลงในคำนำหน้าชั่วคราวใน บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) ถัง

- ชุดข้อมูล EDW จากบัคเก็ต S3 จะถูกโหลดไปยังตัวดำเนินการ Spark ผ่านการผสานรวม Amazon Redshift สำหรับ Apache Spark

- ชุดข้อมูล EDL จะถูกโหลดลงในตัวดำเนินการ Spark ผ่านทาง AWS Glue Data Catalog

ส่วนประกอบเหล่านี้ทำงานร่วมกันเพื่อให้แน่ใจว่าวิศวกรข้อมูลและไปป์ไลน์ข้อมูลการผลิตมีเครื่องมือที่จำเป็นในการใช้งานการผสานรวม Amazon RedShift สำหรับ Apache Spark ดำเนินการสืบค้น และอำนวยความสะดวกในการขนถ่ายข้อมูลจาก Amazon RedShift ไปยัง EDL

การใช้การผสานรวม Amazon RedShift สำหรับ Apache Spark ใน AWS Glue 4.0

ในส่วนนี้ เราจะสาธิตยูทิลิตีของการผสานรวม Amazon RedShift สำหรับ Apache Spark โดยการเพิ่มตารางการสมัครสินเชื่อที่อยู่ใน Data Lake S3 ด้วยข้อมูลลูกค้าจากคลังข้อมูล Redshift ใน PySpark

พื้นที่ dimclient ตารางใน Amazon RedShift มีคอลัมน์ต่อไปนี้:

- ลูกค้าคีย์ – INT8

- ไคลเอ็นต์AltKey – วาร์ชาร์50

- PartyIdentifierNumber – วาร์ชาร์20

- ClientCreateDate - วันที่

- ยกเลิกแล้ว – INT2

- แถวเป็นปัจจุบัน – INT2

พื้นที่ loanapplication ตารางใน AWS Glue Data Catalog มีคอลัมน์ต่อไปนี้:

- รหัสบันทึก – บิ๊กอินท์

- เข้าสู่ระบบวันที่ – ประทับเวลา

- PartyIdentifierNumber – สตริง

ตาราง Redshift จะถูกอ่านผ่านการผสานรวม Amazon RedShift สำหรับ Apache Spark และถูกแคชไว้ ดูรหัสต่อไปนี้:

บันทึกการสมัครสินเชื่อจะถูกอ่านจาก Data Lake ของ S3 และเสริมด้วย dimclient ตารางในข้อมูล Amazon RedShift:

เป็นผลให้บันทึกการสมัครขอสินเชื่อ (จาก Data Lake S3) ได้รับการเสริมสมรรถนะด้วย ClientCreateDate คอลัมน์ (จาก Amazon RedShift)

การผสานรวม Amazon RedShift สำหรับ Apache Spark แก้ปัญหาการจัดหาข้อมูลได้อย่างไร

การผสานรวม Amazon RedShift สำหรับ Apache Spark แก้ไขปัญหาการจัดหาข้อมูลได้อย่างมีประสิทธิภาพผ่านกลไกต่อไปนี้:

- การอ่านทันเวลาพอดี – การผสานรวม Amazon RedShift สำหรับตัวเชื่อมต่อ Apache Spark อ่านตาราง Redshift ในลักษณะที่ทันเวลา ทำให้มั่นใจในความสอดคล้องของข้อมูลและสคีมา ซึ่งมีคุณค่าอย่างยิ่งสำหรับ ประเภทที่ 2 มิติที่เปลี่ยนแปลงอย่างช้าๆ (SCD) และระยะเวลาที่สะสมข้อเท็จจริงสแนปชอต ด้วยการรวมตาราง Redshift เหล่านี้เข้ากับตาราง AWS Glue Data Catalog ของระบบต้นทางจาก EDL ภายในไปป์ไลน์ PySpark ที่ใช้งานจริง ตัวเชื่อมต่อช่วยให้สามารถรวมข้อมูลจากหลายแหล่งได้อย่างราบรื่นในขณะที่ยังคงรักษาความสมบูรณ์ของข้อมูล

- เพิ่มประสิทธิภาพการสืบค้น RedShift – การผสานรวม Amazon RedShift สำหรับ Apache Spark มีบทบาทสำคัญในการแปลงแผนการสืบค้น Spark ให้เป็นการสืบค้น RedShift ที่ปรับให้เหมาะสม กระบวนการแปลงนี้ทำให้ประสบการณ์การพัฒนาสำหรับทีมผลิตภัณฑ์ง่ายขึ้นโดยยึดตามหลักการท้องถิ่นของข้อมูล การสืบค้นที่ได้รับการปรับให้เหมาะสมจะใช้ความสามารถและการเพิ่มประสิทธิภาพการทำงานของ Amazon RedShift เพื่อให้มั่นใจว่าการดึงและประมวลผลข้อมูลจาก Amazon RedShift สำหรับไปป์ไลน์ PySpark มีประสิทธิภาพ ซึ่งจะช่วยปรับปรุงกระบวนการพัฒนาในขณะเดียวกันก็เพิ่มประสิทธิภาพโดยรวมของการดำเนินการจัดหาข้อมูล

ได้รับประสิทธิภาพที่ดีที่สุด

การผสานรวม Amazon RedShift สำหรับ Apache Spark จะใช้เพรดิเคตและการสืบค้นแบบพุชดาวน์โดยอัตโนมัติเพื่อเพิ่มประสิทธิภาพการทำงาน คุณสามารถได้รับการปรับปรุงประสิทธิภาพโดยใช้รูปแบบ Parquet เริ่มต้นที่ใช้สำหรับการขนถ่ายด้วยการผสานรวมนี้

สำหรับรายละเอียดเพิ่มเติมและตัวอย่างโค้ด โปรดดูที่ ใหม่ – การรวม Amazon Redshift กับ Apache Spark.

ประโยชน์ของโซลูชั่น

การนำการบูรณาการมาใช้ทำให้เกิดประโยชน์ที่สำคัญหลายประการสำหรับทีม:

- เพิ่มประสิทธิภาพการทำงานของนักพัฒนา – อินเทอร์เฟซ PySpark ที่ได้จากการผสานรวมช่วยเพิ่มประสิทธิภาพการทำงานของนักพัฒนาถึง 10 เท่า ทำให้สามารถโต้ตอบกับ Amazon RedShift ได้อย่างราบรื่นยิ่งขึ้น

- การกำจัดความซ้ำซ้อนของข้อมูล – ตาราง Redshift ที่จัดทำรายการซ้ำและ AWS Glue ใน Data Lake ถูกกำจัดออกไป ส่งผลให้สภาพแวดล้อมของข้อมูลมีความคล่องตัวมากขึ้น

- ลดภาระ EDW – การบูรณาการช่วยอำนวยความสะดวกในการขนถ่ายข้อมูลแบบเลือก ช่วยลดภาระใน EDW โดยการดึงเฉพาะข้อมูลที่จำเป็นเท่านั้น

ด้วยการใช้การผสานรวม Amazon RedShift สำหรับ Apache Spark ทำให้ Capitec ได้ปูทางสำหรับการประมวลผลข้อมูลที่ได้รับการปรับปรุง ประสิทธิภาพการทำงานที่เพิ่มขึ้น และระบบนิเวศทางวิศวกรรมฟีเจอร์ที่มีประสิทธิภาพมากขึ้น

สรุป

ในโพสต์นี้ เราได้พูดคุยถึงวิธีที่ทีม Capitec นำ Apache Spark ไปใช้ Amazon Redshift สำหรับ Apache Spark ได้สำเร็จ เพื่อลดความซับซ้อนของเวิร์กโฟลว์การประมวลผลฟีเจอร์ พวกเขาเน้นย้ำถึงความสำคัญของการใช้ไปป์ไลน์ข้อมูล PySpark แบบแยกส่วนและแบบแยกส่วนสำหรับการสร้างฟีเจอร์โมเดลเชิงคาดการณ์

ปัจจุบัน การผสานรวม Amazon RedShift สำหรับ Apache Spark ถูกใช้โดยไปป์ไลน์ข้อมูลการผลิต 7 รายการและไปป์ไลน์การพัฒนา 20 รายการ ซึ่งแสดงให้เห็นถึงประสิทธิภาพภายในสภาพแวดล้อมของ Capitec

ในอนาคต ทีมแพลตฟอร์มฟีเจอร์บริการที่ใช้ร่วมกันที่ Capitec วางแผนที่จะขยายการนำการบูรณาการ Amazon RedShift มาใช้สำหรับ Apache Spark ในด้านธุรกิจต่างๆ โดยมีเป้าหมายที่จะปรับปรุงความสามารถในการประมวลผลข้อมูลเพิ่มเติม และส่งเสริมแนวทางปฏิบัติด้านวิศวกรรมฟีเจอร์ที่มีประสิทธิภาพ

สำหรับข้อมูลเพิ่มเติมเกี่ยวกับการใช้การผสานรวม Amazon RedShift สำหรับ Apache Spark โปรดดูแหล่งข้อมูลต่อไปนี้:

เกี่ยวกับผู้เขียน

เพรเชน กูเบียห์ เป็นหัวหน้าวิศวกรการเรียนรู้ของเครื่องสำหรับแพลตฟอร์มฟีเจอร์ที่ Capitec เขามุ่งเน้นไปที่การออกแบบและสร้างส่วนประกอบ Feature Store สำหรับการใช้งานระดับองค์กร ในเวลาว่างเขาชอบอ่านหนังสือและท่องเที่ยว

เพรเชน กูเบียห์ เป็นหัวหน้าวิศวกรการเรียนรู้ของเครื่องสำหรับแพลตฟอร์มฟีเจอร์ที่ Capitec เขามุ่งเน้นไปที่การออกแบบและสร้างส่วนประกอบ Feature Store สำหรับการใช้งานระดับองค์กร ในเวลาว่างเขาชอบอ่านหนังสือและท่องเที่ยว

โยฮัน โอลิเวียร์ เป็นวิศวกรแมชชีนเลิร์นนิงอาวุโสของ Model Platform ของ Capitec เขาเป็นผู้ประกอบการและชอบแก้ปัญหา เขาชอบดนตรีและเข้าสังคมในเวลาว่าง

โยฮัน โอลิเวียร์ เป็นวิศวกรแมชชีนเลิร์นนิงอาวุโสของ Model Platform ของ Capitec เขาเป็นผู้ประกอบการและชอบแก้ปัญหา เขาชอบดนตรีและเข้าสังคมในเวลาว่าง

สุดิปตา บัจฉี เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญอาวุโสที่ Amazon Web Services เขามีประสบการณ์มากกว่า 12 ปีในด้านข้อมูลและการวิเคราะห์ และช่วยลูกค้าออกแบบและสร้างโซลูชันการวิเคราะห์ที่ปรับขนาดได้และมีประสิทธิภาพสูง นอกเหนือจากงาน เขาชอบวิ่ง ท่องเที่ยว และเล่นคริกเก็ต เชื่อมต่อกับเขาบน LinkedIn.

สุดิปตา บัจฉี เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญอาวุโสที่ Amazon Web Services เขามีประสบการณ์มากกว่า 12 ปีในด้านข้อมูลและการวิเคราะห์ และช่วยลูกค้าออกแบบและสร้างโซลูชันการวิเคราะห์ที่ปรับขนาดได้และมีประสิทธิภาพสูง นอกเหนือจากงาน เขาชอบวิ่ง ท่องเที่ยว และเล่นคริกเก็ต เชื่อมต่อกับเขาบน LinkedIn.

ไซอิด ฮูไมร์ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญด้านการวิเคราะห์อาวุโสที่ Amazon Web Services (AWS) เขามีประสบการณ์มากกว่า 17 ปีในด้านสถาปัตยกรรมองค์กรโดยมุ่งเน้นที่ข้อมูลและ AI/ML โดยช่วยเหลือลูกค้า AWS ทั่วโลกในการจัดการกับข้อกำหนดทางธุรกิจและทางเทคนิคของพวกเขา คุณสามารถเชื่อมต่อกับเขาได้ที่ LinkedIn.

ไซอิด ฮูไมร์ เป็นสถาปนิกโซลูชันผู้เชี่ยวชาญด้านการวิเคราะห์อาวุโสที่ Amazon Web Services (AWS) เขามีประสบการณ์มากกว่า 17 ปีในด้านสถาปัตยกรรมองค์กรโดยมุ่งเน้นที่ข้อมูลและ AI/ML โดยช่วยเหลือลูกค้า AWS ทั่วโลกในการจัดการกับข้อกำหนดทางธุรกิจและทางเทคนิคของพวกเขา คุณสามารถเชื่อมต่อกับเขาได้ที่ LinkedIn.

วูยิศา มัสวานา เป็นสถาปนิกโซลูชันอาวุโสที่ AWS ซึ่งประจำอยู่ในเคปทาวน์ Vuyisa ให้ความสำคัญกับการช่วยเหลือลูกค้าในการสร้างโซลูชันทางเทคนิคเพื่อแก้ไขปัญหาทางธุรกิจ เขาได้สนับสนุน Capitec ในการเดินทาง AWS มาตั้งแต่ปี 2019

วูยิศา มัสวานา เป็นสถาปนิกโซลูชันอาวุโสที่ AWS ซึ่งประจำอยู่ในเคปทาวน์ Vuyisa ให้ความสำคัญกับการช่วยเหลือลูกค้าในการสร้างโซลูชันทางเทคนิคเพื่อแก้ไขปัญหาทางธุรกิจ เขาได้สนับสนุน Capitec ในการเดินทาง AWS มาตั้งแต่ปี 2019

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/big-data/simplifying-data-processing-at-capitec-with-amazon-redshift-integration-for-apache-spark/

- :มี

- :เป็น

- $ ขึ้น

- 06

- 1

- 10

- 100

- 12

- 16

- 17

- 19

- 20

- 2019

- 30

- 7

- a

- สามารถ

- เข้า

- สามารถเข้าถึงได้

- คล่องแคล่ว

- ข้าม

- เพิ่มเติม

- ข้อมูลเพิ่มเติม

- นอกจากนี้

- ที่อยู่

- ที่อยู่

- ยึดมั่น

- การนำมาใช้

- ราคาไม่แพง

- AI / ML

- การเล็ง

- จุดมุ่งหมาย

- การอนุญาต

- ช่วยให้

- ด้วย

- อเมซอน

- Amazon Web Services

- Amazon Web Services (AWS)

- ในหมู่

- an

- การวิเคราะห์

- และ

- อาปาเช่

- Apache Spark

- การใช้งาน

- การใช้งาน

- มีผลบังคับใช้

- เข้าใกล้

- สถาปัตยกรรม

- เป็น

- พื้นที่

- AS

- At

- โดยอัตโนมัติ

- อัตโนมัติ

- AWS

- AWS กาว

- ธนาคาร

- การธนาคาร

- ตาม

- เพราะ

- พฤติกรรม

- ประโยชน์

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ดีกว่า

- ระหว่าง

- ที่ใหญ่ที่สุด

- เพิ่มขึ้น

- ทั้งสอง

- ที่กว้างขึ้น

- สร้าง

- การก่อสร้าง

- สร้าง

- ธุรกิจ

- by

- CAN

- ความสามารถในการ

- แหลม

- บัตร

- แค็ตตาล็อก

- เปลี่ยนแปลง

- ไคลเอนต์

- ลูกค้า

- Cluster

- CO

- รหัส

- คอลัมน์

- คอลัมน์

- การรวมกัน

- ซับซ้อน

- ส่วนประกอบ

- การคำนวณ

- เชื่อมต่อ

- การเชื่อมต่อ

- คงเส้นคงวา

- มี

- สิ่งแวดล้อม

- การแปลง

- การแปลง

- สร้าง

- การสร้าง

- หนังสือรับรอง

- เครดิต

- บัตรเครดิต

- จิ้งหรีด

- สำคัญมาก

- ประเพณี

- ลูกค้า

- ประจำวัน

- ข้อมูล

- ดาต้าเลค

- การประมวลผล

- คลังข้อมูล

- ชุดข้อมูล

- ซึ่งกระจายอำนาจ

- ค่าเริ่มต้น

- กำหนด

- สาธิต

- ออกแบบ

- การออกแบบ

- รายละเอียด

- พัฒนา

- ผู้พัฒนา

- นักพัฒนา

- พัฒนาการ

- ต่าง

- Dimension

- มิติ

- สนทนา

- กล่าวถึง

- กระจาย

- หลาย

- อย่างง่ายดาย

- ระบบนิเวศ

- มีประสิทธิภาพ

- ประสิทธิผล

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- ง่าย

- ตัดออก

- เน้น

- ช่วยให้

- การเปิดใช้งาน

- วิศวกร

- ชั้นเยี่ยม

- วิศวกร

- เสริม

- การเสริมสร้าง

- อุดม

- เพิ่มคุณค่า

- ทำให้มั่นใจ

- การสร้างความมั่นใจ

- Enterprise

- คนที่กระตือรือร้น

- ผู้ประกอบการ

- สิ่งแวดล้อม

- จำเป็น

- อีเธอร์ (ETH)

- ที่มีอยู่

- แสดง

- ขยาย

- ประสบการณ์

- อำนวยความสะดวก

- การอำนวยความสะดวก

- ความจริง

- ปัจจัย

- ข้อเท็จจริง

- FAST

- ลักษณะ

- คุณสมบัติ

- เนื้อไม่มีมัน

- ทางการเงิน

- บริการทางการเงิน

- พบ

- โฟกัส

- มุ่งเน้น

- โดยมุ่งเน้น

- ดังต่อไปนี้

- สำหรับ

- รูป

- ข้างหน้า

- บ่อย

- ราคาเริ่มต้นที่

- ฟังก์ชั่น

- ต่อไป

- ได้รับ

- รุ่น

- ได้รับ

- GitHub

- ทั่วโลก

- การจัดการ

- มี

- he

- ช่วย

- การช่วยเหลือ

- จะช่วยให้

- พระองค์

- ของเขา

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTML

- ที่ http

- HTTPS

- AMI

- ประจำตัว

- เอกลักษณ์

- การดำเนินการ

- การดำเนินการ

- นำเข้า

- ความสำคัญ

- การปรับปรุง

- การปรับปรุง

- in

- รวม

- รวมถึง

- เพิ่มขึ้น

- ข้อมูล

- รวบรวม

- บูรณาการ

- ความสมบูรณ์

- ปฏิสัมพันธ์

- อินเตอร์เฟซ

- ภายใน

- เข้าไป

- ปัญหา

- IT

- ITS

- ชวา

- การสัมภาษณ์

- ร่วม

- เข้าร่วม

- การเดินทาง

- ทะเลสาบ

- ภาษา

- ใหญ่

- ขนาดใหญ่

- นำ

- การเรียนรู้

- ซ้าย

- ห้องสมุด

- ห้องสมุด

- กดไลก์

- สด

- โหลด

- เงินกู้

- วันหยุด

- รัก

- เครื่อง

- เรียนรู้เครื่อง

- การบำรุงรักษา

- การบำรุงรักษา

- การทำ

- ลักษณะ

- ด้วยมือ

- กลไก

- กลไก

- ล้าน

- การลด

- นาที

- ML

- แบบ

- โมเดล

- โมดูลาร์

- การตรวจสอบ

- รายเดือน

- ข้อมูลเพิ่มเติม

- มีประสิทธิภาพมากขึ้น

- หลาย

- ดนตรี

- จำเป็น

- of

- เสนอ

- มะกอก

- on

- เพียง

- เปิด

- โอเพนซอร์ส

- การดำเนินการ

- ดีที่สุด

- เพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- ใบสั่ง

- ด้านนอก

- เกิน

- ทั้งหมด

- หมีแพนด้า

- โดยเฉพาะ

- รหัสผ่าน

- ต่อ

- การปฏิบัติ

- แผนการ

- แผน

- เวที

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เล่น

- เล่น

- เล่น

- ยอดนิยม

- ถูกวาง

- ความเป็นไปได้

- โพสต์

- การปฏิบัติ

- ทำนาย

- ก่อน

- หลัก

- ปัญหา

- การแก้ปัญหา

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- การประมวลผล

- ผลิตภัณฑ์

- การผลิต

- ผลผลิต

- ส่งเสริม

- ให้

- ให้

- หลาม

- คำสั่ง

- อย่างรวดเร็ว

- R

- พิสัย

- อ่าน

- การอ่าน

- เรียลไทม์

- ระเบียน

- บันทึก

- ที่เกิดขึ้น

- ลดลง

- อ้างอิง

- ความเชื่อถือได้

- มีชื่อเสียง

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- แก้ไข

- แหล่งข้อมูล

- ผล

- ส่งผลให้

- ค้าปลีก

- ลูกค้ารายย่อย

- บทบาท

- วิ่ง

- วิ่ง

- เงินเดือน

- SC

- สกาล่า

- ที่ปรับขนาดได้

- ขอบเขต

- SDK

- ไร้รอยต่อ

- ได้อย่างลงตัว

- ความลับ

- Section

- เห็น

- เลือก

- การเลือก

- เลือก

- ระดับอาวุโส

- บริการ

- ชุดอุปกรณ์

- หลาย

- ที่ใช้ร่วมกัน

- การจัดแสดง

- สำคัญ

- ง่าย

- ลดความซับซ้อน

- ลดความซับซ้อน

- ตั้งแต่

- ช้า

- เรียบเนียน

- ภาพย่อ

- So

- สังคม

- ทางออก

- โซลูชัน

- แก้

- แก้ปัญหา

- แหล่ง

- แหล่งที่มา

- การจัดหา

- ภาคใต้

- จุดประกาย

- ผู้เชี่ยวชาญ

- การใช้จ่าย

- SQL

- ข้อความที่เริ่ม

- ขั้นตอน

- การเก็บรักษา

- เก็บไว้

- เพรียวลม

- คล่องตัว

- เชือก

- แข็งแรง

- ส่ง

- ที่ประสบความสำเร็จ

- ประสบความสำเร็จ

- ที่สนับสนุน

- รองรับ

- ระบบ

- ตาราง

- ทีม

- วิชาการ

- ชั่วคราว

- การทดสอบ

- ที่

- พื้นที่

- ที่มา

- ของพวกเขา

- พวกเขา

- แล้วก็

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- นี้

- ตลอด

- เวลา

- ไปยัง

- ร่วมกัน

- เครื่องมือ

- ตัวเมือง

- ธุรกรรม

- การเดินทาง

- URL

- ใช้

- มือสอง

- การใช้

- ประโยชน์

- ใช้

- การใช้ประโยชน์

- มีคุณค่า

- ผ่านทาง

- คลังสินค้า

- คือ

- ทาง..

- we

- เว็บ

- บริการเว็บ

- คือ

- ในขณะที่

- กับ

- ภายใน

- งาน

- ทำงานด้วยกัน

- เวิร์กโฟลว์

- ขั้นตอนการทำงาน

- การทำงาน

- เขียน

- ปี

- ผล

- เธอ

- ของคุณ

- ลมทะเล

- เป็นศูนย์